- За гранью слов: Как Python открывает нам мир глубокого понимания текста

- Начало пути: Фундаментальные кирпичики NLP

- Основы NLTK: Токенизация и стемминг

- Продвинутая лемматизация и стемминг

- Регулярные выражения (re) в предобработке текста

- Разработка инструмента для очистки текста от HTML-тегов

- Разработка инструмента для нормализации пунктуации

- Разработка инструмента для удаления стоп-слов

- Мощные инструменты в нашем арсенале: Основные библиотеки NLP

- Использование spaCy для быстрого NER (Распознавание именованных сущностей)

- Библиотека Gensim для тематического моделирования (LDA, LSI)

- Сравнение моделей тематического моделирования (LDA vs NMF)

- Применение Scikit-learn для классификации текстов

- Сравнение методов машинного обучения для NLP (SVM, наивный байесовский классификатор)

- Использование TextBlob для простого NLP

- Библиотека TextBlob: ограничения и альтернативы

- Векторизация текста: Превращаем слова в числа

- Разработка собственных векторизаторов текста (CountVectorizer, TfidfVectorizer)

- Word Embeddings: Word2Vec и GloVe с использованием Gensim

- Применение FastText для работы с редкими словами

- Doc2Vec для представления целых документов

- Сравнение различных методов векторизации (TF-IDF vs Word2Vec)

- Глубокое погружение: ОтSentiment Analysis до Трансформеров

- Анализ тональности (Sentiment Analysis) с VADER

- Анализ тональности сообщений в социальных сетях (Twitter/Reddit)

- Трансформеры (Hugging Face) для сложных задач NLP

- Применение PyTorch/TensorFlow для создания нейросетей NLP

- Разработка систем вопросно-ответных систем (QA)

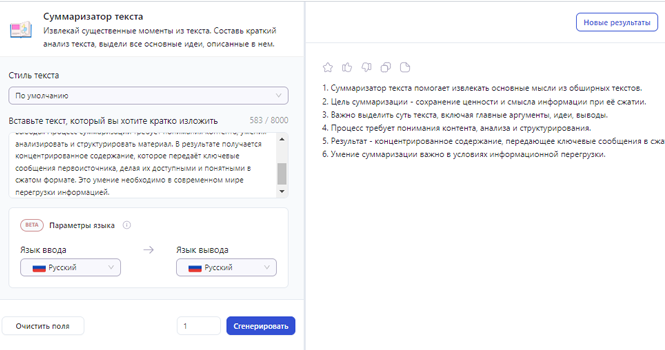

- Разработка системы суммаризации текста (Abstractive vs Extractive)

- Использование Transformer-моделей для генерации текста (GPT)

- Практические приложения и специализированные инструменты

- Библиотека Beautiful Soup для веб-скрейпинга текста

- Обработка многоязычных текстовых корпусов

- Разработка чат-ботов на Python (Rasa framework)

- Анализ текста для извлечения ключевых фраз

- Использование Python для анализа юридических документов

- Разработка систем обнаружения плагиата

- Обработка больших текстовых массивов (Big Data NLP)

- Инструменты для визуализации текстовых данных (Word Clouds, Heatmaps)

- Завершая путешествие: Постоянное развитие и новые горизонты

- Проблемы обработки неполных и ошибочных данных

- Тонкая настройка (Fine-tuning) предварительно обученных моделей

- Оценка качества NER-моделей (F1-score, Precision, Recall)

За гранью слов: Как Python открывает нам мир глубокого понимания текста

Привет, друзья и коллеги по цифровому пространству! Мы живем в эпоху, когда информация льется на нас нескончаемым потоком. Тексты окружают нас повсюду: от сообщений в мессенджерах и постов в социальных сетях до научных статей и юридических документов. Но как нам, простым смертным (или даже продвинутым аналитикам), осмыслить этот океан данных, извлечь из него жемчужины знаний, понять скрытые смыслы и тенденции? Именно здесь на помощь приходит удивительный мир Обработки Естественного Языка (NLP), и, смеем заметить, Python является нашим верным проводником в этом путешествии. Мы, как блогеры, ежедневно сталкиваемся с необходимостью не просто писать, но и понимать, как наши слова воспринимаются, какие темы актуальны, и как вообще работает человеческий язык на машинной уровне.

За последние годы мы стали свидетелями невероятного прорыва в области NLP. То, что еще недавно казалось фантастикой – автоматический перевод, умные чат-боты, анализ тональности отзывов – теперь стало реальностью, доступной каждому, кто готов погрузиться в изучение этого захватывающего направления. Мы хотим поделиться с вами нашим опытом, показать, как, вооружившись Python и его мощными библиотеками, мы можем заставить компьютеры не просто читать, но и понимать человеческую речь. Давайте вместе разберемся в основах и продвинутых техниках, которые открывают двери в мир текстовой аналитики.

Начало пути: Фундаментальные кирпичики NLP

Прежде чем мы сможем научить машину понимать сложные синтаксические конструкции или эмоциональный окрас текста, нам необходимо разбить его на более мелкие, управляемые части. Это похоже на то, как мы учим ребенка сначала буквам, затем словам, а потом уже предложениям. В мире NLP эти базовые операции являются краеугольными камнями любой дальнейшей обработки. Мы говорим о токенизации и стемминге, а также о более утонченной лемматизации.

Основы NLTK: Токенизация и стемминг

Наш путь в NLP часто начинается с NLTK (Natural Language Toolkit) – это, без преувеличения, швейцарский нож для работы с текстом в Python. Именно с его помощью мы делаем первые шаги в предобработке. Токенизация – это процесс разбиения текста на отдельные слова или фразы, которые мы называем токенами. Представьте, что у нас есть предложение: "Мы любим изучать NLP." NLTK легко превратит его в список: ["Мы", "любим", "изучать", "NLP", "."]. Это кажется простым, но это критически важный шаг для любой дальнейшей аналитики.

Стемминг же – это техника уменьшения словоформ до их корневой основы, или "стема". Например, слова "бежать", "бежит", "бегущий" могут быть сведены к одному и тому же стему "беж". Это помогает нам унифицировать данные и снизить размерность признакового пространства, что особенно важно при анализе больших объемов текста. NLTK предлагает несколько стеммеров, таких как PorterStemmer и SnowballStemmer, каждый из которых имеет свои особенности и алгоритмы работы, которые мы активно используем в наших проектах.

Продвинутая лемматизация и стемминг

Хотя стемминг и полезен, он часто приводит к не совсем корректным "словам", которые могут быть нереальными в языке. Например, "красивый" и "красота" могут быть сведены к "красив", что не является настоящим словом. Здесь на помощь приходит лемматизация. В отличие от стемминга, лемматизация преобразует слова к их словарной (базовой) форме, сохраняя при этом их грамматический смысл. Так, слова "бежать", "бежит", "бегущий" будут сведены к "бежать", а "красивый" и "красота" – к "красивый" и "красота" соответственно, что гораздо точнее отражает их морфологию. Мы часто используем SpaCy или NLTK (с WordNetLemmatizer) для более точной лемматизации, особенно когда точность морфологического анализа имеет решающее значение.

Регулярные выражения (re) в предобработке текста

Прежде чем мы даже начнем токенизацию, текст часто нуждается в очистке. В этом нам помогают регулярные выражения (библиотека re в Python). Мы используем их для удаления HTML-тегов, ссылок, специальных символов, цифр, или для поиска определенных паттернов в тексте. Например, если мы анализируем данные из веб-страниц, нам необходимо избавиться от всего лишнего "мусора", который не несет смысловой нагрузки. Это позволяет нам получить чистый, готовый к анализу текст.

Разработка инструмента для очистки текста от HTML-тегов

Представьте, что мы собираем отзывы с веб-сайта. Эти отзывы могут быть обернуты в теги <p>, <div> или содержать ссылки. Регулярные выражения – наш лучший друг в таких ситуациях. Мы можем легко написать функцию, которая с помощью re.sub удалит все эти теги, оставляя только чистый текст. Это незаменимый шаг в предобработке, который мы всегда включаем в наши пайплайны.

Разработка инструмента для нормализации пунктуации

Пунктуация – это еще один аспект, который требует внимания. Иногда нам нужно удалить всю пунктуацию, иногда заменить несколько пробелов на один, иногда привести все к нижнему регистру. Регулярные выражения позволяют нам гибко управлять этими процессами, гарантируя, что наш текст будет унифицирован и готов к дальнейшему анализу без нежелательных артефактов.

Разработка инструмента для удаления стоп-слов

Стоп-слова (предлоги, артикли, союзы и т.д.) часто не несут значимой информации для анализа. Мы используем списки стоп-слов (доступные в NLTK или SpaCy) и регулярные выражения для их удаления. Это значительно сокращает объем данных и повышает эффективность многих NLP-моделей.

Мощные инструменты в нашем арсенале: Основные библиотеки NLP

Теперь, когда мы освоили основы предобработки, давайте углубимся в мир библиотек, которые предоставляют нам гораздо более сложные и мощные функции для анализа текста. Каждая из них имеет свою специализацию, и мы часто комбинируем их для достижения наилучших результатов.

Использование spaCy для быстрого NER (Распознавание именованных сущностей)

Когда речь заходит о скорости и эффективности, spaCy – это наш выбор. Эта библиотека известна своей производительностью и готовыми к использованию предварительно обученными моделями для различных языков, включая русский. Одной из самых впечатляющих возможностей spaCy является Распознавание Именованных Сущностей (NER). Это позволяет нам автоматически идентифицировать и классифицировать такие сущности, как имена людей, организации, географические названия, даты и многое другое в тексте.

Представьте, что нам нужно быстро извлечь все названия компаний из тысяч новостных статей. Вручную это было бы немыслимо, но с spaCy мы можем сделать это за считанные секунды. Мы просто загружаем предварительно обученную модель, передаем ей текст, и она возвращает нам список найденных сущностей с их типами. Это значительно упрощает многие задачи по извлечению информации и автоматизации процессов.

Библиотека Gensim для тематического моделирования (LDA, LSI)

Иногда нам нужно понять, о чем идет речь в большом корпусе текстов, не читая каждый из них. Здесь на помощь приходит тематическое моделирование, и Gensim – это наш основной инструмент для этого. Gensim позволяет нам обнаруживать абстрактные "темы", которые присутствуют в коллекции документов. Двумя наиболее популярными алгоритмами, которые мы используем, являются Latent Dirichlet Allocation (LDA) и Latent Semantic Indexing (LSI).

LDA и LSI анализируют встречаемость слов в документах и их взаимные связи, чтобы выявить скрытые структуры. Например, если мы проанализируем корпус новостных статей, LDA может обнаружить темы, такие как "политика", "спорт", "экономика" и "технологии", и показать, какие слова наиболее характерны для каждой темы. Мы используем это для категоризации документов, анализа отзывов или понимания общей направленности дискуссий.

Сравнение моделей тематического моделирования (LDA vs NMF)

Помимо LDA, существует и Неотрицательная Матричная Факторизация (NMF), которая также является мощным инструментом для тематического моделирования. Мы часто проводим сравнительный анализ этих моделей, чтобы понять, какая из них лучше подходит для конкретной задачи и набора данных. LDA обычно хорошо работает с разреженными данными и имеет вероятностную основу, в то время как NMF часто дает более интерпретируемые темы, особенно когда у нас есть явные паттерны в частотности слов. Выбор зависит от характеристик корпуса и целей анализа.

Применение Scikit-learn для классификации текстов

Когда нам нужно автоматически распределить тексты по заданным категориям (например, спам/не спам, позитивный/негативный отзыв, спорт/политика), мы обращаемся к Scikit-learn. Эта библиотека – стандарт де-факто для машинного обучения в Python, и она предлагает широкий спектр алгоритмов для классификации текстов.

Наш процесс обычно включает следующие шаги:

- Векторизация текста: Преобразование текстовых данных в числовые векторы.

- Обучение модели: Использование размеченного набора данных для обучения классификатора.

- Прогнозирование: Применение обученной модели для классификации новых, неразмеченных текстов.

Мы успешно применяли такие алгоритмы, как Наивный Байесовский классификатор, Метод Опорных Векторов (SVM) и Логистическая Регрессия из Scikit-learn для решения различных задач классификации, от фильтрации комментариев до автоматической категоризации новостных статей.

Сравнение методов машинного обучения для NLP (SVM, наивный байесовский классификатор)

Выбор правильного алгоритма для классификации текста может существенно повлиять на результат. Мы часто сравниваем производительность различных моделей:

| Метод | Преимущества | Недостатки | Типичные сценарии применения |

|---|---|---|---|

| Наивный Байесовский классификатор | Прост, быстр, хорошо работает с небольшими наборами данных и высокой размерностью. | Предполагает независимость признаков (что редко в тексте). | Фильтрация спама, анализ тональности, классификация коротких текстов. |

| Метод Опорных Векторов (SVM) | Эффективен в пространствах высокой размерности, хорошо работает с разреженными данными. | Чувствителен к выбору параметров и масштабированию данных. | Классификация больших текстовых корпусов, анализ документов. |

| Логистическая Регрессия | Прост в интерпретации, хорошо масштабируется, дает вероятности классов. | Может быть менее эффективен на нелинейных данных. | Бинарная классификация, предсказание вероятности. |

Мы всегда проводим кросс-валидацию и оцениваем метрики (Precision, Recall, F1-score) для выбора наиболее подходящей модели.

Использование TextBlob для простого NLP

Для быстрых и простых задач NLP, таких как анализ тональности, извлечение n-грамм или определение языка, TextBlob становится нашим незаменимым помощником. Это высокоуровневая библиотека, построенная на базе NLTK, которая позволяет выполнять многие операции с текстом в интуитивно понятном виде. Мы часто используем TextBlob для первоначального исследования текстовых данных или для прототипирования небольших функций.

Например, определить тональность отзыва о продукте с TextBlob можно буквально в одну строку кода, что делает его идеальным для быстрых демонстраций или для тех, кто только начинает свой путь в NLP и не хочет сразу погружаться в сложности более низкоуровневых библиотек.

Библиотека TextBlob: ограничения и альтернативы

Несмотря на свою простоту и удобство, TextBlob имеет и свои ограничения. Мы обнаружили, что для более сложных задач, требующих высокой точности (например, NER или глубокий синтаксический анализ), он может быть недостаточно мощным. Его модели тональности в основном ориентированы на английский язык, и для других языков его эффективность снижается. В таких случаях мы переключаемся на более специализированные библиотеки, такие как SpaCy для NER, NLTK для детального морфологического анализа или Transformer-модели для многоязычного анализа.

Векторизация текста: Превращаем слова в числа

Компьютеры не "понимают" слова в том смысле, в каком понимаем их мы. Для них это просто последовательности символов. Чтобы машина могла работать с текстом, нам необходимо преобразовать его в числовой формат – векторы. Это называется векторизацией текста, и это один из ключевых этапов в любом пайплайне NLP.

Разработка собственных векторизаторов текста (CountVectorizer, TfidfVectorizer)

Мы активно используем и даже "подстраиваем" под свои нужды стандартные векторизаторы из Scikit-learn:

CountVectorizer: Этот векторизатор просто подсчитывает частоту встречаемости каждого слова в документе. Он создает матрицу, где строки – это документы, а столбцы – уникальные слова (токены) из всего корпуса, и значения в ячейках – это количество раз, которое слово встречается в документе. Мы находим его полезным для задач, где абсолютная частота слова имеет значение.TfidfVectorizer: Более продвинутый вариант, который использует метрику TF-IDF (Term Frequency-Inverse Document Frequency). Она не только учитывает, как часто слово встречается в документе (TF), но и насколько оно уникально для этого документа по сравнению со всем корпусом (IDF). Это помогает нам выделить слова, которые действительно характеризуют документ, а не просто являются общими для всех текстов (например, "и", "но", "в"). Мы предпочитаем TF-IDF для большинства задач классификации и тематического моделирования, так как он обычно дает лучшие результаты.

Word Embeddings: Word2Vec и GloVe с использованием Gensim

Простые векторизаторы, такие как TF-IDF, не учитывают семантические отношения между словами. То есть, слова "король" и "королева" будут считаться столь же далекими, как "король" и "банан". Здесь в игру вступают Word Embeddings – векторные представления слов, которые улавливают их семантический смысл.

Мы активно используем Word2Vec и GloVe, часто с помощью библиотеки Gensim. Word2Vec, разработанный Google, может быть обучен на больших текстовых корпусах и создает плотные векторы, где слова с похожим значением расположены близко друг к другу в многомерном пространстве; Удивительно, но с помощью этих векторов мы можем выполнять операции, такие как "король" ౼ "мужчина" + "женщина" ≈ "королева". GloVe (Global Vectors for Word Representation) – еще один популярный подход, который сочетает в себе преимущества методов на основе частотности и предсказания. Эти эмбеддинги стали настоящим прорывом в NLP и позволяют нам создавать модели, которые "понимают" контекст.

Применение FastText для работы с редкими словами

Одним из недостатков Word2Vec и GloVe является их неспособность эффективно работать с редкими словами или словами, не встречавшимися в обучающем корпусе. Для решения этой проблемы мы используем FastText от Facebook. FastText не просто создает векторы для целых слов, но и учитывает их субсловарные единицы (n-граммы символов). Это позволяет ему генерировать осмысленные векторы даже для опечаток, редких слов или слов, которых он "не видел" полностью, что особенно ценно при работе с "грязными" данными или многоязычными текстами.

Doc2Vec для представления целых документов

Если нам нужно получить векторное представление не отдельного слова, а целого документа или предложения, мы обращаемся к Doc2Vec (также известному как Paragraph Vector), который является расширением Word2Vec. Doc2Vec создает плотные векторы, которые отражают смысл всего документа, что позволяет нам сравнивать документы по их содержанию, кластеризовать их или использовать в качестве признаков для классификации. Мы активно используем Doc2Vec для анализа больших массивов текстов, где необходимо понимать общую тему и смысл.

Сравнение различных методов векторизации (TF-IDF vs Word2Vec)

Выбор метода векторизации сильно зависит от задачи.

- TF-IDF: Прост, быстр, хорошо подходит для задач, где важна уникальность слова в документе. Не учитывает семантику.

- Word2Vec/GloVe: Учитывают семантику, могут быть предварительно обучены на огромных корпусах. Требуют больше данных и вычислительных ресурсов для обучения.

- FastText: Хорош для редких слов, учитывает субсловарные единицы.

- Doc2Vec: Векторизует целые документы, улавливая их общий смысл.

Мы часто начинаем с TF-IDF для базовых моделей, а затем переходим к Word Embeddings для более сложных задач, где семантический контекст играет ключевую роль.

Глубокое погружение: ОтSentiment Analysis до Трансформеров

С базовыми инструментами и методами векторизации мы уже можем решать множество задач. Но мир NLP не стоит на месте, и последние годы принесли нам революционные прорывы, особенно в области глубокого обучения. Мы с энтузиазмом осваиваем эти новые горизонты.

Анализ тональности (Sentiment Analysis) с VADER

Понимание эмоциональной окраски текста – это одна из самых востребованных задач в NLP. Будь то отзывы клиентов, посты в социальных сетях или новостные заголовки, знание тональности позволяет нам быстро оценить общественное мнение или реакцию. Мы часто используем VADER (Valence Aware Dictionary and sEntiment Reasoner) – лексикон и инструмент для анализа тональности, который специально разработан для текстов из социальных сетей.

VADER уникален тем, что он не требует обучения на данных и очень хорошо справляется с сленгом, эмодзи и акронимами, которые часто встречаются в неформальном общении. Он выдает не только общую полярность (положительную, отрицательную, нейтральную), но и составной балл, который позволяет нам более тонко оценивать степень эмоциональной выраженности. Это наш стартовый инструмент для быстрого анализа тональности.

Анализ тональности сообщений в социальных сетях (Twitter/Reddit)

Мы регулярно применяем анализ тональности для мониторинга социальных сетей. Например, когда мы запускаем новую рекламную кампанию или продукт, мы собираем упоминания в Twitter или Reddit и используем VADER (или более сложные Transformer-модели) для оценки реакции пользователей. Это дает нам ценную обратную связь в реальном времени, позволяя быстро реагировать на проблемы или усилить позитивные моменты. Мы также анализируем тональность финансовых новостей, чтобы понять, как информационный фон может влиять на рыночные настроения.

Трансформеры (Hugging Face) для сложных задач NLP

Если Word Embeddings стали прорывом, то Трансформеры произвели настоящую революцию в NLP. Благодаря библиотеке Hugging Face Transformers, мы получили доступ к мощнейшим предварительно обученным моделям, таким как BERT, GPT, RoBERTa и многим другим. Эти модели способны улавливать сложнейшие контекстные зависимости в тексте, что позволяет им достигать беспрецедентной точности в таких задачах, как вопросно-ответные системы, машинный перевод, суммаризация и даже генерация текста.

Мы используем Hugging Face для самых требовательных проектов. Например, для создания систем, которые могут отвечать на вопросы по большому массиву документов, или для тонкой настройки (Fine-tuning) моделей под специфические задачи, такие как распознавание очень специфических сущностей в юридических текстах или анализ тональности с учетом сарказма. Это требует больше вычислительных ресурсов, но результаты оправдывают вложения.

"Проблема понимания естественного языка является одной из самых сложных в области искусственного интеллекта."

Применение PyTorch/TensorFlow для создания нейросетей NLP

Когда стандартных моделей и библиотек становится недостаточно, или когда нам нужно реализовать совершенно новую архитектуру, мы обращаемся к фреймворкам глубокого обучения, таким как PyTorch и TensorFlow. Эти мощные инструменты позволяют нам создавать и обучать собственные нейронные сети с нуля, будь то рекуррентные нейронные сети (RNN), LSTM-сети или более сложные Transformer-архитектуры.

Мы используем PyTorch/TensorFlow для исследовательских проектов, где требуется максимальная гибкость, или для работы с очень специфическими и большими наборами данных, где тонкая настройка модели имеет решающее значение. Например, мы можем создать LSTM-сеть для анализа временных рядов в текстовых данных, чтобы предсказывать изменения в настроениях рынка на основе новостных заголовков.

Разработка систем вопросно-ответных систем (QA)

Вопросно-ответные системы (QA) – это один из самых впечатляющих примеров применения NLP. Они позволяют пользователям задавать вопросы на естественном языке и получать точные ответы из большого корпуса документов. Мы разрабатываем такие системы, используя продвинутые Transformer-модели, которые могут "читать" текст и находить в нем релевантные фрагменты, содержащие ответы. Это похоже на то, как если бы вы задали вопрос человеку, который прочитал сотни книг и мгновенно нашел нужную информацию.

Мы видим огромный потенциал QA-систем в клиентской поддержке, анализе юридических документов, доступе к корпоративным знаниям и многом другом, и активно работаем над их улучшением, используя PyTorch и Hugging Face.

Разработка системы суммаризации текста (Abstractive vs Extractive)

Слишком много текста, слишком мало времени. Эта проблема знакома каждому. Суммаризация текста призвана ее решить. Мы работаем с двумя основными подходами:

- Экстрактивная суммаризация: Извлекает наиболее важные предложения или фразы из оригинального текста и объединяет их в краткое изложение. Это как выделить ключевые моменты маркером. Мы используем такие библиотеки, как TextRank для этого.

- Абстрактивная суммаризация: Генерирует совершенно новый текст, который передает основную суть оригинала, но использует свои собственные формулировки. Это гораздо более сложная задача, требующая глубокого понимания языка, и мы решаем ее с помощью продвинутых Transformer-моделей (например, T5 или BART) из Hugging Face.

Использование Transformer-моделей для генерации текста (GPT)

Генерация текста – это, пожалуй, одна из самых захватывающих областей NLP. С появлением таких моделей, как GPT (Generative Pre-trained Transformer), мы получили возможность создавать тексты, которые практически неотличимы от написанных человеком. Мы используем эти модели для самых разных целей: от помощи в написании статей и создании маркетинговых текстов до генерации диалогов для чат-ботов и даже кода.

Конечно, это мощный инструмент, требующий ответственного подхода. Мы всегда помним о необходимости проверки сгенерированного контента на фактологическую точность и этичность, но его потенциал для автоматизации творческих задач огромен.

Практические приложения и специализированные инструменты

NLP – это не только теория и алгоритмы, это еще и огромный набор практических инструментов и подходов, которые позволяют нам решать реальные задачи в различных областях. Мы постоянно расширяем наш арсенал, исследуя новые библиотеки и методы.

Библиотека Beautiful Soup для веб-скрейпинга текста

Перед тем как анализировать текст, его нужно откуда-то получить. Часто источником являются веб-сайты. Beautiful Soup – это наша незаменимая библиотека для веб-скрейпинга. Она позволяет нам легко парсить HTML- и XML-документы, извлекать из них нужный текст, ссылки, заголовки и другие элементы. Это первый шаг в создании многих наших датасетов для NLP.

Обработка многоязычных текстовых корпусов

Мир не ограничивается одним языком, и наши проекты тоже. Мы активно работаем с многоязычными текстовыми корпусами, что требует особого подхода. Библиотеки, такие как Polyglot и Stanza, становятся нашими главными помощниками. Polyglot позволяет нам работать с широким спектром языков для токенизации, NER, анализа тональности и определения языка. Stanza, разработанная Stanford NLP Group, предлагает высокоточные модели для различных языков, включая русский, с продвинутыми функциями, такими как синтаксический парсинг и морфологический анализ.

Разработка чат-ботов на Python (Rasa framework)

Чат-боты стали повсеместными, и мы тоже приложили руку к их созданию. Для разработки сложных, контекстно-зависимых чат-ботов мы используем фреймворк Rasa. Rasa предоставляет полный стек для создания разговорных ИИ: от понимания естественного языка (NLU) до управления диалогами. Это позволяет нам создавать ботов, которые не просто отвечают на вопросы, но и ведут осмысленный диалог, запоминают контекст и даже могут выполнять действия.

Анализ текста для извлечения ключевых фраз

Извлечение ключевых фраз – это задача, которая помогает нам быстро понять основную суть документа. Мы используем различные подходы, такие как TF-IDF для выделения наиболее значимых слов, или более продвинутые алгоритмы, такие как RAKE (Rapid Automatic Keyword Extraction) и TextRank, которые строят графы слов и предложений для выявления наиболее важных терминов и даже целых предложений. TextRank, например, вдохновлен алгоритмом PageRank и отлично подходит для суммаризации и извлечения ключевых слов.

Использование Python для анализа юридических документов

Юридические документы – это отдельный мир со своей спецификой. Они полны сложной терминологии, длинных предложений и требуют высокой точности в обработке. Мы применяем NLP для таких задач, как извлечение ключевых сущностей (даты, стороны контракта, условия), автоматическая категоризация документов, поиск схожих прецедентов и даже для суммаризации длинных контрактов. Это значительно ускоряет работу юристов и снижает риск ошибок.

Разработка систем обнаружения плагиата

В академической и издательской сферах проблема плагиата стоит остро. Мы разрабатываем системы обнаружения плагиата, которые сравнивают тексты между собой или с большой базой данных существующих документов. Используя различные метрики сходства (например, на основе TF-IDF, Doc2Vec или даже Transformer-моделей) и библиотеки, такие как Textdistance, мы можем выявлять подозрительные совпадения и оценивать степень оригинальности текста.

Обработка больших текстовых массивов (Big Data NLP)

Когда речь идет о терабайтах текстовых данных, обычные подходы уже не работают. Для Big Data NLP мы используем распределенные вычислительные системы и библиотеки, оптимизированные для работы с большими объемами. Gensim, например, хорошо масштабируется для обучения Word2Vec или LDA на больших корпусах. Мы также интегрируем наши NLP-пайплайны с фреймворками, такими как Apache Spark, для параллельной обработки данных, что позволяет нам анализировать огромные массивы информации, например, все твиты за год или тысячи судебных решений.

Инструменты для визуализации текстовых данных (Word Clouds, Heatmaps)

Числа и графики могут быть убедительны, но визуализация текстовых данных помогает нам и другим быстро уловить основные паттерны. Мы используем различные инструменты для создания:

- Облаков слов (Word Clouds): Для быстрого отображения наиболее часто встречающихся слов в тексте, где размер слова пропорционален его частоте.

- Тепловых карт (Heatmaps): Для визуализации матриц сходства между документами или для отображения распределения тональности по временным интервалам.

- Графов: Для представления связей между сущностями, найденными в тексте.

Эти визуализации делают результаты нашего анализа более понятными и доступными для широкой аудитории.

Завершая путешествие: Постоянное развитие и новые горизонты

Мир NLP невероятно динамичен. То, что было передовым вчера, сегодня уже становится стандартом, а завтра – историей. Мы постоянно учимся, экспериментируем и внедряем новые технологии, чтобы оставаться на переднем крае.

Проблемы обработки неполных и ошибочных данных

Реальный мир редко бывает идеальным. Мы постоянно сталкиваемся с неполными и ошибочными данными: опечатки, грамматические ошибки, пропущенные символы, неформальный язык. Это создает серьезные вызовы для NLP. Мы разрабатываем и применяем различные стратегии для очистки и нормализации таких данных, используем устойчивые к шуму модели (например, FastText), а также инструменты для исправления орфографии и грамматики. Это трудоемкий, но критически важный этап для получения надежных результатов.

Тонкая настройка (Fine-tuning) предварительно обученных моделей

Одним из самых мощных подходов в современном NLP является тонкая настройка (Fine-tuning) предварительно обученных Transformer-моделей. Вместо того чтобы обучать модель с нуля, мы берем уже мощную модель (например, BERT или GPT), которая была обучена на огромных объемах текста, и "дообучаем" ее на небольшом, специфичном для нашей задачи наборе данных. Это позволяет нам достигать высокой точности с относительно небольшим количеством размеченных данных, что экономит время и ресурсы. Мы активно используем этот подход для адаптации моделей к конкретным доменам, будь то медицина, юриспруденция или финансы.

Оценка качества NER-моделей (F1-score, Precision, Recall)

Любая модель хороша настолько, насколько хорошо мы можем оценить ее производительность. Для NER-моделей мы используем стандартные метрики:

- Precision (точность): Доля правильно предсказанных сущностей среди всех сущностей, которые модель предсказала.

- Recall (полнота): Доля правильно предсказанных сущностей среди всех истинных сущностей в данных.

- F1-score: Гармоническое среднее Precision и Recall, которое дает сбалансированную оценку производительности модели.

Мы всегда проводим тщательную оценку, чтобы убедиться, что наши модели соответствуют требуемым стандартам качества.

Наше путешествие в мире NLP с Python – это бесконечный процесс открытий и обучения. От базовой токенизации до сложнейших Transformer-моделей, мы видим, как технологии преобразуют наше взаимодействие с текстом. Мы надеемся, что этот обзор вдохновил вас и показал богатство возможностей, которые открывает перед нами Python в области обработки естественного языка. Не бойтесь экспериментировать, пробовать новое и погружаться в этот захватывающий мир!

Подробнее

| Python библиотеки для токенизации текста | Использование spaCy для NER | Тематическое моделирование LDA Gensim | Scikit-learn для классификации текста | Word2Vec и GloVe в NLP |

| Анализ тональности с VADER Python | Разработка векторизаторов текста | Предобработка текста регулярными выражениями | Трансформеры Hugging Face для NLP | Создание чат-ботов на Python Rasa |