- Путешествие в Мир Слов: Как Мы Осваиваем Язык Машин с Python и NLP

- Основы, Без Которых Никуда: Первые Шаги в Мире Текста

- Подготовка Текста: От Сырых Данных к Структурированной Информации

- Осмысление Текста: Извлечение Сущностей и Тональности

- Представление Текста для Машин: Векторизация

- Глубокий Анализ и Современные Подходы: От Классификации до Генерации

- Классификация и Тематическое Моделирование

- Извлечение Информации и Суммаризация

- Эра Трансформеров и Глубокого Обучения

- Практические Приложения и Вызовы

- Разработка Инструментов и Систем

- Работа с "Неидеальными" Данными

- Визуализация и Оценка

- Будущее NLP: Куда Мы Движемся

Путешествие в Мир Слов: Как Мы Осваиваем Язык Машин с Python и NLP

Привет, дорогие читатели и коллеги по цеху! Сегодня мы хотим поделиться с вами нашим захватывающим опытом погружения в мир обработки естественного языка (NLP) с помощью Python․ Это не просто рассказ о технических аспектах; это целое приключение, где мы учимся заставлять машины понимать, интерпретировать и даже генерировать человеческую речь․ Мы убеждены, что каждый, кто хоть раз задумывался о том, как поисковики так точно находят нужную информацию, как чат-боты отвечают на наши вопросы или как системы анализируют тональность отзывов, найдет для себя что-то невероятно ценное в этом материале․ Мы пройдемся по ключевым инструментам, концепциям и практическим задачам, которые формируют фундамент современного NLP․

Мы помним наши первые шаги в этой области – это было похоже на попытку понять язык совершенно новой цивилизации․ Сначала казалось, что текст – это просто набор символов․ Но очень быстро мы осознали, что за каждым словом, за каждой фразой стоит огромный пласт информации, контекста и смысла; Именно этот вызов, эта многогранность и притягательность языка заставляют нас снова и снова углубляться в мир NLP․ Мы видим, как с каждым днем технологии становятся все умнее, а возможности, которые они открывают, – все шире․ Давайте вместе разберемся, как мы можем использовать мощь Python для анализа и обработки текста, превращая его из хаотичного потока данных в структурированный и ценный ресурс․

Основы, Без Которых Никуда: Первые Шаги в Мире Текста

Наше путешествие в NLP всегда начинается с самых азов, с того, как мы вообще можем "разрезать" текст на удобоваримые кусочки․ Это похоже на то, как ребенок учится разбирать слова на буквы, а предложения на слова․ В мире NLP этот процесс называется токенизацией․ Мы используем такие библиотеки, как NLTK (Natural Language Toolkit) и spaCy, чтобы превратить непрерывный поток символов в отдельные слова или предложения, которые уже можно анализировать․ NLTK, например, предлагает множество готовых токенизаторов, а spaCy известен своей скоростью и эффективностью, особенно для больших объемов данных․

Но токенизация – это только начало․ Язык полон изгибов: у слов есть разные формы (бежать, бегу, бежал), и для корректного анализа нам нужно привести их к одной базовой форме․ Здесь на помощь приходят стемминг и лемматизация․ Стемминг (например, с помощью алгоритма Портера из NLTK) просто отсекает окончания, пытаясь найти "корень" слова, что иногда приводит к не очень "красивым" результатам (например, "красивый" -> "красив")․ Лемматизация, в свою очередь, гораздо умнее: она использует словари и морфологический анализ, чтобы привести слово к его словарной форме (например, "бегу" -> "бежать", "были" -> "быть")․ Мы предпочитаем лемматизацию с spaCy или продвинутыми инструментами NLTK, так как она дает более точные и осмысленные результаты, что критически важно для дальнейшего анализа․

Невозможно говорить о предобработке текста, не упомянув регулярные выражения (модуль re в Python)․ Это наш швейцарский армейский нож для очистки данных: удаления лишних символов, ссылок, HTML-тегов, чисел или приведения текста к нижнему регистру․ Мы часто сталкиваемся с "грязными" данными, и без re наша работа была бы гораздо сложнее и дольше․ Представьте, что вы собираете текст из интернета (например, с помощью Beautiful Soup для веб-скрейпинга): там будет много шума в виде HTML-тегов, скриптов и стилей․ Регулярные выражения позволяют нам эффективно отфильтровать все лишнее, оставляя только чистый, пригодный для анализа текст․

Для тех, кто только начинает или кому нужен быстрый и простой инструмент для базовых задач, мы всегда рекомендуем TextBlob․ Эта библиотека построена поверх NLTK и предлагает интуитивно понятный API для токенизации, POS-теггинга (определения частей речи), анализа тональности и даже перевода․ Она идеально подходит для прототипирования и небольших проектов, где нет необходимости в глубокой кастомизации или максимальной производительности․ Мы сами часто используем TextBlob для быстрого получения общего представления о текстовых данных․

Подготовка Текста: От Сырых Данных к Структурированной Информации

Предобработка текста — это, пожалуй, самый важный, но часто недооцениваемый этап в любом проекте NLP․ Это фундамент, на котором мы строим все остальное․

- Очистка Данных: Мы удаляем HTML-теги, специальные символы, числа (если они не важны для задачи), URL-адреса и приводим весь текст к нижнему регистру․ Это помогает унифицировать данные и снизить размер словаря․

- Стоп-слова: Избавление от стоп-слов (артиклей, предлогов, союзов — слов, которые часто встречаются, но не несут существенного смыслового значения) — еще один критический шаг․ NLTK предоставляет списки стоп-слов для многих языков, но мы часто создаем или расширяем их, исходя из специфики нашей задачи․

- Токенизация: Как мы уже упоминали, разделение текста на слова или предложения․

- Лемматизация/Стемминг: Приведение слов к их базовой форме․

- Обработка Многоязычных Корпусов: Работа с текстами на разных языках требует особого подхода․ Библиотеки вроде Polyglot или Stanza (последняя особенно хороша для языков с богатой морфологией, как русский) позволяют нам выполнять токенизацию, лемматизацию и POS-теггинг для нелатинских алфавитов и сложных языков․ Мы часто сталкиваемся с задачей анализа текстов из разных стран, и эти инструменты становятся незаменимыми․

Вот как мы можем представить основные шаги предобработки:

| Этап Предобработки | Описание | Примеры Инструментов |

|---|---|---|

| Очистка | Удаление шума: HTML-теги, пунктуация, числа, символы․ | re (регулярные выражения) |

| Нормализация | Приведение к нижнему регистру, работа с эмодзи и сленгом․ | Строковые методы Python, пользовательские функции |

| Токенизация | Разбиение текста на слова или предложения․ | NLTK, spaCy |

| Удаление стоп-слов | Исключение частотных, но малоинформативных слов․ | NLTK, пользовательские списки |

| Лемматизация/Стемминг | Приведение слов к базовой форме․ | NLTK, spaCy, Stanza |

Осмысление Текста: Извлечение Сущностей и Тональности

После того как текст очищен и структурирован, мы переходим к его осмыслению․ Одной из самых фундаментальных задач в NLP является распознавание именованных сущностей (NER)․ Представьте, что у вас есть огромный объем текста, и вам нужно быстро понять, о каких людях, организациях, местах или датах там идет речь․ Это именно то, что делает NER․ Мы активно используем spaCy для быстрого и точного NER, так как она поставляется с предварительно обученными моделями, которые отлично справляются с этой задачей․ Для более сложных сценариев или языков, где стандартные модели менее эффективны, мы обращаемся к Flair или даже к методам на основе CRF (Conditional Random Fields), которые позволяют нам обучать собственные модели распознавания сущностей․

Мы также очень любим анализировать тональность (Sentiment Analysis)․ Это позволяет нам понять эмоциональную окраску текста – позитивную, негативную или нейтральную․ Это бесценно для анализа отзывов клиентов, постов в социальных сетях (например, Twitter/Reddit) или новостей․ Мы часто начинаем с простого, но эффективного инструмента VADER (Valence Aware Dictionary and sEntiment Reasoner) из NLTK, который отлично работает с английским языком, особенно для коротких текстов из социальных сетей․ Для более глубокого анализа, особенно с учетом сарказма или контекста, мы переходим к моделям машинного обучения, построенным с помощью Scikit-learn или даже нейросетей на PyTorch/TensorFlow, которые мы обучаем на размеченных данных․ TextBlob также предлагает простой анализатор тональности, который удобен для быстрых проверок․

В середине нашего пути по освоению этих мощных инструментов, мы часто вспоминаем, как важно не просто применять технологии, но и понимать их ограничения․

"Машины могут делать работу, машины могут решать проблемы, но только человек может ставить вопросы․"

— Пол Валери

Эта цитата напоминает нам, что наша роль как аналитиков и разработчиков состоит не только в эффективном использовании инструментов, но и в формулировании правильных вопросов к данным, чтобы получить действительно ценные ответы․

Представление Текста для Машин: Векторизация

Машины не понимают слов в их лингвистическом смысле; они работают с числами․ Поэтому нам нужно преобразовать текст в числовые векторы – этот процесс называется векторизацией․ Мы используем несколько подходов:

- CountVectorizer и TfidfVectorizer: Это базовые, но очень мощные инструменты из Scikit-learn․ CountVectorizer просто считает частоту каждого слова в документе․ TfidfVectorizer идет дальше, взвешивая частоту слова в документе по его обратной частоте во всем корпусе (TF-IDF), что помогает выделить более значимые слова․ Мы часто начинаем с них для задач классификации текстов․

- Word Embeddings (Word2Vec, GloVe, FastText): Это более продвинутые методы, которые позволяют словам быть представленными в виде плотных векторов в многомерном пространстве, где слова со схожим значением находятся ближе друг к другу․ Мы используем Gensim для работы с Word2Vec и GloVe, а также FastText, который особенно хорош для языков с богатой морфологией и для работы с редкими словами, так как он учитывает подслова․ Эти эмбеддинги позволяют машинам "понимать" семантическую близость слов․

- Doc2Vec и Sentence Transformers: Если нам нужно получить векторное представление не отдельного слова, а целого документа или предложения, мы обращаемся к Doc2Vec (расширение Word2Vec) или к Sentence Transformers․ Последние, основанные на трансформерных архитектурах, дают очень качественные контекстуальные эмбеддинги предложений, что невероятно полезно для поиска семантически схожих документов или вопросов․

- Контекстуальные Встраивания (BERT, ELMo): С появлением трансформеров, таких как BERT (Bidirectional Encoder Representations from Transformers), мы получили возможность генерировать контекстуальные эмбеддинги․ Это означает, что одно и то же слово может иметь разное векторное представление в зависимости от окружающего его контекста․ Мы используем Hugging Face Transformers для работы с BERT и его многочисленными вариациями, что открывает новые горизонты для таких задач, как NER, классификация и вопросно-ответные системы․

Глубокий Анализ и Современные Подходы: От Классификации до Генерации

Когда у нас есть числовые представления текста, мы можем применять мощные алгоритмы машинного обучения․

Классификация и Тематическое Моделирование

Классификация текстов – это одна из самых распространенных задач, с которой мы сталкиваемся․ Будь то категоризация статей по темам, определение спама, или фильтрация комментариев, мы часто используем Scikit-learn․ Здесь мы экспериментируем с различными алгоритмами: от простых, но эффективных наивных байесовских классификаторов и SVM (машин опорных векторов) до более сложных логистических регрессий и градиентного бустинга․ Для высокопроизводительных задач и работы с большими объемами данных мы переходим к нейронным сетям, реализуемым с помощью PyTorch или TensorFlow, особенно к LSTM-сетям или моделям на основе трансформеров․

Помимо классификации, мы активно применяем тематическое моделирование, чтобы автоматически обнаруживать скрытые темы в больших коллекциях документов․ Для этого мы используем библиотеку Gensim, которая предоставляет реализации таких алгоритмов, как LDA (Латентное размещение Дирихле) и LSI (Латентное семантическое индексирование)․ Мы часто сравниваем LDA с NMF (Неотрицательная матричная факторизация), чтобы выбрать наиболее подходящую модель для конкретной задачи․ Тематическое моделирование позволяет нам понять, о чем говорят пользователи в отзывах, какие тренды появляются в новостях или какие ключевые концепции присутствуют в юридических документах․

Извлечение Информации и Суммаризация

Извлечение ключевых фраз и слов – еще одна важная задача․ Мы используем такие алгоритмы, как RAKE (Rapid Automatic Keyword Extraction) или TextRank, чтобы автоматически выделить наиболее значимые термины из текста․ Это очень полезно для создания тегов, индексации документов или быстрого обзора содержания․

Суммаризация текста – это процесс создания краткого, но информативного изложения длинного документа․ Мы различаем два основных подхода:

- Экстрактивная суммаризация: Мы выбираем наиболее важные предложения из исходного текста и объединяем их․ TextRank может быть использован и для этой цели․

- Абстрактивная суммаризация: Мы генерируем новый текст, который передает суть оригинала, но не обязательно содержит его оригинальные предложения․ Это более сложная задача, требующая использования продвинутых моделей, часто основанных на трансформерах (например, с помощью Hugging Face)․

Мы часто сравниваем эти подходы, чтобы определить, какой из них лучше подходит для конкретных нужд, например, для создания кратких обзоров новостей или аннотаций к научным статьям․

Эра Трансформеров и Глубокого Обучения

Последние годы ознаменовались революцией в NLP благодаря архитектурам Трансформеров․ Мы активно используем библиотеку Hugging Face Transformers, которая предоставляет доступ к сотням предварительно обученных моделей (BERT, GPT, RoBERTa, T5 и многие другие)․ Эти модели изменили наш подход к решению сложных задач:

- Классификация: Тонкая настройка (Fine-tuning) BERT для классификации текстов дает нам результаты, которые раньше были недостижимы․

- NER: Трансформеры значительно улучшили качество распознавания именованных сущностей․

- Генерация Текста: С моделями вроде GPT-2 и GPT-3 мы можем генерировать связные и осмысленные тексты, будь то диалоги для чат-ботов, перефразирование предложений или даже создание кода․

- Машинный Перевод: Трансформеры стали основой для самых современных систем машинного перевода, и мы используем их для разработки собственных решений, в т․ч․ для узкоспециализированных текстов․

- Вопросно-ответные Системы (QA): Создание систем, которые могут отвечать на вопросы на основе предоставленного текста или базы знаний, стало намного проще и эффективнее благодаря этим моделям․

Мы также не забываем про PyTorch и TensorFlow для создания собственных нейросетей, когда нам требуется максимальная гибкость и контроль над архитектурой, например, для разработки систем машинного перевода или анализа стилистики текстов․

Практические Приложения и Вызовы

NLP – это не только академические исследования, но и множество реальных применений, с которыми мы сталкиваемся ежедневно․

Разработка Инструментов и Систем

Мы активно работаем над созданием различных инструментов на основе NLP:

- Чат-боты: С помощью фреймворков вроде Rasa мы разрабатываем умных чат-ботов, способных понимать естественный язык и вести диалог․

- Системы обнаружения плагиата: Используя методы сравнения строк (например, с библиотекой Jellyfish или Textdistance) и векторизации документов, мы строим системы для выявления сходства между текстами․

- Проверка грамматики и орфографии: Разрабатываем инструменты для автоматического исправления ошибок, что критично для контентных платформ․

- Извлечение фактов: Создаем системы, которые могут автоматически извлекать даты, числа, события и связи между сущностями из новостей или юридических документов․

- Анализ юридических и медицинских документов: Это сложная, но очень востребованная область․ Мы используем Python и NLP для автоматического извлечения ключевой информации из контрактов, заключений и историй болезней․

- Автоматическое тегирование и категоризация контента: Для блогов, новостных порталов или систем управления знаниями мы разрабатываем решения, которые автоматически присваивают теги и категории статьям․

Работа с "Неидеальными" Данными

В реальном мире данные редко бывают чистыми и идеальными․ Мы постоянно сталкиваемся с проблемами:

- Неполные и ошибочные данные: Пропущенные значения, опечатки, некорректная разметка – все это требует тщательной предобработки и robustных моделей․

- Сленг и эмодзи: В социальных сетях и чатах мы имеем дело с постоянно меняющимся языком, сленгом, аббревиатурами и эмодзи, которые несут важный смысл․ Мы разрабатываем инструменты для нормализации сленга и анализа эмодзи․

- Большие текстовые массивы (Big Data NLP): Обработка миллионов документов требует оптимизации, использования эффективных библиотек (например, Gensim для тематического моделирования больших корпусов) и, при необходимости, распределенных вычислений или GPU-ускорения․

-

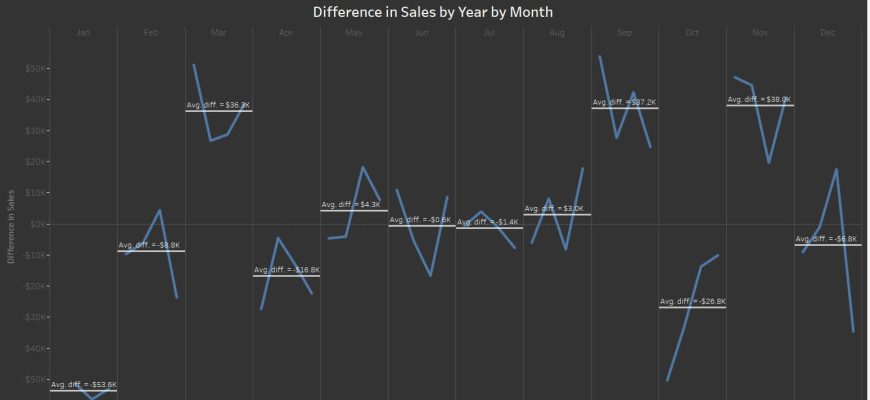

Анализ временных рядов в текстовых данных: Мы отслеживаем, как меняется тональность или темы в текстах со временем, что позволяет выявлять сезонность или реакцию на определенные события․

Визуализация и Оценка

Визуализация данных помогает нам лучше понять результаты анализа․ Мы используем Word Clouds для отображения частотности слов, Heatmaps для визуализации матриц сходства или корреляций, а также другие графики для представления распределения тональности или тематической структуры․

Оценка качества наших моделей – это критически важный этап․ Для NER-моделей мы используем такие метрики, как F1-score, Precision и Recall․ Для классификации текстов – Accuracy, Precision, Recall, F1-score и Confusion Matrix․ Мы постоянно сравниваем различные методы векторизации (TF-IDF vs Word2Vec), алгоритмы кластеризации (K-Means vs DBSCAN) или модели тематического моделирования (LDA vs NMF), чтобы выбрать наиболее эффективное решение для нашей задачи․

Будущее NLP: Куда Мы Движемся

Мир NLP постоянно развивается, и мы стараемся идти в ногу со временем․ Наши следующие шаги включают более глубокое освоение:

- Graph Embeddings: Для анализа взаимосвязей между сущностями в тексте․

- Real-time NLP: Обработка текстовых потоков в режиме реального времени․

- Автоматическая разметка данных: Разработка инструментов для полуавтоматической или автоматической разметки текстовых данных для обучения моделей․

- Тонкая настройка предварительно обученных моделей: Для достижения максимальной производительности на специфических задачах․

- Анализ стилистики текста и определение авторства: Эти задачи становятся все более актуальными в эпоху цифрового контента․

Мы верим, что Python и библиотеки для NLP дают нам невероятные возможности для превращения хаоса текста в структурированную, ценную информацию․ Это область, полная вызовов и открытий, и мы с нетерпением ждем, какие новые горизонты откроются перед нами в ближайшем будущем․

Надеемся, что это путешествие по миру NLP было для вас таким же увлекательным, как и для нас․ Мы всегда рады вашим вопросам и комментариям!

На этом статья заканчивается․

Подробнее

| LSI Запросы | ||||

|---|---|---|---|---|

| Основы токенизации NLTK | Применение spaCy для NER | Сравнение Word2Vec и TF-IDF | Анализ тональности VADER | Трансформеры Hugging Face NLP |

| Лемматизация vs стемминг в Python | Тематическое моделирование Gensim | Классификация текстов Scikit-learn | Разработка чат-ботов Rasa | Извлечение ключевых фраз TextRank |