- Расшифровка Языка Цифровой Вселенной: Наш Путь в Мир Обработки Естественного Языка на Python

- Фундаментальные Шаги: От Сырого Текста к Структурированным Данным

- NLTK и SpaCy: Наши Верные Помощники в Первичной Обработке

- Очистка Данных и Регулярные Выражения: Подготовка Почвы

- Осмысление Текста: Векторизация и Моделирование

- От Частот к Смыслу: Разработка Собственных Векторизаторов

- Word Embeddings: Погружение в Смысловое Пространство

- Революция Трансформеров: Контекстно-Зависимые Эмбеддинги

- Прикладные Задачи NLP: От Сентимента до Генерации

- Классификация и Анализ Тональности: Понимание Мнений

- Извлечение Информации: NER, Ключевые Фразы и Суммаризация

- Продвинутые Применения: От Чат-ботов до Машинного Перевода

- Инструменты и Методологии: Как Мы Работаем

- Визуализация и Оценка: Понимание и Измерение

- Специализированные Инструменты и Методы

Расшифровка Языка Цифровой Вселенной: Наш Путь в Мир Обработки Естественного Языка на Python

Приветствуем вас, дорогие читатели, в нашей увлекательной экспедиции по безбрежным просторам обработки естественного языка, или NLP (Natural Language Processing). Сегодня мы погрузимся в мир, где машины учатся понимать, интерпретировать и даже генерировать человеческую речь. Это не просто футуристическая концепция из научно-фантастических фильмов; это реальность, которую мы ежедневно видим в голосовых помощниках, системах автоматического перевода, спам-фильтрах и даже в умных поисковых системах. Мы, команда увлеченных исследователей и практиков, хотим поделиться с вами нашим опытом и знаниями, показать, как Python стал краеугольным камнем в создании этих удивительных технологий.

Мы помним времена, когда работа с текстом для компьютера казалась чем-то из области фантастики. Ведь для машины текст — это всего лишь последовательность символов, не несущая никакого смысла. Но благодаря удивительному прогрессу в области искусственного интеллекта и появлению мощных библиотек на Python, мы теперь можем заставить эти машины "читать" и "понимать" текст почти так же, как это делаем мы с вами. Это открывает невероятные возможности для автоматизации рутинных задач, извлечения ценных инсайтов из огромных массивов данных и создания совершенно новых интерактивных систем.

В этой статье мы подробно разберем ключевые концепции и инструменты NLP, которые мы используем в нашей повседневной работе. От базовой токенизации и стемминга до сложных трансформерных моделей и систем вопросно-ответной системы – мы пройдем весь путь, чтобы вы не только поняли, как это работает, но и смогли применить эти знания на практике. Приготовьтесь к увлекательному путешествию, полному открытий и практических советов, ведь мы начинаем!

Фундаментальные Шаги: От Сырого Текста к Структурированным Данным

Прежде чем мы сможем научить машину "понимать" текст, нам необходимо его подготовить. Представьте, что вы читаете книгу, написанную без пробелов, знаков препинания и заглавных букв. Это было бы крайне сложно, не так ли? Точно так же и с машинами. Сырой, необработанный текст для них, это хаос. Поэтому первым делом мы всегда обращаемся к предобработке текста, которая включает в себя ряд критически важных этапов.

Наш опыт показывает, что качество предобработки напрямую влияет на результат любой NLP-задачи. Если данные плохо очищены или неправильно структурированы, даже самые продвинутые модели не смогут выдать адекватных результатов. Мы всегда начинаем с этого этапа, уделяя ему должное внимание, чтобы обеспечить прочную основу для дальнейшего анализа.

NLTK и SpaCy: Наши Верные Помощники в Первичной Обработке

Для начальных этапов предобработки текста мы часто обращаемся к двум мощным библиотекам: NLTK (Natural Language Toolkit) и spaCy. Каждая из них имеет свои сильные стороны и применяется нами в зависимости от специфики задачи и требуемой производительности.

NLTK, пожалуй, самая известная и широко используемая библиотека в академических кругах и для обучения. Она предоставляет обширный набор инструментов и корпусов для работы с текстом. Мы часто используем её для:

- Токенизации: Разбиение текста на отдельные слова или предложения. Это первый и самый базовый шаг, который превращает сплошной текст в последовательность осмысленных единиц.

- Стемминга: Приведение слов к их корневой форме путем отсечения окончаний. Например, "бегущий", "бежал", "бегать" могут быть приведены к "бег". Мы знаем, что стемминг грубоват, и иногда отсекает слишком много, но для некоторых задач это вполне приемлемо.

- Морфологического анализа: Понимание структуры слов. NLTK предлагает различные стеммеры (Porter, Snowball) и лемматизаторы.

- POS-теггинга (Part-of-Speech Tagging): Определение части речи для каждого слова (существительное, глагол, прилагательное и т.д.). Это критически важно для дальнейшего синтаксического анализа и понимания структуры предложения.

Когда же нам требуется высокая скорость и более продвинутые функции "из коробки", мы обращаемся к spaCy. Эта библиотека разработана с акцентом на производительность и предоставляет готовые модели для различных языков. Наши любимые функции spaCy включают:

- Быстрое NER (Named Entity Recognition): Распознавание именованных сущностей, таких как имена людей, организаций, географических мест, дат и т.д. Это невероятно полезно для извлечения структурированной информации из неструктурированного текста.

- Продвинутая лемматизация: В отличие от стемминга, лемматизация приводит слова к их словарной форме (лемме), что обычно более точно. Например, "был", "есть", "будет" все сводятся к "быть". SpaCy делает это очень эффективно.

-

Синтаксический парсинг: Анализ грамматической структуры предложения, определение зависимостей между словами. Это позволяет нам понять, кто что делает, с кем или чем связано.

- Анализ зависимостей: Построение дерева зависимостей, которое показывает отношения между словами в предложении.

Помимо этих гигантов, мы также используем TextBlob для более простых задач NLP, таких как быстрый анализ тональности или определение языка. Это отличный инструмент для прототипирования и небольших проектов, где не требуется высокая гибкость или глубокая настройка.

Очистка Данных и Регулярные Выражения: Подготовка Почвы

Даже после токенизации и лемматизации текст все еще может содержать "шум". Нам часто приходится сталкиваться с:

- HTML-тегами: Если мы собираем данные из веба с помощью Beautiful Soup, текст часто содержит лишние теги. Мы разрабатываем инструменты для их очистки.

- Пунктуацией: Знаки препинания обычно не несут смысловой нагрузки для большинства задач NLP (хотя для анализа тональности или стилистики они могут быть важны). Мы нормализуем или удаляем их.

- Стоп-словами: Это частотные слова, такие как "и", "в", "на", "для", которые не несут значимой информации для анализа. Мы используем готовые списки стоп-слов (например, из NLTK) или создаем свои.

- Сленгом и эмодзи: В текстах из социальных сетей это отдельная головная боль. Мы разрабатываем инструменты для нормализации сленга и анализа эмодзи, чтобы учесть их эмоциональную окраску.

- Неполными и ошибочными данными: Опечатки, грамматические ошибки – все это требует инструментов для проверки грамматики и исправления орфографии.

В этом нам неоценимую помощь оказывают регулярные выражения (библиотека `re` в Python). Мы используем их для поиска и замены специфических паттернов в тексте, будь то удаление URL-адресов, чисел, специальных символов или приведение текста к нижнему регистру. Это мощный, хотя иногда и сложный в освоении инструмент, который становится неотъемлемой частью нашего арсенала.

Вот пример таблицы, показывающей, как мы подходим к предобработке:

| Этап предобработки | Цель | Используемые инструменты/библиотеки | Пример результата |

|---|---|---|---|

| Очистка от HTML | Удаление ненужных тегов | Beautiful Soup, регулярные выражения | "Это <b>важный</b> текст." -> "Это важный текст." |

| Токенизация | Разбиение на слова/предложения | NLTK, spaCy | "Привет, мир!" -> ["Привет", ",", "мир", "!"] |

| Лемматизация | Приведение к словарной форме | spaCy, NLTK | "бегущий" -> "бежать" |

| Удаление стоп-слов | Удаление частотных, малозначимых слов | NLTK (списки), кастомные списки | "Это очень важный текст" -> "очень важный текст" |

| Нормализация | Приведение к нижнему регистру, удаление пунктуации | Строковые методы Python, регулярные выражения | "Привет, Мир!" -> "привет мир" |

Осмысление Текста: Векторизация и Моделирование

После того как текст очищен и разбит на токены, перед нами встает следующая задача: как представить эти слова и предложения таким образом, чтобы машина могла их "понять"? Компьютеры работают с числами, а не с человеческим языком. Именно здесь на помощь приходит векторизация текста – процесс преобразования текста в числовые векторы.

Мы видели, как быстро развивались методы векторизации за последние годы. От простых частотных подходов до сложных контекстно-зависимых эмбеддингов – каждый метод имеет свою область применения и свои преимущества. Выбор правильного метода векторизации может кардинально изменить качество результатов в любой NLP-задаче.

От Частот к Смыслу: Разработка Собственных Векторизаторов

На ранних этапах работы с текстом мы часто использовали простые, но эффективные векторизаторы из библиотеки Scikit-learn. Они преобразуют текст в разреженные матрицы, где каждая строка представляет документ, а каждый столбец – уникальное слово (или N-грамму) из всего корпуса.

- CountVectorizer: Этот векторизатор просто подсчитывает частоту вхождения каждого слова в документе. Мы используем его, когда нам важна абсолютная частота слов, например, для анализа частотности слов и N-грамм.

- TfidfVectorizer: Более продвинутый вариант, который учитывает не только частоту слова в документе (Term Frequency, TF), но и его редкость во всем корпусе документов (Inverse Document Frequency, IDF). Это помогает нам выделить слова, которые являются уникальными и важными для конкретного документа, а не просто часто встречаются везде. Мы часто сравниваем эти методы векторизации (TF-IDF vs Word2Vec), чтобы выбрать наиболее подходящий.

Создание собственных словарей и тезаурусов также является важной частью нашей работы, особенно когда мы имеем дело с узкоспециализированными текстами, например, в юридических или медицинских записях. Это помогает нам обогатить векторизацию и лучше понять специфическую терминологию.

Word Embeddings: Погружение в Смысловое Пространство

Хотя TF-IDF и CountVectorizer полезны, они не улавливают семантические отношения между словами. Здесь на сцену выходят Word Embeddings – векторные представления слов, которые кодируют их смысл и контекст. Слова с похожим значением имеют близкие векторы в многомерном пространстве.

Мы активно используем библиотеку Gensim для работы с различными моделями эмбеддингов:

- Word2Vec: Это одна из первых и наиболее влиятельных моделей. Мы экспериментировали с двумя её архитектурами: Skip-gram (предсказывает контекст по слову) и CBOW (Continuous Bag of Words) (предсказывает слово по контексту). Word2Vec позволяет нам увидеть, что "король" минус "мужчина" плюс "женщина" равно "королева", что демонстрирует потрясающую способность модели улавливать аналогии.

- GloVe: Еще одна популярная модель, которая объединяет идеи Word2Vec и матричной факторизации. Мы находим её полезной для некоторых задач, где требуется баланс между локальным и глобальным контекстом.

- Doc2Vec: Если Word2Vec работает со словами, то Doc2Vec позволяет нам получать векторные представления целых документов или предложений. Это чрезвычайно полезно для задач, где нужно сравнивать документы по их смыслу, например, для поиска дубликатов или тематической кластеризации. Мы часто используем Doc2Vec для векторизации предложений и документов.

- FastText: Модель от Facebook, которая расширяет Word2Vec, учитывая субсловесные единицы (н-граммы символов). Это делает её особенно эффективной для работы с редкими словами и языками с богатой морфологией, такими как русский.

Для анализа больших текстовых массивов (Big Data NLP) и тематического моделирования (LDA, LSI) Gensim является нашим незаменимым инструментом. Мы используем его для извлечения скрытых тем из огромных коллекций документов, что помогает нам понять основные нарративы или категории в данных.

"Язык – это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Революция Трансформеров: Контекстно-Зависимые Эмбеддинги

Если Word Embeddings стали прорывом, то появление трансформерных моделей и контекстно-зависимых эмбеддингов произвело настоящую революцию в NLP. Модели, такие как BERT (Bidirectional Encoder Representations from Transformers) и его многочисленные потомки (GPT, RoBERTa, XLNet и др.), полностью изменили наш подход к обработке естественного языка.

Ключевое отличие заключается в том, что трансформеры генерируют векторное представление слова не изолированно, а с учетом всего контекста, в котором оно находится. Это позволяет им различать значения омонимов (например, "коса" как инструмент и "коса" как прическа) и улавливать сложные синтаксические и семантические зависимости.

Мы активно используем библиотеку Hugging Face Transformers, которая стала де-факто стандартом для работы с этими моделями. Она предоставляет доступ к сотням предварительно обученных моделей для широкого спектра задач:

- BERT для задач классификации: Мы тонко настраиваем (fine-tuning) предварительно обученные модели BERT для классификации текстов, что дает нам значительно лучшие результаты, чем традиционные методы.

- BERT для NER: Трансформеры показывают выдающиеся результаты в распознавании именованных сущностей, превосходя многие предыдущие подходы.

- Transformer-модели для генерации текста (GPT): Мы экспериментируем с генеративными моделями для создания осмысленных и связных текстов, что находит применение в автоматическом создании контента, суммаризации и даже разработке чат-ботов.

- Sentence Transformers: Это специализированные модели, которые позволяют нам получать высококачественные эмбеддинги для целых предложений или коротких документов, что очень удобно для поиска сходства и кластеризации.

Работа с этими моделями требует значительных вычислительных ресурсов, поэтому мы часто используем GPU-ускорение для обработки текста. Это позволяет нам значительно сократить время обучения и инференса.

Прикладные Задачи NLP: От Сентимента до Генерации

После того как мы подготовили и векторизовали текст, открываются двери к решению множества практических задач. Мы постоянно применяем эти методы для извлечения ценной информации, автоматизации процессов и создания интеллектуальных систем.

Каждая из этих задач имеет свои нюансы и требует индивидуального подхода, но базовые принципы предобработки и векторизации остаются неизменными. Мы всегда стремимся выбрать наиболее подходящий инструмент и алгоритм для конкретной проблемы, чтобы достичь наилучших результатов.

Классификация и Анализ Тональности: Понимание Мнений

Классификация текстов – это одна из самых распространенных задач в NLP. Мы используем её для автоматического распределения документов по заранее определенным категориям. Примеры включают:

- Автоматическая категоризация статей: Распределение новостей по темам (спорт, политика, экономика).

- Фильтрация спама: Определение, является ли электронное письмо спамом или нет.

- Анализ отзывов: Классификация отзывов клиентов по категориям продуктов или услуг.

Для этих целей мы активно используем Scikit-learn, применяя такие алгоритмы машинного обучения, как SVM (Support Vector Machines) и Наивный Байесовский классификатор. Также, с появлением глубокого обучения, мы начали применять PyTorch/TensorFlow для создания LSTM-сетей и, конечно же, трансформерные модели, такие как BERT, которые значительно повышают точность классификации.

Анализ тональности (Sentiment Analysis) – это частный случай классификации, где мы определяем эмоциональную окраску текста (положительная, отрицательная, нейтральная). Это невероятно ценно для бизнеса, чтобы понимать отношение клиентов к продуктам или услугам.

- Мы используем VADER (Valence Aware Dictionary and sEntiment Reasoner) для быстрого анализа тональности, особенно в коротких текстах и социальных медиа (Twitter/Reddit), так как он хорошо справляется со сленгом и эмодзи.

- Для более глубокого анализа тональности мы применяем TextBlob или обучаем собственные классификаторы на основе размеченных данных, учитывая контекст и даже сарказм.

- Особое внимание мы уделяем анализу тональности финансовых новостей и политических постов, где точность имеет огромное значение.

Извлечение Информации: NER, Ключевые Фразы и Суммаризация

Извлечение конкретной информации из больших объемов текста – еще одна ключевая задача, которую мы решаем с помощью NLP.

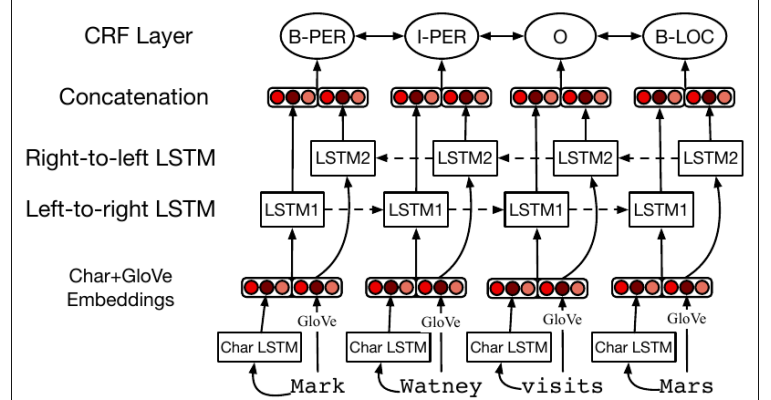

- Распознавание именованных сущностей (NER): Как мы уже упоминали, spaCy и Flair (библиотека, известная своими state-of-the-art моделями для NER) являются нашими основными инструментами. Мы также используем CRF (Conditional Random Fields) для распознавания сущностей в тех случаях, когда требуется более тонкая настройка или нет доступа к большим предобученным моделям.

Оценка качества NER-моделей (F1-score, Precision, Recall) для нас является обязательным этапом, чтобы убедится в надежности наших систем. Мы также разрабатываем системы для автоматической разметки сущностей, чтобы упростить процесс создания обучающих данных. - Извлечение ключевых фраз и слов: Для этой задачи мы используем алгоритмы, такие как RAKE (Rapid Automatic Keyword Extraction) и TextRank. TextRank, основанный на алгоритме PageRank, позволяет нам не только извлекать ключевые слова, но и ключевые предложения, что является отличной основой для суммаризации.

- Суммаризация текста: Мы различаем два основных подхода:

- Экстрактивная суммаризация: Выбор наиболее важных предложений из исходного текста для формирования краткого обзора. Здесь TextRank показывает себя очень хорошо.

- Абстрактивная суммаризация: Генерация нового текста, который передает основной смысл оригинала, но не обязательно содержит его оригинальные предложения. Это более сложная задача, которую мы решаем с помощью Transformer-моделей (например, T5, BART из Hugging Face). Мы постоянно сравниваем модели суммаризации (экстрактивные и абстрактные), чтобы выбрать оптимальное решение для разных типов документов.

Продвинутые Применения: От Чат-ботов до Машинного Перевода

Мир NLP постоянно развивается, и мы всегда ищем новые способы применения этих технологий.

- Разработка чат-ботов на Python (Rasa framework): Мы активно используем Rasa для создания интеллектуальных диалоговых систем. Это позволяет нам разрабатывать чат-боты, которые могут понимать намерения пользователя, извлекать сущности из его запросов и вести естественный диалог.

- Разработка систем вопросно-ответных систем (QA): С помощью трансформерных моделей (например, BERT с архитектурой SQuAD) мы создаем системы, способные находить точные ответы на вопросы в больших массивах текста. Это очень полезно для автоматического создания FAQ на основе документов или для поиска информации в корпоративных базах знаний.

- Разработка систем машинного перевода на Python: Современные трансформерные архитектуры стали стандартом для машинного перевода. Мы используем PyTorch/TensorFlow и Hugging Face для создания и тонкой настройки моделей, способных переводить тексты между языками, включая узкоспециализированные тексты.

- Анализ стилистики текстов (авторский почерк) и определение авторства: Это увлекательная область, где мы анализируем лексическое богатство, частотность слов и N-грамм, синтаксические конструкции, чтобы определить уникальный стиль автора или установить авторство анонимного текста.

- Разработка систем обнаружения плагиата: Используя методы сравнения строк (библиотека Jellyfish) и векторные представления документов (Doc2Vec, Sentence Transformers), мы создаем инструменты для поиска сходства между текстами и выявления плагиата.

- Обработка многоязычных текстовых корпусов: Для работы с языками с богатой морфологией мы используем Stanza (от Stanford NLP Group), а для мультиязычности и анализа редких языков – Polyglot. Это позволяет нам расширять наши NLP-решения за пределы английского языка.

Инструменты и Методологии: Как Мы Работаем

Наш подход к NLP не ограничивается только выбором библиотек. Мы также уделяем внимание методологиям работы, оценке моделей и инструментам, которые помогают нам визуализировать и понимать данные.

Эффективность любого NLP-проекта зависит не только от выбранных алгоритмов, но и от того, насколько хорошо мы понимаем наши данные, как мы их обрабатываем и как мы оцениваем результаты. Мы постоянно совершенствуем наши рабочие процессы, чтобы быть на переднем крае инноваций.

Визуализация и Оценка: Понимание и Измерение

Визуализация текстовых данных играет ключевую роль в нашем процессе анализа. Мы используем различные инструменты для наглядного представления информации:

- Облака слов (Word Clouds): Отличный способ быстро получить представление о наиболее частотных словах в корпусе.

- Тепловые карты (Heatmaps): Помогают визуализировать матрицы сходства между документами или словами.

- Мы также используем библиотеки вроде Sweetviz для анализа текстовых данных, чтобы получить быстрый и наглядный обзор их характеристик.

Оценка качества моделей – это неотъемлемая часть любого проекта. Мы всегда измеряем метрики, такие как F1-score, Precision и Recall, особенно для задач классификации и NER, чтобы быть уверенными в производительности наших моделей.

Сравнение моделей тематического моделирования (LDA vs NMF) или методов лемматизации (SpaCy vs NLTK) – это рутинная задача, которая позволяет нам выбрать наилучший подход для конкретной проблемы. Мы также сравниваем различные методы векторизации (TF-IDF vs Word2Vec), чтобы понять их сильные и слабые стороны.

Специализированные Инструменты и Методы

Помимо основных библиотек, мы используем ряд специализированных инструментов:

- Textacy: Эта библиотека предоставляет богатый набор функций для расширенной обработки текста, включая извлечение информации, работу с зависимостями и многое другое. Мы находим её очень полезной для сложных задач анализа.

- PyMuPDF: Для извлечения текста из PDF-документов, что часто бывает необходимо при работе с корпоративными или научными данными.

- Gentle: Если нам нужно преобразовать речь в текст (Speech-to-Text), Gentle становится нашим выбором.

- Graph Embeddings: Для анализа взаимосвязей в тексте, например, между сущностями или концепциями, мы применяем методы графовых эмбеддингов, которые позволяют нам выявлять скрытые структуры в данных.

- Анализ временных рядов в текстовых данных: Мы исследуем, как меняются темы, тональность или частотность слов со временем, что особенно актуально для анализа социальных медиа или новостных потоков.

- Машинное обучение без учителя: Помимо классификации с учителем, мы активно используем методы машинного обучения без учителя, такие как кластеризация (K-Means vs DBSCAN), для выявления скрытых тем или группировки схожих документов без предварительной разметки. Мы применяем Scikit-learn для кластеризации текстов.

Мы прошли долгий путь, исследуя основы и продвинутые концепции обработки естественного языка на Python. От первых шагов в предобработке текста с NLTK и spaCy до погружения в мир Word Embeddings и революционных трансформерных моделей от Hugging Face – каждая глава этой истории открывает новые горизонты для работы с человеческим языком.

Мы верим, что NLP – это одна из самых динамичных и перспективных областей искусственного интеллекта. Способность машин понимать и генерировать текст уже сейчас преобразует множество отраслей, от клиентского сервиса до медицины и юриспруденции. И это только начало! Мы постоянно видим новые прорывы, которые делают NLP еще более мощным и доступным.

Наш опыт показывает, что ключ к успеху в NLP лежит в непрерывном обучении, экспериментировании и глубоком понимании как лингвистических принципов, так и технических аспектов. Python с его богатой экосистемой библиотек предоставляет нам все необходимые инструменты для реализации самых смелых идей.

Мы надеемся, что эта статья вдохновила вас на собственные исследования и эксперименты в мире обработки естественного языка. Возможности безграничны, и мы с нетерпением ждем, какие новые удивительные применения NLP мы увидим в будущем. Продолжайте учиться, творить и расшифровывать язык цифровой вселенной вместе с нами!

На этом статья заканчивается.

Подробнее: LSI Запросы

| Python NLP библиотеки | Машинное обучение для текста | Как работает TextRank | Сравнение Word2Vec и BERT | Анализ тональности VADER |

| Предобработка текста Python | Тематическое моделирование LDA Gensim | Применение spaCy NER | Создание чат-ботов Rasa | Трансформеры Hugging Face |