- Текстовая Алхимия: Как Мы Превращаем Слова в Золото с Помощью Python и NLP

- Фундамент NLP: С чего Мы Начинаем Разговор с Текстом

- Первые Шаги: Токенизация, Стемминг и Лемматизация с NLTK и spaCy

- Очистка Данных: Регулярные Выражения и Стоп-слова

- Текст как Числа: Как Мы Заставляем Машины "Видеть" Слова

- Классические Векторизаторы: CountVectorizer и TfidfVectorizer

- Векторы Слов (Word Embeddings): Word2Vec, GloVe и FastText

- Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

- Основные Задачи NLP: Разбираем Текст по Косточкам

- Распознавание Именованных Сущностей (NER)

- Анализ Тональности (Sentiment Analysis)

- Тематическое Моделирование (Topic Modeling)

- Классификация Текстов

- Извлечение Ключевых Фраз и Суммаризация

- Продвинутые Техники и Специализированные Приложения

- Трансформеры и Глубокое Обучение в NLP

- Веб-скрейпинг и Извлечение Информации

- Многоязычность и Редкие Языки

- Специализированные Задачи и Сценарии

- Будущее NLP и Наши Постоянные Эксперименты

Текстовая Алхимия: Как Мы Превращаем Слова в Золото с Помощью Python и NLP

Привет, дорогие читатели и коллеги по цеху! Наша команда, вечные искатели смыслов в бескрайних океанах данных, сегодня приглашает вас в увлекательное путешествие по миру Обработки Естественного Языка (NLP)․ Возможно, вы уже слышали эти три магические буквы, но задумывались ли, насколько глубоко они проникли в нашу повседневность? От голосовых помощников, которые каждое утро включают нам любимую музыку, до сложных систем, анализирующих миллиарды отзывов клиентов, NLP — это не просто набор алгоритмов, это ключ к пониманию человеческого языка машинами․ И что самое интересное, для этой магии нам не нужны волшебные палочки, достаточно лишь нашего любимого Python и щепотки любопытства․

Мы, как опытные путешественники по этим цифровым ландшафтам, знаем, что путь может быть извилист, но награда того стоит․ В этой статье мы не просто расскажем о различных инструментах и методах; мы поделимся нашим опытом, нашими открытиями и теми "ага!" моментами, которые делают работу с текстом такой захватывающей․ Мы пройдемся по фундаментальным понятиям, заглянем в продвинутые техники и даже коснемся будущего, которое уже стучится в наши двери в виде мощных трансформерных моделей․ Приготовьтесь, ведь впереди нас ждет детальный разбор того, как мы заставляем компьютеры не просто читать, но и понимать, чувствовать и даже генерировать человеческий язык․

Фундамент NLP: С чего Мы Начинаем Разговор с Текстом

Прежде чем мы сможем научить машину "понимать" текст, нам нужно научить ее "читать"․ И это не так просто, как кажется․ Для компьютера текст — это всего лишь последовательность символов․ Наша задача, как алхимиков данных, состоит в том, чтобы превратить эту последовательность во что-то осмысленное․ Это начинается с предобработки, которая является краеугольным камнем любого NLP-проекта․

Первые Шаги: Токенизация, Стемминг и Лемматизация с NLTK и spaCy

Когда мы получаем сырой текст, первым делом мы разбиваем его на более мелкие, значимые единицы — токены․ Это могут быть слова, пунктуация, числа․ Процесс называется токенизацией․ NLTK (Natural Language Toolkit), это наш старый добрый друг, который всегда готов прийти на помощь с базовыми задачами․ Мы используем его, чтобы легко разделить предложения на слова или текст на предложения․

После токенизации слова могут иметь разные формы: "бежать", "бежит", "бежал"․ Для многих задач нам нужно привести их к одной базовой форме․ Здесь на сцену выходят стемминг и лемматизация․ Стемминг (например, алгоритм Портера в NLTK) просто отсекает окончания, пытаясь найти "корень" слова, не всегда гарантируя, что результат будет настоящим словом․ Лемматизация, в свою очередь, гораздо умнее: она использует словари и морфологический анализ, чтобы привести слово к его словарной форме (лемме)․ Например, "бежали" станет "бежать"․ Для более продвинутой и точной лемматизации, особенно в языках с богатой морфологией, мы часто обращаемся к spaCy или Stanza, которые превосходят NLTK в этом аспекте, особенно для русского языка․

"Язык ─ это дорожная карта культуры․ Он говорит вам, откуда пришли его люди и куда они идут․"

— Рита Мэй Браун

Очистка Данных: Регулярные Выражения и Стоп-слова

Текст редко приходит к нам в идеальном виде․ Он может содержать HTML-теги, специальные символы, ссылки, избыточные пробелы․ Здесь на помощь приходят регулярные выражения (re); Мы используем их как универсальный инструмент для поиска и замены любых паттернов в тексте, будь то удаление всех цифр, очистка от пунктуации или извлечение специфической информации․ Это наш швейцарский нож для предобработки текста․

Кроме того, в любом языке есть слова, которые встречаются очень часто, но не несут особого смыслового значения для анализа (например, "и", "в", "он", "это")․ Мы называем их стоп-словами․ Их удаление помогает сократить размер данных и сосредоточиться на более значимых терминах․ NLTK предлагает списки стоп-слов для многих языков, но мы часто дополняем их собственными, специфичными для нашей задачи․

Типичные шаги предобработки включают:

- Удаление HTML-тегов: Используем библиотеки вроде Beautiful Soup, если текст был получен из веба․

- Удаление пунктуации и специальных символов: Регулярные выражения — наш лучший друг здесь․

- Приведение к нижнему регистру: Чтобы "Слово" и "слово" считались одним и тем же․

- Токенизация: Разбиение на слова или предложения․

- Удаление стоп-слов․

- Лемматизация/Стемминг․

Текст как Числа: Как Мы Заставляем Машины "Видеть" Слова

Как только мы очистили и нормализовали текст, возникает следующая задача: как представить слова и предложения таким образом, чтобы математические алгоритмы могли с ними работать? Машины понимают только числа, поэтому нам нужно перевести наш очищенный текст в числовые векторы․ Это называется векторизацией․

Классические Векторизаторы: CountVectorizer и TfidfVectorizer

Начнем с основ․ CountVectorizer из Scikit-learn просто подсчитывает частоту каждого слова в документе․ Получаеться матрица, где строки — это документы, а столбцы — слова, и на пересечении — количество вхождений слова в документ․ Это простая, но эффективная техника․

Однако, некоторые слова могут быть частыми во всех документах (как те же стоп-слова), и их высокая частота не обязательно означает высокую важность․ Здесь на сцену выходит TfidfVectorizer (Term Frequency-Inverse Document Frequency)․ TF-IDF не только учитывает частоту слова в документе (TF), но и наказывает слова, которые встречаются во многих документах (IDF)․ Таким образом, слова, уникальные для конкретного документа, получают больший вес, что позволяет нам лучше выделить ключевые термины․

| Метод Векторизации | Преимущества | Недостатки | Типичное Применение |

|---|---|---|---|

| CountVectorizer | Простота, сохраняет информацию о частоте | Большая разреженная матрица, не учитывает важность слова | Классификация, базовый анализ частотности |

| TfidfVectorizer | Учитывает важность слова, выделяет ключевые термины | Потеря контекста, большая разреженная матрица | Поиск информации, тематическое моделирование, классификация |

Векторы Слов (Word Embeddings): Word2Vec, GloVe и FastText

Классические векторизаторы не учитывают семантическое значение слов․ Они не "знают", что "король" и "королева" похожи, но "король" и "яблоко" нет․ Здесь нам на помощь приходят векторы слов (Word Embeddings); Это плотные числовые представления слов в многомерном пространстве, где слова со схожим значением располагаются ближе друг к другу․

Мы активно используем Word2Vec и GloVe, которые обучаются на огромных корпусах текста․ Word2Vec, разработанный Google, имеет две архитектуры: Skip-gram (предсказывает контекст по слову) и CBOW (предсказывает слово по контексту)․ Gensim, отличная библиотека для работы с этими моделями․

FastText, разработанный Facebook, является расширением Word2Vec․ Его ключевое преимущество в том, что он учитывает подслова (n-граммы символов)․ Это делает его особенно полезным для работы с редкими словами, опечатками и морфологически богатыми языками, так как он может построить векторы для слов, которых не было в обучающем корпусе․ Мы часто обращаемся к FastText, когда имеем дело с неформальным языком или большим количеством новых терминов․

Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

Что делать, если нам нужно получить вектор не для слова, а для целого предложения или документа? Doc2Vec (расширение Word2Vec) позволяет нам это сделать, создавая плотные векторы для целых текстов․ Это открывает двери для сравнения документов, поиска похожих статей или кластеризации․

В последние годы особую популярность набрали Sentence Transformers․ Эти модели, построенные на архитектуре трансформеров, способны генерировать высококачественные векторы для предложений и документов, которые прекрасно отражают их семантическое значение․ Они показали себя невероятно эффективными в задачах поиска семантически похожих текстов, кластеризации и даже в вопросно-ответных системах․ Мы часто используем их, когда нужна максимальная точность в понимании смысла целых фрагментов текста․

Основные Задачи NLP: Разбираем Текст по Косточкам

Теперь, когда мы умеем обрабатывать и векторизовать текст, мы можем приступить к решению более сложных задач, которые позволяют нам извлекать ценную информацию и понимать смысл․

Распознавание Именованных Сущностей (NER)

Одной из самых востребованных задач является Распознавание Именованных Сущностей (NER)․ Это процесс идентификации и классификации именованных сущностей в тексте, таких как имена людей, названия организаций, географические объекты, даты, суммы денег и т․д․ Представьте, что у вас есть огромный объем новостных статей, и вам нужно быстро узнать, о каких людях, компаниях и местах в них говорится․

Мы активно используем spaCy для быстрого и эффективного NER․ Он поставляется с предварительно обученными моделями для многих языков, которые отлично справляются с большинством стандартных задач․ Для более продвинутых сценариев, где требуется высокая точность или работа с узкоспециализированными сущностями (например, медицинскими терминами), мы обращаемся к библиотекам вроде Flair, а также к трансформерам (Hugging Face), которые позволяют нам тонко настраивать модели под конкретные домены․ Мы также можем использовать методы, основанные на CRF (Conditional Random Fields), для создания собственных моделей NER․

Оценка качества NER-моделей — это отдельная история․ Мы используем метрики, такие как F1-score, Precision и Recall, чтобы убедиться, что наши модели не только находят большинство сущностей (высокий Recall), но и делают это правильно (высокий Precision)․

Анализ Тональности (Sentiment Analysis)

Понимание эмоциональной окраски текста — бесценный инструмент для бизнеса, маркетинга и аналитики социальных сетей․ Анализ тональности (Sentiment Analysis) позволяет нам определить, является ли отзыв, комментарий или статья позитивными, негативными или нейтральными․

Для быстрого и простого анализа тональности английского текста мы часто используем VADER (Valence Aware Dictionary and sEntiment Reasoner)․ Он отлично справляется с текстами из социальных сетей, учитывая даже использование эмодзи и сленга․ Для русского языка и более сложных сценариев, таких как анализ тональности финансовых новостей, где требуется учитывать тонкие нюансы и сарказм, мы разрабатываем собственные модели на основе машинного обучения (Scikit-learn) или даже трансформеров․ TextBlob также предлагает простой API для анализа тональности, хотя его возможности для русского языка ограничены․

Тематическое Моделирование (Topic Modeling)

Представьте, что у вас есть огромный архив документов, и вы хотите понять, о чем они вообще․ Перечитывать все — не вариант․ Здесь на помощь приходит тематическое моделирование, которое позволяет нам автоматически обнаруживать скрытые темы в больших коллекциях текстов․

Мы часто используем библиотеку Gensim для реализации популярных алгоритмов, таких как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing)․ LDA предполагает, что каждый документ представляет собой смесь нескольких тем, а каждая тема — это смесь слов․ LSI, в свою очередь, использует сингулярное разложение для выявления скрытых семантических структур․ Мы также экспериментируем с NMF (Non-negative Matrix Factorization), который может дать более интерпретируемые темы․ Сравнение моделей тематического моделирования (LDA vs NMF) часто становится отдельным проектом, так как выбор лучшей модели зависит от характеристик данных и целей анализа․

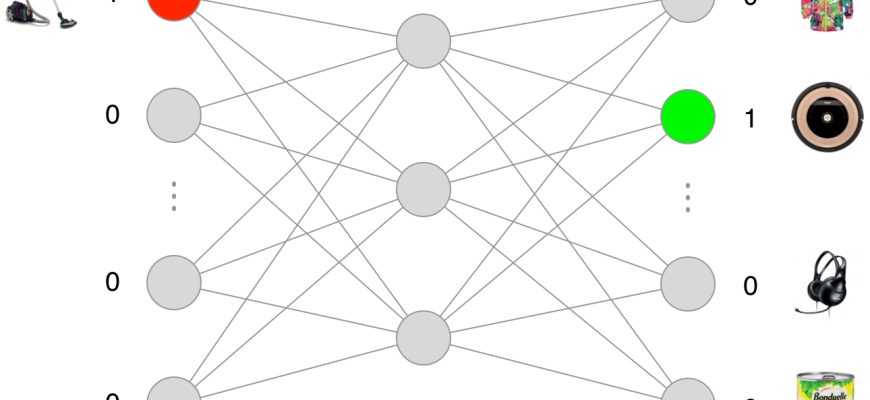

Классификация Текстов

Классификация текстов — это одна из наиболее распространенных задач NLP․ Это может быть категоризация новостей, спам-фильтрация, определение жанра книги или анализ отзывов о продуктах по категориям․

Библиотека Scikit-learn — наш надежный инструмент для этих задач․ Мы используем различные алгоритмы машинного обучения, такие как SVM (Support Vector Machines), Наивный Байесовский классификатор, логистическая регрессия․ В качестве признаков мы используем векторизованные тексты (TF-IDF или Word Embeddings)․ Для более сложных задач, где требуется учитывать контекст и семантику на глубоком уровне, мы переходим к нейронным сетям (LSTM с Keras/TensorFlow) и, конечно же, к трансформерам (BERT)․ Тонкая настройка (Fine-tuning) предварительно обученных моделей BERT для наших специфических задач классификации дает потрясающие результаты․

Извлечение Ключевых Фраз и Суммаризация

В мире перегруженном информацией, способность быстро извлекать суть из длинного текста становится жизненно важной․

- Извлечение ключевых фраз: Мы используем алгоритмы, такие как RAKE (Rapid Automatic Keyword Extraction) или TextRank, чтобы автоматически находить наиболее важные слова и фразы в документе․ TextRank, основанный на алгоритме PageRank, также может быть использован для извлечения ключевых предложений․

- Суммаризация текста: Здесь мы различаем два подхода:

- Экстрактивная суммаризация: Мы извлекаем наиболее важные предложения из исходного текста и объединяем их в краткое резюме․ TextRank хорошо подходит для этого․

- Абстрактивная суммаризация: Модель генерирует новое резюме, которое может содержать слова и фразы, не присутствующие в исходном тексте, подобно тому, как это делает человек․ Это гораздо более сложная задача, и здесь мы полагаемся на Transformer-модели (например, BART, T5) из библиотеки Hugging Face․

Продвинутые Техники и Специализированные Приложения

Мир NLP постоянно развивается, и мы, как блогеры, стремящиеся быть на острие технологий, всегда ищем новые способы применения этих знаний․

Трансформеры и Глубокое Обучение в NLP

Появление архитектуры Трансформеров произвело революцию в NLP․ Модели, такие как BERT, GPT, T5, разработанные на их основе, изменили наше представление о том, что возможно в обработке языка․ Мы используем библиотеку Hugging Face Transformers, которая предоставляет доступ к сотням предварительно обученных моделей и позволяет нам:

- Создавать системы вопросно-ответных систем (QA), которые могут находить ответы на вопросы в заданном тексте․

- Генерировать реалистичный и связный текст (GPT для генерации статей, ответов, даже кода)․

- Решать сложные задачи классификации, NER, анализа тональности с беспрецедентной точностью․

- Разрабатывать системы машинного перевода, способные обрабатывать многоязычные текстовые корпусы․

Помимо трансформеров, мы также активно используем PyTorch/TensorFlow для создания собственных нейронных сетей, например, LSTM-сетей, когда требуется тонкий контроль над архитектурой или работа с последовательными данными․ Обработка текста с использованием GPU-ускорения становится стандартом для больших моделей и массивов данных․

Веб-скрейпинг и Извлечение Информации

Часто данные для анализа находятся не в аккуратных CSV-файлах, а разбросаны по интернету․ Beautiful Soup — наша незаменимая библиотека для веб-скрейпинга текста․ Мы используем ее для извлечения статей, отзывов, новостей с веб-сайтов, которые затем проходят через наш NLP-конвейер․

Но текст не всегда находится в интернете․ Иногда он заперт в PDF-документах․ Для этих случаев мы используем PyMuPDF, который позволяет эффективно извлекать текст из PDF-файлов, сохраняя его структуру․ А для извлечения конкретных сущностей, таких как даты, числа, адреса из неструктурированного текста, мы разрабатываем специализированные системы извлечения фактов, используя комбинацию регулярных выражений и правил, а также более сложные модели на основе NER․

Многоязычность и Редкие Языки

В современном мире невозможно ограничится только английским языком․ Мы часто работаем с многоязычными текстовыми корпусами․ Для этого мы используем библиотеки, такие как Polyglot, которая предоставляет возможности для анализа различных языков, включая их определение․ Для языков с богатой морфологией, таких как русский, мы активно применяем Stanza, который предлагает продвинутую лемматизацию, POS-теггинг и синтаксический парсинг․ Разработка систем машинного перевода на Python, особенно для узкоспециализированных текстов, также является одним из наших направлений, часто с использованием трансформерных моделей․

Специализированные Задачи и Сценарии

Список задач, которые мы решаем с помощью NLP, практически бесконечен:

- Анализ стилистики текстов: Определение авторского почерка, что важно в криминалистике или для анализа литературных произведений․

- Разработка чат-ботов: С использованием фреймворков, таких как Rasa, мы создаем интеллектуальных помощников, способных вести диалог и понимать намерения пользователя․

- Проверка грамматики и орфографии: Создание инструментов для автоматической проверки текстов, что незаменимо для редакторов и писателей․

- Обнаружение плагиата: Сравнение документов с использованием метрик сходства (например, Textdistance или Doc2Vec) для выявления дубликатов․

- Анализ юридических документов, финансовых отчетов, медицинских записей: Извлечение ключевой информации, категоризация, поиск паттернов․

- Работа с эмодзи и сленгом: Разработка инструментов для нормализации сленга и учета эмоциональной окраски эмодзи в современных текстах, особенно в социальных сетях․

- Анализ частотности слов и n-грамм: Выявление наиболее распространенных слов и последовательностей слов, что может дать представление о содержании текста․

- Визуализация текстовых данных: Создание облаков слов (Word Clouds), тепловых карт частотности n-грамм для наглядного представления результатов анализа․

Мы также постоянно работаем над проблемами обработки неполных и ошибочных данных, что является неотъемлемой частью работы с реальными текстовыми массивами․ Создание словарей и тезаурусов помогает нам обогащать семантическое понимание моделей․

Будущее NLP и Наши Постоянные Эксперименты

Мир NLP не стоит на месте, и мы вместе с ним․ Каждый день появляются новые алгоритмы, модели и подходы․ Мы постоянно экспериментируем с анализом временных рядов в текстовых данных, чтобы выявлять сезонность в отзывах или новостях․ Применяем Graph Embeddings для анализа взаимосвязей между сущностями в тексте, строя графы знаний․

Для нас это не просто работа, это страсть — страсть к разгадыванию головоломок, которые скрыты в словах․ От тонкой настройки предварительно обученных моделей до разработки собственных векторизаторов текста, от анализа тональности сообщений в социальных сетях до создания сложных систем суммаризации, мы всегда стремимся к новым вершинам․ Мы верим, что каждый текст содержит в себе уникальную историю, и наша задача, помочь машинам ее услышать, понять и даже пересказать․

Вот мы и подошли к концу нашего обширного обзора․ Мы прошлись по основам токенизации и стемминга, погрузились в мир векторизаторов и векторов слов, освоили NER и анализ тональности, затронули тематическое моделирование и классификацию, и даже заглянули в будущее с трансформерами․ Мы убедились, что Python с его богатой экосистемой библиотек, это идеальный инструмент для любого, кто хочет заниматься текстовой алхимией․

Наш опыт показывает, что нет единого "лучшего" инструмента или метода․ Успех в NLP кроется в глубоком понимании задачи, гибкости в выборе подходов и готовности постоянно учиться и экспериментировать․ Мы надеемся, что эта статья вдохновила вас на собственные исследования и помогла увидеть, насколько мощным и увлекательным может быть мир обработки естественного языка․ Продолжайте кодировать, продолжайте исследовать, и пусть каждое ваше слово превращается в золото!

Подробнее

| Основы NLTK | NER с spaCy | Тематическое моделирование LDA | Word2Vec Gensim | Анализ тональности VADER |

| Трансформеры Hugging Face | Векторизация TF-IDF | Лемматизация SpaCy | Классификация текста Scikit-learn | Суммаризация TextRank |