- От Шепота Слов к Океану Смыслов: Наш Путь в Мир Обработки Естественного Языка (NLP) на Python

- Фундамент Понимания: Первые Шаги в Предобработке Текста

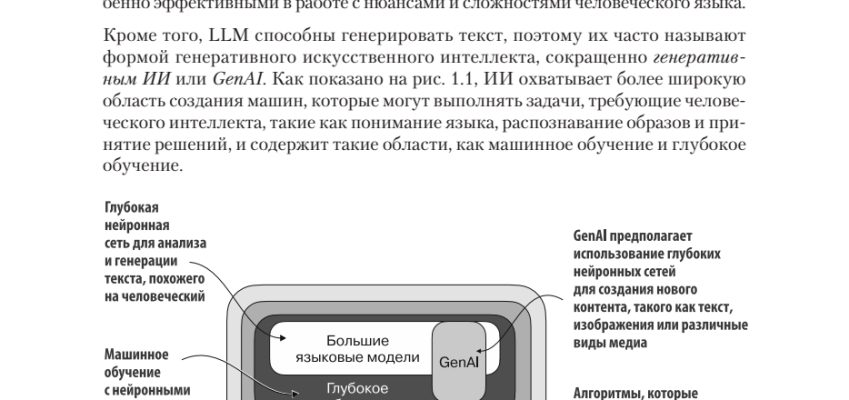

- Токенизация и Стемминг: Разбираем Текст на Части

- Лемматизация: К Точной Основной Форме

- Регулярные Выражения (re) и Очистка Текста

- Стоп-Слова и Многоязычность

- Векторизация Текста: От Слов к Числам, Понятным Машине

- Базовые Методы: CountVectorizer и TfidfVectorizer

- Сравнение векторизаторов:

- Word Embeddings: Word2Vec, GloVe и FastText

- Векторизация Предложений и Документов (Doc2Vec, Sentence Transformers)

- Контекстное Встраивание: BERT и Трансформеры

- Извлечение Смысла: Ключевые Задачи NLP

- Распознавание Именованных Сущностей (NER)

- Тематическое Моделирование: Поиск Скрытых Тем

- Анализ Тональности (Sentiment Analysis)

- Извлечение Ключевых Фраз и Суммаризация Текста

- Классификация Текстов: Распределение по Категориям

- Продвинутые Методы и Приложения: Глубокое Погружение

- Трансформеры (Hugging Face): Новый Горизонт NLP

- Генерация Текста и Диалогов: Творческий ИИ

- Системы Вопросно-Ответных Систем (QA) и Машинный Перевод

- Разработка Чат-Ботов на Python (Rasa Framework)

- Практические Кейсы и Инструменты: NLP в Действии

- Анализ Отзывов Клиентов: От Продуктов до Политики

- Работа с Большими Текстовыми Массивами (Big Data NLP)

- Извлечение Текста и Веб-Скрейпинг

- Визуализация Текстовых Данных

- Специфические Области Применения

- Вызовы и Будущее NLP: Куда Движемся Дальше?

- Проблемы с Данными и Их Решение

- Производительность и Масштабирование

- Этика и Предвзятость

- Новые Горизонты

От Шепота Слов к Океану Смыслов: Наш Путь в Мир Обработки Естественного Языка (NLP) на Python

Приветствуем вас, дорогие читатели, в нашей уютной гавани, где мы делимся самым сокровенным — опытом и знаниями, накопленными за годы увлекательных странствий по бескрайним просторам данных. Сегодня мы приглашаем вас в путешествие, которое изменило наше представление о том, как машины могут "понимать" человека. Речь пойдет о магии Обработки Естественного Языка, или NLP, и о том, как Python стал нашим верным проводником в этом захватывающем мире. Мы расскажем, как мы начинали с азов, преодолевали сложности и открывали для себя удивительные возможности, которые скрыты в обычных словах. Приготовьтесь, будет интересно!

В современном мире текст окружает нас повсюду: от коротких сообщений в мессенджерах до многостраничных юридических документов, от отзывов клиентов до научных статей. Все это — необъятное море информации, которое хранит в себе ценные инсайты. Но как извлечь эти жемчужины знаний из хаотичного потока слов? Именно здесь на помощь приходит NLP. Эта область на стыке искусственного интеллекта, лингвистики и информатики позволяет компьютерам не просто обрабатывать человеческий язык, но и интерпретировать его, извлекать смысл и даже генерировать новые тексты. Для нас это стало не просто технической задачей, а настоящим искусством, где каждая строка кода открывает новые грани понимания.

Наш путь в NLP начался с чистого любопытства и желания понять, как можно автоматизировать рутинные задачи, связанные с текстом. Мы быстро осознали, что Python с его богатой экосистемой библиотек — это идеальный инструмент для таких экспериментов. От простых скриптов до сложных нейросетевых моделей, Python всегда предлагал элегантные и эффективные решения. Мы пройдемся по основным этапам этого пути, делясь нашими находками, ошибками и, конечно же, успехами. Надеемся, что наш опыт вдохновит и вас на собственные исследования в этой увлекательной области.

Фундамент Понимания: Первые Шаги в Предобработке Текста

Прежде чем машина сможет "понять" текст, его нужно подготовить. Представьте, что вы хотите прочитать книгу, написанную на незнакомом языке, да еще и с опечатками, сокращениями и без пробелов. Примерно так выглядит сырой текст для компьютера. Поэтому первым и одним из самых важных этапов в любом NLP-проекте является предобработка данных. Именно здесь мы закладываем фундамент для дальнейшего анализа, превращая хаотичный поток символов в структурированные и осмысленные единицы. Этот этап может показаться рутинным, но мы убедились, что качество предобработки напрямую влияет на результат всей работы.

Наши первые эксперименты в предобработке начались с библиотеки NLTK (Natural Language Toolkit), это, пожалуй, одна из старейших и наиболее полных библиотек для работы с естественным языком в Python. Мы помним, как с восторгом открывали для себя ее возможности, начиная с простейших, но таких важных операций, как токенизация.

Токенизация и Стемминг: Разбираем Текст на Части

Токенизация, это процесс разбиения текста на более мелкие смысловые единицы, называемые токенами. Чаще всего токенами являются слова, но это могут быть и символы пунктуации, и даже целые предложения. Мы использовали NLTK для токенизации предложений и слов, что позволяло нам получить список отдельных элементов, с которыми уже можно было работать. Например, предложение "Мы изучаем NLP." превращается в токены ["Мы", "изучаем", "NLP", "."]. Это кажется элементарным, но без этого шага дальнейший анализ был бы невозможен.

После токенизации мы столкнулись с проблемой того, что одно и то же слово может иметь разные формы ("бежать", "бежит", "бежал"). Чтобы компьютер воспринимал их как одно и то же понятие, нам нужен был стемминг — процесс усечения слов до их корневой формы (стема). NLTK предлагает несколько стеммеров, например, PorterStemmer и SnowballStemmer. Последний оказался полезен для русского языка. Несмотря на свою простоту, стемминг имеет недостатки: он может создавать несуществующие слова (например, "красив" из "красивый"). Но для быстрых итераций это был отличный старт.

Лемматизация: К Точной Основной Форме

Осознав ограничения стемминга, мы начали искать более продвинутые методы нормализации слов. Так мы пришли к лемматизации. В отличие от стемминга, который просто отсекает окончания, лемматизация приводит слово к его словарной форме (лемме), используя при этом морфологический анализ. Например, слова "бежать", "бежит", "бежал" будут приведены к лемме "бежать". Для нас это было настоящим прорывом в точности обработки.

Мы активно использовали spaCy для лемматизации. Эта библиотека гораздо "умнее" NLTK в плане морфологического анализа и предоставляет высококачественные модели для различных языков. Работа с spaCy сразу показала нам, насколько мощными могут быть специализированные инструменты, когда речь идет о языковом анализе.

Регулярные Выражения (re) и Очистка Текста

Любой реальный текстовый корпус далек от идеала. Он содержит HTML-теги, специальные символы, лишние пробелы, URL-адреса, цифры и многое другое, что мешает анализу. Здесь на сцену выходят регулярные выражения (библиотека `re` в Python). Мы научились виртуозно использовать их для удаления всего лишнего:

- Удаление HTML-тегов из веб-страниц, полученных с помощью Beautiful Soup.

- Извлечение конкретных паттернов, таких как даты, номера телефонов или email-адреса.

- Очистка от пунктуации и специальных символов.

- Приведение текста к нижнему регистру для унификации.

Процесс очистки данных, это итеративный процесс. Мы начинали с общих правил, затем, анализируя ошибки, добавляли более специфичные. Например, для русского языка мы разработали инструмент для нормализации сленга и работы с эмодзи, что оказалось критически важным при анализе сообщений в социальных сетях.

Стоп-Слова и Многоязычность

Стоп-слова — это часто встречающиеся, но малоинформативные слова (например, "и", "в", "на", "он", "она"). Их удаление помогает сократить объем данных и сфокусироваться на более значимых словах. NLTK предоставляет списки стоп-слов для многих языков, но мы часто создавали и свои, специфичные для конкретных предметных областей.

Работа с многоязычными текстовыми корпусами поставила перед нами новые вызовы. Русский, английский, немецкий — каждый язык имеет свои особенности морфологии и синтаксиса. Здесь нам очень помогли библиотеки, такие как Polyglot и Stanza; Polyglot отлично подходит для базовых задач, таких как определение языка или токенизация на редких языках. Stanza же, разработанная Stanford NLP Group, предоставляет полноценные конвейеры для обработки языков с богатой морфологией, включая русский, с возможностью POS-теггинга, лемматизации и синтаксического парсинга. Это позволило нам расширить горизонты наших проектов, выходя за рамки англоязычных данных.

| Шаг предобработки | Цель | Примеры инструментов |

|---|---|---|

| Токенизация | Разбить текст на слова/предложения | NLTK, spaCy |

| Стемминг/Лемматизация | Привести слова к базовой форме | NLTK (PorterStemmer, SnowballStemmer), spaCy |

| Очистка от шума | Удалить HTML, пунктуацию, цифры | re (регулярные выражения), Beautiful Soup |

| Удаление стоп-слов | Убрать малоинформативные слова | NLTK, собственные списки |

| Приведение к нижнему регистру | Унифицировать регистр символов | Методы строк Python |

Векторизация Текста: От Слов к Числам, Понятным Машине

После того как текст очищен и приведен в порядок, перед нами встает новая задача: как представить слова и предложения в виде, понятном компьютеру? Ведь машины работают с числами, а не с буквами. Этот процесс называется векторизацией или встраиванием (embeddings). Это был один из самых захватывающих этапов нашего обучения, когда мы увидели, как абстрактные идеи превращаються в многомерные векторы, открывая путь к сложным алгоритмам машинного обучения.

Мы начали с относительно простых, но очень эффективных методов, которые до сих пор остаются рабочими лошадками во многих проектах.

Базовые Методы: CountVectorizer и TfidfVectorizer

CountVectorizer, это метод, который создает вектор для каждого документа, где каждая компонента вектора соответствует частоте появления слова из всего корпуса текстов. Проще говоря, он считает, сколько раз каждое слово встречается в документе. Мы использовали его для задач классификации, когда было важно, какие слова присутствуют и как часто.

Однако мы быстро поняли, что простое количество вхождений не всегда отражает важность слова. Очень частые слова, такие как "и" или "в", будут иметь высокие значения, но не несут много смысла. Здесь на помощь пришел TfidfVectorizer (Term Frequency-Inverse Document Frequency). Этот метод не только учитывает частоту слова в документе (TF), но и его редкость во всем корпусе (IDF). Таким образом, слова, которые часто встречаются в одном документе, но редко в других, получают более высокий вес. TF-IDF стал нашим основным инструментом для многих задач, от поиска похожих документов до извлечения ключевых слов.

Сравнение векторизаторов:

На ранних этапах мы часто задавались вопросом: что лучше, TF-IDF или Word2Vec? Ответ, как и всегда в NLP, "зависит от задачи".

- TF-IDF: Отлично подходит, когда важна уникальность слова в контексте всего корпуса. Хорош для классификации, поиска информации, извлечения ключевых слов. Не учитывает семантическую близость слов.

- Word Embeddings (Word2Vec, GloVe): Создает плотные векторы, которые отражают семантическое значение слов и их взаимосвязи. Идеален для задач, где важно "понимание" смысла, например, поиск синонимов, рекомендательные системы, более сложные классификаторы.

Мы часто начинали с TF-IDF из-за его простоты и интерпретируемости, а затем переходили к более сложным эмбеддингам, когда требовалась большая точность и учет семантики.

Word Embeddings: Word2Vec, GloVe и FastText

Настоящий прорыв в векторизации произошел с появлением Word Embeddings — плотных векторных представлений слов, которые улавливают их семантические и синтаксические отношения. Мы были поражены, когда узнали, что с помощью этих векторов можно выполнять арифметические операции, например, "король ౼ мужчина + женщина = королева".

Мы активно использовали библиотеку Gensim для работы с Word2Vec. Gensim, это мощная библиотека для работы с неструктурированными текстовыми данными, и она позволила нам легко обучать собственные модели Word2Vec на наших данных или использовать предобученные. Мы экспериментировали с двумя архитектурами Word2Vec: Skip-gram (предсказывает контекст по слову) и CBOW (предсказывает слово по контексту). В наших проектах Skip-gram часто давал лучшие результаты для редких слов.

Помимо Word2Vec, мы исследовали и другие модели:

- GloVe (Global Vectors for Word Representation): В отличие от Word2Vec, который основан на локальном контексте, GloVe использует глобальную статистику со-встречаемости слов. Мы находили, что для некоторых задач GloVe давал более сбалансированные представления.

- FastText: Это расширение Word2Vec, которое учитывает подсловные единицы (символьные n-граммы). Это позволяет FastText генерировать векторы для слов, не встречавшихся в обучающем корпусе (out-of-vocabulary words), и лучше работать с морфологически богатыми языками, а также с редкими словами. Для русского языка FastText оказался особенно ценным.

Векторизация Предложений и Документов (Doc2Vec, Sentence Transformers)

Представление отдельных слов в виде векторов — это здорово, но что, если нам нужно получить векторное представление целого предложения или документа? Здесь мы обратились к Doc2Vec (расширение Word2Vec) и Sentence Transformers.

- Doc2Vec: Позволяет получить векторное представление для целого документа. Это было крайне полезно для задач, таких как поиск похожих документов, кластеризация или рекомендательные системы. Мы использовали Gensim для реализации Doc2Vec.

- Sentence Transformers: Это более современный подход, который использует трансформерные архитектуры (о которых мы поговорим позже) для создания семантически осмысленных векторных представлений предложений и даже коротких параграфов. Мы были поражены точностью этих моделей в задачах измерения сходства предложений и поиска семантически похожих текстов.

Контекстное Встраивание: BERT и Трансформеры

Самый значительный прорыв в векторизации произошел с появлением контекстного встраивания, реализованного в таких моделях, как BERT (Bidirectional Encoder Representations from Transformers). В отличие от Word2Vec, где каждое слово имеет один фиксированный вектор, BERT генерирует вектор для слова, который зависит от его контекста в предложении. Это означает, что слово "банк" будет иметь разные векторы в предложениях "сидеть на берегу банка" и "взять кредит в банке".

Работа с трансформерными моделями, особенно через библиотеку Hugging Face Transformers, стала для нас настоящим открытием. Это позволило нам не только использовать предобученные мощные модели, но и тонко настраивать (fine-tuning) их под наши специфические задачи, достигая результатов, которые ранее казались недостижимыми. Подробнее о трансформерах мы расскажем чуть позже, но уже на этом этапе векторизации стало ясно, что они меняют правила игры.

Извлечение Смысла: Ключевые Задачи NLP

После того как текст подготовлен и представлен в числовом виде, мы можем приступить к самому интересному — извлечению из него полезной информации и решению конкретных задач. Этот раздел нашего путешествия посвящен основным задачам NLP, которые мы решали, используя различные подходы и библиотеки. Здесь мы учились не просто обрабатывать слова, но и "читать между строк", выявлять скрытые закономерности и принимать решения на основе текста.

Распознавание Именованных Сущностей (NER)

Одной из первых задач, которая нас по-настоящему увлекла, было Распознавание Именованных Сущностей (NER). Это процесс идентификации и классификации именованных сущностей в тексте, таких как имена людей, названия организаций, географические объекты, даты и т.д. Например, в предложении "Илон Маск основал SpaceX в Калифорнии" NER должен выделить "Илон Маск" как человека, "SpaceX" как организацию и "Калифорния" как место.

Мы начали с spaCy для быстрого NER. SpaCy имеет отличные предобученные модели, которые позволяют выполнять NER с высокой точностью "из коробки" и на нескольких языках, включая русский. Это было невероятно удобно для быстрого прототипирования. Позже мы углубились в более сложные методы, такие как использование CRF (Conditional Random Fields) для распознавания сущностей, когда требовалась большая гибкость и возможность обучения на собственных данных. С появлением трансформеров, таких как BERT, точность NER вышла на совершенно новый уровень, и мы активно применяли эти модели через Hugging Face для самых сложных задач.

Тематическое Моделирование: Поиск Скрытых Тем

Как понять, о чем говорят тысячи или миллионы документов, не читая каждый из них? Здесь на помощь приходит Тематическое Моделирование, набор алгоритмов, которые позволяют автоматически обнаружить абстрактные "темы", присутствующие в коллекции документов. Для нас это стало мощным инструментом для анализа больших массивов текстов, например, отзывов клиентов или новостных статей.

Мы активно использовали библиотеку Gensim для реализации таких моделей, как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing). LDA, в частности, очень хорошо показала себя в наших проектах по анализу текстов отзывов клиентов, позволяя выявить основные болевые точки или, наоборот, преимущества продуктов. Мы также экспериментировали с NMF (Non-negative Matrix Factorization) и сравнивали его с LDA, чтобы понять, какой метод лучше подходит для конкретных данных.

"Язык – это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Эта цитата Риты Мэй Браун идеально отражает наше отношение к NLP. Мы не просто обрабатываем данные; мы пытаемся понять культуру, историю и намерения, которые стоят за каждым словом.

Анализ Тональности (Sentiment Analysis)

В эпоху социальных сетей и онлайн-отзывов понимание эмоциональной окраски текста стало критически важным. Анализ тональности — это процесс определения эмоционального отношения автора к предмету, выраженного в тексте (положительное, отрицательное, нейтральное).

Мы начали с простого, но эффективного инструмента — VADER (Valence Aware Dictionary and sEntiment Reasoner). VADER отлично подходит для анализа тональности сообщений в социальных сетях, так как он специально обучен на данных из Twitter и учитывает эмодзи, сленг и акронимы. Мы использовали его для анализа отзывов о фильмах и продуктах. Позже мы перешли к более сложным моделям, включая машинное обучение (SVM, наивный байесовский классификатор) с использованием Scikit-learn, а затем и к трансформерам, которые показали выдающиеся результаты даже при анализе тональности с учетом сарказма.

Извлечение Ключевых Фраз и Суммаризация Текста

Когда у вас есть длинный текст, не всегда есть время читать его полностью. Поэтому задачи извлечения ключевых фраз и суммаризации текста стали для нас очень актуальными.

- Извлечение ключевых фраз: Мы использовали такие алгоритмы, как RAKE (Rapid Automatic Keyword Extraction) и TextRank. RAKE основан на частотности слов и их со-встречаемости, а TextRank (похожий на Google PageRank) выделяет важные предложения или слова на основе их связей в тексте. TextRank также оказался очень полезен для выделения тем в больших коллекциях документов.

- Суммаризация текста: Мы экспериментировали с двумя основными подходами:

- Экстрактивная суммаризация: Выбирает наиболее важные предложения из оригинального текста и объединяет их. Это проще в реализации и часто дает хорошие результаты.

- Абстрактивная суммаризация: Генерирует новый текст, который передает основной смысл оригинала, но не обязательно содержит его оригинальные предложения. Это более сложная задача, требующая использования генеративных моделей, таких как трансформеры. Мы были восхищены тем, как современные трансформерные модели могут создавать связные и осмысленные резюме.

Классификация Текстов: Распределение по Категориям

Классификация текстов — это одна из самых распространенных задач в NLP. Она заключается в присвоении тексту одной или нескольких предопределенных категорий. Мы применяли Scikit-learn для классификации текстов, используя различные алгоритмы машинного обучения, такие как SVM (Support Vector Machine), наивный байесовский классификатор и логистическую регрессию. Например, мы разработали системы для автоматической категоризации новостных статей или анализа отзывов о продуктах по категориям.

С появлением глубокого обучения, мы стали использовать PyTorch/TensorFlow для создания нейросетей NLP, таких как LSTM-сети, которые показали значительно лучшие результаты на больших и сложных корпусах данных. И, конечно, BERT для задач классификации стал новым стандартом, позволяя достигать state-of-the-art результатов.

Продвинутые Методы и Приложения: Глубокое Погружение

По мере того, как мы осваивали основы, мы начали понимать, что потенциал NLP гораздо шире, чем просто анализ слов. Мы углубились в мир глубокого обучения и трансформеров, которые открыли для нас совершенно новые горизонты в обработке естественного языка. Это был этап, когда мы перестали просто "обрабатывать" текст и начали заставлять машины "думать" и "творить".

Трансформеры (Hugging Face): Новый Горизонт NLP

Появление архитектуры Трансформеров и моделей, основанных на ней (BERT, GPT, T5 и многие другие), стало настоящей революцией в NLP. Эти модели способны улавливать долгосрочные зависимости в тексте и понимать контекст слов с беспрецедентной точностью. Библиотека Hugging Face Transformers стала для нас краеугольным камнем в работе с этими моделями. Она предоставляет удобный интерфейс для загрузки и использования сотен предобученных моделей, а также для их тонкой настройки под конкретные задачи.

Мы использовали трансформеры для широкого спектра задач: от NER и анализа тональности до генерации текста и машинного перевода. Возможность взять предобученную модель (например, на огромном корпусе текстов из интернета) и затем тонко настроить (fine-tuning) ее на наших специфических данных, позволила нам достигать невероятных результатов при относительно небольших затратах на обучение.

Генерация Текста и Диалогов: Творческий ИИ

Одна из самых впечатляющих возможностей трансформеров, это генерация текста. С моделями, такими как GPT (Generative Pre-trained Transformer), мы смогли генерировать связные, осмысленные и даже стилистически выдержанные тексты. Это открыло двери для таких приложений, как:

- Автоматическое создание тегов и заголовков для статей.

- Разработка систем для автоматического перефразирования текста.

- Генерация ответов в чат-ботах, создание диалогов.

- Даже помощь в написании кода или создании контента.

Использование Transformer-моделей для генерации диалогов позволило нам создать более естественные и интерактивные чат-боты.