- Расшифровываем Текст: Наш Путь в Захватывающий Мир Обработки Естественного Языка (NLP) на Python

- Первые Шаги: От Сырого Текста к Структурированным Данным

- Токенизация и Стемминг: Разбираем Текст на Части

- Лемматизация: За Гранью Стемминга

- Очистка Текста: Избавляемся от Шума

- Core NLP: От Слов к Значениям и Структурам

- Векторизация Текста: Математическое Представление Слов

- Распознавание Именованных Сущностей (NER) с spaCy

- Тематическое Моделирование с Gensim: Открываем Скрытые Темы

- За Гранью Слов: Векторы‚ Эмоции и Глубокое Обучение

- Word Embeddings: Слово как Вектор Смысла

- Анализ Тональности (Sentiment Analysis): Чувства в Тексте

- Трансформеры и Глубокое Обучение: Новый Уровень Понимания

- Практические Приложения и Вызовы Реального Мира

- Работа с Разнородными Данными

- Извлечение Информации и Знаний

- Создание Интеллектуальных Систем

Расшифровываем Текст: Наш Путь в Захватывающий Мир Обработки Естественного Языка (NLP) на Python

Добро пожаловать‚ дорогие читатели‚ в нашу цифровую лабораторию‚ где мы с вами погрузимся в одну из самых увлекательных и быстро развивающихся областей современного программирования – обработку естественного языка‚ или NLP (Natural Language Processing)․ Возможно‚ вы уже слышали эти три заветные буквы‚ а может быть‚ только начинаете свой путь․ В любом случае‚ мы уверены‚ что наш опыт и практические наработки помогут вам лучше понять‚ как можно заставить компьютеры не просто читать‚ но и понимать‚ анализировать и даже генерировать человеческую речь․ Это путешествие‚ в котором мы откроем для себя мощь Python и его библиотек‚ превращая безликий текст в ценные данные и проницательные инсайты․

На протяжении многих лет мы активно работаем с текстами‚ и каждый новый проект открывает перед нами удивительные горизонты․ От анализа огромных массивов клиентских отзывов до создания интеллектуальных чат-ботов и систем машинного перевода – везде в основе лежит NLP․ Мы научились видеть в словах не просто символы‚ а целые миры‚ наполненные смыслом‚ эмоциями и скрытыми связями․ И сегодня мы хотим поделиться с вами этим знанием‚ проведя вас через ключевые концепции и инструменты‚ которые стали нашими верными спутниками в этом увлекательном приключении․ Приготовьтесь‚ будет интересно!

Первые Шаги: От Сырого Текста к Структурированным Данным

Наше путешествие в мир NLP начинается с самого фундаментального – понимания того‚ как подготовить текст к анализу․ Представьте себе гору сырых данных: статьи‚ твиты‚ обзоры‚ логи; Все это – неструктурированный текст‚ который компьютеру сам по себе ничего не говорит․ Наша задача – "научить" его видеть в этом хаосе порядок․ И здесь на помощь приходят базовые‚ но крайне важные операции․

Токенизация и Стемминг: Разбираем Текст на Части

Первое‚ что мы делаем‚ работая с любым текстом‚ это токенизация․ Это процесс разбиения текста на отдельные единицы‚ или "токены"․ Токенами могут быть слова‚ символы или даже целые фразы‚ в зависимости от задачи․ Например‚ предложение "Мы изучаем NLP․" будет токенизировано в ["Мы"‚ "изучаем"‚ "NLP"‚ "․"]․ Этот‚ казалось бы‚ простой шаг критически важен‚ ведь именно токены станут основными строительными блоками для дальнейшего анализа․ Мы активно используем библиотеку NLTK (Natural Language Toolkit) для этих целей‚ она предоставляет отличные инструменты для различных видов токенизации․

После токенизации часто возникает необходимость привести слова к их базовой форме․ Здесь в игру вступают стемминг и лемматизация․ Стемминг – это грубый процесс отсечения окончаний слов‚ чтобы привести их к общему "стволу" (stem)․ Например‚ слова "бегущий"‚ "бежал"‚ "бегать" могут быть приведены к "бег"․ Это полезно для сокращения словаря и объединения похожих слов․ Однако у стемминга есть недостаток: полученные "стволы" не всегда являются реальными словами․

Пример работы стеммера в NLTK:

import nltk

from nltk․stem import PorterStemmer

stemmer = PorterStemmer

words = ["running"‚ "runs"‚ "ran"‚ "runner"]

stemmed_words = [stemmer․stem(word) for word in words]

# Результат: ['run'‚ 'run'‚ 'ran'‚ 'runner']

Лемматизация: За Гранью Стемминга

Лемматизация‚ в свою очередь‚ более интеллектуальный процесс; Она использует морфологический анализ словаря‚ чтобы привести слово к его лемме – словарной форме․ Так‚ "бегущий"‚ "бежал"‚ "бегать" будут приведены к "бежать"․ Это обеспечивает более точное представление текста‚ сохраняя грамматическую корректность․ Мы часто отдаем предпочтение лемматизации‚ особенно когда точность критична‚ и активно используем для этого NLTK (WordNetLemmatizer) или более продвинутые инструменты из spaCy или Stanza‚ особенно для языков с богатой морфологией‚ таких как русский․

Сравнение стемминга и лемматизации:

| Исходное слово | Стемминг (PorterStemmer) | Лемматизация (WordNetLemmatizer) |

|---|---|---|

| running | run | run |

| better | better | good |

| geese | gees | goose |

Очистка Текста: Избавляемся от Шума

После токенизации и нормализации (стемминг/лемматизация) мы переходим к очистке данных․ Это критически важный этап‚ поскольку сырой текст содержит много "шума": знаки препинания‚ числа‚ стоп-слова (артикли‚ предлоги‚ союзы‚ которые не несут основной смысловой нагрузки)‚ HTML-теги‚ специальные символы‚ эмодзи и даже сленг․ Мы активно используем регулярные выражения (библиотека `re`) для удаления ненужных символов‚ очистки от HTML-тегов‚ и приведения текста к нижнему регистру․

Типичные шаги по очистке текста включают:

- Приведение к нижнему регистру․

- Удаление знаков препинания․

- Удаление чисел․

- Удаление стоп-слов (например‚ "и"‚ "в"‚ "на"‚ "он" – списки стоп-слов доступны в NLTK)․

- Удаление HTML-тегов и других структурных элементов (часто с помощью Beautiful Soup для веб-скрейпинга)․

- Обработка эмодзи и сленга (требует создания специальных словарей или использования продвинутых моделей)․

Мы всегда помним‚ что нет универсального решения для очистки․ Каждый проект требует индивидуального подхода‚ а иногда даже разработки собственных инструментов для нормализации сленга или проверки грамматики‚ если мы работаем с очень специфическими данными․

Core NLP: От Слов к Значениям и Структурам

Когда текст очищен и приведен в порядок‚ мы готовы к более глубокому анализу․ Здесь на сцену выходят мощные библиотеки и методы‚ которые позволяют нам извлекать из текста гораздо больше‚ чем просто слова․ Мы переходим от предобработки к непосредственно пониманию смысла и структуры․

Векторизация Текста: Математическое Представление Слов

Для того чтобы алгоритмы машинного обучения могли работать с текстом‚ нам необходимо преобразовать слова в числовой формат․ Этот процесс называется векторизацией․ Мы часто используем два основных подхода:

- CountVectorizer: Создает матрицу‚ где каждая строка представляет документ‚ а каждый столбец – слово из всего корпуса․ Значение в ячейке – это количество вхождений слова в документ․ Просто и эффективно для многих задач․

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): Улучшенная версия CountVectorizer․ Он не просто считает вхождения‚ но и взвешивает их‚ учитывая‚ насколько часто слово встречается в конкретном документе (TF) и насколько редко оно встречается во всем корпусе (IDF)․ Это помогает выявить наиболее значимые слова․

Мы разработали множество собственных векторизаторов текста‚ адаптируя их под специфические нужды проектов‚ будь то анализ юридических документов или отзывов о продуктах․ Сравнение различных методов векторизации (TF-IDF vs Word2Vec‚ например) – это отдельная тема для глубоких исследований‚ и мы постоянно ищем оптимальные решения․

Распознавание Именованных Сущностей (NER) с spaCy

Одной из наиболее востребованных задач в NLP является распознавание именованных сущностей (Named Entity Recognition‚ NER)․ Это процесс идентификации и классификации именованных сущностей в тексте‚ таких как имена людей‚ названия организаций‚ географические объекты‚ даты‚ денежные суммы и т․д․ Мы активно используем библиотеку spaCy для быстрого и точного NER․ Она предоставляет предобученные модели для многих языков‚ что позволяет нам буквально в несколько строк кода извлекать ценную информацию․

Пример NER с spaCy:

import spacy

# Загружаем русскую модель

nlp = spacy․load("ru_core_news_sm")

text = "Лев Толстой родился в 1828 году в Ясной Поляне․"

doc = nlp(text)

print("Извлеченные сущности:")

for ent in doc․ents:

print(f" {ent․text} ⎯ {ent․label_}")

# Результат:

# Лев Толстой ー PER (персона)

# 1828 году ー DATE (дата)

# Ясной Поляне ⎯ LOC (местоположение)

Мы также экспериментируем с Flair и CRF (Conditional Random Fields) для более продвинутых и кастомизированных NER-моделей‚ особенно когда стандартные модели не справляются со спецификой наших данных‚ например‚ с медицинскими или юридическими терминами․ Оценка качества NER-моделей (F1-score‚ Precision‚ Recall) является неотъемлемой частью нашей работы․

Тематическое Моделирование с Gensim: Открываем Скрытые Темы

Часто нам нужно понять‚ о чем говорят большие объемы текста‚ выявить скрытые темы или кластеры документов․ Для этого мы применяем тематическое моделирование․ Библиотека Gensim является нашим основным инструментом для таких задач‚ предлагая реализации алгоритмов‚ как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing)․ Эти алгоритмы позволяют автоматически обнаруживать абстрактные "темы" в коллекции документов․

Мы использовали LDA для анализа текстов отзывов клиентов‚ постов в социальных сетях‚ блогов и форумов‚ выявляя популярные темы обсуждений‚ проблемные зоны продуктов или услуг․ Сравнение моделей тематического моделирования (LDA vs NMF) помогает нам выбирать наиболее подходящий подход для конкретной задачи․

"Язык – это дорожная карта культуры․ Он говорит вам‚ откуда пришли его люди и куда они идут․"

— Рита Мэй Браун

За Гранью Слов: Векторы‚ Эмоции и Глубокое Обучение

Наш опыт показывает‚ что простого подсчета слов или определения их базовых форм часто недостаточно․ Для по-настоящему глубокого понимания текста нам нужно уловить его смысл и контекст․ Здесь на помощь приходят более продвинутые концепции и технологии․

Word Embeddings: Слово как Вектор Смысла

Одним из революционных прорывов в NLP стало появление Word Embeddings․ Вместо того чтобы представлять слова как дискретные сущности‚ мы теперь можем представлять их как плотные векторы чисел в многомерном пространстве․ Слова‚ имеющие схожий смысл или контекст‚ располагаются близко друг к другу в этом пространстве․

Мы активно работаем с такими моделями‚ как:

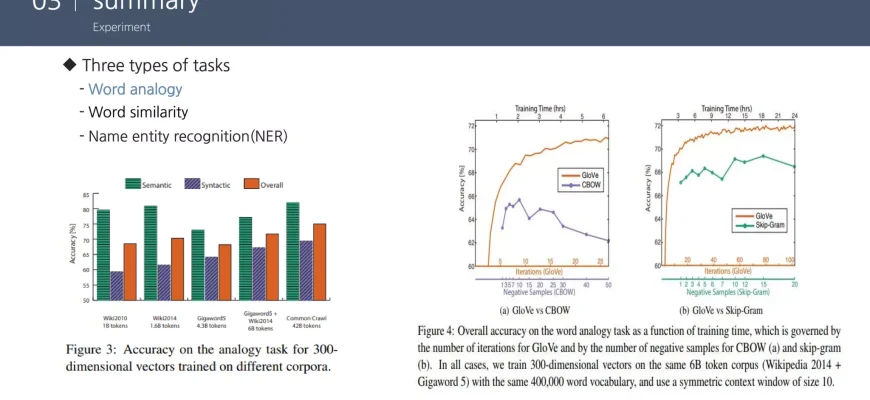

- Word2Vec (Skip-gram и CBOW): Позволяет обучать векторные представления слов на больших текстовых корпусах․ Мы часто используем Gensim для обучения собственных моделей Word2Vec или загружаем предобученные․

- GloVe (Global Vectors for Word Representation): Еще одна популярная модель для создания векторных представлений слов‚ которая учитывает глобальную статистику со-встречаемости слов․

- FastText: Расширение Word2Vec‚ которое учитывает подсловные единицы (символьные n-граммы)‚ что делает его особенно эффективным для работы с редкими словами и морфологически богатыми языками․

- Doc2Vec: Расширяет идею Word2Vec на целые документы‚ позволяя нам получать векторные представления не только слов‚ но и предложений или целых текстов․ Это бесценно для сравнения документов и поиска похожих статей․

Использование Word Embeddings кардинально улучшило качество многих наших проектов‚ таких как:

- Классификация текстов․

- Анализ тональности․

- Поиск похожих документов․

- Разработка систем вопросно-ответных систем (QA)․

Анализ Тональности (Sentiment Analysis): Чувства в Тексте

Понимание эмоциональной окраски текста – это еще одна важнейшая задача․ Анализ тональности позволяет нам определить‚ является ли отзыв положительным‚ отрицательным или нейтральным․ Мы используем различные подходы:

VADER (Valence Aware Dictionary and sEntiment Reasoner): Отлично подходит для анализа тональности сообщений в социальных сетях (Twitter‚ Reddit) благодаря своей способности учитывать сленг‚ эмодзи и акронимы․

- Модели машинного обучения: Мы обучаем собственные классификаторы (например‚ с помощью Scikit-learn) на размеченных данных․

- Трансформеры: Современные модели‚ о которых мы поговорим чуть позже‚ демонстрируют выдающиеся результаты в анализе тональности‚ даже с учетом сарказма и сложных контекстов․

Мы активно применяем анализ тональности для оценки отзывов о продуктах‚ анализа финансовых новостей‚ мониторинга бренда в социальных медиа․ Это позволяет нашим клиентам принимать более обоснованные решения․

Трансформеры и Глубокое Обучение: Новый Уровень Понимания

Последние несколько лет ознаменовались настоящей революцией в NLP благодаря появлению трансформерных архитектур․ Эти модели‚ разработанные с использованием глубоких нейронных сетей‚ способны улавливать долгосрочные зависимости в тексте и понимать контекст на беспрецедентном уровне․ Мы активно работаем с библиотекой Hugging Face Transformers‚ которая стала де-факто стандартом для работы с такими моделями‚ как BERT‚ GPT‚ RoBERTa и многими другими․

Трансформеры открыли перед нами новые возможности:

- Продвинутый NER: Более точное распознавание сущностей‚ включая их связи․

- Классификация текстов: Значительное повышение точности по сравнению с традиционными методами․ Мы используем BERT для задач классификации‚ таких как категоризация статей или анализ тональности финансовых новостей․

- Генерация текста (GPT): Создание связных и осмысленных текстов‚ что мы применяем для автоматического создания ответов в чат-ботах или суммаризации․

- Машинный перевод: Разработка систем‚ способных переводить тексты с высокой точностью‚ включая узкоспециализированные домены․

- Суммаризация текста (Abstractive vs Extractive): Автоматическое создание кратких изложений документов․

Мы постоянно экспериментируем с тонкой настройкой (Fine-tuning) предварительно обученных моделей на наших собственных данных‚ чтобы добиться максимальной производительности для конкретных задач․ Также мы используем PyTorch/TensorFlow для создания и обучения собственных нейросетей‚ включая LSTM-сети‚ когда это необходимо․ Обработка текста с использованием GPU-ускорения стала стандартом для работы с этими сложными моделями․

Практические Приложения и Вызовы Реального Мира

Знания и инструменты – это одно‚ но применение их на практике‚ в условиях реальных данных‚ всегда сопряжено с уникальными вызовами․ Мы сталкивались с ними многократно и выработали подходы‚ которые позволяют нам эффективно решать самые разнообразные задачи․

Работа с Разнородными Данными

Наш опыт включает работу с очень широким спектром текстовых данных:

Веб-скрейпинг: Мы используем Beautiful Soup для извлечения текста из веб-страниц‚ что является первым шагом для многих проектов‚ от мониторинга новостей до анализа рыночных трендов․

Извлечение текста из PDF: С помощью PyMuPDF мы успешно извлекаем информацию из PDF-документов‚ что особенно актуально для анализа юридических и финансовых документов․

Многоязычные текстовые корпусы: Работа с текстами на разных языках требует специальных подходов․ Мы используем Polyglot и Stanza‚ особенно для языков с богатой морфологией‚ а также для анализа редких языков․

Социальные сети: Анализ тональности сообщений в социальных сетях‚ выявление паттернов поведения в чатах‚ работа с эмодзи и сленгом – это отдельная большая область‚ где мы применяем наши навыки․

Специализированные тексты: Анализ текста в медицинских записях‚ юридических контрактах‚ финансовых отчетах требует не только NLP-навыков‚ но и глубокого понимания предметной области․

Извлечение Информации и Знаний

Помимо базового анализа‚ мы разрабатываем системы для извлечения конкретной информации:

Наши ключевые направления:

- Извлечение ключевых фраз/слов: С помощью RAKE или TextRank мы автоматически определяем наиболее важные слова и фразы в тексте․

- Создание словарей и тезаурусов: Для специфических доменов мы разрабатываем собственные терминологические базы․

- Разработка систем для извлечения дат и чисел: Критично для анализа событий и финансовых данных․

- Анализ стилистики текстов (авторский почерк): Мы работаем над системами для определения авторства текста‚ что имеет применение в криминалистике или анализе литературных произведений․

- Разработка моделей для выявления связей между сущностями: Это позволяет строить графы знаний и проводить более глубокий семантический анализ․

Создание Интеллектуальных Систем

Наконец‚ все эти технологии сходятся в разработке сложных‚ интеллектуальных систем:

Примеры наших проектов:

- Разработка чат-ботов на Python (Rasa framework): От простых диалоговых систем до сложных ассистентов‚ способных понимать естественный язык и поддерживать осмысленный диалог․

- Разработка систем вопросно-ответных систем (QA): Поиск точных ответов на вопросы в больших базах документов․

- Разработка систем обнаружения плагиата: Сравнение документов с использованием методов векторизации и измерения сходства (Textdistance);

- Автоматическая категоризация и тегирование контента: Используем классификаторы на основе Scikit-learn и трансформеров для организации больших объемов информации․

- Разработка систем автоматической разметки данных: Для обучения новых моделей часто нужна разметка‚ и мы создаем инструменты‚ которые автоматизируют этот процесс․

Мы также экспериментируем с визуализацией текстовых данных (Word Clouds‚ Heatmaps) для более наглядного представления результатов анализа․

Итак‚ мы с вами совершили впечатляющее путешествие по миру обработки естественного языка․ От самых основ – токенизации и стемминга‚ до сложнейших нейросетевых архитектур-трансформеров‚ способных понимать и генерировать текст‚ мы увидели‚ насколько далеко продвинулась эта область․ Наш опыт показывает‚ что Python и его экосистема библиотек (NLTK‚ spaCy‚ Gensim‚ Scikit-learn‚ Hugging Face‚ PyTorch/TensorFlow) предоставляют невероятно мощный и гибкий инструментарий для решения практически любых задач‚ связанных с текстом․

Мы столкнулись с множеством вызовов: обработка неполных и ошибочных данных‚ работа с редкими словами и многоязычными текстами‚ анализ тональности с учетом сарказма‚ создание систем‚ способных учиться на постоянно меняющихся данных․ Каждый такой вызов – это не препятствие‚ а возможность для роста и совершенствования․ Мы постоянно учимся‚ адаптируемся и интегрируем новейшие достижения в наши проекты‚ чтобы предоставлять нашим клиентам самые передовые и эффективные решения․

Мир NLP продолжает стремительно развиваться‚ и мы с нетерпением ждем новых прорывов‚ которые еще больше расширят границы возможного․ Надеемся‚ что этот обзор вдохновил вас на собственные эксперименты и открытия в этой захватывающей области․ Помните‚ что каждый текст – это не просто набор слов‚ а потенциальный источник ценных инсайтов‚ ждущих‚ чтобы их расшифровали․ И у нас есть все необходимые инструменты‚ чтобы это сделать․ До новых встреч в нашем блоге!

Подробнее

| Основы NLTK | NER с spaCy | Тематическое моделирование LDA | Классификация текстов Scikit-learn | Word Embeddings |

| Анализ тональности VADER | Трансформеры Hugging Face | Лемматизация и стемминг | Разработка чат-ботов Python | Векторизация текста TF-IDF |