- Расшифровка Языка Цифрового Мира: Наш Путь в Мир NLP с Python

- Первые Шаги: Токенизация, Стемминг и Лемматизация — Основы Понимания Текста

- Зачем нужны Регулярные Выражения? Очистка Данных – Наш Первый Фронт Работы

- Волшебство spaCy: Скорость и Точность в Распознавании Сущностей и Синтаксисе

- Продвинутая Лемматизация и Стемминг: Когда Контекст Имеет Значение

- Представление Текста: От Мешка Слов к Смысловым Векторам

- Разработка Собственных Векторизаторов: CountVectorizer и TfidfVectorizer

- Word Embeddings: Word2Vec, GloVe и FastText – Глубина Смысла

- Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

- Анализ Текста: От Чувств к Темам и Сущностям

- Анализ Тональности (Sentiment Analysis): Понимая Эмоции

- Тематическое Моделирование: Раскрытие Скрытых Тем

- Извлечение Ключевых Фраз и Сущностей

- Классификация Текстов: Распределение по Категориям

- Эра Трансформеров: Революция в NLP

- От NER до Генерации Текста: Мощь Трансформеров

- Практические Применения и Инструменты: От Веб-Скрейпинга до Чат-ботов

- Извлечение Текста из Различных Источников

- Создание Интеллектуальных Систем

- Работа с Многоязычными и Сложными Данными

- Визуализация и Оценка Качества

Расшифровка Языка Цифрового Мира: Наш Путь в Мир NLP с Python

Привет, дорогие читатели и коллеги-энтузиасты технологий! Сегодня мы хотим поделиться с вами нашим глубоким погружением в одну из самых захватывающих областей современного программирования и искусственного интеллекта – Обработку Естественного Языка, или как ее чаще называют, NLP (Natural Language Processing). Возможно, для кого-то это звучит как нечто из научно-фантастического фильма, но на самом деле NLP уже прочно вошло в нашу повседневную жизнь. Когда мы общаемся с голосовыми помощниками, получаем персонализированные рекомендации, или видим автоматический перевод текстов – это все магия NLP. Мы, как команда, всегда стремились не просто пользоваться готовыми решениями, но и понимать, как они устроены изнутри, и, что самое главное, создавать свои собственные.

За последние годы мы накопили колоссальный опыт в работе с текстовыми данными, и сегодня мы готовы разложить по полочкам весь наш путь, от самых азов до продвинутых архитектур трансформеров. Мы расскажем о фундаментальных инструментах и библиотеках Python, которые стали нашими верными спутниками в этом путешествии. Наша цель – не просто перечислить термины, а показать, как эти концепции применяются на практике, как они помогают нам решать реальные задачи и открывать новые горизонты в работе с текстом. Приготовьтесь к увлекательному рассказу о том, как мы научили машины понимать человеческий язык!

Первые Шаги: Токенизация, Стемминг и Лемматизация — Основы Понимания Текста

Прежде чем машина сможет "понять" текст, его нужно подготовить. Представьте, что вы читаете книгу на незнакомом языке – сначала вы пытаетесь выделить отдельные слова, затем понять их базовую форму. Именно этим и занимаются первые шаги в NLP. Мы начинали наше знакомство с библиотекой NLTK (Natural Language Toolkit) – это настоящий швейцарский нож для начальной обработки текста в Python. NLTK предоставила нам базовые инструменты, без которых дальнейшее движение было бы просто невозможно.

Одной из первых задач, с которой мы столкнулись, была токенизация. Это процесс разбиения текста на более мелкие значимые единицы, называемые токенами. Чаще всего токенами являются слова или пунктуационные знаки. Мы использовали NLTK для токенизации предложений и слов, что позволило нам перейти от сырого текстового массива к структурированному списку элементов, которые уже можно было анализировать.

Далее мы столкнулись с проблемой того, что одно и то же слово может иметь разные формы (бегать, бегу, бежал). Для эффективного анализа нам нужно было привести эти слова к их базовой форме. Здесь на помощь пришли стемминг и лемматизация.

- Стемминг – это грубый процесс отсечения окончаний слов для получения их "корня" (стема). Например, "running", "ran", "runs" могут быть сведены к "run". Мы использовали стеммеры NLTK, такие как PorterStemmer и SnowballStemmer, которые отлично справлялись с английским языком. Однако мы быстро обнаружили, что стемминг может создавать несуществующие слова и не всегда сохраняет смысл.

- Лемматизация – это более сложный и точный процесс, который приводит слово к его словарной (канонической) форме, называемой леммой. Например, "better" будет лемматизировано до "good", а не до "bettr". Для этого мы активно применяли WordNetLemmatizer из NLTK, а позднее перешли на более продвинутые решения, такие как spaCy и Stanza, особенно когда дело доходило до русского языка с его богатой морфологией. Эти библиотеки показали себя гораздо эффективнее в сохранении грамматической корректности и точности лемм.

Зачем нужны Регулярные Выражения? Очистка Данных – Наш Первый Фронт Работы

Сырой текст, который мы получаем из внешних источников – будь то веб-страницы, PDF-документы или сообщения из социальных сетей – редко бывает идеальным. Он часто содержит лишние символы, HTML-теги, URL-адреса, специальные символы и прочий "шум". Наш опыт показал, что без тщательной предобработки любые дальнейшие аналитические шаги будут неэффективными или даже ошибочными. И здесь на сцену выходят регулярные выражения (re) – мощный инструмент для поиска и манипулирования текстовыми паттернами.

Мы активно использовали модуль `re` в Python для следующих задач:

- Удаление HTML-тегов: Часто мы скрейпили данные с сайтов, и текст приходил вместе с разметкой. Регулярные выражения позволяли нам легко избавиться от тегов типа `<p>`, `<a href="…">` и т.д.

-

Удаление URL-адресов: Ссылки в тексте редко несут смысловую нагрузку для большинства задач NLP, поэтому мы их также удаляли.

- Обработка пунктуации: Иногда нам требовалось убрать всю пунктуацию, иногда – заменить множественные пробелы на одиночные, или нормализовать различные типы кавычек.

- Работа с эмодзи и сленгом: В текстах из социальных сетей мы сталкивались с эмодзи и специфическим сленгом. Регулярные выражения помогали нам либо удалять их, либо приводить к унифицированному виду, чтобы не мешать дальнейшему анализу. Для более продвинутой работы со сленгом мы даже разрабатывали собственные инструменты для его нормализации.

Эта фаза очистки данных, хоть и кажется рутинной, является критически важной. Мы всегда уделяли ей особое внимание, понимая, что "мусор на входе" неизбежно приведет к "мусору на выходе".

Волшебство spaCy: Скорость и Точность в Распознавании Сущностей и Синтаксисе

После того как мы освоили основы с NLTK, нам захотелось большего – скорости, эффективности и глубокого понимания структуры текста. И тут мы открыли для себя spaCy. Это не просто библиотека, это целая экосистема для промышленного NLP. Ее отличает невероятная скорость и предобученные модели для множества языков, включая русский.

Одной из ключевых возможностей spaCy, которую мы сразу же начали активно использовать, стало Распознавание Именованных Сущностей (NER ― Named Entity Recognition). NER позволяет автоматически находить и классифицировать именованные сущности в тексте, такие как имена людей, организации, географические названия, даты, денежные суммы и многое другое.

Представьте, что мы анализируем тысячи новостных статей. Вручную выискивать все имена политиков, названия компаний или места событий – это утопия. С помощью spaCy мы смогли автоматизировать этот процесс, что кардинально ускорило нашу работу над извлечением информации.

Вот пример того, как мы применяли NER:

| Исходный Текст | Распознанные Сущности | Тип Сущности |

|---|---|---|

| "Барак Обама посетил Берлин в мае 2017 года." | Барак Обама | PERSON (Человек) |

| Берлин | GPE (Геополитическая сущность) | |

| май 2017 года | DATE (Дата) | |

| "Google объявила о новых инвестициях в размере $10 миллионов." | ORG (Организация) | |

| $10 миллионов | MONEY (Деньги) |

Помимо NER, spaCy стал нашим основным инструментом для синтаксического парсинга. Он позволяет построить дерево зависимостей для каждого предложения, показывая, как слова связаны друг с другом грамматически. Это дало нам возможность глубже анализировать структуру предложений, понимать роли слов и даже разрабатывать системы вопросно-ответных систем (QA) на основе этих зависимостей.

Продвинутая Лемматизация и Стемминг: Когда Контекст Имеет Значение

Как мы уже упоминали, лемматизация в NLTK была хороша для старта, но spaCy вывела нас на новый уровень. Ее предобученные модели учитывают контекст слова в предложении, что делает лемматизацию намного точнее. Например, слово "saw" может быть леммой "see" (глагол) или "saw" (существительное, пила). spaCy, благодаря своим моделям POS-теггинга (Part-of-Speech Tagging), способна различить эти случаи.

Для языков с очень богатой морфологией, таких как русский, мы также активно использовали библиотеку Stanza от Stanford NLP. Stanza предоставляет state-of-the-art модели для множества языков и позволяет выполнять комплексный лингвистический анализ, включая точную лемматизацию, POS-теггинг и синтаксический анализ, что было неоценимо при обработке многоязычных текстовых корпусов.

Представление Текста: От Мешка Слов к Смысловым Векторам

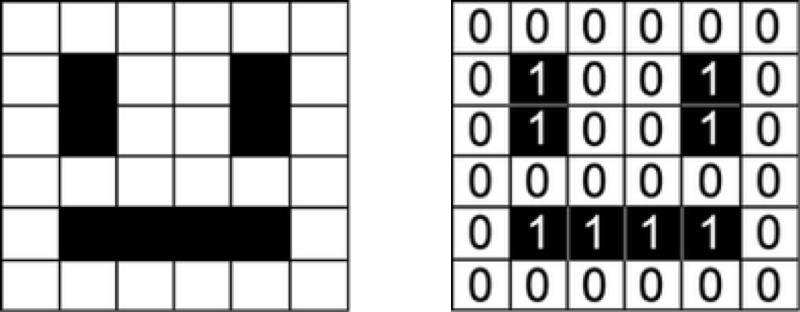

Чтобы машина могла работать с текстом, его нужно преобразовать в числовой формат. Это как перевести слова на язык, понятный компьютеру. Мы прошли долгий путь от простейших методов до сложных векторных представлений, которые улавливают семантические отношения между словами.

Разработка Собственных Векторизаторов: CountVectorizer и TfidfVectorizer

Наши первые шаги в векторизации текста были связаны с классическими моделями "мешка слов" (Bag-of-Words). Мы использовали инструменты из библиотеки Scikit-learn, которые являются стандартом в машинном обучении.

- CountVectorizer: Этот векторизатор просто подсчитывает частоту появления каждого слова в документе. Он создает матрицу, где строки – это документы, а столбцы – слова из всего корпуса, и в каждой ячейке стоит количество раз, сколько слово появилось в документе. Простой, но эффективный для многих задач, особенно когда мы только начинали.

- TfidfVectorizer: Мы быстро поняли, что простое количество слов не всегда отражает их важность. Слово "и" или "в" встречается часто, но не несет много информации. TfidfVectorizer (Term Frequency-Inverse Document Frequency) решает эту проблему, взвешивая частоту слова в документе с его обратной частотой в корпусе. Это позволяет нам выделить слова, которые являются уникальными и важными для конкретного документа, но при этом не являются повсеместными. Мы активно применяли TF-IDF для извлечения ключевых фраз и для классификации текстов.

Word Embeddings: Word2Vec, GloVe и FastText – Глубина Смысла

Хотя CountVectorizer и TfidfVectorizer были полезны, они имели существенный недостаток: они не улавливали семантические отношения между словами. Слова "король" и "королева" по этим моделям были так же далеки друг от друга, как "король" и "банан". Мы знали, что есть что-то более продвинутое, и это были Word Embeddings.

С помощью библиотеки Gensim мы погрузились в мир Word2Vec. Это нейросетевая модель, которая учится представлять слова в виде плотных векторов (эмбеддингов), где слова со схожим значением располагаются близко друг к другу в многомерном пространстве. Мы экспериментировали с двумя архитектурами Word2Vec:

- Skip-gram: Предсказывает контекстные слова по данному слову.

- CBOW (Continuous Bag-of-Words): Предсказывает текущее слово по его контексту.

Оба метода дали нам мощные эмбеддинги, которые позволили значительно улучшить качество наших моделей в задачах классификации и анализа схожести.

Помимо Word2Vec, мы также работали с GloVe (Global Vectors for Word Representation), еще одним популярным методом получения эмбеддингов, который использует глобальную статистику соо встречаемости слов.

И, конечно, FastText. Эта библиотека от Facebook AI Research особенно ценна тем, что она учитывает морфологию слов, представляя их как набор символьных n-грамм. Это позволяет FastText эффективно работать с редкими словами и даже со словами, которых не было в обучающем корпусе (out-of-vocabulary words), что было прорывом для нас.

Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

Эмбеддинги слов были отличным началом, но что, если нам нужно получить векторное представление целого предложения или даже документа? Для этого мы использовали:

- Doc2Vec (Paragraph Vectors) из Gensim: Расширение Word2Vec, которое позволяет создавать эмбеддинги не только для слов, но и для целых документов. Это было очень полезно для задач поиска схожих документов или кластеризации текстов.

- Sentence Transformers: Это более современные модели, основанные на архитектуре трансформеров, которые позволяют получать высококачественные векторные представления предложений. Они превосходно справляются с задачей измерения сходства между предложениями и используются нами для широкого круга задач, от поиска ответов до суммаризации текста.

Анализ Текста: От Чувств к Темам и Сущностям

После того как текст преобразован в числовой вид, мы можем начинать его анализировать. Здесь открывается огромное поле для исследований – от определения эмоциональной окраски до выявления скрытых тем.

Анализ Тональности (Sentiment Analysis): Понимая Эмоции

Одной из самых востребованных задач, с которой мы постоянно сталкиваемся, является анализ тональности. Понимание эмоциональной окраски текста – положительная, отрицательная или нейтральная – критически важно для анализа отзывов клиентов, сообщений в социальных сетях или финансовых новостей.

Мы начинали с простых, но эффективных инструментов:

- VADER (Valence Aware Dictionary and sEntiment Reasoner): Это лексический инструмент для анализа тональности, который особенно хорошо работает с текстами из социальных сетей. Он не требует обучения и учитывает такие нюансы, как использование заглавных букв, пунктуации и эмотиконов для определения интенсивности эмоций. Мы успешно применяли VADER для анализа тональности сообщений в Twitter и Reddit.

- TextBlob: Эта библиотека предоставляет простой API для выполнения общих задач NLP, включая анализ тональности. Она была удобна для быстрого прототипирования, хотя мы быстро столкнулись с ее ограничениями, особенно при работе с более сложными и специфическими доменами.

Для более сложных задач, таких как анализ тональности с учетом сарказма или контекста, мы переходили к моделям на основе машинного обучения и глубокого обучения, используя предварительно обученные трансформеры.

Тематическое Моделирование: Раскрытие Скрытых Тем

Когда мы работаем с большими массивами текстовых данных, например, с отзывами о продуктах или статьями из новостных лент, возникает потребность понять, о чем эти тексты в целом, какие основные темы они затрагивают. Здесь на помощь приходит тематическое моделирование.

Библиотека Gensim стала нашим основным инструментом для этого. Мы активно использовали:

- LDA (Latent Dirichlet Allocation): Это один из самых популярных алгоритмов тематического моделирования. Он позволяет нам определить, какие скрытые темы присутствуют в наборе документов и какие слова наиболее характерны для каждой темы. Мы применяли LDA для анализа отзывов, чтобы выявить основные категории жалоб или похвалы.

- LSI (Latent Semantic Indexing): Еще один метод, основанный на сингулярном разложении (SVD), который мы использовали для выявления скрытых семантических связей в тексте.

Мы также сравнивали LDA с NMF (Non-Negative Matrix Factorization), другим методом тематического моделирования, который часто дает сопоставимые или даже лучшие результаты в зависимости от характеристик данных. Мы пришли к выводу, что выбор между LDA и NMF часто зависит от конкретной задачи и свойств корпуса, и всегда проводили эксперименты для определения наилучшего подхода.

В процессе работы с тематическим моделированием мы часто сталкивались с проблемой оценки качества моделей. Здесь нам помогали метрики, такие как когерентность тем (Coherence Score), которые позволяют объективно сравнить различные модели и их параметры.

Извлечение Ключевых Фраз и Сущностей

Помимо NER, нам часто требовалось извлекать наиболее важные ключевые фразы или предложения из текста.

- RAKE (Rapid Automatic Keyword Extraction): Это алгоритм, который позволяет быстро извлекать ключевые слова и фразы из текста на основе их частотности и встречаемости с другими словами. Мы использовали его для быстрого получения списка наиболее релевантных терминов в статье.

- TextRank: Модель, вдохновленная алгоритмом PageRank, но примененная к тексту. TextRank позволяет извлекать ключевые слова и даже целые ключевые предложения, что было очень полезно для создания экстрактивной суммаризации текста. Мы применяли TextRank для выделения тем в больших статьях и получения кратких выжимок.

"Машины должны быть способны понимать язык человека, чтобы стать по-настоящему полезными."

— Алан Тьюринг

Классификация Текстов: Распределение по Категориям

Одна из самых распространенных и мощных задач в NLP – это классификация текстов. Это позволяет нам автоматически распределять документы по заранее определенным категориям. Мы использовали классификацию для самых разных целей: от категоризации новостей и статей до анализа отзывов о продуктах по категориям.

Мы начали наше путешествие с классических методов машинного обучения, используя Scikit-learn:

- Наивный Байесовский Классификатор (Naive Bayes): Простой, но удивительно эффективный алгоритм, особенно для классификации текстов. Мы использовали его в своих ранних проектах для определения спама или категоризации писем.

- Метод Опорных Векторов (SVM ⎼ Support Vector Machines): Более мощный алгоритм, который строит гиперплоскость для разделения классов. SVM показал отличные результаты в наших задачах, особенно когда мы работали с TF-IDF векторами. Мы успешно применяли SVM для классификации текстов юридических документов и определения их типа.

С развитием технологий глубокого обучения мы перешли к более продвинутым моделям. Мы использовали PyTorch и TensorFlow для создания нейросетей, таких как LSTM (Long Short-Term Memory) сети, которые способны улавливать долгосрочные зависимости в тексте. Эти сети значительно улучшили точность наших классификаторов, особенно для длинных и сложных текстов.

И, конечно, невозможно говорить о современной классификации текстов без упоминания BERT (Bidirectional Encoder Representations from Transformers). Мы активно применяли BERT для задач классификации, тонко настраивая (fine-tuning) предварительно обученные модели на наших специфических данных. BERT, благодаря своей способности понимать контекст каждого слова в предложении, продемонстрировал впечатляющие результаты, превзойдя классические методы во многих наших проектах.

Эра Трансформеров: Революция в NLP

Если Word Embeddings были значительным шагом вперед, то трансформерные архитектуры стали настоящей революцией в NLP. Они полностью изменили наш подход к решению сложных задач. С появлением таких библиотек, как Hugging Face Transformers, мы получили доступ к десяткам тысяч предобученных моделей, которые можно легко адаптировать под свои нужды.

От NER до Генерации Текста: Мощь Трансформеров

Трансформеры позволяют нам решать практически любые задачи NLP с невиданной ранее точностью и эффективностью:

- Продвинутое NER: Мы использовали трансформеры (например, BERT, Flair) для распознавания сущностей, достигая гораздо большей точности, чем с классическими подходами, особенно при работе с нестандартными сущностями или на языках с более сложной структурой.

- Вопросно-ответные Системы (QA): Разработка систем, которые могут отвечать на вопросы на основе предоставленного текста, стала намного проще и эффективнее с трансформерами. Мы создавали QA-системы, которые могли извлекать точные ответы из больших документов.

- Суммаризация Текста: Мы освоили как экстрактивную (извлечение ключевых предложений), так и абстрактивную (генерация нового, краткого текста) суммаризацию с помощью трансформеров. Это было особенно полезно для обработки длинных новостных статей или отчетов.

- Машинный Перевод: Трансформеры являются основой современных систем машинного перевода. Мы экспериментировали с созданием собственных моделей для перевода узкоспециализированных текстов, где стандартные переводчики часто ошибались.

- Генерация Текста (GPT, T5): Возможность генерировать связный и осмысленный текст открыла для нас новые горизонты. Мы использовали трансформерные модели, такие как GPT, для создания диалогов для чат-ботов, генерации статей на заданную тему и даже для автоматического перефразирования текста.

- Распознавание Эмоций и Анализ Стилистики: Трансформеры позволяют нам не только определить тональность, но и глубже понять эмоции, выраженные в тексте, а также анализировать авторский почерк и стилистику.

- Анализ Кода: Мы даже применяли трансформеры для анализа кода, например, для его сжатия или выявления уязвимостей.

Тонкая настройка (Fine-tuning) предварительно обученных моделей на наших специфических данных стала рутинной практикой, позволяющей достигать state-of-the-art результатов при относительно небольших затратах ресурсов.

Практические Применения и Инструменты: От Веб-Скрейпинга до Чат-ботов

Вся эта теория и библиотеки были бы бесполезны без их применения в реальных проектах. Наш опыт охватывает широкий спектр практических задач, где NLP играет ключевую роль.

Извлечение Текста из Различных Источников

Прежде чем анализировать текст, его нужно получить. Мы часто сталкиваемся с необходимостью извлекать текст из различных форматов:

- Веб-скрейпинг с Beautiful Soup: Для сбора текстовых данных с веб-сайтов мы активно использовали библиотеку Beautiful Soup. Она позволяет удобно парсить HTML и XML документы, извлекая нужные нам текстовые блоки.

- Извлечение текста из PDF с PyMuPDF: Работа с PDF-документами – это отдельная головная боль, но PyMuPDF (или Fitz) оказался незаменимым инструментом для извлечения текста, а иногда и изображений, из этих файлов.

- Обработка лог-файлов: Анализ лог-файлов с помощью регулярных выражений и других NLP-техник помогал нам выявлять аномалии и паттерны в работе систем.

Создание Интеллектуальных Систем

Наши навыки в NLP позволили нам разрабатывать более сложные и интерактивные системы:

- Разработка Чат-ботов на Python (Rasa framework): Мы использовали фреймворк Rasa для создания продвинутых чат-ботов. Rasa позволяет нам строить диалоговые системы, которые не только понимают намерения пользователя, но и могут поддерживать контекст беседы, используя наши знания в NER и классификации намерений.

- Разработка Систем для Автоматической Категоризации Статей и Тегирования Контента: Основываясь на классификации текстов и тематическом моделировании, мы создавали системы, которые автоматически присваивают категории или теги новым статьям, упрощая их индексацию и поиск.

- Разработка Систем Обнаружения Плагиата: Сравнение текстов с использованием векторизации и метрик сходства (например, Textdistance, Jellyfish) позволило нам создавать инструменты для выявления плагиата.

- Разработка Инструментов для Проверки Грамматики и Орфографии: Используя продвинутые языковые модели и правила, мы экспериментировали с созданием инструментов, которые могли бы проверять грамматику и исправлять орфографические ошибки, а также нормализовать пунктуацию.

- Создание Словарей и Тезаурусов: Для специфических доменов мы разрабатывали инструменты для автоматического извлечения терминов и построения собственных словарей и тезаурусов.

- Разработка Системы для Создания FAQ на Основе Документов: Мы успешно применяли комбинацию методов извлечения информации и суммаризации для автоматического формирования ответов на часто задаваемые вопросы из больших текстовых корпусов.

Работа с Многоязычными и Сложными Данными

Мир не ограничивается одним языком, и текстовые данные часто бывают неидеальными. Мы активно работали над решением этих проблем:

- Обработка Многоязычных Текстовых Корпусов: Помимо spaCy и Stanza, мы использовали библиотеку Polyglot для анализа редких языков и выполнения таких задач, как определение языка, транслитерация и морфологический анализ.

- Работа с Нелатинскими Алфавитами: Мы успешно адаптировали наши пайплайны для работы с текстами на языках с нелатинскими алфавитами, такими как русский, арабский или китайский, что требовало особого внимания к кодировкам и специфическим токенизаторам.

- Проблемы Обработки Неполных и Ошибочных Данных: Мы разработали стратегии для работы с "грязными" данными, включая заполнение пропусков, исправление опечаток и нормализацию текста перед анализом.

Визуализация и Оценка Качества

Как опытные блогеры, мы знаем, что без наглядности и оценки результатов сложно донести ценность нашей работы.

Инструменты для Визуализации Текстовых Данных:

- Word Clouds: Простой, но эффективный способ визуализировать частотность слов в тексте.

- Heatmaps: Мы использовали тепловые карты для визуализации матриц сходства между документами или для отображения распределения тем.

- Библиотека Sweetviz: Хотя она больше ориентирована на EDA (Exploratory Data Analysis) для табличных данных, мы адаптировали ее для анализа распределения длин текстов, частотности символов и других метаданных.

Оценка Качества Моделей:

Для оценки качества наших моделей мы использовали стандартные метрики:

| Метрика | Описание | Применение |

|---|---|---|

| Precision (Точность) | Доля правильно предсказанных положительных классов из всех предсказанных положительных. | Важна, когда стоимость ложноположительного результата высока (например, в спам-фильтре). |

| Recall (Полнота) | Доля правильно предсказанных положительных классов из всех фактических положительных. | Важна, когда стоимость ложноотрицательного результата высока (например, в медицинских диагнозах). |

| F1-score | Гармоническое среднее Precision и Recall. | Хороший баланс между Precision и Recall, особенно при несбалансированных классах. |

| Accuracy (Правильность) | Доля правильно предсказанных классов из всех предсказаний. | Общая метрика, но может быть обманчива при несбалансированных классах. |

Мы всегда проводили кросс-валидацию и использовали различные тестовые наборы данных, чтобы убедиться в надежности наших моделей.

Наш путь в мире NLP был и остается невероятно увлекательным. Мы прошли от основ токенизации и стемминга до освоения мощных трансформерных архитектур, способных генерировать текст и отвечать на сложные вопросы. Мы научились очищать, векторизовать, классифицировать и анализировать текстовые данные, создавая при этом полезные инструменты и системы.

Эта область продолжает развиваться с поразительной скоростью. Каждый день появляются новые модели и методы, и мы постоянно учимся, экспериментируем и адаптируемся. Будущее NLP обещает еще более интеллектуальные системы, способные не только понимать, но и взаимодействовать с нами на человеческом языке, помогая нам решать еще более сложные задачи. Мы уверены, что Python с его богатой экосистемой библиотек останется ключевым инструментом в этом захватывающем путешествии. Надеемся, что наш опыт вдохновил вас на собственные исследования и эксперименты в мире Обработки Естественного Языка.

Подробнее: LSI Запросы к Статье

| NLTK основы | spaCy NER | Gensim тематическое моделирование | Word2Vec GloVe | Анализ тональности VADER |

| Трансформеры Hugging Face | Scikit-learn классификация текста | Регулярные выражения Python | Разработка чат-ботов Python | Лемматизация стемминг разница |