- Расшифровка Языка Машин: Наш Путь в Захватывающий Мир NLP на Python

- Первые Шаги: Строим Фундамент Понимания Текста

- Основы NLTK: Токенизация и Стемминг

- Продвинутая Лемматизация и Стоп-слова

- От Слова к Смыслу: Как Машины "Видят" Текст

- Разработка Собственных Векторизаторов: CountVectorizer и TfidfVectorizer

- Word Embeddings: Word2Vec, GloVe и FastText с использованием Gensim

- Извлекаем Смысл: Ключевые Задачи NLP и Их Решения

- Распознавание Именованных Сущностей (NER) с spaCy и Flair

- Тематическое Моделирование: Погружение в Суть Текстов

- Анализ Тональности (Sentiment Analysis): Чувства в Цифрах

- Классификация Текстов: Сортируем Информацию Автоматически

- Продвинутые Техники и Инструменты: Заглядываем в Будущее NLP

- Трансформеры (Hugging Face) для Сложных Задач NLP

- Библиотеки для Специфических Задач и Языков

- Прикладные Сценарии и Наши Решения

- Очистка и Нормализация Текстовых Данных

- Анализ Текста для Извлечения Ключевых Фраз и Суммаризация

- Разработка Чат-ботов и QA-систем

- Анализ Стилистики и Авторского Почерка

- Визуализация и Оценка Качества Моделей

- Инструменты для Визуализации Текстовых Данных

- Оценка Качества NLP-моделей

Расшифровка Языка Машин: Наш Путь в Захватывающий Мир NLP на Python

Привет, дорогие читатели и коллеги-энтузиасты! Сегодня мы отправляемся в одно из самых увлекательных путешествий в мире современных технологий – в область Обработки Естественного Языка (NLP) с помощью Python. Мы, как блогеры, ежедневно сталкиваемся с текстом: пишем его, читаем, анализируем комментарии, пытаемся понять настроения нашей аудитории. И если раньше это было прерогативой исключительно человеческого разума, то сегодня Python предлагает нам мощнейшие инструменты, способные автоматизировать и углубить это понимание до невиданных ранее масштабов.

Наш опыт показал, что погружение в NLP — это не просто изучение очередного набора библиотек. Это открытие совершенно нового способа взаимодействия с информацией, где машины начинают "слышать" и "понимать" текст так, как это делаем мы. Или, по крайней мере, стремятся к этому. Мы хотим поделиться с вами нашим путем, нашими находками и теми инструментами, которые кардинально изменили наш подход к работе с текстовыми данными. Приготовьтесь, ведь мы собираемся разобрать весь арсенал Python для NLP – от самых азов до продвинутых трансформеров, и покажем, как эти знания можно применить в реальной жизни.

Первые Шаги: Строим Фундамент Понимания Текста

Прежде чем машина сможет "прочитать" текст и извлечь из него смысл, ей необходимо его подготовить. Представьте, что вы пытаетесь проанализировать сложный документ, написанный на незнакомом языке. Сначала вы разделите его на слова, потом, возможно, попытаетесь найти корни этих слов. Именно этим и занимаются базовые методы NLP.

Основы NLTK: Токенизация и Стемминг

Наш путь в NLP начался с библиотеки NLTK (Natural Language Toolkit). Это своего рода "швейцарский нож" для новичков и опытных разработчиков, предлагающий обширный набор инструментов для работы с текстом. Одними из первых понятий, с которыми мы столкнулись, были токенизация и стемминг.

Токенизация – это процесс разбиения текста на более мелкие единицы, называемые токенами. Чаще всего токенами являются слова или предложения. Например, фраза "Мы пишем интересный блог!" может быть токенизирована в слова: ["Мы", "пишем", "интересный", "блог", "!"]. NLTK предлагает различные токенизаторы, и мы часто используем `word_tokenize` и `sent_tokenize` для начальной обработки. Это позволяет нам привести весь текст к единому формату для дальнейшего анализа, убирая лишние символы и подготавливая данные.

Стемминг же – это процесс усечения слов до их основы или "корня" (стема). Например, слова "бегущий", "бежал", "бегать" могут быть приведены к одному стему "бег". Это крайне полезно, когда нам нужно сравнивать слова по их смысловой близости, игнорируя грамматические формы. Однако у стемминга есть свой недостаток: стем не всегда является настоящим словом. Например, "красивый" может превратиться в "красив", что уже не совсем корректно с лингвистической точки зрения.

Продвинутая Лемматизация и Стоп-слова

Для более точной работы с формами слов мы быстро перешли к лемматизации. В отличие от стемминга, лемматизация приводит слова к их словарной (канонической) форме, называемой леммой. Например, "бегущий", "бежал", "бегать" будут приведены к лемме "бежать". Это гораздо точнее и позволяет сохранить смысл слова. Для лемматизации мы часто используем NLTK’s `WordNetLemmatizer` или инструменты из `spaCy`, о котором поговорим чуть позже.

Также важным шагом в предобработке является удаление стоп-слов. Это часто встречающиеся, но малоинформативные слова, такие как предлоги, союзы, артикли ("и", "в", "на", "a", "the" и т.д.). Их удаление значительно уменьшает объем данных для анализа и помогает сфокусироваться на действительно значимых словах. NLTK предоставляет списки стоп-слов для многих языков, и мы часто расширяем их собственными, специфичными для наших задач.

От Слова к Смыслу: Как Машины "Видят" Текст

Как только текст очищен и подготовлен, возникает следующая задача: как представить его в виде, понятном для алгоритмов машинного обучения? Ведь компьютеры работают с числами, а не с буквами. Здесь на помощь приходят методы векторизации текста и встраивания слов (Word Embeddings).

Разработка Собственных Векторизаторов: CountVectorizer и TfidfVectorizer

Мы начали с самых базовых, но очень эффективных векторизаторов из библиотеки Scikit-learn.

CountVectorizer: Этот векторизатор создает матрицу, где каждая строка представляет документ, а каждый столбец – уникальное слово во всем корпусе. Значение в ячейке показывает, сколько раз данное слово встречается в конкретном документе. Это просто, но эффективно для многих задач.

from sklearn.feature_extraction.text import CountVectorizer

corpus = ['Мы любим NLP', 'NLP это очень интересно']

vectorizer = CountVectorizer

X = vectorizer.fit_transform(corpus)

print(X.toarray)

TfidfVectorizer (Term Frequency-Inverse Document Frequency): Этот метод не просто считает слова, но и взвешивает их по значимости. Он учитывает, насколько часто слово встречается в документе (TF) и насколько редко оно встречается во всем корпусе документов (IDF); Таким образом, слова, которые часто встречаются в одном документе, но редко в других, получают более высокий вес, становясь более значимыми. Это помогло нам выделять действительно уникальные и важные термины в наших статьях и комментариях.

from sklearn.feature_extraction.text import TfidfVectorizer

corpus = ['Мы любим NLP', 'NLP это очень интересно']

vectorizer = TfidfVectorizer

X = vectorizer.fit_transform(corpus)

print(X.toarray)

Word Embeddings: Word2Vec, GloVe и FastText с использованием Gensim

Векторизаторы типа TF-IDF отлично работают, но они не учитывают семантическую близость слов. То есть, слова "король" и "королева" с точки зрения TF-IDF будут такими же разными, как "король" и "банан". Здесь на сцену выходят Word Embeddings – векторные представления слов, которые улавливают их смысловые отношения.

Мы активно используем библиотеку Gensim для работы с Word Embeddings.

Word2Vec: Этот алгоритм (в двух вариантах: Skip-gram и CBOW) учится предсказывать контекст слова по самому слову или наоборот. В результате каждое слово представляется вектором чисел таким образом, что семантически близкие слова имеют близкие векторы. Это открыло для нас совершенно новые возможности для анализа текстов, поиска синонимов и даже для понимания эмоциональной окраски слов.

GloVe (Global Vectors for Word Representation): Похож на Word2Vec, но основан на глобальной матрице совместной встречаемости слов. Мы обнаружили, что для некоторых задач GloVe дает более стабильные результаты.

FastText: Разработанный Facebook AI, FastText расширяет Word2Vec, учитывая не только слова целиком, но и их подслова (n-граммы символов). Это делает его особенно эффективным для работы с редкими словами и языками с богатой морфологией (например, русский), где одно слово может иметь множество форм.

Doc2Vec: Расширение Word2Vec, которое позволяет получать векторные представления не только для слов, но и для целых документов или предложений. Это стало бесценным инструментом для нас при сравнении статей, поиске похожих материалов и кластеризации текстов.

Sentence Transformers: Для получения высококачественных эмбеддингов предложений и документов мы также активно применяем Sentence Transformers. Эти модели, часто основанные на архитектуре трансформеров, способны генерировать семантически насыщенные векторы для целых фрагментов текста, что значительно улучшает качество таких задач, как поиск семантически похожих предложений или кластеризация.

"Язык – это не просто набор слов; это система, посредством которой мы придаем смысл миру и делимся этим смыслом."

— Noam Chomsky

Извлекаем Смысл: Ключевые Задачи NLP и Их Решения

Теперь, когда мы научились представлять текст в числовом виде, настало время применять эти знания для решения реальных задач. Мир NLP предлагает огромное количество инструментов для извлечения информации, классификации и даже генерации текста.

Распознавание Именованных Сущностей (NER) с spaCy и Flair

Одной из самых полезных задач для нас стала Распознавание Именованных Сущностей (NER). NER позволяет автоматически находить и классифицировать именованные сущности в тексте, такие как имена людей, названия организаций, локации, даты и т.д.. Это невероятно ценно для анализа новостей, отзывов или просто для быстрой выжимки ключевой информации.

Мы начали с spaCy – одной из самых быстрых и эффективных библиотек для NLP, особенно хорошей для производственного использования. spaCy предлагает предобученные модели для NER, которые работают "из коробки" и отлично справляются со своей задачей. Мы используем её для:

- Извлечения имен авторов из статей.

- Определения компаний, упоминаемых в финансовых новостях.

- Выявления географических названий в туристических обзорах.

Помимо spaCy, мы также исследовали Flair, особенно для более сложных задач и языков с богатой морфологией, а также для получения контекстных эмбеддингов. Flair часто дает более точные результаты, особенно при тонкой настройке на специфические данные. Для задач, где требовалось максимальная точность в распознавании сущностей с учетом контекста, мы также применяли CRF (Conditional Random Fields), хотя это уже более классический подход по сравнению с нейросетевыми моделями.

Тематическое Моделирование: Погружение в Суть Текстов

Как узнать, о чем на самом деле говорят люди в тысячах комментариев или статьях? Тематическое моделирование помогает нам обнаружить скрытые темы в больших коллекциях документов.

Библиотека Gensim стала нашим основным инструментом для этого. Мы используем:

LDA (Latent Dirichlet Allocation): Этот алгоритм позволяет нам определить "скрытые" темы в коллекции документов. Каждый документ рассматривается как смесь нескольких тем, а каждая тема – как смесь слов. LDA помог нам понять основные направления дискуссий в наших блогах, выявить популярные темы среди читателей и даже найти неочевидные связи между статьями.

LSI (Latent Semantic Indexing): Более старый, но все еще актуальный метод, основанный на сингулярном разложении матрицы. Мы использовали LSI для поиска семантически связанных документов и улучшения поиска по контенту.

NMF (Non-negative Matrix Factorization): Альтернатива LDA, которая часто дает более интерпретируемые темы, особенно когда мы работаем с разреженными матрицами. Мы сравнивали LDA и NMF, чтобы выбрать наиболее подходящий метод для конкретной задачи, часто находя, что NMF лучше работает для коротких текстов, а LDA – для более длинных и структурированных.

Сравнение моделей тематического моделирования:

| Модель | Преимущества | Недостатки | Типичное Применение |

|---|---|---|---|

| LDA | Хорошо работает с большими корпусами, гибкая в настройке. | Требует настройки гиперпараметров (число тем), темы могут быть менее интерпретируемыми. | Анализ больших коллекций документов, научных статей. |

| NMF | Часто дает более интерпретируемые темы, хорошо с разреженными данными. | Может быть менее эффективен для очень больших корпусов, чувствителен к начальной инициализации. | Анализ коротких текстов, отзывов, маркировка контента. |

| LSI | Прост в реализации, быстр для средних корпусов. | Не всегда дает четко разделенные темы, не учитывает многозначность слов. | Поиск похожих документов, сокращение размерности. |

Анализ Тональности (Sentiment Analysis): Чувства в Цифрах

Понимание настроения нашей аудитории – это то, что мы, как блогеры, ценим больше всего. Анализ тональности позволяет нам определить эмоциональную окраску текста: позитивный, негативный или нейтральный.

Мы использовали несколько подходов:

VADER (Valence Aware Dictionary and sEntiment Reasoner): Это правило-ориентированный лексический анализатор тональности, который удивительно хорошо работает для текстов из социальных сетей. VADER учитывает не только слова, но и их интенсивность (например, "очень хорошо" vs. "хорошо"), использование заглавных букв и знаков препинания. Мы часто применяем VADER для быстрого анализа комментариев на YouTube или постов в социальных сетях.

TextBlob: Эта библиотека предоставляет простой API для выполнения общих задач NLP, включая анализ тональности. Она очень удобна для быстрых прототипов и небольших проектов, но для более глубокого анализа мы предпочитаем другие инструменты.

Машинное обучение: Для более сложных задач, особенно когда VADER не справлялся с нюансами (например, сарказмом), мы обучали собственные модели классификации тональности с использованием Scikit-learn. Это включало сбор размеченных данных (отзывов с оценками), векторизацию текста (TF-IDF или Word Embeddings) и обучение классификаторов, таких как SVM (Support Vector Machine) или Наивный Байесовский классификатор. Также мы экспериментировали с использованием BERT для анализа тональности, что давало значительно более точные результаты, особенно для контекстно-зависимых выражений.

Вот список задач, где анализ тональности оказался для нас наиболее полезным:

- Анализ отзывов клиентов: Понимание общего настроения по продукту или услуге.

- Анализ тональности сообщений в социальных сетях: Мониторинг репутации бренда, реакция на события;

- Анализ тональности финансовых новостей: Прогнозирование реакции рынка.

- Выявление сарказма: Хотя это сложная задача, современные модели трансформеров показывают в ней хорошие результаты.

Классификация Текстов: Сортируем Информацию Автоматически

Представьте, что у вас есть тысячи статей, и вам нужно распределить их по категориям. Вручную это займет вечность. Классификация текстов – это задача, где мы обучаем модель автоматически присваивать метки (категории) документам.

Мы активно используем Scikit-learn для этих целей. После векторизации текста (TF-IDF или Word Embeddings) мы применяем различные алгоритмы машинного обучения:

Наивный Байесовский классификатор: Прост, быстр и часто дает хорошие результаты, особенно для текстовых данных.

Метод опорных векторов (SVM): Отлично работает для классификации, особенно когда у нас есть четко разделяемые классы.

Логистическая регрессия: Надежный и интерпретируемый алгоритм.

Для более сложных задач и когда требовалась максимальная точность, мы перешли к глубокому обучению. PyTorch и TensorFlow стали нашими платформами для создания нейросетей NLP, таких как LSTM (Long Short-Term Memory), которые хорошо справляются с последовательными данными, такими как текст. А с появлением трансформерных моделей (BERT) из библиотеки Hugging Face, мы смогли значительно улучшить качество классификации, используя предварительно обученные модели и их тонкую настройку (fine-tuning) под наши специфические задачи.

Продвинутые Техники и Инструменты: Заглядываем в Будущее NLP

Мир NLP не стоит на месте, и мы постоянно исследуем новые горизонты. Современные модели трансформеров и глубокое обучение открыли двери для решения задач, которые раньше казались невозможными.

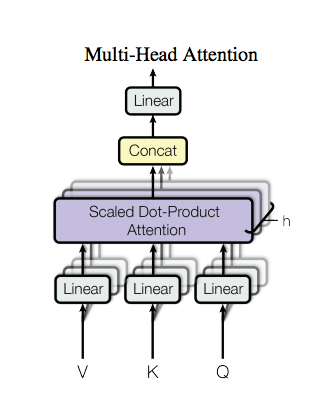

Трансформеры (Hugging Face) для Сложных Задач NLP

Библиотека Hugging Face Transformers стала настоящим прорывом. Она предоставляет легкий доступ к сотням предварительно обученных моделей, таких как BERT, GPT, T5, RoBERTa и многим другим. Эти модели, основанные на архитектуре трансформеров, способны понимать контекст слов и предложений на беспрецедентном уровне.

Мы используем их для:

Тонкой настройки (Fine-tuning) предварительно обученных моделей под наши специфические задачи, будь то классификация, NER или суммаризация. Это позволяет нам достигать state-of-the-art результатов с относительно небольшим объемом размеченных данных.

Генерации текста: Модели, подобные GPT, позволяют нам генерировать черновики статей, заголовки, описания продуктов и даже отвечать на комментарии, что значительно экономит наше время. Мы также экспериментировали с использованием трансформер-моделей для генерации кода, что очень помогает в автоматизации рутинных задач.

Машинного перевода: Хотя и не всегда идеально, трансформеры значительно продвинули эту область, позволяя нам работать с многоязычными текстовыми корпусами и даже разрабатывать системы автоматического перевода узкоспециализированных текстов.

Разработки систем вопросно-ответных систем (QA): Мы можем "скормить" модели большой объем текста и задавать вопросы, получая точные ответы, что очень полезно для создания FAQ или поиска информации в больших документах.

Библиотеки для Специфических Задач и Языков

Помимо основных фреймворков, мы активно используем специализированные библиотеки для решения конкретных задач:

Beautiful Soup: Наш незаменимый инструмент для веб-скрейпинга текста. Перед анализом часто приходится сначала собрать данные из интернета, и Beautiful Soup делает эту задачу максимально простой, помогая извлекать текст из HTML-тегов.

PyMuPDF: Для извлечения текста из PDF-документов мы используем PyMuPDF. Это позволяет нам анализировать отчеты, научные статьи и другие материалы, доступные только в формате PDF.

Polyglot: Для работы с многоязычными текстовыми корпусами и особенно с редкими языками, Polyglot предлагает удобные инструменты для определения языка, токенизации и NER.

Stanza: Разработанная Stanford NLP Group, Stanza – это мощная библиотека, особенно ценная для языков с богатой морфологией, как русский. Она предоставляет предобученные модели для токенизации, POS-теггинга, лемматизации и синтаксического парсинга, что дает нам гораздо более глубокое понимание структуры предложения.

Textacy: Эта библиотека, построенная на основе spaCy, предоставляет высокоуровневые инструменты для извлечения информации, анализа ключевых фраз, синтаксических паттернов и многого другого.

TextBlob: Как уже упоминалось, для простых задач NLP, таких как быстрый анализ тональности или определение языка, TextBlob является удобным и легким решением.

Gensim: Помимо тематического моделирования, Gensim также незаменим для работы с большими данными и эффективного обучения Word Embeddings.

TextRank: Для извлечения ключевых фраз и суммаризации мы часто используем алгоритм TextRank (реализованный, например, в библиотеке `sumy`), который основан на алгоритме PageRank и выявляет наиболее важные предложения или слова в тексте.

RAKE (Rapid Automatic Keyword Extraction): Еще один эффективный алгоритм для быстрого извлечения ключевых слов из текста.

Прикладные Сценарии и Наши Решения

Наш блогерский путь не ограничивается просто написанием статей. Мы постоянно ищем способы улучшить взаимодействие с аудиторией, оптимизировать контент и глубже понимать тренды. NLP стал для нас ключом к этим задачам.

Очистка и Нормализация Текстовых Данных

Качество анализа напрямую зависит от качества исходных данных. Реальные тексты часто полны "шума": HTML-теги, пунктуация, эмодзи, сленг, опечатки. Мы разработали ряд инструментов для автоматической очистки:

- Удаление HTML-тегов: С помощью Beautiful Soup мы легко извлекаем чистый текст с веб-страниц.

- Нормализация пунктуации: Приведение различных знаков препинания к стандартному виду или их удаление.

- Обработка эмодзи и сленга: Создание словарей для перевода эмодзи в текстовое описание или нормализации сленговых выражений.

- Исправление орфографии и грамматики: С использованием различных библиотек и правил, мы создаем инструменты для проверки текстов, что особенно важно для нашего контента.

- Удаление стоп-слов: Как уже упоминали, это базовый, но очень важный шаг.

Анализ Текста для Извлечения Ключевых Фраз и Суммаризация

Для быстрого понимания сути длинных статей или докладов мы используем:

- Извлечение ключевых фраз: С помощью RAKE или TextRank мы автоматически находим наиболее значимые фразы в тексте, что помогает нам быстро ориентироваться в информации.

- Суммаризация текста: Мы экспериментируем как с экстрактивной суммаризацией (выделение наиболее важных предложений из оригинального текста), так и с абстрактивной суммаризацией (генерация нового, краткого текста, передающего основной смысл, с использованием трансформеров).

Разработка Чат-ботов и QA-систем

Для улучшения взаимодействия с аудиторией мы начали разрабатывать собственных чат-ботов. Rasa framework стал для нас отличной платформой для создания диалоговых систем. С его помощью мы можем:

- Автоматически отвечать на часто задаваемые вопросы.

- Направлять пользователей к нужным статьям или ресурсам.

- Собирать обратную связь.

Также мы используем продвинутые трансформерные модели для создания систем вопросно-ответных систем (QA), которые могут извлекать точные ответы из нашей базы знаний.

Анализ Стилистики и Авторского Почерка

Как блогеры, мы ценим уникальный стиль. NLP позволяет нам анализировать:

- Лексическое богатство текстов: Разнообразие используемых слов.

- Частотность слов и n-грамм: Какие слова и сочетания слов характерны для того или иного автора.

- Синтаксические особенности: Как строятся предложения.

Это помогает нам не только анализировать наш собственный стиль, но и определять авторство текста, выявлять плагиат и даже подстраивать тон под целевую аудиторию.

Пример анализа частотности N-грамм:

- Токенизация текста.

- Формирование N-грамм (например, биграмм, триграмм).

- Подсчет частотности каждой N-граммы.

- Выделение наиболее частых N-грамм для характеристики текста.

Визуализация и Оценка Качества Моделей

Любой анализ должен быть представлен наглядно, а модели должны быть оценены.

Инструменты для Визуализации Текстовых Данных

- Word Clouds (Облака слов): Простой и эффективный способ визуализировать частотность слов в тексте. Чем больше слово, тем чаще оно встречается.

- Heatmaps (Тепловые карты): Используем для отображения матриц сходства документов или слов, что помогает нам видеть кластеры и взаимосвязи.

- Sweetviz: Для более глубокого разведочного анализа данных, включая текстовые поля, Sweetviz предлагает автоматизированные визуализации и статистические отчеты.

Оценка Качества NLP-моделей

Для оценки наших моделей мы используем стандартные метрики:

- Accuracy (Точность): Общая доля правильно классифицированных примеров.

- Precision (Точность): Доля правильно предсказанных положительных примеров среди всех предсказанных положительных.

- Recall (Полнота): Доля правильно предсказанных положительных примеров среди всех фактических положительных.

- F1-score: Гармоническое среднее между Precision и Recall, часто используемое для задач с несбалансированными классами.

Эти метрики помогают нам понять, насколько хорошо наша модель справляется с задачей и где есть возможности для улучшения.

Наш путь в мир Обработки Естественного Языка – это постоянное обучение и эксперименты. От простых токенизаторов до сложнейших трансформерных архитектур, Python предоставляет нам невероятный арсенал для работы с текстом. Мы увидели, как NLP может не только автоматизировать рутинные задачи, но и открыть новые горизонты для понимания нашей аудитории, улучшения контента и создания инновационных продуктов.

Будущее NLP обещает еще более впечатляющие возможности: более умные чат-боты, способные вести естественный диалог, системы, способные генерировать высококачественный, креативный контент, и инструменты, которые позволят нам обрабатывать и анализировать текст в режиме реального времени. Мы с нетерпением ждем, какие новые вызовы и решения принесет нам эта захватывающая область. И мы обещаем продолжать делиться нашим опытом и знаниями с вами, наши дорогие читатели. До новых встреч в мире данных и алгоритмов!

Подробнее

| Основы НЛП | Python для текста | Машинное обучение текста | Трансформеры НЛП | Анализ тональности |

| Токенизация Python | Лемматизация NLTK | Word2Vec Gensim | NER SpaCy | LDA тематическое моделирование |