- Раскрываем Тайны Текста: Наш Путь в Мир Обработки Естественного Языка на Python

- Первые Шаги: Подготовка Текста к Анализу

- Токенизация и Стемминг: Разбираем Текст на Части

- Очистка Текста: Регулярные Выражения и Стоп-слова

- Представление Текста: Как Компьютер "Видит" Слова

- От Мешков Слов к Смысловым Векторам

- Word Embeddings: От Слов к Глубинным Смыслам

- Контекстные Встраивания: Революция Трансформеров

- Основные Задачи NLP: От Сентимента до Суммаризации

- Распознавание Именованных Сущностей (NER)

- Анализ Тональности (Sentiment Analysis)

- Тематическое Моделирование (Topic Modeling)

- Классификация Текстов

- Суммаризация Текста (Text Summarization)

- Продвинутые Приложения и Инструменты

- Трансформеры и Глубокое Обучение: На Вершине Возможностей

- Многоязычность и Специфические Задачи

- Извлечение Информации и Аналитика

- Инструменты для Визуализации и Оценки

- Проблемы и Вызовы: Куда Мы Движемся Дальше

- Неполные и Ошибочные Данные

- Сложность Языка и Контекста

- Масштабирование и Автоматизация

Раскрываем Тайны Текста: Наш Путь в Мир Обработки Естественного Языка на Python

Привет, дорогие читатели и коллеги-энтузиасты! Сегодня мы отправимся в увлекательное путешествие по безграничному миру Обработки Естественного Языка (NLP) с помощью нашего верного спутника — языка Python. Мы, команда исследователей и практиков, накопили значительный опыт в этой области и готовы поделится своими наработками, инсайтами и, конечно же, практическими советами. Мир, где машины понимают человеческую речь, уже не фантастика, а повседневная реальность, и мы стоим у истоков многих удивительных открытий. Приготовьтесь, ведь нас ждет глубокое погружение в каждую деталь, от азов до самых продвинутых концепций.

За последние годы мы стали свидетелями невероятного прогресса в области NLP. От простых задач, таких как определение части речи, до создания сложных систем, способных вести осмысленный диалог или генерировать связный текст, – возможности постоянно расширяются. Мы убеждены, что каждый, кто работает с текстом, будь то аналитик данных, разработчик или маркетолог, найдет для себя что-то ценное в этой статье. Мы покажем, как Python, с его богатой экосистемой библиотек, становится незаменимым инструментом для работы с текстовыми данными любой сложности.

Первые Шаги: Подготовка Текста к Анализу

Прежде чем мы сможем заставить компьютер "понять" текст, его необходимо должным образом подготовить. Это фундамент любого NLP-проекта. Мы всегда начинаем с этапа предобработки, который включает в себя ряд важнейших операций. Без этого этапа наши модели будут работать неэффективно или, что еще хуже, выдавать совершенно некорректные результаты. Мы рассмотрим ключевые шаги, которые помогают нам превратить сырой текст в структурированные данные, готовые к глубокому анализу.

Токенизация и Стемминг: Разбираем Текст на Части

Наш путь начинается с токенизации – процесса разбиения текста на более мелкие, осмысленные единицы, называемые токенами. Токенами могут быть слова, пунктуация, числа и даже эмодзи. Мы используем NLTK (Natural Language Toolkit) как одну из старейших и наиболее популярных библиотек для этой цели. NLTK предоставляет нам мощные инструменты для токенизации предложений и слов, учитывая специфику различных языков.

После токенизации часто возникает необходимость привести слова к их базовой форме. Здесь на помощь приходят стемминг и лемматизация. Стемминг – это процесс удаления аффиксов (суффиксов, префиксов) от слова, чтобы получить его "корень" (стем). Например, слова "бегущий", "бежал", "бегать" могут быть приведены к стемму "бег". Мы часто используем стеммеры, такие как PorterStemmer или SnowballStemmer из NLTK, для быстрой и эффективной нормализации. Однако стемминг не всегда дает лингвистически корректное слово.

Лемматизация, в отличие от стемминга, направлена на приведение слова к его словарной форме (лемме). Это более сложный процесс, требующий знания морфологии языка. Например, "бегущий", "бежал", "бегать" будут приведены к лемме "бежать". Для лемматизации мы предпочитаем использовать spaCy или Stanza, особенно для русского языка, где морфология очень богата. Эти библиотеки предоставляют более точные результаты, что критически важно для многих задач.

Практический пример: Токенизация и Лемматизация

import nltk

from nltk.tokenize import word_tokenize

from nltk.stem import SnowballStemmer

import spacy

Мы загружаем необходимые модели (один раз)

nltk.download('punkt')

nltk.download('wordnet')

nltk.download('omw-1.4')

python -m spacy download ru_core_news_sm # для русского языка

text = "Мы бегали по лесу, наслаждаясь бегом и бегущими ручьями."

Токенизация с NLTK

tokens = word_tokenize(text.lower)

print(f"Токены: {tokens}")

Стемминг с NLTK (для русского)

stemmer = SnowballStemmer("russian")

stemmed_tokens = [stemmer.stem(word) for word in tokens]

print(f"Стемминг: {stemmed_tokens}")

Лемматизация с spaCy (для русского)

nlp = spacy.load("ru_core_news_sm")

doc = nlp(text.lower)

lemmas = [token.lemma_ for token in doc]

print(f"Лемматизация: {lemmas}")

Очистка Текста: Регулярные Выражения и Стоп-слова

После токенизации и лемматизации нам часто приходится удалять из текста элементы, которые не несут смысловой нагрузки для нашей конкретной задачи. Это могут быть стоп-слова (артикли, предлоги, союзы – "и", "но", "в", "на"), пунктуация, числа, HTML-теги, URL-адреса, а иногда даже эмодзи и сленг. Для удаления стоп-слов мы используем предопределенные списки из NLTK или spaCy, которые доступны для многих языков.

Регулярные выражения (библиотека re в Python) являются нашим незаменимым инструментом для более сложной очистки; С их помощью мы можем удалять HTML-теги, ссылки, специальные символы или заменять повторяющиеся пробелы. Например, при анализе отзывов клиентов мы часто сталкиваемся с неструктурированным текстом, содержащим много "шума". Регулярные выражения позволяют нам эффективно "выуживать" из него полезную информацию.

Кроме того, мы уделяем внимание нормализации сленга и работе с эмодзи, особенно при анализе текстов из социальных сетей. Это требует создания собственных словарей или использования специализированных библиотек, поскольку стандартные NLP-инструменты могут не справиться с такой спецификой. Для сравнения строк и поиска опечаток мы иногда прибегаем к библиотеке Jellyfish, которая помогает нам справиться с неполными и ошибочными данными.

Представление Текста: Как Компьютер "Видит" Слова

Когда текст очищен и нормализован, следующим шагом является его преобразование в числовой формат, который могут понимать алгоритмы машинного обучения. Компьютеры не работают с буквами, они работают с числами. Мы называем этот процесс векторизацией текста. Существуют различные подходы к векторизации, каждый из которых имеет свои преимущества и недостатки.

От Мешков Слов к Смысловым Векторам

Один из самых простых, но эффективных методов – это CountVectorizer из Scikit-learn. Мы используем его для создания "мешка слов", где каждый документ представляется вектором, а каждый элемент вектора – это количество вхождений слова в документ. Это отличный старт для многих задач классификации.

Далее мы часто переходим к TfidfVectorizer (Term Frequency-Inverse Document Frequency). Этот метод не только учитывает частоту слова в документе, но и его редкость во всем корпусе текстов. Слова, которые часто встречаются в одном документе, но редко в других, получают больший вес, что позволяет нам лучше выделять ключевые термины. Мы обнаружили, что TF-IDF хорошо работает для извлечения ключевых фраз и тематического моделирования.

Сравнение CountVectorizer и TfidfVectorizer

| Характеристика | CountVectorizer | TfidfVectorizer |

|---|---|---|

| Принцип | Частота слова в документе | Частота слова в документе + обратная частота в корпусе |

| Отражение важности | Только количество | Важность слова в контексте всего корпуса |

| Преимущества | Простота, скорость, хорошо для небольших корпусов | Выделение ключевых терминов, подавление общих слов |

| Недостатки | Не учитывает важность, может быть шумным | Сложнее для интерпретации, может быть медленнее для очень больших корпусов |

Word Embeddings: От Слов к Глубинным Смыслам

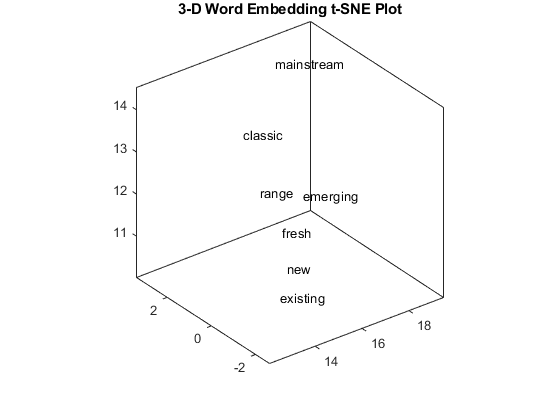

Современные методы векторизации идут дальше простого подсчета. Word Embeddings (векторные представления слов), такие как Word2Vec и GloVe, позволяют нам представить слова в виде плотных векторов в многомерном пространстве; Ключевая идея здесь в том, что слова, имеющие схожее значение или использующиеся в похожих контекстах, будут располагаться близко друг к другу в этом пространстве. Мы используем библиотеку Gensim для работы с Word2Vec и GloVe, что позволяет нам обучать собственные модели или использовать предобученные.

Для представления целых предложений или документов мы используем Doc2Vec (расширение Word2Vec) или Sentence Transformers. Эти подходы позволяют нам получать высококачественные векторные представления, которые учитывают не только отдельные слова, но и их контекст в предложении или документе. Мы обнаружили, что такие эмбеддинги значительно улучшают производительность моделей в задачах классификации, кластеризации и поиска сходства.

Контекстные Встраивания: Революция Трансформеров

Настоящая революция в NLP произошла с появлением трансформерных архитектур и моделей, таких как BERT, GPT, RoBERTa и других. Эти модели способны создавать контекстные встраивания, что означает, что векторное представление слова меняется в зависимости от его окружения в предложении. Это кардинально отличает их от традиционных Word Embeddings, где у каждого слова был один фиксированный вектор.

Мы активно применяем библиотеки Hugging Face Transformers, которые предоставляют простой доступ к огромному количеству предобученных моделей. С их помощью мы можем выполнять сложные задачи, такие как распознавание именованных сущностей (NER), классификация текста, ответы на вопросы, и даже генерация связного текста. Тонкая настройка (fine-tuning) этих моделей на наших собственных данных позволяет нам достигать беспрецедентной точности.

Основные Задачи NLP: От Сентимента до Суммаризации

После того как текст подготовлен и векторизован, мы можем приступать к решению конкретных задач. Мир NLP богат разнообразными приложениями, и мы покажем, как с помощью Python и его библиотек можно справиться с наиболее распространенными и важными из них.

Распознавание Именованных Сущностей (NER)

Распознавание именованных сущностей (NER) – это задача идентификации и классификации именованных сущностей в тексте, таких как имена людей, названия организаций, географические объекты, даты, суммы денег и т. д. Это краеугольный камень для извлечения информации из неструктурированного текста. Мы используем spaCy как наш основной инструмент для NER благодаря его скорости и точности. Также мы экспериментируем с библиотекой Flair, которая демонстрирует отличные результаты, особенно с моделями на основе трансформеров.

Для более сложных задач, требующих высокой точности, мы иногда строим собственные NER-модели, используя CRF (Conditional Random Fields) или нейронные сети (LSTM, BERT) с помощью PyTorch или TensorFlow. Оценка качества NER-моделей являеться критически важной, и мы всегда используем такие метрики, как F1-score, Precision и Recall, чтобы убедиться в надежности наших решений.

Анализ Тональности (Sentiment Analysis)

Анализ тональности – это процесс определения эмоциональной окраски текста: является ли он положительным, отрицательным или нейтральным. Это чрезвычайно полезно для анализа отзывов клиентов, сообщений в социальных сетях, новостных статей и многого другого. Мы начинаем с простых инструментов, таких как VADER (Valence Aware Dictionary and sEntiment Reasoner) для английского языка, который хорошо справляется с текстами из социальных медиа, и TextBlob для более общего анализа.

Однако для русского языка или более сложных сценариев (например, анализ тональности финансовых новостей или текстов с сарказмом) мы разрабатываем собственные модели на основе Scikit-learn (SVM, наивный байесовский классификатор) или глубокого обучения с PyTorch/TensorFlow. Мы также активно исследуем, как трансформерные архитектуры могут помочь в распознавании эмоций и тональности, особенно в контексте социальных медиа, где язык часто бывает неоднозначным.

"Язык – это дорожная карта культуры. Он показывает, откуда пришли ее люди и куда они идут."

– Рита Мэй Браун

Тематическое Моделирование (Topic Modeling)

Тематическое моделирование позволяет нам обнаруживать скрытые темы в больших коллекциях документов. Это похоже на то, как мы можем быстро понять, о чем идет речь в тысячах статей, не читая каждую из них. Мы используем библиотеку Gensim для реализации популярных алгоритмов, таких как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing).

Сравнение моделей тематического моделирования, таких как LDA и NMF (Non-negative Matrix Factorization), является важной частью нашей работы. Каждая из них имеет свои сильные стороны, и выбор зависит от характеристик данных и конкретной задачи. Мы также используем TextRank для выделения тем и ключевых предложений, что является более экстрактивным подходом к суммаризации и извлечению информации.

Классификация Текстов

Классификация текстов – это одна из наиболее распространенных задач NLP, при которой мы присваиваем тексту одну или несколько предопределенных категорий. Это может быть спам/не спам, положительный/отрицательный отзыв, новость о спорте/политике/экономике и т.д.. Мы активно применяем Scikit-learn для классификации текстов, используя алгоритмы SVM, наивный байесовский классификатор, логистическую регрессию и другие.

Для более сложных задач и больших объемов данных мы переходим к нейронным сетям, создавая LSTM-сети с Keras/TensorFlow или используя трансформерные модели (например, BERT) с PyTorch для задач классификации; Тонкая настройка предобученных трансформерных моделей дала нам возможность достигать впечатляющих результатов даже на относительно небольших датасетах.

Суммаризация Текста (Text Summarization)

Суммаризация текста – это процесс создания краткого и связного изложения более длинного документа. Мы различаем два основных подхода: экстрактивный и абстрактивный. Экстрактивная суммаризация выбирает наиболее важные предложения из исходного текста, тогда как абстрактивная генерирует новые предложения, передающие основной смысл.

Для экстрактивной суммаризации мы часто используем алгоритмы, основанные на TextRank. Для абстрактивной суммаризации, которая является значительно более сложной задачей, мы обращаемся к Transformer-моделям (например, BART, T5) из Hugging Face. Эти модели способны понимать контекст и генерировать новые, грамматически корректные и осмысленные резюме, что открывает огромные возможности для автоматического создания аннотаций и дайджестов.

Продвинутые Приложения и Инструменты

Мир NLP не стоит на месте, и мы постоянно исследуем новые горизонты и применяем самые современные технологии для решения все более сложных задач. От создания чат-ботов до анализа юридических документов – возможности безграничны.

Трансформеры и Глубокое Обучение: На Вершине Возможностей

Трансформеры (Hugging Face) стали де-факто стандартом для многих продвинутых задач NLP. Мы используем их не только для NER, классификации и суммаризации, но и для генерации текста (например, GPT-модели), машинного перевода, вопросно-ответных систем (QA), и даже для анализа кода (сжатие кода или генерация комментариев); Их способность улавливать долгосрочные зависимости в тексте делает их невероятно мощными.

PyTorch/TensorFlow – наши основные фреймворки для создания и обучения нейронных сетей в NLP, когда нам требуется максимальная гибкость или когда мы разрабатываем совершенно новые архитектуры. Мы применяем их для создания LSTM-сетей, сверточных нейронных сетей (CNN) и, конечно же, для работы с трансформерными моделями на низком уровне.

Многоязычность и Специфические Задачи

Работа с многоязычными текстовыми корпусами представляет собой отдельный вызов. Мы используем библиотеки, такие как Polyglot и Stanza, которые поддерживают широкий спектр языков и предоставляют инструменты для токенизации, POS-теггинга (разметки частей речи) и лемматизации для языков с богатой морфологией, как, например, русский.

Наши проекты часто включают разработку чат-ботов на Python, где мы используем фреймворки вроде Rasa для создания диалоговых систем. Мы также занимаемся анализом стилистики текстов (определением авторского почерка), извлечением ключевых фраз с использованием RAKE и TextRank, а также построением языковых моделей на основе N-грамм для предсказания следующего слова или оценки вероятности последовательности слов.

Извлечение Информации и Аналитика

Мы регулярно сталкиваемся с задачами извлечения информации из различных источников. Это включает веб-скрейпинг текста с помощью Beautiful Soup, извлечение текста из PDF с PyMuPDF, а также анализ лог-файлов. Для более глубокого анализа мы используем библиотеки, такие как Textacy, для извлечения информации, работы с зависимостями и создания более сложных конвейеров обработки текста.

Для анализа текстовых данных для выявления сезонности, анализа временных рядов в текстовых данных или анализа поведенческих паттернов в чатах и отзывах, мы комбинируем NLP с методами анализа данных и машинного обучения. Например, для выявления связей между сущностями мы используем Graph Embeddings, представляя текст как граф и анализируя отношения между узлами.

Инструменты для Визуализации и Оценки

Визуализация данных играет ключевую роль в понимании результатов NLP. Мы создаем Word Clouds для быстрого выявления наиболее частых слов, Heatmaps для отображения матриц сходства или корреляции, и другие интерактивные графики для представления сложных отношений в тексте. Библиотека Sweetviz иногда помогает нам в первичном анализе текстовых данных.

Оценка качества моделей – это не просто подсчет метрик, это глубокое понимание того, как модель ведет себя на реальных данных. Мы постоянно сравниваем различные методы векторизации (TF-IDF vs Word2Vec), методы лемматизации (SpaCy vs NLTK) и алгоритмы кластеризации (K-Means vs DBSCAN), чтобы выбрать наиболее подходящий инструмент для каждой конкретной задачи.

Проблемы и Вызовы: Куда Мы Движемся Дальше

Несмотря на весь прогресс, NLP по-прежнему сталкивается с рядом серьезных проблем. Мы постоянно работаем над их решением, исследуя новые подходы и технологии.

Неполные и Ошибочные Данные

Обработка неполных и ошибочных данных является одной из самых больших головных болей в реальных проектах. Опечатки, грамматические ошибки, несоблюдение пунктуации – все это может значительно ухудшить качество анализа. Мы разрабатываем собственные инструменты для проверки грамматики и исправления орфографии, используем библиотеки для сравнения строк (Jellyfish, Textdistance) для поиска дубликатов и нечеткого сопоставления.

Нормализация пунктуации и удаление стоп-слов также требуют внимания, особенно когда мы имеем дело с очень "грязными" данными, например, из пользовательских комментариев или социальных сетей. Мы постоянно совершенствуем наши конвейеры предобработки, чтобы максимально эффективно очищать текст, не теряя при этом важную информацию.

Сложность Языка и Контекста

Понимание сарказма, иронии и тонких нюансов языка остается одной из сложнейших задач для машин. Хотя трансформеры значительно улучшили способность моделей улавливать контекст, полное понимание человеческой речи все еще далеко. Мы активно исследуем, как можно интегрировать больше внешних знаний и использовать более сложные архитектуры для решения этих проблем.

Анализ лексического богатства и сложности текстов позволяет нам оценивать качество письменной речи и адаптировать контент под целевую аудиторию. Мы также работаем над разработкой систем для определения авторства текста и анализа поведенческих паттернов в пользовательских запросах, что имеет большое значение для кибербезопасности и маркетинга.

Масштабирование и Автоматизация

Обработка больших текстовых массивов (Big Data NLP) требует эффективных решений. Мы используем GPU-ускорение для обучения глубоких нейронных сетей и распределенные вычисления для обработки огромных объемов данных. Разработка инструментов для автоматической разметки данных и автоматического создания тегов/словарей терминов является ключевой для масштабирования наших проектов, поскольку ручная разметка очень трудоемка.

Мы также стремимся к созданию систем, способных работать в режиме реального времени (Streaming NLP), что критически важно для мониторинга социальных сетей, анализа чатов или систем обнаружения аномалий. И, конечно, мы постоянно ищем способы автоматического перевода узкоспециализированных текстов и нормализации сленга, чтобы наши системы могли работать с максимально широким спектром данных.

Наш путь в мир Обработки Естественного Языка на Python – это непрерывное обучение и эксперименты. Мы видим, как каждый день появляются новые библиотеки, модели и подходы, делающие возможным то, что еще вчера казалось фантастикой. От основ токенизации до сложнейших трансформерных архитектур, Python предоставляет нам мощный и гибкий инструментарий для работы с текстом.

Мы надеемся, что наш опыт поможет вам увереннее ориентироваться в этом захватывающем мире. Важно помнить, что NLP – это не просто набор алгоритмов, это искусство и наука понимания человеческого языка, его нюансов и контекста. Мы, как блогеры и практики, будем продолжать делиться своими открытиями и вдохновлять вас на новые свершения. Будущее текста в руках машин, и мы рады быть его частью!

Подробнее

| Продвинутая лемматизация на русском | Трансформеры Hugging Face для NLP | Анализ тональности социальных сетей Python | Сравнение Word2Vec и TF-IDF | Разработка чат-ботов на Rasa Framework |

| Извлечение ключевых фраз TextRank | Векторизация предложений Doc2Vec | Оценка качества NER моделей | Обработка многоязычных текстов Python | Суммаризация текста с Transformer моделями |