- Когда Текст Оживает: Наше Путешествие в Мир NLP с Python – От Азов до Нейросетей

- Начало Пути: Основы Предобработки Текста

- Токенизация, Стемминг и Лемматизация: Разбираем Текст на Части

- Регулярные Выражения: Хирургическая Точность в Очистке

- Очистка Данных: Удаляем Шум, Оставляем Смысл

- Векторизация Текста: От Слов к Числам, Понятным Машине

- Простые, но Эффективные: CountVectorizer и TF-IDF

- Word Embeddings: Когда Слова Обретают Смысл

- Контекстные Встраивания: Революция Трансформеров

- Основные Задачи NLP: Что Мы Можем Делать с Текстом

- Распознавание Именованных Сущностей (NER)

- Анализ Тональности (Sentiment Analysis)

- Тематическое Моделирование (Topic Modeling)

- Классификация Текстов

- Суммаризация Текста

- Извлечение Ключевых Фраз и Слов

- Продвинутые Темы и Приложения: Разговор с Машиной

- Трансформеры (Hugging Face): Революция в NLP

- Разработка Чат-ботов и Вопросно-ответных Систем (QA)

- Анализ Стилистики и Авторства

- Работа с Большими Текстовыми Массивами (Big Data NLP)

- Наши Любимые Инструменты и Библиотеки: Краткий Обзор

- Вызовы и Будущее NLP: Куда Мы Движемся Дальше

Когда Текст Оживает: Наше Путешествие в Мир NLP с Python – От Азов до Нейросетей

Привет, друзья и коллеги-энтузиасты технологий! Сегодня мы хотим поделиться с вами одним из самых захватывающих приключений, в которое мы когда-либо погружались – это мир Обработки Естественного Языка, или NLP (Natural Language Processing). Представьте себе: миллиарды слов, ежедневно генерируемых людьми, скрывают в себе бесценные знания, эмоции, идеи. И наша задача как разработчиков и исследователей – научить машины понимать этот поток, извлекать из него смысл и даже генерировать новые тексты. Звучит как научная фантастика? Возможно, но с Python это становится реальностью прямо на наших глазах.

Мы прошли долгий путь, экспериментируя с различными библиотеками, алгоритмами и подходами. От простейших операций по подсчету слов до создания сложных моделей, способных вести осмысленный диалог – каждый шаг был наполнен открытиями. В этой статье мы хотим не просто перечислить инструменты, а провести вас по нашему собственному пути познания NLP, показать, как мы справлялись с вызовами и какие удивительные возможности открылись перед нами. Приготовьтесь, будет интересно!

Начало Пути: Основы Предобработки Текста

Любое путешествие в мир NLP начинается не с создания нейросетей, а с куда более прозаичных, но критически важных вещей – предобработки текста. Мы быстро усвоили, что "грязные" данные – это прямой путь к некорректным результатам. Представьте, что вы пытаетесь понять речь человека, который постоянно заикается, использует непонятные слова и пропускает окончания. Примерно так же машина воспринимает необработанный текст. Поэтому мы начали с самых азов, используя проверенные временем библиотеки.

Токенизация, Стемминг и Лемматизация: Разбираем Текст на Части

Первый шаг – это токенизация. Мы берем большой кусок текста и делим его на более мелкие, осмысленные единицы – токены. Обычно это слова или знаки препинания. NLTK (Natural Language Toolkit) стал нашим верным спутником в этом деле. Он предлагает различные токенизаторы, и мы быстро поняли, что выбор токенизатора зависит от задачи.

Затем мы столкнулись с проблемой того, что одно и то же слово может иметь разные формы: "бежать", "бежит", "бежал". Для машины это три разных слова, но для нас они обозначают одно и то же действие. Здесь на помощь приходят стемминг и лемматизация. Стемминг отсекает окончания, пытаясь привести слово к его "основе" (stem), которая не всегда является реальным словом. Лемматизация же более интеллектуальна: она приводит слово к его словарной форме (лемме), используя морфологический анализ. Мы обнаружили, что SpaCy в этом плане более продвинут и точен, особенно для лемматизации, так как он учитывает контекст слова.

Наш опыт показал, что для большинства задач лемматизация предпочтительнее стемминга, несмотря на большую вычислительную стоимость. Она обеспечивает более высокое качество для дальнейшего анализа. Например, в NLTK мы часто использовали PorterStemmer или WordNetLemmatizer, а в SpaCy процесс лемматизации происходит автоматически при обработке документа.

Регулярные Выражения: Хирургическая Точность в Очистке

Когда мы начали работать с реальными данными из интернета, мы быстро поняли, что текст полон "шума": HTML-теги, URL-адреса, числа, специальные символы, эмодзи и т.д. Здесь нашими лучшими друзьями стали регулярные выражения (библиотека re в Python). Мы научились создавать паттерны для удаления всего лишнего, оставляя только чистый, релевантный текст.

Это было похоже на обучение новому языку программирования внутри Python. Сначала сложно, но потом ты начинаешь видеть элегантность и мощь в одном лишь символе. Например, удаление HTML-тегов или извлечение email-адресов стало для нас рутиной благодаря регулярным выражениям. Этот навык оказался незаменимым при веб-скрейпинге с использованием Beautiful Soup, позволяя нам извлекать чистый текст из хаоса веб-страниц.

Очистка Данных: Удаляем Шум, Оставляем Смысл

Помимо токенизации и лемматизации, мы разработали целый конвейер очистки:

- Удаление HTML-тегов: Используя

Beautiful Soup, мы парсили HTML и извлекали только текстовое содержимое. - Удаление пунктуации и специальных символов: Регулярные выражения помогли нам избавится от всего, что не является буквой или цифрой.

- Приведение к нижнему регистру: Чтобы слова "Привет" и "привет" воспринимались как одно и то же.

- Удаление стоп-слов: Такие слова, как "и", "в", "на", "он", которые не несут большого смыслового значения, но встречаются очень часто, мы удаляли с помощью готовых списков из NLTK или SpaCy. Для русского языка нам часто приходилось формировать свои списки или находить расширенные версии.

- Нормализация сленга и работа с эмодзи: В анализе социальных сетей это стало отдельным вызовом. Мы создавали собственные словари для замены сленга на общепринятые слова, а эмодзи пытались перевести в текстовое описание, чтобы сохранить их эмоциональный заряд.

На этом этапе мы также экспериментировали с TextBlob для простых задач NLP, таких как определение языка, что оказалось полезным при работе с многоязычными корпусами. А для языков с богатой морфологией, таких как русский, Stanza и Polyglot показали себя с лучшей стороны, предлагая более глубокий морфологический и синтаксический анализ.

Векторизация Текста: От Слов к Числам, Понятным Машине

После того как текст очищен и приведен в порядок, перед нами встала следующая фундаментальная задача: как представить слова и предложения в виде, понятном машине? Компьютеры оперируют числами, а не буквами. Здесь на сцену выходит векторизация текста.

Простые, но Эффективные: CountVectorizer и TF-IDF

Начали мы с самых базовых методов, которые, тем не менее, очень эффективны для многих задач.

- CountVectorizer: Просто подсчитывает, сколько раз каждое слово встречается в документе. Это создает вектор, где каждая позиция соответствует слову из всего словаря, а значение – его частоте в текущем документе.

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): Улучшенная версия. Она не только учитывает частоту слова в документе (TF), но и придает меньший вес словам, которые часто встречаются во всех документах корпуса (IDF), тем самым выделяя более уникальные и значимые слова для конкретного документа;

Мы использовали эти векторизаторы из библиотеки Scikit-learn для множества задач, от классификации спама до анализа отзывов. Они просты в реализации и дают хорошие результаты, особенно когда объем данных не слишком велик или требуется быстрая прототипизация. Мы также поняли важность настройки параметров, таких как ngram_range, чтобы учитывать не только отдельные слова, но и их последовательности (биграммы, триграммы).

Word Embeddings: Когда Слова Обретают Смысл

Следующим шагом в нашем развитии стало знакомство с Word Embeddings – векторными представлениями слов. В отличие от CountVectorizer и TF-IDF, которые создают разреженные векторы большой размерности, Word Embeddings представляют слова в плотном векторном пространстве меньшей размерности, где семантически близкие слова находятся ближе друг к другу. Это было для нас настоящим откровением!

Мы активно работали с:

- Word2Vec (Skip-gram и CBOW): Используя библиотеку Gensim, мы обучали собственные модели Word2Vec на больших текстовых корпусах. Мы обнаружили, что Skip-gram лучше справляется с редкими словами, а CBOW быстрее обучается. Удивительно было видеть, как модель учится улавливать отношения между словами, например, "король" ⎯ "мужчина" + "женщина" = "королева".

- GloVe (Global Vectors for Word Representation): Ещё один популярный метод, который мы использовали. Он фокусируется на глобальной статистике совместной встречаемости слов.

- FastText: Разработанный Facebook, FastText обрабатывает слова как наборы символьных n-грамм, что делает его особенно эффективным для работы с редкими словами и языками с богатой морфологией (например, русский). Мы использовали его, когда Word2Vec и GloVe давали сбои на небольших или очень специфических корпусах.

- Doc2Vec: Естественное развитие Word2Vec, позволяющее получать векторные представления целых документов или предложений. Это стало бесценным инструментом для поиска похожих документов или кластеризации текстов.

- Sentence Transformers: Для получения качественных эмбеддингов предложений мы начали использовать Sentence Transformers. Они оказались чрезвычайно эффективными для задач, где необходимо сравнивать семантическое сходство целых предложений, например, в вопросно-ответных системах.

Сравнение этих методов векторизации стало отдельным исследованием. Каждая из них имеет свои сильные и слабые стороны, и выбор всегда зависел от конкретной задачи и объема данных.

Контекстные Встраивания: Революция Трансформеров

И вот, когда мы думали, что уже многое повидали, пришла эра трансформеров и контекстных встраиваний. Модели вроде BERT (Bidirectional Encoder Representations from Transformers) полностью изменили наше представление о векторных представлениях слов. Теперь вектор слова зависит от его контекста в предложении. Слово "банк" будет иметь разные векторы в предложениях "Я иду в банк" (финансовое учреждение) и "берег реки – это банк" (географический объект).

Мы начали активно использовать предварительно обученные модели из библиотеки Hugging Face Transformers. Это значительно ускорило разработку, поскольку не нужно было обучать гигантские модели с нуля. Мы научились делать тонкую настройку (Fine-tuning) этих моделей под наши специфические задачи, получая результаты, которые раньше казались недостижимыми.

Основные Задачи NLP: Что Мы Можем Делать с Текстом

С хорошо подготовленными и векторизованными данными мы были готовы к решению реальных NLP-задач. Диапазон возможностей поражает воображение!

Распознавание Именованных Сущностей (NER)

NER (Named Entity Recognition) – это задача по извлечению и классификации именованных сущностей (люди, организации, локации, даты, продукты) из текста. Это критически важно для извлечения информации. Мы начали с SpaCy, который предлагает отличные предварительно обученные модели NER. Затем мы перешли к более сложным подходам, таким как CRF (Conditional Random Fields) для пользовательских сущностей и, конечно же, BERT. Библиотека Flair также показала себя очень хорошо для NER, особенно с предварительно обученными моделями, демонстрируя высокую точность даже на ограниченных данных.

Мы использовали NER для анализа юридических документов, чтобы автоматически извлекать имена сторон, даты, суммы, и для анализа новостей, чтобы определять участников событий и места их возникновения. Оценка качества NER-моделей с помощью F1-score, Precision и Recall стала неотъемлемой частью нашей работы.

Анализ Тональности (Sentiment Analysis)

Понимание эмоций, выраженных в тексте, является одной из самых востребованных задач; Мы начали с простого, но эффективного VADER (Valence Aware Dictionary and sEntiment Reasoner) из NLTK, который отлично подходит для текстов из социальных сетей благодаря своему словарю, учитывающему сленг и эмодзи. Затем мы использовали TextBlob для быстрого определения тональности, хотя и столкнулись с его ограничениями на более сложных или узкоспециализированных текстах;

Для более глубокого анализа тональности, особенно в отзывах клиентов, финансовых новостях или постах о политике, мы перешли к моделям машинного обучения (SVM, наивный байесовский классификатор с Scikit-learn) и, конечно же, к трансформерам. Анализ тональности с учетом сарказма и иронии – это отдельная, сложная задача, над которой мы до сих пор активно работаем, используя более продвинутые модели контекстного встраивания.

"Язык – это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Тематическое Моделирование (Topic Modeling)

Как из большого объема текста извлечь основные темы? Тематическое моделирование дает ответ на этот вопрос. Мы активно использовали Gensim для реализации таких алгоритмов, как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing). Они позволяют нам находить скрытые темы в коллекциях документов, что оказалось бесценным для анализа отзывов клиентов, блогов и форумов, или статей.

Сравнение LDA и NMF (Non-negative Matrix Factorization) показало, что выбор модели часто зависит от характеристик данных и желаемой интерпретируемости результатов. LDA обычно дает более "читаемые" темы с распределением слов, тогда как NMF может быть более эффективным с точки зрения производительности и для некоторых типов данных. Мы также экспериментировали с визуализацией этих тем, используя Word Clouds и Heatmaps, чтобы сделать результаты более наглядными.

Классификация Текстов

Классификация текстов – это одна из самых распространенных задач в NLP: отнесение документа к одной или нескольким предопределенным категориям. Мы использовали Scikit-learn для реализации классических алгоритмов, таких как SVM, логистическая регрессия, наивный байесовский классификатор, обучая их на TF-IDF или Word2Vec представлениях.

По мере роста сложности задач и объемов данных, мы перешли к использованию глубокого обучения с PyTorch и TensorFlow, создавая LSTM-сети и, конечно, применяя трансформерные модели, такие как BERT, для классификации. Последние показали феноменальные результаты в задачах, где требуется тонкое понимание контекста, например, при категоризации новостей или статей, а также при анализе поведенческих паттернов в чатах.

Суммаризация Текста

Как сократить длинный текст, сохранив при этом его основной смысл? Это задача суммаризации текста. Мы исследовали два основных подхода:

- Экстрактивная суммаризация: Извлечение наиболее важных предложений из исходного текста. Здесь нам очень помог TextRank (реализованный, например, в библиотеке Textacy), который строит граф предложений и ранжирует их по важности.

- Абстрактивная суммаризация: Генерация нового текста, который передает суть оригинала, но не обязательно содержит его оригинальные предложения. Это более сложная задача, требующая использования трансформерных моделей, таких как GPT или другие модели Hugging Face, специально обученные для суммаризации.

Мы применяли суммаризацию для создания кратких обзоров новостей, автоматического создания FAQ на основе документов и даже для анализа юридических документов, чтобы быстро выявлять ключевые пункты.

Извлечение Ключевых Фраз и Слов

Иногда нам нужно просто быстро понять, о чем текст, выделив из него ключевые слова или фразы. Мы использовали для этого RAKE (Rapid Automatic Keyword Extraction) и TextRank. Эти методы оказались очень полезными для автоматического тегирования контента, анализа запросов пользователей и выявления скрытых тем.

Продвинутые Темы и Приложения: Разговор с Машиной

По мере того как наши навыки росли, мы начали замахиваться на более амбициозные проекты, которые действительно демонстрируют мощь NLP.

Трансформеры (Hugging Face): Революция в NLP

Как мы уже упоминали, трансформеры и платформа Hugging Face стали краеугольным камнем наших продвинутых проектов. Мы использовали их для:

- Генерации текста: Модели GPT позволили нам создавать осмысленные тексты, будь то продолжение статьи, ответы на вопросы или даже генерация кода. Это открыло двери для автоматического создания контента.

- Машинного перевода: Обучение и тонкая настройка трансформерных моделей для перевода между языками, включая создание систем для автоматического перевода узкоспециализированных текстов.

- Генерации диалогов: Создание моделей, способных вести человекоподобные диалоги, что стало основой для наших экспериментов с чат-ботами.

Работа с трансформерами требует понимания архитектуры, но благодаря Hugging Face порог входа значительно снизился, позволяя нам сосредоточиться на тонкой настройке и применении.

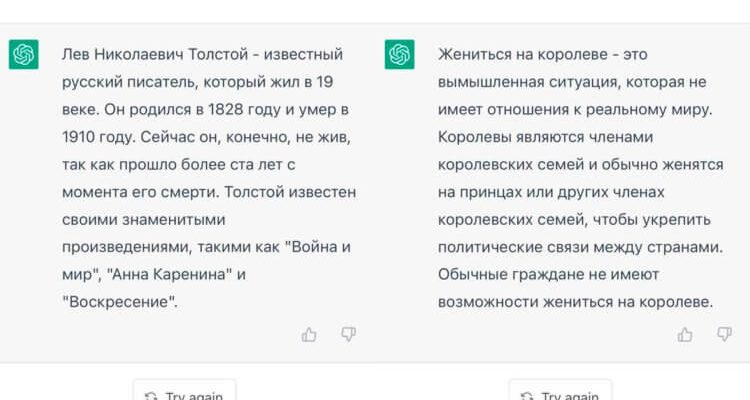

Разработка Чат-ботов и Вопросно-ответных Систем (QA)

Создание чат-ботов, способных понимать запросы пользователей и давать адекватные ответы, было одной из наших давних целей. Мы начали с простых правил, но быстро поняли, что для создания по-настоящему полезного бота необходимы продвинутые NLP-техники. Фреймворк Rasa стал для нас отличной платформой для разработки диалоговых систем, позволяя интегрировать NER, классификацию намерений и управление диалогом.

Вопросно-ответные системы (QA) – это следующий уровень. Здесь мы используем трансформерные модели для поиска ответов на вопросы в большом корпусе документов. Это похоже на умный поиск, который не просто находит релевантные документы, но и указывает на конкретное предложение или абзац, содержащий ответ.

Анализ Стилистики и Авторства

Мы также углубились в анализ стилистики текстов, пытаясь определить авторский почерк, выявить плагиат или даже создать инструмент для проверки грамматики и синтаксиса. Здесь нам помогли такие библиотеки, как Textacy для работы с зависимостями и Jellyfish для сравнения строк. Анализ лексического богатства, частотности n-грамм и специфических конструкций позволяет создавать "отпечатки" авторов.

Работа с Большими Текстовыми Массивами (Big Data NLP)

Когда данные измеряются терабайтами, обычные подходы уже не работают. Мы осваивали методы обработки текста в режиме реального времени (Streaming NLP) и использовали специализированные библиотеки, такие как Gensim, оптимизированные для работы с большими корпусами. Использование GPU-ускорения для обучения нейросетей стало необходимостью, а не роскошью.

Наши Любимые Инструменты и Библиотеки: Краткий Обзор

Наше путешествие по миру NLP было бы невозможно без удивительного арсенала инструментов, которые предлагает экосистема Python. Вот краткий список тех, что стали для нас незаменимыми:

| Библиотека | Основные Возможности | Наш Опыт Использования |

|---|---|---|

| NLTK | Токенизация, стемминг, лемматизация, стоп-слова, POS-теггинг, базовый Sentiment Analysis (VADER). | Отличный старт для изучения основ. Мы использовали его для быстрых экспериментов и для VADER. |

| spaCy | Быстрая токенизация, лемматизация, NER, синтаксический парсинг, векторные представления слов. | Наш выбор для продакшн-систем благодаря скорости и точности. Особенно хорош для NER и синтаксиса. |

| Gensim | Тематическое моделирование (LDA, LSI), Word2Vec, Doc2Vec, FastText. | Незаменим для работы с векторными представлениями и извлечения тем из больших корпусов. |

| Scikit-learn | CountVectorizer, TfidfVectorizer, широкий спектр алгоритмов классификации и кластеризации. | Наш основной инструмент для классических ML-задач в NLP. |

| Hugging Face Transformers | Доступ к предварительно обученным трансформерным моделям (BERT, GPT, T5 и др.), тонкая настройка. | Революционный инструмент для самых современных задач NLP: генерация, QA, NER, классификация. |

| TextBlob | Простой API для базового NLP: тональность, POS-теггинг, определение языка, исправление орфографии. | Удобен для быстрых прототипов и задач, не требующих высокой точности. |

| Beautiful Soup | Парсинг HTML/XML документов, извлечение текста с веб-страниц. | Наш помощник в веб-скрейпинге для сбора текстовых данных. |

| Flair | Современный NER, Sentence Embeddings, анализ тональности. | Показал отличные результаты для высокоточного NER и контекстных эмбеддингов. |

| Textacy | Продвинутая обработка текста: извлечение n-грамм, ключевых фраз, синтаксический анализ, суммаризация. | Полезен для более глубокого лингвистического анализа и извлечения информации. |

| PyTorch/TensorFlow | Создание и обучение нейросетей для NLP, включая LSTM, CNN, и собственные трансформеры. | Наши "тяжеловесы" для разработки моделей глубокого обучения с нуля или для тонкой настройки. |

Вызовы и Будущее NLP: Куда Мы Движемся Дальше

Несмотря на все наши успехи, мир NLP полон вызовов. Мы постоянно сталкиваемся с проблемами:

- Неполные и ошибочные данные: Реальные тексты редко бывают идеальными. Мы учимся разрабатывать более устойчивые к шуму модели.

- Нюансы человеческого языка: Сарказм, ирония, метафоры, сложные эмоциональные оттенки – все это пока дается машинам с трудом.

- Многоязычность: Хотя прогресс в обработке разных языков огромен, создание универсальных моделей, одинаково хорошо работающих для всех языков, остается сложной задачей.

- Этика и предвзятость: Модели NLP, обученные на данных из интернета, могут унаследовать человеческие предубеждения. Мы активно работаем над созданием более справедливых и непредвзятых систем.

- Объяснимость моделей: Часто глубокие нейронные сети работают как "черные ящики". Мы стремимся понять, почему модель приняла то или иное решение.

Будущее NLP обещает быть еще более захватывающим. Мы видим развитие в области генерации еще более естественного и креативного текста, создании персонализированных интеллектуальных помощников, способных вести глубокие и осмысленные диалоги, а также в применении NLP для решения глобальных проблем, таких как анализ медицинских записей для диагностики или юридических документов для ускорения правосудия. Мы также активно следим за развитием Graph Embeddings для анализа взаимосвязей в тексте и анализом временных рядов в текстовых данных.

Наше путешествие в мир Обработки Естественного Языка с Python – это непрерывный процесс обучения, экспериментов и открытий. От простых скриптов, подсчитывающих слова, до сложных нейронных сетей, способных генерировать осмысленные тексты, мы прошли огромный путь. Каждый новый проект – это новая головоломка, новое испытание, но и новая возможность увидеть, как машины начинают "понимать" наш мир через язык.

Мы надеемся, что наш опыт вдохновит вас на собственные исследования и эксперименты. NLP – это не просто набор алгоритмов и библиотек; это мост между человеческим языком и миром машин, позволяющий нам извлекать знания, автоматизировать процессы и создавать интеллектуальные системы, которые меняют нашу жизнь к лучшему. Вперед, к новым открытиям!

Подробнее

| Основы NLTK | SpaCy NER | Gensim LDA | Scikit-learn классификация текста | Word2Vec GloVe |

| Анализ тональности VADER | Трансформеры Hugging Face | Разработка чат-ботов Python | Суммаризация текста | Анализ текста Python |