- Когда Текст Заговорит: Наш Опыт Погружения в Магию NLP с Python

- Первые Шаги: Строим Фундамент Понимания Текста

- Токенизация и Стемминг: Разбираем Текст на Части

- Продвинутая Лемматизация и Стемминг: За Гранью Простого Корня

- Регулярные Выражения и Очистка Текста: Наводим Порядок

- Представление Текста для Машинного Обучения: От Слов к Числам

- Классические Векторизаторы: CountVectorizer и TF-IDF

- Word Embeddings: От Слов к Смыслам

- Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

- Ключевые Задачи NLP: Разгадываем Смысл Текста

- Распознавание Именованных Сущностей (NER)

- Анализ Тональности (Sentiment Analysis)

- Тематическое Моделирование (Topic Modeling)

- Классификация Текстов

- Продвинутые Техники и Современные Тенденции в NLP

- Трансформеры и Hugging Face: Революция в NLP

- Суммаризация Текста: Извлечение Сути

- Мультиязычный NLP: Разрушая Языковые Барьеры

- NLP для Специфических Областей и Задач

- Экосистема Python для NLP: Инструменты, Которые Мы Любим

- Дополнительные Инструменты

- Вызовы и Перспективы: Куда Движется NLP?

- Визуализация Текстовых Данных: Делаем Невидимое Видимым

Когда Текст Заговорит: Наш Опыт Погружения в Магию NLP с Python

Привет, друзья и коллеги по цифровому цеху! Сегодня мы хотим поделиться с вами чем-то поистине захватывающим, тем, что изменило наш взгляд на данные и открыло новые горизонты в аналитике. Мы говорим о магии обработки естественного языка (NLP) с использованием Python. Если вы когда-либо задавались вопросом, как компьютеры понимают человеческую речь, анализируют эмоции или даже генерируют связный текст, то эта статья для вас. Мы пройдем по этому удивительному пути вместе, от самых азов до продвинутых концепций, опираясь на наш собственный, многолетний опыт.

Мир вокруг нас пропитан текстом: электронные письма, сообщения в социальных сетях, новостные статьи, обзоры продуктов, юридические документы. Представьте, сколько ценной информации скрыто в этих потоках неструктурированных данных! Именно NLP позволяет нам извлекать эту информацию, находить закономерности, предсказывать поведение и даже создавать новые смыслы. Наш путь в NLP начался с простого любопытства и постепенно превратился в глубокое увлечение, где каждый новый инструмент или концепция открывала перед нами безграничные возможности. Давайте вместе окунемся в этот увлекательный мир.

Первые Шаги: Строим Фундамент Понимания Текста

Прежде чем компьютер сможет "понять" текст, его нужно подготовить. Человеческий язык полон нюансов, синонимов, грамматических форм и опечаток. Для машины это просто последовательность символов. Наши первые эксперименты в NLP всегда начинались с этапа предобработки, который является краеугольным камнем любого проекта.

Токенизация и Стемминг: Разбираем Текст на Части

Мы начали с токенизации – процесса разбиения текста на более мелкие единицы, называемые токенами. Чаще всего токенами являются слова, но это могут быть и предложения, или даже отдельные символы. Представьте себе предложение: "Мы любим изучать NLP!". После токенизации оно может превратиться в список: [‘Мы’, ‘любим’, ‘изучать’, ‘NLP’, ‘!’]. Это кажется простым, но на деле есть много нюансов: как обрабатывать пунктуацию, числа, сокращения?

Для этих задач мы часто обращаемся к библиотеке NLTK (Natural Language Toolkit). Она предоставляет мощные инструменты для токенизации, которые учитывают особенности различных языков. Например, для токенизации предложений мы используем `nltk.sent_tokenize`, а для слов – `nltk.word_tokenize`. По нашему опыту, NLTK является отличной отправной точкой для понимания базовых принципов.

Далее идет стемминг – процесс уменьшения слова до его корневой формы, или "стема". Например, слова "бежать", "бежит", "бегал" могут быть сведены к одному и тому же стему, например, "беж". Это помогает уменьшить размер словаря и рассматривать различные формы одного и того же слова как одну сущность. NLTK предлагает несколько алгоритмов стемминга, таких как PorterStemmer и SnowballStemmer. Последний, кстати, поддерживает несколько языков, что было для нас особенно полезно при работе с мультиязычными корпусами.

Продвинутая Лемматизация и Стемминг: За Гранью Простого Корня

Хотя стемминг полезен, он часто создает несуществующие слова (например, "красив" вместо "красивый"). Здесь на помощь приходит лемматизация. Лемматизация стремится привести слово к его базовой словарной форме (лемме), которая имеет грамматическое значение. Например, "бежать", "бежит", "бегал" будут приведены к лемме "бежать". Это требует более глубокого лингвистического анализа, часто с использованием информации о части речи (POS-теггинг).

Мы обнаружили, что spaCy – это настоящий швейцарский нож в мире NLP. Он не только выполняет токенизацию и лемматизацию на высочайшем уровне, но и делает это невероятно быстро. Для языков с богатой морфологией, таких как русский, лемматизация критически важна. spaCy использует обученные модели, которые позволяют ему понимать контекст и правильно определять леммы, что значительно повышает качество предобработки по сравнению со стеммингом.

Регулярные Выражения и Очистка Текста: Наводим Порядок

Предобработка – это не только токенизация и лемматизация. Это также удаление шума: HTML-тегов, специальных символов, URL-адресов, чисел, которые не несут смысловой нагрузки для нашей задачи. Здесь нашими лучшими друзьями становятся регулярные выражения (библиотека `re` в Python). Мы используем их для:

- Удаления HTML-тегов из веб-страниц (часто с помощью Beautiful Soup, о которой мы поговорим позже).

- Извлечения или удаления URL-адресов.

- Очистки текста от пунктуации, кроме случаев, когда она несет смысловую нагрузку (например, в эмодзи или при анализе тональности).

- Приведения текста к нижнему регистру для единообразия.

- Удаления стоп-слов (артиклей, предлогов, союзов), которые очень часты, но обычно не несут уникального смысла для анализа.

Создание инструмента для нормализации пунктуации или маркировки стоп-слов – это то, чем мы занимались на ранних этапах, чтобы подготовить наши данные к более сложному анализу. Это рутинная, но крайне важная работа, от которой зависит успех последующих этапов.

Представление Текста для Машинного Обучения: От Слов к Числам

После того как текст очищен и приведен к нормальной форме, нам нужно преобразовать его в числовой формат, который могут обрабатывать алгоритмы машинного обучения. Это называется векторизацией текста, и мы исследовали множество методов, каждый из которых имеет свои сильные и слабые стороны.

Классические Векторизаторы: CountVectorizer и TF-IDF

Наш путь в векторизации часто начинается с простых, но эффективных методов, предлагаемых Scikit-learn:

- CountVectorizer: Этот векторизатор создает матрицу, где каждая строка представляет документ, а каждый столбец – уникальное слово в нашем корпусе. Значение в ячейке – это просто количество раз, которое слово встречается в документе. Мы использовали его для задач, где важна абсолютная частота слов, например, для анализа частотности слов и n-грамм.

Документ Слово А (частота) Слово Б (частота) Слово В (частота) Документ 1 3 0 1 Документ 2 1 2 0 - TfidfVectorizer: Этот метод не просто считает частоту, но и взвешивает ее с учетом обратной частоты документа (IDF). Суть в том, что слова, которые встречаются очень часто во всех документах (например, "и", "в"), получают меньший вес, а слова, уникальные для конкретного документа, – больший. Это позволяет нам сосредоточиться на наиболее информативных словах. Мы часто используем TF-IDF для классификации текстов и извлечения ключевых фраз, так как он прекрасно выделяет "важные" слова.

Мы постоянно сравниваем методы векторизации (TF-IDF vs Word2Vec), чтобы выбрать наиболее подходящий для конкретной задачи. Для некоторых задач простота CountVectorizer оказывается достаточной, для других требуется более глубокий подход TF-IDF.

Word Embeddings: От Слов к Смыслам

Классические векторизаторы не учитывают семантическую близость слов. "Король" и "королева" могут быть очень разными по их представлению. Здесь на сцену выходят Word Embeddings – плотные векторные представления слов, которые захватывают их смысловое значение. Мы с удовольствием погрузились в мир Word2Vec и GloVe с использованием библиотеки Gensim.

- Word2Vec: Эта модель, представленная Google, обучается на больших текстовых корпусах и генерирует векторы, где семантически близкие слова имеют близкие векторы. Мы обнаружили, что Word2Vec (в его вариациях Skip-gram и CBOW) позволяет нам выполнять удивительные вещи, например, "король" ⎯ "мужчина" + "женщина" = "королева". Gensim делает обучение и использование Word2Vec очень удобным.

- GloVe: Еще один популярный метод, основанный на глобальной матрице ко-встречаемости слов. Его преимущество в том, что он более эффективно использует статистику всего корпуса.

Мы также исследовали FastText, особенно полезный для работы с редкими словами и языками с богатой морфологией, так как он учитывает подсловные единицы (символьные n-граммы). Это позволяет ему генерировать векторы даже для слов, которых он не видел во время обучения, что является огромным преимуществом.

Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

Если Word Embeddings дают нам векторы для отдельных слов, то что делать, если нам нужно получить вектор для целого предложения или документа? Здесь на помощь приходят более продвинутые методы:

- Doc2Vec (Paragraph Vector): Развитие Word2Vec, которое позволяет генерировать векторы для целых документов. Мы использовали Doc2Vec для представления юридических документов или статей, что позволяло нам сравнивать их по смыслу и находить схожие.

- Sentence Transformers: Это семейство моделей, основанных на архитектуре трансформеров, специально разработанных для создания семантически осмысленных эмбеддингов предложений. Они превзошли Doc2Vec по качеству во многих наших задачах, особенно когда требовалась высокая точность для сравнения документов или поиска релевантных ответов.

Векторизация текста с учетом контекста (контекстное встраивание), как в BERT, о котором мы поговорим позже, полностью изменила правила игры, позволив нам захватывать смысл слов не изолированно, а в зависимости от их окружения.

Ключевые Задачи NLP: Разгадываем Смысл Текста

С хорошо подготовленными и векторизованными данными мы можем переходить к решению реальных задач NLP. Наш опыт охватывает широкий спектр таких задач, от базовой классификации до сложных систем вопросно-ответных систем.

Распознавание Именованных Сущностей (NER)

Одной из самых полезных задач является NER (Named Entity Recognition) – идентификация и классификация именованных сущностей в тексте, таких как имена людей, названия организаций, географические объекты, даты, суммы денег и т.д. Это невероятно важно для извлечения информации. Например, из новостной статьи мы можем автоматически извлечь, кто, где и когда совершил какое-либо действие;

Мы начинали с spaCy для быстрого NER, который благодаря своим предварительно обученным моделям, работает очень эффективно и точно. Для более сложных или специализированных доменов (например, медицинских записей или юридических документов) мы использовали:

- CRF (Conditional Random Fields): Классический статистический метод, который позволяет нам обучать собственные модели NER на размеченных данных.

- Библиотека Flair: Отличный инструмент для современного NER, который использует глубокие контекстуальные эмбеддинги и показывает впечатляющие результаты.

- Применение BERT для задачи NER: С появлением трансформеров, BERT стал золотым стандартом. Мы тонко настраивали (fine-tuning) предварительно обученные модели BERT для наших специфических задач NER, что позволило достичь состояния искусства в точности.

Оценка качества NER-моделей (F1-score, Precision, Recall) всегда является неотъемлемой частью нашей работы. Мы тщательно анализируем метрики, чтобы убедиться в надежности наших систем.

Анализ Тональности (Sentiment Analysis)

Понимание эмоций и мнений, выраженных в тексте, критически важно для бизнеса, политики и маркетинга. Анализ тональности позволяет нам определять, является ли текст позитивным, негативным или нейтральным. Мы применяли его для анализа:

- Отзывов клиентов о продуктах и ресторанах.

- Сообщений в социальных сетях (Twitter/Reddit) для мониторинга бренда.

- Финансовых новостей, чтобы предсказывать изменения на рынке.

- Отзывов о фильмах.

Для простых задач мы часто начинали с VADER (Valence Aware Dictionary and sEntiment Reasoner), который отлично подходит для текста из социальных сетей и учитывает восклицательные знаки, смайлики и другие усилители. TextBlob для простого NLP также предлагает быстрый и легкий способ оценить тональность. Однако для более глубокого анализа, особенно с учетом сарказма или контекста, мы переходили к моделям машинного обучения, обученным на размеченных данных, включая использование трансформерных архитектур для распознавания эмоций.

Тематическое Моделирование (Topic Modeling)

Когда у нас есть большой объем текста, бывает сложно понять, о чем он. Тематическое моделирование помогает нам автоматически выявлять скрытые темы в текстовых корпусах. Мы активно используем библиотеку Gensim для тематического моделирования (LDA, LSI).

- LDA (Latent Dirichlet Allocation): Наш основной инструмент для выявления тем. Он предполагает, что каждый документ представляет собой смесь нескольких тем, а каждая тема – это смесь слов. Мы применяли LDA для анализа отзывов, новостей, а также для выявления скрытых тем в больших текстовых массивах.

- LSI (Latent Semantic Indexing): Более ранний метод, также полезный для тематического анализа.

Мы проводили сравнение моделей тематического моделирования (LDA vs NMF), чтобы выбрать наиболее подходящую для конкретных данных. NMF (Non-negative Matrix Factorization) иногда давал более интерпретируемые темы в определенных контекстах. Использование TextRank для выделения тем также является интересным подходом, основанным на графовых алгоритмах.

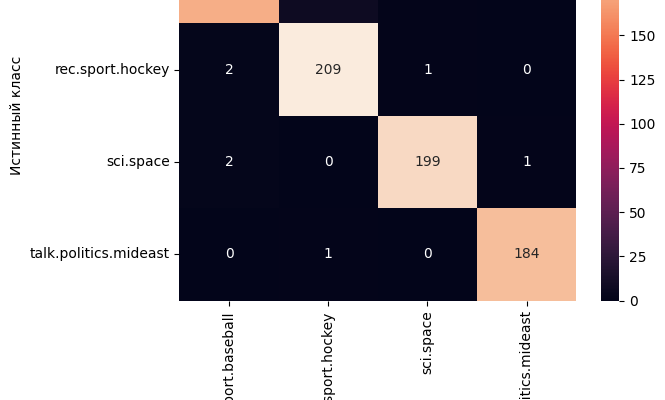

Классификация Текстов

Одна из самых распространенных задач в NLP – автоматическая категоризация текстов. Это может быть классификация спама, маршрутизация запросов клиентов в нужный отдел, или категоризация новостных статей. Мы активно применяли Scikit-learn для классификации текстов, используя различные алгоритмы:

- Наивный Байесовский классификатор: Простой, но часто эффективный, особенно с TF-IDF векторизацией.

- SVM (Support Vector Machines): Показал отличные результаты на многих наших проектах благодаря своей способности находить оптимальную разделяющую гиперплоскость.

- Логистическая регрессия: Хороший баланс между простотой и производительностью.

Для более сложных задач мы перешли к глубокому обучению, применяя PyTorch/TensorFlow для создания нейросетей NLP, таких как LSTM-сети, которые способны улавливать долгосрочные зависимости в тексте. А с появлением трансформеров, применение BERT для задач классификации стало стандартом, значительно повысив точность.

"Язык – это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Продвинутые Техники и Современные Тенденции в NLP

Мир NLP развиваеться с невероятной скоростью. То, что вчера казалось фантастикой, сегодня становится повседневным инструментом. Мы постоянно следим за новейшими разработками и внедряем их в нашу практику.

Трансформеры и Hugging Face: Революция в NLP

Появление архитектуры Трансформеров и библиотеки Hugging Face стало настоящей революцией. Эти модели, такие как BERT, GPT, T5, способны понимать и генерировать текст на уровне, который ранее был недостижим. Мы используем трансформеры (Hugging Face) для сложных задач NLP, включая:

- Тонкая настройка (Fine-tuning) предварительно обученных моделей: Мы берем огромные, предварительно обученные модели (например, BERT) и дообучаем их на наших специфических данных для конкретных задач, будь то классификация, NER или вопросно-ответные системы. Это позволяет нам достигать впечатляющих результатов с относительно небольшим объемом размеченных данных.

- Генерация текста (GPT): Мы экспериментируем с использованием Transformer-моделей для генерации текста, от создания коротких резюме до автоматического написания ответов в чат-ботах и даже генерации кода.

- Разработка систем вопросно-ответных систем (QA): С помощью трансформеров мы создавали системы, которые могут отвечать на вопросы, извлекая информацию из больших текстовых корпусов. Это очень перспективно для поддержки клиентов и поиска информации.

- Машинный перевод: Использование Transformer-моделей для машинного перевода позволяет создавать системы, которые значительно превосходят традиционные подходы.

Векторизация текста с учётом контекста (контекстное встраивание), которое обеспечивают трансформеры, является ключевым фактором их успеха. Они понимают не просто слова, а их смысл в конкретном предложении.

Суммаризация Текста: Извлечение Сути

В мире информационного перегруза, автоматическая суммаризация текста становится бесценным инструментом. Мы работали над разработкой системы суммаризации текста (Abstractive vs Extractive):

- Экстрактивная суммаризация: Выбирает наиболее важные предложения из исходного текста и объединяет их в краткое резюме. Мы использовали библиотеку TextRank для извлечения ключевых предложений и суммаризации.

- Абстрактивная суммаризация: Генерирует совершенно новый текст, который передает основную идею оригинала, но использует новые формулировки. Это более сложная задача, которую мы решали с помощью Transformer-моделей для суммаризации, например, T5 или BART.

Сравнение моделей суммирования: экстрактивная и абстрактная, всегда показывает, что абстрактивные модели дают более "человечные" резюме, но требуют гораздо больших вычислительных ресурсов и сложнее в обучении.

Мультиязычный NLP: Разрушая Языковые Барьеры

Наши проекты часто выходят за рамки одного языка. Обработка многоязычных текстовых корпусов – это отдельное направление, где мы используем специализированные инструменты:

- Библиотека Polyglot: Отличный инструмент для мультиязычности, позволяющий работать с языками, которые не так хорошо поддерживаются другими библиотеками. Мы использовали Polyglot для анализа редких языков.

- Stanza (от Stanford NLP Group): Особенно полезна для языков с богатой морфологией, таких как русский, так как предоставляет глубокий лингвистический анализ (POS-теггинг, синтаксический парсинг, лемматизация) для множества языков. Использование Stanza для русского языка дало нам очень хорошие результаты.

- Работа с нелатинскими алфавитами в Python NLP требует особого внимания к кодировкам и правильным моделям токенизации.

NLP для Специфических Областей и Задач

Мы постоянно находим новые применения для NLP в самых разных областях:

- Анализ юридических документов: Использование Python для анализа юридических документов, извлечения дат, сумм, сторон контрактов – это огромная экономия времени для юристов.

- Анализ медицинских записей: Извлечение симптомов, диагнозов, названий лекарств из неструктурированных медицинских текстов помогает в исследованиях и диагностике.

- Разработка чат-ботов на Python (Rasa framework): Мы создавали интерактивные боты для поддержки клиентов и автоматизации ответов, используя фреймворк Rasa, который позволяет строить сложные диалоговые системы.

- Анализ стилистики текстов (авторский почерк): Определение автора текста, анализ его уникальных языковых паттернов.

- Работа с эмодзи и сленгом в современных текстах: Для анализа социальных сетей это критически важно. Мы разрабатывали инструменты для нормализации сленга.

- Разработка систем обнаружения плагиата: Сравнение документов и выявление совпадений с использованием методов измерения сходства, например, библиотеки Textdistance для сравнения строк и документов.

- Анализ лог-файлов: Извлечение полезной информации из хаотичных логов для мониторинга систем.

- Разработка инструментов для проверки грамматики и орфографии: Создание собственных или использование существующих библиотек для улучшения качества текста.

- Анализ текста для извлечения ключевых фраз: Помимо TF-IDF, мы использовали RAKE (Rapid Automatic Keyword Extraction) и TextRank.

Экосистема Python для NLP: Инструменты, Которые Мы Любим

Python предлагает богатую экосистему библиотек, которые значительно упрощают нашу работу. Вот некоторые из них, которые мы упоминали и активно используем:

| Библиотека | Основные Функции | Наши Сценарии Использования |

|---|---|---|

| NLTK | Токенизация, стемминг, лемматизация, POS-теггинг, синтаксический парсинг, доступ к корпусам | Изучение основ NLP, морфологический анализ, работа с небольшими корпусами |

| spaCy | NER, лемматизация, синтаксический парсинг, POS-теггинг, быстродействие, готовые модели | Быстрый и точный NER, лемматизация для различных языков, синтаксический парсинг |

| Gensim | Тематическое моделирование (LDA, LSI), Word2Vec, Doc2Vec, FastText | Анализ тем в больших корпусах, создание векторных представлений слов и документов |

| Scikit-learn | Классификация, кластеризация, векторизаторы (CountVectorizer, TfidfVectorizer) | Классификация текстов, разработка собственных векторизаторов, сравнение методов ML |

| Hugging Face Transformers | Предварительно обученные модели (BERT, GPT, T5), тонкая настройка, генерация текста | Продвинутый NER, суммаризация, вопросно-ответные системы, машинный перевод, генерация контента |

| TextBlob | Простой NLP, анализ тональности, POS-теггинг, перевод, определение языка | Быстрый анализ тональности, прототипирование, простые задачи определения языка |

| Beautiful Soup | Парсинг HTML/XML, веб-скрейпинг | Извлечение текста из веб-страниц для последующего анализа |

| `re` (модуль регулярных выражений) | Поиск и манипуляции с текстовыми паттернами | Очистка текста, извлечение специфических сущностей (даты, номера) |

Дополнительные Инструменты

Помимо этих гигантов, мы активно используем и другие библиотеки:

- VADER для быстрого анализа тональности.

- PyMuPDF для извлечения текста из PDF-документов.

- Textacy для более продвинутой работы с текстом, включая извлечение информации и анализ зависимостей;

- Stanza для глубокого лингвистического анализа многоязычных текстов.

- Sentence Transformers для создания семантически осмысленных эмбеддингов предложений.

- Flair для современного NER и других задач.

Вызовы и Перспективы: Куда Движется NLP?

Наш путь в NLP не был лишен трудностей. Проблемы обработки неполных и ошибочных данных, работа с сарказмом и иронией, а также необходимость обработки больших текстовых массивов (Big Data NLP) – это лишь часть вызовов, с которыми мы сталкивались. Мы постоянно ищем способы улучшить оценку качества моделей (F1-score, Precision, Recall) и сравниваем различные подходы, чтобы найти оптимальное решение.

Будущее NLP выглядит невероятно захватывающим. Развитие трансформерных архитектур открывает двери для еще более совершенных систем генерации текста, машинного перевода, вопросно-ответных систем и даже анализа кода. Мы видим огромный потенциал в разработке моделей для выявления связей между сущностями, что позволит нам строить графы знаний и извлекать еще более глубокие инсайты из текста.

Визуализация Текстовых Данных: Делаем Невидимое Видимым

Визуализация – это не просто красивый способ представить данные, это мощный инструмент для понимания скрытых паттернов. Мы часто используем:

- Word Clouds (облака слов): Для быстрого выявления наиболее частых слов в тексте.

- Heatmaps: Для визуализации матриц сходства документов или корреляций между темами.

- Графики частотности слов и n-грамм: Помогают нам выявлять ключевые фразы и анализировать лексическое богатство текстов.

Итак, мы прошли долгий, но невероятно увлекательный путь по миру обработки естественного языка с Python. От основ токенизации и стемминга до глубинных нейронных сетей и трансформеров, мы увидели, как компьютеры учатся понимать и взаимодействовать с человеческим языком. Наш опыт показывает, что Python с его богатой экосистемой библиотек является идеальным инструментом для каждого, кто хочет погрузиться в эту область.

Каждый новый проект в NLP – это как разгадывание новой головоломки, где текст – это ключ, а Python – наш универсальный отмычка. Мы продолжаем учиться, экспериментировать и делиться нашими открытиями. Надеемся, что этот обзор вдохновил вас на собственные исследования и показал, какие безграничные возможности открывает NLP. Мир текста ждет своих исследователей, и мы уверены, что вы сможете сделать в нем свои уникальные открытия!

Подробнее

| Основы NLTK | NER с spaCy | Word Embeddings | Анализ тональности VADER | Трансформеры Hugging Face |

| Тематическое моделирование Gensim | Классификация текстов Scikit-learn | Разработка векторизаторов | Продвинутая лемматизация | Вопросно-ответные системы |