- Раскрываем Тайны Текста: Наш Путь в Мир NLP на Python от А до Я

- Первые Шаги: Подготовка Текста к Анализу

- Основы NLTK: Токенизация и Стемминг

- Регулярные Выражения и Очистка Текста

- Представление Текста: От Слов к Числам

- Классические Векторизаторы: CountVectorizer и TfidfVectorizer

- Word Embeddings: Word2Vec, GloVe и FastText

- Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

- Ключевые Задачи NLP: Извлечение Смысла

- Распознавание Именованных Сущностей (NER)

- Тематическое Моделирование: Поиск Скрытых Смыслов

- Анализ Тональности (Sentiment Analysis)

- Классификация Текстов: Автоматическая Категоризация

- Извлечение Ключевых Фраз и Суммаризация

- Продвинутый NLP: На Вершине Технологий

- Трансформеры (Hugging Face) для Сложных Задач NLP

- Синтаксический Парсинг и Анализ Зависимостей

- Мультиязычный NLP и Сложная Морфология

- Практические Приложения и Инструменты

- Сбор и Извлечение Данных

- Создание Интеллектуальных Систем

- Анализ и Визуализация Данных

- Дополнительные Полезные Библиотеки

- Вызовы и Перспективы NLP

- Проблемы Обработки Неполных и Ошибочных Данных

- Масштабирование и Производительность

- Оценка Качества Моделей

Раскрываем Тайны Текста: Наш Путь в Мир NLP на Python от А до Я

Привет, дорогие читатели и коллеги по цеху! Сегодня мы хотим погрузиться в одну из самых увлекательных и быстро развивающихся областей современного программирования – Обработку Естественного Языка, или как мы любим ее называть, NLP․ Это не просто набор алгоритмов; это целое искусство, позволяющее компьютерам не только "читать", но и "понимать" наш человеческий язык․ Представьте, как много информации скрыто в текстах, которые мы ежедневно создаем: от постов в социальных сетях до многостраничных юридических документов․ И Python, с его мощными библиотеками, предоставляет нам невероятные инструменты для того, чтобы эти тайны раскрыть․

Мы прошли долгий путь от первых экспериментов с простым подсчетом слов до построения сложных нейросетей, способных генерировать осмысленный текст․ И за это время мы убедились: NLP – это не магия, а систематический подход, подкрепленный глубоким пониманием лингвистики и математики․ В этой статье мы хотим поделиться нашим обширным опытом, провести вас через ключевые концепции и инструменты, которые мы используем в своей ежедневной работе, и показать, как вы можете начать свой собственный путь или углубить уже имеющиеся знания․ Приготовьтесь, нас ждет увлекательное путешествие по лабиринтам текста!

Первые Шаги: Подготовка Текста к Анализу

Прежде чем компьютер сможет что-либо "понять" в тексте, нам необходимо его подготовить․ Человеческий язык полон нюансов, неоднозначностей и беспорядка․ Слова могут быть написаны по-разному, иметь разные окончания, включать знаки препинания или даже ошибки․ Поэтому этап предобработки – это фундамент любого NLP-проекта, и мы всегда уделяем ему особое внимание․

Основы NLTK: Токенизация и Стемминг

Наш путь в NLP часто начинается с NLTK (Natural Language Toolkit) – это, по сути, швейцарский нож для работы с текстом в Python․ NLTK предоставляет нам базовые, но крайне важные инструменты․ Одним из первых шагов всегда является токенизация – процесс разбиения текста на отдельные слова или фразы, которые мы называем токенами․ Представьте, что у нас есть предложение "Искусственный интеллект меняет мир!"․ Без токенизации компьютер видит это как одну длинную строку․ С помощью NLTK мы легко можем разбить его на [‘Искусственный’, ‘интеллект’, ‘меняет’, ‘мир’, ‘!’]․

После токенизации часто возникает необходимость привести слова к их базовой форме․ Здесь на помощь приходят стемминг и лемматизация․ Стемминг, например, с помощью алгоритма Портера или Сноуболла, отсекает суффиксы и окончания, чтобы получить "корень" слова․ Так, "бегающий", "бегал", "бежать" могут быть сведены к "бег"․ Это быстрый и эффективный метод, но он не всегда дает морфологически правильные слова․ Лемматизация, в свою очередь, использует словарные данные для приведения слова к его словарной форме (лемме), например, "были" к "быть"․ Мы часто используем NLTK для стемминга на ранних этапах, а для более точной работы переходим к лемматизации, которая, как правило, дает более качественные результаты, особенно с использованием spaCy или Stanza для языков с богатой морфологией, таких как русский․

Регулярные Выражения и Очистка Текста

Реальные текстовые данные редко бывают чистыми․ Они могут содержать HTML-теги, URL-адреса, специальные символы, опечатки, эмодзи и даже сленг․ Регулярные выражения (библиотека `re`) – это наш незаменимый инструмент для поиска и замены таких паттернов․ Мы используем их для удаления всего лишнего, что может помешать дальнейшему анализу․ Например, удалить все HTML-теги из веб-страницы или очистить текст от пунктуации․

Процесс очистки данных охватывает множество аспектов:

- Удаление HTML-тегов: Часто мы получаем текст из веба, и теги вроде ` ` или `

` нам совершенно не нужны․

На этом этапе мы также часто сталкиваемся с необходимостью сравнения библиотек для лемматизации и стемминга․ Если для английского языка разница не так критична, то для русского, с его богатой морфологией, spaCy и Stanza обычно дают гораздо лучшие результаты лемматизации по сравнению со стеммерами NLTK, хотя и работают медленнее․

Представление Текста: От Слов к Числам

После того как текст очищен и приведен к более-менее стандартизированному виду, перед нами встает следующая задача: как преобразовать слова и предложения в формат, понятный для машины? Компьютеры работают с числами, а не с буквами․ Здесь на сцену выходят методы векторизации, которые позволяют нам представить текст в виде числовых векторов․

Классические Векторизаторы: CountVectorizer и TfidfVectorizer

Самые простые, но все еще эффективные методы векторизации – это CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn․

- CountVectorizer: Создает вектор, где каждая позиция соответствует слову из всего корпуса текста, а значение – это количество раз, сколько данное слово встречается в конкретном документе․ Это простой подсчет частотности слов․

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): Более продвинутый метод․ Он не только учитывает частоту слова в документе (TF), но и дает ему меньший вес, если это слово часто встречается во всем корпусе документов (IDF)․ Таким образом, слова, которые часто встречаются везде (как "и" или "на"), получают меньший вес, а слова, уникальные для конкретного документа, – больший․ Это помогает выделить наиболее значимые слова․

Мы часто начинаем с TF-IDF для задач классификации текста, поскольку он хорошо работает и его легко интерпретировать․ Однако, у этих методов есть свои ограничения: они не учитывают семантическую близость слов (например, "кошка" и "кот" будут восприниматься как совершенно разные слова) и создают очень разреженные векторы (много нулей), особенно при больших словарях․

Word Embeddings: Word2Vec, GloVe и FastText

Чтобы преодолеть ограничения классических методов, были разработаны Word Embeddings – "встраивания" слов․ Это плотные векторы, которые улавливают семантические и синтаксические отношения между словами․ Слова с похожим значением будут иметь близкие векторы в многомерном пространстве․

Мы активно используем библиотеку Gensim для работы с:

- Word2Vec: Это одна из первых и наиболее популярных моделей, которая обучается предсказывать слово по его контексту (CBOW) или контекст по слову (Skip-gram)․ Мы сравниваем Word2Vec (Skip-gram vs CBOW) для разных задач и часто выбираем Skip-gram, когда у нас меньше данных, так как он лучше работает с редкими словами․

- GloVe (Global Vectors for Word Representation): Альтернатива Word2Vec, которая использует глобальную статистику соо встречаемости слов․

- FastText: Разработанный Facebook AI, FastText расширяет идею Word2Vec, представляя слова как набор символьных N-грамм․ Это позволяет ему хорошо работать с редкими словами и даже со словами, не встречавшимися в обучающем корпусе (out-of-vocabulary words), а также эффективно обрабатывать морфологически богатые языки․

Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

Если Word Embeddings отлично работают на уровне слов, то для целых предложений или документов нам нужны другие подходы․

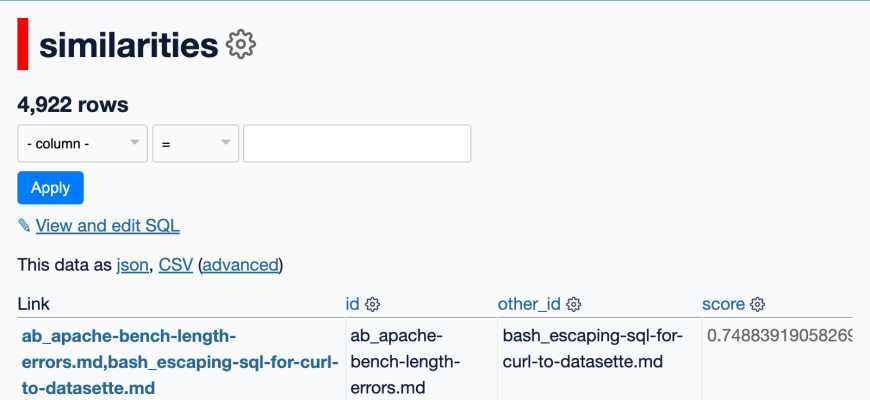

- Doc2Vec (Paragraph Vector): Также из Gensim, это расширение Word2Vec, которое позволяет создавать векторы для целых документов, учитывая их контекст и семантику․ Мы используем его для представления целых документов в задачах поиска сходства или кластеризации․

- Sentence Transformers: Это относительно новая, но крайне мощная библиотека, которая позволяет получать высококачественные эмбеддинги для предложений и документов, основанные на трансформерных архитектурах․ Они отлично подходят для задач измерения сходства текстов, поиска дубликатов, суммаризации и даже для создания вопросно-ответных систем․

Выбор метода векторизации всегда зависит от задачи и объема данных․

| Метод | Преимущества | Недостатки | Типичные Задачи |

|---|---|---|---|

| CountVectorizer | Простота, легкость интерпретации․ | Не учитывает семантику, разреженные векторы․ | Базовая классификация, анализ частотности․ |

| TfidfVectorizer | Выделяет важные слова, лучше чем CountVectorizer․ | Не учитывает семантику, разреженные векторы․ | Классификация, извлечение ключевых слов․ |

| Word2Vec/GloVe | Учитывает семантику и синтаксис, плотные векторы․ | Сложно обучать с нуля на малых корпусах, не работает с OOV․ | Поиск сходства слов, расширение словаря․ |

| FastText | Работает с OOV и редкими словами, учитывает морфологию․ | Более требователен к ресурсам чем Word2Vec․ | Морфологически богатые языки, классификация текста․ |

| Doc2Vec | Векторизация целых документов, учитывает контекст․ | Сложнее в настройке, требует больше данных для обучения․ | Поиск сходства документов, кластеризация․ |

| Sentence Transformers | Высококачественные эмбеддинги предложений, контекст․ | Основаны на больших моделях, требуют GPU для эффективной работы․ | Поиск дубликатов, QA, суммаризация, поиск․ |

Ключевые Задачи NLP: Извлечение Смысла

Теперь, когда мы умеем подготавливать текст и преобразовывать его в числовой формат, перед нами открываются двери к решению более сложных и интересных задач․ Мы можем извлекать именованные сущности, определять эмоциональную окраску, находить скрытые темы и классифицировать документы․ Каждая из этих задач имеет огромное практическое значение․

Распознавание Именованных Сущностей (NER)

NER (Named Entity Recognition) – это задача идентификации и классификации именованных сущностей в тексте, таких как имена людей, названия организаций, географические местоположения, даты и денежные суммы․ Это критически важно для систем извлечения информации, вопросно-ответных систем и многих других приложений․ Например, в предложении "Илон Маск встретился с главой Apple в Купертино 12 января․" NER поможет нам выделить "Илон Маск" как человека, "Apple" как организацию, "Купертино" как локацию и "12 января" как дату․

Для быстрого и эффективного NER мы часто используем spaCy․ Это высокопроизводительная библиотека, которая предоставляет готовые, предварительно обученные модели для различных языков, включая русский․ Она не только распознает сущности, но и выполняет синтаксический парсинг, POS-теггинг и лемматизацию․ Помимо spaCy, для более сложных сценариев или языков с богатой морфологией мы применяем CRF (Conditional Random Fields) или современные нейросетевые подходы, такие как те, что реализованы в библиотеке Flair, которая использует контекстные встраивания для NER․ Мы также разрабатываем системы для автоматической разметки сущностей, чтобы облегчить создание обучающих данных для наших моделей․

Оценка качества NER-моделей является ключевым этапом․ Мы используем метрики, такие как F1-score, Precision и Recall, чтобы понять, насколько хорошо наша модель справляется с задачей, и где есть возможности для улучшения․

Тематическое Моделирование: Поиск Скрытых Смыслов

Представьте, что у вас есть огромный корпус текстов – тысячи или миллионы документов․ Как понять, о чем они? Вручную это невозможно․ Здесь на помощь приходит тематическое моделирование – набор алгоритмов, которые позволяют автоматически обнаруживать скрытые "темы" в коллекции документов․ Каждая тема представлена набором слов, которые часто встречаются вместе․

Для тематического моделирования мы активно используем библиотеку Gensim, которая предлагает реализации таких алгоритмов, как:

- LDA (Latent Dirichlet Allocation): Одна из самых популярных моделей, которая предполагает, что каждый документ является смесью нескольких тем, а каждая тема – смесью слов․

- LSI (Latent Semantic Indexing): Более старый, но все еще полезный метод, основанный на сингулярном разложении матрицы терм-документ․

Мы также сравниваем модели тематического моделирования, такие как LDA vs NMF (Non-negative Matrix Factorization)․ NMF часто дает более интерпретируемые темы, особенно когда у нас есть дополнительные ограничения․ Эти методы бесценны для анализа больших текстовых массивов, таких как отзывы клиентов, новостные статьи или юридические документы, помогая нам выявлять скрытые темы и тенденции․ Для извлечения ключевых предложений, которые наилучшим образом представляют темы, мы часто применяем TextRank – алгоритм, основанный на PageRank․

Анализ Тональности (Sentiment Analysis)

Понимание эмоциональной окраски текста – это один из краеугольных камней современного NLP, особенно в бизнесе․ Отзывы клиентов, посты в социальных сетях, новостные заголовки – везде есть тональность․ Мы используем анализ тональности для определения, является ли текст позитивным, негативным или нейтральным․

В нашем арсенале есть несколько инструментов:

- VADER (Valence Aware Dictionary and sEntiment Reasoner): Это правиловая модель, которая отлично работает с текстами из социальных сетей, поскольку учитывает капитализацию, пунктуацию и смайлики․ Мы используем VADER для анализа тональности сообщений в социальных сетях (Twitter/Reddit)․

- TextBlob: Простая в использовании библиотека, которая предоставляет готовые модели для анализа тональности․ Однако, мы всегда помним про ограничения TextBlob и ищем альтернативы для более сложных задач или специфических доменов, например, для русского языка․

- Для более глубокого анализа тональности, особенно с учетом сарказма или контекста (например, анализ тональности финансовых новостей или отзывов о продуктах по категориям), мы обучаем собственные модели на основе машинного обучения (классификаторы) или используем предварительно обученные трансформерные модели․

Классификация Текстов: Автоматическая Категоризация

Классификация текстов – это задача отнесения документа к одной или нескольким предопределенным категориям․ Это может быть спам-фильтр, категоризация новостных статей, отзывов или юридических документов․ Мы применяем Scikit-learn для классификации текстов, используя различные алгоритмы машинного обучения:

- Наивный Байесовский классификатор: Простой, но часто эффективный, особенно для текстовых данных․

- SVM (Support Vector Machines): Мощный алгоритм, который хорошо работает с высокоразмерными данными, такими как текстовые эмбеддинги․

- Случайный лес (Random Forest) и градиентный бустинг (XGBoost, LightGBM): Древовидные ансамбли, которые также показывают отличные результаты․

«Язык – это дорожная карта культуры․ Он говорит вам, откуда пришли его люди и куда они идут․»

— Рита Мэй Браун

Помимо классических ML-алгоритмов, мы активно используем PyTorch/TensorFlow для создания нейросетей NLP, таких как LSTM-сети (Long Short-Term Memory), которые отлично подходят для последовательных данных, учитывая контекст слов․ А с появлением трансформерных моделей, применение BERT для задач классификации стало стандартом де-факто, позволяя достигать выдающихся результатов․

Извлечение Ключевых Фраз и Суммаризация

В мире, перегруженном информацией, способность быстро извлекать ключевые идеи из текста становится бесценной․ Мы работаем над двумя основными задачами в этой области:

- Извлечение ключевых фраз: Для этого мы используем такие инструменты, как RAKE (Rapid Automatic Keyword Extraction), который эффективно извлекает ключевые слова и фразы на основе их частотности и встречаемости в определенных паттернах․ Также мы применяем TextRank, который, подобно PageRank, ранжирует предложения или слова по их важности в тексте․

- Суммаризация текста: Это процесс создания краткого изложения длинного документа․ Мы различаем два типа:

- Экстрактивная суммаризация: Выбирает наиболее важные предложения из исходного текста и объединяет их․ Это проще в реализации и часто дает хорошие результаты, особенно для информационных текстов․

- Абстрактивная суммаризация: Генерирует новые предложения, которые передают суть исходного текста, подобно тому, как это делает человек․ Это гораздо более сложная задача, требующая глубокого понимания языка и часто реализуется с помощью трансформерных моделей (Hugging Face)․

Сравнение моделей суммирования: экстрактивная и абстрактная показывает, что для простых случаев экстрактивные методы быстрее и достаточно точны, но для создания по-настоящему связных и новых изложений, абстрактивные подходы на основе трансформеров незаменимы․

Продвинутый NLP: На Вершине Технологий

По мере развития вычислительных мощностей и появления новых архитектур, таких как трансформеры, мир NLP переживает настоящую революцию․ Мы активно исследуем и внедряем эти передовые технологии, чтобы решать все более сложные задачи и создавать по-настоящему интеллектуальные системы․

Трансформеры (Hugging Face) для Сложных Задач NLP

Трансформеры – это архитектура, которая полностью изменила ландшафт NLP․ Их способность улавливать долгосрочные зависимости в тексте благодаря механизму внимания (attention mechanism) открыла новые горизонты․ Мы активно работаем с библиотекой Hugging Face Transformers, которая предоставляет доступ к сотням предварительно обученных моделей, таких как BERT, GPT, T5, RoBERTa и многим другим․ Эти модели являются основой для множества продвинутых задач:

- Тонкая настройка (Fine-tuning) предварительно обученных моделей: Вместо обучения модели с нуля, мы берем уже существующую большую модель и дообучаем ее на наших специфических данных для конкретной задачи (например, классификации медицинских документов или анализа тональности финансовых новостей)․ Это позволяет достигать выдающихся результатов при относительно небольшом объеме наших собственных данных․

- Генерация текста (GPT): Модели, такие как GPT (Generative Pre-trained Transformer), способны генерировать связный и осмысленный текст на основе заданного начального фрагмента․ Мы используем их для создания описаний товаров, написания черновиков статей, генерации диалогов для чат-ботов и даже для генерации кода․

- Машинный перевод: Transformer-модели являются основой современных систем машинного перевода, обеспечивая качество, которое ранее казалось недостижимым․ Мы разрабатываем системы машинного перевода на Python, используя эти архитектуры, в т․ч․ для узкоспециализированных текстов․

- Вопросно-ответные системы (QA): Трансформеры позволяют нам создавать системы, которые могут отвечать на вопросы, извлекая информацию из больших объемов текста или генерируя ответы․

- Распознавание эмоций: Используя трансформерные архитектуры, мы можем анализировать текст не только на тональность, но и на более тонкие эмоции, что важно для анализа отзывов и пользовательских взаимодействий․

- Анализ кода: Трансформеры могут быть применены даже для анализа и генерации кода, помогая в его сжатии или автоматическом дополнении․

Работа с трансформерами часто требует GPU-ускорения, особенно для обучения и тонкой настройки на больших данных, но их эффективность оправдывает эти затраты․

Синтаксический Парсинг и Анализ Зависимостей

Понимание структуры предложения – кто что делает, с чем связано – является критическим для многих продвинутых задач NLP․ Синтаксический парсинг позволяет нам построить дерево зависимостей, которое показывает грамматические связи между словами в предложении․ Мы активно используем spaCy для реализации синтаксического парсинга и анализа зависимостей․

Например, из предложения "Собака быстро бежит за мячом" spaCy может определить, что "собака" является подлежащим, "бежит" – сказуемым, "быстро" – наречием, модифицирующим "бежит", а "мячом" – дополнением, связанным с "бежит" через предлог "за"․ Это позволяет нам:

- Извлекать отношения между сущностями (кто кого/что делает)․

- Создавать более точные системы вопросно-ответных систем․

- Улучшать качество машинного перевода․

- Анализировать стилистику текстов и авторский почерк․

Мультиязычный NLP и Сложная Морфология

Мир не ограничивается английским языком․ Мы часто работаем с многоязычными текстовыми корпусами, включая русский и другие языки с богатой морфологией․ Это ставит перед нами дополнительные вызовы, но и предоставляет новые возможности․

Для работы с различными языками мы используем:

- Библиотека Polyglot: Отличный инструмент для мультиязычности, который поддерживает широкий спектр языков для токенизации, NER, анализа тональности и определения языка․ Мы используем Polyglot для анализа редких языков, с которыми менее популярные библиотеки могут не справиться․

- Библиотека Stanza: Разработанная Stanford NLP Group, Stanza предоставляет комплексный набор инструментов для многих языков, включая высококачественную лемматизацию, POS-теггинг и синтаксический парсинг для языков с богатой морфологией․ Мы используем Stanza для русского языка, где ее морфологический анализ значительно превосходит более простые методы․

- Обработка нелатинских алфавитов: Это требует особого внимания к кодировкам и правильной токенизации․

Практические Приложения и Инструменты

Все эти теоретические знания и алгоритмы обретают истинную ценность, когда мы применяем их для решения реальных проблем․ Наш опыт охватывает широкий спектр практических приложений, от автоматизации рутинных задач до создания сложных интеллектуальных систем․

Сбор и Извлечение Данных

Для начала работы с текстом нам, очевидно, нужен сам текст․ И часто он находится не в идеальном формате․

- Веб-скрейпинг с Beautiful Soup: Мы регулярно используем библиотеку Beautiful Soup для веб-скрейпинга текста с веб-страниц․ Это позволяет нам собирать данные для анализа отзывов, новостных статей, блогов и форумов․

- Извлечение текста из PDF: Многие важные документы, такие как юридические контракты или научные статьи, хранятся в формате PDF․ Библиотека PyMuPDF (или `fitz`) позволяет нам эффективно извлекать текст из PDF-файлов для дальнейшей обработки․

- Анализ метаданных текста: Иногда не только сам текст, но и его метаданные (автор, дата создания, источник) содержат ценную информацию, которую мы также извлекаем․

- Анализ лог-файлов: В системном администрировании и разработке ПО, логи – это золотая жила информации․ Мы используем Python для анализа лог-файлов, выявляя аномалии, ошибки и поведенческие паттерны․

Создание Интеллектуальных Систем

NLP позволяет нам создавать системы, которые взаимодействуют с пользователями или автоматизируют сложные задачи․

- Разработка чат-ботов на Python (Rasa framework): Мы активно используем Rasa для создания диалоговых систем․ Rasa предоставляет полноценный фреймворк для построения контекстно-зависимых чат-ботов, способных понимать естественный язык и вести осмысленные диалоги․

- Разработка систем вопросно-ответных систем (QA): Используя трансформерные модели и продвинутые методы извлечения информации, мы создаем системы, способные отвечать на вопросы пользователей на основе большого массива документов․

- Разработка систем обнаружения плагиата: Сравнение документов с использованием Textdistance или векторизации Doc2Vec позволяет нам выявлять сходство текстов и обнаруживать плагиат․

- Разработка систем автоматической категоризации статей и новостей: На основе классификации текста мы создаем системы, которые автоматически присваивают категориям входящие документы․

- Разработка систем для автоматического тегирования контента: Мы используем алгоритмы извлечения ключевых слов и тематического моделирования для автоматического создания тегов для статей, блогов или товаров․

- Разработка системы для создания FAQ на основе документов: Анализируя часто задаваемые вопросы и документы, мы можем автоматически генерировать базу знаний․

Анализ и Визуализация Данных

Чтобы понять результаты нашего анализа, часто необходима визуализация․

- Инструменты для визуализации текстовых данных (Word Clouds, Heatmaps): Word Clouds (облака слов) – это простой, но эффективный способ визуализации частоты слов․ Heatmaps могут быть использованы для визуализации матриц сходства или корреляций․

- Анализ частотности слов и n-грамм: Мы часто начинаем с подсчета частотности отдельных слов и n-грамм (последовательностей из N слов) для быстрого обзора содержимого текста и выявления наиболее важных терминов․

- Анализ лексического богатства текстов: Оценка уникальных слов, длины предложений и других метрик позволяет нам судить о сложности и стилистике текста․

- Анализ временных рядов в текстовых данных: Например, отслеживание изменения тональности или частотности определенных тем в отзывах с течением времени․

- Использование Sweetviz для анализа текстовых данных: Хотя Sweetviz в основном для табличных данных, его возможности по визуализации категориальных признаков могут быть полезны для анализа распределения слов или тегов․

Дополнительные Полезные Библиотеки

Помимо уже упомянутых, мы активно используем следующие библиотеки в нашей работе:

- Textacy: Мощная библиотека для более продвинутой обработки текста, включая извлечение информации, анализ зависимостей и работу с графами․

- Textdistance: Для измерения сходства строк и документов, что полезно для поиска дубликатов, исправления опечаток или сравнения текстов․

- Pattern: Многоцелевая библиотека для NLP, веб-майнинга и машинного обучения․ Мы используем Pattern для анализа социальных сетей и тональности, особенно когда требуется более легковесное решение, чем полномасштабные трансформеры․

- Scipy: Для различных математических операций, кластеризации текстов и работы с разреженными матрицами․

- Jellyfish: Для сравнения строк и работы с расстояниями Левенштейна, что полезно для проверки орфографии и поиска похожих слов․

Вызовы и Перспективы NLP

Несмотря на все достижения, NLP – это область, полная вызовов․ Мы постоянно сталкиваемся с проблемами и ищем пути их решения, чтобы сделать наши системы еще умнее и надежнее․

Проблемы Обработки Неполных и Ошибочных Данных

Реальный мир редко бывает идеальным․ Текстовые данные часто содержат опечатки, пропуски, неполные предложения, неформальный язык и грамматические ошибки․ Проблемы обработки неполных и ошибочных данных – это то, с чем мы боремся на каждом проекте․ Мы разрабатываем инструменты для проверки грамматики и орфографии, нормализации сленга и очистки текста от "шума", чтобы повысить качество исходных данных․ Это включает в себя не только автоматические алгоритмы, но и создание инструментов для полуавтоматической разметки данных, где человек-оператор может быстро исправлять ошибки․

Масштабирование и Производительность

Работа с большими текстовыми массивами (Big Data NLP) требует особого подхода․ Обучение сложных моделей на терабайтах текста – это ресурсоемкая задача․ Мы активно используем GPU-ускорение для обучения нейросетей и трансформерных моделей․ Оптимизация кода, использование распределенных вычислений и эффективное управление памятью становятся критически важными․

Кроме того, есть задачи, требующие обработки текста в режиме реального времени (Streaming NLP), например, анализ сообщений в чатах или мониторинг социальных сетей․ Здесь важна не только точность, но и скорость обработки, что требует использования легковесных моделей или высокооптимизированных конвейеров․

Оценка Качества Моделей

Как понять, что наша модель работает хорошо? Правильная оценка качества NLP-моделей является ключевым этапом․ Мы используем различные метрики, такие как F1-score, Precision, Recall для классификации и NER, BLEU-score для машинного перевода, ROUGE-score для суммаризации, а также человеческую оценку для более субъективных задач, таких как генерация текста․ Разработка инструментов для автоматической разметки данных и сравнение алгоритмов кластеризации (K-Means vs DBSCAN) или методов машинного обучения без учителя также помогают нам в этом процессе․

Наш путь в мире NLP на Python – это непрерывное обучение и исследование․ Мы видели, как эта область трансформировалась от символьных правил и статистических моделей до сложных нейросетевых архитектур, способных к удивительным вещам․ От простейшей токенизации и стемминга с NLTK до создания продвинутых вопросно-ответных систем на трансформерах – каждый шаг приносил нам новые знания и вдохновение․

Будущее NLP выглядит невероятно захватывающим․ Мы ожидаем дальнейшего развития мультимодальных моделей, которые будут объединять текст, изображения и аудио; более глубокого понимания контекста и здравого смысла; а также создания еще более интуитивных и персонализированных интеллектуальных ассистентов․ Мы продолжим экспериментировать с новыми архитектурами, такими как Graph Embeddings для анализа взаимосвязей в тексте, и совершенствовать наши инструменты для анализа поведенческих паттернов в чатах и отзывах․

Надеемся, что наш опыт вдохновил вас на собственные исследования и открытия в этой удивительной области․ Python предоставляет нам мощный и гибкий инструментарий, а сообщество – огромное количество ресурсов и поддержку․ Давайте вместе продолжим раскрывать тайны текста и строить будущее, где компьютеры будут понимать нас еще лучше!․

Подробнее

| Основы NLTK | NER с spaCy | Тематическое моделирование LDA | Word2Vec в Gensim | Анализ тональности VADER |

| Векторизация TF-IDF | Трансформеры Hugging Face | Чат-боты Rasa | Doc2Vec для документов | Суммаризация текста |