- Магия Слов и Python: Наш Глубокий Погружение в NLP

- Начало Пути: Фундаментальные Концепции NLP и Первые Шаги с Python

- Токенизация, Стемминг и Лемматизация: Разбираем Текст на Части

- Регулярные Выражения и Очистка Текста: Делаем Данные Пригодными для Анализа

- Представляем Слова и Документы: От Текста к Числам

- Простые Модели: CountVectorizer и TF-IDF

- Глубокое Понимание: Word Embeddings (Word2Vec, GloVe, FastText)

- Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

- Основные Задачи NLP: От Классификации до Тематического Моделирования

- Классификация Текстов: Автоматическая Категоризация и Фильтрация

- Распознавание Именованных Сущностей (NER): Извлекаем Ключевую Информацию

- Анализ Тональности (Sentiment Analysis): Понимаем Эмоции

- Тематическое Моделирование: Выявляем Скрытые Темы

- Извлечение Ключевых Фраз и Суммаризация: Сокращаем и Выделяем Главное

- Продвинутые Темы и Современные Подходы в NLP

- Трансформеры и Hugging Face: Новый Уровень Понимания Языка

- Работа с Разнообразными Текстовыми Данными и Языками

- Разработка Сложных Систем: От Чат-ботов до Проверки Фактов

- Практические Аспекты и Лучшие Практики

- Очистка и Подготовка Данных: Ключ к Успеху

- Оценка Качества Моделей: Как Понять, что Работает Хорошо

- Масштабирование и Производительность: Big Data NLP

- Визуализация и Исследование Текстовых Данных

- Word Clouds и Heatmaps: Красота и Смысл

Магия Слов и Python: Наш Глубокий Погружение в NLP

Привет, друзья! Сегодня мы отправляемся в увлекательное путешествие по миру обработки естественного языка, или NLP, как его сокращенно называют. Если вы когда-либо задумывались, как голосовые помощники понимают наши команды, как почтовые сервисы фильтруют спам или как поисковые системы находят именно то, что мы ищем, то эта статья для вас. Мы, как давние исследователи и практики в этой области, готовы поделиться нашим богатым опытом, показать ключевые инструменты и методы, которые позволяют компьютерам "понимать" человеческий язык. Приготовьтесь, будет интересно и, самое главное, очень практично!

В нашем стремительно развивающемся цифровом мире, где текст является основной формой обмена информацией, способность машин анализировать, интерпретировать и даже генерировать человеческий язык стала не просто полезной, а абсолютно необходимой. От автоматического перевода до интеллектуального поиска, от анализа клиентских отзывов до создания продвинутых чат-ботов – NLP проникает во все сферы нашей жизни. Мы увидим, как Python, с его мощными библиотеками, стал де-факто стандартом для разработки решений в этой области, открывая двери для инноваций даже тем, кто только начинает свой путь. Мы не просто расскажем о концепциях, но и покажем, как эти идеи воплощаются в реальность с помощью конкретных инструментов и подходов, опробованных нами на практике.

Начало Пути: Фундаментальные Концепции NLP и Первые Шаги с Python

Прежде чем мы начнем строить сложные системы, нам необходимо заложить прочный фундамент. Любая работа с текстом начинается с его подготовки. Представьте, что у нас есть огромная гора сырых данных — статей, сообщений в чатах, отзывов. Прежде чем извлекать из них смысл, нам нужно их "очистить" и "структурировать". Именно здесь в игру вступают базовые концепции NLP. Эти шаги, хоть и кажутся простыми, являются краеугольным камнем для любой последующей обработки и анализа, определяя успех всего проекта.

Токенизация, Стемминг и Лемматизация: Разбираем Текст на Части

Первый шаг в обработке текста — это токенизация. Это процесс разделения текста на более мелкие единицы, называемые токенами. Токенами могут быть слова, символы, символы пунктуации или даже подслова. Представьте предложение "Мы любим NLP!", после токенизации оно может превратиться в список: ["Мы", "любим", "NLP", "!"]. Кажется просто, но это критически важный этап, который влияет на все последующие шаги анализа. От качества токенизации зависит, насколько точно мы сможем интерпретировать смысл текста и применять к нему дальнейшие алгоритмы.

После токенизации часто возникает задача привести слова к их базовой форме. Здесь мы сталкиваемся со стеммингом и лемматизацией. Стемминг, это грубый процесс отсечения окончаний слов, чтобы привести их к общей "основе" или "стемме". Например, слова "бегущий", "бежал", "бегать" могут быть приведены к "бег". Это быстро, но не всегда корректно, так как "бег" не является настоящим словом. Лемматизация, в свою очередь, более интеллектуальный процесс. Она использует морфологический анализ словаря, чтобы привести слово к его словарной (канонической) форме — лемме. Так, "бегущий", "бежал", "бегать" будут приведены к "бежать". Лемматизация более точна, но и более ресурсоемка, и мы выбираем ее, когда требуется высокая семантическая точность.

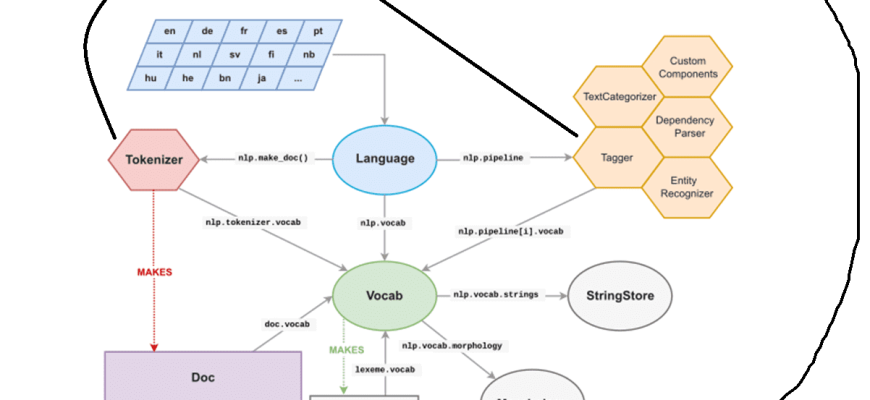

Для этих задач мы часто обращаемся к таким библиотекам, как NLTK (Natural Language Toolkit) и spaCy. NLTK — это старый добрый друг, который предлагает обширный набор алгоритмов и корпусов для исследований. Он идеально подходит для образовательных целей и экспериментов. spaCy, с другой стороны, более современный и производительный инструмент, оптимизированный для промышленного использования, особенно для английского языка, но также с хорошей поддержкой других языков, включая русский через дополнительные модели. Мы часто комбинируем их, используя NLTK для прототипирования и spaCy для продакшн-решений.

| Концепция | Описание | Примеры |

|---|---|---|

| Токенизация | Разделение текста на отдельные единицы (токены) | "Мы работаем." → ["Мы", "работаем", "."] |

| Стемминг | Отсечение окончаний для получения основы слова (стеммы) | "бегущий", "бежать" → "бег" |

| Лемматизация | Приведение слова к словарной форме (лемме) | "бегущий", "бежал" → "бежать" |

Регулярные Выражения и Очистка Текста: Делаем Данные Пригодными для Анализа

Сырые текстовые данные редко бывают идеальными. Они могут содержать HTML-теги, специальные символы, URL-адреса, числа, которые нам не нужны для анализа, или даже просто лишние пробелы. Здесь на помощь приходят регулярные выражения (модуль `re` в Python). Это мощный инструмент для поиска и манипуляции строками на основе шаблонов. С их помощью мы можем легко удалить все лишнее, оставив только чистый текст, готовый к дальнейшей обработке. Например, одно регулярное выражение может очистить текст от всех HTML-тегов, а другое — от ссылок на веб-сайты.

Помимо удаления шума, важным этапом является работа со стоп-словами — это часто встречающиеся, но малоинформативные слова (например, "и", "в", "на", "он"). Их удаление помогает сократить размер данных, уменьшить вычислительную нагрузку и улучшить качество анализа, так как мы фокусируемся на более значимых словах. Мы также можем нормализовать пунктуацию, привести весь текст к нижнему регистру для единообразия, а в более продвинутых сценариях даже работать с эмодзи и сленгом, который встречается в современных текстах, особенно в социальных сетях. Все эти шаги составляют важную часть предобработки текста, и мы всегда начинаем с них, чтобы обеспечить наилучшие результаты.

Представляем Слова и Документы: От Текста к Числам

Компьютеры не "понимают" слова так, как мы. Для них это просто последовательности символов. Чтобы машины могли работать с текстом, нам нужно преобразовать его в числовой формат. Этот процесс называется векторизацией или созданием эмбеддингов. Это критически важный этап, поскольку качество числового представления текста напрямую влияет на производительность наших NLP-моделей. Мы исследуем различные методы, от классических до самых современных, чтобы найти оптимальный баланс между простотой и точностью для каждой конкретной задачи.

Простые Модели: CountVectorizer и TF-IDF

Одними из самых простых, но эффективных способов векторизации являются CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn. CountVectorizer просто подсчитывает частоту вхождения каждого слова в документе. В результате мы получаем вектор, где каждая позиция соответствует слову из нашего словаря, а значение — его количеству в тексте. Это метод "мешка слов" (Bag-of-Words), который игнорирует порядок слов, но хорошо работает для многих задач классификации.

Однако простая частотность не всегда идеальна. Слова типа "и", "в" будут иметь высокую частоту, но мало информативны. Здесь на помощь приходит TF-IDF (Term Frequency-Inverse Document Frequency). Этот метод учитывает не только частоту слова в текущем документе (TF), но и его редкость во всем корпусе документов (IDF). Таким образом, слова, которые часто встречаются в одном документе, но редко в других, получают более высокий вес, становясь более значимыми для классификации или поиска. Мы активно используем TF-IDF для задач, где важна уникальность слова в контексте конкретного документа или группы документов, а также для создания базовых моделей для сравнения с более сложными подходами.

Глубокое Понимание: Word Embeddings (Word2Vec, GloVe, FastText)

Более современные и мощные методы векторизации называются Word Embeddings (векторные представления слов). Вместо того чтобы просто считать слова, эти модели учатся представлять слова в виде плотных векторов чисел (например, 300-мерных), где слова со схожим значением или контекстом располагаются близко друг к другу в векторном пространстве. Это позволяет моделям улавливать семантические отношения между словами, такие как синонимия или даже аналогии (например, "король" ─ "мужчина" + "женщина" = "королева").

Среди наиболее известных моделей — Word2Vec и GloVe. Word2Vec, разработанный Google, имеет два основных подхода: Skip-gram и CBOW. Skip-gram предсказывает контекстные слова по целевому слову, а CBOW (Continuous Bag of Words) предсказывает целевое слово по контекстным. Мы часто используем библиотеку Gensim для работы с Word2Vec, так как она предлагает эффективные реализации и позволяет обучать модели на больших корпусах данных, что критически важно для получения качественных эмбеддингов.

GloVe (Global Vectors for Word Representation), это еще одна популярная модель, которая сочетает в себе глобальную матрицу частотности слов и локальные контекстные окна. Для работы с редкими словами и морфологически богатыми языками мы также обращаем внимание на FastText, который представляет слова как набор символьных n-грамм, что позволяет ему создавать векторы даже для слов, не встречавшихся в обучающем корпусе. Это особенно ценно для языков, где слова имеют много словоформ, или для анализа текста с опечатками.

- Word2Vec: Обучается на локальном контексте слов, предсказывая слова по контексту или контекст по слову.

- GloVe: Использует глобальную статистику со-встречаемости слов, создавая векторы на основе частоты совместного появления слов.

- FastText: Учитывает подсловные единицы (n-граммы символов), что делает его устойчивым к редким словам и морфологическим вариациям.

Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

Когда нам нужно получить векторное представление не просто слова, а целого предложения или документа, мы обращаемся к таким методам, как Doc2Vec (расширение Word2Vec) или более современным Sentence Transformers. Doc2Vec позволяет представлять целые документы в виде векторов фиксированной длины, что очень полезно для поиска схожих документов, кластеризации или классификации. Мы используем его, когда нужно сравнивать документы целиком, а не просто отдельные слова.

Sentence Transformers, основанные на архитектуре трансформеров, стали особенно популярны благодаря своей способности генерировать очень качественные эмбеддинги для предложений, сохраняя их семантический смысл даже в сложных контекстах. Они обучаются таким образом, чтобы предложения со схожим значением имели близкие векторные представления. Мы используем их для задач, где требуется высокая точность в сравнении текстов, например, при поиске плагиата, разработке систем рекомендаций или в вопросно-ответных системах, где нужно найти наиболее релевантный ответ в базе знаний. Эти инструменты позволяют нам перейти от работы со словами к работе со смыслом целых фрагментов текста.

Основные Задачи NLP: От Классификации до Тематического Моделирования

После того как текст преобразован в числовой формат, мы можем применять мощные алгоритмы машинного обучения для решения самых разных задач. Это сердце NLP, где мы начинаем извлекать реальную ценность из языковых данных. Здесь мы переходим от теоретических концепций к практическим применениям, которые решают реальные бизнес-задачи и улучшают взаимодействие человека с компьютером; Мы рассмотрим наиболее востребованные задачи и библиотеки, которые позволяют нам их эффективно решать.

Классификация Текстов: Автоматическая Категоризация и Фильтрация

Одна из самых распространенных и прикладных задач — классификация текстов. Это может быть определение спама, категоризация новостей по темам (спорт, политика, экономика), или анализ тональности отзывов. Для этих целей мы активно используем Scikit-learn, предлагающий широкий спектр классификаторов: от логистической регрессии и опорных векторов (SVM) до наивного байесовского классификатора. Выбор модели часто зависит от размера данных, их характеристик и сложности задачи. Например, SVM часто показывает хорошие результаты на среднеразмерных наборах данных, а наивный байес удивительно эффективен для спам-фильтров.

Для больших и комплексных наборов данных, особенно когда нужно уловить более тонкие зависимости, мы можем перейти к нейронным сетям, используя PyTorch или TensorFlow. В частности, рекуррентные нейронные сети, такие как LSTM-сети (Long Short-Term Memory), хорошо работают с последовательными данными, такими как текст, позволяя модели "запоминать" информацию из предыдущих слов; В последнее время, конечно, трансформерные модели, такие как BERT, стали стандартом для классификации текста, значительно улучшая качество по сравнению с классическими подходами, особенно при наличии достаточного объема данных для тонкой настройки.

Распознавание Именованных Сущностей (NER): Извлекаем Ключевую Информацию

NER (Named Entity Recognition) — это задача идентификации и классификации именованных сущностей в тексте, таких как имена людей, организаций, географических объектов, дат, денежных сумм и т.п. Это критически важно для извлечения структурированной информации из неструктурированного текста. Например, из новостной статьи мы можем автоматически извлечь, кто (лицо), что (событие), где (локация) и когда (дата) произошло. Это позволяет нам создавать базы знаний, автоматизировать заполнение форм или проводить более глубокий анализ событий.

Для NER мы часто используем spaCy, который имеет отличные предварительно обученные модели для различных языков, обеспечивающие высокую скорость и точность. Для более сложных или специфических задач, где требуется высокая точность и возможность адаптации под уникальные сущности, мы можем применять условные случайные поля (CRF), которые исторически были одним из самых мощных методов для последовательной разметки, или современные библиотеки, такие как Flair, которые используют глубокие контекстуальные эмбеддинги для достижения впечатляющих результатов. Также, BERT и другие трансформерные модели показали выдающиеся результаты в NER, позволяя нам тонко настраивать их под наши нужды, достигая state-of-the-art качества даже на специфических доменах, таких как юридические или медицинские тексты.

Анализ Тональности (Sentiment Analysis): Понимаем Эмоции

Анализ тональности позволяет определить эмоциональную окраску текста — является ли он позитивным, негативным или нейтральным. Это бесценный инструмент для анализа отзывов клиентов, комментариев в социальных сетях, финансовых новостей, позволяющий компаниям быстро реагировать на настроения рынка или потребителей. Мы используем различные подходы, в зависимости от контекста и требуемой глубины анализа:

- VADER (Valence Aware Dictionary and sEntiment Reasoner): Отличный инструмент для анализа тональности, особенно хорошо работает с текстами из социальных сетей, поскольку он специально разработан для понимания сленга, акронимов и эмодзи. Он основан на правилах и словарях, что делает его быстрым и интерпретируемым.

- TextBlob: Простая в использовании библиотека для быстрого анализа тональности и других базовых NLP-задач. Она подходит для быстрого прототипирования, но для более глубокого анализа мы часто прибегаем к более мощным моделям, так как ее точность может быть ограничена.

- Модели машинного обучения: Мы обучаем собственные классификаторы на размеченных данных, используя TF-IDF или Word Embeddings в сочетании с алгоритмами Scikit-learn (SVM, логистическая регрессия) или нейронными сетями. Это позволяет нам адаптировать модель под специфику предметной области и повысить точность.

Важно помнить, что анализ тональности в социальных сетях требует особого внимания к сарказму, иронии и другим нюансам человеческой речи, что делает его одной из самых сложных, но увлекательных задач. Мы постоянно ищем способы улучшить распознавание этих сложных языковых конструкций, чтобы наши модели были максимально точными.

"Язык – это карта того, как мы думаем. Он формирует нашу реальность, а не просто описывает ее."

— Эдвард Сепир

Тематическое Моделирование: Выявляем Скрытые Темы

Когда у нас есть большой объем текстовых данных, бывает сложно понять, о чем идет речь в целом. Тематическое моделирование — это мощный инструмент, который позволяет автоматически обнаруживать скрытые "темы" в коллекции документов. Представьте, что у нас есть тысячи новостных статей или клиентских отзывов; тематическое моделирование поможет нам выявить, какие из них посвящены политике, какие, спорту, а какие — экономике, даже без предварительной разметки. Это особенно ценно для анализа неструктурированных данных, где ручная категоризация невозможна.

Наиболее популярный алгоритм — LDA (Latent Dirichlet Allocation), реализованный в библиотеке Gensim. LDA предполагает, что каждый документ состоит из смеси нескольких тем, а каждая тема характеризуется распределением слов. Мы активно используем Gensim для извлечения тем из больших массивов текста, например, из отзывов клиентов, научных статей или постов в блогах, чтобы понять основные интересы и болевые точки. Сравнение моделей, таких как LDA и NMF (Non-negative Matrix Factorization), часто помогает нам выбрать наиболее подходящий подход для конкретной задачи, исходя из характеристик данных и требуемой интерпретируемости результатов. NMF, например, часто дает более интерпретируемые темы, но может быть менее эффективным на сильно разреженных данных.

Извлечение Ключевых Фраз и Суммаризация: Сокращаем и Выделяем Главное

В мире, где информации становится все больше, способность быстро извлекать ключевые идеи или создавать краткие пересказы документов становится критически важной. Это экономит время и позволяет быстро ориентироваться в больших объемах данных. Мы используем несколько подходов для этого:

- Извлечение ключевых фраз: С помощью алгоритмов, таких как RAKE (Rapid Automatic Keyword Extraction) или TextRank (реализованный в библиотеке TextRank), мы можем автоматически идентифицировать наиболее важные слова и фразы в тексте. RAKE обычно быстрее и основан на статистике слов, а TextRank использует графовые алгоритмы для определения важности предложений и ключевых фраз. Это полезно для создания тегов, индексации, быстрого обзора содержания или для улучшения поиска.

- Суммаризация текста: Здесь мы различаем два основных подхода:

- Экстрактивная суммаризация: Идентифицирует и извлекает наиболее важные предложения из исходного текста, чтобы сформировать краткий пересказ. TextRank часто используется для этого, выбирая предложения с высоким "весом" в графе. Этот метод сохраняет оригинальную формулировку, что иногда критически важно.

- Абстрактивная суммаризация: Генерирует новые предложения, которые передают суть исходного текста, но не обязательно присутствуют в нем дословно. Это более сложная задача, требующая использования продвинутых нейронных сетей, таких как трансформеры, способных "понимать" и переформулировать информацию.

Мы часто применяем эти методы для анализа больших массивов статей, генерации аннотаций, создания кратких отчетов или даже для создания ответов в системах поддержки пользователей, где краткость и информативность играют ключевую роль.

Продвинутые Темы и Современные Подходы в NLP

Мир NLP не стоит на месте, и последние годы принесли с собой революционные изменения, особенно с появлением глубокого обучения и архитектуры трансформеров. Эти технологии позволили нам перейти от статистических методов к моделям, которые способны улавливать гораздо более сложные нюансы языка, открывая двери для решения задач, которые раньше казались неразрешимыми. Мы постоянно следим за новейшими исследованиями и внедряем передовые подходы в наши проекты.

Трансформеры и Hugging Face: Новый Уровень Понимания Языка

Появление трансформеров полностью изменило ландшафт NLP. Модели, такие как BERT, GPT, T5, способны улавливать сложнейшие контекстные зависимости в тексте, что делает их незаменимыми для широкого круга задач — от классификации и NER до машинного перевода и генерации текста. Эти модели обучаются на огромных массивах текста, "запоминая" грамматику, синтаксис и семантику языка, а затем могут быть тонко настроены (fine-tuning) под конкретную задачу с относительно небольшим объемом данных.

Мы активно используем библиотеку Hugging Face Transformers, которая предоставляет простой и унифицированный интерфейс для работы с сотнями предварительно обученных моделей. Это позволяет нам быстро прототипировать и развертывать мощные NLP-решения, часто с помощью тонкой настройки уже существующих моделей под наши конкретные данные и задачи. Благодаря этой библиотеке, сложные архитектуры становятся доступными даже для разработчиков с ограниченным опытом в глубоком обучении.

Трансформеры используются для множества задач, включая:

- Генерация текста: От написания статей и постов в блогах до создания диалогов для чат-ботов и даже генерации кода.

- Машинный перевод: Достижение практически человеческого уровня качества, особенно в парах языков, для которых есть много обучающих данных.

- Вопросно-ответные системы (QA): Поиск точных ответов на вопросы в больших текстовых корпусах, что критически важно для систем поддержки клиентов или интеллектуального поиска.

- Распознавание эмоций и анализ тональности: Улавливание тонких нюансов эмоциональной окраски, включая сарказм и иронию, что значительно улучшает качество анализа.

- Анализ кода: Даже для задач, не связанных напрямую с естественным языком, например, для суммаризации кода, генерации комментариев или его анализа на уязвимости.

Они открывают совершенно новые горизонты для того, что мы можем делать с текстом, и являются движущей силой многих инноваций в области искусственного интеллекта.

Работа с Разнообразными Текстовыми Данными и Языками

Наш опыт показывает, что реальный мир редко ограничивается чистым английским текстом. Мы постоянно сталкиваемся с необходимостью обрабатывать тексты на разных языках, извлекать информацию из различных форматов и учитывать особенности конкретных доменов. Это требует гибкости и использования специализированных инструментов:

- Многоязычные текстовые корпусы: Библиотеки вроде Polyglot и Stanza (особенно полезная для языков с богатой морфологией, таких как русский) позволяют нам работать с текстами на разных языках, выполняя токенизацию, лемматизацию, POS-теггинг (разметку частей речи) и NER. Stanza, разработанная Stanford NLP Group, предлагает высококачественные модели для многих языков, обеспечивая унифицированный пайплайн обработки.

- Неструктурированный текст: Это могут быть логи-файлы, медицинские записи, юридические документы, где требуется особое внимание к структуре и терминологии. Мы используем Python для извлечения ключевых фактов, дат, чисел и специфических сущностей из таких документов, часто разрабатывая кастомные регулярные выражения и правила.

- Текст из PDF: С помощью библиотек вроде PyMuPDF (или `pdfminer.six`) мы можем эффективно извлекать текст из PDF-документов, что является частой задачей при работе с отчетами, научными статьями или сканированными документами. Иногда требуется дополнительная постобработка для корректного восстановления структуры текста.

- Сообщения в социальных сетях: Twitter, Reddit, Telegram — здесь свои особенности: сленг, эмодзи, сокращения, хештеги. Мы разрабатываем инструменты для нормализации сленга, обработки эмодзи и учета этих особенностей при анализе тональности, поведенческих паттернов или извлечении тем.

Использование таких инструментов, как Beautiful Soup, для веб-скрейпинга позволяет нам собирать огромные объемы текстовых данных из интернета для последующего анализа, предоставляя сырье для наших NLP-проектов.

Разработка Сложных Систем: От Чат-ботов до Проверки Фактов

Накопленные знания и инструменты позволяют нам создавать по-настоящему сложные и интеллектуальные системы, которые автоматизируют рутинные задачи и предоставляют новые возможности для взаимодействия с информацией:

- Чат-боты: Мы разрабатываем чат-боты, используя фреймворки, такие как Rasa, которые позволяют создавать диалоговые системы, способные понимать намерения пользователя, извлекать сущности из запросов и вести осмысленный диалог. Это выходит за рамки простых скриптов, позволяя ботам "понимать" естественный язык.

- Системы вопросно-ответных систем (QA): С помощью трансформеров мы можем строить системы, которые отвечают на вопросы по заданному тексту или коллекции документов, будь то поиск информации в корпоративной базе знаний или извлечение фактов из новостей.

- Системы обнаружения плагиата: Сравнение документов с использованием векторизации (TF-IDF, Doc2Vec, Sentence Transformers) и метрик сходства (например, из библиотеки Textdistance) позволяет нам выявлять дубликаты и плагиат, что критически важно в образовании и издательской деятельности.

- Инструменты проверки грамматики и орфографии: Хотя и существуют готовые решения, иногда требуется разработать специализированные инструменты, учитывающие особенности предметной области или языка, а также для работы с неполными и ошибочными данными.

- Системы автоматической разметки данных: Для обучения моделей часто нужна размеченная обучающая выборка, и мы создаем инструменты, которые автоматизируют этот процесс, экономя время и ресурсы, используя активное обучение или предобученные модели.

- Анализ стилистики текстов: Это позволяет определить авторский почерк, что полезно для атрибуции текстов, анализа уникальности стиля или даже для обнаружения подделок.

Практические Аспекты и Лучшие Практики

Работа с NLP — это не только алгоритмы и модели, но и множество практических нюансов, которые мы выявили на собственном опыте. Успех проекта часто зависит не только от выбора самой продвинутой модели, но и от того, насколько хорошо мы справились с подготовительными этапами и учли реальные ограничения. Здесь мы поделимся теми аспектами, которые часто недооцениваются, но являются ключевыми для достижения стабильных и надежных результатов.

Очистка и Подготовка Данных: Ключ к Успеху

Мы не устаем повторять: "Мусор на входе — мусор на выходе". Качество исходных данных напрямую влияет на качество конечного результата. Поэтому мы уделяем огромное внимание очистке данных. Это включает в себя не просто удаление очевидного шума, но и более тонкую нормализацию:

- Удаление HTML-тегов, URL-адресов, нежелательных символов и артефактов веб-страниц.

- Обработка пропущенных или ошибочных данных, которые могут привести к смещению модели.

- Нормализация текста (приведение к нижнему регистру, унификация пунктуации, удаление лишних пробелов).

- Работа с особенностями языка: нормализация сленга, обработка сокращений, корректное распознавание и учет эмодзи.

Для этих задач мы часто используем комбинацию регулярных выражений и специализированных библиотек. Например, Textacy — отличный инструмент для более продвинутой предобработки и извлечения информации, позволяющий создавать гибкие пайплайны обработки текста.

Оценка Качества Моделей: Как Понять, что Работает Хорошо

Чтобы быть уверенными в эффективности наших NLP-решений, мы всегда проводим тщательную оценку качества моделей. Это не просто запуск одной метрики, а комплексный анализ поведения модели. Для задач классификации мы используем такие метрики, как Precision, Recall и F1-score, а также строим матрицы ошибок для более детального понимания того, где модель ошибается. Для NER или других задач, где важна точность локализации, эти метрики также адаптируются.

Сравнение различных методов векторизации (TF-IDF vs Word2Vec), алгоритмов кластеризации (K-Means vs DBSCAN) или моделей тематического моделирования (LDA vs NMF) — это рутинная часть нашей работы, которая позволяет нам выбрать наилучший подход для конкретной задачи. Мы также обращаем внимание на интерпретируемость моделей, чтобы не только знать, что модель работает, но и понимать, почему она принимает те или иные решения, особенно в критически важных областях, таких как медицина или юриспруденция;

Масштабирование и Производительность: Big Data NLP

Когда речь заходит об обработке больших текстовых массивов (Big Data NLP), производительность становится критически важной. Миллионы документов или сообщений в социальных сетях требуют эффективных подходов и оптимизированных инструментов. Мы используем следующие стратегии:

- Оптимизация кода на Python: Использование векторизованных операций, генераторов, эффективных структур данных и профилирование кода для выявления узких мест.

- GPU-ускорение: Для обучения глубоких нейронных сетей (особенно трансформеров) использование GPU через PyTorch или TensorFlow значительно сокращает время обучения с дней до часов или даже минут.

- Распределенные вычисления: Для очень больших корпусов данных мы можем использовать распределенные фреймворки, такие как Dask или Apache Spark, хотя для большинства задач Python-библиотеки достаточно оптимизированы и могут эффективно работать на одном мощном сервере.

- Обработка текста в режиме реального времени (Streaming NLP): Для таких задач, как анализ сообщений в социальных сетях, мы разрабатываем системы, способные обрабатывать потоки данных, используя эффективные архитектуры и алгоритмы, которые могут инкрементально обновлять модели или анализировать данные на лету.

Визуализация и Исследование Текстовых Данных

Понимание текстовых данных — это не только числа, но и визуализация. Визуальные представления помогают нам быстро выявлять паттерны, аномалии и тренды, которые было бы сложно обнаружить, просто просматривая таблицы или метрики. Мы активно используем инструменты для наглядного представления результатов нашего анализа, делая данные более доступными и интуитивно понятными.

Word Clouds и Heatmaps: Красота и Смысл

Одним из самых простых, но эффективных способов визуализации является Word Cloud (облако слов). Это позволяет нам быстро увидеть наиболее часто встречающиеся слова в корпусе текста, причем размер слова пропорционален его частоте. Это отличный инструмент для первоначального исследования данных, выявления ключевых терминов и презентации результатов неспециалистам. Мы часто используем его в начале проекта, чтобы быстро получить общее представление о содержании текстового корпуса.

Для более глубокого анализа мы используем тепловые карты (Heatmaps), например, для визуализации матриц сходства между документами или темами. Это помогает нам выявлять скрытые паттерны и взаимосвязи, которые сложно обнаружить, просто просматривая числа. Например, тепловая карта может показать, насколько сильно связаны между собой различные темы или как изменяется тональность текста с течением времени. Инструменты, такие как Sweetviz, также могут быть полезны для автоматического анализа и визуализации текстовых данных, предоставляя быстрый обзор их характеристик, включая распределение слов и пропущенные значения.

Наше путешествие по миру обработки естественного языка с Python подошло к концу, но это лишь вершина айсберга. Мы начали с основ токенизации и лемматизации, перешли к векторизации слов и документов, освоили ключевые задачи, такие как классификация, NER и тематическое моделирование, и заглянули в будущее с трансформерами и глубоким обучением. Мы увидели, как Python, с его богатой экосистемой библиотек, таких как NLTK, spaCy, Gensim, Scikit-learn, PyTorch, TensorFlow и Hugging Face, предоставляет нам все необходимые инструменты для решения самых амбициозных задач, от обработки малых текстовых корпусов до анализа больших данных в реальном времени.

NLP, это динамично развивающаяся область, где каждый день появляются новые исследования и прорывы. Способность машин понимать и взаимодействовать с человеческим языком открывает невероятные возможности для автоматизации, анализа и создания интеллектуальных систем. Мы надеемся, что наш опыт и знания вдохновили вас на собственные исследования и эксперименты. Помните, что каждый проект начинается с любопытства и желания разгадать тайны слов. Удачи в ваших NLP-приключениях, и пусть ваш код будет чист, а ваши модели — точны! Мы верим, что с правильными инструментами и подходом вы сможете раскрыть потенциал языка и создать по-настоящему инновационные решения.

точка..

Подробнее

| Основы NLTK Python | Распознавание сущностей spaCy | Тематическое моделирование LDA | Векторные представления слов | Анализ тональности VADER |

| Трансформеры Hugging Face | Классификация текста Python | Извлечение ключевых фраз | Doc2Vec для документов | Обработка русского языка |