Магия Слова в Коде: Как Мы Освоили NLP с Python для Понимания Мира Текста

Приветствуем‚ дорогие читатели и коллеги-энтузиасты! Сегодня мы хотим поделиться с вами нашим захватывающим опытом погружения в мир Обработки Естественного Языка‚ или NLP (Natural Language Processing)‚ и рассказать‚ как Python стал нашим верным проводником в этом удивительном путешествии. За последние годы мы прошли путь от новичков‚ смутно представляющих‚ как машина может "понять" человеческую речь‚ до уверенных разработчиков‚ способных создавать сложные системы для анализа и генерации текста. Это было не просто изучение библиотек и алгоритмов; это было постоянное открытие того‚ насколько богат и многогранен мир языка‚ и как технологии помогают нам расшифровывать его тайны.

Представьте себе: ежедневно миллиарды слов пишутся‚ произносятся и обмениваются по всему миру. От твитов и отзывов до научных статей и юридических документов – вся эта масса информации содержит в себе бесценные знания‚ мнения и тенденции. Но как извлечь этот смысл‚ когда текст не структурирован‚ полон нюансов‚ сарказма‚ сленга и даже ошибок? Именно здесь на сцену выходит NLP. В этой статье мы подробно расскажем о наших любимых инструментах и подходах‚ поделимся практическими советами и покажем‚ как мы применяли их для решения реальных задач. Мы верим‚ что наш опыт вдохновит вас и поможет вам найти свой путь в этом увлекательном направлении.

Первые Шаги: Строим Фундамент Понимания Текста

Наше знакомство с NLP началось‚ как и у многих‚ с основ. Мы быстро поняли‚ что прежде чем машина сможет "прочитать" текст‚ его нужно подготовить. Это похоже на то‚ как мы учимся читать: сначала буквы‚ потом слова‚ предложения‚ и только потом смысл. В мире NLP этот процесс называеться предобработкой‚ и он является краеугольным камнем любых дальнейших аналитических задач. Без качественной предобработки все наши усилия по построению сложных моделей могут оказаться напрасными.

NLTK и spaCy: Наши Первые Проводники

В самом начале пути мы активно использовали две фундаментальные библиотеки Python: NLTK (Natural Language Toolkit) и spaCy. NLTK стал для нас настоящей энциклопедией‚ предлагающей множество алгоритмов и корпусов для изучения. Мы учились токенизации‚ разбивая текст на отдельные слова или предложения‚ и стеммингу‚ пытаясь свести слова к их корневой форме. NLTK замечательно подходит для образовательных целей и экспериментов‚ когда нужно глубоко понять‚ как работают те или иные алгоритмы.

Однако вскоре мы осознали‚ что для более производительных и готовых к продакшену решений нам нужна скорость и эффективность. Тут на помощь пришла spaCy. Эта библиотека поразила нас своей скоростью и интуитивно понятным API‚ особенно когда речь зашла о более продвинутых задачах‚ таких как распознавание именованных сущностей (NER) и синтаксический парсинг. Мы обнаружили‚ что spaCy предоставляет уже обученные модели для различных языков‚ что значительно упрощает старт проектов. Например‚ для русского языка spaCy предлагает отличные модели‚ которые мы активно используем.

Практический совет: Для быстрого прототипирования и глубокого изучения алгоритмов начинайте с NLTK. Когда нужна производительность и готовые к использованию модели‚ переходите на spaCy; Обе библиотеки прекрасно дополняют друг друга.

Токенизация‚ Стемминг и Лемматизация: Разбираем Слова на Части

Как мы уже упомянули‚ первым шагом является токенизация – процесс разделения текста на "токены"‚ которые обычно являются словами‚ знаками препинания или даже предложениями. Это критически важно‚ потому что машина не понимает текст как единое целое; ей нужны дискретные единицы для анализа. Мы экспериментировали с различными токенизаторами из NLTK и spaCy‚ выбирая оптимальный в зависимости от задачи.

После токенизации мы часто сталкиваемся с проблемой разных форм одного и того же слова ("бежал"‚ "бегу"‚ "бежать"). Чтобы машина воспринимала их как одно и то же понятие‚ используются стемминг и лемматизация. Стемминг (например‚ с помощью Porter Stemmer из NLTK) обрезает окончания слов‚ приводя их к общему "корню"‚ который не всегда является реальным словом. Лемматизация (доступная в spaCy и NLTK) более продвинута: она приводит слово к его базовой словарной форме (лемме)‚ учитывая морфологию языка. Мы быстро поняли‚ что лемматизация чаще всего дает лучшие результаты для русского языка из-за его богатой морфологии.

Вот краткое сравнение‚ которое мы часто используем для объяснения:

| Метод | Описание | Пример (рус.) | Преимущества | Недостатки |

|---|---|---|---|---|

| Токенизация | Разбиение текста на отдельные единицы (токены). | "Мы читали книги." -> ["Мы"‚ "читали"‚ "книги"‚ "."] | Основа для всех последующих шагов. | Не обрабатывает морфологию. |

| Стемминг | Приведение слова к его "корню" путём отсечения окончаний. | "читали" -> "чита"‚ "книги" -> "книг" | Прост в реализации‚ быстр. | Результат не всегда является реальным словом; не учитывает контекст. |

| Лемматизация | Приведение слова к его базовой словарной форме (лемме). | "читали" -> "читать"‚ "книги" -> "книга" | Результат – всегда реальное слово; учитывает морфологию. | Более ресурсоемкий; требует наличия словарей. |

Регулярные Выражения и Очистка Данных: Наш Щит от "Шума"

Работа с реальными текстовыми данными почти всегда означает столкновение с "шумом": HTML-тегами‚ специальными символами‚ URL-адресами‚ лишними пробелами‚ эмодзи и сленгом. Мы быстро освоили мощь регулярных выражений (библиотека re в Python) для эффективной очистки текста. Это наш незаменимый инструмент для удаления всего‚ что не несет смысловой нагрузки для конкретной задачи.

Мы часто используем регулярные выражения для:

- Удаления HTML-тегов из веб-страниц (часто с помощью Beautiful Soup для парсинга‚ а

reдля окончательной чистки). - Извлечения или удаления URL-адресов‚ email-адресов.

- Нормализации пунктуации‚ приведения к нижнему регистру.

- Работы с эмодзи и сленгом‚ которые требуют особого подхода – иногда их нужно удалять‚ иногда сохранять и интерпретировать.

Этот этап может показаться рутинным‚ но мы научились ценить его важность. Чистые данные – залог успешного анализа. Иногда мы даже разрабатываем собственные инструменты для проверки грамматики и исправления орфографии‚ чтобы максимально улучшить качество входных данных‚ особенно когда имеем дело с пользовательскими отзывами или сообщениями в социальных сетях‚ где ошибки – обычное дело.

Извлечение Смысла: Как Мы Заставляем Машину Понимать

После того как текст очищен и подготовлен‚ наступает самая интересная часть – извлечение из него смысла. Это похоже на разгадывание головоломки‚ где каждый кусочек информации приближает нас к полному пониманию. Здесь мы применяем более сложные техники‚ которые позволяют нам не просто обрабатывать слова‚ но и понимать их контекст‚ отношения между ними и общую тему документа.

Распознавание Именованных Сущностей (NER): Находим "Кто"‚ "Что"‚ "Где"

Одной из наших первых по-настоящему захватывающих задач стало распознавание именованных сущностей (NER). Представьте‚ что у вас есть огромный объем текстов‚ и вам нужно быстро найти все упоминания людей‚ организаций‚ мест‚ дат или продуктов. Это как иметь очень умного помощника‚ который моментально выделяет ключевые факты; Мы активно используем для этого spaCy‚ который с его предобученными моделями обеспечивает высокую скорость и точность.

Помимо spaCy‚ мы также экспериментировали с другими библиотеками‚ такими как Flair‚ которая предлагает современные подходы на основе нейронных сетей и часто показывает отличные результаты‚ особенно для языков с богатой морфологией. Иногда‚ для специфических задач‚ мы даже применяем Conditional Random Fields (CRF)‚ когда требуется тонкая настройка и разметка данных для узкоспециализированных сущностей. Это позволяет нам находить‚ например‚ названия лекарств в медицинских записях или конкретные статьи законов в юридических документах.

Кейс из практики: Мы использовали NER для анализа новостных статей‚ чтобы автоматически извлекать имена политиков‚ названия компаний и географические объекты. Это значительно ускорило процесс мониторинга и категоризации новостей.

Векторизация Текста: Превращаем Слова в Числа

Для того чтобы компьютеры могли работать с текстом‚ его нужно преобразовать в числовой формат. Это называется векторизацией. Мы начинали с простых методов‚ таких как CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn. CountVectorizer просто подсчитывает частоту слов‚ а TfidfVectorizer учитывает не только частоту слова в документе‚ но и его редкость во всем корпусе текстов‚ что помогает выделить более значимые слова.

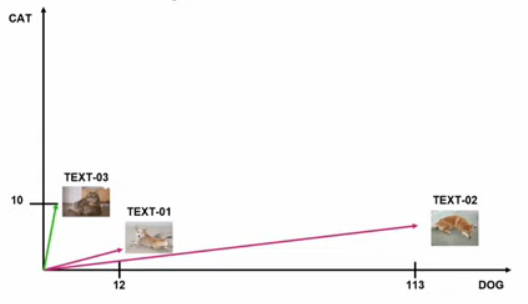

Однако эти методы имеют свои ограничения – они не учитывают семантику слов. Слово "кошка" и "кот" будут рассматриваться как совершенно разные сущности‚ хотя они очень близки по смыслу. Именно здесь на сцену вышли Word Embeddings (Векторные представления слов). Мы были поражены‚ когда впервые увидели‚ как Word2Vec и GloVe (используемые с Gensim) могут представлять слова в виде многомерных векторов таким образом‚ что семантически близкие слова оказываются близко друг к другу в векторном пространстве. Это открыло для нас совершенно новые возможности!

Позднее мы углубились в более продвинутые методы‚ такие как FastText‚ который хорошо справляется с редкими словами и даже морфологически сложными языками‚ поскольку учитывает подслова. А для представления целых документов или предложений мы освоили Doc2Vec и Sentence Transformers‚ что стало незаменимым при поиске похожих документов или кластеризации текстов.

"Язык – это лабиринт путей. Вы приходите с одной стороны и знаете‚ где вы находитесь‚ но когда вы входите‚ вы теряетесь."

— Людвиг Витгенштейн

Эта цитата глубоко отражает сложность и многогранность языка‚ с которой мы сталкиваемся в NLP. Наша задача – не потеряться в этом лабиринте‚ а найти в нем структуру и смысл.

Тематическое Моделирование: Открываем Скрытые Темы

Как понять‚ о чем говорят люди в тысячах отзывов‚ не читая каждый из них? Здесь нам на помощь приходит тематическое моделирование. С помощью библиотеки Gensim мы научились применять такие алгоритмы‚ как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing). Эти модели позволяют нам автоматически обнаруживать скрытые "темы" в большом корпусе текстов. Например‚ в отзывах о продукте мы можем выделить темы "качество сборки"‚ "срок службы батареи" или "удобство использования".

Мы часто сравниваем различные модели тематического моделирования‚ такие как LDA и NMF (Non-negative Matrix Factorization)‚ чтобы понять‚ какая из них лучше подходит для конкретного набора данных. Наш опыт показывает‚ что выбор модели сильно зависит от характеристик текста и того‚ насколько четко мы хотим определить темы. Визуализация результатов с помощью Word Clouds или Heatmaps помогает нам наглядно представить найденные темы и их ключевые слова.

Извлечение Ключевых Фраз: Выделяем Суть

Помимо общих тем‚ часто требуется выделить конкретные ключевые фразы или предложения‚ которые наилучшим образом описывают содержание текста. Для этого мы используем такие алгоритмы‚ как RAKE (Rapid Automatic Keyword Extraction) и TextRank. RAKE, это более простой‚ но эффективный метод‚ основанный на статистике слов и их расположении. TextRank‚ в свою очередь‚ использует графовые алгоритмы‚ аналогичные PageRank‚ для выявления наиболее важных слов и предложений в тексте.

Мы применяли TextRank для суммаризации длинных статей‚ извлекая ключевые предложения‚ которые составляют краткий‚ но информативный обзор. Это особенно полезно‚ когда нужно быстро ознакомиться с содержанием большого документа.

Классификация и Анализ Тональности: Определяем Настроение и Категорию

После того как мы научились извлекать сущности‚ векторизовать слова и определять темы‚ следующим логичным шагом стало научить машину классифицировать тексты и понимать их эмоциональную окраску. Это открывает двери для автоматической категоризации контента‚ анализа отзывов клиентов и мониторинга социальных сетей.

Классификация Текстов с Scikit-learn: Сортируем Полочки

Когда речь заходит о классификации текстов‚ Scikit-learn – это наша рабочая лошадка. Мы начинали с относительно простых‚ но очень эффективных алгоритмов‚ таких как Naive Bayes и Support Vector Machines (SVM). После векторизации текста (часто с использованием TF-IDF)‚ эти классификаторы позволяют нам с высокой точностью определять категорию документа – будь то новость о спорте‚ политике или финансах‚ или отзыв о продукте. Мы также использовали их для автоматической категоризации статей и даже для разработки систем обнаружения плагиата путем сравнения документов.

Процесс обычно выглядит так:

- Сбор и предобработка данных: Собираем размеченные тексты‚ очищаем их и приводим к нужной форме.

- Векторизация: Преобразуем тексты в числовые векторы (например‚ с помощью TF-IDF).

- Обучение модели: Используем часть данных для обучения классификатора.

- Оценка качества: Измеряем производительность модели на тестовых данных‚ используя метрики‚ такие как F1-score‚ Precision и Recall.

- Применение: Используем обученную модель для классификации новых‚ неразмеченных текстов.

Мы обнаружили‚ что сравнение различных методов машинного обучения для NLP – это ключ к выбору оптимального решения. Иногда более простые модели‚ такие как Наивный Байес‚ работают удивительно хорошо для определенных задач‚ в то время как SVM или более сложные нейросети требуются для более тонкой классификации.

Анализ Тональности (Sentiment Analysis): Чувствуем Эмоции

Понимание эмоциональной окраски текста – это бесценный навык для бизнеса и аналитики. Мы часто используем анализ тональности (Sentiment Analysis) для оценки отзывов клиентов‚ постов в социальных сетях и финансовых новостей. Наше первое знакомство с этой областью произошло благодаря библиотеке VADER (Valence Aware Dictionary and sEntiment Reasoner)‚ которая отлично справляется с анализом англоязычного текста‚ учитывая даже интенсивность эмоций и наличие восклицательных знаков или смайликов.

Для более простых задач и русскоязычного текста мы иногда используем TextBlob‚ который предлагает интуитивно понятный интерфейс для анализа тональности и определения языка. Однако мы быстро поняли‚ что для серьезного анализа‚ особенно с учетом сарказма‚ сленга и специфики социальных медиа (Twitter‚ Reddit)‚ требуются более продвинутые подходы‚ часто с использованием обученных моделей на основе нейросетей или трансформеров.

Особое внимание: Анализ тональности в социальных сетях – это отдельная большая задача. Мы сталкивались с тем‚ что модели часто не улавливают сарказм или иронию‚ и это требует дополнительных усилий по разметке данных и тонкой настройке моделей. Работа с эмодзи и сленгом также является важной частью этого процесса.

Вершина Технологий: Нейросети и Трансформеры для NLP

Последние годы ознаменовались настоящим прорывом в области NLP благодаря развитию глубокого обучения и‚ в частности‚ архитектур трансформеров. Это изменило наш подход ко многим задачам‚ позволив достигать невиданной ранее точности и создавать системы‚ которые раньше казались научной фантастикой. Мы активно внедряем эти передовые технологии в нашу работу.

PyTorch/TensorFlow и LSTM: Когда Нужен Глубокий Контекст

До эпохи трансформеров‚ когда нам требовалось улавливать долгосрочные зависимости в тексте‚ мы активно использовали рекуррентные нейронные сети (RNN)‚ в частности LSTM (Long Short-Term Memory)‚ с фреймворками PyTorch и TensorFlow. LSTM оказались невероятно эффективными для задач‚ где важен порядок слов и контекст предложения‚ таких как машинный перевод‚ генерация текста или более сложный синтаксический парсинг. Мы разрабатывали собственные нейросети NLP‚ обучая их на больших корпусах данных‚ чтобы решать специфические задачи‚ например‚ анализ поведенческих паттернов в чатах.

Работа с PyTorch и TensorFlow позволила нам глубоко понять архитектуру нейросетей и принципы их обучения‚ что стало бесценным опытом для дальнейшего освоения трансформеров. Мы научились эффективно использовать GPU-ускорение для обработки больших текстовых массивов‚ что значительно сократило время обучения моделей.

Революция Трансформеров (Hugging Face): Новый Уровень Понимания

Но настоящим game-changer’ом для нас стали Трансформеры и экосистема Hugging Face. Эти модели‚ такие как BERT‚ GPT‚ T5‚ произвели революцию в NLP. Они способны улавливать сложнейшие контекстные зависимости в тексте‚ что делает их незаменимыми для широкого круга задач. Hugging Face предоставил нам легкий доступ к тысячам предобученных моделей‚ что значительно ускорило нашу разработку.

Мы используем трансформеры для:

- Сложных задач NER: BERT для NER часто превосходит традиционные методы.

- Классификации: Тонкая настройка (Fine-tuning) предварительно обученных моделей BERT для задач классификации дает потрясающие результаты.

- Генерации текста: С GPT-подобными моделями мы экспериментируем в генерации диалогов‚ автоматического создания тегов и даже кода. Это кажется невероятным‚ но эти модели могут писать связный и осмысленный текст!

- Суммаризации текста: Как экстрактивной (выделение ключевых предложений)‚ так и абстрактивной (генерация нового‚ краткого текста).

- Машинного перевода: Трансформерные архитектуры лежат в основе современных систем машинного перевода.

- Вопросно-ответных систем (QA): Мы разрабатывали системы‚ которые могут находить ответы на вопросы в больших текстовых корпусах.

- Распознавания эмоций: Контекстное встраивание‚ предоставляемое трансформерами‚ позволяет более точно определять эмоциональную окраску‚ включая нюансы и сарказм.

Тонкая настройка (Fine-tuning) этих моделей на наших собственных данных стала стандартной практикой. Это позволяет нам адаптировать мощь общих языковых моделей под специфику наших задач и данных‚ достигая впечатляющей производительности.

Практические Применения и Специализированные Задачи: Где NLP Встречается с Реальностью

Наш путь в NLP не ограничивается только теоретическими знаниями и базовыми алгоритмами. Мы активно применяем эти технологии для решения реальных проблем в различных областях‚ сталкиваясь с уникальными вызовами и находя инновационные решения. Вот несколько примеров из нашего опыта.

Работа с Разнообразными Источниками и Форматами

Текст не всегда приходит в удобном формате. Часто нам приходится извлекать его из различных источников:

- Веб-скрейпинг: Для сбора данных из интернета мы активно используем библиотеку Beautiful Soup. Она позволяет нам парсить HTML-страницы и извлекать нужный текст‚ который затем проходит через наш конвейер предобработки.

- PDF-документы: Извлечение текста из PDF – отдельная головная боль‚ но с PyMuPDF мы научились эффективно справляться с этой задачей‚ получая структурированный текст для дальнейшего анализа‚ например‚ в юридических документах или финансовых отчетах.

- Лог-файлы: Анализ лог-файлов с помощью NLP помогает нам выявлять аномалии и паттерны в работе систем‚ что критически важно для мониторинга и безопасности.

Мультиязычность и Сложная Морфология

Мир не ограничивается английским языком. Мы работаем с многоязычными текстовыми корпусами‚ и это ставит перед нами новые вызовы. Для языков с богатой морфологией‚ таких как русский‚ мы используем специализированные библиотеки:

- Stanza: Эта библиотека от Стэнфордского университета предоставляет полный набор инструментов для лингвистического анализа (токенизация‚ POS-теггинг‚ лемматизация‚ синтаксический парсинг) для множества языков‚ включая русский. Мы высоко ценим ее точность.

- Polyglot: Для более редких языков или когда нужна быстрая мультиязычная поддержка‚ Polyglot оказывается весьма полезной.

Разработка систем машинного перевода на Python – это амбициозная‚ но достижимая цель с использованием трансформерных моделей. Мы экспериментировали с созданием систем для автоматического перевода узкоспециализированных текстов‚ что требует тщательной подготовки данных и тонкой настройки.

Генерация и Вопросно-ответные Системы (QA)

Генерация текста и создание систем‚ способных отвечать на вопросы‚ – это‚ пожалуй‚ одни из самых впечатляющих применений NLP:

- Разработка чат-ботов: Мы работали с фреймворком Rasa для создания умных чат-ботов‚ которые могут вести диалог‚ понимать намерения пользователя и предоставлять релевантную информацию.

- QA-системы: Создание систем вопросно-ответных систем‚ которые могут извлекать ответы непосредственно из документов‚ стало возможным благодаря мощным трансформерным моделям. Мы использовали их для автоматизации службы поддержки и быстрого поиска информации в корпоративных базах знаний.

- Суммаризация текста: Разработка систем суммаризации текста‚ как экстрактивной (выбор наиболее важных предложений)‚ так и абстрактивной (генерация нового текста‚ передающего суть)‚ позволяет нам создавать краткие обзоры для длинных документов‚ отчетов или новостных лент.

Специфический Анализ: От Стиля до Плагиата

Иногда задачи требуют очень специфического подхода к анализу текста:

- Анализ стилистики текстов: Мы разрабатывали инструменты для определения авторского почерка‚ что полезно в криминалистике или для анализа литературных произведений.

- Обнаружение плагиата: Сравнение документов с использованием различных методов векторизации (TF-IDF‚ Word2Vec‚ Doc2Vec) и метрик сходства (библиотека Jellyfish‚ Textdistance) позволяет нам создавать системы для выявления плагиата.

- Анализ метаданных текста: Извлечение информации о датах‚ авторах‚ источниках‚ что помогает в каталогизации и анализе больших архивов.

- Факт-чекинг: Разработка систем для проверки фактов – это сложная‚ но крайне важная задача в эпоху дезинформации‚ требующая интеграции различных NLP-техник.

Вызовы и Перспективы: Куда Движемся Дальше

Несмотря на все наши достижения‚ мир NLP постоянно развивается‚ и мы сталкиваемся с новыми вызовами. Работа с неполными и ошибочными данными остается одной из главных проблем. Также важна оценка качества NER-моделей и других алгоритмов‚ используя такие метрики‚ как F1-score‚ Precision и Recall‚ чтобы убедиться в надежности наших систем.

Мы продолжаем активно изучать новые подходы‚ такие как Graph Embeddings для анализа взаимосвязей в тексте и анализ временных рядов в текстовых данных для выявления сезонности или трендов. Разработка инструментов для автоматической разметки данных становится все более актуальной‚ поскольку ручная разметка больших объемов текста – это трудоемкий и дорогостоящий процесс.

Наш взгляд в будущее: Мы видим огромный потенциал в дальнейшем развитии трансформерных моделей для еще более сложных задач‚ таких как генерация креативного контента‚ более тонкое понимание человеческих эмоций и создание по-настоящему интеллектуальных помощников. Обработка текста в режиме реального времени (Streaming NLP) также становится все более востребованной для анализа потоков данных.

Мы верим‚ что NLP с Python продолжит оставаться одним из самых мощных инструментов для работы с информацией. Возможности безграничны‚ и каждый день приносит новые открытия. Наш опыт показывает‚ что главное – это не бояться экспериментировать‚ постоянно учиться и применять полученные знания для решения реальных задач‚ делая мир немного понятнее с помощью кода.

На этом статья заканчивается. .

Подробнее: LSI Запросы к статье

| Основы NLTK и spaCy | Word Embeddings Gensim | Анализ тональности VADER | Трансформеры Hugging Face | Разработка чат-ботов Python |

| Применение Scikit-learn NLP | Тематическое моделирование LDA | Продвинутая лемматизация | Веб-скрейпинг Beautiful Soup | Извлечение ключевых фраз RAKE |