Тайны Текста: Наш Путь в Мир Обработки Естественного Языка на Python

Привет, дорогие читатели и коллеги-энтузиасты! Сегодня мы хотим поделиться с вами чем-то поистине захватывающим – нашим погружением в удивительный мир Обработки Естественного Языка (NLP) с помощью Python. За последние годы мы прошли путь от полного новичка до уверенного специалиста, и поверьте, это было невероятное приключение. Мы видели, как текст, казалось бы, простой набор символов, оживает, раскрывая скрытые смыслы, эмоции и связи.

Мы помним наши первые шаги, когда каждый абзац кода казался магией, а каждая новая библиотека открывала целый неизведанный мир возможностей. Мы экспериментировали, ошибались, учились на своих ошибках и, самое главное, получали огромное удовольствие от процесса. Эта статья – не просто техническое руководство, это наш личный опыт, наши открытия и, конечно, наши любимые инструменты, которые помогли нам покорить эту вершину. Приготовьтесь, ведь мы собираемся раскрыть перед вами все карты и показать, как вы тоже можете заставить компьютеры понимать человеческую речь!

Начало Пути: Как Мы Заставили Компьютер "Читать"

Прежде чем мы сможем научить машину понимать текст, нам нужно научить ее его "видеть" и "слышать" так, как это делаем мы. Это означает, что сырой, неструктурированный текст, который мы читаем ежедневно – будь то новостные статьи, посты в социальных сетях или отзывы клиентов – должен быть преобразован в формат, понятный для алгоритмов. Этот этап, который мы ласково называем "предварительной обработкой", является фундаментом всего нашего здания NLP. Без него все наши дальнейшие усилия будут тщетны.

Наши первые эксперименты показали, что даже самые мощные алгоритмы бесполезны, если им "скормить" грязные или неформатированные данные. Мы быстро усвоили, что качество выходных данных напрямую зависит от качества входных. Поэтому мы уделяем особое внимание каждому шагу предварительной обработки, тщательно очищая и структурируя каждый текстовый фрагмент. Это как подготовка ингредиентов перед приготовлением сложного блюда: без правильной подготовки результат будет далек от идеала.

Токенизация и Стемминг/Лемматизация: Первые Шаги в Разборке Текста

Первое, что мы делаем, когда сталкиваемся с новым текстом – это токенизация. Представьте, что вы ребенок, который учится читать. Вы начинаете с отдельных слов. Так же и компьютер: он не может сразу понять предложение целиком. Ему нужно разбить его на мельчайшие значимые единицы – токены. Обычно это слова, но могут быть и знаки препинания, числа, специальные символы. Мы использовали NLTK (Natural Language Toolkit) для этих целей, и это стало для нас настоящим открытием.

NLTK предлагает множество токенизаторов, и мы часто начинали с простого `word_tokenize`. Но со временем мы поняли, что одного разбиения на слова недостаточно. Например, слова "бегает", "бегал", "бегущий" – это все формы одного и того же корня "бег". Чтобы компьютер понимал, что это одно и то же понятие, нам нужны стемминг или лемматизация. Стемминг отсекает окончания, пытаясь найти "корень" слова, даже если он не является настоящим словом. Лемматизация более умна: она приводит слово к его базовой словарной форме (лемме), используя морфологический анализ.

Мы обнаружили, что для русского языка и других языков с богатой морфологией `spaCy` и `Stanza` показали себя значительно лучше, чем базовый стемминг NLTK. `spaCy` не только быстрее, но и предлагает более качественную лемматизацию, а `Stanza` превосходно справляется с языками, где морфология играет ключевую роль, предоставляя глубокий лингвистический анализ.

| Метод | Описание | Пример (слово "бегущий") | Предпочтительная библиотека |

|---|---|---|---|

| Токенизация | Разбиение текста на отдельные слова или символы. | ["бегущий"] | NLTK, spaCy |

| Стемминг | Удаление суффиксов и префиксов для получения корня слова. | "бег" (может быть "бег" или "бег") | NLTK (Porter, Snowball) |

| Лемматизация | Приведение слова к его базовой словарной форме (лемме) с учетом контекста и части речи. | "бежать" | spaCy, Stanza |

Регулярные Выражения и Очистка Текста: Борьба с Шумом

Сырой текст полон "шума": HTML-теги, URL-адреса, специальные символы, лишние пробелы, эмодзи, сленг. Все это мешает нашим алгоритмам. Мы быстро осознали, что регулярные выражения (библиотека `re` в Python) – наш лучший друг в этой битве. С их помощью мы научились эффективно удалять ненужные элементы, оставляя только значимый текст. Например, удаление HTML-тегов из веб-страницы или очистка текста от ссылок – это классические задачи, которые мы решали с помощью `re`.

Мы также столкнулись с необходимостью работы с нелатинскими алфавитами и различными кодировками, что потребовало от нас более глубокого понимания юникода. Очистка данных – это не одноразовая операция, это итеративный процесс, который постоянно совершенствуется по мере того, как мы лучше понимаем наши данные. Иногда мы даже сталкивались с проблемами обработки неполных и ошибочных данных, когда в тексте были опечатки или пропущенные символы, и приходилось разрабатывать инструменты для проверки грамматики и исправления орфографии.

Стоп-слова и Пунктуация: Устранение Избыточности

Во многих задачах NLP такие слова, как "и", "в", "на", "для" (так называемые стоп-слова), не несут глубокого смысла и могут быть удалены. Они встречаются очень часто и могут "засорять" наши модели. NLTK предоставляет списки стоп-слов для разных языков, и мы активно их использовали. Однако, мы всегда помним, что в некоторых задачах (например, в анализе стилистики или машинном переводе) стоп-слова могут быть важны, поэтому их удаление – это всегда осознанный выбор.

Аналогично, пунктуация часто удаляется, если она не важна для конкретной задачи. Но и здесь есть нюансы. Например, для анализа тональности восклицательный знак или вопросительный знак могут нести эмоциональную окраску. Мы учились подходить к этому вопросу гибко, создавая инструменты для нормализации пунктуации, а не просто ее удаления. Это позволило нам сохранять ценную информацию, когда это было необходимо, и упрощать данные, когда это было уместно.

Представление Текста: От Слов к Числам – Язык для Машин

После того как текст очищен и разбит на токены, возникает новый вызов: как представить эти слова в виде, который будет понятен математическим моделям? Компьютеры понимают только числа. Поэтому нам нужно найти способ преобразовать каждое слово, каждую фразу, каждый документ в числовой вектор. Это один из самых критически важных этапов в NLP, определяющий, насколько хорошо наши модели смогут "учиться" на текстовых данных.

Мы исследовали различные подходы к векторизации, каждый из которых имеет свои преимущества и недостатки. От простых методов подсчета до сложных нейросетевых моделей, способных улавливать тончайшие семантические нюансы. Это было похоже на изучение разных диалектов одного и того же языка, где каждый диалект открывает новые возможности для общения с машиной. Наше путешествие в мир векторизации научило нас, что не существует универсального "лучшего" метода; выбор всегда зависит от конкретной задачи и характеристик данных.

Простые Векторизаторы: CountVectorizer и TfidfVectorizer

Наши первые попытки преобразовать текст в числа начались с относительно простых, но очень эффективных методов. CountVectorizer из Scikit-learn – это как составление списка покупок: он просто подсчитывает, сколько раз каждое слово встречается в документе. Если у нас есть большой набор документов, он создает матрицу, где строки – это документы, а столбцы – уникальные слова, а значения – их частоты. Это отличная отправная точка, но у него есть недостаток: очень частые слова (даже не стоп-слова, а просто распространенные) могут доминировать, скрывая более значимые.

Здесь на помощь приходит TfidfVectorizer (Term Frequency-Inverse Document Frequency). Мы научились, что TF-IDF не просто считает слова, он взвешивает их. Он увеличивает вес слов, которые часто встречаются в данном документе (TF), но редко встречаются в других документах (IDF). Таким образом, слова, уникальные для конкретного документа, получают более высокий вес, а общие слова – низкий. Это позволило нам лучше выделять ключевые термины и темы в текстах. Мы часто используем его для классификации текстов или тематического моделирования.

Word Embeddings: Word2Vec, GloVe, FastText, Doc2Vec

Революция в векторизации произошла с появлением Word Embeddings (векторных представлений слов). Мы были поражены, когда узнали, что слова можно представить в виде многомерных векторов таким образом, что семантически близкие слова будут иметь близкие векторы. Это как расположить слова в пространстве, где "король" и "королева" будут рядом, а "король" минус "мужчина" плюс "женщина" будет равно "королева"!

Мы активно работали с Word2Vec и GloVe через библиотеку Gensim. Word2Vec имеет две архитектуры: Skip-gram (предсказывает контекст по слову) и CBOW (предсказывает слово по контексту). GloVe же основан на матрицах совместной встречаемости слов. Эти модели позволили нам улавливать семантические отношения между словами, что было недостижимо для CountVectorizer и TF-IDF. Когда нам нужно было работать с редкими словами, FastText оказался незаменимым. Он создает векторные представления не только для слов, но и для подслов (символьных n-грамм), что позволяет ему генерировать векторы для слов, которых он никогда не "видел" целиком, просто комбинируя векторы своих частей.

А для представления целых документов? Здесь на сцену выходит Doc2Vec, также из Gensim. Он расширяет идеи Word2Vec на уровень абзацев или целых документов, позволяя нам сравнивать целые тексты по их смысловому содержанию, а не просто по частотности слов. Это было особенно полезно при поиске похожих статей или кластеризации документов.

Контекстные Встраивания и Sentence Transformers: Глубокое Понимание

Несмотря на всю мощь Word Embeddings, у них был один фундаментальный недостаток: каждое слово имело один и тот же вектор, независимо от контекста. Слово "банк" в значении "финансовое учреждение" и "берег реки" имело одинаковое представление. Это было серьезным ограничением. И тут мы открыли для себя контекстные встраивания, которые произвели настоящую революцию.

Модели, такие как ELMo, а затем и BERT (Bidirectional Encoder Representations from Transformers), изменили все. Они создают вектор для слова, учитывая весь контекст предложения. Теперь слово "банк" в разных предложениях имеет разные векторы, что позволяет моделям улавливать полисемию и тончайшие нюансы смысла. Работая с Hugging Face Transformers, мы смогли легко использовать предобученные BERT-модели для векторизации предложений и документов, а затем дообучать их под наши конкретные задачи, такие как классификация или NER.

Для задач, где нужно сравнивать целые предложения или документы (например, поиск семантически похожих вопросов), мы активно используем Sentence Transformers. Они позволяют получать высококачественные векторные представления предложений, которые затем можно сравнивать с помощью косинусного сходства. Это значительно упростило разработку систем вопросно-ответных систем (QA) и систем обнаружения плагиата, где нужно быстро находить похожие фрагменты текста.

Понимание Текста: Наш Инструментарий для Извлечения Смысла

После того как мы научились очищать и численно представлять текст, настало время перейти к самому интересному – извлечению из него полезной информации. Это то, ради чего мы все это затевали: заставить компьютер не просто "читать" слова, но и "понимать" их, отвечать на вопросы, категоризировать, выявлять эмоции. Этот раздел – сердце нашей работы в NLP, где мы применяем все полученные знания на практике.

Мы видели, как эти инструменты преобразуют горы неструктурированных данных в ценные инсайты. От автоматического распознавания названий компаний в новостных статьях до определения настроения тысяч отзывов клиентов – возможности безграничны. Каждый новый проект приносил новые вызовы и новые решения, и мы с удовольствием делились нашими находками и лучшими практиками. Давайте погрузимся в основные задачи, которые мы решаем в мире NLP.

Распознавание Именованных Сущностей (NER): Поиск Ключевых Игроков

Одна из наших любимых задач – это Распознавание Именованных Сущностей (NER). Представьте, что у вас есть огромный объем текста, и вам нужно быстро найти все имена людей, названия организаций, географические объекты, даты. NER делает именно это! Мы начали со `spaCy`, который предлагает очень быстрые и точные модели для NER из коробки. Для нас это стало незаменимым инструментом при анализе новостных статей, где нужно было автоматически извлекать информацию о действующих лицах и местах.

Когда нам требовалась более высокая точность или поддержка специфических сущностей (например, медицинских терминов), мы углубились в использование `Flair` и даже экспериментировали с CRF (Conditional Random Fields). Flair, благодаря своим state-of-the-art моделям, показал впечатляющие результаты, особенно для языков с богатой морфологией. Мы также учились оценивать качество NER-моделей, используя метрики, такие как F1-score, Precision и Recall, чтобы убедиться, что наши системы работают наилучшим образом. Разработка систем для автоматической разметки сущностей стала одним из наших ключевых направлений.

Анализ Тональности (Sentiment Analysis): Чувства в Тексте

Понимание эмоционального окраса текста – это бесценный навык, особенно в мире маркетинга и обслуживания клиентов. Анализ тональности позволяет нам определить, является ли отзыв положительным, отрицательным или нейтральным. Мы начали с простых подходов, таких как `VADER (Valence Aware Dictionary and sEntiment Reasoner)`, который отлично подходит для английского языка и даже учитывает интенсивность эмоций и сарказм.

Для более простых задач мы использовали `TextBlob`, который хотя и не всегда самый точный, но невероятно прост в освоении и быстро дает результат. Однако, мы быстро поняли, что анализ тональности сообщений в социальных сетях (Twitter/Reddit) с учетом сленга и эмодзи требует более продвинутых методов. Мы экспериментировали с обучением собственных классификаторов на размеченных данных, используя Scikit-learn и даже PyTorch/TensorFlow для создания нейросетей, способных улавливать тонкости сарказма и иронии. Анализ тональности финансовых новостей или отзывов о продуктах стал стандартной задачей в нашей практике.

Тематическое Моделирование (Topic Modeling): Выявление Скрытых Тем

Представьте, что у вас есть огромный архив документов, и вы хотите понять, о чем они. Прочитать все вручную невозможно. Здесь на помощь приходит тематическое моделирование. Мы использовали библиотеку Gensim, которая является настоящим сокровищем для таких задач. Мы активно работали с LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing); Эти алгоритмы позволяют автоматически обнаруживать скрытые "темы" в коллекции текстов и присваивать каждому документу определенную степень принадлежности к этим темам.

Сравнение моделей тематического моделирования, таких как LDA и NMF (Non-negative Matrix Factorization), стало для нас важным шагом в выборе оптимального инструмента. Мы обнаружили, что LDA часто дает более интерпретируемые темы, в то время как NMF может быть эффективен для определенных типов данных. Анализ скрытых тем в отзывах клиентов или научных статьях стал для нас рутинной, но всегда увлекательной задачей.

"Язык – это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Классификация Текстов: Автоматическая Сортировка

Классификация текстов – это одна из самых распространенных задач в NLP. Нам нужно автоматически присвоить категорию документу: спам или не спам, новость о спорте или политике, положительный или отрицательный отзыв. Мы начали с Scikit-learn, который предоставляет широкий спектр алгоритмов машинного обучения: от наивных байесовских классификаторов и SVM (Support Vector Machines) до более сложных ансамблевых методов.

Мы создавали собственные векторизаторы (CountVectorizer, TfidfVectorizer), а затем обучали модели для классификации. По мере усложнения задач и увеличения объемов данных мы переходили к более мощным инструментам, таким как PyTorch/TensorFlow для создания нейросетей (например, LSTM-сетей) и, конечно же, трансформерам. Применение BERT для задач классификации текстов дало нам беспрецедентную точность, особенно после тонкой настройки (fine-tuning) предварительно обученных моделей на наших специфических данных. Разработка систем для автоматической категоризации статей и новостей стала одним из наших ключевых достижений.

Извлечение Ключевых Фраз: Суть Текста в Нескольких Словах

Иногда нам не нужен полный анализ всего текста, а лишь его суть – ключевые слова и фразы. Мы исследовали различные методы для извлечения ключевых фраз. Одним из первых инструментов, который мы освоили, был RAKE (Rapid Automatic Keyword Extraction). Он довольно прост и эффективен для быстрого извлечения ключевых слов на основе частотности и совместной встречаемости слов.

Однако, когда нам нужно было извлекать не просто слова, а целые ключевые предложения, мы обратились к TextRank. Этот алгоритм, основанный на PageRank (алгоритме, который Google использует для ранжирования веб-страниц), позволяет ранжировать предложения или слова в тексте по их важности. Мы использовали TextRank не только для извлечения ключевых фраз, но и для суммаризации текста, когда нужно было получить краткое содержание, состоящее из наиболее важных предложений оригинала.

Продвинутый NLP и Современные Подходы: На Гребне Волны

Мир NLP развивается с невероятной скоростью. То, что еще вчера казалось фантастикой, сегодня становится стандартом. Мы всегда старались держать руку на пульсе, изучая и внедряя самые передовые технологии. Этот раздел посвящен нашему опыту работы с этими новейшими и наиболее мощными инструментами, которые позволили нам выйти за рамки простых задач и начать решать по-настоящему сложные проблемы.

От глубоких нейронных сетей до архитектур трансформеров, мы погрузились в мир, где машины не просто обрабатывают текст, но и начинают его генерировать, переводить и даже отвечать на сложные вопросы. Это был период интенсивного обучения и экспериментов, который принес нам огромное удовлетворение от возможностей, которые открываются перед нами.

Трансформеры (Hugging Face): Новая Эра NLP

Если бы нас спросили, что произвело самое большое впечатление в NLP за последние годы, мы бы без колебаний назвали Трансформеры. Благодаря библиотеке Hugging Face Transformers, мощнейшие модели, такие как BERT, GPT, RoBERTa и многие другие, стали доступны каждому. Эти модели изменили правила игры, достигнув беспрецедентной точности в огромном спектре задач NLP.

Мы использовали трансформеры для самых разных целей: от классификации текстов и NER до разработки систем вопросно-ответных систем (QA), где модель может "читать" документ и отвечать на вопросы по его содержимому. Особенно впечатляющими были наши эксперименты с генерацией текста с использованием моделей типа GPT. Это открыло двери для автоматического создания контента, суммаризации текста и даже генерации кода. Тонкая настройка (Fine-tuning) предварительно обученных моделей на наших специфических данных стала нашим стандартным подходом для достижения максимальной производительности.

Синтаксический Парсинг: Грамматика для Машин

Понимание структуры предложения – это следующий уровень после простого распознавания слов. Синтаксический парсинг позволяет нам понять, как слова связаны друг с другом в предложении, кто выполняет действие, над чем оно выполняется. Мы активно использовали `spaCy` для реализации синтаксического парсинга, который выдает дерево зависимостей, показывающее грамматические связи между токенами.

Это оказалось невероятно полезным для более сложных задач, таких как извлечение фактов из новостей или разработка систем для выявления связей между сущностями. Например, если мы хотим найти, кто "купил" что-то, синтаксический парсинг помогает нам идентифицировать субъект и объект глагола. Использование Stanza также дало нам мощные возможности для глубокого морфологического и синтаксического анализа, особенно для русского языка.

Работа с Многоязычными Текстами: Преодолевая Языковые Барьеры

В нашем глобализированном мире все чаще возникает необходимость обрабатывать тексты на разных языках. Мы активно работали с многоязычными текстовыми корпусами. Библиотека Polyglot стала для нас отличным инструментом для базовых задач, таких как определение языка, токенизация и NER для различных языков.

Для более глубокого анализа языков с богатой морфологией, таких как русский, мы обращались к Stanza, разработанной Stanford NLP Group. Stanza предоставляет state-of-the-art модели для токенизации, POS-теггинга, лемматизации и синтаксического парсинга для множества языков. Это позволило нам расширить наши возможности и работать с клиентами по всему миру, преодолевая языковые барьеры.

Обработка Неструктурированного Текста и Big Data NLP: Масштабные Задачи

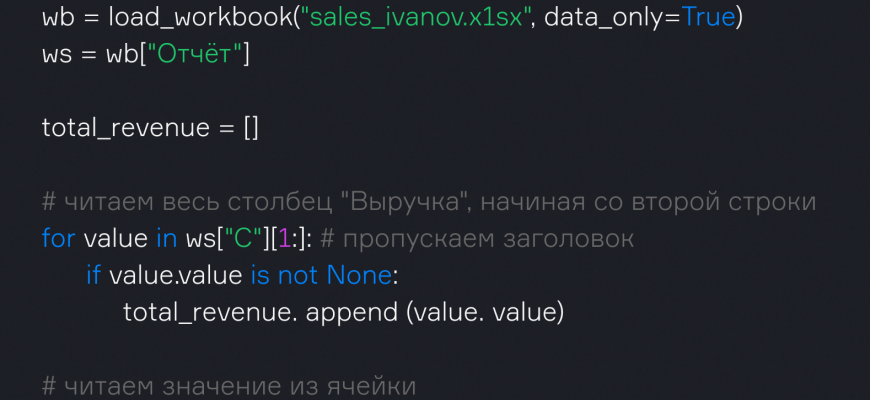

Текст в реальном мире редко бывает аккуратно структурирован. От электронных писем и веб-страниц до лог-файлов и медицинских записей – мы постоянно сталкиваемся с неструктурированным текстом. Очистка и предобработка таких данных – это отдельное искусство. Мы использовали Beautiful Soup для веб-скрейпинга, чтобы извлекать текст с веб-страниц, и PyMuPDF для извлечения текста из PDF-документов.

Когда речь заходила об обработке больших текстовых массивов (Big Data NLP), мы сталкивались с проблемами масштабируемости. Здесь на помощь приходили оптимизированные библиотеки, такие как Gensim, способные эффективно работать с большими корпусами данных, а также распределенные вычислительные системы. Мы также учились работать с эмодзи и сленгом в современных текстах, что требовало разработки специальных словарей и правил нормализации.

Практические Приложения и За Горизонтом: Где NLP Встречается с Реальностью

Вся эта теория и инструментарий были бы бессмысленны без их применения в реальном мире. Мы всегда стремились не просто изучать NLP, но и использовать его для решения практических задач, создавать что-то полезное и инновационное. Этот раздел посвящен тем областям, где наши знания и опыт в NLP нашли свое воплощение.

От автоматизации рутинных процессов до создания интеллектуальных систем, которые взаимодействуют с пользователями, мы видели, как NLP преобразует различные сферы. Это то, что делает наше путешествие в мир обработки естественного языка таким увлекательным и значимым.

Разработка Чат-ботов и Систем Вопросно-ответных Систем (QA)

Кто из нас не мечтал создать собственного умного ассистента? Мы погрузились в мир разработки чат-ботов на Python, и фреймворк Rasa стал нашим основным инструментом. Rasa позволяет создавать контекстно-зависимых чат-ботов, способных понимать намерения пользователя и управлять диалогом. Мы также использовали Transformer-модели для генерации диалогов, что значительно улучшило естественность общения с ботами.

Параллельно мы работали над системами вопросно-ответных систем (QA). Это системы, которые могут отвечать на вопросы пользователя, извлекая информацию из большого корпуса документов. Используя трансформеры (например, BERT с Hugging Face), мы смогли достичь впечатляющих результатов, создавая системы, которые могут точно находить ответы даже в очень больших и сложных текстах, например, в юридических документах или технических руководствах.

Суммаризация Текста: Краткость – Сестра Таланта

В эпоху информационного переизбытка способность быстро получить суть большого текста бесценна. Мы изучали разработку систем суммаризации текста. Есть два основных подхода: экстрактивная и абстрактивная суммаризация. Экстрактивная система выбирает наиболее важные предложения из оригинального текста и объединяет их. Здесь мы использовали TextRank.

Абстрактивная суммаризация – это более сложная задача. Она не просто выбирает, а генерирует новые предложения, которые передают суть текста. Здесь на сцену выходят трансформерные модели. Использование Transformer-моделей для суммаризации (например, BART, T5) позволило нам создавать более связные и естественные резюме, которые не просто повторяют фразы из оригинала, а перефразируют их. Мы также сравнивали различные модели суммаризации, чтобы найти оптимальный баланс между качеством и производительностью.

Анализ Текста для Различных Отраслей

Наши навыки в NLP нашли применение в самых разных областях. Мы занимались анализом текстов отзывов клиентов, выявляя частотные проблемы и предпочтения, что помогало компаниям улучшать свои продукты и услуги. Мы также работали с анализом юридических документов, автоматизируя извлечение ключевых дат, условий и обязательств, что значительно ускоряло работу юристов.

Не менее интересной была задача анализа финансовых новостей для прогнозирования настроений рынка, а также анализ лог-файлов для выявления аномалий и проблем в работе систем. Мы даже заглянули в мир анализа стилистики текстов для определения авторского почерка и разработки систем обнаружения плагиата. Возможности применения NLP оказались поистине безграничными, и каждый новый проект приносил нам новые знания и опыт.

Визуализация Текстовых Данных: Увидеть Невидимое

Представлять результаты анализа в наглядном виде – это ключевой навык для любого аналитика. Мы использовали различные инструменты для визуализации текстовых данных; Самый простой и эффектный способ – это облака слов (Word Clouds), которые позволяют быстро увидеть наиболее часто встречающиеся слова в тексте. Это отличный способ для первого знакомства с данными.

Для более глубокого анализа мы использовали тепловые карты (Heatmaps) для визуализации матриц сходства документов или корреляций между темами. Также мы экспериментировали с различными графиками для анализа частотности слов и n-грамм, что помогало нам выявлять паттерны в пользовательских запросах или поведенческих паттернах в чатах и отзывах. Визуализация не только делает данные более понятными, но и часто помогает выявить неочевидные закономерности.

Наше путешествие в мир Обработки Естественного Языка было невероятно увлекательным, полным открытий и постоянного обучения. Мы начали с базовых концепций токенизации и стемминга, освоили различные методы векторизации текста, научились извлекать смысл с помощью NER, анализа тональности и тематического моделирования, и, наконец, погрузились в мир трансформеров, которые полностью изменили ландшафт NLP.

Мы убедились, что Python с его богатой экосистемой библиотек (NLTK, spaCy, Gensim, Scikit-learn, Hugging Face Transformers, PyTorch/TensorFlow) является идеальным инструментом для любого, кто хочет работать с текстом. Каждый новый проект, каждая новая задача бросает нам вызов, но также открывает новые горизонты. Мы верим, что NLP будет играть все более важную роль в нашей жизни, делая взаимодействие человека с компьютером более естественным и интуитивным.

И помните, самое главное в этом путешествии – это любопытство и готовность постоянно учиться. Мир NLP постоянно меняется, и это делает его таким захватывающим. Присоединяйтесь к нам, исследуйте, экспериментируйте, и вы увидите, как текст раскрывает перед вами свои удивительные тайны. До новых встреч на просторах кода и слов!

Подробнее

| Основы NLTK | NER с spaCy | Тематическое моделирование LDA | Word Embeddings | Анализ тональности VADER |

| Трансформеры Hugging Face | Разработка чат-ботов Rasa | Суммаризация текста Python | Векторизация текста TF-IDF | Лемматизация Stanza |