- Расшифровка Языка Цифрового Мира: Наш Путь в Мире NLP с Python

- Фундамент Работы с Текстом: Превращаем Слова в Данные

- Токенизация и Стемминг: Первые Шаги к Пониманию

- Лемматизация: Глубокое Погружение в Смысл

- Очистка и Нормализация: Регулярные Выражения и Стоп-слова

- Векторизация Текста: От Слов к Числам

- Извлечение Знаний: От Сущностей до Эмоций

- Распознавание Именованных Сущностей (NER) с spaCy и Flair

- Тематическое Моделирование: Раскрываем Скрытые Темы

- Анализ Тональности: Понимаем Настроения

- Извлечение Ключевых Фраз и Суммаризация

- Современные Вызовы и Решения: Трансформеры и Глубокое Обучение

- Революция Трансформеров (Hugging Face, BERT, GPT)

- Нейросети для NLP: PyTorch/TensorFlow и LSTM

- Создание Продвинутых Систем: QA, Машинный Перевод, Чат-боты

- Инструменты и Практики: Строим Наши NLP-Решения

- Scikit-learn: Наш Выбор для Классификации Текстов

- Работа с Разнообразными Источниками: Веб-скрейпинг и PDF

- Многоязычный NLP и Специфические Задачи

- Визуализация и Анализ Больших Данных

Расшифровка Языка Цифрового Мира: Наш Путь в Мире NLP с Python

Дорогие читатели, когда мы говорим о цифровом мире, мы часто представляем себе потоки данных, алгоритмы и сложные вычисления. Но что, если мы скажем, что одним из самых важных и интересных источников информации является обычный человеческий язык? Текст – это не просто набор символов; это мысли, эмоции, факты, истории. И задача понять этот текст, извлечь из него ценность и даже научить машины общаться на нём, лежит в основе удивительной области, которую мы называем Обработкой Естественного Языка (Natural Language Processing, NLP).

Мы, как опытные исследователи и практикующие разработчики, не раз убеждались в мощи NLP. От анализа отзывов клиентов до создания умных чат-ботов, от перевода текстов до поиска скрытых паттернов в огромных массивах данных – везде, где есть текст, найдётся место для NLP. В этой статье мы приглашаем вас в увлекательное путешествие по миру NLP с использованием Python – языка, который стал де-факто стандартом для многих задач в этой сфере благодаря своей гибкости, богатой экосистеме библиотек и активному сообществу. Мы поделимся нашим опытом, расскажем о ключевых инструментах и методах, которые помогают нам превращать хаотичные потоки слов в осмысленные инсайты. Приготовьтесь, будет интересно!

Фундамент Работы с Текстом: Превращаем Слова в Данные

Прежде чем мы сможем извлекать смысл из текста, нам необходимо подготовить его. Представьте, что у нас есть огромная библиотека, и мы хотим её упорядочить. Мы не можем просто взять все книги и начать их анализировать, не зная, что в них написано. С текстом то же самое: его нужно разобрать на более мелкие, управляемые части, очистить от "шума" и привести к стандартному виду. Это и есть основа предобработки, без которой любое дальнейшее исследование будет неполным или даже ошибочным.

В нашем арсенале блогеров и разработчиков, эти этапы являются краеугольным камнем. Мы всегда начинаем с них, потому что качество конечного результата напрямую зависит от того, насколько хорошо мы подготовили наши данные. Именно здесь начинают проявляться чудеса Python и его специализированных библиотек, позволяющих нам с лёгкостью выполнять эти порой рутинные, но крайне важные операции.

Токенизация и Стемминг: Первые Шаги к Пониманию

Наш первый шаг в работе с текстом – это токенизация. Мы берём большой кусок текста и разбиваем его на более мелкие единицы, называемые токенами. Чаще всего токенами являются слова или знаки препинания. Например, фраза "Привет, мир!" будет токенизирована в ["Привет", ",", "мир", "!"]. Почему это важно? Потому что компьютеры не понимают предложений целиком, им нужны дискретные элементы для анализа. Мы используем библиотеку NLTK, которая предоставляет мощные инструменты для токенизации, позволяя нам работать как с отдельными словами, так и с предложениями.

После токенизации мы часто прибегаем к стеммингу. Стемминг – это процесс сокращения слов до их корневой формы, или "основы". Например, слова "бегущий", "бежал", "бегать" могут быть приведены к основе "бег". Это помогает нам уменьшить количество уникальных слов в корпусе и сосредоточиться на их смысловом ядре. В NLTK мы часто используем стеммеры, такие как PorterStemmer или SnowballStemmer, которые хорошо зарекомендовали себя в наших проектах. Однако, мы всегда помним, что стемминг – это довольно грубый метод, который может обрезать слова слишком агрессивно, иногда теряя при этом часть смысла.

Лемматизация: Глубокое Погружение в Смысл

Если стемминг – это быстрый и иногда "жестокий" метод, то лемматизация – это его более интеллектуальный аналог. При лемматизации мы стремимся привести слово к его словарной, или канонической, форме – лемме. Например, слова "бегущий", "бежал", "бегать" будут приведены к лемме "бежать". В отличие от стемминга, лемматизация использует морфологический анализ языка и требует наличия словарей. Это делает её более точной, но и более ресурсоёмкой.

Для продвинутой лемматизации мы активно используем библиотеки spaCy и Stanza. spaCy особенно хороша своей скоростью и точностью, предоставляя готовые модели для различных языков. Stanza от Stanford NLP – это ещё более мощный инструмент, особенно когда мы работаем с языками, обладающими богатой морфологией, такими как русский. Она позволяет нам выполнять не только лемматизацию, но и другие сложные задачи морфологического анализа, что крайне важно для глубокого понимания текста. Мы также можем использовать NLTK для лемматизации с помощью WordNetLemmatizer, но для большинства наших проектов spaCy и Stanza предлагают более комплексные решения.

Очистка и Нормализация: Регулярные Выражения и Стоп-слова

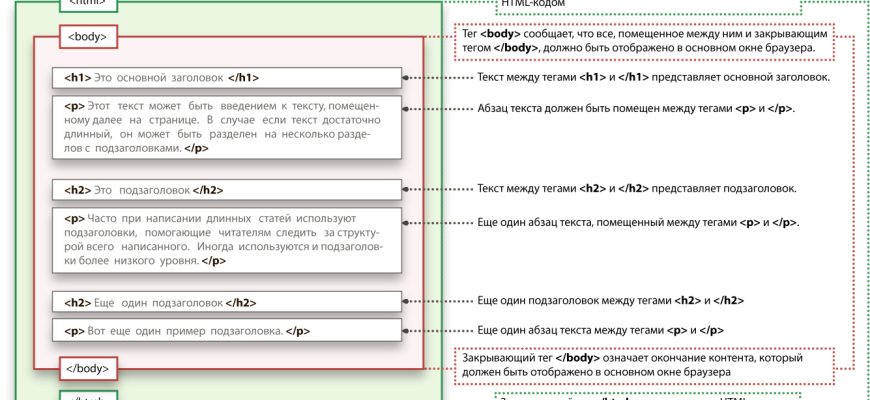

Сырой текст редко бывает идеальным. Он может содержать HTML-теги, специальные символы, лишние пробелы, цифры, URL-адреса и другие элементы, которые мешают анализу. Здесь на помощь приходят регулярные выражения (re). Мы используем модуль `re` в Python для создания паттернов, которые позволяют нам находить и заменять ненужные фрагменты текста. Например, мы можем легко удалить все HTML-теги или привести весь текст к нижнему регистру, что является важным шагом в нормализации данных.

Ещё одна важная часть очистки – удаление стоп-слов. Это общие слова, такие как "и", "в", "на", "он", которые встречаются очень часто, но не несут существенной смысловой нагрузки для большинства задач NLP. Их удаление помогает нам сосредоточиться на более значимых словах и уменьшить размерность данных. NLTK предоставляет списки стоп-слов для различных языков, и мы часто расширяем их собственными списками, специфичными для конкретной предметной области. Кроме того, мы используем библиотеку Textacy, которая предлагает более продвинутые функции для очистки и нормализации текста, включая работу с эмодзи и сленгом, что особенно актуально при анализе текстов из социальных сетей.

Векторизация Текста: От Слов к Числам

После того как мы очистили и нормализовали наш текст, возникает новая задача: как представить слова и предложения в виде, понятном для компьютера? Машины работают с числами, а не с буквами. Здесь на сцену выходит векторизация текста – процесс преобразования текстовых данных в числовые векторы. Это критически важный этап, поскольку качество векторизации напрямую влияет на производительность наших моделей.

Мы начинаем с базовых, но эффективных методов, таких как CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn. CountVectorizer просто подсчитывает частоту вхождения каждого слова в документе, создавая вектор, где каждая позиция соответствует уникальному слову из всего корпуса. TfidfVectorizer идёт дальше, присваивая словам веса на основе их частоты в документе и обратной частоты в корпусе (TF-IDF), что позволяет нам выделить слова, которые являются уникальными и важными для конкретного документа.

Однако эти методы имеют свои ограничения – они не улавливают семантические отношения между словами. Здесь на помощь приходят Word Embeddings. Мы активно используем модели Word2Vec и GloVe, реализованные в библиотеке Gensim. Word2Vec, например, обучается на больших текстовых корпусах и размещает слова в многомерном пространстве таким образом, что слова с похожим значением находятся ближе друг к другу. Это позволяет нам выполнять такие операции, как "король ー мужчина + женщина = королева". FastText, также доступный через Gensim, расширяет эту идею, учитывая подсловные единицы (n-граммы символов), что делает его особенно эффективным для работы с редкими словами и морфологически богатыми языками.

Для представления целых предложений и документов мы используем Doc2Vec (расширение Word2Vec) и Sentence Transformers. Doc2Vec позволяет нам получать векторные представления для целых документов, что очень полезно для задач кластеризации и поиска похожих документов. Sentence Transformers, построенные на архитектуре трансформеров, создают высококачественные векторные представления предложений, которые хорошо улавливают контекст и семантику.

Чтобы нагляднее представить сравнение методов векторизации, мы часто обращаемся к следующей таблице:

| Метод | Описание | Преимущества | Недостатки | Применение |

|---|---|---|---|---|

| CountVectorizer | Подсчёт частоты слов | Простота, интерпретируемость | Не учитывает семантику, высокая размерность | Базовая классификация, анализ частотности |

| TfidfVectorizer | Взвешивание частоты слов с учётом редкости | Выделяет важные слова, снижает влияние общих слов | Не учитывает семантику, высокая размерность | Поиск информации, кластеризация |

| Word2Vec/GloVe | Контекстно-независимые векторные представления слов | Улавливает семантические отношения, снижает размерность | Требует большого корпуса для обучения, не учитывает контекст предложения | Поиск синонимов, классификация, NER |

| FastText | Векторные представления слов с учётом подсловных единиц | Эффективен для редких слов и морфологически богатых языков | Требует большого корпуса, дольше обучается | Классификация текста, NER, поиск |

| Doc2Vec | Векторные представления документов | Улавливает семантику документов, сравнение документов | Требует настройки, дольше обучается | Кластеризация документов, поиск похожих |

| Sentence Transformers | Векторные представления предложений с учётом контекста | Высокое качество, улавливает контекст предложения | Требует больше ресурсов, медленнее | Поиск похожих предложений, QA, суммаризация |

Мы также часто анализируем частотность слов и n-грамм. N-граммы – это последовательности из N слов. Анализ частотности отдельных слов (1-граммы) помогает нам выявить наиболее распространённые термины, а анализ n-грамм (например, биграмм – пары слов) может раскрыть устойчивые словосочетания и фразы, что очень полезно для построения более точных языковых моделей и понимания специфики текста.

Извлечение Знаний: От Сущностей до Эмоций

После того как мы подготовили наш текст и представили его в числовом виде, мы можем приступить к извлечению более глубоких знаний. Это как после тщательной подготовки ингредиентов мы начинаем готовить сложное и вкусное блюдо. Наша цель – не просто обработать слова, но и понять их смысл, найти важные сущности, определить главные темы и даже распознать эмоциональную окраску текста.

Эта часть NLP является одной из самых увлекательных, поскольку именно здесь мы начинаем видеть, как машины "понимают" человеческий язык. Мы используем различные методы и библиотеки, чтобы раскрыть скрытые инсайты, которые были бы практически невидимы при ручном анализе.

Распознавание Именованных Сущностей (NER) с spaCy и Flair

Одной из ключевых задач в NLP является Распознавание Именованных Сущностей (Named Entity Recognition, NER). Это процесс идентификации и классификации именованных сущностей в тексте, таких как имена людей, названия организаций, географические местоположения, даты, суммы денег и т.д. Например, в предложении "Джон Смит из Google посетил Лондон 15 мая" NER может выделить "Джон Смит" как PERSON, "Google" как ORGANIZATION, "Лондон" как GPE (геополитическая сущность) и "15 мая" как DATE.

Для быстрого и точного NER мы регулярно используем библиотеку spaCy. Она поставляется с предварительно обученными моделями, которые обеспечивают высокую производительность прямо "из коробки" для многих языков, включая русский. spaCy позволяет нам легко извлекать сущности и даже визуализировать их. В более сложных случаях, когда требуется высокая точность или работа с языками с богатой морфологией, мы обращаемся к библиотеке Flair. Flair известна своими state-of-the-art моделями, основанными на глубоком обучении, и предоставляет отличные возможности для тонкой настройки под конкретные задачи и домены. Мы также применяем методы CRF (Conditional Random Fields) для распознавания сущностей, особенно когда работаем с относительно небольшими размеченными датасетами, где глубокое обучение может быть избыточным. Оценка качества NER-моделей (F1-score, Precision, Recall) является для нас обязательным этапом, чтобы убедиться в надёжности наших решений.

Тематическое Моделирование: Раскрываем Скрытые Темы

Представьте, что у нас есть огромная коллекция новостных статей, и мы хотим понять, о чём они, не читая каждую из них. Здесь нам помогает тематическое моделирование – набор алгоритмов, которые позволяют нам автоматически обнаруживать скрытые абстрактные "темы" в коллекции документов. Каждая тема определяется распределением слов, и каждый документ может быть представлен как смесь этих тем.

Для тематического моделирования мы используем библиотеку Gensim, которая предоставляет реализации популярных алгоритмов, таких как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing). LDA – это вероятностная модель, которая предполагает, что темы существуют в документах как скрытые переменные. LSI, в свою очередь, использует сингулярное разложение для выявления латентных семантических структур. Мы также экспериментируем с NMF (Non-negative Matrix Factorization), который часто показывает хорошие результаты для тематического моделирования. Сравнение моделей тематического моделирования (LDA vs NMF) – это отдельная задача, которую мы часто выполняем, чтобы выбрать наиболее подходящий подход для конкретного датасета.

Для наглядности сравнения основных моделей тематического моделирования мы подготовили следующую таблицу:

| Модель | Описание | Основные преимущества | Основные недостатки | Типичные сценарии использования |

|---|---|---|---|---|

| LDA (Latent Dirichlet Allocation) | Вероятностная модель, предполагающая, что документы состоят из смесей тем, а темы — из смесей слов. | Хорошо интерпретируемые темы, гибкость в определении количества тем. | Чувствительна к начальным условиям, требует настройки гиперпараметров. | Анализ новостных статей, научных публикаций, отзывов. |

| LSI (Latent Semantic Indexing) | Использует сингулярное разложение (SVD) для выявления латентных семантических структур в документах. | Простота реализации, высокая скорость для небольших корпусов. | Темы менее интерпретируемы, проблемы с добавлением новых документов. | Поиск информации, кластеризация документов. |

| NMF (Non-negative Matrix Factorization) | Разлагает матрицу документ-слово на две матрицы с неотрицательными значениями, представляющими темы и их распределение в документах. | Часто даёт более чёткие и интерпретируемые темы, чем LSI. | Чувствительна к предобработке, может требовать настройки количества тем. | Анализ текстов отзывов, блогов, выявление скрытых тем. |

Анализ Тональности: Понимаем Настроения

В современном мире, где социальные сети и онлайн-отзывы играют огромную роль, способность понимать эмоциональную окраску текста становится бесценной. Анализ тональности (Sentiment Analysis) позволяет нам определить, выражает ли текст позитивное, негативное или нейтральное отношение. Мы используем его для анализа отзывов клиентов, сообщений в социальных сетях (Twitter/Reddit), финансовых новостей и даже политических постов.

Для простых, но эффективных решений мы часто используем библиотеку VADER (Valence Aware Dictionary and sEntiment Reasoner), которая отлично подходит для анализа тональности текстов из социальных сетей благодаря своему словарю, учитывающему сленг и эмодзи. Другой полезный инструмент – TextBlob, который предоставляет простой API для выполнения анализа тональности. Однако, мы всегда помним, что TextBlob имеет свои ограничения, особенно для сложных и контекстно-зависимых текстов, и в таких случаях мы прибегаем к более продвинутым методам.

"Язык – это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Когда требуется более глубокий и точный анализ, мы переходим к моделям, основанным на глубоком обучении, в т.ч. к Sentiment Transformers, которые могут улавливать тонкие нюансы и сарказм. Анализ тональности финансовых новостей, например, требует специализированных моделей, обученных на финансовых текстах, чтобы точно интерпретировать специфическую лексику и контекст. Мы также активно работаем над разработкой инструментов для анализа тональности с учётом сарказма, что является одной из наиболее сложных задач в этой области.

Извлечение Ключевых Фраз и Суммаризация

В мире перегруженном информацией, способность быстро извлекать суть из больших объёмов текста является крайне ценной. Мы часто сталкиваемся с задачами, где нужно быстро получить ключевые идеи документа или сгенерировать его краткое изложение.

Для извлечения ключевых фраз мы используем алгоритмы, такие как RAKE (Rapid Automatic Keyword Extraction) и TextRank. RAKE основан на частотности и ко-однородности слов, а TextRank – на алгоритме PageRank, адаптированном для текстовых графов, где узлами являются слова или предложения, а рёбрами – их связи. Эти методы помогают нам автоматически определять наиболее важные термины и концепции в тексте.

Суммаризация текста – это процесс создания краткого, но информативного изложения документа или группы документов. Мы различаем два основных подхода:

- Экстрактивная суммаризация: Мы выбираем наиболее важные предложения из исходного текста и объединяем их в краткое изложение. TextRank часто используется для этой цели.

- Абстрактивная суммаризация: Мы генерируем новое изложение, которое может содержать слова и фразы, не присутствующие в оригинальном тексте. Это более сложная задача, требующая глубокого понимания текста и часто реализуемая с использованием трансформерных моделей.

Разработка системы суммаризации текста, особенно абстрактивной, является одной из наших приоритетных задач, поскольку она позволяет создавать по-настоящему человекоподобные резюме.

Современные Вызовы и Решения: Трансформеры и Глубокое Обучение

Последние годы принесли революционные изменения в мир NLP благодаря появлению архитектур трансформеров и развитию глубокого обучения. Эти технологии кардинально изменили наш подход к решению самых сложных задач, позволив нам достигать беспрецедентной точности и гибкости. Мы активно интегрируем эти инновации в наши проекты, открывая новые горизонты в обработке естественного языка.

Это направление требует глубоких знаний в области машинного обучения и нейронных сетей, но результаты, которые мы получаем, оправдывают все усилия. От создания моделей, способных генерировать текст, до разработки систем, отвечающих на сложные вопросы, трансформеры и глубокое обучение стали нашими основными инструментами для решения передовых задач NLP.

Революция Трансформеров (Hugging Face, BERT, GPT)

Появление архитектуры трансформеров стало, пожалуй, самым значительным прорывом в NLP за последние десятилетия. Они позволили моделям эффективно обрабатывать длинные последовательности текста, улавливая сложные зависимости между словами на больших расстояниях. Благодаря механизму внимания (attention mechanism), трансформеры могут "взвешивать" важность различных частей входного текста при обработке каждого слова.

Мы активно используем библиотеку Hugging Face Transformers, которая стала стандартом де-факто для работы с предварительно обученными трансформерными моделями. Она предоставляет доступ к огромному количеству моделей, таких как BERT (Bidirectional Encoder Representations from Transformers), GPT (Generative Pre-trained Transformer) и многим другим. BERT, например, превосходно справляется с задачами классификации текста, NER, вопросно-ответными системами благодаря своей способности понимать контекст слова с обеих сторон. GPT-модели, в свою очередь, стали эталоном для генерации текста, диалогов и даже кода, демонстрируя удивительную связность и креативность. Мы часто выполняем тонкую настройку (Fine-tuning) предварительно обученных моделей под наши специфические задачи, что позволяет нам достигать высокой производительности с относительно небольшими датасетами.

Нейросети для NLP: PyTorch/TensorFlow и LSTM

До появления трансформеров, рекуррентные нейронные сети (RNN) и их разновидности, такие как LSTM (Long Short-Term Memory), были доминирующей архитектурой для многих задач NLP, связанных с последовательностями. LSTM-сети способны "помнить" информацию на протяжении длительных периодов, что делает их подходящими для моделирования языковых зависимостей.

Мы используем фреймворки глубокого обучения, такие как PyTorch и TensorFlow (включая высокоуровневый API Keras), для создания и обучения наших собственных нейросетей для NLP. Это позволяет нам разрабатывать кастомные архитектуры, оптимизированные под уникальные требования наших проектов. Например, для задач классификации текста или анализа временных рядов в текстовых данных LSTM-сети всё ещё могут быть эффективным решением, особенно когда у нас нет доступа к обширным вычислительным ресурсам для работы с большими трансформерными моделями. Использование GPU-ускорения является для нас стандартом при обучении этих моделей, значительно сокращая время разработки.

Создание Продвинутых Систем: QA, Машинный Перевод, Чат-боты

Благодаря трансформерам и глубокому обучению, мы можем разрабатывать по-настоящему интеллектуальные системы:

- Вопросно-ответные системы (QA): Эти системы способны понимать вопросы, заданные на естественном языке, и находить на них ответы в предоставленном тексте или базе знаний. Мы используем BERT-подобные модели для чтения текста и извлечения точных ответов.

- Машинный перевод: С появлением трансформеров, качество машинного перевода достигло нового уровня. Мы можем разрабатывать системы для автоматического перевода текстов, включая узкоспециализированные домены, и даже систем для перевода сленга или работы с многоязычными текстовыми корпусами, используя такие библиотеки как Polyglot.

- Чат-боты: Разработка чат-ботов на Python с использованием фреймворка Rasa позволяет нам создавать диалоговые системы, способные понимать намерения пользователя, извлекать сущности и вести осмысленные диалоги. Мы также используем трансформерные модели для генерации диалогов, делая взаимодействие с ботами более естественным.

Разработка моделей для выявления связей между сущностями (Relation Extraction) также является важным направлением, позволяющим нам строить графы знаний и обогащать информацию, извлечённую из текста. Эти продвинутые системы открывают огромные возможности для автоматизации и улучшения пользовательского опыта в самых разных сферах.

Инструменты и Практики: Строим Наши NLP-Решения

Помимо фундаментальных концепций и передовых моделей, существует целый набор инструментов и практик, которые мы ежедневно используем для построения полноценных NLP-решений. Это как иметь не только чертежи и материалы, но и полный ящик инструментов для строительства. От базовых библиотек для машинного обучения до специализированных инструментов для работы с различными форматами данных и визуализации – каждый элемент играет свою роль.

Мы всегда стремимся к созданию надёжных, эффективных и масштабируемых систем. В этом разделе мы поделимся нашим опытом использования различных библиотек и методологий, которые помогают нам достигать этих целей, а также рассмотрим, как мы подходим к работе с разнообразными и порой "грязными" текстовыми данными.

Scikit-learn: Наш Выбор для Классификации Текстов

Когда дело доходит до классификации текстов, библиотека Scikit-learn является нашим незаменимым помощником. Она предоставляет широкий спектр алгоритмов машинного обучения, которые легко интегрируются с нашими векторизаторами текста (CountVectorizer, TfidfVectorizer). Мы применяем её для таких задач, как категоризация статей, определение спама, классификация отзывов по категориям и многое другое.

Мы часто используем такие классификаторы, как Support Vector Machines (SVM), Наивный Байесовский классификатор, Логистическая Регрессия и другие. Scikit-learn позволяет нам быстро экспериментировать с различными моделями, оценивать их производительность (Precision, Recall, F1-score) и выбирать наиболее подходящий для конкретной задачи. Мы также используем Scikit-learn для кластеризации текстов, например, с помощью алгоритмов K-Means или DBSCAN, чтобы выявить естественные группы документов без предварительной разметки.

Работа с Разнообразными Источниками: Веб-скрейпинг и PDF

Текстовые данные редко приходят к нам в идеальном формате. Часто их нужно извлекать из различных источников. Для веб-скрейпинга текста – то есть извлечения данных с веб-страниц – мы активно используем библиотеку Beautiful Soup. Она позволяет нам парсить HTML и XML документы, находить нужные элементы и извлекать текст, который затем мы можем подавать на вход нашим NLP-пайплайнам.

Для извлечения текста из PDF-документов мы используем библиотеку PyMuPDF (или `fitz`). Она позволяет нам работать с PDF-файлами, извлекать текстовое содержимое, а также изображения и метаданные. Это особенно актуально при анализе юридических документов, научных статей или финансовой отчетности, которые часто распространяются в формате PDF. Мы также разрабатываем инструменты для очистки текста от HTML-тегов и других артефактов, которые могут попасть в текст при извлечении.

Многоязычный NLP и Специфические Задачи

Мы живём в глобальном мире, и часто нам приходится работать с текстами на разных языках. Обработка многоязычных текстовых корпусов представляет собой особый вызов. Для этого мы применяем библиотеку Polyglot, которая предоставляет функциональность для определения языка, токенизации, NER и перевода для множества языков. Stanza также является отличным инструментом для языков с богатой морфологией, предлагая высококачественные модели для русского, немецкого, испанского и многих других языков. Работа с нелатинскими алфавитами в Python NLP – это отдельная область, требующая внимательного подбора инструментов и моделей.

Кроме того, мы решаем специфические задачи:

- Анализ стилистики текстов: Определение авторского почерка, например, с использованием методов машинного обучения.

- Работа с эмодзи и сленгом: Разработка инструментов для нормализации сленга и корректной интерпретации эмодзи в текстах социальных сетей.

- Проблемы обработки неполных и ошибочных данных: Разработка инструментов для проверки грамматики и орфографии, используем библиотеку Jellyfish для сравнения строк и поиска опечаток.

- Создание словарей и тезаурусов: Для обогащения наших моделей и лучшего понимания специфической лексики.

- Разработка систем обнаружения плагиата: С использованием методов сравнения строк и векторизации документов.

- Разработка инструмента для проверки фактов (Fact-Checking): Сложная, но перспективная задача, требующая интеграции с базами знаний.

Визуализация и Анализ Больших Данных

Визуализация является ключевым элементом для понимания наших текстовых данных и результатов NLP. Мы используем различные инструменты для наглядного представления:

- Облака слов (Word Clouds): Простой, но эффективный способ показать наиболее часто встречающиеся слова в тексте.

- Тепловые карты (Heatmaps): Для визуализации корреляций между словами, темами или документами.

- Графики распределения: Для анализа частотности слов, n-грамм, длин предложений и других метрик.

Библиотека Sweetviz также может быть полезна для быстрого автоматического анализа и визуализации текстовых данных, предоставляя общую статистику и паттерны.

Когда мы сталкиваемся с большими текстовыми массивами (Big Data NLP), мы используем оптимизированные под производительность библиотеки, такие как Gensim, который хорошо работает с большими корпусами данных, не помещающимися в оперативную память. Мы также рассматриваем распределённые вычисления и облачные платформы для обработки таких объёмов. Обработка текста в режиме реального времени (Streaming NLP) требует особых подходов к проектированию систем, минимизации задержек и эффективному управлению ресурсами.

Наше путешествие по миру Обработки Естественного Языка с Python подошло к концу, но лишь на страницах этой статьи. В реальной жизни это бесконечный процесс изучения, экспериментов и открытий. Мы увидели, как из хаотичного потока букв и слов мы можем извлекать структурированные данные, выявлять скрытые закономерности, понимать настроения и даже строить интеллектуальные системы, способные общаться на человеческом языке.

От базовой токенизации и стемминга с NLTK до революционных трансформеров от Hugging Face, от простого анализа тональности с TextBlob до сложных систем вопросно-ответных систем и машинного перевода – Python предоставляет нам невероятно мощный и гибкий инструментарий. Мы надеемся, что наш опыт и знания, которыми мы поделились, вдохновят вас на собственные исследования и помогут вам освоить этот захватывающий мир. Помните, что каждый текст – это не просто информация, это возможность для понимания, и NLP даёт нам ключ к этому пониманию. Удачи вам в ваших будущих проектах!

Подробнее

| Токенизация NLTK | Лемматизация SpaCy | BERT NER | LDA Gensim | Анализ тональности Python |

| Word2Vec Gensim | Трансформеры Hugging Face | Scikit-learn классификация текста | Чат-боты Rasa | TextRank суммаризация |