- Раскрываем Тайны Текста: Наш Путь в Мир Обработки Естественного Языка на Python

- Начинаем с Азов: Предобработка Текста – Фундамент Всех Задач NLP

- Стемминг и Лемматизация: Укрощаем Многообразие Слов

- Превращаем Слова в Числа: Векторизация Текста

- Традиционные Методы: CountVectorizer и TF-IDF

- Революция в Представлении Слов: Word Embeddings (Word2Vec, GloVe, FastText)

- Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

- Распознавание Сущностей: NER и его Применение

- Выявление Скрытых Темы: Тематическое Моделирование

- Понимаем Эмоции: Анализ Тональности (Sentiment Analysis)

- Классификация и Категоризация Текстов: Сортировка Информации

- Мощь Трансформеров: Новый Уровень NLP

- Извлечение Информации и Знаний

- Ключевые Фразы и Суммарный Обзор

- Работа с Различными Источниками Текста

- Многоязычность и Специализированные Задачи

- Анализ Мультиязычных Текстов

- Продвинутые Приложения NLP

- Оценка, Визуализация и Оптимизация

Раскрываем Тайны Текста: Наш Путь в Мир Обработки Естественного Языка на Python

Приветствуем, дорогие читатели! Сегодня мы хотим пригласить вас в увлекательное путешествие по безграничным просторам обработки естественного языка, или NLP (Natural Language Processing), с нашим верным спутником — языком программирования Python. Как опытные исследователи и практики, мы с уверенностью можем сказать: этот мир полон удивительных открытий и невероятных возможностей, способных преобразить наше взаимодействие с информацией. Мы не просто расскажем о теории, но и поделимся собственным опытом, покажем, какие инструменты стали нашими незаменимыми помощниками и как они позволяют нам "понять" текст на совершенно новом уровне.

В эпоху, когда текст является одним из главных источников информации — будь то посты в социальных сетях, отзывы клиентов, научные статьи или юридические документы — умение извлекать из него смысл становится критически важным. Мы наблюдали, как компании трансформируют свой подход к маркетингу и клиентскому сервису благодаря NLP, как исследователи находят новые закономерности в огромных массивах данных, и как обычные люди получают более персонализированный контент. Именно поэтому мы считаем, что каждый, кто работает с данными, должен хотя бы базово разбираться в этой области. Мы пройдемся от самых азов до продвинутых концепций, вооружив вас знаниями и вдохновением для собственных экспериментов;

Начинаем с Азов: Предобработка Текста – Фундамент Всех Задач NLP

Любое серьезное погружение в мир NLP начинается с предобработки текста. Мы всегда говорим нашим ученикам: "Качество вашего анализа напрямую зависит от качества ваших исходных данных". И это не пустые слова. Представьте, что вы пытаетесь приготовить изысканное блюдо из немытых, неочищенных ингредиентов. Результат будет, мягко говоря, неудовлетворительным. То же самое и с текстом. Сырой, необработанный текст полон шума, который может сбить с толку даже самые продвинутые алгоритмы. Именно поэтому мы уделяем предобработке столько внимания, используя целый арсенал инструментов.

Один из первых шагов, который мы осваиваем, это токенизация. По сути, это процесс разбиения текста на более мелкие, значимые единицы – токены. Это могут быть слова, предложения или даже символы. В NLTK, одной из старейших и наиболее уважаемых библиотек, мы находим удобные функции для этого. Например, `word_tokenize` и `sent_tokenize` позволяют нам быстро и эффективно разделять текст. Но мир текста не всегда так прост: пунктуация, специальные символы, смайлики – все это требует внимательного подхода. Именно здесь на помощь приходят регулярные выражения (re). Мы используем их для очистки текста от ненужных элементов, унификации формата и извлечения специфических паттернов. Это как универсальный швейцарский нож для работы с текстом, позволяющий нам контролировать каждый аспект процесса очистки.

Стемминг и Лемматизация: Укрощаем Многообразие Слов

После токенизации мы часто сталкиваемся с проблемой: одно и то же слово может иметь множество форм. Например, "бежать", "бежит", "бежал" – все они относятся к одному корню. Чтобы алгоритмы могли распознавать эти слова как одно целое, нам нужно привести их к базовой форме. Здесь на сцену выходят стемминг и лемматизация. Стемминг – это более грубый процесс, который просто отсекает окончания, чтобы получить "корень" слова. Например, "running" может превратиться в "runn". NLTK предлагает различные стеммеры, такие как PorterStemmer или SnowballStemmer, которые мы активно используем для английского языка.

Однако стемминг не всегда идеален, особенно для языков с богатой морфологией, таких как русский. Иногда он может привести к потере смысла или созданию несуществующих слов. Именно поэтому лемматизация является нашим предпочтительным выбором, когда требуется более высокая точность. Лемматизация приводит слово к его словарной (канонической) форме, учитывая морфологию и часть речи. Например, "бегущий" превратится в "бежать". Для этого мы часто используем библиотеку spaCy, которая славится своей эффективностью и точностью, а также Stanza, особенно для языков с богатой морфологией. Эти инструменты позволяют нам значительно улучшить качество дальнейшего анализа, снижая "размерность" словаря и помогая выявлять истинные связи между словами.

Превращаем Слова в Числа: Векторизация Текста

Компьютеры, как мы знаем, не понимают человеческий язык напрямую. Для них текст – это просто последовательность символов. Чтобы мы могли применять к тексту математические модели и алгоритмы машинного обучения, нам необходимо преобразовать слова и документы в числовые векторы. Этот процесс называется векторизацией текста, и он является одним из краеугольных камней современного NLP. Мы используем различные подходы, каждый из которых имеет свои преимущества в зависимости от задачи.

Традиционные Методы: CountVectorizer и TF-IDF

Наш путь в векторизации часто начинается с простых, но мощных методов, таких как CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn. CountVectorizer создает вектор, где каждая позиция соответствует слову из всего корпуса текста, а значение – это количество раз, которое это слово встречается в документе. Это интуитивно понятно, но имеет свои недостатки: оно не учитывает важность слов. Например, очень частое слово "и" будет иметь высокий счет, хотя его информационная ценность низка.

Здесь на помощь приходит TF-IDF (Term Frequency-Inverse Document Frequency). Мы используем его для взвешивания слов: чем чаще слово встречается в данном документе (TF), но реже во всем корпусе документов (IDF), тем выше его вес. Это позволяет нам выделить слова, которые действительно характеризуют конкретный документ. Мы часто применяем TF-IDF для задач классификации текстов, когда нужно определить категорию документа на основе его содержания. Например, в анализе отзывов клиентов TF-IDF помогает нам понять, какие уникальные слова используются для описания конкретного продукта.

Революция в Представлении Слов: Word Embeddings (Word2Vec, GloVe, FastText)

Традиционные методы векторизации рассматривают слова как независимые сущности. Однако мы знаем, что слова не существуют в вакууме; они имеют смысл в контексте других слов; Революцию в этом понимании произвели Word Embeddings – плотные векторные представления слов, которые улавливают их семантические и синтаксические отношения. Мы были свидетелями того, как эти методы изменили ландшафт NLP;

Word2Vec, разработанный Google, стал одним из первых и наиболее влиятельных подходов. Мы используем его, чтобы получить векторы слов таким образом, что слова с похожим значением оказываются близко друг к другу в многомерном пространстве. Есть две основные архитектуры: Skip-gram (предсказывает контекст по слову) и CBOW (Continuous Bag of Words) (предсказывает слово по контексту). Библиотека Gensim является нашим основным инструментом для работы с Word2Vec, позволяя нам легко обучать собственные модели на больших корпусах текста.

Помимо Word2Vec, мы активно работаем с GloVe (Global Vectors for Word Representation), который комбинирует преимущества матричной факторизации и контекстного окна. Он также строит векторные представления слов, но делает это, используя глобальную статистику со-встречаемости слов. А для работы с редкими словами и морфологически сложными языками мы обращаемся к FastText от Facebook. Он расширяет идеи Word2Vec, представляя слова как сумму n-грамм символов, что позволяет ему создавать качественные векторы даже для слов, которые не встречались в обучающем корпусе.

Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

Когда нам нужно получить векторное представление не отдельного слова, а целого предложения или документа, мы используем Doc2Vec (также известный как Paragraph Vector). Это расширение Word2Vec, которое позволяет нам получать плотные векторы для произвольных фрагментов текста. Gensim также предоставляет отличную реализацию Doc2Vec, и мы успешно применяли его для задач поиска похожих документов или кластеризации текстов.

Современные прорывы в NLP привели к появлению Sentence Transformers – моделей, специально обученных для получения высококачественных эмбеддингов предложений и документов. Они основаны на трансформерных архитектурах и позволяют нам сравнивать семантическое сходство текстов с беспрецедентной точностью. Мы используем их для поиска семантически похожих вопросов в FAQ, определения дубликатов статей или даже для построения систем суммаризации текста.

Распознавание Сущностей: NER и его Применение

Одной из наиболее практичных и часто используемых задач в NLP является Распознавание Именованных Сущностей (NER ⎯ Named Entity Recognition). Мы часто объясняем NER как способность компьютера "вычленять" из текста конкретные, предопределенные типы сущностей, такие как имена людей, названия организаций, географические места, даты, денежные суммы и т.д.. Это невероятно мощный инструмент, который лежит в основе многих интеллектуальных систем.

Для быстрого и эффективного NER мы регулярно используем spaCy. Эта библиотека поставляется с предварительно обученными моделями для различных языков, которые позволяют нам моментально извлекать сущности без необходимости обучать что-либо с нуля. Мы применяем spaCy для анализа новостных статей, чтобы быстро определить, о каких людях, компаниях или местах идет речь. Это значительно ускоряет процесс сбора и категоризации информации.

Однако, когда требуются более продвинутые возможности или работа с узкоспециализированными сущностями, мы обращаемся к другим инструментам. Например, CRF (Conditional Random Fields) долгое время был популярным алгоритмом для NER, особенно когда данных для обучения было не так много. В последние годы, с появлением глубокого обучения, мы активно используем библиотеки вроде Flair. Flair предлагает state-of-the-art модели для NER, основанные на рекуррентных нейронных сетях и контекстных эмбеддингах, обеспечивая высокую точность даже для сложных случаев. И, конечно, современные Трансформеры (Hugging Face), о которых мы поговорим позже, также предоставляют мощные возможности для NER, часто превосходящие традиционные подходы.

"Язык – это мощный инструмент. Он может быть использован как для строительства мостов, так и для разрушения стен."

— Барак Обама

Выявление Скрытых Темы: Тематическое Моделирование

Представьте, что у вас есть огромный архив документов – тысячи или даже миллионы текстов. Как понять, о чем в них говорится? Как выделить основные темы, которые пронизывают этот массив информации, не читая каждый документ вручную? Именно для таких задач мы используем тематическое моделирование. Это набор статистических методов, которые позволяют нам обнаруживать абстрактные "темы", присутствующие в коллекции документов. Мы можем представить это как "скрытые измерения", которые формируют содержание наших текстов.

Наиболее популярный алгоритм, который мы используем для тематического моделирования, это LDA (Latent Dirichlet Allocation). Gensim предоставляет отличную и оптимизированную реализацию LDA. Мы часто применяем LDA для анализа больших массивов текстовых отзывов, статей или новостных лент. Он помогает нам выявить, какие темы обсуждаются чаще всего, как они распределены по документам, и какие слова наиболее характерны для каждой темы. Например, в отзывах о ресторанах LDA может выделить темы, связанные с "качеством еды", "обслуживанием", "атмосферой" или "ценой".

Помимо LDA, мы также работаем с LSI (Latent Semantic Indexing) и NMF (Non-negative Matrix Factorization). LSI – это более старый метод, основанный на сингулярном разложении матриц, который также помогает нам находить скрытые семантические структуры. NMF, в свою очередь, является мощным методом матричной факторизации, который особенно хорошо работает, когда мы хотим получить более интерпретируемые темы, поскольку он накладывает ограничение на неотрицательность всех компонент. Мы часто проводим сравнение моделей тематического моделирования (LDA vs NMF), чтобы выбрать наиболее подходящий подход для конкретной задачи, оценивая качество и интерпретируемость полученных тем.

Понимаем Эмоции: Анализ Тональности (Sentiment Analysis)

В современном мире, где социальные сети и онлайн-отзывы играют огромную роль, способность автоматически определять эмоциональную окраску текста – его тональность – стала бесценной. Анализ тональности (Sentiment Analysis) позволяет нам понять, является ли сообщение позитивным, негативным или нейтральным. Это помогает нам отслеживать общественное мнение о продукте или бренде, анализировать отзывы клиентов и даже оценивать настроение в финансовых новостях.

Для простых и быстрых задач анализа тональности мы часто используем VADER (Valence Aware Dictionary and sEntiment Reasoner), который входит в NLTK. VADER специально разработан для анализа тональности в социальных сетях и отлично справляется с сленгом, смайликами и даже сарказмом. Он не требует обучения и сразу дает достаточно точные результаты. Ещё один наш помощник – TextBlob, который предлагает простой и интуитивно понятный API для анализа тональности, а также базовые функции для предобработки текста.

Однако, когда дело доходит до более сложных случаев, таких как анализ тональности с учетом сарказма или тонких нюансов эмоций, мы переходим к более продвинутым моделям, часто основанным на глубоком обучении и трансформерах. Мы обучаем собственные модели на размеченных данных или используем предварительно обученные модели из экосистемы Hugging Face. Анализ тональности в социальных сетях (Twitter/Reddit) с учетом контекста и динамики становится возможным благодаря этим мощным инструментам. Мы также применяем его для анализа стилистики текстов (авторский почерк), чтобы понять не только что сказано, но и как это сказано, выявляя эмоциональные паттерны, присущие конкретному автору или группе.

Классификация и Категоризация Текстов: Сортировка Информации

Одна из наиболее фундаментальных задач в NLP – это классификация текстов. Будь то автоматическая категоризация новостных статей, фильтрация спама, распределение клиентских запросов по отделам или определение тематики юридических документов, классификация позволяет нам эффективно организовывать и управлять огромными объемами текстовой информации. Мы применяем различные методы, от классических до самых современных.

Начальный этап часто включает использование библиотеки Scikit-learn, которая предоставляет широкий спектр алгоритмов машинного обучения. Мы работаем с SVM (Support Vector Machines) и наивным байесовским классификатором, которые, несмотря на свою относительную простоту, показывают отличные результаты на многих задачах. Для этого мы сначала векторизуем тексты с помощью TF-IDF или других методов, а затем подаем эти числовые представления на вход классификаторам. Мы постоянно сравниваем методы машинного обучения для NLP, чтобы выбрать наиболее эффективный для каждой конкретной задачи, будь то анализ отзывов о продуктах по категориям или автоматическое тегирование контента.

С появлением глубокого обучения горизонты классификации значительно расширились. Мы активно используем PyTorch/TensorFlow для создания нейросетей NLP, в частности, LSTM-сети, которые хорошо подходят для обработки последовательных данных, таких как текст. А в последнее время, конечно, BERT для задач классификации стал нашим фаворитом. Трансформерные модели, благодаря своей способности улавливать контекст, демонстрируют выдающуюся производительность. Мы часто проводим тонкую настройку (Fine-tuning) предварительно обученных моделей, чтобы адаптировать их под наши специфические задачи и получить максимально точные результаты.

Мощь Трансформеров: Новый Уровень NLP

Мы не можем говорить о современном NLP, не упомянув трансформерные архитектуры. Это настоящий прорыв, который изменил всю индустрию. Библиотека Hugging Face Transformers стала нашим незаменимым инструментом для работы с этими моделями. Она предоставляет доступ к сотням предварительно обученных моделей, таких как BERT, GPT, RoBERTa, T5 и многим другим, которые позволяют нам решать самые сложные задачи NLP с беспрецедентной эффективностью.

Трансформеры великолепны в своей способности улавливать долгосрочные зависимости в тексте, что делает их идеальными для таких задач, как распознавание именованных сущностей (NER), анализ тональности, машинный перевод и суммаризация текста. Мы используем их для генерации текста (GPT), создавая связные и осмысленные тексты на основе заданных начальных условий. Это открывает двери для автоматического написания статей, создания креативного контента и даже генерации кода. Мы также активно применяем Transformer-модели для генерации диалогов, что является основой для разработки продвинутых чат-ботов и вопросно-ответных систем.

Извлечение Информации и Знаний

Помимо понимания общего смысла текста, нам часто требуется извлекать из него конкретные факты и детали. Это критически важно для создания баз знаний, автоматического заполнения форм или построения систем поддержки принятия решений. Мы используем целый арсенал инструментов для этой цели.

Ключевые Фразы и Суммарный Обзор

Когда нужно быстро понять суть длинного документа, мы обращаемся к извлечению ключевых фраз и суммаризации текста. Для извлечения ключевых слов мы часто используем алгоритм RAKE (Rapid Automatic Keyword Extraction) или более продвинутую библиотеку TextRank, которая также может быть применена для извлечения ключевых предложений. TextRank основан на алгоритме PageRank и позволяет нам выделить наиболее важные слова и предложения в тексте, которые наилучшим образом отражают его основное содержание.

Суммаризация текста – это ещё одна область, где NLP демонстрирует свою мощь. Мы различаем два основных подхода: экстрактивную суммаризацию, которая выбирает наиболее важные предложения из исходного текста, и абстрактивную суммаризацию, которая генерирует новые предложения, передающие смысл оригинала. Для экстрактивной суммаризации TextRank является отличным инструментом. Для абстрактивной, более сложной задачи, мы используем Transformer-модели для суммаризации, такие как T5 или BART, которые способны генерировать высококачественные краткие обзоры.

Работа с Различными Источниками Текста

Текст не всегда находится в удобном для обработки формате. Он может быть на веб-страницах, в PDF-документах или даже в аудиозаписях. Мы разработали методы для работы с этими вызовами:

- Веб-скрейпинг текста: Beautiful Soup: Для извлечения текста с веб-страниц мы активно используем библиотеку Beautiful Soup. Она позволяет нам парсить HTML и XML документы, находить нужные элементы и извлекать чистый текст, удаляя HTML-теги.

- Извлечение текста из PDF: PyMuPDF: PDF-документы – это отдельная история. Мы используем библиотеку PyMuPDF для эффективного извлечения текста, а иногда и изображений, из PDF-файлов. Это критически важно для анализа юридических документов, научных статей или финансовых отчетов, которые часто представлены в этом формате.

- Распознавание речи (Speech-to-Text): Gentle: Хотя это и не чисто текстовая задача, для работы с аудиоданными мы используем такие инструменты, как Gentle, который помогает нам преобразовывать речь в текст, а затем применять к нему все наши NLP-инструменты.

Многоязычность и Специализированные Задачи

Мир не ограничивается английским языком, и мы это прекрасно понимаем. Работа с многоязычными текстовыми корпусами ставит свои задачи, но современные библиотеки предоставляют нам мощные инструменты для их решения.

Анализ Мультиязычных Текстов

- Polyglot: Для работы с редкими языками и мультиязычности мы используем библиотеку Polyglot, которая предоставляет функциональность для токенизации, NER, анализа тональности и определения языка для большого количества языков;

- Stanza для языков с богатой морфологией: Как мы уже упоминали, Stanza от Stanford NLP – это отличный выбор для языков со сложной морфологией, таких как русский, позволяя нам выполнять продвинутую лемматизацию и синтаксический парсинг.

- Машинный перевод: Разработка систем машинного перевода на Python, особенно с использованием трансформерных моделей, позволяет нам преодолевать языковые барьеры и обрабатывать тексты на разных языках, переводя их на целевой язык для дальнейшего анализа.

Продвинутые Приложения NLP

Наш опыт также включает разработку более сложных и специализированных систем, которые демонстрируют истинный потенциал NLP:

- Разработка систем вопросно-ответных систем (QA): Мы создаем системы, которые могут отвечать на вопросы, извлекая информацию из больших корпусов документов. Трансформеры здесь незаменимы.

- Разработка чат-ботов на Python (Rasa framework): Для интерактивного общения и автоматизации клиентской поддержки мы используем фреймворки, такие как Rasa, которые позволяют нам строить умных чат-ботов с пониманием естественного языка.

- Разработка систем обнаружения плагиата: Сравнивая документы на основе их векторных представлений и используя такие метрики, как сходство косинусов, мы можем эффективно выявлять плагиат. Библиотека Textdistance помогает нам измерять сходство строк и документов.

- Анализ юридических документов: Это очень специфическая область, где точность имеет первостепенное значение. Мы используем NER для извлечения ключевых сущностей (даты, стороны, суммы), классификацию для категоризации документов и суммаризацию для быстрого понимания сути контрактов.

- Разработка инструментов для проверки грамматики и орфографии: Создание таких систем требует глубокого понимания синтаксиса и морфологии, часто с использованием правил, статистических моделей и даже нейросетей.

- Работа с эмодзи и сленгом: В современных текстах, особенно в социальных сетях, эмодзи и сленг несут важную смысловую нагрузку. Мы разрабатываем инструменты для их нормализации и включения в анализ тональности и другие задачи.

Оценка, Визуализация и Оптимизация

Ни один проект NLP не обходится без тщательной оценки результатов и наглядной визуализации. Мы всегда следим за тем, чтобы наши модели были не только эффективными, но и понятными. Для оценки качества NER-моделей и классификаторов мы используем такие метрики, как F1-score, Precision и Recall, которые дают нам полное представление о производительности модели.

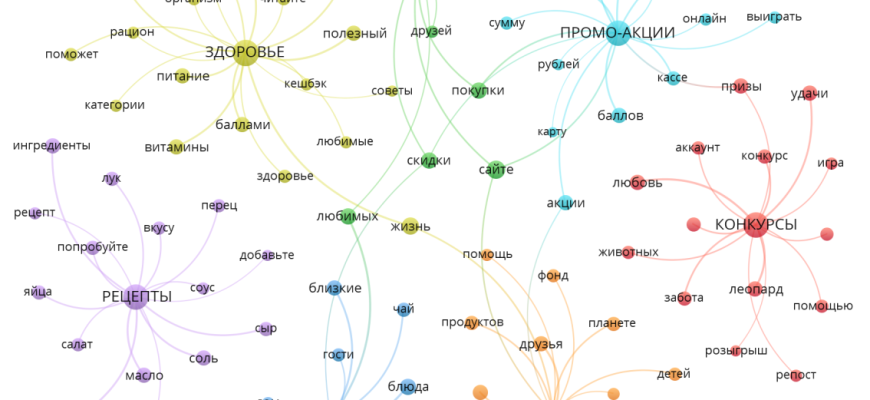

Визуализация данных играет ключевую роль в понимании результатов. Мы создаем Word Clouds для отображения частотности слов, Heatmaps для визуализации матриц сходства или корреляции, а также различные графики для иллюстрации распределения тем или тональности. Инструменты вроде Sweetviz могут помочь в быстром анализе текстовых данных, предоставляя красивые и информативные отчеты.

При работе с большими текстовыми массивами (Big Data NLP) мы сталкиваемся с вызовами производительности. Здесь на помощь приходит обработка текста с использованием GPU-ускорения, особенно для глубоких нейронных сетей, и обработка текста в режиме реального времени (Streaming NLP), когда данные поступают непрерывным потоком. Мы оптимизируем наши пайплайны, чтобы они могли эффективно масштабироваться и справляться с огромными объемами информации.

Итак, мы завершили наше увлекательное путешествие по миру обработки естественного языка на Python. Мы увидели, как от базовой предобработки текста мы переходим к сложным трансформерным моделям, способным генерировать связные тексты и понимать тончайшие нюансы человеческой речи. Этот путь был полон вызовов, но каждый новый инструмент, каждая новая библиотека открывали перед нами новые горизонты. Мы надеемся, что наш опыт и знания вдохновили вас на собственные эксперименты и исследования.

Мир NLP постоянно развивается, и мы убеждены, что впереди нас ждут ещё более захватывающие открытия. Возможности, которые предоставляют нам современные технологии, позволяют нам не просто обрабатывать текст, а по-настоящему взаимодействовать с ним, извлекая знания, понимая эмоции и создавая новые формы коммуникации. Продолжайте учиться, экспериментировать и применять эти мощные инструменты для решения реальных задач. Будущее обработки естественного языка яркое и полное обещаний, и мы рады быть его частью.

На этом статья заканчивается.

Подробнее

| NLTK токенизация | spaCy NER | Gensim LDA | Word2Vec GloVe | Sentiment Analysis VADER |

| Scikit-learn классификация | Трансформеры Hugging Face | Python NLP | Лемматизация стемминг | Векторизация текста |