- Текст как Золотая Жила: Как мы с Python извлекаем смыслы и строим будущее

- Первые шаги: Основы предобработки текста

- Токенизация и стемминг: Разбираем слова по косточкам

- Лемматизация: В поисках истинного корня

- Регулярные выражения: Наш швейцарский нож для текста

- Очистка данных: Превращаем хаос в порядок

- Главные инструменты: Библиотеки для NLP

- NLTK: Классика жанра

- spaCy: Скорость и эффективность

- TextBlob и Pattern: Простота для быстрых задач

- Stanza и Polyglot: Работаем с многообразием языков

- Представление текста: Как машина "понимает" слова?

- Векторизаторы: От слов к числам (CountVectorizer, TfidfVectorizer)

- Word Embeddings: Глубокое понимание смысла (Word2Vec, GloVe, FastText)

- Контекстные встраивания: Когда смысл зависит от окружения (Doc2Vec, Sentence Transformers)

- Анализируем текст: От тона до тем

- Распознавание именованных сущностей (NER): Кто, что, где?

- Анализ тональности: Чувства и эмоции в тексте (VADER)

- Тематическое моделирование: Выявляем скрытые темы (LDA, LSI, NMF)

- Классификация текстов: Распределяем по категориям

- Извлечение ключевых фраз и предложений (RAKE, TextRank)

- Революция Трансформеров: Новая эра NLP

- Hugging Face и предварительно обученные модели (BERT, GPT)

- Тонкая настройка (Fine-tuning): Адаптируем под наши нужды

- Генерация текста и диалогов: Машина пишет сама

- Практические применения и продвинутые задачи

- Веб-скрейпинг и извлечение текста (Beautiful Soup, PyMuPDF)

- Разработка чат-ботов и QA-систем (Rasa)

- Анализ больших текстовых массивов и социальных медиа

- Специализированные задачи: Юриспруденция, медицина, финансы

- Системы суммаризации: Краткость — сестра таланта

- Оценка и сравнение: Как выбрать лучшее?

- Метрики качества (F1-score, Precision, Recall)

- Сравнение моделей и методов: Что эффективнее для нас?

- Будущее NLP: Новые горизонты

Текст как Золотая Жила: Как мы с Python извлекаем смыслы и строим будущее

Привет, друзья! Сегодня мы погрузимся в удивительный мир обработки естественного языка (NLP) с помощью Python. Для нас, как для блогеров, работа с текстом – это не просто рутина, это искусство и наука одновременно. Мы постоянно сталкиваемся с огромными объемами информации: комментарии читателей, аналитические отчеты, новости, научные публикации. Как же не утонуть в этом океане слов, а, наоборот, извлечь из него максимум пользы и ценных инсайтов? Именно здесь на помощь приходит NLP, и поверьте, это не просто модное слово, а мощный набор инструментов, который преображает наш подход к контенту.

За последние годы мы видели, как NLP эволюционировало от простых правил и статистических методов до сложнейших нейронных сетей, способных понимать контекст, генерировать связные тексты и даже отвечать на вопросы, как человек. Наш путь в этом направлении был полон открытий, экспериментов и, конечно же, ошибок, на которых мы учились. Мы хотим поделиться этим опытом с вами, показать, как мы используем Python и его богатейший арсенал библиотек, чтобы не просто читать текст, а по-настоящему его "понимать". Приготовьтесь, нас ждет увлекательное путешествие по миру слов, превращенных в данные, и данных, превращенных в знания. Мы расскажем, как даже самые сложные концепции можно применить на практике, сделав вашу работу с текстом гораздо эффективнее и интереснее.

Мы живем в эпоху информации, где текст является основной формой обмена знаниями, мнениями и идеями. Ежедневно генерируются миллиарды слов в статьях, социальных сетях, электронных письмах, отзывах и базах данных. Для человека обработка такого объема данных – задача непосильная. Именно поэтому мы, как эксперты в области работы с данными, обратились к NLP. Оно позволяет нам автоматизировать анализ, извлечение, классификацию и даже генерацию текста, открывая новые возможности для понимания нашей аудитории, рынка и даже самих себя.

Наш опыт показывает, что применение NLP не ограничивается только техническими задачами. Мы используем его для улучшения качества контента, персонализации рекомендаций, анализа трендов, мониторинга репутации бренда и даже для автоматизации ответов на часто задаваемые вопросы. Это инструмент, который дает нам конкурентное преимущество, позволяя принимать более обоснованные решения, основанные не на интуиции, а на глубоком анализе текстовых данных. Без NLP мы бы просто утонули в море неструктурированной информации, теряя ценные идеи и возможности. Это наш компас в бескрайнем океане слов.

Первые шаги: Основы предобработки текста

Прежде чем машина сможет "понять" наш текст, его необходимо подготовить. Этот этап, известный как предобработка, является одним из самых важных и трудоемких в любом проекте NLP. Представьте, что вы пытаетесь приготовить изысканное блюдо из сырых, неочищенных ингредиентов – результат будет, мягко говоря, непредсказуемым. Точно так же и с текстом: если мы подадим алгоритму "грязные" данные, то и выводы будут ошибочными. Мы научились уделять этому этапу особое внимание, ведь именно здесь закладывается фундамент для всей дальнейшей работы.

Наш опыт показывает, что качество предобработки напрямую влияет на точность и релевантность результатов. Мы начинаем с удаления ненужных символов, пунктуации, HTML-тегов и приведения текста к единому регистру. Затем следуют более сложные, но крайне важные операции, которые позволяют стандартизировать слова и подготовить их к анализу. Давайте рассмотрим ключевые из них, которые мы активно используем в нашей работе.

Токенизация и стемминг: Разбираем слова по косточкам

Первым шагом в любом анализе текста является его разбиение на более мелкие, осмысленные единицы – токены. Обычно это слова или знаки препинания. Например, предложение "Мы любим NLP!" может быть токенизировано как ["Мы", "любим", "NLP", "!"]. Этот процесс, называемый токенизацией, позволяет нам работать с отдельными компонентами текста, а не со сплошным потоком символов. Мы используем для этого основы NLTK, которая предлагает различные токенизаторы, учитывающие особенности разных языков.

После токенизации часто возникает проблема: одно и то же слово может иметь разные формы ("бежать", "бежит", "бежал", "бегущий"). Чтобы алгоритм воспринимал эти слова как одно и то же понятие, мы применяем стемминг. Стемминг – это процесс усечения слова до его основы (стебля) путем отбрасывания окончаний и суффиксов. Например, "running", "ran", "runs" могут быть сведены к "run". Это грубый, но быстрый метод. Наш опыт показывает, что стемминг особенно полезен, когда скорость обработки критична, а небольшая потеря точности не является проблемой. Для русского языка, конечно, он работает менее идеально, чем для английского, но все равно дает хорошие результаты для многих задач.

Пример токенизации и стемминга:

| Оригинальное слово | Токен | Стем |

|---|---|---|

| программирование | программирование | программ |

| программист | программист | программист |

| программировать | программировать | программ |

| программа | программа | программ |

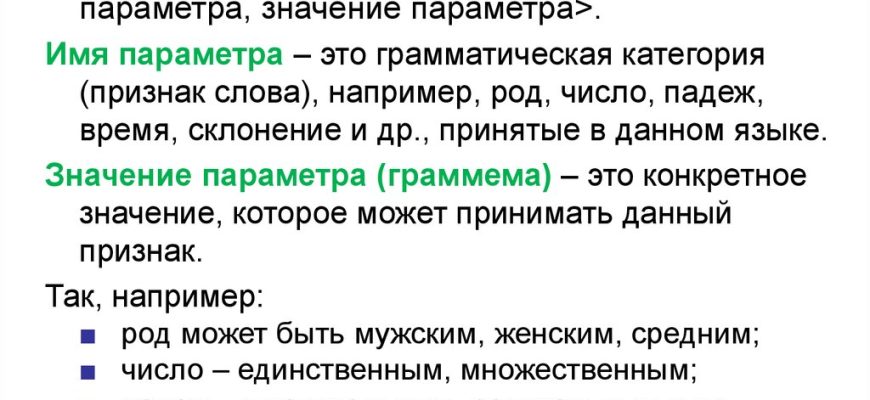

Лемматизация: В поисках истинного корня

В отличие от стемминга, лемматизация – это более сложный и интеллектуальный процесс. Она приводит слово к его базовой словарной форме, называемой леммой, с учетом морфологического анализа и контекста. Например, "бегущий", "бежать", "бежит" будут приведены к лемме "бежать", а не к "бег", как это мог бы сделать стеммер. Это особенно важно для языков с богатой морфологией, таких как русский, где одно слово может иметь десятки различных форм. Продвинутая лемматизация и стемминг позволяют нам получить более точные результаты.

Мы активно используем лемматизацию в задачах, где важна высокая точность, например, при построении поисковых систем или анализе отзывов, где каждое слово может нести важный эмоциональный оттенок. Хотя лемматизация требует больше вычислительных ресурсов и зачастую использует словари и морфологические правила, ее преимущества в качестве анализа неоспоримы. Наш выбор между стеммингом и лемматизацией всегда зависит от конкретной задачи и требований к точности. Для русского языка мы предпочитаем лемматизацию, так как она дает гораздо более адекватные результаты, используя такие библиотеки, как spaCy или Stanza.

Регулярные выражения: Наш швейцарский нож для текста

Предобработка текста часто включает в себя поиск и замену определенных паттернов. Здесь на помощь приходят регулярные выражения (re) – мощный инструмент для работы со строками. С их помощью мы можем легко удалять URL-адреса, хештеги, упоминания пользователей в социальных сетях, приводить к единому формату числа или даты, а также выполнять более сложные операции по очистке и форматированию текста.

Например, мы регулярно используем регулярные выражения для очистки текста от HTML-тегов при веб-скрейпинге, чтобы получить чистый контент без лишней разметки. Также они незаменимы при разработке инструмента для нормализации пунктуации или для удаления стоп-слов, которые, хоть и являются частью языка, но не несут существенной смысловой нагрузки для большинства задач NLP (например, "и", "в", "на"). Наш опыт показывает, что мастерство владения регулярными выражениями значительно ускоряет и упрощает этап предобработки, позволяя нам решать широкий спектр задач по манипуляции текстовыми данными.

Очистка данных: Превращаем хаос в порядок

Помимо токенизации, стемминга и лемматизации, предобработка включает в себя ряд других важных шагов. Мы часто сталкиваемся с проблемами обработки неполных и ошибочных данных, поэтому очистка данных становится критически важной. Это может быть удаление дубликатов, исправление опечаток (используя библиотеки вроде Jellyfish для сравнения строк), работа с разными кодировками, а также нормализация сленга и обработка эмодзи и сленга в современных текстах, что особенно актуально для анализа социальных сетей.

Каждый проект имеет свои уникальные особенности, и мы всегда адаптируем наш пайплайн предобработки под конкретные требования. Иногда приходится создавать словари и тезаурусы, чтобы унифицировать терминологию, или разрабатывать инструменты для проверки грамматики и орфографии, чтобы повысить качество исходного текста. Мы всегда помним, что хорошо подготовленные данные – это 80% успеха в любом проекте NLP, и не жалеем времени на этот этап.

Главные инструменты: Библиотеки для NLP

Python предлагает невероятное количество библиотек для работы с естественным языком, каждая из которых имеет свои сильные стороны и области применения. Мы перепробовали многие из них и выделили несколько ключевых, которые стали нашими надежными спутниками в ежедневной работе. Выбор правильного инструмента зависит от задачи, масштаба данных и требуемой производительности. Давайте посмотрим, какие библиотеки мы ценим больше всего и почему.

Наш опыт показывает, что нет универсального решения, подходящего для всех задач. Поэтому мы часто комбинируем функционал разных библиотек, чтобы достичь наилучших результатов. Главное – понимать, для чего каждая из них предназначена, и уметь эффективно их использовать.

NLTK: Классика жанра

Основы NLTK (Natural Language Toolkit) – это, пожалуй, первая библиотека, с которой мы познакомились, когда начинали свой путь в NLP. Это настоящий ветеран в мире обработки текста на Python, предлагающий обширный набор инструментов для токенизации, стемминга, лемматизации, POS-теггинга (разметки частей речи) и многого другого. NLTK идеально подходит для обучения и экспериментов благодаря своей модульной структуре и большому количеству встроенных корпусов и лексических ресурсов.

Мы используем NLTK для быстрого прототипирования и изучения новых концепций. Например, использование NLTK для POS-теггинга позволяет нам понять грамматическую структуру предложения, что полезно для синтаксического анализа. Однако, для масштабных проектов и задач, требующих высокой производительности, мы часто переходим к более оптимизированным решениям. Несмотря на это, NLTK остается в нашем арсенале как надежный базовый инструмент.

spaCy: Скорость и эффективность

Если NLTK – это академический набор инструментов, то spaCy – это высокопроизводительная библиотека для "продакшн" задач. Мы ценим spaCy за его скорость, эффективность и готовность к работе с большими объемами данных. Она предоставляет готовые, оптимизированные модели для различных языков, включая русский, что делает ее незаменимой для нас.

Использование spaCy для быстрого NER (Распознавание именованных сущностей) – одна из наших любимых функций. Она позволяет нам автоматически выделять имена людей, организаций, географические названия и другие сущности из текста, что критически важно для извлечения информации. Кроме того, spaCy прекрасно справляется с лемматизацией и реализацией синтаксического парсинга с spaCy, что дает нам глубокое понимание структуры предложений. Для нас spaCy – это рабочий конь, который справляется с самыми требовательными задачами.

TextBlob и Pattern: Простота для быстрых задач

Иногда нам не нужны сложные архитектуры и глубокий анализ. Для быстрых и простых задач, таких как базовый анализ тональности или извлечение существительных, мы обращаемся к TextBlob. Это удобная библиотека, построенная поверх NLTK, которая предоставляет простой API для выполнения общих задач NLP. Использование TextBlob для простого NLP позволяет нам быстро получить нужные данные без лишних усилий.

Аналогично, библиотека Pattern предлагает схожий функционал, но с некоторыми дополнительными возможностями, такими как веб-скрейпинг. Использование библиотеки Pattern может быть полезно для быстрого сбора данных и их последующего анализа. Однако, как мы обнаружили, библиотека TextBlob: ограничения и альтернативы существуют, и для более серьезных проектов ее возможностей может не хватить. Мы используем эти библиотеки как "легкие" инструменты для экспресс-анализа или демонстрации концепций.

Stanza и Polyglot: Работаем с многообразием языков

Мир не ограничивается английским языком, и мы, как блогеры, часто работаем с многоязычным контентом. Здесь на помощь приходят библиотеки, специально разработанные для обработки многоязычных текстовых корпусов. Stanza, разработанная в Стэнфордском университете, – это мощный инструмент, который предоставляет высококачественные модели для десятков языков, включая русский. Использование Stanza для языков с богатой морфологией, таких как русский, позволяет нам выполнять точную лемматизацию, POS-теггинг и синтаксический анализ.

Polyglot – еще одна отличная библиотека для мультиязычного NLP. Она поддерживает большое количество языков и предоставляет функционал для определения языка, токенизации, NER и анализа тональности. Применение библиотеки Polyglot для мультиязычности значительно упрощает работу с глобальным контентом. Наш опыт показывает, что эти библиотеки незаменимы, когда мы анализируем отзывы клиентов из разных стран или отслеживаем мировые новости.

Представление текста: Как машина "понимает" слова?

Текст в его сыром виде – это последовательность символов, которая ничего не говорит компьютеру. Чтобы алгоритмы машинного обучения могли работать с текстом, его необходимо преобразовать в числовой формат. Этот процесс, называемый векторизацией или созданием "встраиваний" (embeddings), является фундаментальным для всего NLP. Мы прошли долгий путь от простых методов подсчета слов до сложных нейросетевых моделей, способных улавливать тончайшие оттенки смысла.

Выбор метода представления текста сильно влияет на результат анализа. Мы всегда стараемся выбрать подход, который наилучшим образом соответствует нашей задаче, будь то классификация, кластеризация или поиск сходства. Давайте рассмотрим основные методы, которые мы активно используем.

Векторизаторы: От слов к числам (CountVectorizer, TfidfVectorizer)

Самые простые, но все еще эффективные методы представления текста основаны на подсчете слов. CountVectorizer из Scikit-learn создает матрицу, где каждая строка соответствует документу, а каждый столбец – уникальному слову (токену) во всем корпусе текстов. Значение в ячейке – это просто количество вхождений слова в документ. Это отличная отправная точка для многих задач.

Однако, мы часто обнаруживаем, что некоторые слова (например, "и", "в", "на") встречаются очень часто, но не несут много информации. Здесь на помощь приходит TfidfVectorizer (Term Frequency-Inverse Document Frequency). Этот метод не только считает частоту слова в документе (TF), но и учитывает его редкость во всем корпусе (IDF). Таким образом, слова, которые часто встречаются в одном документе, но редко в других, получают больший вес. Разработка собственных векторизаторов текста (CountVectorizer, TfidfVectorizer) – это основа для многих наших проектов. Сравнение различных методов векторизации (TF-IDF vs Word2Vec) показывает, что для некоторых задач TF-IDF может быть даже эффективнее из-за своей простоты и интерпретируемости.

Пример TF-IDF (упрощенный):

| Слово | Документ 1 (TF) | Документ 2 (TF) | IDF | TF-IDF (Д1) | TF-IDF (Д2) |

|---|---|---|---|---|---|

| кошка | 2 | 0 | 1.3 | 2.6 | 0 |

| собака | 0 | 1 | 1.3 | 0 | 1.3 |

| и | 3 | 2 | 0.1 | 0.3 | 0.2 |

Word Embeddings: Глубокое понимание смысла (Word2Vec, GloVe, FastText)

Простые векторизаторы не учитывают семантическую связь между словами. То есть, "кошка" и "кот" будут восприниматься как совершенно разные сущности, хотя семантически они очень близки. Здесь на сцену выходят Word Embeddings – плотные векторные представления слов, которые улавливают их семантические и синтаксические отношения. Идея проста: слова, которые часто встречаются в похожих контекстах, имеют схожие векторные представления.

Мы активно используем Word Embeddings: Word2Vec и GloVe с использованием Gensim. Word2Vec, разработанный Google, позволяет обучать векторы слов двумя способами: Skip-gram и CBOW. GloVe (Global Vectors for Word Representation) использует глобальную статистику совместной встречаемости слов. Сравнение моделей Word2Vec (Skip-gram vs CBOW) часто показывает, что Skip-gram лучше справляется с редкими словами, а CBOW быстрее обучается.

Для работы с редкими словами и морфологически богатыми языками мы также используем FastText. Он строит векторы не только для слов, но и для их подслов (символьных n-грамм), что позволяет ему создавать хорошие встраивания даже для слов, которых он "не видел" полностью. Применение FastText для работы с редкими словами значительно расширяет наши возможности, особенно при работе с пользовательским контентом, где много опечаток и неологизмов. Библиотека Gensim – наш основной инструмент для работы с этими моделями.

Контекстные встраивания: Когда смысл зависит от окружения (Doc2Vec, Sentence Transformers)

Word Embeddings прекрасны для слов, но что если нам нужно получить векторное представление целого предложения или документа? Здесь в дело вступают более продвинутые методы, такие как Doc2Vec, который является расширением Word2Vec. Применение Doc2Vec для представления целых документов позволяет нам получать векторные представления для целых текстов, сохраняя при этом их семантическое значение. Это крайне полезно для поиска схожих документов или кластеризации.

Но настоящий прорыв произошел с появлением контекстных встраиваний. В отличие от статических Word Embeddings, где каждое слово имеет один и тот же вектор, независимо от контекста, контекстные модели (например, на основе трансформеров) создают уникальный вектор для слова в каждом конкретном предложении. Векторизация предложений и документов с помощью таких инструментов, как Sentence Transformers, позволяет нам учитывать тончайшие нюансы смысла. Это открывает двери для высокоточного поиска схожести текстов, суммаризации и многих других задач, где контекст играет ключевую роль.

Анализируем текст: От тона до тем

После того как мы подготовили и векторизовали наш текст, начинается самое интересное – его анализ. Это этап, на котором мы извлекаем из данных конкретные знания и инсайты. От определения настроения автора до выявления основных тем в большом корпусе документов – возможности NLP здесь практически безграничны. Мы используем различные методики, каждая из которых заточена под решение определенного круга задач.

Наш опыт показывает, что комбинация различных аналитических методов часто дает более полное и глубокое понимание текста. Мы не просто применяем алгоритмы, а интерпретируем их результаты, чтобы принимать обоснованные решения. Давайте рассмотрим основные аналитические задачи, которые мы решаем с помощью NLP.

Распознавание именованных сущностей (NER): Кто, что, где?

Одной из самых востребованных задач в NLP является Распознавание именованных сущностей (NER). Это процесс автоматического извлечения и классификации сущностей из текста, таких как имена людей (PER), названия организаций (ORG), географические объекты (LOC), даты (DATE) и т.д.. Представьте, что у вас есть тысячи новостных статей, и вам нужно быстро получить список всех упомянутых компаний, персон и мест – NER справляется с этим за считанные секунды.

Мы активно используем использование spaCy для быстрого NER и использование библиотеки Flair для современного NER. Flair, например, предлагает state-of-the-art модели, которые показывают очень высокую точность. NER незаменим для нас при анализе новостей, отслеживании упоминаний бренда или для автоматической категоризации контента. Оценка качества NER-моделей (F1-score, Precision, Recall) – это то, что мы делаем регулярно, чтобы убедиться в эффективности наших систем. Мы даже экспериментируем с применением CRF для распознавания сущностей, чтобы адаптировать модели под специфические доменные задачи.

Анализ тональности: Чувства и эмоции в тексте (VADER)

Как блогеры, мы постоянно отслеживаем, что наша аудитория думает о нашем контенте, продуктах или услугах. Анализ тональности (Sentiment Analysis) позволяет нам автоматически определять эмоциональную окраску текста – является ли он позитивным, негативным или нейтральным. Это мощный инструмент для понимания общественного мнения.

Мы начинали с простых подходов, но быстро перешли к более продвинутым. Анализ тональности (Sentiment Analysis) с VADER (Valence Aware Dictionary and sEntiment Reasoner) – это наш первый шаг для английского языка. VADER – это лексический и основанный на правилах анализатор тональности, который учитывает не только отдельные слова, но и их контекст, усилители, отрицания и пунктуацию.

Для более сложных задач, особенно при анализе тональности сообщений в социальных сетях (Twitter/Reddit) или анализе тональности в социальных медиа с учетом сарказма, мы используем модели на основе машинного обучения и глубокого обучения. Мы анализируем анализ текстов отзывов клиентов, анализ тональности финансовых новостей и даже анализ тональности в постах о политике. Эти инструменты помогают нам не только понять текущие настроения, но и предсказать будущие тренды.

Тематическое моделирование: Выявляем скрытые темы (LDA, LSI, NMF)

Когда у нас есть большой корпус текстов, например, тысячи комментариев или статей, вручную определить основные темы становится невозможно; Тематическое моделирование – это набор алгоритмов, которые позволяют нам автоматически выявлять скрытые темы в коллекции документов. Эти алгоритмы группируют слова, которые часто встречаются вместе, и ассоциируют их с определенной темой.

Мы активно используем библиотека Gensim для тематического моделирования (LDA, LSI). LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing) – это классические и очень мощные методы. LDA предполагает, что каждый документ представляет собой смесь нескольких тем, а каждая тема – смесь слов. LSI использует сингулярное разложение для выявления скрытых семантических структур. Сравнение моделей тематического моделирования (LDA vs NMF) показывает, что NMF (Non-negative Matrix Factorization) также является отличным вариантом, особенно когда требуется лучшая интерпретируемость.

Эти методы позволяют нам анализировать текст для выявления скрытых тем, что особенно ценно при анализе текстов из блогов и форумов или при применении Topic Modeling для анализа отзывов. Мы можем быстро понять, какие вопросы волнуют нашу аудиторию, какие темы наиболее обсуждаемы, и на основе этого формировать нашу контент-стратегию.

"Язык – это лабиринт путей. Вы подходите с одной стороны и знаете, где вы находитесь, но когда вы входите, вы теряетесь."

— Людвиг Витгенштейн

Эта цитата прекрасно отражает сложность и многогранность работы с естественным языком. Мы, погружаясь в этот лабиринт с помощью NLP, стремимся найти в нем структуру и смысл.

Классификация текстов: Распределяем по категориям

Одной из наиболее распространенных задач NLP является классификация текстов. Это процесс присвоения тексту одной или нескольких предопределенных категорий. Например, мы можем классифицировать новостные статьи по темам (спорт, политика, экономика), электронные письма как спам или не спам, или отзывы клиентов как позитивные, негативные или нейтральные.

Мы активно используем применение Scikit-learn для классификации текстов. Scikit-learn предоставляет широкий спектр алгоритмов машинного обучения, таких как SVM (Support Vector Machines), наивный байесовский классификатор, логистическая регрессия и многие другие. Сравнение методов машинного обучения для NLP (SVM, наивный байесовский классификатор) помогает нам выбрать наиболее подходящий алгоритм для конкретной задачи. Мы также экспериментируем с применением классификации текста с использованием PyTorch для построения более сложных нейросетевых моделей.

Для нас классификация текста – это основа для разработки систем автоматической категоризации статей и разработки системы для автоматической категоризации новостей. Это позволяет нам эффективно управлять огромными объемами контента, автоматически тегировать его и предоставлять пользователям релевантную информацию.

Извлечение ключевых фраз и предложений (RAKE, TextRank)

Часто нам нужно быстро понять суть длинного текста, не читая его полностью. Здесь на помощь приходят методы извлечения ключевых фраз и предложений. Вместо того чтобы создавать новые предложения (абстрактивная суммаризация), эти методы выбирают наиболее важные фрагменты из исходного текста (экстрактивная суммаризация).

Мы используем такие алгоритмы, как RAKE (Rapid Automatic Keyword Extraction) для извлечения ключевых слов. Применение RAKE для извлечения ключевых слов позволяет нам быстро получить список наиболее важных терминов в документе. Для извлечения ключевых предложений мы обращаемся к TextRank, который использует алгоритм, похожий на PageRank, для ранжирования предложений по их важности. Использование библиотеки TextRank для извлечения ключевых предложений – это отличный способ получить краткий обзор статьи или документа. Эти инструменты незаменимы для нас при подготовке дайджестов, создании мета-описаний для статей или быстрого анализа больших отчетов.

Революция Трансформеров: Новая эра NLP

Последние годы ознаменовались настоящей революцией в области NLP благодаря появлению архитектуры Трансформеров. Эти модели изменили все, что мы знали о работе с текстом, позволив достичь невиданных ранее результатов во многих задачах. Мы, как и все сообщество NLP, были поражены их возможностями и быстро интегрировали их в наши проекты. Трансформеры позволяют моделям учитывать контекст каждого слова в предложении, что приводит к гораздо более глубокому пониманию языка.

Наш переход к трансформерам был одним из самых значимых событий в нашем пути NLP. Они открыли для нас двери к решению задач, которые ранее казались недостижимыми. Давайте разберемся, как мы используем эти мощные инструменты.

Hugging Face и предварительно обученные модели (BERT, GPT)

Когда мы говорим о трансформерах, невозможно не упомянуть Hugging Face. Эта компания создала невероятную экосистему, которая демократизировала доступ к самым передовым моделям NLP. Их библиотека Transformers позволяет нам легко использовать предварительно обученные модели, такие как BERT (Bidirectional Encoder Representations from Transformers) и GPT (Generative Pre-trained Transformer), для широкого спектра задач. Трансформеры (Hugging Face) для сложных задач NLP стали нашим основным инструментом.

BERT, например, стал золотым стандартом для задач понимания языка, таких как классификация, NER и вопросно-ответные системы. GPT, с другой стороны, специализируется на генерации текста. Мы используем применение BERT для задач классификации и применение BERT для задачи NER, достигая при этом впечатляющей точности. Благодаря Hugging Face, нам не нужно обучать эти огромные модели с нуля – мы можем использовать их готовые версии, что экономит нам огромное количество времени и вычислительных ресурсов.

Тонкая настройка (Fine-tuning): Адаптируем под наши нужды

Предварительно обученные модели трансформеров уже обладают огромными знаниями о языке, но для достижения максимальной производительности в наших специфических задачах мы используем процесс, называемый тонкой настройкой (Fine-tuning). Это означает, что мы берем уже обученную модель и продолжаем ее обучение на небольшом, специализированном наборе данных, который соответствует нашей конкретной задаче.

Тонкая настройка (Fine-tuning) предварительно обученных моделей позволяет нам адаптировать универсальные модели под наш домен, будь то анализ юридических документов, медицинских записей или отзывов о фильмах. Мы используем PyTorch и TensorFlow для этих целей. Применение PyTorch/TensorFlow для создания нейросетей NLP дает нам гибкость в архитектуре и процессе обучения. Fine-tuning позволяет нам получить модели, которые не просто "знают" язык, но и "понимают" специфику нашей предметной области, что дает значительно лучшие результаты.

Генерация текста и диалогов: Машина пишет сама

Одной из самых захватывающих областей применения трансформеров является генерация текста. Модели, такие как GPT (и его многочисленные преемники), способны создавать связные, грамматически правильные и даже креативные тексты на основе заданного начала или темы. Это открывает невероятные возможности для автоматизации создания контента.

Мы экспериментируем с использованием Transformer-моделей для генерации текста (GPT) для создания черновиков статей, генерации идей для заголовков, написания коротких описаний продуктов или даже для использования Transformer-моделей для генерации диалогов в наших чат-ботах. Конечно, сгенерированный текст требует редактуры и проверки на факты, но он значительно ускоряет процесс создания контента. Это как иметь очень талантливого ассистента-копирайтера, который всегда готов предложить новую идею или развить мысль.

Практические применения и продвинутые задачи

Теория без практики мертва. Мы всегда стремимся применять наши знания NLP для решения реальных задач, которые возникают в нашей блогерской деятельности и в проектах наших клиентов. От сбора данных до создания интеллектуальных систем – NLP предоставляет нам инструменты для инноваций. Давайте рассмотрим некоторые из самых интересных и полезных практических применений, которые мы освоили.

Эти задачи часто требуют комбинации различных методов и библиотек, а также глубокого понимания предметной области. Наш подход всегда заключается в итеративном улучшении, тестировании и адаптации решений под конкретные требования.

Веб-скрейпинг и извлечение текста (Beautiful Soup, PyMuPDF)

Для анализа нам часто нужны данные из интернета. Веб-скрейпинг – это процесс автоматического сбора информации с веб-сайтов. Мы используем библиотеку Beautiful Soup для этой цели. Библиотека Beautiful Soup для веб-скрейпинга текста позволяет нам парсить HTML и XML документы, извлекая нужный контент, например, тексты статей, комментарии, заголовки.

Кроме того, мы часто сталкиваемся с информацией, представленной в PDF-файлах. Использование PyMuPDF для извлечения текста из PDF позволяет нам программно извлекать текстовое содержимое из этих документов, что крайне важно для анализа отчетов, научных работ или юридических документов. Затем этот извлеченный текст проходит все стадии предобработки, о которых мы говорили ранее, прежде чем быть поданным нашим NLP-моделям.

Разработка чат-ботов и QA-систем (Rasa)

Взаимодействие с аудиторией – это ключевой аспект нашей работы. Чат-боты и системы вопросно-ответных систем (QA) помогают нам автоматизировать этот процесс, предоставляя мгновенные ответы на вопросы пользователей. Разработка чат-ботов на Python (Rasa framework) стала для нас увлекательным и очень полезным проектом. Rasa – это мощный фреймворк с открытым исходным кодом, который позволяет создавать контекстно-зависимых чат-ботов с возможностями понимания естественного языка (NLU) и управления диалогами.

Мы также работаем над разработкой систем вопросно-ответных систем (QA), которые могут извлекать ответы непосредственно из большой базы документов. Это значительно улучшает пользовательский опыт, предоставляя точную и релевантную информацию без необходимости ручного поиска. Для этого мы часто используем трансформеры, которые прекрасно справляются с задачей поиска ответа в тексте.

Анализ больших текстовых массивов и социальных медиа

Объем текстовых данных, с которыми мы работаем, постоянно растет. Обработка больших текстовых массивов (Big Data NLP) требует особых подходов и оптимизированных инструментов. Мы используем распределенные вычисления и специализированные библиотеки, чтобы эффективно обрабатывать гигабайты и терабайты текста.

Особенно актуальным для нас является анализ тональности сообщений в социальных сетях (Twitter/Reddit). Социальные медиа – это неиссякаемый источник информации о настроениях, трендах и мнениях. Мы отслеживаем упоминания нашего бренда, анализируем реакцию на наши публикации, выявляем популярные темы и даже анализируем поведенческие паттерны в чатах. Использование библиотеки Sweetviz для анализа текстовых данных помогает нам быстро получить сводную статистику и визуализации. Это позволяет нам быть в курсе событий и быстро реагировать на изменения.

Специализированные задачи: Юриспруденция, медицина, финансы

NLP находит применение не только в блогинге и маркетинге, но и в очень специфических областях. Мы активно исследуем, как Python и NLP могут быть применены в более узких доменах. Например, использование Python для анализа юридических документов открывает возможности для автоматического извлечения ключевых положений, дат, участников и классификации контрактов.

Аналогично, в финансовой сфере анализ тональности финансовых новостей может помочь в прогнозировании движений рынка, а анализ текстовых данных в финансовой отчетности позволяет автоматизировать извлечение ключевых показателей и рисков. Мы также работаем над разработкой систем обнаружения плагиата, используя методы сравнения строк и векторизации документов. Эти проекты показывают, насколько универсален NLP и какой огромный потенциал он имеет для автоматизации и оптимизации работы в самых разных отраслях.

Системы суммаризации: Краткость — сестра таланта

В современном мире, где время – самый ценный ресурс, способность быстро извлекать суть из длинных текстов становится критически важной. Здесь на помощь приходят системы суммаризации текста. Они позволяют нам автоматически создавать краткие изложения документов, не теряя при этом их основной смысл.

Мы различаем два основных подхода: экстрактивная суммаризация (выбор наиболее важных предложений из исходного текста) и абстрактивная суммаризация (генерация нового текста, который передает смысл оригинала). Разработка системы суммаризации текста (Abstractive vs Extractive) – это одна из самых интересных задач, над которой мы работаем. Для экстрактивной суммаризации мы часто используем TextRank, а для абстрактивной – трансформерные модели, такие как BART или T5, через библиотеку Hugging Face. Использование Transformer-моделей для суммаризации дает потрясающие результаты, позволяя нам быстро получать качественные резюме для статей, отчетов или новостей.

Оценка и сравнение: Как выбрать лучшее?

В мире NLP существует огромное количество алгоритмов, моделей и библиотек. Как понять, какой из них лучше подходит для нашей конкретной задачи? Ответ прост: нужно тестировать и измерять. Мы всегда подходим к выбору инструмента и метода с аналитической точки зрения, опираясь на количественные метрики. Это позволяет нам не только выбирать наиболее эффективные решения, но и постоянно улучшать качество наших систем.

Наш процесс всегда включает в себя тщательную оценку и сравнение. Без этого мы бы работали вслепую, полагаясь на догадки, а не на данные. Давайте рассмотрим, какие метрики мы используем и как подходим к выбору.

Метрики качества (F1-score, Precision, Recall)

Для оценки производительности наших моделей мы используем стандартные метрики из области машинного обучения.

- Precision (точность): Доля правильно предсказанных положительных результатов среди всех предсказанных положительных результатов. Высокая точность означает мало "ложных срабатываний".

- Recall (полнота): Доля правильно предсказанных положительных результатов среди всех фактически положительных результатов. Высокая полнота означает, что мы не пропустили много истинных положительных случаев.

- F1-score: Гармоническое среднее Precision и Recall. Эта метрика особенно полезна, когда существует дисбаланс между классами или когда одинаково важны как точность, так и полнота.

Оценка качества NER-моделей (F1-score, Precision, Recall) или классификаторов текста – это стандартная практика для нас. Мы всегда стремимся найти баланс между этими метриками, в зависимости от того, что важнее для конкретной задачи – не пропустить что-то важное (высокий Recall) или избежать ошибочных предсказаний (высокий Precision).

Сравнение моделей и методов: Что эффективнее для нас?

Помимо метрик, мы регулярно проводим комплексное сравнение различных подходов. Это может быть сравнение моделей тематического моделирования (LDA vs NMF), сравнение различных методов векторизации (TF-IDF vs Word2Vec) или сравнение методов лемматизации (SpaCy vs NLTK). Мы даже сравниваем сравнение алгоритмов кластеризации (K-Means vs DBSCAN) при анализе текстовых данных.

Такие сравнения позволяют нам не только выбрать наиболее подходящий инструмент, но и понять его сильные и слабые стороны. Мы учитываем не только точность, но и скорость обучения, потребление памяти, простоту использования и возможность масштабирования. Наш подход к выбору всегда прагматичен: мы ищем оптимальное решение, которое дает наилучшие результаты при имеющихся ресурсах и требованиях.

Будущее NLP: Новые горизонты

Мир NLP постоянно развивается. То, что еще вчера казалось фантастикой, сегодня становится реальностью. Мы видим, как модели становятся все более умными, способными не только понимать, но и генерировать текст, который неотличим от человеческого. Мы внимательно следим за новейшими исследованиями и технологиями, чтобы быть на переднем крае этих изменений.

Наш интерес лежит в таких областях, как разработка моделей для выявления связей между сущностями (например, кто связан с кем, что произошло между объектами), разработка инструментов для проверки фактов (Fact-Checking), которые борются с дезинформацией, и анализ стилистики текстов (авторский почерк) для определения авторства или выявления уникальных особенностей написания. Мы также экспериментируем с использованием трансформеров для анализа кода (сжатие кода), что открывает новые возможности за пределами традиционного текста.

Будущее NLP обещает еще более глубокое понимание человеческого языка, автоматизацию сложных интеллектуальных задач и создание по-настоящему умных систем, способных взаимодействовать с нами естественным образом. Мы гордимся тем, что являемся частью этого захватывающего путешествия.

Как вы видите, мир обработки естественного языка огромен и полон возможностей. От базовой предобработки текста до использования сложнейших трансформерных моделей – каждый этап имеет свою важность и открывает новые горизонты. Мы, как блогеры, используем этот арсенал знаний и инструментов Python, чтобы не просто писать статьи, а по-настоящему взаимодействовать с информацией, извлекать из нее смыслы и создавать ценность для нашей аудитории.

Наш путь в NLP – это непрерывный процесс обучения, экспериментов и адаптации. Мы постоянно открываем для себя новые библиотеки, алгоритмы и методики, которые помогают нам быть более эффективными и инновационными. Надеемся, что этот обзор вдохновил вас на собственные исследования и эксперименты в области NLP. Помните, что каждый текст – это не просто набор слов, а потенциальный источник ценных данных, ожидающих, когда мы извлечем из них знания. Удачи в ваших NLP-приключениях!

Подробнее

| Основы NLTK | Использование spaCy для NER | Тематическое моделирование LDA | Word2Vec и GloVe | Анализ тональности VADER |

| Трансформеры Hugging Face | Разработка чат-ботов на Python | Суммаризация текста | Лемматизация и стемминг | Сравнение TF-IDF и Word2Vec |