- Путешествие в Глубины Языка: Как Мы Осваивали NLP на Python и Чему Научились

- Первые Шаги в Мире NLP: Разбираемся с Основами

- NLTK: Наш Первый Учитель в Токенизации и Стемминге

- spaCy: Скорость и Точность в Распознавании Именованных Сущностей (NER)

- Регулярные Выражения (re): Наш Надежный Помощник в Очистке Текста

- TextBlob: Простота и Скорость для Базовых Задач

- От Слов к Числам: Как Машины "Видят" Текст

- Разработка Собственных Векторизаторов: CountVectorizer и TfidfVectorizer

- Word Embeddings: Word2Vec и GloVe с Использованием Gensim

- Продвинутые Векторизации: Doc2Vec и Sentence Transformers

- Сердце Текста: Анализ Тональности и Тематическое Моделирование

- Анализ Тональности (Sentiment Analysis) с VADER и не только

- Тематическое Моделирование с Gensim: От LDA до NMF

- Машинное Обучение в NLP: Классификация и Прогнозирование

- Применение Scikit-learn для Классификации Текстов

- Новая Эра: Трансформеры и Глубокое Обучение

- Трансформеры (Hugging Face) для Сложных Задач NLP

- Применение PyTorch/TensorFlow для Создания Нейросетей NLP

- Прикладное NLP: От Вопросно-Ответных Систем до Чат-ботов

- Разработка Систем Вопросно-Ответных Систем (QA)

- Разработка Чат-ботов на Python (Rasa Framework)

- Обработка Многоязычных Текстовых Корпусов и Редких Языков

- Инструменты для Глубокого Анализа и Визуализации

- Анализ Текста для Извлечения Ключевых Фраз и Суммаризации

- Инструменты для Визуализации Текстовых Данных

- Секреты Мастерства: Продвинутые Техники и Лучшие Практики

- Проблемы Обработки Неполных и Ошибочных Данных

- Оценка Качества Моделей и Сравнение Подходов

- Работа с Большими Текстовыми Массивами (Big Data NLP)

Путешествие в Глубины Языка: Как Мы Осваивали NLP на Python и Чему Научились

Добро пожаловать‚ дорогие читатели‚ в наш увлекательный мир обработки естественного языка (NLP)! На протяжении многих лет мы‚ как команда увлеченных исследователей и практиков‚ погружались в безграничные возможности Python для анализа‚ понимания и даже генерации человеческой речи. Это путешествие было полно открытий‚ вызовов и бесценных уроков‚ которыми мы с радостью делимся с вами. Мы не просто рассказываем о концепциях‚ мы делимся нашим реальным опытом‚ нашими победами и теми моментами‚ когда мы чувствовали себя первооткрывателями на неизведанных землях цифрового лингвистического анализа.

В этой статье мы проведем вас по всем ключевым этапам освоения NLP‚ от самых азов до продвинутых трансформерных моделей‚ которые сегодня меняют мир. Мы покажем‚ как мы начинали‚ какие инструменты выбирали и почему‚ с какими сложностями сталкивались и как их преодолевали. Наша цель – не просто перечислить технологии‚ а дать вам полное представление о том‚ как можно применить эти мощные инструменты для решения реальных задач‚ будь то анализ отзывов клиентов‚ создание умных чат-ботов или даже перевод документов в автоматическом режиме. Приготовьтесь к глубокому погружению‚ ведь мы начинаем наше приключение!

Первые Шаги в Мире NLP: Разбираемся с Основами

Наше знакомство с миром NLP началось‚ как и у многих‚ с фундаментальных концепций и базовых библиотек. Мы быстро осознали‚ что прежде чем строить сложные модели‚ необходимо научиться "разбирать" текст на его составные части и стандартизировать его. Это как учиться читать и писать‚ прежде чем браться за написание романа. Мы начали с самого сердца – с токенизации и стемминга.

NLTK: Наш Первый Учитель в Токенизации и Стемминге

Когда мы только начинали‚ библиотека NLTK (Natural Language Toolkit) стала нашим надежным проводником. Мы обнаружили‚ что она предоставляет интуитивно понятные инструменты для базовой предобработки текста‚ которая является краеугольным камнем любого NLP-проекта.

Мы учились токенизировать текст – разбивать его на отдельные слова (токены) или предложения. Это кажется простым‚ но на деле есть множество нюансов: как обрабатывать пунктуацию‚ числа‚ сокращения? NLTK предлагал различные токенизаторы‚ и мы экспериментировали с ними‚ чтобы понять‚ какой лучше подходит для наших данных. Например‚ для русского языка мы столкнулись с необходимостью учитывать особенности словообразования и падежей‚ что усложняло процесс по сравнению с английским.

Далее мы перешли к стеммингу – процессу усечения слов до их корневой формы. Мы использовали популярные стеммеры‚ такие как PorterStemmer и SnowballStemmer. Наш опыт показал‚ что стемминг весьма полезен для уменьшения размерности данных и обработки различных форм одного и того же слова как единой сущности. Однако‚ мы также быстро поняли его ограничение: стемминг часто создает несуществующие слова‚ что может искажать смысл‚ но для задач‚ где важна лишь общая корневая принадлежность‚ это отличный старт.

spaCy: Скорость и Точность в Распознавании Именованных Сущностей (NER)

По мере усложнения задач мы поняли‚ что NLTK‚ хотя и является мощной базой‚ не всегда справляется с требованиями к скорости и продвинутому анализу. Именно тогда мы открыли для себя spaCy – библиотеку‚ которая произвела революцию в нашем подходе к NLP.

Мы были поражены ее производительностью и возможностями‚ особенно в области NER (Named Entity Recognition). spaCy с его предобученными моделями позволял нам быстро и точно извлекать из текста именованные сущности‚ такие как имена людей‚ организации‚ географические названия‚ даты и многое другое. Это было похоже на то‚ как если бы мы внезапно получили возможность видеть не просто слова‚ а их роли и значения в контексте предложения. Для нас это стало ключевым инструментом в проектах по анализу новостных статей и извлечению информации из документов. Мы часто использовали его для:

- Автоматической категоризации документов по ключевым сущностям.

- Создания систем для мониторинга упоминаний брендов и персон.

- Предварительной обработки данных для построения более сложных моделей.

Регулярные Выражения (re): Наш Надежный Помощник в Очистке Текста

Ни один проект NLP не обходится без тщательной предобработки текста. Мы быстро осознали‚ что "грязные" данные – это бич для любой модели. Здесь на помощь приходят регулярные выражения (модуль `re` в Python). Мы использовали их для множества задач:

- Очистка данных: Удаление HTML-тегов‚ специальных символов‚ лишних пробелов‚ URL-адресов.

- Извлечение информации: Поиск и выделение конкретных паттернов‚ таких как телефонные номера‚ email-адреса‚ даты или числовые значения.

- Нормализация: Приведение текста к единому регистру‚ замена синонимов или сокращений.

Наш опыт показал‚ что мастерство владения регулярными выражениями – это суперсила для любого‚ кто работает с текстом. Они позволяют нам творить чудеса с данными‚ превращая хаос в упорядоченную структуру‚ готовую к дальнейшему анализу.

TextBlob: Простота и Скорость для Базовых Задач

Иногда нам требовался быстрый и простой инструмент для выполнения базовых задач‚ не требующих глубокой настройки или высокой производительности. Здесь на сцену выходила библиотека TextBlob. Мы использовали ее для:

- Простого анализа тональности (sentiment analysis) для быстрых оценок.

- Определения языка текста.

- Базовой токенизации и выделения частей речи (POS-теггинг).

TextBlob стал нашим выбором‚ когда нужно было получить быстрый инсайт или провести предварительный анализ без развертывания тяжелых моделей. Мы обнаружили‚ что она идеально подходит для прототипирования и образовательных целей‚ предоставляя доступ к мощным алгоритмам через простой API.

От Слов к Числам: Как Машины "Видят" Текст

Чтобы компьютер мог обрабатывать человеческий язык‚ ему нужно каким-то образом преобразовать слова в числовой формат. Это один из самых фундаментальных и захватывающих аспектов NLP. Мы исследовали различные методы векторизации текста‚ каждый из которых имеет свои преимущества и области применения.

Разработка Собственных Векторизаторов: CountVectorizer и TfidfVectorizer

Наши первые шаги в векторизации текста были связаны с классическими моделями из библиотеки Scikit-learn. Мы активно использовали CountVectorizer и TfidfVectorizer.

CountVectorizer помог нам понять‚ как можно представить текст в виде простого мешка слов‚ где каждое измерение соответствует слову‚ а значение – его частоте в документе. Мы использовали его для задач‚ где важна была абсолютная частота слов‚ например‚ для анализа частотности слов и N-грамм.

Однако‚ мы быстро осознали‚ что простое количество слов не всегда отражает их значимость. Именно тогда мы перешли к TfidfVectorizer‚ который учитывает не только частоту слова в документе (Term Frequency)‚ но и его редкость во всем корпусе текстов (Inverse Document Frequency). Этот подход позволил нам выделить более значимые слова‚ которые лучше характеризуют конкретный документ. Мы часто применяли TF-IDF для:

- Определения ключевых фраз в статьях.

- Фильтрации спама или нерелевантного контента.

- Предварительной обработки перед кластеризацией текстов.

Word Embeddings: Word2Vec и GloVe с Использованием Gensim

Мир векторизации претерпел значительные изменения с появлением Word Embeddings – векторных представлений слов‚ которые улавливают их семантические и синтаксические отношения. Это был настоящий прорыв! Мы активно работали с Word2Vec и GloVe‚ используя библиотеку Gensim.

Мы обучали собственные модели Word2Vec на больших корпусах текстов и были поражены тем‚ как слова‚ близкие по смыслу‚ оказывались близко друг к другу в многомерном векторном пространстве. Например‚ "король" и "королева"‚ "мужчина" и "женщина" показывали удивительные векторные отношения. Этот метод позволил нам:

- Улучшить качество рекомендательных систем.

- Повысить точность моделей классификации текста.

- Анализировать семантическое сходство слов и документов.

С Gensim мы также исследовали тематическое моделирование с помощью алгоритмов LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing). Это позволило нам обнаруживать скрытые темы в больших коллекциях документов‚ что было невероятно полезно для анализа отзывов клиентов и исследования новостных трендов. Мы могли видеть‚ как тексты группируются по неявным темам‚ даже если они не содержали общих ключевых слов.

Продвинутые Векторизации: Doc2Vec и Sentence Transformers

Если Word Embeddings отлично работают со словами‚ то как быть с целыми предложениями или документами? Здесь мы обратились к Doc2Vec (расширению Word2Vec) и Sentence Transformers. Doc2Vec позволил нам создавать векторные представления для целых документов‚ что было критически важно для задач‚ где требовалось сравнивать схожесть больших текстовых блоков или категоризировать их.

Sentence Transformers‚ построенные на архитектуре трансформеров‚ стали для нас настоящим открытием. Они создают высококачественные векторные представления предложений‚ которые удивительно хорошо улавливают семантику. Мы использовали их для:

- Поиска семантически похожих предложений в больших базах данных.

- Разработки систем вопросно-ответных систем‚ где нужно найти наиболее релевантный ответ.

- Кластеризации предложений или коротких текстов по смыслу.

Сердце Текста: Анализ Тональности и Тематическое Моделирование

Помимо понимания отдельных слов‚ нас всегда интересовало‚ что "чувствует" текст и о чем он на самом деле говорит. Это привело нас к двум мощным областям NLP: анализу тональности и тематическому моделированию.

Анализ Тональности (Sentiment Analysis) с VADER и не только

Анализ тональности – это процесс определения эмоциональной окраски текста (положительной‚ отрицательной или нейтральной). Мы начали с VADER (Valence Aware Dictionary and sEntiment Reasoner)‚ который оказался удивительно эффективным для анализа текстов из социальных сетей‚ благодаря своей способности учитывать знаки препинания‚ смайлики и сленг.

Наш опыт показал‚ что VADER отлично подходит для английского языка‚ но для русского мы часто сталкивались с необходимостью обучения собственных моделей или использования специализированных словарей. Мы анализировали тональность:

- Отзывов о продуктах и услугах‚ чтобы понять отношение клиентов.

- Сообщений в социальных сетях‚ чтобы отслеживать общественное мнение о брендах или событиях.

- Финансовых новостей‚ чтобы прогнозировать влияние на рынки.

Особенно сложной задачей для нас стал анализ тональности с учетом сарказма и иронии. Эти тонкие нюансы человеческой речи до сих пор остаются вызовом для большинства моделей‚ и мы активно экспериментировали с контекстными эмбеддингами и трансформерами‚ чтобы улучшить распознавание таких случаев.

Тематическое Моделирование с Gensim: От LDA до NMF

Когда у нас был большой объем неструктурированного текста‚ мы часто задавались вопросом: "О чем все это?" Здесь на помощь приходило тематическое моделирование. Библиотека Gensim стала нашим основным инструментом для работы с LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing).

Мы использовали LDA для выявления скрытых тем в больших корпусах документов‚ например‚ в архивах новостей или научных статьях. Это позволяло нам автоматически категоризировать контент и понимать основные дискурсы‚ присутствующие в данных. Мы также проводили сравнение моделей тематического моделирования (LDA vs NMF). NMF (Non-negative Matrix Factorization) часто давала нам более интерпретируемые темы‚ особенно когда мы работали с разреженными матрицами признаков.

Вот как мы сравнивали эти подходы:

| Критерий | LDA (Latent Dirichlet Allocation) | NMF (Non-negative Matrix Factorization) |

|---|---|---|

| Основа | Вероятностная модель | Линейное алгебраическое разложение |

| Интерпретируемость | Хорошая‚ но может требовать настройки гиперпараметров | Часто более высокая‚ особенно для разреженных данных |

| Подход | Каждый документ – смесь тем‚ каждая тема – смесь слов | Разложение матрицы "документ-слово" на матрицы "документ-тема" и "тема-слово" |

| Требования к данным | Требует подсчета частот слов | Лучше работает с TF-IDF векторизацией |

Машинное Обучение в NLP: Классификация и Прогнозирование

После того как мы научились векторизировать текст и извлекать из него темы‚ следующим логическим шагом стало применение традиционных методов машинного обучения для решения более сложных задач‚ таких как классификация.

Применение Scikit-learn для Классификации Текстов

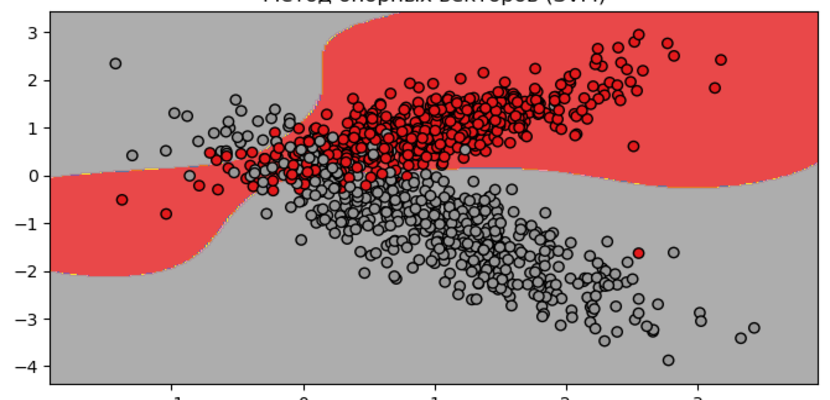

Библиотека Scikit-learn стала нашим основным инструментом для построения моделей классификации. Мы использовали ее для множества задач‚ от категоризации новостей до фильтрации спама. Мы экспериментировали с различными алгоритмами:

- Наивный Байесовский классификатор: Отлично работает с текстовыми данными‚ особенно когда признаки (слова) условно независимы. Мы ценили его за простоту и скорость.

- SVM (Support Vector Machines): Показал высокую эффективность в задачах классификации текста‚ особенно с линейными ядрами‚ когда нам нужно было найти оптимальную гиперплоскость для разделения классов.

- Логистическая регрессия: Часто использовалась нами как хороший базовый алгоритм‚ дающий интерпретируемые результаты.

Мы научились тщательно подбирать векторизаторы (TF-IDF или Word Embeddings) в зависимости от задачи и проводить кропотливую настройку гиперпараметров моделей‚ чтобы достичь максимальной точности.

"Язык – это дорожная карта культуры. Он говорит вам‚ откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Новая Эра: Трансформеры и Глубокое Обучение

Когда мы думали‚ что уже многое поняли в NLP‚ появились Трансформеры. Это было похоже на переход от черно-белого телевидения к цветному‚ а затем к 4K. Трансформеры и глубокое обучение полностью изменили наше представление о возможностях обработки языка.

Трансформеры (Hugging Face) для Сложных Задач NLP

Библиотека Hugging Face Transformers стала нашим окном в мир самых передовых моделей. Мы были поражены их способностью понимать контекст‚ генерировать связный текст и выполнять задачи‚ которые раньше казались научной фантастикой. Мы активно использовали их для:

- BERT для задач классификации и NER: Мы научились тонко настраивать (Fine-tuning) предварительно обученные модели BERT для наших специфических задач‚ что давало невероятные результаты по сравнению с классическими методами.

- Генерация текста (GPT): Эксперименты с моделями GPT для создания связных текстов‚ ответов на вопросы и даже написания кода показали нам‚ насколько далеко продвинулась область.

- Машинный перевод: Трансформерные архитектуры лежат в основе современных систем машинного перевода‚ и мы использовали их для создания более точных и контекстно-зависимых переводов.

- Суммаризация текста: Мы применяли Transformer-модели для создания как экстрактивных (выбирают ключевые предложения)‚ так и абстрактивных (генерируют новый текст) суммаризаций‚ что было невероятно полезно для обработки больших объемов информации.

Работа с трансформерами требовала значительных вычислительных ресурсов‚ и мы часто использовали GPU-ускорение для обучения и инференса моделей‚ чтобы сократить время обработки и получить результаты быстрее.

Применение PyTorch/TensorFlow для Создания Нейросетей NLP

Хотя Hugging Face предоставляет удобный интерфейс‚ для более глубокого контроля и создания кастомных архитектур мы обращались к фреймворкам PyTorch и TensorFlow. Мы строили собственные нейронные сети‚ включая LSTM-сети‚ для задач‚ где требовалось улавливать долгосрочные зависимости в тексте‚ например‚ в анализе стилистики текстов или в задачах генерации.

Этот опыт позволил нам не только использовать готовые решения‚ но и понимать внутреннюю механику работы современных NLP-моделей‚ что бесценно для исследовательской работы и создания по-настоящему инновационных продуктов.

Прикладное NLP: От Вопросно-Ответных Систем до Чат-ботов

Теоретические знания и освоенные инструменты обретают истинную ценность‚ когда мы применяем их для решения реальных задач. Мы активно работали над созданием различных прикладных систем‚ которые демонстрируют мощь NLP.

Разработка Систем Вопросно-Ответных Систем (QA)

Создание QA-систем было одной из самых захватывающих областей. Мы стремились разработать системы‚ которые могли бы не просто находить ключевые слова‚ но и понимать смысл вопросов и извлекать точные ответы из больших объемов текста. Мы использовали:

- BERT-подобные модели‚ обученные на QA-датасетах‚ для извлечения ответов из предоставленного контекста.

- Sentence Transformers для поиска наиболее релевантных абзацев‚ содержащих потенциальные ответы.

Наш опыт показал‚ что создание эффективной QA-системы требует не только мощных моделей‚ но и продуманной архитектуры для индексации документов и ранжирования ответов.

Разработка Чат-ботов на Python (Rasa Framework)

Чат-боты стали неотъемлемой частью современного цифрового мира‚ и мы активно занимались их разработкой. Rasa framework оказался мощным и гибким инструментом для создания контекстно-зависимых диалоговых систем. Мы использовали его для:

- Определения намерений пользователя (intent recognition).

- Извлечения сущностей из запросов (entity extraction).

- Управления диалогом и ответами.

Мы создавали чат-ботов для поддержки клиентов‚ автоматизации процессов и даже для образовательных целей. Наш главный вывод: для создания по-настоящему полезного чат-бота требуется не только техническая реализация‚ но и глубокое понимание пользовательского опыта и дизайна диалогов.

Обработка Многоязычных Текстовых Корпусов и Редких Языков

Мир не ограничивается английским языком‚ и мы часто сталкивались с необходимостью работы с многоязычными текстовыми корпусами‚ в т.ч. с языками‚ обладающими богатой морфологией‚ такими как русский. Здесь нам помогали:

- Stanza: Библиотека от Stanford NLP Group‚ которая отлично справляется с языками с богатой морфологией‚ предоставляя продвинутую лемматизацию‚ POS-теггинг и синтаксический парсинг.

- Polyglot: Мощный инструмент для мультиязычного NLP‚ поддерживающий широкий спектр языков для токенизации‚ NER и анализа тональности. Мы использовали его для анализа редких языков‚ для которых не было специализированных моделей.

Работа с многоязычными данными требовала от нас особого внимания к предобработке и выбору подходящих моделей‚ но открывала огромные возможности для глобальных проектов.

Инструменты для Глубокого Анализа и Визуализации

NLP – это не только алгоритмы и модели‚ это еще и искусство извлечения смысла и представления его в понятной форме. Мы активно использовали различные инструменты для анализа и визуализации текстовых данных.

Анализ Текста для Извлечения Ключевых Фраз и Суммаризации

Для быстрого понимания сути больших текстов мы использовали методы извлечения ключевых фраз.

- RAKE (Rapid Automatic Keyword Extraction): Этот алгоритм позволял нам быстро извлекать наиболее релевантные ключевые слова и фразы без предварительного обучения модели.

- TextRank: Основанный на алгоритме PageRank‚ TextRank помогал нам не только извлекать ключевые слова‚ но и ключевые предложения‚ что являлось основой для экстрактивной суммаризации текста.

Мы также исследовали абстрактивную суммаризацию с использованием трансформерных моделей‚ которые генерируют новый‚ более краткий текст‚ передающий основной смысл оригинала. Это было особенно полезно для автоматического создания аннотаций или коротких обзоров.

Инструменты для Визуализации Текстовых Данных

Визуализация играет ключевую роль в понимании результатов NLP. Мы часто использовали:

- Облака слов (Word Clouds): Простой‚ но эффективный способ визуализации частотности слов в корпусе текста. Они помогали нам быстро определить наиболее доминирующие темы или ключевые термины.

- Тепловые карты (Heatmaps): Мы использовали их для визуализации матриц сходства между документами или темами‚ что помогало нам выявлять скрытые паттерны и взаимосвязи.

Визуализация делала наши отчеты более наглядными и помогала нам донести сложные результаты до нетехнической аудитории.

Секреты Мастерства: Продвинутые Техники и Лучшие Практики

Наш путь в NLP был не только освоением инструментов‚ но и пониманием глубинных принципов и тонкостей работы с языком. Мы столкнулись с множеством вызовов и выработали ряд лучших практик.

Проблемы Обработки Неполных и Ошибочных Данных

Реальные данные редко бывают идеальными. Мы постоянно сталкивались с неполными и ошибочными данными‚ опечатками‚ грамматическими ошибками‚ сленгом и эмодзи. Для этого мы разработали и использовали:

- Инструменты для проверки грамматики и орфографии: Иногда приходилось интегрировать внешние API или использовать специализированные библиотеки.

- Нормализация сленга и эмодзи: Создание собственных словарей для перевода неформальной лексики в стандартную форму.

- Библиотека Jellyfish: Для сравнения строк и поиска близких по написанию слов‚ что было полезно для обработки опечаток.

Наш опыт показал‚ что качество предобработки напрямую влияет на качество конечного результата. "Мусор на входе – мусор на выходе" – это золотое правило в NLP.

Оценка Качества Моделей и Сравнение Подходов

Как понять‚ насколько хороша наша модель? Мы всегда уделяли особое внимание оценке качества NLP-моделей. Мы использовали стандартные метрики:

- Precision‚ Recall‚ F1-score: Эти метрики были незаменимы для оценки точности классификаторов и NER-моделей‚ особенно при работе с несбалансированными классами.

- Accuracy: Хотя и простая‚ но полезная метрика для общей оценки.

Мы также регулярно проводили сравнение различных методов машинного обучения для NLP (например‚ SVM против Наивного Байеса‚ или разных токенизаторов‚ лемматизаторов) и сравнение моделей Word2Vec (Skip-gram vs CBOW)‚ чтобы понять‚ какой подход лучше всего подходит для конкретной задачи и набора данных.

Работа с Большими Текстовыми Массивами (Big Data NLP)

По мере роста объема данных мы столкнулись с вызовами обработки больших текстовых массивов. Это требовало не только эффективных алгоритмов‚ но и оптимизации инфраструктуры. Мы использовали:

- Параллельные вычисления и распределенные системы.

- Оптимизированные библиотеки‚ такие как Gensim‚ которые могут работать с большими корпусами "из коробки".

- Эффективное управление памятью и дисковым пространством.

Наш опыт показал‚ что для Big Data NLP необходим комплексный подход‚ включающий как программные‚ так и аппаратные решения.

Мы надеемся‚ что это путешествие по миру NLP на Python было для вас таким же увлекательным и познавательным‚ как и для нас. От самых базовых концепций до передовых моделей‚ мы всегда стремились использовать Python как мощный инструмент для раскрытия потенциала человеческого языка. Наш путь продолжается‚ и мы верим‚ что возможности NLP еще далеко не исчерпаны.

Подробнее: LSI Запросы к статье

| Основы NLTK | SpaCy NER | Тематическое моделирование LDA | Классификация Scikit-learn | Word Embeddings Gensim |

| Анализ тональности VADER | Трансформеры Hugging Face | Разработка чат-ботов Rasa | Продвинутая лемматизация | Извлечение ключевых фраз RAKE |