- Разгадывая Язык Цифрового Мира: Наш Путь в Мир NLP с Python

- Первые Шаги: От Сырого Текста к Значимым Единицам

- Токенизация и Стемминг: Разбираем Текст на Части

- Продвинутая Лемматизация и Мощный SpaCy

- Регулярные Выражения и Очистка Данных

- Превращение Слов в Числа: Векторизация Текста

- Классические Векторизаторы: CountVectorizer и TF-IDF

- Word Embeddings: От Слов к Смыслу

- Контекстуальные Эмбеддинги: Революция Трансформеров

- Ключевые Задачи NLP, Которые Мы Решаем

- Распознавание Именованных Сущностей (NER)

- Анализ Тональности (Sentiment Analysis)

- Тематическое Моделирование (Topic Modeling)

- Классификация Текстов

- Суммаризация Текста и Извлечение Ключевых Фраз

- Продвинутые Инструменты и Специализированные Задачи

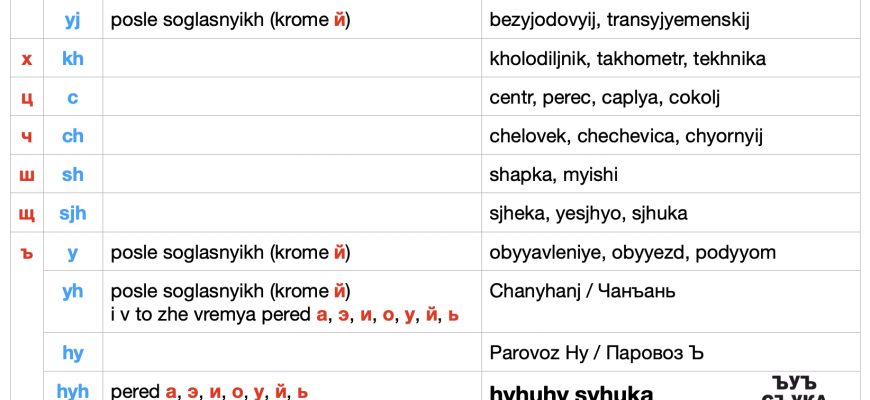

- Работа с Многоязычными Текстами и Сложной Морфологией

- Извлечение Информации и Веб-Скрейпинг

- Разработка QA-систем и Чат-ботов

- Анализ Стилистики и Обнаружение Плагиата

- Визуализация Текстовых Данных

- Применение NLP в Реальных Сценариях: От Отзывов до Юридических Документов

- Анализ Отзывов Клиентов и Социальных Сетей

- Юридический и Финансовый NLP

- Автоматизация и Разработка Инструментов

- Будущее NLP и Наши Перспективы

Разгадывая Язык Цифрового Мира: Наш Путь в Мир NLP с Python

Добро пожаловать, дорогие читатели, в наш увлекательный мир, где машины учатся понимать человеческий язык! Мы, как опытные блогеры и энтузиасты технологий, всегда стремимся делиться самым интересным и полезным из нашего личного опыта. Сегодня мы погрузимся в захватывающую область Обработки Естественного Языка (NLP) с помощью Python – инструмента, который открывает безграничные возможности для взаимодействия с текстом. В этой статье мы расскажем о том, как мы осваивали NLP, какие инструменты использовали и какие удивительные задачи решали, превращая сырой текст в ценные инсайты.

Мир вокруг нас наполнен текстом: электронные письма, сообщения в социальных сетях, научные статьи, отзывы клиентов, юридические документы. Вся эта информация, если ее правильно обработать, может стать ключом к пониманию тенденций, настроений, предпочтений и даже скрытых смыслов. Именно здесь на помощь приходит NLP – дисциплина на стыке информатики, искусственного интеллекта и лингвистики, которая позволяет компьютерам анализировать, понимать и генерировать человеческий язык. И Python, с его богатой экосистемой библиотек, является нашим верным спутником в этом путешествии.

Первые Шаги: От Сырого Текста к Значимым Единицам

Наш путь в NLP всегда начинался с самого фундаментального этапа – предобработки текста. Мы быстро поняли, что "сырой" текст, как он есть, редко подходит для прямого анализа. Он полон шума, нерегулярностей и особенностей человеческой речи, которые могут сбить с толку любую модель. Поэтому, прежде чем приступать к глубокому анализу, мы всегда уделяем особое внимание очистке и подготовке данных.

Токенизация и Стемминг: Разбираем Текст на Части

Один из первых шагов, который мы освоили, — это токенизация. Это процесс разделения текста на отдельные слова или фразы, называемые токенами. Представьте, что у вас есть предложение: "Мы учимся NLP с Python". Токенизация превратит его в список: ["Мы", "учимся", "NLP", "с", "Python"]. Для этого мы часто используем библиотеку NLTK (Natural Language Toolkit), которая предлагает различные токенизаторы, учитывающие особенности пунктуации и многословных выражений.

После токенизации мы часто сталкиваемся с проблемой различных форм одного и того же слова. Например, "бежать", "бежит", "бежал" – это все варианты глагола "бежать". Здесь нам на помощь приходят стемминг и лемматизация. Стемминг – это процесс сокращения слова до его корневой формы (стема), которая не обязательно является существующим словом. Например, "running", "runs", "runner" могут быть сведены к "run". Стеммеры NLTK, такие как PorterStemmer или SnowballStemmer, стали нашими первыми инструментами для этой задачи.

Продвинутая Лемматизация и Мощный SpaCy

Со временем мы поняли, что стемминг, хоть и прост в реализации, иногда бывает слишком агрессивен и может удалять слишком много информации. Тогда мы перешли к лемматизации. Лемматизация – это более изощренный процесс, который приводит слова к их словарной (базовой) форме, называемой леммой, с учетом морфологического анализа и части речи. Например, "лучше" превращается в "хороший", а не "луч".

Для лемматизации и многих других продвинутых задач мы активно используем библиотеку spaCy. Она гораздо быстрее и предоставляет более точные результаты, особенно для языков с богатой морфологией, таких как русский. SpaCy не только лемматизирует, но и выполняет POS-теггинг (определение части речи), синтаксический парсинг и распознавание именованных сущностей (NER) прямо из коробки. Мы обнаружили, что для проектов, требующих высокой производительности и точности, spaCy является незаменимым инструментом.

Для сравнения этих подходов, мы часто используем следующую таблицу:

| Признак | Стемминг | Лемматизация |

|---|---|---|

| Цель | Сокращение слова до корня (без учета смысла). | Приведение слова к словарной форме (лемме), с учетом грамматики. |

| Результат | Может быть не существующее слово (e.g., "красив" -> "крас"). | Всегда существующее слово (e.g., "красивый" -> "красивый"). |

| Сложность | Проще и быстрее. | Сложнее, требует словарей и морфологического анализа, медленнее. |

| Применение | Информационный поиск, где важна скорость. | Анализ тональности, классификация текстов, QA-системы, где важна точность. |

Регулярные Выражения и Очистка Данных

Помимо морфологического анализа, предобработка текста включает в себя удаление шума: HTML-тегов, URL-адресов, специальных символов, цифр, а иногда и стоп-слов (артиклей, предлогов, союзов, которые не несут смысловой нагрузки). Для этих целей мы активно используем регулярные выражения (библиотека `re` в Python). Они позволяют нам с хирургической точностью находить и заменять нужные паттерны в тексте.

Мы также разработали собственные инструменты для очистки текста от HTML-тегов, нормализации пунктуации и работы с эмодзи и сленгом, особенно при анализе данных из социальных сетей. Это помогло нам обрабатывать неполные и ошибочные данные, которые так часто встречаются в реальных проектах.

Превращение Слов в Числа: Векторизация Текста

Как только текст очищен и приведен в порядок, следующим критически важным шагом является его трансформация в числовой формат. Компьютеры не "понимают" слова в человеческом смысле; они работают с числами. Этот процесс называется векторизацией текста, и мы исследовали множество способов его реализации.

Классические Векторизаторы: CountVectorizer и TF-IDF

Наши первые эксперименты начались с простых, но эффективных методов. CountVectorizer из библиотеки Scikit-learn создает матрицу, где каждая строка представляет документ, а каждый столбец – слово из всего корпуса текстов, и ячейка содержит количество вхождений слова в документ. Это даёт нам представление о частотности слов.

Однако частотность сама по себе не всегда является лучшим показателем важности слова. Слова типа "и", "в", "на" встречаются очень часто, но не несут много смысла. Здесь в игру вступает TfidfVectorizer (Term Frequency-Inverse Document Frequency). TF-IDF не только учитывает, как часто слово встречается в документе (TF), но и как редко оно встречается во всем корпусе документов (IDF). Таким образом, слова, которые часто встречаются в конкретном документе, но редко в других, получают более высокий вес, что делает их более значимыми. Мы часто используем TF-IDF для классификации текстов и извлечения ключевых фраз.

Word Embeddings: От Слов к Смыслу

Со временем мы поняли ограничения CountVectorizer и TF-IDF: они не улавливают семантические отношения между словами. Например, "король" и "королева" могут быть похожи по смыслу, но для этих векторизаторов они просто два разных слова. Здесь мы открыли для себя мир Word Embeddings – векторных представлений слов, которые кодируют их семантическое значение.

- Word2Vec и GloVe: Мы начали с Word2Vec и GloVe, используя библиотеку Gensim. Word2Vec, разработанный Google, учится, предсказывая соседние слова в контексте (Skip-gram) или предсказывая слово на основе его контекста (CBOW). GloVe, от Stanford, использует глобальную статистику совместной встречаемости слов. Эти модели позволили нам увидеть, как слова, близкие по смыслу, располагаются близко друг к другу в многомерном векторном пространстве. Мы использовали их для задач анализа тональности и поиска синонимов.

- FastText: Для работы с редкими словами и языками с богатой морфологией мы обратили внимание на FastText (также от Facebook). В отличие от Word2Vec, FastText рассматривает слова как наборы символьных n-грамм. Это позволяет ему генерировать векторы для слов, которые не встречались в обучающем корпусе, и лучше справляться с опечатками.

- Doc2Vec и Sentence Transformers: Для представления целых документов или предложений мы перешли к Doc2Vec (расширению Word2Vec) и, что еще более эффективно, к Sentence Transformers. Последние позволяют нам создавать высококачественные семантические эмбеддинги для предложений и документов, что критически важно для задач поиска схожих текстов, кластеризации и суммаризации.

Контекстуальные Эмбеддинги: Революция Трансформеров

Настоящая революция произошла с появлением контекстуальных эмбеддингов и архитектуры трансформеров. Модели, такие как BERT (Bidirectional Encoder Representations from Transformers), изменили наше представление о векторных представлениях. В отличие от Word2Vec, где каждое слово имеет один фиксированный вектор, BERT генерирует вектор для слова в зависимости от его контекста в предложении. Это позволяет улавливать тонкие нюансы значений и полисемию.

Мы активно используем библиотеку Hugging Face Transformers, которая предоставляет доступ к огромному количеству предварительно обученных моделей (BERT, GPT, RoBERTa и многие другие) и позволяет легко применять их для различных задач NLP, а также проводить тонкую настройку (fine-tuning) на наших собственных данных.

"Язык – это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они направляются."

Рита Мэй Браун

Ключевые Задачи NLP, Которые Мы Решаем

После того как мы освоили предобработку и векторизацию, перед нами открылся целый спектр задач, которые мы могли решать с помощью Python и его библиотек. Мы расскажем о самых интересных и практически применимых из них.

Распознавание Именованных Сущностей (NER)

Одной из наиболее востребованных задач, с которой мы регулярно сталкиваемся, является NER (Named Entity Recognition). Это процесс идентификации и классификации именованных сущностей в тексте, таких как имена людей, названия организаций, географические местоположения, даты и денежные суммы. SpaCy предоставляет отличные предварительно обученные модели для NER, которые мы активно используем.

Однако иногда стандартных категорий недостаточно, или нам нужно распознавать специфические для предметной области сущности (например, названия лекарств в медицинских текстах). В таких случаях мы прибегаем к более продвинутым методам, таким как использование библиотеки Flair, которая известна своей точностью и гибкостью, особенно при работе с собственными наборами данных для тонкой настройки NER-моделей. Также мы экспериментировали с CRF (Conditional Random Fields) для создания собственных, более контролируемых NER-систем.

Анализ Тональности (Sentiment Analysis)

Понимание эмоциональной окраски текста – это бесценный навык для анализа отзывов клиентов, постов в социальных сетях или новостных статей. Мы активно применяем VADER (Valence Aware Dictionary and sEntiment Reasoner) из NLTK для быстрого анализа тональности, особенно в социальных медиа, поскольку он хорошо справляется с сленгом и эмодзи.

Для более сложных задач и многоязычного анализа мы обращаемся к обученным моделям классификации или используем такие библиотеки, как TextBlob для простого NLP и определения тональности. Однако мы также осознаем ограничения TextBlob и для критически важных приложений предпочитаем тренировать собственные модели на специфических данных, например, для анализа тональности финансовых новостей, где контекст имеет решающее значение.

Тематическое Моделирование (Topic Modeling)

Когда нам нужно понять основные темы в большом корпусе текстов без предварительной разметки, мы обращаемся к тематическому моделированию. Библиотека Gensim предлагает мощные реализации алгоритмов, таких как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing).

LDA позволяет нам выявлять скрытые темы в документах, представляя каждый документ как смесь тем, а каждую тему как смесь слов. Это помогает нам анализировать тексты отзывов клиентов, выявлять сезонность в текстовых данных или категоризировать статьи. Мы также сравнивали LDA с NMF (Non-negative Matrix Factorization) и другими моделями, чтобы выбрать наиболее подходящий подход для конкретной задачи.

Классификация Текстов

Отнесение текстов к определенным категориям – одна из самых распространенных задач в NLP. Будь то спам-фильтрация, категоризация новостей или анализ отзывов о продуктах, классификация текста играет ключевую роль. Мы активно используем библиотеку Scikit-learn, применяя различные алгоритмы машинного обучения, такие как:

- Наивный Байесовский классификатор: Прост, быстр и часто удивительно эффективен.

- Метод опорных векторов (SVM): Хорошо работает с высокоразмерными данными, такими как TF-IDF векторы.

- Логистическая регрессия: Простой, но мощный линейный классификатор.

Для более сложных задач, где требуеться улавливать глубокие контекстуальные зависимости, мы переходим к нейронным сетям. Мы строили LSTM-сети с использованием PyTorch и TensorFlow/Keras, а также использовали предварительно обученные трансформерные модели (BERT) для задач классификации, часто достигая State-of-the-Art результатов после тонкой настройки.

Суммаризация Текста и Извлечение Ключевых Фраз

В эпоху информационного перегруза способность быстро извлекать суть из больших объемов текста становится критически важной. Мы исследовали два основных подхода к суммаризации:

- Экстрактивная суммаризация: Выбирает наиболее важные предложения из исходного текста. Для этого мы часто используем алгоритм TextRank (реализованный, например, в библиотеке Textacy или через собственные реализации), который ранжирует предложения на основе их схожести с другими предложениями в тексте.

- Абстрактивная суммаризация: Генерирует новые предложения, которые передают основной смысл исходного текста. Это более сложная задача, требующая глубокого понимания языка. Для этого мы используем продвинутые трансформерные модели, такие как GPT-2 или BART, доступные через Hugging Face.

Параллельно с суммаризацией мы занимаемся извлечением ключевых фраз, используя такие алгоритмы, как RAKE (Rapid Automatic Keyword Extraction) или тот же TextRank, но уже для слов и фраз. Это помогает нам быстро понять основное содержание документа.

Продвинутые Инструменты и Специализированные Задачи

Наше путешествие в NLP не ограничивается базовыми задачами. Мы постоянно ищем новые инструменты и методы для решения более сложных и специфических проблем.

Работа с Многоязычными Текстами и Сложной Морфологией

Мир не ограничивается английским языком. Мы часто работаем с многоязычными текстовыми корпусами, включая русский, испанский, немецкий и другие. Для этого мы используем:

- Stanza (StanfordNLP): Отличная библиотека для языков с богатой морфологией, таких как русский. Она предоставляет высококачественные модели для токенизации, POS-теггинга, лемматизации и синтаксического парсинга.

- Polyglot: Еще одна полезная библиотека для работы с множеством языков, предлагающая функциональность для определения языка, токенизации, NER и анализа тональности.

- Трансформеры (Hugging Face): Современные мультиязычные трансформерные модели, такие как mBERT или XLM-R, являются мощнейшими инструментами для решения кросс-языковых задач, от машинного перевода до классификации текстов на разных языках.

Мы также разрабатываем системы машинного перевода на Python, используя трансформерные архитектуры, и инструменты для нормализации сленга и работы с эмодзи в современных текстах, что особенно актуально для анализа социальных сетей.

Извлечение Информации и Веб-Скрейпинг

Прежде чем анализировать текст, его нужно откуда-то получить. Для извлечения текста из веб-страниц мы активно используем библиотеку Beautiful Soup. Она позволяет нам парсить HTML и XML документы, извлекая нужные блоки текста, заголовки, ссылки и другие элементы. Для работы с PDF-документами мы применяем PyMuPDF, который эффективно извлекает текст и метаданные.

Разработка QA-систем и Чат-ботов

Одной из самых захватывающих областей, в которую мы погрузились, является разработка вопросно-ответных систем (QA) и чат-ботов. QA-системы позволяют пользователям задавать вопросы на естественном языке и получать точные ответы из большого корпуса документов. Мы использовали трансформерные модели, такие как BERT, для поиска ответов в тексте (extractive QA).

Для создания чат-ботов мы экспериментировали с фреймворком Rasa, который предоставляет все необходимые инструменты для построения контекстных, диалоговых ИИ-ассистентов. Это позволяет нам создавать интерактивные системы, способные понимать намерения пользователя и вести осмысленный диалог.

Анализ Стилистики и Обнаружение Плагиата

Иногда нам нужно не просто понять смысл текста, но и проанализировать его стиль. Мы разрабатывали инструменты для анализа стилистики текстов (авторский почерк), извлекая такие признаки, как частотность слов и n-грамм, длина предложений, использование пунктуации и другие лексические и синтаксические особенности. Это может быть полезно для определения авторства текста или анализа поведенческих паттернов в чатах.

Вместе с этим мы создавали системы обнаружения плагиата, используя различные метрики сравнения строк (например, с помощью библиотеки Jellyfish) и векторизацию документов (Doc2Vec, Sentence Transformers) для измерения семантического сходства.

Визуализация Текстовых Данных

Визуализация является ключевым элементом для понимания и представления результатов NLP. Мы часто используем:

- Облака слов (Word Clouds): Для быстрого отображения наиболее часто встречающихся слов в корпусе.

- Тепловые карты (Heatmaps): Для визуализации матриц сходства, например, между документами или темами.

- Графики распределения частотности: Для анализа частотности слов и n-грамм.

Эти инструменты помогают нам не только лучше понять данные, но и эффективно донести результаты анализа до нетехнической аудитории.

Применение NLP в Реальных Сценариях: От Отзывов до Юридических Документов

Один из самых захватывающих аспектов нашей работы – это видеть, как NLP преобразует данные в реальные бизнес-решения. Мы применяли наши знания и инструменты в самых разнообразных областях.

Анализ Отзывов Клиентов и Социальных Сетей

Анализ текстов отзывов клиентов – это золотая жила для бизнеса. Мы использовали анализ тональности и тематическое моделирование для:

- Выявления болевых точек продуктов и услуг.

- Отслеживания настроений в социальных сетях (Twitter, Reddit) относительно бренда или продукта.

- Классификации отзывов по категориям (например, доставка, качество товара, обслуживание).

- Анализа тональности с учетом сарказма и иронии, что является одной из самых сложных, но важных задач.

Это позволяет компаниям быстро реагировать на обратную связь и принимать обоснованные решения.

Юридический и Финансовый NLP

Работа с юридическими и финансовыми документами требует особой точности и внимания к деталям. Мы применяли NLP для:

- Извлечения ключевых фактов, дат и сущностей из юридических контрактов.

- Анализа тональности финансовых новостей для прогнозирования рыночных тенденций.

- Автоматической категоризации статей и документов.

- Разработки инструмента для создания словарей терминов и тезаурусов, специфичных для этих областей.

Эти проекты часто включают обработку больших текстовых массивов (Big Data NLP) и требуют оптимизации для GPU-ускорения.

Автоматизация и Разработка Инструментов

Помимо анализа, мы активно занимаемся разработкой собственных инструментов:

- Инструментов для автоматической разметки данных, что значительно ускоряет создание обучающих выборок для моделей.

- Систем для автоматического создания тегов и категоризации контента.

- Инструментов для проверки грамматики и исправления орфографии.

- Систем для определения стиля письма и авторства текста.

- Инструментов для автоматического перефразирования и создания FAQ на основе существующих документов.

Мы постоянно сравниваем различные методы и библиотеки, такие как NLTK, spaCy, Stanza, Gensim, Scikit-learn, TextBlob, Flair, Hugging Face, Polyglot, Textacy, Pattern, Sweetviz, Jellyfish, TextDistance, PyMuPDF, Rasa, Beautiful Soup, PyTorch, TensorFlow, чтобы выбрать наиболее эффективные решения для наших задач.

Будущее NLP и Наши Перспективы

Мир NLP постоянно развивается, и мы с воодушевлением следим за новыми прорывами. Трансформерные архитектуры открыли двери для совершенно новых возможностей, таких как генерация текста (GPT-модели), генерация кода, генерация диалогов и сложный анализ кода. Мы видим, что будущие системы будут еще более контекстно-зависимыми, способными к рассуждению и пониманию нюансов человеческого языка.

Мы продолжим исследовать новые методы, такие как Graph Embeddings для анализа взаимосвязей в тексте, и совершенствовать наши навыки в тонкой настройке предварительно обученных моделей для достижения максимальной производительности. Наша цель – не просто обрабатывать текст, а по-настоящему понимать его, раскрывая его скрытые смыслы и превращая их в ценные знания.

На этом наша статья заканчивается.

Подробнее

| NLTK токенизация стемминг | spaCy NER лемматизация | Gensim LDA LSI | Scikit-learn классификация текста | Word2Vec GloVe Gensim |

| Анализ тональности VADER | Трансформеры Hugging Face | PyTorch TensorFlow NLP | CountVectorizer TfidfVectorizer | TextRank суммаризация |