- Раскрываем Тайны Текста: Наш Путь в Мир NLP с Python

- Начало Пути: Основы Предобработки Текста

- Регулярные Выражения (re): Наш Щит и Меч

- Токенизация, Стемминг и Лемматизация: Разбираем Слова по Косточкам

- Наши Любимые Инструменты: Библиотеки Python для NLP

- NLTK: Наш Стартовый Набор

- spaCy: Скорость и Эффективность для Продакшена

- TextBlob: Простота в Действии для Быстрых Задач

- Gensim: Вглубь Смысла Слов и Документов

- Scikit-learn: Классика Машинного Обучения для Текста

- Глубокое Погружение: От Векторов к Трансформерам

- Word Embeddings: От Слов к Смысловым Векторам

- Трансформеры и Hugging Face: Революция в Глубоком NLP

- Прикладные Задачи и Особенности Работы с Текстом

- Тематическое Моделирование: Открываем Скрытые Смыслы

- Анализ Тональности (Sentiment Analysis): Чувства в Данных

- Распознавание Именованных Сущностей (NER): Ищем Важное

- Разработка Интеллектуальных Систем: От Чат-ботов до Суммаризации

- Специфические Задачи и Наш Опыт

- Работа с «Грязными» Данными и Неполными Текстами

- Сравнение и Оптимизация Моделей

- Анализ Стилистики и Авторства

- Визуализация и Большие Данные

Раскрываем Тайны Текста: Наш Путь в Мир NLP с Python

Привет, дорогие читатели и коллеги по цеху! Сегодня мы с вами отправимся в увлекательное путешествие по миру обработки естественного языка (NLP) с помощью Python – инструмента, который стал для нас настоящей волшебной палочкой. Если вы когда-либо задумывались, как машины понимают человеческую речь, анализируют настроения, переводят тексты или даже генерируют их, то эта статья для вас. Мы покажем вам, как шаг за шагом осваивать этот невероятно мощный и перспективный раздел искусственного интеллекта, опираясь на наш собственный многолетний опыт. Приготовьтесь к погружению в мир, где текст оживает, а данные начинают говорить.

За годы работы с текстовыми данными мы убедились, что NLP — это не просто набор алгоритмов и библиотек, это целое искусство. Искусство превращения хаотичного потока слов в структурированную информацию, извлечения скрытых смыслов и построения интеллектуальных систем, способных взаимодействовать с человеком на его языке. Мы видели, как компании трансформируют свой бизнес, используя анализ отзывов клиентов, как исследователи находят новые закономерности в огромных корпусах текстов, и как разработчики создают умных чат-ботов, которые становятся незаменимыми помощниками. И все это стало возможным благодаря развитию NLP и доступности мощных Python-библиотек.

Начало Пути: Основы Предобработки Текста

Прежде чем машина сможет "понять" текст, его нужно подготовить. Представьте, что вы хотите испечь пирог: сначала нужно просеять муку, взбить яйца, подготовить все ингредиенты. Точно так же и с текстом. Этот этап называется предобработкой, и он является краеугольным камнем любого NLP-проекта. Мы всегда начинаем именно с него, ведь от качества предобработки напрямую зависит успех последующего анализа.

Мы используем целый арсенал инструментов для предобработки, каждый из которых играет свою роль. Регулярные выражения, например, помогают нам быстро и эффективно очищать текст от ненужных символов, ссылок, HTML-тегов или извлекать конкретные паттерны. Затем в дело вступают токенизация, стемминг и лемматизация – три кита, на которых держится понимание структуры языка. Давайте углубимся в эти базовые, но критически важные концепции, которые мы применяем в каждом нашем проекте.

Регулярные Выражения (re): Наш Щит и Меч

Регулярные выражения, или сокращенно "регексы", — это мощный язык для поиска и манипулирования строками. Мы часто сравниваем их с универсальным инструментом, который позволяет нам "вырезать" нужные части текста или "зачищать" его от мусора. Будь то удаление HTML-тегов из веб-страницы, извлечение электронных адресов или номеров телефонов, или просто очистка от лишних пробелов — регексы всегда приходят на помощь. Мы обнаружили, что глубокое понимание регулярных выражений значительно ускоряет и упрощает процесс предобработки.

В Python для работы с регулярными выражениями мы используем встроенный модуль re. Он предоставляет все необходимые функции для поиска, замены и разделения строк по заданным шаблонам. Например, чтобы удалить все небуквенные символы или привести текст к нижнему регистру, мы применяем простые, но эффективные регекс-паттерны. Это позволяет нам привести текст к унифицированному виду, что крайне важно для последующего машинного анализа. Мы всегда рекомендуем начинающим уделить достаточно времени изучению этого инструмента, ведь он сэкономит вам часы ручной работы.

Токенизация, Стемминг и Лемматизация: Разбираем Слова по Косточкам

После первичной очистки текста мы переходим к его структурированию. Первым шагом является токенизация — процесс разделения текста на отдельные смысловые единицы, или "токены". Чаще всего токенами являются слова, но это могут быть и предложения, или даже отдельные символы, в зависимости от задачи. Для нас токенизация — это как разбор здания на отдельные кирпичи, чтобы потом из них можно было построить что-то новое.

Далее мы сталкиваемся с проблемой различных форм одного и того же слова. Например, "бежать", "бежит", "бежал" — все они относятся к одному корню. Здесь на помощь приходят стемминг и лемматизация. Стемминг, это процесс отсечения окончаний и суффиксов, чтобы привести слово к его "основе" (стволу). Например, "running", "runs", "ran" могут быть сведены к "run". Это быстрый и эффективный метод, но у него есть свои недостатки: стволы не всегда являются реальными словами.

Лемматизация, в отличие от стемминга, более интеллектуальный процесс. Она приводит слова к их словарной форме, или "лемме", используя морфологический анализ. Так, "лучше" станет "хорошо", а "были" — "быть". Для нас лемматизация предпочтительнее в большинстве случаев, так как она сохраняет смысл слов и их грамматическую корректность, что критично для задач, требующих глубокого понимания контекста. В продвинутых случаях мы используем библиотеки, такие как Stanza, особенно для языков с богатой морфологией, где простые стеммеры не справляются.

"Язык, это дорожная карта культуры. Он показывает, откуда пришли ее люди и куда они идут."

— Рита Мэй Браун

Наши Любимые Инструменты: Библиотеки Python для NLP

Python предлагает невероятное богатство библиотек, которые значительно упрощают разработку NLP-приложений. Наш опыт показывает, что выбор правильного инструмента для конкретной задачи, это уже половина успеха. Мы регулярно используем целый набор библиотек, каждая из которых имеет свои сильные стороны и идеально подходит для определенных этапов работы с текстом. Давайте рассмотрим те, которые стали нашими незаменимыми помощниками.

NLTK: Наш Стартовый Набор

Когда мы только начинали свой путь в NLP, библиотека NLTK (Natural Language Toolkit) была нашим первым и главным учителем. Это своего рода "швейцарский нож" для лингвистов и разработчиков, предоставляющий обширный набор инструментов для токенизации, стемминга, лемматизации, POS-теггинга (разметки частей речи) и многого другого. NLTK идеально подходит для обучения и экспериментов, позволяя нам быстро прототипировать и понимать фундаментальные концепции NLP.

Мы часто используем NLTK для:

- Токенизации: Как слов, так и предложений.

- Стемминга: С помощью различных алгоритмов, таких как Porter или Snowball.

- POS-теггинга: Определения части речи каждого слова в предложении, что очень помогает в дальнейшем анализе.

- Работы со стоп-словами: Удаления часто встречающихся, но малоинформативных слов (например, "и", "в", "на"), что улучшает качество моделей.

NLTK также включает в себя множество корпусов и лексических ресурсов, что делает его бесценным для исследований и разработки. Однако, для очень больших данных или задач, требующих высокой производительности, мы часто обращаемся к другим библиотекам;

spaCy: Скорость и Эффективность для Продакшена

Если NLTK — это наш учебный полигон, то spaCy — наш боевой конь. Эта библиотека разработана с упором на производительность и предназначена для использования в реальных проектах. Мы ценим spaCy за его невероятную скорость, встроенные предварительно обученные модели для различных языков и удобный API. Это наш выбор номер один для задач, требующих быстрого и точного распознавания именованных сущностей (NER), синтаксического анализа и лемматизации.

Что мы особенно любим в spaCy:

- NER (Named Entity Recognition): spaCy умеет автоматически находить в тексте имена людей, организации, местоположения, даты и другие сущности. Это незаменимо для извлечения информации.

- Синтаксический парсинг: Библиотека строит дерево зависимостей для каждого предложения, показывая грамматические связи между словами. Это позволяет нам глубоко анализировать структуру предложений.

- Векторы слов: spaCy поставляется с предварительно обученными векторами слов, что позволяет нам сразу же работать с семантикой слов.

- Обработка многоязычных текстовых корпусов: Мы активно используем spaCy для работы с текстами на разных языках, включая русский, благодаря наличию качественных языковых моделей.

Для нас spaCy — это стандарт де-факто для многих производственных задач, где скорость и точность играют ключевую роль.

TextBlob: Простота в Действии для Быстрых Задач

Иногда нам нужно быстро выполнить простую NLP-задачу, не вдаваясь в сложные детали. В таких случаях мы обращаемся к TextBlob. Это библиотека, построенная поверх NLTK, которая предоставляет простой API для общих NLP-операций, таких как анализ тональности, POS-теггинг, извлечение фраз и перевод. Мы считаем TextBlob отличным инструментом для быстрого прототипирования и для тех, кто только начинает знакомство с NLP.

Вот несколько примеров того, для чего мы используем TextBlob:

- Простой анализ тональности: Быстро оценить, является ли текст позитивным, негативным или нейтральным.

- Извлечение существительных: Легко получить список ключевых существительных из текста.

- Перевод: Интеграция с Google Translate позволяет быстро переводить тексты.

Конечно, TextBlob имеет свои ограничения в плане глубины анализа и производительности по сравнению с spaCy или Transformer-моделями, но для многих повседневных задач его простота бесценна.

Gensim: Вглубь Смысла Слов и Документов

Gensim — это библиотека, которая изменила наш подход к работе с семантикой текста. Мы используем её для тематического моделирования и для создания векторных представлений слов и документов. Gensim отлично работает с большими текстовыми корпусами и предлагает эффективные реализации таких алгоритмов, как LDA (Латентное размещение Дирихле) и LSI (Латентное семантическое индексирование).

Наш опыт с Gensim включает:

- Тематическое моделирование: Мы применяем LDA для выявления скрытых тем в больших коллекциях документов, что позволяет нам понять основные направления обсуждений в отзывах клиентов или новостных статьях.

- Word Embeddings (Векторы слов): С помощью Gensim мы обучаем модели Word2Vec и Doc2Vec. Эти модели позволяют нам представлять слова и целые документы в виде плотных векторов, которые отражают их семантическое значение. Это открывает двери для поиска синонимов, определения схожести документов и создания рекомендательных систем.

- Сравнение моделей тематического моделирования: Мы регулярно сравниваем LDA и NMF (Неотрицательная матричная факторизация) для различных задач, чтобы выбрать наиболее подходящий подход.

Gensim особенно полезен, когда нам нужно работать с семантическим уровнем текста, выходя за рамки простого подсчета слов.

Scikit-learn: Классика Машинного Обучения для Текста

Для задач классификации текстов, кластеризации и других традиционных методов машинного обучения, Scikit-learn является нашим незаменимым инструментом. Мы интегрируем его с результатами предобработки и векторизации текста, чтобы строить мощные классификаторы и кластеризаторы. Scikit-learn предоставляет обширный набор алгоритмов и утилит, которые мы используем для решения самых разнообразных задач.

Как мы применяем Scikit-learn в NLP:

- Классификация текстов: От определения спама до категоризации статей и анализа тональности, мы используем такие алгоритмы, как SVM (Метод опорных векторов), Наивный байесовский классификатор, Логистическая регрессия.

- Разработка собственных векторизаторов текста: Мы используем

CountVectorizerиTfidfVectorizerдля преобразования текстовых данных в числовые векторы, которые затем подаются на вход моделям машинного обучения. - Кластеризация текстов: Для поиска естественных групп в коллекции документов без предварительной разметки, мы применяем K-Means или DBSCAN, используя Scikit-learn.

- Оценка качества моделей: Мы активно используем метрики, такие как F1-score, Precision, Recall, предоставляемые Scikit-learn, для объективной оценки производительности наших NER-моделей и классификаторов.

Scikit-learn — это основа для построения многих наших NLP-систем, особенно когда речь идет о контролируемом или неконтролируемом обучении на текстовых данных.

Глубокое Погружение: От Векторов к Трансформерам

Мир NLP не стоит на месте, и мы вместе с ним. Если раньше мы полагались на простые статистические модели, то сейчас на передний план выходят более сложные подходы, основанные на глубоком обучении. Эти методы позволяют машинам не просто обрабатывать слова, но и "понимать" их в контексте, улавливать нюансы и даже генерировать связный и осмысленный текст. Мы активно исследуем и внедряем эти продвинутые техники в нашу работу.

Word Embeddings: От Слов к Смысловым Векторам

Одним из ключевых прорывов в NLP стало создание векторных представлений слов, или Word Embeddings. Вместо того чтобы рассматривать слова как дискретные сущности, мы теперь можем представлять их в виде плотных числовых векторов в многомерном пространстве. Слова с похожим значением оказываются близко друг к другу в этом пространстве. Это изменило все, позволив моделям машинного обучения работать с семантикой языка. Мы активно используем несколько подходов к созданию таких векторов:

- Word2Vec и GloVe: Это классические методы, которые мы применяем с помощью Gensim. Word2Vec (Skip-gram и CBOW) обучается на контексте слов, а GloVe использует глобальную статистику соо встречаемости. Мы часто сравниваем эти модели для разных задач, чтобы выбрать оптимальное решение.

- FastText: Разработанный Facebook AI, FastText расширяет Word2Vec, представляя слова как наборы n-грам символов. Это позволяет ему эффективно работать с редкими словами и даже со словами, которых он не видел в обучающих данных, что делает его крайне полезным для языков с богатой морфологией.

- Векторизация предложений и документов (Doc2Vec, Sentence Transformers): Для представления не отдельных слов, а целых предложений или документов, мы обращаемся к Doc2Vec (расширению Word2Vec) или к более современным Sentence Transformers. Последние позволяют нам получать высококачественные векторные представления, сохраняющие смысл всего предложения, что бесценно для задач поиска схожих документов или суммаризации.

Векторизация текста с учетом контекста, или контекстное встраивание, стало следующим большим шагом. Оно позволяет одному и тому же слову иметь разные векторные представления в зависимости от окружающего его контекста, что гораздо ближе к тому, как люди понимают язык.

Трансформеры и Hugging Face: Революция в Глубоком NLP

Архитектура Трансформеров и библиотека Hugging Face Transformers полностью изменили ландшафт NLP за последние несколько лет. Модели, такие как BERT, GPT, T5, стали основой для решения самых сложных задач: от машинного перевода до генерации текста и вопросно-ответных систем. Мы активно используем Hugging Face, так как она предоставляет легкий доступ к сотням предварительно обученных моделей и позволяет нам быстро адаптировать их под наши нужды.

Что мы делаем с Трансформерами:

- BERT для классификации и NER: Мы тонко настраиваем (fine-tuning) предварительно обученные модели BERT для задач классификации текстов (например, анализ тональности финансовых новостей) и распознавания именованных сущностей (NER). BERT позволяет нам достигать беспрецедентной точности благодаря своему глубокому пониманию контекста.

- GPT для генерации текста: Для задач, где требуется создание нового, связного текста (например, суммаризация, генерация диалогов для чат-ботов, или даже автоматическое создание контента), мы используем модели семейства GPT. Это позволяет нам не только анализировать, но и производить текст, имитируя человеческий стиль.

- Машинный перевод: Transformer-модели стали стандартом де-факто для машинного перевода. Мы разрабатываем и используем системы, способные переводить тексты, в т.ч. узкоспециализированные, с высокой точностью.

- Анализ эмоций и связей: Используя трансформерные архитектуры, мы можем распознавать эмоции в тексте, а также выявлять сложные связи между сущностями, что крайне важно для глубокого анализа данных.

Работа с Трансформерами требует понимания глубокого обучения, но благодаря Hugging Face, порог входа стал значительно ниже, и мы можем сосредоточиться на решении прикладных задач.

Прикладные Задачи и Особенности Работы с Текстом

Теория и инструменты, это здорово, но настоящий кайф начинается, когда мы видим, как все это применяется на практике. За годы работы мы сталкивались с огромным разнообразием задач, где NLP играет ключевую роль. От анализа отзывов до создания интеллектуальных систем — каждый проект приносит новые вызовы и открывает новые горизонты. Мы хотим поделиться с вами некоторыми из наиболее интересных и актуальных направлений.

Тематическое Моделирование: Открываем Скрытые Смыслы

Часто перед нами стоит задача понять, о чем говорят люди в огромных массивах текста, не имея предварительных категорий. Здесь на помощь приходит тематическое моделирование — набор алгоритмов, которые позволяют нам автоматически выявлять скрытые темы в коллекции документов. Мы используем его для анализа клиентских отзывов, новостных лент, форумов и блогов.

Наиболее часто мы применяем:

- LDA (Latent Dirichlet Allocation): Классический алгоритм, который позволяет нам определить распределение тем в каждом документе и распределение слов в каждой теме. Мы используем его, например, для анализа отзывов о продуктах по категориям, чтобы понять, какие аспекты продукта наиболее обсуждаемы.

- LSI (Latent Semantic Indexing): Более старый, но все еще эффективный метод, основанный на сингулярном разложении матрицы «терм-документ».

- NMF (Non-negative Matrix Factorization): Альтернатива LDA, часто дающая более интерпретируемые результаты в некоторых случаях. Мы регулярно сравниваем LDA и NMF, чтобы выбрать метод, который лучше всего раскрывает скрытые темы для конкретного набора данных.

Тематическое моделирование позволяет нам быстро получить высокоуровневое представление о содержании больших текстовых массивов, что бесценно для принятия стратегических решений.

Анализ Тональности (Sentiment Analysis): Чувства в Данных

Понимание эмоциональной окраски текста — одна из самых востребованных задач в NLP. Будь то отзывы клиентов, сообщения в социальных сетях или новостные заголовки, знание тональности позволяет нам оценить общественное мнение, предсказать тренды или отреагировать на негатив. Мы подходим к анализу тональности комплексно:

- Словарные методы (VADER): Для быстрого анализа англоязычных текстов мы часто используем VADER (Valence Aware Dictionary and sEntiment Reasoner), который учитывает не только слова, но и их интенсивность, использование заглавных букв и пунктуацию.

- Машинное обучение: Для более точного и специфичного анализа (например, анализ тональности финансовых новостей или отзывов о фильмах), мы обучаем собственные классификаторы с использованием Scikit-learn или трансформерных моделей.

- Работа со сложностями: Мы знаем, что анализ тональности сообщений в социальных сетях часто требует учета сарказма, сленга и эмодзи. Для этого мы разрабатываем инструменты для нормализации сленга и используем продвинутые модели, способные распознавать эти тонкости.

Анализ тональности — это не просто «позитив/негатив», это глубокое понимание человеческих эмоций, выраженных в тексте.

Распознавание Именованных Сущностей (NER): Ищем Важное

Представьте, что вам нужно извлечь все имена людей, названия компаний, даты и местоположения из тысяч юридических документов или новостных статей. Вручную это невозможно. Здесь на помощь приходит NER — задача по обнаружению и классификации именованных сущностей в тексте. Для нас это один из самых часто используемых инструментов для извлечения структурированной информации из неструктурированных данных.

Наши подходы к NER:

- spaCy: Как мы уже упоминали, spaCy с его предварительно обученными моделями является нашим первым выбором для быстрого и точного NER.

- Библиотека Flair: Для современного и высокоточного NER, особенно на сложных или специфичных данных, мы используем Flair. Она основана на глубоких нейронных сетях и часто дает превосходные результаты.

- CRF (Conditional Random Fields): В некоторых случаях, особенно когда у нас есть небольшие, но хорошо размеченные данные, мы используем CRF для распознавания сущностей, так как они хорошо работают с последовательностями.

- Автоматическая разметка сущностей: Мы также разрабатываем инструменты для автоматической разметки данных, что помогает нам быстро создавать обучающие выборки для наших NER-моделей.

NER — это ключ к превращению сырого текста в базу данных, готовую к дальнейшему анализу.

Разработка Интеллектуальных Систем: От Чат-ботов до Суммаризации

Конечная цель многих наших NLP-проектов, создание интеллектуальных систем, которые могут взаимодействовать с пользователями или автоматизировать сложные текстовые задачи. Мы накопили богатый опыт в разработке таких систем:

- Чат-боты на Python (Rasa framework): Мы создаем умных чат-ботов, используя фреймворк Rasa. Он позволяет нам строить диалоговые системы, способные понимать намерения пользователя, извлекать сущности из его запросов и генерировать осмысленные ответы.

- Системы вопросно-ответных систем (QA): Для автоматического поиска ответов на вопросы в большом корпусе документов мы разрабатываем QA-системы, часто используя Transformer-модели, которые отлично справляются с этой задачей.

- Суммаризация текста (Abstractive vs Extractive): Мы работаем над системами, которые могут автоматически генерировать краткое содержание длинных текстов. Экстрактивная суммаризация извлекает наиболее важные предложения из оригинального текста, а абстрактивная генерирует новое содержание, перефразируя исходный текст. Для этого мы используем библиотеки TextRank и Transformer-модели.

- Автоматическая категоризация и тегирование: Мы разрабатываем системы для автоматической категоризации статей, новостей или других документов, а также для создания тегов, что значительно упрощает навигацию и поиск информации.

- Машинный перевод: Используя PyTorch/TensorFlow и Transformer-модели, мы создаем нейросети для машинного перевода, в т.ч. для узкоспециализированных текстов.

Разработка таких систем, это всегда вызов, но и огромное удовольствие видеть, как наши программы начинают «думать» и «говорить».

Специфические Задачи и Наш Опыт

Помимо общих задач, в NLP существует множество нишевых направлений, каждое из которых требует особого подхода и инструментария. Мы накопили опыт работы с различными типами текстовых данных и специфическими требованиями, которые часто встречаются в реальных проектах.

Работа с «Грязными» Данными и Неполными Текстами

Реальные данные редко бывают идеальными. Мы часто сталкиваемся с неполными текстами, опечатками, грамматическими ошибками, сленгом и эмодзи. Обработка неструктурированного текста начинается с его тщательной очистки. Мы разрабатываем собственные инструменты для:

- Очистки текста от HTML-тегов: Используя Beautiful Soup для веб-скрейпинга и извлечения текста из веб-страниц, мы затем очищаем его от всех ненужных HTML-элементов.

- Исправления орфографии и грамматики: Мы экспериментируем с инструментами для проверки грамматики и исправления орфографии, чтобы повысить качество входных данных.

- Нормализации сленга и эмодзи: Для анализа современных текстов, особенно из социальных сетей, мы разрабатываем словари и правила для нормализации сленга и корректной обработки эмодзи.

- Извлечения текста из PDF: С помощью PyMuPDF мы извлекаем текстовые данные из PDF-документов, что является частой задачей в корпоративной среде.

Проблемы обработки неполных и ошибочных данных — это то, с чем мы сталкиваемся постоянно, и разработка надежных решений для очистки данных является одним из наших приоритетов.

Сравнение и Оптимизация Моделей

В NLP редко бывает "одно правильное" решение. Мы постоянно сравниваем различные подходы и алгоритмы, чтобы выбрать наиболее эффективный для конкретной задачи. Это касается всего: от токенизаторов до методов векторизации и моделей глубокого обучения.

Вот некоторые из наших регулярных сравнений:

| Категория | Методы / Библиотеки | Критерии Сравнения |

|---|---|---|

| Лемматизация | SpaCy vs NLTK (WordNetLemmatizer) | Точность, скорость, поддержка языков |

| Векторизация текста | TF-IDF vs Word2Vec vs Doc2Vec | Семантическая глубина, размерность, производительность |

| Тематическое моделирование | LDA vs NMF vs LSI | Интерпретируемость тем, качество кластеризации |

| Классификация текста | SVM, Наивный Байес, Трансформеры | Точность, скорость обучения, устойчивость к шуму |

Оценка качества NER-моделей с помощью таких метрик, как F1-score, Precision и Recall, является стандартной практикой для нас, чтобы убедиться в надежности наших решений.

Анализ Стилистики и Авторства

Иногда нам приходится погружаться в более тонкие аспекты текста, такие как его стилистика или даже определение авторского почерка. Это может быть полезно для анализа юридических документов, выявления плагиата или изучения литературных произведений. Мы используем различные методы для анализа лексического богатства текстов, частотности слов и n-грамм, а также для выявления уникальных стилистических паттернов.

Для этих задач мы можем применять:

- Библиотеку Textacy для работы с зависимостями и извлечения информации.

- Специализированные инструменты для создания словарей и тезаурусов.

- Методы машинного обучения для определения авторства текста, основываясь на стилистических характеристиках.

- Библиотеку Jellyfish для сравнения строк и поиска сходств, что полезно для систем обнаружения плагиата.

Такой глубокий анализ позволяет нам не просто понять "что сказано", но и "как сказано", и "кем сказано".

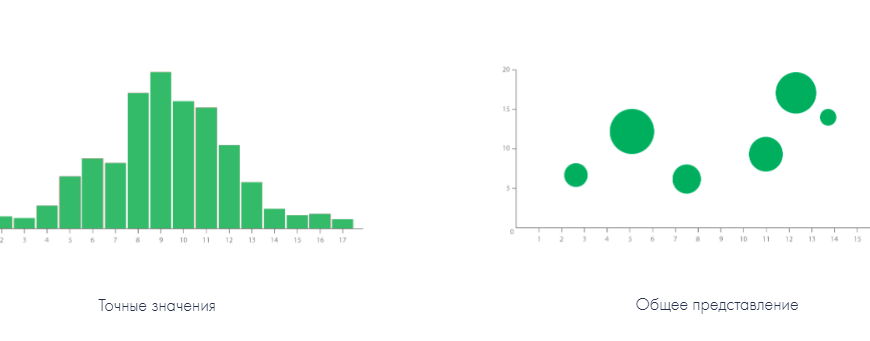

Визуализация и Большие Данные

Когда мы работаем с огромными текстовыми массивами (Big Data NLP), визуализация становится нашим лучшим другом. Она помогает нам быстро понять распределение данных, выявить аномалии и представить результаты анализа в наглядной форме. Мы используем различные инструменты для визуализации текстовых данных:

- Облака слов (Word Clouds): Для быстрого представления наиболее часто встречающихся слов.

- Тепловые карты (Heatmaps): Для визуализации матриц сходства слов или документов.

- Графики распределения: Для анализа частотности слов, n-грамм или распределения тональности.

Кроме того, мы активно используем библиотеки, такие как Sweetviz, для анализа текстовых данных, что позволяет нам получать быстрые инсайты и автоматизированные отчеты о качестве данных.

Итак, дорогие друзья, мы проделали с вами долгий путь по невероятно обширному и динамичному миру обработки естественного языка с помощью Python. Мы показали, как от базовой предобработки текста и использования классических библиотек, таких как NLTK и spaCy, мы переходим к более сложным концепциям: векторным представлениям слов, тематическому моделированию и, конечно же, к революционным Transformer-моделям. Мы поделились нашим опытом в решении самых разнообразных задач – от анализа тональности и распознавания сущностей до разработки чат-ботов и систем суммаризации.

Мир NLP развивается с ошеломляющей скоростью, и мы убеждены, что его потенциал еще далек от исчерпания. Каждый день появляются новые алгоритмы, модели и инструменты, которые делают возможным то, о чем еще вчера мы могли только мечтать. Мы постоянно учимся, экспериментируем и внедряем самые передовые технологии, чтобы наши проекты оставались на острие прогресса. Для нас это не просто работа, это страсть, это постоянное стремление к тому, чтобы машины понимали нас еще лучше, а мы — их. Мы приглашаем вас продолжать этот путь вместе с нами, исследовать, создавать и открывать новые горизонты в этом захватывающем мире. Успехов вам в ваших NLP-проектах!

На этом статья заканчивается.

Подробнее

| NLP Python библиотеки | Токенизация стемминг лемматизация | Анализ тональности Python | Трансформеры Hugging Face | Распознавание именованных сущностей NER |

| Тематическое моделирование LDA | Word Embeddings Word2Vec | Чат-боты Python Rasa | Очистка текста Python | Машинный перевод NLP |