- От Базовых Слов к Глубоким Смыслам: Наш Полный Путеводитель по NLP с Python

- Наш Первый Шаг: Основы Предобработки Текста – Фундамент Всех Задач NLP

- Токенизация и Стемминг: Разбираем Текст на Элементы с NLTK

- Продвинутая Лемматизация: За Гранью Стемминга

- Регулярные Выражения (re) в Предобработке Текста

- Могучие Инструменты: Библиотеки Python для Глубокого Погружения

- Использование spaCy для Быстрого NER и Синтаксического Парсинга

- Библиотека Gensim для Тематического Моделирования (LDA‚ LSI)

- Применение Scikit-learn для Классификации Текстов

- Разработка Собственных Векторизаторов Текста (CountVectorizer‚ TfidfVectorizer)

- Глубокое Понимание: От Слов к Смыслам с Векторными Представлениями

- Word Embeddings: Word2Vec и GloVe с Использованием Gensim

- Векторизация Предложений и Документов (Doc2Vec‚ Sentence Transformers)

- Современные Чудеса: Трансформеры и Глубокое Обучение в NLP

- Трансформеры (Hugging Face) для Сложных Задач NLP

- Применение PyTorch/TensorFlow для Создания Нейросетей NLP

- Практическое Применение: NLP в Реальном Мире

- Анализ Тональности (Sentiment Analysis): Отзывы‚ Соцсети‚ Финансы

- Разработка Систем Суммаризации Текста (Abstractive vs Extractive)

- Библиотека Beautiful Soup для Веб-Скрейпинга Текста

- Разработка Чат-ботов на Python (Rasa framework)

- Анализ Текста для Извлечения Ключевых Фраз и Ключевых Слов

- Расширенные Горизонты: Многоязычность‚ Ошибки и Эффективность

- Обработка Многоязычных Текстовых Корпусов и Редких Языков

- Проблемы Обработки Неполных и Ошибочных Данных

- Визуализация Текстовых Данных (Word Clouds‚ Heatmaps)

- Будущее NLP: Постоянное Развитие и Новые Горизонты

- Разработка Систем Обнаружения Плагиата и Проверки Фактов

- Анализ Стилистики Текстов (Авторский Почерк)

- Обработка Больших Текстовых Массивов (Big Data NLP)

От Базовых Слов к Глубоким Смыслам: Наш Полный Путеводитель по NLP с Python

Приветствуем вас‚ дорогие читатели‚ в нашем увлекательном путешествии по миру Обработки Естественного Языка (NLP)! Мы‚ как опытные исследователи и энтузиасты Python‚ хотим поделиться с вами нашим обширным опытом и знаниями‚ которые мы накопили‚ работая с текстами и превращая их из простой последовательности символов в нечто осмысленное и полезное․ Сегодня мы раскроем все карты и покажем‚ как Python стал нашим незаменимым инструментом в этом сложнейшем‚ но невероятно захватывающем деле․

Мир вокруг нас буквально пронизан текстом: от электронных писем и сообщений в социальных сетях до юридических документов и научных статей․ Способность машин понимать‚ интерпретировать и даже генерировать человеческий язык, это не просто научная фантастика‚ это реальность‚ которую мы строим с помощью NLP․ Мы видим в этом не только технологический прорыв‚ но и мост между миром людей и миром алгоритмов‚ позволяющий автоматизировать рутинные задачи‚ находить скрытые инсайты и создавать совершенно новые интерактивные возможности․ Наша цель – не просто перечислить инструменты‚ а показать вам‚ как они работают‚ зачем нужны и как мы применяем их на практике․

Наш Первый Шаг: Основы Предобработки Текста – Фундамент Всех Задач NLP

Прежде чем машина сможет "понять" текст‚ его нужно подготовить․ Представьте‚ что вы строите дом: нельзя сразу класть крышу‚ не заложив фундамент․ В NLP этот фундамент – предобработка текста․ Мы всегда начинаем с этого этапа‚ потому что качество наших результатов напрямую зависит от чистоты и структурированности входных данных․ Без должной предобработки‚ даже самые продвинутые модели будут работать хуже‚ чем могли бы․

Токенизация и Стемминг: Разбираем Текст на Элементы с NLTK

Первое‚ что мы делаем‚ это токенизация – процесс разделения текста на отдельные слова или символы‚ которые называются токенами․ Это критически важный шаг‚ так как компьютеры не понимают целые предложения‚ им нужны дискретные единицы․ Для этого мы часто используем библиотеку NLTK (Natural Language Toolkit)‚ которая является настоящим швейцарским ножом для базовых задач NLP․ NLTK предоставляет множество токенизаторов‚ позволяющих гибко настроить процесс разделения․

После токенизации мы часто прибегаем к стеммингу․ Стемминг – это процесс сокращения слова до его корневой формы‚ или "стема"․ Например‚ слова "бежать"‚ "бежит"‚ "бежал" будут приведены к одному и тому же стему‚ что помогает снизить размер словаря и обрабатывать различные формы одного и того же слова как одно целое․ NLTK предлагает различные алгоритмы стемминга‚ такие как PorterStemmer и SnowballStemmer‚ каждый со своими особенностями․ Мы выбираем их в зависимости от языка и специфики задачи‚ понимая‚ что стемминг может быть довольно агрессивным и иногда отсекать лишнее․

Продвинутая Лемматизация: За Гранью Стемминга

Хотя стемминг и полезен‚ у него есть свои недостатки: он может создавать несуществующие слова․ Например‚ "красота" и "красивый" могут быть сведены к "красот"‚ что не является реальным словом․ Здесь на помощь приходит лемматизация․ Лемматизация – это более сложный процесс‚ который приводит слово к его базовой словарной форме (лемме)‚ используя морфологический анализ и словарь․ Например‚ "бежать"‚ "бежит"‚ "бежал" будут приведены к "бежать"․ Для лемматизации мы предпочитаем использовать spaCy или NLTK с WordNet‚ так как они обеспечивают более точные результаты․

Наш опыт показывает‚ что выбор между стеммингом и лемматизацией всегда зависит от конкретной задачи․ Для быстрого прототипирования или задач‚ где небольшая потеря семантики некритична‚ стемминг вполне подойдет․ Но для более точного анализа‚ например‚ в вопросно-ответных системах или анализе тональности‚ лемматизация почти всегда дает лучшие результаты․

Регулярные Выражения (re) в Предобработке Текста

Невозможно говорить о предобработке текста без упоминания регулярных выражений․ Модуль `re` в Python – это наш верный помощник‚ когда дело доходит до очистки текста от ненужных символов‚ URL-адресов‚ хештегов‚ упоминаний‚ HTML-тегов и других "шумов"․ Мы используем их для:

- Удаления пунктуации․

- Приведения текста к нижнему регистру․

- Удаления стоп-слов (артиклей‚ предлогов и т․д․‚ которые не несут смысловой нагрузки)․

- Извлечения специфических паттернов‚ таких как даты‚ номера телефонов или email-адреса․

Гибкость регулярных выражений позволяет нам точно контролировать процесс очистки‚ адаптируя его под каждый новый набор данных․

Могучие Инструменты: Библиотеки Python для Глубокого Погружения

После того как текст очищен и подготовлен‚ наступает время для его анализа․ Здесь на сцену выходят специализированные библиотеки‚ каждая из которых предлагает уникальные возможности для решения конкретных задач NLP․ Мы хотим рассказать о тех‚ которые стали нашими незаменимыми помощниками․

Использование spaCy для Быстрого NER и Синтаксического Парсинга

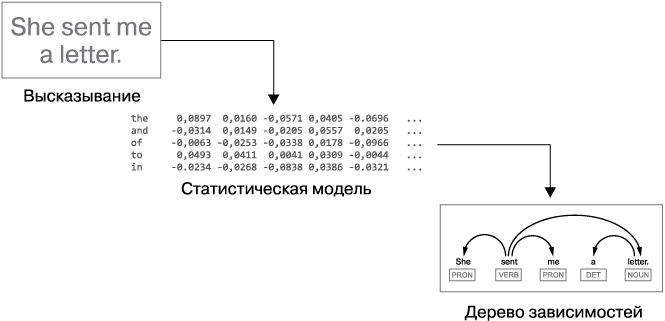

Когда нам нужна скорость и точность‚ особенно для распознавания именованных сущностей (NER) и синтаксического парсинга‚ мы обращаемся к spaCy․ Это современная и очень эффективная библиотека‚ которая превосходит NLTK по производительности во многих аспектах․ NER позволяет нам автоматически находить и классифицировать сущности в тексте‚ такие как имена людей‚ организации‚ местоположения‚ даты и денежные суммы․

| Функционал | NLTK | spaCy |

|---|---|---|

| Токенизация | Широкий выбор токенизаторов‚ но часто медленнее․ | Очень быстрая и эффективная․ |

| Лемматизация | Требует WordNet‚ менее эффективна․ | Встроена‚ высокоточна‚ основана на статистических моделях․ |

| NER | Базовые возможности‚ часто менее точны․ | Высокоточные‚ предобученные модели для многих языков․ |

| Синтаксический парсинг | Ограниченные возможности․ | Предоставляет полную структуру зависимостей предложений․ |

| Производительность | Хорошо для исследований‚ но не всегда для продакшена․ | Оптимизирована для скорости и использования в продакшене․ |

Синтаксический парсинг со spaCy позволяет нам строить дерево зависимостей‚ показывая‚ как слова в предложении связаны друг с другом․ Это бесценно для понимания структуры предложений и извлечения более глубокого смысла‚ например‚ для систем вопросно-ответных систем или анализа отношений между сущностями․

Библиотека Gensim для Тематического Моделирования (LDA‚ LSI)

Когда мы сталкиваемся с большими коллекциями документов и хотим понять‚ какие скрытые темы в них присутствуют‚ мы обращаемся к Gensim․ Эта библиотека специализируется на неконтролируемом тематическом моделировании․ Мы используем её для:

- LDA (Latent Dirichlet Allocation): Позволяет нам обнаруживать скрытые "темы" в коллекции документов․ Каждый документ рассматривается как смесь тем‚ а каждая тема – как смесь слов․ Это помогает нам классифицировать документы и понять их основное содержание․

- LSI (Latent Semantic Indexing): Также используется для обнаружения скрытых семантических структур в тексте‚ но использует другой математический подход (сингулярное разложение)․

Gensim также отлично справляется с обработкой больших корпусов текста‚ работая "вне памяти"‚ что крайне важно при работе с Big Data․

Применение Scikit-learn для Классификации Текстов

Scikit-learn – это фундаментальная библиотека машинного обучения в Python‚ и она‚ конечно же‚ находит широкое применение в NLP․ Мы используем её для задач классификации текста‚ таких как:

- Классификация спама: Отделение нежелательных писем от полезных․

- Категоризация статей: Автоматическое присвоение статей к определенным категориям (спорт‚ политика‚ технологии)․

- Анализ тональности: Определение эмоциональной окраски текста (положительная‚ отрицательная‚ нейтральная)․

Scikit-learn предоставляет нам широкий спектр алгоритмов: от наивного байесовского классификатора и логистической регрессии до SVM (Support Vector Machines) и случайных лесов․ Прежде чем применить эти алгоритмы‚ мы векторизуем текст‚ превращая его в числовое представление‚ понятное машинам․

Разработка Собственных Векторизаторов Текста (CountVectorizer‚ TfidfVectorizer)

Как мы только что упомянули‚ для машинного обучения текст должен быть представлен в числовом виде․ Здесь нам на помощь приходят векторизаторы․

- CountVectorizer: Создает матрицу‚ где каждая строка представляет документ‚ а каждый столбец – уникальное слово из всего корпуса․ Значение в ячейке – это количество раз‚ которое слово встречается в документе․ Это простой‚ но эффективный метод․

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): Более продвинутый метод‚ который не просто считает слова‚ но и взвешивает их по их важности․ Он учитывает‚ насколько часто слово встречается в конкретном документе (TF) и насколько редко оно встречается во всем корпусе документов (IDF)․ Таким образом‚ слова‚ которые встречаются повсеместно (например‚ "и"‚ "в"‚ "на")‚ получают меньший вес‚ а уникальные и информативные слова – больший․

Мы часто начинаем с TF-IDF‚ так как он обычно дает более осмысленные результаты‚ чем простое количество слов․

Глубокое Понимание: От Слов к Смыслам с Векторными Представлениями

Простое подсчитывание слов или TF-IDF имеет свои ограничения: они не улавливают семантические отношения между словами․ Например‚ "король" и "королева" с точки зрения этих методов будут такими же различными‚ как "король" и "банан"․ Для более глубокого понимания семантики нам нужны векторные представления слов и предложений․

Word Embeddings: Word2Vec и GloVe с Использованием Gensim

Word Embeddings (векторные представления слов) – это мощная концепция‚ которая позволяет нам представить слова в виде плотных векторов в многомерном пространстве․ Идея в том‚ что слова‚ которые часто встречаются в похожих контекстах‚ будут иметь схожие векторные представления․ Это означает‚ что математически мы можем увидеть‚ что "король" и "королева" находятся ближе друг к другу в этом пространстве‚ чем "король" и "банан"․

Мы активно используем модели Word2Vec и GloVe:

- Word2Vec (от Google): Мы обучаем его на больших текстовых корпусах․ Он имеет два основных алгоритма: Skip-gram (предсказывает контекстные слова по целевому слову) и CBOW (Continuous Bag of Words‚ предсказывает целевое слово по контексту)․ Gensim предоставляет отличные реализации Word2Vec․

- GloVe (Global Vectors for Word Representation‚ от Stanford): Этот метод основан на глобальной статистике совместной встречаемости слов․ Он также генерирует высококачественные векторные представления․

Эти эмбеддинги стали настоящим прорывом в NLP‚ позволяя нам решать задачи‚ которые ранее были немыслимы‚ такие как поиск синонимов‚ аналогии (король ─ мужчина + женщина = королева) и улучшение качества машинного перевода․

Векторизация Предложений и Документов (Doc2Vec‚ Sentence Transformers)

Если Word2Vec и GloVe работают на уровне слов‚ то для понимания целых предложений и документов нам нужны другие подходы․

- Doc2Vec (расширение Word2Vec): Позволяет нам создавать векторные представления для целых документов․ Это очень полезно для поиска похожих документов или кластеризации текстов․

- Sentence Transformers: Это более современные модели‚ основанные на трансформерах‚ которые способны генерировать высококачественные эмбеддинги для предложений․ Они превосходно справляются с задачей измерения семантического сходства между предложениями‚ что критично для задач суммаризации‚ вопросно-ответных систем и поиска похожих фраз․

"Язык – это дорожная карта культуры․ Он говорит вам‚ откуда пришли его люди и куда они идут․"

— Рита Мэй Браун

Современные Чудеса: Трансформеры и Глубокое Обучение в NLP

Последние несколько лет произвели революцию в NLP благодаря появлению архитектуры трансформеров и глубокого обучения․ Эти технологии изменили правила игры‚ позволив нам решать задачи‚ которые казались невозможными․

Трансформеры (Hugging Face) для Сложных Задач NLP

Архитектура трансформеров‚ представленная в 2017 году‚ стала краеугольным камнем для таких моделей‚ как BERT‚ GPT‚ RoBERTa и многих других․ Они используют механизм "внимания" (attention)‚ который позволяет моделям взвешивать важность различных слов в предложении при обработке‚ улавливая дальние зависимости‚ которые RNN и LSTM часто упускали․

Мы активно используем библиотеку Hugging Face Transformers․ Это наш основной инструмент для работы с предобученными моделями трансформеров․ С её помощью мы можем:

- Выполнять классификацию текста с беспрецедентной точностью (например‚ с BERT для задач классификации)․

- Распознавать именованные сущности (NER) с Flair или BERT-подобными моделями‚ достигая state-of-the-art результатов․

- Отвечать на вопросы (QA-системы) с помощью моделей‚ способных находить ответы в предоставленном тексте․

- Генерировать текст (с GPT и подобными моделями)‚ создавая связные и осмысленные предложения‚ статьи или даже код․

- Тонко настраивать (Fine-tuning) предварительно обученные модели под наши специфические задачи с относительно небольшим объемом данных․

Гибкость и доступность моделей Hugging Face делают их незаменимыми для любого продвинутого проекта NLP․

Применение PyTorch/TensorFlow для Создания Нейросетей NLP

Хотя Hugging Face предоставляет высокоуровневый API‚ иногда нам требуется полный контроль над архитектурой и процессом обучения․ В таких случаях мы обращаемся к фреймворкам глубокого обучения‚ таким как PyTorch и TensorFlow (с Keras)․ Мы используем их для:

- Создания собственных LSTM-сетей для последовательностей (например‚ для распознавания речи или предсказания следующего слова)․

- Разработки кастомных архитектур трансформеров‚ когда стандартные модели не подходят․

- Реализации систем машинного перевода с нуля или адаптации существующих моделей․

- Обработки текста с использованием GPU-ускорения для значительного сокращения времени обучения․

Эти фреймворки дают нам мощь и гибкость для экспериментов и создания по-настоящему инновационных решений․

Практическое Применение: NLP в Реальном Мире

Теория и инструменты – это одно‚ но реальная ценность NLP проявляется в его практическом применении․ Мы хотим показать‚ как эти технологии помогают нам решать повседневные и сложные задачи․

Анализ Тональности (Sentiment Analysis): Отзывы‚ Соцсети‚ Финансы

Анализ тональности – это одна из самых востребованных задач NLP․ Мы используем его для понимания общественного мнения‚ анализа отзывов клиентов и мониторинга брендов․

- VADER (Valence Aware Dictionary and sEntiment Reasoner): Для быстрого и эффективного анализа тональности на английском языке мы часто используем VADER из NLTK․ Он отлично подходит для текстов из социальных сетей‚ поскольку специально обучен на сленге и эмодзи․

- Модели на основе трансформеров: Для более сложных случаев‚ особенно с учетом сарказма или нюансов языка‚ мы обучаем или тонко настраиваем модели BERT/RoBERTa․

Мы анализируем тональность сообщений в социальных сетях (Twitter/Reddit)‚ отзывы о продуктах и услугах‚ а также финансовые новости‚ чтобы предсказывать изменения на рынке․

Разработка Систем Суммаризации Текста (Abstractive vs Extractive)

В мире переизбытка информации способность быстро получать суть длинных текстов неоценима․ Мы разрабатываем системы суммаризации текста‚ которые делятся на два основных типа:

- Экстрактивная суммаризация: Эта система извлекает наиболее важные предложения или фразы из оригинального текста и объединяет их для создания краткого обзора․ Мы используем такие методы‚ как TextRank (из библиотеки Textacy)‚ который строит граф предложений и ранжирует их по важности․

- Абстрактивная суммаризация: Более сложная задача‚ при которой система генерирует совершенно новые предложения‚ которые передают основной смысл исходного текста․ Для этого мы используем модели на основе трансформеров (например‚ из Hugging Face)‚ которые способны "понимать" контекст и создавать новый‚ связный текст․

Обе эти системы находят применение в новостных агрегаторах‚ юридических документах и корпоративных отчетах․

Библиотека Beautiful Soup для Веб-Скрейпинга Текста

Прежде чем мы сможем анализировать текст‚ его нужно откуда-то взять․ Часто источником становяться веб-страницы․ Для этого мы используем библиотеку Beautiful Soup в связке с `requests`․ Она позволяет нам парсить HTML и XML документы‚ извлекая нужный текст‚ ссылки‚ заголовки и другие элементы․ Это наш первый шаг к созданию собственного корпуса данных для обучения моделей или для анализа контента из открытых источников․

Разработка Чат-ботов на Python (Rasa framework)

Чат-боты стали неотъемлемой частью современного сервиса․ Мы активно участвуем в их разработке‚ часто используя фреймворк Rasa․ Rasa позволяет нам создавать контекстно-зависимых‚ диалоговых ботов‚ которые могут не только отвечать на вопросы‚ но и вести осмысленный диалог‚ запоминать предыдущие реплики и выполнять действия․ Это включает в себя распознавание намерений пользователя (intent recognition) и извлечение сущностей (entity extraction) из его запросов․

Анализ Текста для Извлечения Ключевых Фраз и Ключевых Слов

Когда нам нужно быстро понять основные идеи документа‚ мы извлекаем ключевые фразы и слова․ Для этого мы используем различные подходы:

- TF-IDF: Простой‚ но эффективный метод для выявления слов‚ которые являются наиболее характерными для данного документа по сравнению со всем корпусом․

- RAKE (Rapid Automatic Keyword Extraction): Алгоритм‚ который автоматически извлекает ключевые фразы из текста‚ основываясь на их частотности и встречаемости с другими словами․

- TextRank: Помимо суммаризации‚ TextRank также отлично подходит для извлечения ключевых слов и фраз‚ используя тот же подход‚ что и PageRank для веб-страниц․

Эти методы помогают нам создавать теги для статей‚ улучшать поиск и быстро классифицировать контент․

Расширенные Горизонты: Многоязычность‚ Ошибки и Эффективность

Мир не ограничивается одним языком‚ а данные редко бывают идеальными․ Мы сталкиваемся с этими вызовами ежедневно и разрабатываем решения для их преодоления․

Обработка Многоязычных Текстовых Корпусов и Редких Языков

Работа с текстами на разных языках требует особого подхода․ Мы используем:

- Библиотеки Polyglot и Stanza: Эти библиотеки отлично подходят для многоязычного NLP․ Polyglot предлагает широкий спектр функционала для многих языков‚ включая определение языка‚ токенизацию‚ NER․ Stanza (от Stanford NLP Group) особенно полезна для языков с богатой морфологией‚ таких как русский‚ предоставляя высококачественный синтаксический анализ и NER․

- Мультиязычные трансформеры: Модели‚ такие как mBERT (Multilingual BERT) или XLM-R‚ обученные на сотнях языков‚ позволяют нам применять одни и те же архитектуры для различных языков‚ значительно упрощая разработку многоязычных систем․

Это открывает перед нами возможности для создания систем машинного перевода‚ обработки отзывов от клиентов со всего мира и анализа глобальных тенденций․

Проблемы Обработки Неполных и Ошибочных Данных

Реальный мир полон неидеальных данных: опечатки‚ грамматические ошибки‚ сленг‚ сокращения․ Мы разработали ряд стратегий для работы с такими "грязными" данными:

- Инструменты для проверки грамматики и исправления орфографии: Мы можем использовать библиотеки‚ такие как `TextBlob` (для простого исправления) или более сложные модели на основе машинного обучения․

- Нормализация сленга и эмодзи: Создание словарей для перевода сленговых выражений и эмодзи в их стандартные формы‚ что критично для анализа социальных сетей․

- Библиотека Jellyfish и Textdistance: Для сравнения строк и поиска похожих слов (например‚ при опечатках) мы используем алгоритмы Левенштейна‚ Джаро-Винклера и другие‚ реализованные в этих библиотеках․ Это помогает нам "чистить" данные и повышать качество сопоставления․

Визуализация Текстовых Данных (Word Clouds‚ Heatmaps)

Понимание больших объемов текстовых данных часто начинается с визуализации․ Мы используем различные инструменты‚ чтобы сделать наши инсайты наглядными:

- Облака слов (Word Clouds): Простой‚ но эффективный способ показать наиболее часто встречающиеся слова в корпусе․ Чем больше слово‚ тем чаще оно встречается․

- Тепловые карты (Heatmaps): Мы используем их для визуализации матриц сходства документов или слов‚ а также для отображения распределения тем в документах․

- Графики распределения частотности: Позволяют нам увидеть‚ какие слова или n-граммы наиболее распространены․

Визуализация помогает нам быстро выявлять паттерны‚ аномалии и ключевые темы‚ что является отличным дополнением к количественному анализу․

Будущее NLP: Постоянное Развитие и Новые Горизонты

Мир NLP развивается с невероятной скоростью․ То‚ что еще вчера казалось фантастикой‚ сегодня уже становится стандартом․ Мы постоянно учимся‚ экспериментируем и внедряем новые технологии в нашу работу․

Разработка Систем Обнаружения Плагиата и Проверки Фактов

В эпоху "фейковых новостей" и легкодоступной информации‚ инструменты для проверки подлинности текста становятся критически важными․ Мы работаем над системами‚ которые могут:

- Обнаруживать плагиат: Сравнивая документы с огромными корпусами текстов‚ мы используем алгоритмы сравнения строк (TextDistance) и векторные представления документов (Doc2Vec) для выявления совпадений и перефразирований․

- Проверять факты (Fact-Checking): Используя комбинацию NER‚ извлечения отношений и поиска информации в базах знаний‚ мы стремимся создавать системы‚ которые могут автоматически проверять утверждения в тексте на соответствие известным фактам․

Анализ Стилистики Текстов (Авторский Почерк)

Каждый автор имеет свой уникальный стиль․ Анализ стилистики текста позволяет нам идентифицировать автора‚ выявлять подделки или анализировать эволюцию стиля писателя․ Мы используем метрики лексического богатства‚ частотность n-грамм‚ длину предложений и другие стилистические признаки‚ а затем применяем методы машинного обучения для классификации․ Это очень интересная область‚ которая находит применение в криминалистике и литературоведении․

Обработка Больших Текстовых Массивов (Big Data NLP)

С ростом объема доступных данных‚ способность обрабатывать гигантские текстовые массивы становится необходимостью․ Мы используем распределенные вычислительные системы и библиотеки‚ которые могут работать "вне памяти" (например‚ Gensim для тематического моделирования) или использовать параллельные вычисления (например‚ Dask)․ Оптимизация кода и эффективное использование ресурсов (включая GPU-ускорение) – это ключевые аспекты нашей работы с Big Data NLP․

Наше путешествие по миру NLP с Python – это бесконечный процесс обучения и открытий․ От базовой токенизации до сложнейших трансформерных моделей‚ каждый инструмент‚ каждая библиотека открывает новые возможности для понимания и взаимодействия с человеческим языком․ Мы надеемся‚ что наш опыт и знания‚ которыми мы с вами поделились‚ вдохновят вас на собственные исследования и помогут вам в ваших проектах․

Помните‚ что ключ к успеху в NLP – это не только знание инструментов‚ но и глубокое понимание лингвистических принципов‚ а также постоянная практика и эксперименты․ Мы видим огромный потенциал в этой области‚ и уверены‚ что в ближайшие годы нас ждут еще более захватывающие открытия․ Не бойтесь экспериментировать‚ задавайте вопросы и делитесь своими результатами – ведь именно так мы вместе строим будущее!

На этом статья заканчивается точка․․

Подробнее: LSI Запросы

| Python библиотеки для NLP | Машинное обучение текста | Анализ естественного языка | Создание чат-ботов Python | Обработка текста на русском |

| Векторные представления слов | Трансформеры в NLP | Автоматическая суммаризация | Извлечение сущностей NER | Word2Vec и GloVe |