- От Хаоса к Смыслу: Наш Большой Путь в Мире NLP на Python

- Фундамент: Первые Шаги в Обработке Естественного Языка

- Подготовка Текста: От Хаоса к Порядку

- Представление Слов и Смыслов: Как Компьютер "Видит" Текст

- Разгадываем Смысл: Ключевые Задачи NLP

- Распознавание Именованных Сущностей (NER): Имена, Даты, Места

- Анализ Тональности (Sentiment Analysis): Чувства в Тексте

- Классификация и Категоризация Текстов: Порядок в Информации

- Тематическое Моделирование: Скрытые Темы

- Глубокое Погружение: От Классики к Современным Трансформерам

- Эпоха Трансформеров (Hugging Face): Новый Уровень Понимания

- Нейросети для NLP: PyTorch и TensorFlow

- Инструменты для Извлечения Информации: Золото в Данных

- Практика и Применение: NLP в Реальном Мире

- Анализ Отзывов и Социальных Сетей: Голос Клиента

- Юридические и Финансовые Документы: Точность и Детали

- Разработка Систем: От Чат-ботов до Перевода

- Расширяем Горизонты: Инструменты и Вызовы

- Дополнительные Библиотеки и Специализированные Задачи

- Преодоление Трудностей: Неполные Данные и Оптимизация

От Хаоса к Смыслу: Наш Большой Путь в Мире NLP на Python

Привет, дорогие читатели и коллеги-энтузиасты данных! Сегодня мы приглашаем вас в увлекательное путешествие по безграничным просторам обработки естественного языка (NLP) с использованием мощи Python. Мы, как опытные исследователи и блогеры, знаем, что текст – это не просто набор символов; это сокровищница информации, эмоций и знаний, ждущая своего часа, чтобы быть раскрытой; И Python предоставляет нам идеальный набор инструментов для этого.

В этой статье мы не просто расскажем о различных библиотеках и алгоритмах, мы поделимся нашим глубоким опытом, покажем, как мы подходим к решению реальных задач, и какие "подводные камни" встречались на нашем пути. Мы рассмотрим всё: от самых базовых шагов по подготовке текста до продвинутых архитектур трансформеров, способных творить чудеса. Приготовьтесь, ведь это будет не просто чтение, а погружение в мир, где машины начинают по-настоящему "понимать" человеческий язык.

Фундамент: Первые Шаги в Обработке Естественного Языка

Каждое великое здание начинается с прочного фундамента, и мир NLP не исключение. Прежде чем мы сможем научить компьютер "читать" и "понимать", нам необходимо тщательно подготовить текст. Этот этап, известный как предобработка, является критически важным, поскольку качество конечных результатов напрямую зависит от чистоты и структурированности наших данных. Мы часто говорим, что "мусор на входе — мусор на выходе", и это особенно верно для NLP.

Подготовка Текста: От Хаоса к Порядку

Начать работу с текстом — значит сначала его разобрать. Представьте, что у вас есть огромная книга, и вам нужно понять каждое слово и каждое предложение. Точно так же мы подходим к тексту в NLP. Токенизация — это первый и один из самых фундаментальных шагов. Мы разбиваем непрерывный поток текста на отдельные значимые единицы, или "токены". Чаще всего это слова, но могут быть и предложения, или даже субслова. Классическая библиотека NLTK (Natural Language Toolkit) предоставляет нам простые и эффективные средства для токенизации, позволяя быстро превратить текст в список слов или предложений. Однако, когда мы работаем с более сложными сценариями, такими как контракции или специфические символы, мы часто обращаемся к spaCy, который предлагает более продвинутые и контекстно-зависимые методы.

После того как мы разбили текст на токены, часто возникает вопрос: "Что делать со словами, которые по сути обозначают одно и то же, но имеют разные окончания или формы?" Здесь на сцену выходят стемминг и лемматизация. Стемминг — это процесс удаления суффиксов и префиксов, чтобы привести слово к его "корневой" форме, даже если она не является настоящим словом. Например, слова "бегущий", "бежал", "бегать" могут быть приведены к "бег". Это быстрый и часто достаточный метод. Однако лемматизация идет глубже: она использует словарный анализ для приведения слова к его базовой форме (лемме), которая является настоящим словом. Так, "лучше" станет "хороший". Для русского языка, с его богатой морфологией, мы часто предпочитаем лемматизацию с использованием библиотек вроде spaCy или Stanza, которые лучше справляются с этой задачей, предоставляя более точные результаты, критически важные для последующего анализа.

Но текст редко бывает идеальным. Он полон "шума": стоп-слов (таких как "и", "в", "на", "он"), пунктуации, чисел, HTML-тегов, специальных символов и прочего мусора, который может мешать нашей модели сосредоточиться на действительно важных словах. Здесь мы активно используем регулярные выражения (re) для очистки. Мы пишем паттерны для удаления ненужных элементов, приводим текст к нижнему регистру для унификации. Для более сложных задач, например, удаления HTML-тегов из веб-страниц, мы применяем специализированные инструменты или просто комбинацию регулярных выражений. Textacy также предлагает удобные функции для предобработки, позволяя нам строить пайплайны очистки. А для работы с многоязычными корпусами, где каждый язык имеет свои особенности, мы обращаемся к Polyglot или Stanza, которые поддерживают широкий спектр языков и их морфологию, помогая нам справляться с нелатинскими алфавитами и сложными грамматическими структурами.

Представление Слов и Смыслов: Как Компьютер "Видит" Текст

После того как текст очищен и разбит на токены, возникает следующий вызов: как представить эти слова в формате, который понятен компьютеру? Компьютеры оперируют числами, а не буквами. Здесь мы переходим к концепции векторизации текста — преобразованию слов, предложений или целых документов в числовые векторы.

Самый простой подход — это "мешок слов" (Bag of Words). Мы строим словарь всех уникальных слов в нашем корпусе и для каждого документа считаем, сколько раз каждое слово встречается. CountVectorizer из Scikit-learn делает это за нас, создавая матрицу, где каждая строка, документ, а каждый столбец — слово из словаря, а значения — частота. Более продвинутая версия этого подхода — TF-IDF (Term Frequency-Inverse Document Frequency). Этот метод не просто считает частоту слова, но и взвешивает её, уменьшая значимость часто встречающихся слов (например, стоп-слов) и увеличивая значимость редких, но информативных терминов. Мы активно используем TfidfVectorizer, поскольку он часто дает лучшие результаты в задачах классификации, чем простой CountVectorizer, помогая моделям фокусироваться на более релевантных словах.

Однако "мешок слов" и TF-IDF имеют существенный недостаток: они не учитывают семантическую близость слов. "Король" и "королева" воспринимаются как совершенно разные сущности. Чтобы преодолеть это, мы перешли к векторам слов (Word Embeddings). Это плотные векторные представления, где слова с похожим смыслом имеют близкие векторы в многомерном пространстве. Самые известные из них — это Word2Vec и GloVe. Мы тренируем эти модели на больших текстовых корпусах с помощью библиотеки Gensim, и они учатся отображать слова в векторы таким образом, что математические операции над векторами отражают семантические отношения (например, "король" ⎼ "мужчина" + "женщина" ≈ "королева"). FastText, также из Gensim, является расширением Word2Vec, способным работать с редкими словами и даже символами, что делает его особенно полезным для языков с богатой морфологией или для работы с опечатками.

Но что, если нам нужно получить вектор не для отдельного слова, а для целого предложения или документа? Здесь на помощь приходят векторизация предложений и документов. Doc2Vec (расширение Word2Vec) позволяет нам создавать векторные представления для целых документов, что очень полезно для задач поиска похожих документов или кластеризации. В последние годы мы активно используем Sentence Transformers, которые основаны на архитектуре трансформеров и способны генерировать высококачественные эмбеддинги для предложений и документов, учитывая их контекст. Это значительно улучшает качество таких задач, как поиск семантически похожих текстов или построение вопросно-ответных систем.

Разгадываем Смысл: Ключевые Задачи NLP

Когда текст подготовлен и представлен в числовом виде, мы можем приступить к извлечению из него глубокого смысла и решению конкретных задач. Этот раздел посвящен основным направлениям, где NLP проявляет свою истинную мощь, позволяя нам не просто обрабатывать слова, но и понимать их, классифицировать, находить скрытые связи и даже генерировать новые тексты.

Распознавание Именованных Сущностей (NER): Имена, Даты, Места

Представьте, что вы читаете огромный новостной портал, и вам нужно быстро понять, о каких людях, организациях, местах или датах идет речь. Распознавание именованных сущностей (NER) — это задача извлечения и классификации таких "сущностей" из текста. Мы используем NER для автоматической аннотации документов, построения баз знаний, анализа текстов в юридических документах и многого другого.

Для быстрого и эффективного NER мы часто обращаемся к spaCy. Он поставляется с предварительно обученными моделями для различных языков, которые очень хорошо справляются с распознаванием стандартных сущностей, таких как PERSON, ORG, GPE (геополитическая единица). Однако, когда нам нужна более высокая точность или мы работаем со специфическими доменами (например, медицинскими текстами), мы можем использовать Flair, который известен своими мощными контекстными эмбеддингами и часто дает state-of-the-art результаты. Иногда, для более старых или специфических задач, мы даже строим модели на основе Conditional Random Fields (CRF). Конечно, современные трансформеры (Hugging Face), такие как BERT, также отлично справляются с NER, позволяя нам достигать невероятной точности после тонкой настройки на наших данных.

Как мы оцениваем качество наших NER-моделей? Мы используем стандартные метрики: F1-score, Precision и Recall. Precision показывает, сколько из обнаруженных сущностей были корректными, Recall, сколько из всех истинных сущностей было найдено, а F1-score — их гармоническое среднее, дающее общую оценку производительности. Эти метрики позволяют нам точно понять, насколько хорошо наша модель справляеться с задачей и где есть место для улучшений.

Анализ Тональности (Sentiment Analysis): Чувства в Тексте

В современном мире, где каждый оставляет отзывы, комментарии и сообщения, понимание эмоциональной окраски текста стало невероятно ценным. Анализ тональности (Sentiment Analysis) позволяет нам определить, является ли мнение, выраженное в тексте, положительным, отрицательным или нейтральным. Мы применяем его для анализа отзывов клиентов о продуктах, мониторинга репутации бренда в социальных сетях, анализа финансовых новостей и даже для понимания настроений в политических дебатах.

Для простого и быстрого анализа мы часто используем VADER (Valence Aware Dictionary and sEntiment Reasoner), который специализируется на текстах из социальных сетей и хорошо улавливает сленг и эмодзи. TextBlob также предлагает простой API для анализа тональности, хотя его точность может быть ниже для сложных или специфических текстов. Однако, для более глубокого анализа, особенно когда речь идет о нюансах, сарказме или специфическом сленге в социальных медиа (Twitter/Reddit), мы часто строим собственные модели на основе машинного обучения или даже глубокого обучения, обучая их на размеченных данных. Мы также изучаем, как работать с эмодзи и сленгом, разрабатывая инструменты для их нормализации, чтобы наши модели могли адекватно их интерпретировать.

Классификация и Категоризация Текстов: Порядок в Информации

Представьте, что у вас есть тысячи новостных статей, и вам нужно автоматически распределить их по категориям: "Спорт", "Политика", "Экономика". Это задача классификации текстов. Мы используем её для автоматического тегирования контента, фильтрации спама, маршрутизации запросов клиентов и многого другого. Классификация текстов — одна из самых распространенных и полезных задач в NLP.

Наш подход к классификации обычно начинается с классических методов машинного обучения. Мы часто применяем алгоритмы из Scikit-learn, такие как Support Vector Machines (SVM) или Наивный Байесовский классификатор. Эти модели хорошо работают на TF-IDF или CountVectorizer представлениях текста и часто дают отличные базовые результаты. Для более сложных задач, где требуется улавливать долгосрочные зависимости в тексте, мы переходим к глубокому обучению, используя PyTorch/TensorFlow для создания LSTM-сетей или, что более актуально сегодня, моделей на основе трансформеров, таких как BERT. Эти модели способны улавливать гораздо более сложные паттерны и контекст, значительно повышая точность классификации, особенно для больших и разнообразных текстовых корпусов.

Мы также используем классификацию для автоматической категоризации статей и новостей, что позволяет нам эффективно организовывать огромные объемы информации и быстро находить релевантный контент. Это значительно упрощает работу контент-менеджеров и аналитиков, освобождая их от рутинной ручной разметки;

Тематическое Моделирование: Скрытые Темы

Иногда нам нужно не просто классифицировать текст по заранее определенным категориям, а понять, какие скрытые темы присутствуют в большом наборе документов. Это задача тематического моделирования. Оно позволяет нам "обнаружить" абстрактные темы, которые проходят через коллекцию документов, основываясь на статистическом анализе слов.

"Язык — это дорожная карта культуры. Он говорит вам, откуда люди пришли и куда они идут."

— Рита Мэй Браун

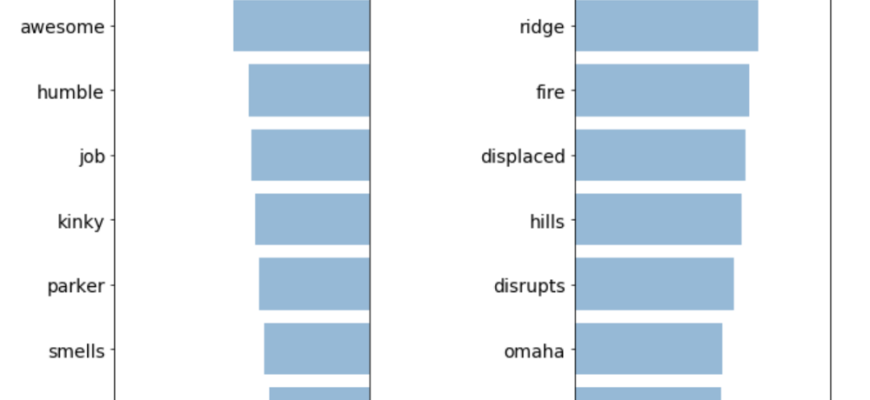

Мы активно используем библиотеку Gensim для тематического моделирования, в частности, алгоритмы LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing). LDA предполагает, что каждый документ представляет собой смесь нескольких тем, и каждая тема — это смесь слов. LSI же использует сингулярное разложение для выявления латентных семантических структур. Эти методы помогают нам анализировать тексты отзывов, выявлять скрытые темы в клиентских запросах или определять основные направления обсуждений на форумах.

Мы также экспериментируем с NMF (Non-negative Matrix Factorization) для тематического моделирования, который часто дает более интерпретируемые темы. Сравнение моделей тематического моделирования (LDA vs NMF), это отдельная область нашего исследования, поскольку выбор алгоритма сильно зависит от характеристик данных и конкретной задачи. Мы всегда тщательно оцениваем качество полученных тем, чтобы убедиться, что они действительно отражают содержательную структуру текста.

Глубокое Погружение: От Классики к Современным Трансформерам

После того как мы освоили основы и ключевые задачи, пришло время погрузиться в наиболее захватывающие и мощные методы, которые буквально произвели революцию в мире NLP за последние несколько лет. Мы говорим о глубоком обучении и, в частности, о трансформерных архитектурах, которые открыли для нас совершенно новые горизонты в понимании и генерации человеческого языка.

Эпоха Трансформеров (Hugging Face): Новый Уровень Понимания

Если бы нас попросили назвать одно самое значимое достижение в NLP последнего десятилетия, мы бы без колебаний указали на трансформерные архитектуры. Эти модели, впервые представленные в статье "Attention Is All You Need", изменили правила игры. Они позволяют моделям обрабатывать текст, учитывая глобальный контекст, а не только ближайшие слова, что приводит к беспрецедентному уровню понимания языка. Библиотека Hugging Face Transformers стала нашим незаменимым инструментом в этой области, предоставляя доступ к сотням предварительно обученных моделей.

Мы активно используем модели, такие как BERT (Bidirectional Encoder Representations from Transformers), для широкого спектра задач, включая классификацию текста, NER и вопросно-ответные системы. Его способность понимать контекст слова, анализируя его со всех сторон, делает его чрезвычайно мощным. А для задач генерации текста, таких как создание осмысленных абзацев, написание кода или даже ведение диалогов, мы обращаемся к моделям семейства GPT (Generative Pre-trained Transformer). Это действительно поразительно, как эти модели могут создавать связный и контекстно-релевантный текст, будто его написал человек.

Одной из ключевых особенностей работы с трансформерами является тонкая настройка (Fine-tuning) предварительно обученных моделей. Вместо того чтобы обучать модель с нуля (что требует огромных вычислительных ресурсов и данных), мы берем уже обученную на огромном корпусе модель и дообучаем её на небольшом, специфическом для нашей задачи наборе данных. Это позволяет нам достигать высокой точности при значительно меньших затратах времени и ресурсов. Мы используем этот подход для адаптации моделей под уникальные задачи, такие как анализ специфического сленга в чатах или обработка юридических терминов.

Нейросети для NLP: PyTorch и TensorFlow

Хотя трансформеры сейчас доминируют, мы не забываем и о других архитектурах глубокого обучения, которые заложили основу для их появления. Для создания более кастомных или специализированных нейронных сетей мы активно используем фреймворки PyTorch и TensorFlow (включая Keras). Эти библиотеки предоставляют нам гибкость для построения и обучения самых разных архитектур, от простых полносвязных сетей до более сложных рекуррентных нейронных сетей (RNN) и их вариантов, таких как LSTM (Long Short-Term Memory).

Мы применяем LSTM-сети для задач, где важна последовательность и долгосрочные зависимости, например, для анализа временных рядов в текстовых данных или для создания моделей, понимающих сложные синтаксические структуры. Создание собственных нейросетей позволяет нам глубоко понимать принципы их работы и адаптировать их под уникальные вызовы, которые не всегда могут быть эффективно решены готовыми моделями.

Инструменты для Извлечения Информации: Золото в Данных

Помимо понимания и генерации текста, одной из главных задач NLP является извлечение конкретных фактов и фрагментов информации. Это похоже на поиск иголки в стоге сена, но с помощью правильных инструментов это становится возможным.

Для извлечения ключевых фраз из текста мы часто используем алгоритмы вроде RAKE (Rapid Automatic Keyword Extraction) или TextRank. TextRank, основанный на алгоритме PageRank, также может быть применен для суммаризации текста, выделяя наиболее важные предложения. Это особенно полезно для быстрого получения сути длинных статей или документов.

Часто исходные данные находяться не в удобном для анализа формате. Мы используем Beautiful Soup для веб-скрейпинга текста, чтобы извлекать информацию с веб-страниц, а PyMuPDF — для извлечения текста из PDF-документов. Эти инструменты позволяют нам получить доступ к огромным объемам неструктурированных данных, которые затем мы можем предобработать и анализировать. Извлечение дат и чисел из текста — отдельная, но очень важная задача, особенно в финансовых или юридических документах, где точность имеет решающее значение.

В эпоху дезинформации, разработка инструментов для проверки фактов (Fact-Checking) становится все более актуальной. Мы исследуем методы, которые позволяют автоматически сопоставлять утверждения в тексте с надежными источниками информации, помогая выявлять ложные или недостоверные данные. Это сложная, но чрезвычайно важная область, где NLP может принести огромную пользу обществу.

Практика и Применение: NLP в Реальном Мире

Теория — это прекрасно, но истинная магия NLP раскрывается, когда мы применяем эти мощные инструменты для решения реальных проблем. За годы нашей работы мы видели, как NLP преобразует целые отрасли, от улучшения клиентского сервиса до автоматизации сложных бизнес-процессов. Давайте посмотрим на некоторые из наиболее ярких примеров того, как мы используем NLP каждый день.

Анализ Отзывов и Социальных Сетей: Голос Клиента

В мире бизнеса понимание мнения клиента — это ключ к успеху. Мы активно применяем NLP для анализа текстов отзывов клиентов. Это не просто определение "положительный" или "отрицательный", это глубокое погружение в суть того, что нравится или не нравится людям. Мы можем анализировать отзывы о продуктах по категориям, выявлять конкретные функции, которые вызывают восторг или разочарование. Это позволяет компаниям быстро реагировать на обратную связь и улучшать свои продукты и услуги.

Анализ тональности сообщений в социальных сетях (Twitter/Reddit) является еще одной нашей специализацией. Социальные сети — это живой пульс общественного мнения. Мы отслеживаем упоминания брендов, анализируем настроения вокруг политических событий или новых трендов. При этом мы сталкиваемся с такими вызовами, как работа с эмодзи и сленгом в современных текстах, а также с анализом тональности с учетом сарказма, что требует более сложных моделей и тщательной предобработки. Мы также анализируем поведенческие паттерны в чатах, чтобы понять, как пользователи взаимодействуют, какие вопросы задают и какие проблемы испытывают.

Юридические и Финансовые Документы: Точность и Детали

Области, где точность и внимание к деталям имеют первостепенное значение, такие как юриспруденция и финансы, также получают огромную выгоду от NLP. Мы разрабатываем системы для анализа юридических контрактов, которые могут автоматически извлекать ключевые условия, даты, имена сторон и обязательства. Это значительно сокращает время на их проверку и снижает риск ошибок.

Аналогично, в финансовом секторе, анализ текстовых данных в финансовой отчетности и анализ тональности финансовых новостей позволяют инвесторам и аналитикам быстро получать важную информацию и принимать более обоснованные решения. Мы можем выявлять риски, прогнозировать изменения на рынке, основываясь на тональности и содержании публикаций, а также извлекать факты из новостей, которые могут повлиять на стоимость активов.

Разработка Систем: От Чат-ботов до Перевода

NLP не только про анализ, но и про создание интеллектуальных систем, которые взаимодействуют с нами на естественном языке.

- Разработка чат-ботов на Python: Мы активно используем фреймворки, такие как Rasa, для создания умных чат-ботов, способных понимать намерения пользователя, вести диалог и предоставлять релевантную информацию. Это революционизирует клиентскую поддержку и автоматизирует рутинные взаимодействия.

- Разработка систем машинного перевода: Хотя крупные корпорации имеют свои мощные системы перевода, мы также работаем над созданием узкоспециализированных систем машинного перевода, например, для медицинских или технических текстов, где требуется высокая точность терминологии. Трансформерные модели здесь незаменимы.

- Разработка системы суммаризации текста: Будь то абстрактивная (генерирующая новый, сжатый текст) или экстрактивная (выделяющая наиболее важные предложения из оригинала) суммаризация, эти системы помогают быстро получать суть длинных документов, от новостных статей до научных работ.

- Разработка систем обнаружения плагиата: Мы используем различные методы, включая сравнение векторов документов и алгоритмы измерения сходства строк (например, с помощью библиотеки Jellyfish или TextDistance), для выявления плагиата в текстах. Это критически важно для образования и издательского дела.

- Разработка инструментов для проверки грамматики и орфографии: Хотя готовые решения существуют, мы часто строим свои для специфических задач или языков, используя продвинутую лемматизацию, POS-теггинг (Part-of-Speech tagging, NLTK) и анализ зависимостей (SpaCy).

Расширяем Горизонты: Инструменты и Вызовы

Наш путь в NLP — это постоянное обучение и поиск новых решений; Мир меняется, и вместе с ним развиваются и инструменты. В этом разделе мы затронем некоторые дополнительные библиотеки, специализированные задачи и неизбежные вызовы, с которыми мы сталкиваемся, работая с реальными текстовыми данными.

Дополнительные Библиотеки и Специализированные Задачи

Мы уже упоминали множество мощных библиотек, но список на этом не исчерпывается. Вот еще несколько, которые мы активно используем или исследуем:

- TextBlob: Это простая в использовании библиотека для базовых задач NLP, таких как тональность, POS-теггинг и извлечение N-грамм. Мы часто используем её для быстрого прототипирования, но для более сложных проектов мы знаем её ограничения и альтернативы.

- Textacy: Эта библиотека предоставляет более продвинутые функции для извлечения информации, работы с синтаксическими зависимостями, извлечения ключевых предложений и построения сложных пайплайнов обработки текста.

- Stanza: Разработанная в Стэнфорде, Stanza — это мощный инструмент для многих языков, особенно тех, что обладают богатой морфологией, как русский. Она предлагает высококачественные модели для токенизации, POS-теггинга, лемматизации и синтаксического парсинга.

- Sweetviz: Хотя это не чисто NLP-библиотека, Sweetviz помогает нам в автоматическом EDA (Exploratory Data Analysis) текстовых данных, давая быстрый обзор распределения слов, пропусков и других характеристик.

- Jellyfish: Для задач сравнения строк, таких как поиск похожих названий или исправление опечаток, Jellyfish предоставляет различные алгоритмы расстояния (например, Левенштейна, Джаро-Винклера).

- Pattern: Эта библиотека предлагает функционал для веб-майнинга, NLP и машинного обучения. Мы используем её для анализа социальных сетей и более глубокого анализа тональности.

- TextDistance: Отличный инструмент для измерения сходства между строками или документами, полезен для поиска дубликатов, плагиата или кластеризации похожих текстов.

- Scipy: Хотя Scipy — это библиотека для научных вычислений, мы используем её для различных статистических анализов текстовых данных, особенно при работе с большими матрицами признаков.

- Gentle: Для задач распознавания речи (Speech-to-Text) мы иногда обращаемся к таким инструментам, что позволяет нам переводить аудиоданные в текст для последующего NLP-анализа.

- Graph Embeddings: Это передовое направление, где мы используем представления графов для анализа взаимосвязей между сущностями в тексте, например, для построения сетей знаний.

Преодоление Трудностей: Неполные Данные и Оптимизация

Работа с реальными данными всегда сопряжена с вызовами. Проблемы обработки неполных и ошибочных данных — это наша ежедневная реальность. Текст часто бывает неструктурированным, содержит опечатки, пропуски, нестандартную пунктуацию. Мы разрабатываем кастомные инструменты для очистки неструктурированного текста, нормализации сленга, исправления орфографии и пунктуации. Это требует глубокого понимания данных и тщательного подхода к предобработке.

Когда мы работаем с большими текстовыми массивами (Big Data NLP), производительность становиться критически важной. Мы исследуем методы обработки текста в режиме реального времени (Streaming NLP) и используем GPU-ускорение для тренировки моделей глубокого обучения. Библиотеки, такие как Gensim, оптимизированы для работы с большими данными, но для максимальной эффективности мы часто используем параллельные вычисления и распределенные системы.

Наш подход всегда включает сравнение различных методов векторизации (TF-IDF vs Word2Vec), сравнение моделей лемматизации (SpaCy vs NLTK), а также сравнение моделей Word2Vec (Skip-gram vs CBOW), чтобы выбрать наиболее подходящий инструмент для конкретной задачи. Мы также постоянно оцениваем эффективность различных токенизаторов и алгоритмов кластеризации (K-Means vs DBSCAN), чтобы гарантировать, что наши решения являются не только мощными, но и оптимальными.

Итак, мы прошли долгий путь, от базовой токенизации до продвинутых трансформерных архитектур, от анализа тональности до разработки умных чат-ботов. Мы увидели, как Python, с его богатой экосистемой библиотек, стал языком выбора для большинства специалистов в области NLP. Этот мир постоянно развивается, и то, что вчера казалось фантастикой, сегодня уже становиться обыденностью.

Наш опыт показывает, что ключ к успеху в NLP лежит не только в знании алгоритмов, но и в глубоком понимании самого языка, его нюансов и контекста. Мы постоянно учимся, экспериментируем и делимся своими знаниями, ведь именно в сообществе рождаются самые интересные идеи и прорывные решения. Будущее NLP обещает быть еще более захватывающим, с новыми моделями, способными еще глубже понимать человеческие намерения, генерировать еще более креативный текст и создавать по-настоящему интеллектуальные системы. Мы уверены, что вместе мы продолжим открывать новые горизонты в этом удивительном мире.

На этом статья заканчивается.

Подробнее

| Анализ стилистики текстов | Векторизация предложений | Оценка качества NER | Работа с эмодзи | Обработка неструктурированного текста |

| Сравнение моделей тематического моделирования | Тонкая настройка моделей | Анализ временных рядов в тексте | Разработка систем обнаружения плагиата | GPU-ускорение в NLP |