- Тайны Текста Раскрыты: Наш Захватывающий Путь в Мир NLP с Python

- Первые Шаги: Строим Фундамент NLP

- NLTK и spaCy: Наши Первые Шаги в Мире Текста

- Регулярные Выражения: Точность в Каждой Детали

- От Слов к Числам: Векторизация и Понимание Смысла

- Разработка Собственных Векторизаторов и Word Embeddings

- Преимущества Word Embeddings:

- Ключевые Задачи NLP: От Распознавания до Понимания Эмоций

- Распознавание Именованных Сущностей (NER): Взгляд в Суть Текста

- Тематическое Моделирование: Открытие Скрытых Смыслов

- Анализ Тональности: Понимание Эмоций

- Классификация Текстов: Распределение по Полкам

- Эра Глубокого Обучения и Трансформеров: Новые Горизонты NLP

- Hugging Face и Трансформеры: Мощность и Гибкость

- Нейросети: PyTorch и TensorFlow

- Практическое Применение и Решение Сложных Задач

- От Веб-Скрейпинга до QA-Систем

- Работа с Многоязычными Данными и Специфическими Вызовами

- Примеры Наших Разработок:

- Продвинутый Анализ и Визуализация: Делаем Данные Понятными

- Извлечение Ключевых Фраз и Анализ Частотности

- Инструменты для Глубокого Понимания Текста

Тайны Текста Раскрыты: Наш Захватывающий Путь в Мир NLP с Python

Дорогие читатели‚ добро пожаловать в наш блог! Сегодня мы хотим поделиться с вами чем-то по-настоящему увлекательным и‚ без преувеличения‚ революционным – нашим личным опытом и глубоким погружением в мир Обработки Естественного Языка (NLP) с использованием такого мощного инструмента‚ как Python. Мы прошли долгий путь от первых робких попыток токенизации до создания сложных систем‚ способных понимать и даже генерировать текст. И мы хотим‚ чтобы вы присоединились к нам в этом путешествии‚ раскрыв завесу над тем‚ как мы заставляем компьютеры "читать" и "думать" подобно человеку.

В современном мире объемы текстовой информации растут экспоненциально. Электронные письма‚ посты в социальных сетях‚ научные статьи‚ юридические документы‚ отзывы клиентов – все это необъятное море данных‚ в котором скрыты бесценные инсайты. Без NLP мы были бы обречены на бесконечный ручной анализ‚ что‚ конечно же‚ неэффективно и утомительно. Именно поэтому мы так сильно полюбили эту область: она дает нам суперспособность извлекать смысл‚ обнаруживать закономерности и автоматизировать рутинные задачи‚ открывая совершенно новые возможности для бизнеса и исследований. Мы уверены‚ что каждый‚ кто хоть раз сталкивался с необходимостью анализа больших текстовых массивов‚ оценит мощь и элегантность решений‚ о которых мы сегодня расскажем.

Первые Шаги: Строим Фундамент NLP

Наше путешествие в NLP началось‚ как и у многих‚ с основ. Мы быстро поняли‚ что прежде чем компьютер сможет "понять" текст‚ его нужно подготовить. Это похоже на то‚ как мы учим ребенка сначала различать буквы‚ затем слова‚ а потом уже строить предложения. В мире NLP для этого существуют свои инструменты и методики‚ которые мы активно используем каждый день.

NLTK и spaCy: Наши Первые Шаги в Мире Текста

Мы начали с NLTK (Natural Language Toolkit) – это настоящая "швейцарская армия" для начинающего NLP-специалиста. Эта библиотека предоставила нам все необходимое для базовой предобработки текста. Мы освоили токенизацию‚ процесс разбиения текста на отдельные слова или фразы (токены)‚ что является краеугольным камнем любого NLP-проекта. Без токенизации текст для компьютера — это просто длинная строка символов. Затем мы перешли к стеммингу – процессу усечения слов до их корневой формы. Например‚ слова "бежать"‚ "бежит"‚ "бежал" будут приведены к "беж". Это помогает уменьшить количество уникальных слов и повысить эффективность анализа.

Однако‚ со временем мы осознали‚ что стемминг иногда бывает слишком агрессивен и может терять важный смысл; Тогда мы открыли для себя лемматизацию‚ которая‚ в отличие от стемминга‚ приводит слова к их словарной (базовой) форме‚ учитывая при этом морфологию языка. Например‚ "бежать"‚ "бежит"‚ "бежал" будут приведены к "бежать". Для более продвинутой и точной лемматизации‚ особенно для языков с богатой морфологией‚ мы стали активно использовать spaCy и Stanza. Эти библиотеки не только быстрее‚ но и предлагают более глубокий синтаксический анализ‚ что значительно повышает качество наших моделей.

Регулярные Выражения: Точность в Каждой Детали

Помните‚ как мы говорили о предобработке? Невозможно обойтись без регулярных выражений (re). Это наш незаменимый инструмент для очистки текста от "шума" – HTML-тегов‚ лишних пробелов‚ специальных символов‚ ссылок и многого другого. Мы научились создавать сложные паттерны‚ которые позволяют нам эффективно извлекать нужную информацию или‚ наоборот‚ удалять ненужное‚ делая текст максимально чистым и готовым к дальнейшему анализу. Это как тонкая настройка фильтра‚ позволяющего отсеять все лишнее и оставить только суть.

Наш Опыт: Мы часто сталкиваемся с тем‚ что данные приходят к нам в "сыром" виде – с ошибками‚ неполные‚ с форматированием‚ которое нужно удалить. Регулярные выражения в связке с такими библиотеками‚ как TextBlob (для простого NLP и быстрого тестирования идей) и Textacy (для более продвинутой обработки неструктурированного текста)‚ позволяют нам превратить хаос в упорядоченный набор данных. Мы даже разработали свои инструменты для очистки текста от HTML-тегов и нормализации пунктуации‚ чтобы наши модели всегда работали с идеальными входными данными.

От Слов к Числам: Векторизация и Понимание Смысла

Компьютеры не понимают слова в том виде‚ в каком их понимаем мы. Для них это просто последовательность символов. Чтобы машина могла работать с текстом‚ его необходимо преобразовать в числовое представление – векторы. Этот этап является одним из самых критичных‚ поскольку от качества векторизации напрямую зависит эффективность всех последующих задач.

Разработка Собственных Векторизаторов и Word Embeddings

Мы активно используем стандартные векторизаторы из Scikit-learn‚ такие как CountVectorizer и TfidfVectorizer. CountVectorizer просто подсчитывает частоту слов‚ а TfidfVectorizer идет дальше‚ учитывая не только частоту слова в документе‚ но и его редкость во всем корпусе текстов. Это помогает нам выделить наиболее значимые слова. Мы постоянно сравниваем различные методы векторизации (TF-IDF vs Word2Vec vs Doc2Vec)‚ чтобы выбрать оптимальный для каждой конкретной задачи.

Однако‚ эти методы не учитывают семантический смысл слов. И вот тут на сцену выходят Word Embeddings – векторные представления слов‚ которые улавливают их семантические и синтаксические отношения. Мы глубоко погрузились в изучение и применение Word2Vec и GloVe с использованием библиотеки Gensim. Эти модели позволяют нам получить векторное представление каждого слова таким образом‚ что слова с похожим значением оказываются близко друг к другу в многомерном пространстве. Мы также экспериментировали с различными моделями Word2Vec (Skip-gram vs CBOW)‚ чтобы понять их сильные и слабые стороны.

Преимущества Word Embeddings:

- Семантическая Близость: Слова "король" и "королева" будут ближе друг к другу‚ чем "король" и "яблоко".

- Аналогии: Можно выполнять векторную арифметику‚ например‚ "король" ⏤ "мужчина" + "женщина" = "королева".

- Сокращение Размерности: Представляют слова в более плотном и информативном виде.

- Работа с Редкими Словами: FastText‚ например‚ может генерировать векторы для слов‚ не встречавшихся в обучающей выборке‚ разбивая их на подслова.

Мы не остановились на уровне слов. Для представления целых предложений и документов мы активно применяем Doc2Vec и Sentence Transformers‚ а также изучаем контекстное встраивание‚ которое учитывает контекст слова в предложении‚ что является огромным шагом вперед по сравнению с классическими Word Embeddings. Это позволяет нам улавливать более тонкие нюансы смысла в больших текстовых массивах.

Ключевые Задачи NLP: От Распознавания до Понимания Эмоций

После того как мы научились эффективно предобрабатывать и векторизовать текст‚ мы перешли к решению реальных задач. Это тот момент‚ когда текст начинает "оживать" и давать нам ответы на вопросы.

Распознавание Именованных Сущностей (NER): Взгляд в Суть Текста

NER (Named Entity Recognition) – это одна из наших любимых задач. Она позволяет нам автоматически находить и классифицировать именованные сущности в тексте‚ такие как имена людей‚ названия организаций‚ географические объекты‚ даты и т.д.. Мы активно используем spaCy для быстрого и эффективного NER‚ а также изучаем применение CRF (Conditional Random Fields) для более сложных случаев и библиотеку Flair для современного NER‚ которая демонстрирует впечатляющие результаты. Мы даже разработали системы для автоматической разметки сущностей‚ что значительно ускоряет процесс подготовки данных для обучения. Оценка качества NER-моделей (F1-score‚ Precision‚ Recall) всегда является для нас приоритетом.

Тематическое Моделирование: Открытие Скрытых Смыслов

Представьте‚ что у вас есть тысячи документов‚ и вам нужно понять‚ о чем они. Ручной анализ – это утопия. Здесь на помощь приходит тематическое моделирование. Мы используем библиотеку Gensim для реализации таких алгоритмов‚ как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing). Эти методы позволяют нам автоматически выявлять скрытые темы в больших коллекциях документов‚ группируя слова‚ которые часто встречаются вместе. Мы постоянно сравниваем модели тематического моделирования (LDA vs NMF)‚ чтобы найти наиболее подходящий подход для каждого проекта‚ будь то анализ отзывов клиентов или научных статей.

"Язык – это дорожная карта культуры. Он говорит вам‚ откуда пришли его люди и куда они идут." – Рита Мэй Браун

Анализ Тональности: Понимание Эмоций

Один из самых востребованных запросов от наших клиентов – это анализ тональности (Sentiment Analysis). Понять‚ что чувствуют люди‚ читая отзывы о продукте‚ посты в социальных сетях или финансовые новости – бесценно. Мы начинали с VADER‚ простого‚ но эффективного алгоритма‚ ориентированного на социальные медиа. Со временем мы перешли к более сложным моделям‚ включая машинное обучение с Scikit-learn и даже трансформеры. Мы проводили анализ тональности сообщений в социальных сетях (Twitter/Reddit)‚ отзывов о фильмах и ресторанах‚ финансовых новостей‚ а также учились учитывать сарказм и другие нюансы современной речи. Библиотека Pattern также оказалась полезной для быстрого анализа тональности.

Классификация Текстов: Распределение по Полкам

Классификация текстов – это задача отнесения документа к одной или нескольким предопределенным категориям. Мы применяем Scikit-learn для классификации текстов‚ используя такие алгоритмы‚ как SVM и наивный байесовский классификатор. Это позволяет нам автоматически категоризировать статьи‚ новости‚ отзывы клиентов или даже юридические документы. Мы разрабатываем системы для автоматической категоризации статей и новостей‚ а также для тегирования контента. С появлением глубокого обучения мы также начали применять классификацию текста с использованием PyTorch и TensorFlow.

Эра Глубокого Обучения и Трансформеров: Новые Горизонты NLP

Последние годы принесли революцию в мир NLP с появлением глубокого обучения‚ и особенно трансформерных архитектур. Мы с энтузиазмом погрузились в эту область‚ осознавая ее огромный потенциал.

Hugging Face и Трансформеры: Мощность и Гибкость

Сегодня невозможно говорить о передовом NLP без упоминания трансформеров (Hugging Face). Эти модели‚ такие как BERT‚ GPT‚ T5 и другие‚ изменили правила игры. Они позволяют нам решать самые сложные задачи NLP‚ достигая беспрецедентной точности. Мы используем Hugging Face Transformers для:

- Классификации: Например‚ применение BERT для задач классификации текстов.

- NER: BERT также отлично подходит для распознавания именованных сущностей.

- Генерации Текста: Использование Transformer-моделей для генерации кода‚ диалогов‚ суммаризации и даже автоматического перефразирования.

- Машинного Перевода: Трансформерные модели – основа современных систем машинного перевода.

- Анализа Эмоций: Более тонкое распознавание эмоций с учетом контекста.

Мы активно занимаемся тонкой настройкой (Fine-tuning) предварительно обученных моделей под наши специфические задачи‚ что позволяет достигать выдающихся результатов даже при ограниченном объеме данных.

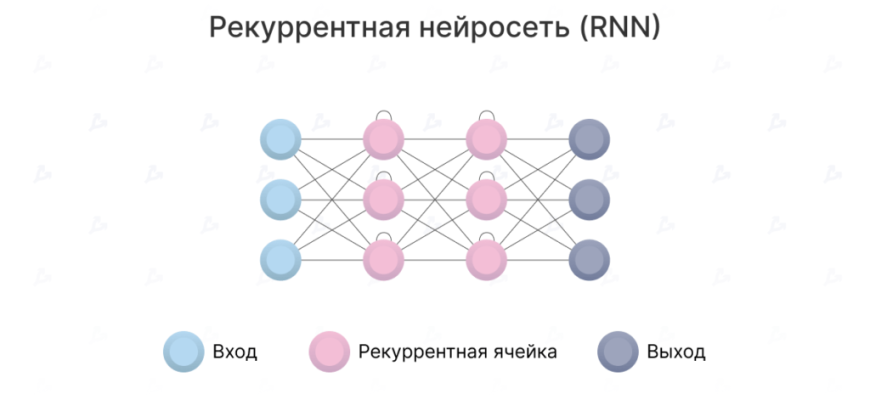

Нейросети: PyTorch и TensorFlow

Для создания и обучения собственных нейросетей для NLP мы используем фреймворки PyTorch и TensorFlow. С их помощью мы строим LSTM-сети (через Keras/TensorFlow)‚ разрабатываем модели для выявления связей между сущностями и экспериментируем с различными архитектурами. GPU-ускорение стало неотъемлемой частью нашей работы с большими моделями и объемами данных.

Практическое Применение и Решение Сложных Задач

NLP – это не только теория и алгоритмы‚ это прежде всего инструмент для решения реальных проблем. За годы работы мы сталкивались с множеством разнообразных задач‚ каждая из которых требовала уникального подхода.

От Веб-Скрейпинга до QA-Систем

Прежде чем мы можем анализировать текст‚ его нужно получить. Для этого мы используем библиотеку Beautiful Soup для веб-скрейпинга текста. Она позволяет нам извлекать текстовые данные с веб-страниц‚ которые затем становятся основой для наших NLP-проектов.

Одним из самых амбициозных направлений для нас является разработка систем вопросно-ответных систем (QA). Это системы‚ которые могут понимать вопрос пользователя и находить на него ответ в большом корпусе текстов. Мы также работаем над разработкой систем суммаризации текста (как абстрактивной‚ так и экстрактивной) – это позволяет нам автоматически создавать краткие изложения больших документов‚ что очень полезно для новостных агрегаторов или обзоров. TextRank – один из алгоритмов‚ который мы используем для извлечения ключевых предложений и суммаризации.

Работа с Многоязычными Данными и Специфическими Вызовами

Мир не ограничивается английским языком‚ и мы это прекрасно понимаем. Мы активно занимаемся обработкой многоязычных текстовых корпусов. Для этого мы применяем библиотеку Polyglot‚ которая хорошо справляется с мультиязычностью‚ а также Stanza для языков с богатой морфологией‚ включая русский. Мы также работаем с нелатинскими алфавитами и разрабатываем системы машинного перевода на Python‚ в т.ч. для узкоспециализированных текстов.

Особый интерес для нас представляет анализ стилистики текстов (авторский почерк)‚ работа с эмодзи и сленгом в современных текстах‚ а также обработка неполных и ошибочных данных. Мы разработали инструменты для нормализации сленга и автоматической проверки грамматики и орфографии‚ используя такие библиотеки‚ как Jellyfish для сравнения строк.

Примеры Наших Разработок:

| Задача | Используемые Инструменты | Результат |

|---|---|---|

| Анализ юридических документов | spaCy‚ BERT‚ PyMuPDF | Извлечение ключевых дат‚ сущностей‚ положений |

| Разработка чат-ботов | Rasa framework‚ Transformer-модели | Автоматизированные диалоговые системы |

| Обнаружение плагиата | TextDistance‚ Doc2Vec | Сравнение документов‚ выявление схожести |

| Извлечение текста из PDF | PyMuPDF | Преобразование PDF в текстовый формат для анализа |

Продвинутый Анализ и Визуализация: Делаем Данные Понятными

Мало просто извлечь информацию; важно уметь ее интерпретировать и представлять в понятном виде. Мы уделяем большое внимание инструментам для визуализации текстовых данных‚ таким как Word Clouds и Heatmaps‚ которые помогают быстро получить общее представление о содержимом.

Извлечение Ключевых Фраз и Анализ Частотности

Для быстрого понимания сути документа мы используем анализ текста для извлечения ключевых фраз. Мы применяем RAKE (Rapid Automatic Keyword Extraction) и TextRank для извлечения ключевых слов и предложений. Также мы регулярно проводим анализ частотности слов и n-грамм‚ чтобы выявить наиболее значимые термины и их комбинации в тексте. Это помогает нам‚ например‚ в анализе лог-файлов или выявлении сезонности в текстовых данных.

Инструменты для Глубокого Понимания Текста

Мы постоянно расширяем наш арсенал инструментов. Библиотека Sweetviz помогает нам проводить быстрый анализ текстовых данных‚ а Scipy используется для более сложных статистических анализов. Для анализа зависимостей и синтаксического парсинга мы полагаемся на spaCy. Мы даже работаем над разработкой инструмента для проверки фактов (Fact-Checking)‚ что является крайне актуальной задачей в наше время.

Наш путь в мире NLP был и остается невероятно захватывающим. От основ токенизации до сложнейших трансформерных моделей – мы постоянно учимся‚ экспериментируем и внедряем новые подходы. Мы убеждены‚ что NLP продолжит развиваться стремительными темпами‚ открывая все новые и новые возможности для взаимодействия человека и компьютера.

Мы видим будущее‚ где системы NLP будут еще лучше понимать контекст‚ эмоции‚ сарказм‚ смогут вести более естественные и содержательные диалоги. Разработка инструментов для автоматической разметки данных‚ создание словарей и тезаурусов‚ совершенствование систем обнаружения плагиата и анализа Big Data NLP – все это лишь часть нашего непрерывного стремления к совершенству. Мы продолжим делится нашим опытом и знаниями‚ чтобы каждый из вас мог найти свой путь в этом удивительном мире. Спасибо‚ что были с нами!

Подробнее

| Токенизация текста Python | Стемминг и лемматизация NLTK | NER с использованием spaCy | Word Embeddings Gensim | Анализ тональности VADER |

| Тематическое моделирование LDA | Трансформеры Hugging Face | Классификация текстов Scikit-learn | Векторизация TF-IDF | Разработка чат-ботов Rasa |