- От Слов к Смыслам: Магия Обработки Естественного Языка с Python – Наш Опыт

- Первые Шаги в Мире Текста: От Сырых Данных к Понятным Блокам

- Основы NLTK: Токенизация и Стемминг

- Продвинутая Лемматизация и Стемминг

- Регулярные Выражения (re) в Предобработке Текста

- Инструменты для Глубокого Понимания: От Сущностей до Настроений

- Использование spaCy для Быстрого NER (Распознавание Именованных Сущностей)

- Библиотека Gensim для Тематического Моделирования (LDA‚ LSI)

- Анализ Тональности (Sentiment Analysis) с VADER и Трансформерами

- Представление Текста для Машин: От Слов к Векторам

- Разработка Собственных Векторизаторов Текста (CountVectorizer‚ TfidfVectorizer)

- Word Embeddings: Word2Vec и GloVe с Использованием Gensim и FastText

- Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

- Решение Сложных Задач: Классификация‚ Моделирование и Генерация

- Применение Scikit-learn для Классификации Текстов

- Трансформеры (Hugging Face) для Сложных Задач NLP

- Применение PyTorch/TensorFlow для Создания Нейросетей NLP

- Практические Приложения и Расширенные Возможности

- Анализ Текста для Извлечения Ключевых Фраз и Суммаризации

- Разработка Систем Вопросно-ответных Систем (QA) и Чат-ботов

- Обработка Многоязычных Текстовых Корпусов и Машинный Перевод

- Работа с Неструктурированным Текстом: Очистка Данных и Веб-скрейпинг

- Глубокий Анализ и Специализированные Задачи

- Анализ Стилистики Текстов и Определение Авторства

- Инструменты для Визуализации Текстовых Данных

- Анализ Текста в Специализированных Областях

От Слов к Смыслам: Магия Обработки Естественного Языка с Python – Наш Опыт

Привет‚ дорогие читатели и коллеги-энтузиасты технологий! Сегодня мы хотим поделиться с вами нашим глубоким погружением в мир Обработки Естественного Языка (NLP) с использованием одного из самых мощных и гибких инструментов — языка Python. Это путешествие‚ которое мы совершили‚ открывая для себя невероятные возможности превращения хаотичного текстового потока в структурированные данные‚ способные раскрывать скрытые смыслы‚ предсказывать настроения и даже генерировать новые тексты.

В этой статье мы не просто расскажем о теории; мы проведем вас по практическим аспектам‚ основанным на нашем собственном опыте работы с многочисленными библиотеками и фреймворками. Мы покажем‚ как шаг за шагом освоить инструменты‚ которые позволяют машинам "понимать" человеческий язык‚ и как вы сможете применить эти знания для решения реальных задач. Будьте готовы к тому‚ что текст будет насыщен деталями‚ примерами и‚ надеемся‚ вдохновением для ваших собственных проектов. Пристегните ремни – мы начинаем!

Первые Шаги в Мире Текста: От Сырых Данных к Понятным Блокам

Любое путешествие начинается с первых шагов‚ и в NLP эти шаги связаны с предобработкой текста. Представьте себе гору сырых данных – электронные письма‚ сообщения в социальных сетях‚ статьи‚ книги. Без должной подготовки этот массив информации подобен необработанному алмазу. Наша задача – огранить его‚ сделав сияющим и полезным.

Мы начинаем с самых фундаментальных операций‚ которые закладывают основу для всех последующих‚ более сложных анализов. Эти техники позволяют нам разбить текст на осмысленные единицы‚ привести слова к их базовой форме и отфильтровать ненужный "шум".

Основы NLTK: Токенизация и Стемминг

Когда мы только начинали свой путь в NLP‚ библиотека NLTK (Natural Language Toolkit) стала нашим верным спутником. Это настоящая "швейцарская армия" для лингвистических задач‚ предлагающая множество инструментов для работы с текстом. Одними из первых понятий‚ с которыми мы столкнулись‚ были токенизация и стемминг.

Токенизация – это процесс разделения текста на отдельные слова или фразы‚ которые называются токенами. Представьте себе предложение: "Мы изучаем NLP." NLTK поможет нам разбить его на токены: ["Мы"‚ "изучаем"‚ "NLP"‚ "."]. Это кажется простым‚ но на самом деле есть множество нюансов‚ связанных с пунктуацией‚ сокращениями и составными словами. NLTK предлагает различные токенизаторы‚ например‚ word_tokenize для слов и sent_tokenize для предложений.

Стемминг (от англ. "stem" – корень) – это процесс удаления аффиксов (суффиксов и префиксов) от слов‚ чтобы получить их базовую форму‚ или "корень". Например‚ слова "бегу"‚ "бежать"‚ "бежал" могут быть сведены к "бег". Это полезно для сокращения количества уникальных слов и сосредоточения на их основном значении. NLTK предоставляет несколько алгоритмов стемминга‚ таких как PorterStemmer и SnowballStemmer. Наш опыт показал‚ что стемминг может быть довольно агрессивным‚ иногда обрезая слова слишком сильно‚ что приводит к потере смысла. Тем не менее‚ для многих задач‚ особенно на ранних этапах исследования данных‚ это очень эффективный инструмент.

Продвинутая Лемматизация и Стемминг

Как мы уже упомянули‚ стемминг иногда бывает слишком "грубым". Здесь на помощь приходит лемматизация; В отличие от стемминга‚ который просто отсекает окончания‚ лемматизация использует словарные знания и морфологический анализ для приведения слова к его словарной (канонической) форме – лемме. Например‚ "был"‚ "есть"‚ "буду" будут лемматизированы в "быть". Это гораздо более точный метод‚ который сохраняет смысл слова.

Для лемматизации мы часто используем NLTK с WordNetLemmatizer‚ который опирается на базу данных WordNet. Однако‚ когда речь заходит о более сложных языках или более высокой точности‚ мы обращаемся к spaCy или Stanza. Эти библиотеки предлагают более продвинутые модели для лемматизации‚ особенно для языков с богатой морфологией‚ таких как русский. Они учитывают часть речи слова (существительное‚ глагол и т.д.)‚ что критически важно для корректной лемматизации.

Регулярные Выражения (re) в Предобработке Текста

Предобработка текста редко обходится без регулярных выражений. Модуль re в Python – это мощный инструмент для поиска‚ замены и извлечения паттернов в строках. Мы используем его для самых разных задач: от удаления HTML-тегов и URL-адресов до очистки текста от пунктуации‚ чисел и специальных символов. Например‚ для удаления HTML-тегов мы можем использовать re.sub(r'<.*?>'‚ ''‚ text). Для удаления лишних пробелов или нормализации пунктуации регулярные выражения также незаменимы. Это позволяет нам получить максимально "чистый" текст‚ готовый к дальнейшему анализу.

Инструменты для Глубокого Понимания: От Сущностей до Настроений

После того как текст очищен и разбит на токены‚ мы можем перейти к более сложным задачам‚ направленным на извлечение смысла. Здесь на сцену выходят библиотеки‚ способные распознавать именованные сущности‚ определять тональность и даже строить сложные модели предметных областей.

Использование spaCy для Быстрого NER (Распознавание Именованных Сущностей)

Когда нам нужно быстро и эффективно извлечь из текста именованные сущности‚ такие как имена людей‚ организации‚ географические названия‚ даты или денежные суммы‚ spaCy становится нашим основным выбором. Эта библиотека известна своей скоростью и точностью‚ а также наличием пред-обученных моделей для множества языков.

С spaCy мы можем легко загрузить модель и обработать текст‚ чтобы получить список сущностей с их типами. Например‚ в предложении "Джон Смит работает в Google в Нью-Йорке" spaCy распознает "Джон Смит" как PERSON‚ "Google" как ORG и "Нью-Йорк" как GPE (геополитическая сущность). Это крайне полезно для автоматического тегирования контента‚ извлечения фактов из новостей или анализа юридических документов. Мы также активно применяем CRF (Conditional Random Fields) и библиотеку Flair‚ особенно когда требуется более тонкая настройка или работа с менее распространенными типами сущностей‚ или же когда нужны state-of-the-art результаты‚ которые Flair часто предоставляет благодаря своим глубоким контекстуальным встраиваниям.

Библиотека Gensim для Тематического Моделирования (LDA‚ LSI)

Представьте‚ что у вас есть огромный корпус документов‚ и вы хотите понять‚ о чем они вообще. Здесь на помощь приходит тематическое моделирование. Библиотека Gensim – это наш фаворит для таких задач. Она реализует такие алгоритмы‚ как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing)‚ которые позволяют нам обнаружить скрытые "темы" в коллекции текстов.

LDA‚ например‚ рассматривает каждый документ как смесь нескольких тем‚ а каждую тему – как смесь слов. В результате мы получаем список тем‚ каждая из которых характеризуется набором наиболее релевантных слов. Это невероятно полезно для анализа больших текстовых массивов‚ таких как отзывы клиентов‚ посты на форумах или научные статьи‚ позволяя нам быстро уловить основные направления обсуждений или исследования. Мы также сравниваем LDA с NMF (Non-negative Matrix Factorization)‚ еще одним мощным методом тематического моделирования‚ который Gensim также поддерживает‚ чтобы выбрать наиболее подходящий для конкретной задачи.

Анализ Тональности (Sentiment Analysis) с VADER и Трансформерами

Понимание эмоциональной окраски текста – это одна из самых востребованных задач NLP. Анализ тональности позволяет нам определить‚ является ли отзыв положительным‚ отрицательным или нейтральным. Для простых‚ но эффективных решений мы часто используем VADER (Valence Aware Dictionary and sEntiment Reasoner)‚ который входит в NLTK. VADER особенно хорош для текстов из социальных сетей‚ так как он учитывает смайлики‚ сокращения и знаки пунктуации‚ влияющие на тональность.

Однако‚ когда требуются более глубокие и контекстно-зависимые оценки‚ мы переходим к моделям на основе трансформеров или к более сложным подходам с использованием Scikit-learn для классификации текстов. Мы также активно применяем TextBlob для быстрого анализа тональности‚ хотя и осознаем его ограничения по сравнению с более мощными моделями. Анализ тональности в социальных сетях‚ особенно с учетом сарказма и эмодзи‚ становится все более сложной задачей‚ где трансформеры показывают себя с лучшей стороны.

Язык – это не просто набор слов; это сложный ландшафт значений‚ контекста и эмоций. Понимание этого ландшафта машинами – одна из самых захватывающих задач нашего времени.

— Фей-Фей Ли

Представление Текста для Машин: От Слов к Векторам

Компьютеры не "понимают" слова так‚ как мы. Им нужны числовые представления. Векторизация текста – это процесс преобразования слов‚ предложений или целых документов в числовые векторы. Это критически важный шаг‚ который позволяет нам применять алгоритмы машинного обучения к текстовым данным.

Разработка Собственных Векторизаторов Текста (CountVectorizer‚ TfidfVectorizer)

Наш опыт показывает‚ что двумя самыми базовыми‚ но при этом мощными векторизаторами являются CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn.

CountVectorizer просто подсчитывает частоту вхождения каждого слова в документе. Он создает матрицу‚ где строки – это документы‚ а столбцы – уникальные слова (словарный запас). Значения в ячейках – это количество раз‚ которое каждое слово встречается в данном документе. Это простой‚ но часто очень эффективный метод‚ особенно для задач классификации;

TfidfVectorizer (Term Frequency-Inverse Document Frequency) идет дальше. Он не просто считает вхождения слов‚ но и взвешивает их‚ придавая больший вес словам‚ которые часто встречаются в конкретном документе‚ но редко – во всей коллекции документов. Это помогает выделить слова‚ которые являются уникальными для данного документа и‚ следовательно‚ более информативными. Мы часто используем его‚ когда нужно уменьшить влияние общеупотребительных слов (вроде "и"‚ "в"‚ "на")‚ которые могут искажать результаты анализа. Сравнение методов векторизации (TF-IDF vs Word2Vec) всегда является частью нашего рабочего процесса‚ и выбор зависит от специфики задачи.

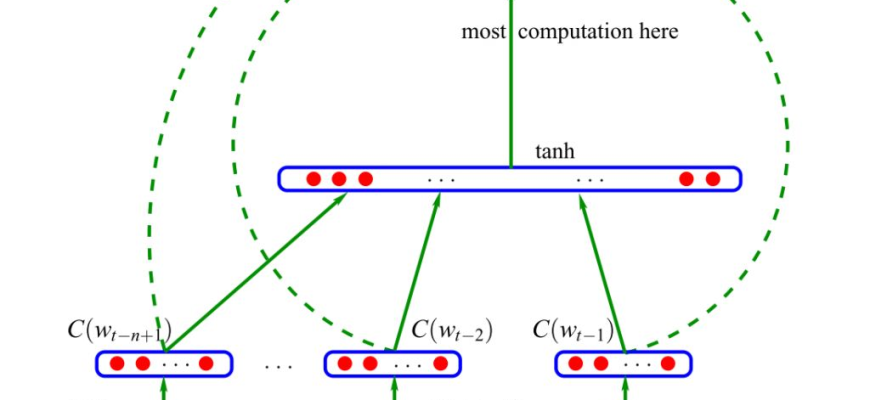

Word Embeddings: Word2Vec и GloVe с Использованием Gensim и FastText

Векторизаторы вроде TF-IDF рассматривают слова как независимые сущности‚ что игнорирует семантические отношения между ними. Здесь на помощь приходят Word Embeddings (векторные представления слов). Это плотные векторы‚ которые улавливают контекст и семантические отношения между словами. Слова с похожим значением или контекстом оказываются близко друг к другу в векторном пространстве.

Мы активно используем Word2Vec (Skip-gram и CBOW) и GloVe. Gensim предоставляет отличные реализации Word2Vec‚ позволяя нам обучать модели на собственных корпусах текстов или использовать уже предобученные. Word2Vec и GloVe позволяют нам выполнять такие операции‚ как "король ─ мужчина + женщина = королева"‚ что демонстрирует их способность улавливать аналогии. Мы также применяем FastText‚ особенно когда имеем дело с редкими словами или хотим учитывать морфологическую структуру (FastText строит векторы на основе подслов‚ что очень полезно для языков с богатой морфологией). Использование FastText для векторизации текста с учетом морфологии значительно улучшает качество анализа для таких языков.

Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

Помимо отдельных слов‚ нам часто нужно получать векторные представления для целых предложений или документов. Doc2Vec (также из Gensim) является расширением Word2Vec и позволяет нам создавать векторы для целых документов. Это очень полезно для задач поиска похожих документов‚ кластеризации или классификации.

В последние годы мы все чаще обращаемся к Sentence Transformers. Это предобученные модели (часто на основе архитектуры трансформеров)‚ которые способны генерировать высококачественные векторные представления для предложений и даже коротких параграфов. Они улавливают контекст на уровне предложения‚ что делает их незаменимыми для задач сравнения предложений‚ поиска семантически похожих фраз или построения вопросно-ответных систем. Контекстное встраивание‚ которое предлагают Sentence Transformers‚ стало настоящим прорывом в NLP.

Решение Сложных Задач: Классификация‚ Моделирование и Генерация

С хорошо подготовленными и векторизованными данными мы можем переходить к решению более амбициозных задач‚ используя мощные алгоритмы машинного обучения и глубокого обучения.

Применение Scikit-learn для Классификации Текстов

Scikit-learn – это наш основной инструмент для классификации текстов. Будь то категоризация статей по темам‚ определение спама в электронных письмах или анализ тональности отзывов‚ Scikit-learn предоставляет широкий спектр алгоритмов машинного обучения: от Naive Bayes и SVM (Support Vector Machines) до логистической регрессии и случайных лесов;

Мы используем Scikit-learn для:

- Классификации статей: автоматическое присвоение категорий новостным статьям или блогам.

- Анализа отзывов: определение‚ является ли отзыв о продукте положительным или отрицательным.

- Обнаружения спама: фильтрация нежелательных сообщений.

Мы всегда проводим тщательное сравнение моделей машинного обучения для NLP‚ оценивая их по метрикам F1-score‚ Precision и Recall‚ чтобы выбрать наиболее эффективный классификатор для конкретной задачи.

Трансформеры (Hugging Face) для Сложных Задач NLP

Последние несколько лет стали революционными для NLP благодаря появлению трансформерных архитектур. Библиотека Hugging Face Transformers стала de-facto стандартом для работы с этими моделями. Она предоставляет доступ к сотням предобученных моделей‚ таких как BERT‚ GPT‚ RoBERTa‚ T5‚ которые способны решать широкий спектр задач NLP с беспрецедентной точностью.

Мы используем трансформеры для:

- Продвинутого NER: распознавание сущностей в более сложных и специфических контекстах.

- Классификации текстов: достижение state-of-the-art результатов в задачах классификации.

- Анализа тональности: с учетом тонких нюансов и сарказма.

- Генерации текста: создание связных и контекстуально релевантных текстов (например‚ с GPT).

- Машинного перевода: построение высококачественных систем перевода.

- Суммаризации текста: как абстрактной‚ так и экстрактивной.

Тонкая настройка (Fine-tuning) предобученных моделей нашими собственными данными позволяет нам адаптировать эти мощные инструменты к очень специфическим задачам и получить выдающиеся результаты. Мы также исследуем применение трансформеров для анализа кода и выявления связей между сущностями‚ что открывает новые горизонты.

Применение PyTorch/TensorFlow для Создания Нейросетей NLP

Для тех случаев‚ когда предобученные модели или стандартные алгоритмы не дают нужного результата‚ или когда мы хотим построить что-то совершенно новое‚ мы обращаемся к фреймворкам глубокого обучения: PyTorch и TensorFlow/Keras. Эти библиотеки дают нам полную свободу в проектировании и обучении нейронных сетей для NLP.

Мы применяем их для:

- Создания LSTM-сетей для анализа последовательностей (например‚ для распознавания речи или языкового моделирования).

- Разработки более сложных архитектур нейросетей для специфических задач‚ таких как вопросно-ответные системы или генерация диалогов.

- Использования GPU-ускорения для обучения больших моделей на огромных текстовых массивах.

Работа с PyTorch и TensorFlow требует более глубокого понимания принципов глубокого обучения‚ но она позволяет нам выйти за рамки готовых решений и создавать по-настоящему инновационные продукты.

Практические Приложения и Расширенные Возможности

NLP – это не только о теории и алгоритмах; это о решении реальных проблем и создании ценности. Наш опыт охватывает широкий спектр практических применений‚ от извлечения информации до построения интерактивных систем.

Анализ Текста для Извлечения Ключевых Фраз и Суммаризации

В мире перегруженном информацией‚ способность быстро извлекать ключевые фразы и создавать краткие резюме (суммаризация) становится бесценной. Мы используем различные подходы для этих задач:

Извлечение ключевых фраз:

- RAKE (Rapid Automatic Keyword Extraction): Простой‚ но эффективный алгоритм‚ который выявляет ключевые фразы‚ анализируя частоту слов и их встречаемость в одном предложении.

- TextRank: Алгоритм‚ основанный на PageRank‚ который строит граф из слов и предложений‚ а затем ранжирует их по важности. Мы используем его для извлечения как ключевых слов‚ так и ключевых предложений.

Суммаризация текста:

- Экстрактивная суммаризация: Выбор наиболее важных предложений из исходного текста для создания резюме. TextRank также может быть использован для этого.

- Абстрактивная суммаризация: Генерация совершенно нового текста‚ который передает основной смысл оригинала. Это более сложная задача‚ которая часто решается с использованием трансформерных моделей (например‚ T5 или BART) из Hugging Face.

Мы постоянно сравниваем модели суммирования‚ такие как экстрактивная и абстрактная‚ чтобы понять‚ какой подход лучше подходит для конкретного типа документов и требуемой детализации.

Разработка Систем Вопросно-ответных Систем (QA) и Чат-ботов

Создание систем‚ способных отвечать на вопросы пользователей или вести осмысленный диалог‚ является одной из вершин NLP.

Для вопросно-ответных систем (QA) мы используем предобученные трансформерные модели‚ которые способны находить ответы в заданном тексте (экстрактивные QA) или даже генерировать их (генеративные QA). Это позволяет нам создавать инструменты‚ которые могут мгновенно находить нужную информацию в больших базах знаний.

В области чат-ботов мы активно работаем с фреймворком Rasa. Rasa позволяет нам строить контекстно-зависимых ботов‚ которые могут понимать намерения пользователя‚ извлекать сущности из запросов и вести сложный диалог. Это выходит за рамки простых скриптов и позволяет создавать по-настоящему интеллектуальных ассистентов.

Обработка Многоязычных Текстовых Корпусов и Машинный Перевод

Мир не ограничивается одним языком‚ и наш опыт в NLP также включает работу с многоязычными текстовыми корпусами; Это открывает новые вызовы и возможности.

- Polyglot: Отличная библиотека для мультиязычности‚ позволяющая выполнять токенизацию‚ NER‚ анализ тональности и перевод для множества языков‚ включая редкие.

- Stanza: Разработанная в Стэнфорде‚ Stanza является еще одним мощным инструментом для языков с богатой морфологией (как русский)‚ предоставляя высокоточные модели для POS-теггинга‚ лемматизации и синтаксического парсинга.

Для машинного перевода мы все чаще полагаемся на Transformer-модели из Hugging Face. Они позволяют создавать системы‚ способные переводить тексты с высокой точностью‚ а тонкая настройка этих моделей на узкоспециализированных корпусах (например‚ юридических или медицинских) позволяет достичь невероятных результатов.

Работа с Неструктурированным Текстом: Очистка Данных и Веб-скрейпинг

Реальный мир полон "грязных" данных. Наш опыт показывает‚ что львиная доля работы в NLP приходится на очистку и предобработку неструктурированного текста. Это включает:

| Задача очистки | Инструменты и методы | Описание |

|---|---|---|

| Удаление HTML-тегов | Beautiful Soup‚ re | Извлечение чистого текста из веб-страниц или HTML-документов. |

| Извлечение текста из PDF | PyMuPDF | Конвертация PDF-документов в текстовый формат для анализа. |

| Работа с эмодзи и сленгом | Пользовательские словари‚ re‚ нормализация | Преобразование неформального языка в стандартизированную форму. |

| Обработка неполных/ошибочных данных | Инструменты проверки грамматики/орфографии‚ Jellyfish | Исправление ошибок‚ заполнение пропусков‚ измерение сходства строк. |

Для веб-скрейпинга текста‚ который является первым шагом к получению данных из интернета‚ Beautiful Soup является нашим незаменимым инструментом. Он позволяет нам парсить HTML и XML документы‚ извлекая нужные текстовые блоки. После извлечения‚ мы используем все вышеупомянутые методы предобработки‚ чтобы подготовить текст к анализу. Это особенно важно для анализа отзывов о продуктах‚ постов в блогах или финансовых новостей‚ где данные часто представлены в беспорядочном виде.

Глубокий Анализ и Специализированные Задачи

По мере нашего развития в NLP‚ мы сталкиваемся с задачами‚ требующими более специализированных подходов и инструментов. Здесь мы рассмотрим некоторые из них.

Анализ Стилистики Текстов и Определение Авторства

Иногда нам нужно понять не только "что" сказано‚ но и "как" это сказано. Анализ стилистики текстов включает в себя изучение авторского почерка‚ лексического богатства‚ частотности n-грамм‚ длины предложений и других лингвистических особенностей. Это может быть полезно для:

- Определения авторства текста: Сравнение стилистических отпечатков разных авторов.

- Выявления плагиата: Сравнение текстов на предмет сходства. Здесь TextDistance – очень полезная библиотека для измерения сходства строк и документов.

- Анализа изменений в стиле: Например‚ в творчестве одного автора на протяжении времени.

Мы используем комбинацию статистических методов‚ таких как анализ частотности слов и n-грамм‚ и машинного обучения для классификации текстов по стилю или автору.

Инструменты для Визуализации Текстовых Данных

Визуализация – это ключ к пониманию больших объемов текстовых данных. Мы активно используем различные инструменты для наглядного представления результатов нашего анализа:

- Word Clouds (Облака слов): Простой‚ но эффективный способ показать наиболее часто встречающиеся слова в корпусе.

- Heatmaps (Тепловые карты): Для визуализации матриц сходства между документами или темами.

- Графы: Для отображения взаимосвязей между сущностями или словами (например‚ извлеченных с помощью Graph Embeddings).

Библиотеки‚ такие как Matplotlib‚ Seaborn‚ WordCloud и даже Sweetviz для быстрого анализа текстовых данных‚ помогают нам создавать информативные и привлекательные визуализации.

Анализ Текста в Специализированных Областях

NLP находит применение во множестве специализированных областей‚ каждая из которых имеет свои особенности и требования:

- Юридические документы: Извлечение дат‚ имен‚ событий‚ ключевых положений из контрактов и судебных решений. Python с его библиотеками становится незаменимым инструментом для анализа юридических документов.

- Медицинские записи: Извлечение симптомов‚ диагнозов‚ названий лекарств из неструктурированных медицинских текстов.

- Финансовая отчетность и новости: Анализ тональности финансовых новостей для прогнозирования рыночных движений или выявления рисков.

- Лог-файлы: Извлечение полезной информации из больших объемов лог-файлов для мониторинга систем и обнаружения аномалий.

Каждая из этих областей требует специфической предобработки‚ настройки моделей и создания специализированных словарей и тезаурусов. Мы также используем Textacy для более продвинутого анализа зависимостей и извлечения информации в таких специализированных областях.

Наше путешествие по миру NLP с Python было долгим и увлекательным. Мы прошли путь от базовой токенизации до разработки сложных трансформерных моделей‚ способных генерировать текст и отвечать на вопросы. Мы видели‚ как постоянно развиваются библиотеки‚ появляются новые алгоритмы и открываются ранее немыслимые возможности.

Мы убеждены‚ что возможности NLP в Python практически безграничны. От автоматической категоризации новостей и создания систем для проверки фактов до анализа поведенческих паттернов в чатах и обработки текста в режиме реального времени – каждый день приносит новые вызовы и новые решения. Важно помнить‚ что выбор правильного инструмента и подхода зависит от конкретной задачи‚ объема данных и требуемой точности.

Мы надеемся‚ что наш опыт вдохновит вас на собственные исследования и проекты в этой захватывающей области. Мир слов ждет‚ чтобы вы помогли машинам его понять. Удачи!

Подробнее

| Основы токенизации Python | Стемминг и лемматизация NLTK | Распознавание сущностей spaCy | Тематическое моделирование Gensim LDA | Word Embeddings с Word2Vec |

| Анализ тональности VADER | Трансформеры Hugging Face NLP | Классификация текстов Scikit-learn | Веб-скрейпинг текста Beautiful Soup | Разработка чат-ботов Python |