- От Слов к Смыслам: Наш Глубокий Погружение в Мир NLP с Python

- Фундамент NLP: От Сырого Текста к Структурированным Данным

- Токенизация, Стемминг и Лемматизация: Первые Шаги

- Очистка Данных: Регулярные Выражения и Другие Инструменты

- Векторизация Текста: Перевод Слов в Числа

- Постигая Смысл: Ключевые Задачи NLP

- Распознавание Именованных Сущностей (NER)

- Тематическое Моделирование: Открытие Скрытых Тем

- Классификация Текстов: Сортировка и Категоризация

- Анализ Тональности (Sentiment Analysis): Понимание Эмоций

- Извлечение Ключевых Фраз и Синтаксический Парсинг

- Нейронные Сети и Трансформеры: Революция в NLP

- От LSTM к Трансформерам

- Создавая Интеллектуальные Системы: Прикладное NLP

- Вопросно-ответные Системы (QA) и Суммаризация

- Машинный Перевод и Чат-боты

- Проверка Качества и Уникальности Текста

- Работа с Данными: От Сбора до Визуализации

- Сбор и Извлечение Текста

- Анализ и Визуализация

- Многоязычность и Специализированные Задачи

От Слов к Смыслам: Наш Глубокий Погружение в Мир NLP с Python

Приветствуем вас, дорогие читатели, в нашем блоге! Сегодня мы хотим поделиться тем, что по-настоящему захватывает умы и сердца многих разработчиков, аналитиков и энтузиастов данных — миром Обработки Естественного Языка (NLP) с помощью Python. Мы прошли долгий и увлекательный путь, погружаясь в тонкости того, как заставить машины понимать и взаимодействовать с человеческим языком. Наш опыт показывает, что Python — это не просто инструмент, а целая экосистема, открывающая безграничные возможности для работы с текстом.

За последние годы мы стали свидетелями невероятного прорыва в области NLP. От простых задач по подсчету слов до создания сложных систем машинного перевода и генерации текста, все это стало возможным благодаря мощным библиотекам и фреймворкам, доступным в Python. Мы видели, как бизнес-процессы оптимизируются, как улучшается взаимодействие с клиентами, и как открываются новые горизонты для исследований, когда текст перестает быть просто набором символов и превращается в ценный источник информации. Давайте вместе исследуем эти возможности, опираясь на наш практический опыт.

Фундамент NLP: От Сырого Текста к Структурированным Данным

Прежде чем мы сможем научить компьютер понимать человеческий язык, нам нужно перевести этот язык в форму, которую машина сможет обработать. Этот процесс, часто называемый предобработкой текста, является краеугольным камнем любого проекта NLP. Наш опыт подсказывает, что игнорирование или недостаточное внимание к этому этапу может привести к неточным результатам и разочарованию. Мы всегда начинаем с самых азов, постепенно углубляясь в более сложные методы.

Токенизация, Стемминг и Лемматизация: Первые Шаги

Одним из первых шагов в предобработке является токенизация — процесс разбиения текста на отдельные слова или фразы, называемые токенами. Мы часто используем библиотеку NLTK (Natural Language Toolkit), которая предлагает различные токенизаторы, например, для слов и предложений. Это позволяет нам работать не с монолитным блоком текста, а с его осмысленными компонентами. Без этого шага дальнейший анализ был бы крайне затруднен.

После токенизации мы сталкиваемся с проблемой различных форм одного и того же слова (например, "бежать", "бежит", "бежал"). Для решения этой задачи мы применяем стемминг и лемматизацию. Стемминг, как правило, отсекает окончания слов, приводя их к общей "основе" (например, "красивый", "красивая" -> "красив"). Это быстрый, но иногда грубый метод. Лемматизация же более интеллектуальна: она приводит слово к его базовой словарной форме (лемме), учитывая морфологию и часть речи. Для продвинутой лемматизации и стемминга мы часто обращаемся к spaCy, которая предлагает более точные и контекстно-зависимые алгоритмы, особенно для языков с богатой морфологией, таких как русский, где Stanza также показывает отличные результаты.

Очистка Данных: Регулярные Выражения и Другие Инструменты

Сырой текст редко бывает идеальным. Он может содержать HTML-теги, пунктуацию, специальные символы, ссылки, а иногда и просто "шум", который мешает анализу. Мы активно используем регулярные выражения (модуль `re` в Python) для очистки данных. Это мощный инструмент, позволяющий находить и заменять сложные паттерны в тексте. Например, мы можем легко удалить все URL-адреса или очистить текст от HTML-тегов, чтобы получить чистый контент для анализа. Это критически важный этап, особенно при работе с веб-скрейпингом или текстами из социальных сетей.

Помимо регулярных выражений, мы также занимаемся удалением стоп-слов (часто встречающихся, но малозначимых слов, таких как "и", "в", "на"), нормализацией сленга и обработкой эмодзи. Сленг и эмодзи представляют особую сложность в современных текстах, особенно в социальных сетях, где они несут значимую эмоциональную нагрузку. Мы создаем собственные словари и тезаурусы для решения этих задач, а также используем библиотеки вроде TextBlob для простого NLP и определения языка, хотя для более сложных задач обращаемся к специализированным инструментам. Проблемы обработки неполных и ошибочных данных также постоянно стоят перед нами, требуя гибкости и тщательного подхода к очистке.

| Этап | Описание | Примеры инструментов |

|---|---|---|

| Токенизация | Разбиение текста на слова или предложения. | NLTK, spaCy |

| Очистка | Удаление шума, HTML, пунктуации, чисел. | Модуль `re`, пользовательские функции |

| Нормализация | Приведение слов к базовой форме (стемминг, лемматизация). | NLTK, spaCy, Stanza |

| Удаление стоп-слов | Исключение часто встречающихся, но малозначимых слов. | NLTK, spaCy, пользовательские списки |

Векторизация Текста: Перевод Слов в Числа

После очистки и нормализации текста наступает момент, когда нам нужно представить слова и документы в числовом виде, чтобы алгоритмы машинного обучения могли с ними работать. Это называется векторизацией текста. Мы используем несколько подходов, каждый из которых имеет свои преимущества и недостатки в зависимости от задачи.

Самые простые методы — это CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn. CountVectorizer просто подсчитывает частоту слов в документе, создавая разреженную матрицу. TfidfVectorizer идет дальше, учитывая не только частоту слова в документе, но и его редкость во всем корпусе текстов (TF-IDF: Term Frequency-Inverse Document Frequency). Это помогает нам выделить более значимые слова, которые лучше характеризуют документ. Мы часто применяем их для задач классификации и кластеризации текстов.

Однако эти методы не учитывают семантическое значение слов или их контекст. Здесь на помощь приходят Word Embeddings (векторные представления слов), такие как Word2Vec и GloVe, которые мы реализуем с помощью библиотеки Gensim. Эти модели обучаются на больших корпусах текста и представляют слова в виде многомерных векторов, где семантически близкие слова находятся близко друг к другу в векторном пространстве. Например, вектор "короля" и "королевы" будут похожи, как и вектор "мужчины" и "женщины". Мы также используем FastText, который хорошо работает с редкими словами и морфологически сложными языками, поскольку он учитывает подслова. Для представления целых документов мы обращаемся к Doc2Vec, а для векторизации предложений — к Sentence Transformers, что позволяет нам анализировать тексты с учетом более широкого контекста.

Постигая Смысл: Ключевые Задачи NLP

Когда текст преобразован в числовой формат, мы можем приступить к решению более сложных задач, направленных на извлечение смысла и структуры. Эти задачи формируют основу для создания интеллектуальных систем, способных "читать" и "понимать" текст.

Распознавание Именованных Сущностей (NER)

Одна из наиболее востребованных задач в NLP — это распознавание именованных сущностей (NER), которая позволяет нам автоматически идентифицировать и классифицировать такие объекты, как имена людей, организации, местоположения, даты и другие важные сущности в тексте. Для быстрого NER мы часто используем spaCy, которая предоставляет предварительно обученные модели и очень эффективна. Однако для более сложных и кастомизированных задач мы обращаемся к библиотеке Flair, предлагающей современные подходы к NER, или к моделям на основе CRF (Conditional Random Fields) для более гибкого обучения. В последнее время мы активно внедряем BERT для NER, так как трансформерные модели показывают выдающиеся результаты, особенно после тонкой настройки под конкретные домены.

Тематическое Моделирование: Открытие Скрытых Тем

Иногда нам нужно понять, о чем в целом говорят в большом корпусе текстов, без необходимости читать каждый документ. Здесь на помощь приходит тематическое моделирование. Библиотека Gensim является нашим основным инструментом для таких задач, как LDA (Латентное размещение Дирихле) и LSI (Латентное семантическое индексирование). Эти алгоритмы позволяют нам автоматически выявлять скрытые темы в текстовых данных, группируя слова, которые часто встречаются вместе. Мы также экспериментируем с NMF (Неотрицательная матричная факторизация) и часто сравниваем эти модели, чтобы выбрать наиболее подходящую для конкретного набора данных и задачи. Тематическое моделирование незаменимо для анализа больших массивов отзывов клиентов, постов на форумах или научных статей, помогая нам быстро выявить основные дискуссионные направления.

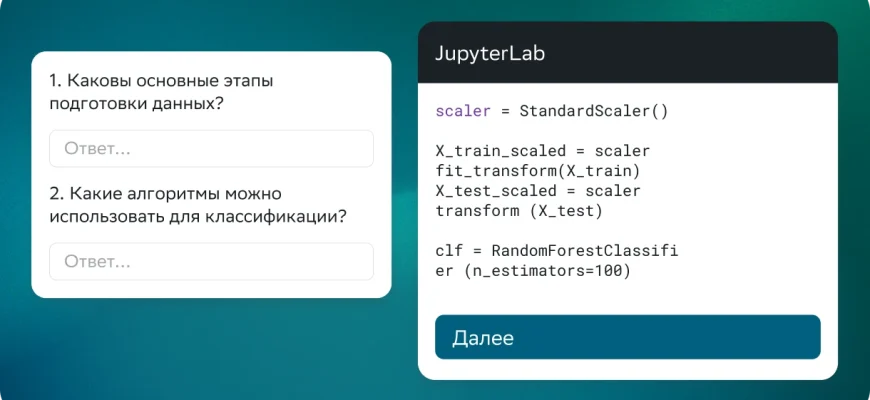

Классификация Текстов: Сортировка и Категоризация

Классификация текстов, это задача отнесения документа к одной или нескольким заранее определенным категориям. Мы применяем Scikit-learn для классификации текстов, используя такие алгоритмы, как SVM (метод опорных векторов) и наивный байесовский классификатор. Это может быть категоризация статей по темам, фильтрация спама, или определение тональности отзывов. Наш опыт показывает, что выбор правильного алгоритма и качественная предобработка данных играют решающую роль в достижении высокой точности. С появлением трансформерных моделей, таких как BERT, мы также активно используем их для классификации, так как они часто превосходят традиционные методы, особенно на больших и сложных данных.

Анализ Тональности (Sentiment Analysis): Понимание Эмоций

Понимание эмоционального окраса текста, это мощный инструмент для бизнеса и маркетинга. Анализ тональности (Sentiment Analysis) позволяет нам определить, является ли отзыв, комментарий или сообщение положительным, отрицательным или нейтральным. Для простого анализа мы начинаем с библиотеки VADER (Valence Aware Dictionary and sEntiment Reasoner), которая отлично подходит для текстов из социальных сетей благодаря своему лексикону. Также TextBlob предоставляет простой интерфейс для анализа тональности, хотя для русского языка его эффективность ограничена. Мы часто строим собственные модели на основе машинного обучения или используем трансформеры для анализа тональности сообщений в социальных сетях (Twitter/Reddit), финансовых новостей или отзывов о продуктах, учитывая такие нюансы, как сарказм, который является одной из самых сложных задач в этой области. Мы также анализируем тональность отзывов о фильмах и ресторанах, выявляя скрытые темы и паттерны.

«Язык — это ключ к сердцу человека, а NLP, ключ к языку машин. Когда мы учим машины понимать нас, мы открываем путь к совершенно новому уровню взаимодействия и инноваций.»

— Йошуа Бенжио, пионер глубокого обучения.

Извлечение Ключевых Фраз и Синтаксический Парсинг

Чтобы быстро понять суть документа, нам часто необходимо извлечь из него наиболее важные слова или фразы. Для этого мы применяем методы извлечения ключевых фраз. Одним из таких инструментов является RAKE (Rapid Automatic Keyword Extraction), который мы используем для извлечения ключевых слов. Другой мощный инструмент — это TextRank, который может извлекать не только ключевые слова, но и целые ключевые предложения, что полезно для суммаризации текста.

Для более глубокого понимания структуры предложения мы используем синтаксический парсинг. Библиотека spaCy предоставляет отличные возможности для реализации синтаксического парсинга, позволяя нам строить деревья зависимостей и понимать грамматические отношения между словами в предложении. Это помогает в таких задачах, как вопросно-ответные системы, где важно точно определить субъект, объект и предикат вопроса. Мы также используем NLTK для POS-теггинга (Part-of-Speech Tagging), который определяет часть речи каждого слова, что является основой для многих последующих анализов.

Нейронные Сети и Трансформеры: Революция в NLP

Последние годы принесли революцию в NLP благодаря глубокому обучению. Нейронные сети и, в особенности, трансформерные архитектуры изменили правила игры, позволив нам решать задачи, которые ранее казались невозможными.

От LSTM к Трансформерам

До эпохи трансформеров мы активно использовали рекуррентные нейронные сети (RNN), особенно их разновидности, такие как LSTM (Long Short-Term Memory), для работы с последовательными данными, такими как текст. Мы применяли Keras/TensorFlow для создания LSTM-сетей для различных задач NLP, включая классификацию и генерацию последовательностей. LSTM хорошо справлялись с удержанием долгосрочных зависимостей в тексте, что было значительным шагом вперед по сравнению с более простыми моделями.

Однако появление трансформеров стало настоящим прорывом. Модели, основанные на архитектуре трансформеров, такие как BERT, GPT и T5, которые мы используем через библиотеку Hugging Face Transformers, преобразили мир NLP. Их способность параллельно обрабатывать последовательности и механизм внимания позволяют им улавливать контекст гораздо эффективнее, чем RNN. Мы применяем трансформеры для широкого спектра сложных задач: от NER и классификации до генерации текста (GPT), генерации диалогов и даже сжатия кода. Возможности этих моделей кажутся безграничными.

Одной из ключевых особенностей трансформерных моделей является возможность тонкой настройки (Fine-tuning) предварительно обученных моделей на наших собственных данных. Это означает, что нам не нужно обучать модель с нуля на огромных массивах текста, а можно взять уже мощную, обученную модель и "доучить" ее под нашу специфическую задачу с относительно небольшим объемом данных. Это значительно ускоряет разработку и повышает качество решений. Мы используем PyTorch/TensorFlow для создания нейросетей NLP, а также для тонкой настройки этих мощных моделей.

Создавая Интеллектуальные Системы: Прикладное NLP

Теория и методы NLP обретают истинную ценность, когда мы применяем их для создания реальных, полезных систем. Мы активно участвуем в разработке различных интеллектуальных решений, которые автоматизируют рутинные задачи и предоставляют новые возможности для взаимодействия с информацией.

Вопросно-ответные Системы (QA) и Суммаризация

Разработка систем вопросно-ответных систем (QA), это одна из наиболее захватывающих областей. Наша цель — позволить машине отвечать на вопросы, сформулированные на естественном языке, используя большой корпус документов. Это требует глубокого понимания текста, извлечения фактов и сопоставления их с вопросами. Мы используем трансформерные модели, такие как BERT, для извлечения ответов из текста, что значительно улучшило точность по сравнению с более ранними подходами. Кроме того, мы работаем над разработкой системы для создания FAQ на основе документов, которая автоматически генерирует вопросы и ответы из предоставленного текста.

Еще одной важной задачей является суммаризация текста. Мы различаем два основных подхода: экстрактивную суммаризацию, которая извлекает наиболее важные предложения из исходного текста (здесь TextRank показывает себя хорошо), и абстрактивную суммаризацию, которая генерирует новый, сокращенный текст, передающий основную суть, но не обязательно содержащий исходные предложения. Для абстрактивной суммаризации мы активно используем Transformer-модели, которые способны генерировать связные и информативные резюме. Сравнение моделей суммирования: экстрактивная и абстрактная, помогает нам выбрать наилучший подход для конкретной задачи.

Машинный Перевод и Чат-боты

Разработка систем машинного перевода на Python — это сложная, но крайне полезная задача. Мы работаем с различными подходами, от статистического машинного перевода до нейронных сетей. Библиотека Polyglot предоставляет хорошие возможности для мультиязычности и анализа редких языков, но для высококачественного перевода мы все чаще обращаемся к Transformer-моделям. Наша цель — создавать системы для автоматического перевода узкоспециализированных текстов, где требуется высокая точность и понимание доменной лексики.

Разработка чат-ботов на Python стала неотъемлемой частью нашего портфолио. Мы используем фреймворк Rasa, который позволяет нам создавать контекстно-зависимые диалоговые системы. Чат-боты помогают автоматизировать поддержку клиентов, отвечать на часто задаваемые вопросы и даже проводить простые диалоги. Это значительно улучшает пользовательский опыт и снижает нагрузку на операторов. Анализ поведенческих паттернов в чатах также помогает нам постоянно улучшать их эффективность.

Проверка Качества и Уникальности Текста

В современном мире, где контент производится в огромных объемах, разработка систем обнаружения плагиата становится критически важной. Мы используем библиотеки для сравнения строк, такие как Jellyfish и Textdistance, которые позволяют измерять сходство между текстовыми фрагментами. Это помогает нам проверять оригинальность документов и выявлять заимствования.

Кроме того, мы разрабатываем инструменты для проверки грамматики и орфографии. Хотя существуют готовые решения, создание собственных инструментов позволяет нам адаптировать их под специфические требования и языковые особенности, например, для нормализации сленга или работы с нелатинскими алфавитами. Мы также работаем над инструментом для автоматического перефразирования, который может быть полезен для генерации вариантов текста или обхода простых проверок на уникальность (с этическим использованием, конечно).

Работа с Данными: От Сбора до Визуализации

Успех любого проекта NLP напрямую зависит от качества и объема данных. Мы уделяем большое внимание сбору, подготовке и анализу текстовых данных, используя различные инструменты и подходы.

Сбор и Извлечение Текста

Часто исходные данные находятся не в удобном для анализа формате. Для веб-скрейпинга текста мы используем библиотеку Beautiful Soup, которая позволяет нам извлекать контент с веб-страниц, очищая его от HTML-тегов и других нежелательных элементов. Это основной инструмент, когда нам нужно собрать большой корпус текстов из интернета, например, новостные статьи, отзывы или посты на форумах.

Помимо веб-страниц, текст часто содержится в PDF-документах. Для извлечения текста из PDF мы применяем библиотеку PyMuPDF (или `fitz`), которая позволяет эффективно парсить содержимое PDF-файлов, извлекая текст, изображения и метаданные. Это особенно важно при работе с юридическими документами, научными публикациями или финансовой отчетностью.

Анализ и Визуализация

После сбора и предобработки данных наступает этап глубокого анализа. Мы проводим анализ частотности слов и n-грамм, чтобы выявить наиболее значимые термины и устойчивые выражения. Это помогает нам понять ключевые концепции в тексте и подготовить данные для дальнейшего моделирования. Мы также анализируем частотность редких слов и их значение, поскольку иногда именно они несут уникальную информацию.

Для более глубокого понимания данных мы используем инструменты для визуализации текстовых данных, такие как Word Clouds (облака слов), которые наглядно показывают наиболее часто встречающиеся слова, и Heatmaps для визуализации матриц сходства или корреляций. Это делает результаты анализа более доступными и понятными для широкой аудитории. Библиотека Sweetviz также может быть полезна для быстрого анализа текстовых данных и генерации отчетов.

Мы также занимаемся анализом метаданных текста, анализом временных рядов в текстовых данных (например, как меняется тональность или темы в новостях со временем) и анализом лог-файлов для выявления аномалий или важных событий. Обработка больших текстовых массивов (Big Data NLP) требует эффективных решений, и здесь мы полагаемся на оптимизированные библиотеки, такие как Gensim, и распределенные вычислительные системы.

Многоязычность и Специализированные Задачи

Мир не ограничивается одним языком, и наши проекты тоже. Мы активно работаем с многоязычными текстовыми корпусами, используя библиотеки, такие как Polyglot для мультиязычности и Stanza для языков с богатой морфологией, включая русский. Это позволяет нам применять одни и те же подходы к анализу текстов на разных языках, а также работать с нелатинскими алфавитами в Python NLP.

Среди других специализированных задач, которыми мы занимаемся: разработка инструмента для проверки фактов (Fact-Checking), анализ стилистики текстов (авторский почерк), разработка систем для определения авторства текста, а также создание словарей и тезаурусов для конкретных доменов. Мы также используем библиотеку Textacy, которая предоставляет набор высокоуровневых функций для анализа зависимостей, извлечения информации и других задач.

Наш путь в мире NLP с Python — это непрерывное обучение и эксперименты. Мы видим, как быстро развивается эта область, и как новые методы и инструменты появляются буквально каждый день. От базовой токенизации до сложнейших трансформерных архитектур, Python предоставляет нам все необходимое для работы с текстом на любом уровне сложности. Мы продолжим исследовать такие направления, как анализ тональности с учетом сарказма, разработка моделей для выявления связей между сущностями, обработка текста в режиме реального времени (Streaming NLP) и использование GPU-ускорения для более быстрых вычислений.

Мы уверены, что понимание и применение NLP станет ключевым навыком для каждого, кто работает с данными. Возможности, которые открывает анализ естественного языка, огромны: от улучшения пользовательского опыта и автоматизации рутинных задач до проведения глубоких социальных исследований и создания по-настоящему интеллектуальных систем. Мы приглашаем вас присоединиться к этому увлекательному путешествию и вместе с нами открывать новые горизонты в мире слов и смыслов.

Подробнее

| Токенизация NLTK | NER spaCy | Тематическое моделирование Gensim | Классификация Scikit-learn | Word2Vec GloVe |

| Анализ тональности VADER | Трансформеры Hugging Face | Регулярные выражения Python | Лемматизация Stanza | Векторизация TF-IDF |