Погружение в бездну текста: Как мы приручаем слова с Python и NLP

Привет, дорогие читатели и коллеги по цеху! Сегодня мы хотим поделиться с вами одним из самых захватывающих приключений в мире данных, которое изменило наше восприятие информации – это путешествие в мир обработки естественного языка, или NLP (Natural Language Processing). Помните, как в детстве мы пытались понять, что говорят наши питомцы или как работает радио? Сегодня мы стоим на пороге понимания самого сложного, что создала природа – человеческого языка, но уже с помощью кода и невероятно мощных инструментов Python.

Мы живем в эпоху информации, где текст – это не просто набор символов, а океан нераскрытых знаний. От социальных сетей до юридических документов, от медицинских карт до отзывов клиентов – повсюду нас окружают слова, предложения, абзацы. Но как из этого хаоса извлечь смысл? Как заставить компьютер не просто хранить текст, а понимать его, анализировать, генерировать и даже переводить? Именно здесь на сцену выходит NLP – дисциплина на стыке искусственного интеллекта, лингвистики и информатики, которая позволяет нам, программистам и аналитикам, говорить с машинами на одном языке с человеком.

За годы работы с текстом мы накопили огромный опыт, экспериментируя с различными библиотеками, подходами и моделями. И сегодня мы готовы раскрыть вам наши самые ценные секреты и проверенные методы. Приготовьтесь, ведь нас ждет глубокое погружение в мир Python и его арсенала для NLP – от базовых концепций до передовых архитектур трансформеров. Мы покажем, как эти инструменты помогают нам не только решать повседневные задачи, но и открывать совершенно новые горизонты в работе с текстовыми данными. Давайте начнем этот увлекательный путь вместе!

Первые шаги: Основы предобработки текста

Прежде чем мы сможем заставить компьютер "понять" текст, нам нужно его подготовить. Представьте, что вы готовите ингредиенты для сложного блюда – их нужно очистить, нарезать, отсортировать. То же самое и с текстом. Этот этап, известный как предобработка, является фундаментом любого NLP-проекта, и мы всегда уделяем ему особое внимание. Без качественной предобработки даже самые продвинутые модели будут работать неэффективно.

Мы начинаем с самых азов, и здесь нашими верными спутниками становятся библиотеки, которые давно зарекомендовали себя как стандарты индустрии. Каждая из них предлагает уникальный набор инструментов, и мы учились выбирать правильный для каждой конкретной задачи.

Токенизация и Стемминг с NLTK

Когда мы получаем сырой текст, он представляет собой единую строку символов. Наша первая задача – разбить его на более мелкие, осмысленные единицы. Этот процесс называется токенизацией. NLTK (Natural Language Toolkit) – это настоящая "швейцарская армия" для начинающих и опытных NLP-специалистов. С его помощью мы легко можем разделить текст на слова или предложения.

После токенизации мы часто сталкиваемся с проблемой: слова могут иметь разные формы ("бежать", "бежит", "бегал"). Для компьютера это разные слова, хотя по сути они обозначают одно и то же действие. Здесь на помощь приходит стемминг – процесс усечения слов до их корневой формы (стема), например, "бежать" для всех вышеупомянутых форм. Это позволяет нам уменьшить размер словаря и сосредоточиться на основном значении слова. Мы используем различные стеммеры, такие как PorterStemmer или SnowballStemmer, в зависимости от языка и специфики задачи.

Лемматизация: Глубже, чем стемминг

Стемминг, хоть и полезен, имеет свои ограничения: он часто создает несуществующие слова (например, "красив" из "красивый"). Для более точного приведения слова к его словарной форме (лемме), мы используем лемматизацию. Она учитывает морфологию языка и возвращает грамматически правильное базовое слово. Это особенно важно для языков с богатой морфологией, таких как русский. Например, "бежал", "бегущий", "побежали" будут приведены к "бежать". Мы часто используем возможности spaCy или Stanza для продвинутой лемматизации, так как они предлагают более точные и контекстно-зависимые алгоритмы.

Регулярные выражения (re) в предобработке

Несмотря на мощь специализированных библиотек, в нашей работе мы постоянно возвращаемся к старому доброму модулю re (regular expressions) в Python. Регулярные выражения – это незаменимый инструмент для тонкой настройки предобработки: удаления лишних символов, таких как HTML-теги или пунктуация, поиска определенных паттернов в тексте, замены специфических строк или нормализации сленга и эмодзи. Мы используем их для создания собственных инструментов очистки текста, чтобы гарантировать, что данные идеально подходят для дальнейшего анализа. Например, для удаления URL-адресов или хэштегов из твитов.

Очистка и нормализация неструктурированного текста

Текст в реальном мире редко бывает чистым. Он полон опечаток, сокращений, неформальной лексики, символов, которые не несут смысловой нагрузки; Наша задача – максимально очистить эти данные. Это может включать:

- Удаление стоп-слов (артиклей, предлогов, союзов), которые часто не несут уникальной информации.

- Нормализация регистра (приведение всего текста к нижнему регистру).

- Обработка чисел, дат и специальных символов.

- Разработка инструментов для исправления орфографии и грамматики.

Мы часто создаем кастомные пайплайны очистки, комбинируя регулярные выражения с функционалом таких библиотек, как NLTK и spaCy, чтобы добиться максимальной чистоты и консистентности данных.

Понимание структуры и смысла: От слов к знаниям

После того как текст очищен и подготовлен, мы переходим к этапу, где компьютер начинает не просто видеть слова, но и понимать их взаимосвязи, структуру и даже скрытый смысл. Это сердце NLP, где мы применяем различные алгоритмы для извлечения ценной информации и трансформации текста в формат, который машины могут эффективно обрабатывать.

Использование spaCy для быстрого NER и синтаксического парсинга

spaCy – это высокопроизводительная библиотека, которая стала нашим незаменимым инструментом для многих задач. Она отличается своей скоростью и точностью, особенно в части распознавания именованных сущностей (NER) и синтаксического парсинга. NER позволяет нам автоматически находить и классифицировать сущности в тексте, такие как имена людей, организации, географические названия, даты и многое другое. Это невероятно полезно для извлечения фактов и структурирования неструктурированных данных.

Синтаксический парсинг, в свою очередь, раскрывает грамматическую структуру предложений, показывая взаимосвязи между словами. Например, мы можем определить подлежащее, сказуемое, дополнения и другие части речи. Это помогает нам не только анализировать зависимости, но и улучшать качество вопросов для вопросно-ответных систем или точно извлекать информацию.

Вот пример того, как мы используем spaCy для NER:

import spacy

Загружаем модель для английского языка

Мы убеждаемся, что модель уже загружена: python -m spacy download en_core_web_sm

nlp = spacy.load("en_core_web_sm")

text = "Apple Inc. была основана Стивом Джобсом в Купертино, Калифорния."

doc = nlp(text)

print("Распознанные сущности:")

for ent in doc.ents:

print(f" {ent.text} ⸺ {ent.label_}")

Apple Inc. ー ORG

Стивом Джобсом ⸺ PERSON

Купертино ー GPE

Калифорния ⸺ GPE

Векторизация текста: Превращение слов в числа

Компьютеры лучше всего работают с числами. Поэтому, чтобы применить математические алгоритмы и модели машинного обучения к тексту, нам необходимо преобразовать слова и предложения в числовые векторы. Этот процесс называется векторизацией.

Разработка собственных векторизаторов (CountVectorizer, TfidfVectorizer)

На самых базовых уровнях мы используем такие векторизаторы, как CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn. CountVectorizer просто подсчитывает частоту каждого слова в документе, создавая вектор, где каждое измерение соответствует уникальному слову. TfidfVectorizer идет дальше, учитывая не только частоту слова в документе (Term Frequency, TF), но и его редкость во всем корпусе документов (Inverse Document Frequency, IDF). Это позволяет нам выделять слова, которые более значимы для конкретного документа.

Word Embeddings: Word2Vec и GloVe с Gensim

Эти методы, хоть и эффективны, имеют один существенный недостаток: они не учитывают семантическую связь между словами. То есть, слова "король" и "королева" будут считаться столь же далекими, как "король" и "банан". Для решения этой проблемы мы обратились к так называемым "встраиваниям слов" (Word Embeddings), таким как Word2Vec и GloVe. Эти модели обучаются на огромных корпусах текста и представляют слова в виде многомерных векторов, где семантически близкие слова находятся близко друг к другу в векторном пространстве. Мы часто используем библиотеку Gensim для работы с Word2Vec и GloVe, а также для обучения собственных моделей на наших данных.

Doc2Vec и Sentence Transformers для векторизации документов и предложений

Если Word Embeddings отлично подходят для отдельных слов, то для векторизации целых предложений или документов мы используем Doc2Vec (расширение Word2Vec) или более современные Sentence Transformers. Последние особенно эффективны, так как они способны учитывать контекст и генерировать высококачественные векторы для предложений, которые затем можно использовать для задач сходства, кластеризации или поиска.

Тематическое моделирование с Gensim (LDA, LSI)

Представьте, что у вас есть тысячи документов, и вы хотите понять, о чем они. Прочитать каждый – нереально. Здесь на помощь приходит тематическое моделирование. Мы используем библиотеку Gensim для реализации таких алгоритмов, как Латентное Размещение Дирихле (LDA) и Латентно-Семантический Индекс (LSI). Эти методы позволяют нам автоматически находить скрытые "темы" в корпусе документов, представляя каждый документ как смесь этих тем, а каждую тему – как распределение слов.

Тематическое моделирование – это мощный инструмент для анализа больших текстовых массивов, позволяющий нам выявлять скрытые закономерности, категоризировать статьи, анализировать отзывы клиентов по категориям и даже отслеживать изменения тем со временем. Сравнение моделей тематического моделирования, таких как LDA и NMF (Non-negative Matrix Factorization), помогает нам выбрать наиболее подходящий подход для конкретной задачи, учитывая особенности данных и желаемую интерпретируемость результатов.

"Язык – это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Извлечение смысла: От мнений до фактов

Когда текст преобразован в числа, а его структура проанализирована, мы можем перейти к извлечению более глубокого смысла: определению тональности, классификации по категориям и даже генерации нового текста.

Анализ тональности (Sentiment Analysis)

Одной из самых востребованных задач в NLP является анализ тональности – определение эмоциональной окраски текста (положительной, отрицательной, нейтральной). Это критически важно для анализа отзывов клиентов, мониторинга социальных сетей и оценки репутации бренда.

VADER и TextBlob для простого анализа

Для быстрого и простого анализа тональности мы часто используем VADER (Valence Aware Dictionary and sEntiment Reasoner), который хорошо работает с текстами из социальных сетей и учитывает сленг, эмодзи и акронимы. TextBlob также предлагает простой интерфейс для анализа тональности, хотя его точность может быть ниже для специфических доменов.

Продвинутый анализ тональности с учетом сарказма и домена

Однако, реальные тексты часто содержат сарказм, иронию или специфическую лексику, которую простые модели не понимают. Для таких случаев мы обучаем собственные модели тональности, используя машинное обучение (SVM, Naive Bayes) или глубокое обучение (LSTM, Transformer-модели). Мы также специализируемся на анализе тональности в узкоспециализированных областях, таких как финансовые новости или юридические документы, где требуется особая внимательность к контексту.

Классификация текстов с Scikit-learn и PyTorch/TensorFlow

Классификация текстов – это задача отнесения документа к одной или нескольким предопределенным категориям. Будь то спам-фильтрация, категоризация новостных статей, или определение жанра книги, классификация является фундаментальной задачей NLP.

Мы активно используем Scikit-learn для классических методов машинного обучения, таких как SVM (Support Vector Machines) и Наивный Байесовский классификатор. Эти методы демонстрируют отличные результаты на хорошо размеченных данных и относительно просты в интерпретации.

Для более сложных задач и больших объемов данных мы переходим к глубокому обучению, используя PyTorch или TensorFlow. Создание нейросетей, таких как LSTM (Long Short-Term Memory) или сверточные нейронные сети (CNN), позволяет нам улавливать более сложные зависимости и паттерны в текстовых данных, значительно повышая точность классификации.

Извлечение ключевых фраз и суммаризация

Как быстро получить самую важную информацию из длинного текста? Здесь нам помогают извлечение ключевых фраз и суммаризация. Для извлечения ключевых слов и фраз мы используем такие алгоритмы, как RAKE (Rapid Automatic Keyword Extraction) или TextRank, которые анализируют частотность и взаимосвязи слов. Это позволяет нам быстро понять основное содержание документа.

Суммаризация текста делится на два основных типа:

- Экстрактивная суммаризация: Выбирает наиболее важные предложения из оригинального текста и объединяет их. Мы часто используем TextRank для этого подхода.

- Абстрактивная суммаризация: Генерирует новые предложения, которые передают суть оригинального текста. Это гораздо более сложная задача, требующая глубокого понимания языка и часто реализуемая с помощью трансформерных моделей.

Разработка систем суммаризации текста является одним из наших любимых направлений, поскольку она напрямую помогает пользователям экономить время и быстрее получать доступ к информации.

Новая эра NLP: Трансформеры и глубокое обучение

Последние несколько лет принесли революцию в мир NLP с появлением трансформерных архитектур. Эти модели, такие как BERT, GPT и их многочисленные вариации, изменили правила игры, позволив нам решать задачи, которые ранее казались недостижимыми.

Трансформеры (Hugging Face) для сложных задач NLP

Мы активно используем библиотеку Hugging Face Transformers, которая предоставляет простой доступ к сотням предварительно обученных моделей. Эти модели способны выполнять широкий спектр задач, от классификации текста и распознавания именованных сущностей до машинного перевода и генерации текста. Их особенность в том, что они обучаются на огромных массивах данных и способны улавливать сложнейшие контекстные зависимости в языке.

Применение BERT для задач классификации и NER, а также тонкая настройка (Fine-tuning) предварительно обученных моделей под наши специфические данные, стали стандартной практикой. Это позволяет нам достигать состояния "state-of-the-art" даже с относительно небольшими объемами размеченных данных.

Генерация текста и диалогов с GPT-подобными моделями

Возможность генерировать связный и осмысленный текст всегда была одной из главных целей NLP. С появлением GPT-подобных моделей, это стало реальностью. Мы используем их для создания чат-ботов, автоматического написания статей, генерации описаний продуктов и даже для разработки систем вопросно-ответных систем (QA), которые могут отвечать на вопросы, основываясь на предоставленном тексте. Это открывает безграничные возможности для автоматизации контента и взаимодействия с пользователями.

Машинный перевод и многоязычные корпуса

Мир становится все более глобальным, и необходимость в качественном машинном переводе растет. Мы работаем над созданием систем машинного перевода на Python, используя как традиционные подходы, так и современные трансформерные модели. Обработка многоязычных текстовых корпусов требует особого внимания к языковым особенностям, и такие библиотеки, как Polyglot и Stanza, становятся нашими союзниками для работы с языками с богатой морфологией или редкими языками.

Практические инструменты и сценарии применения

Теория – это хорошо, но без практических инструментов и реальных сценариев применения, все наши знания остаются лишь абстракциями. Мы всегда стремимся применять полученные знания на практике, создавая полезные и эффективные решения.

Веб-скрейпинг и извлечение текста

Один из первых шагов в любом NLP-проекте – это получение данных. Если данные не доступны в чистом виде, мы прибегаем к веб-скрейпингу. Библиотека Beautiful Soup является нашим основным инструментом для извлечения текста из HTML-страниц. Она позволяет нам парсить веб-страницы, находить нужные элементы и извлекать текстовое содержимое, очищая его от ненужных тегов и форматирования. Аналогично, для извлечения текста из PDF-документов мы используем PyMuPDF, что особенно актуально при работе с юридическими или научными текстами.

Чат-боты и вопросно-ответные системы

Разработка чат-ботов – это одно из самых увлекательных направлений в NLP. Мы используем фреймворки вроде Rasa для создания интеллектуальных диалоговых систем, которые могут понимать намерения пользователя, извлекать сущности и генерировать осмысленные ответы. Для более простых задач или для прототипирования мы можем использовать TextBlob для определения языка или базового анализа. А для создания более сложных вопросно-ответных систем мы используем трансформерные архитектуры, которые способны находить ответы в больших корпусах документов.

Специализированные задачи и библиотеки

Мир NLP огромен, и постоянно появляются новые задачи и инструменты. Вот некоторые из них, которые мы активно используем:

- Stanza: Для языков с богатой морфологией, таких как русский, Stanza (разработанная в Стэнфордском университете) предлагает высококачественную лемматизацию, POS-теггинг и синтаксический парсинг.

- Flair: Современная библиотека для NER, POS-теггинга и других задач, известная своими мощными встраиваниями символов и состоянием "state-of-the-art" производительностью.

- Textacy: Удобная библиотека для более продвинутого анализа текста, включая извлечение n-грамм, ключевых фраз, синтаксических паттернов и стилистики.

- Polyglot: Отлично подходит для мультиязычной обработки текста, включая токенизацию, NER, языковое определение для широкого спектра языков.

- Jellyfish и Textdistance: Эти библиотеки незаменимы для сравнения строк, поиска дубликатов, исправления опечаток и даже для обнаружения плагиата. Мы используем их для измерения расстояния Левенштейна, Джаро-Винклера и других метрик сходства.

- Sweetviz: Для быстрого и красивого анализа текстовых данных, Sweetviz предоставляет интерактивные отчеты, которые помогают нам быстро понять структуру и качество наших данных.

- Sentence Transformers: Предоставляет предварительно обученные модели для генерации встраиваний предложений, что позволяет сравнивать целые предложения или документы по смыслу.

Анализ лог-файлов и Big Data NLP

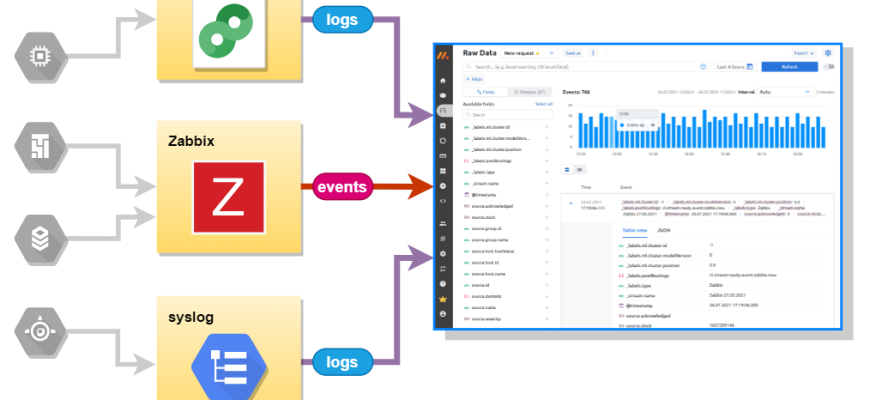

Текст – это не только человеческая речь. Лог-файлы, системные сообщения, данные датчиков – все это огромные текстовые массивы, которые содержат ценную информацию. Мы применяем методы NLP для анализа лог-файлов, выявления аномалий, обнаружения паттернов и автоматической категоризации событий. Работа с большими текстовыми массивами (Big Data NLP) требует оптимизированных алгоритмов и распределенных вычислений, и мы постоянно ищем способы улучшить производительность наших систем.

Визуализация текстовых данных

Понимание текстовых данных часто начинается с визуализации. Мы используем инструменты для создания облаков слов (Word Clouds) для быстрого выявления наиболее часто встречающихся терминов. Тепловые карты (Heatmaps) помогают нам визуализировать матрицы сходства между документами или словами. Эти методы позволяют нам не только лучше понять данные, но и эффективно представить результаты анализа нашим коллегам и заказчикам.

| Область | Задача NLP | Используемые инструменты/методы |

|---|---|---|

| Маркетинг | Анализ тональности отзывов клиентов, извлечение ключевых фраз из социальных сетей. | VADER, TextBlob, Scikit-learn (классификация), RAKE. |

| Медицина | Извлечение информации из медицинских записей, NER для симптомов и диагнозов. | spaCy (NER), NLTK (токенизация), Transformers (BERT для извлечения). |

| Юриспруденция | Анализ юридических документов, извлечение дат и событий, сравнение контрактов. | PyMuPDF, spaCy (NER), Jellyfish (Textdistance), Transformers (для связей между сущностями). |

| Финансы | Анализ тональности финансовых новостей, категоризация отчетов. | Scikit-learn (классификация), Transformers (BERT), специализированные словари. |

| Обслуживание клиентов | Разработка чат-ботов, автоматическая категоризация запросов, суммаризация обращений. | Rasa, Transformers (GPT), TextRank, Scikit-learn. |

Вызовы и перспективы: Куда мы движемся

Мир NLP постоянно развивается, и вместе с ним растут как наши возможности, так и вызовы, с которыми мы сталкиваемся. Мы не стоим на месте, постоянно исследуя новые горизонты и совершенствуя наши подходы.

Проблемы обработки неполных и ошибочных данных

Одна из самых больших проблем в реальных проектах – это работа с "грязными" данными. Опечатки, грамматические ошибки, неполные предложения, сленг, эмодзи, сокращения – все это требует тщательной предобработки. Мы постоянно совершенствуем наши инструменты для проверки грамматики и орфографии, нормализации сленга и автоматической разметки данных, чтобы наши модели могли работать максимально эффективно даже с несовершенными входными данными.

Оценка качества моделей

Как понять, насколько хорошо работает наша модель? Оценка качества NLP-моделей – это отдельная наука. Мы используем различные метрики, такие как F1-score, Precision, Recall для NER и классификации, BLEU для машинного перевода, и другие, чтобы объективно измерять производительность наших систем. Сравнение различных методов машинного обучения (SVM, Naive Bayes, трансформеры) и различных библиотек (SpaCy vs NLTK для лемматизации) – это непрерывный процесс оптимизации и выбора наилучшего подхода для каждой конкретной задачи.

Будущее NLP: Контекст, эмоции и этика

Мы видим, что будущее NLP лежит в более глубоком понимании контекста, эмоций и даже намерений. Анализ тональности с учетом сарказма, распознавание эмоций с помощью трансформерных архитектур – это лишь начало. Разработка моделей для выявления связей между сущностями, систем для автоматического тегирования контента и анализа стилистики текстов открывает новые возможности. Однако, с этой мощью приходят и этические вопросы, связанные с предвзятостью моделей, конфиденциальностью данных и ответственным использованием ИИ. Мы всегда помним об этих аспектах, разрабатывая наши решения.

Обработка текста в режиме реального времени (Streaming NLP) также является важным направлением, особенно для мониторинга социальных сетей, анализа лог-файлов и интерактивных чат-ботов. Это требует высокоэффективных и масштабируемых решений.

Наконец, мы активно исследуем использование GPU-ускорения для обработки текста, особенно для работы с большими трансформерными моделями, что значительно сокращает время обучения и инференса.

Мы надеемся, что это путешествие по миру NLP с Python оказалось для вас таким же увлекательным, как и для нас. Это область, которая постоянно развивается, предлагая новые вызовы и невероятные возможности. Если вы только начинаете свой путь, не бойтесь экспериментировать, читать документацию и пробовать новые инструменты. Сообщество NLP огромно и всегда готово помочь. А мы, в свою очередь, всегда готовы делиться нашим опытом и знаниями, чтобы вместе приручать этот сложный, но удивительный мир текста. Успехов вам в ваших NLP-приключениях!

.

Подробнее

| Основы NLTK | Векторизация текста | Анализ тональности | Трансформеры NLP | Чат-боты Python |

| Использование spaCy | Тематическое моделирование | Классификация текстов | Генерация текста GPT | NLP для юристов |