- Погружение в бездну текста: Как Python открывает нам мир NLP от токенов до Трансформеров

- Фундамент понимания: Первые шаги в обработке текста

- От слов к смыслам: Токенизация, стемминг и лемматизация

- Мастерство очистки: Регулярные выражения и предобработка

- От слов к числам: Как машины понимают смысл

- Векторизация текста: От простого к сложному

- Word Embeddings: Глубокое погружение в смысл слов

- Контекстуальные встраивания и Трансформеры: Когда контекст – это всё

- Ключевые задачи NLP: От распознавания сущностей до тематического моделирования

- Распознавание именованных сущностей (NER)

- Анализ тональности (Sentiment Analysis)

- Тематическое моделирование: Поиск скрытых тем

- Классификация текстов: Распределение по категориям

- Продвинутые техники и реальные сценарии применения

- Суммаризация текста: От длинного к краткому и ёмкому

- Веб-скрейпинг и извлечение данных: За пределами структурированных источников

- Мультиязычность и сложные языки: Преодолевая барьеры

- Будущее уже здесь: Трансформеры и генеративные модели

- Инструменты и экосистема: Наш любимый арсенал

- Визуализация и оценка качества

- Завершающие мысли: Путь NLP бесконечен

Погружение в бездну текста: Как Python открывает нам мир NLP от токенов до Трансформеров

Привет, друзья! Как опытные исследователи цифровых джунглей, мы постоянно ищем новые способы понять и осмыслить огромные объемы информации, которые нас окружают․ Сегодня мы хотим поговорить о том, что давно стало не просто инструментом, а целой философией для нас – об обработке естественного языка, или NLP (Natural Language Processing), и о том, как Python стал нашим верным компаньоном в этом увлекательном путешествии․ Мы погрузимся в мир, где текст перестает быть просто набором символов и превращается в данные, полные смысла, эмоций и скрытых связей;

За последние годы технологии NLP совершили невероятный скачок, перейдя от простых статистических методов к сложным нейронным сетям, способным не только понимать, но и генерировать человеческий язык с поразительной точностью․ И если вы когда-либо задавались вопросом, как работают голосовые помощники, системы рекомендаций или даже автоматический перевод, то знайте – за всем этим стоит магия NLP․ Мы с вами не раз убеждались, что освоение этих инструментов открывает двери к решению сложнейших задач, от анализа отзывов клиентов до создания умных чат-ботов․ Присоединяйтесь к нам, и мы покажем, как шаг за шагом превратить хаотичный текст в ценные инсайты․

Фундамент понимания: Первые шаги в обработке текста

Прежде чем мы сможем научить машину "читать" и "понимать", нам необходимо подготовить текст․ Этот этап, известный как предобработка, является критически важным, поскольку от его качества зависит успех всех последующих шагов․ Мы часто говорим, что "мусор на входе – мусор на выходе", и в NLP это правило работает безотказно․ Давайте рассмотрим основные инструменты и техники, которые мы используем для превращения сырого текста в пригодные для анализа данные․

От слов к смыслам: Токенизация, стемминг и лемматизация

Первое, что мы делаем с текстом, – это разбиваем его на более мелкие, осмысленные единицы, которые называются токенами․ Чаще всего токенами являются слова, но это могут быть и пунктуационные знаки, цифры или даже целые фразы, в зависимости от задачи․ Библиотека NLTK (Natural Language Toolkit) является нашей рабочей лошадкой для этих базовых операций․ Мы используем её для токенизации предложений и слов, что позволяет нам получить структурированный список из текста․

После токенизации мы сталкиваемся с проблемой вариативности слов: "бежать", "бежит", "бежал" – все это формы одного и того же глагола․ Здесь на помощь приходят стемминг и лемматизация․

- Стемминг – это процесс удаления суффиксов и окончаний слов для приведения их к базовой форме (стему)․ Например, "running", "runs", "ran" могут быть сведены к "run"․ Это быстрый, но иногда грубый метод, который может привести к появлению несуществующих слов․

- Лемматизация – более интеллектуальный подход; Она использует словарные базы и морфологический анализ, чтобы привести слово к его базовой форме (лемме), которая является корректным словом языка; Так, "лучше" будет лемматизировано до "хорошо", а не до "лучш"․ Для русского языка мы часто полагаемся на spaCy или Stanza, поскольку они предлагают более продвинутые модели для языков с богатой морфологией․

Мы всегда взвешиваем, какой метод выбрать: для задач, где важна скорость и приблизительная форма, стемминг подходит лучше, но для глубокого семантического анализа лемматизация – наш выбор․

Мастерство очистки: Регулярные выражения и предобработка

Сырой текст, который мы получаем из интернета или баз данных, часто содержит много шума: HTML-теги, специальные символы, URL-адреса, цифры, множественные пробелы и т․д․ Здесь в игру вступают регулярные выражения (re) – мощный инструмент для поиска и манипулирования текстовыми шаблонами․ Мы используем их для:

- Удаления HTML-тегов и JavaScript-кода․

- Извлечения URL-адресов или их удаления․

- Нормализации пунктуации и приведения текста к нижнему регистру․

- Очистки текста от стоп-слов (артиклей, предлогов, союзов), которые не несут значимой смысловой нагрузки для большинства задач․

Для нас важно создать чистый, унифицированный корпус текста, который позволит моделям сосредоточиться на содержательной части․ Мы даже разработали собственные инструменты для проверки грамматики и исправления орфографии, чтобы минимизировать влияние ошибок на дальнейший анализ․

От слов к числам: Как машины понимают смысл

Компьютеры не понимают слова в том виде, в каком их понимаем мы․ Для них это просто последовательности символов․ Чтобы машина могла работать с текстом, нам нужно преобразовать слова и документы в числовые представления, или векторы․ Это один из самых фундаментальных и захватывающих аспектов NLP․

Векторизация текста: От простого к сложному

Начнем с классических методов, которые до сих пор широко используются благодаря своей простоте и эффективности:

- CountVectorizer: Этот метод просто подсчитывает частоту появления каждого слова в документе․ Он создает матрицу, где строки – это документы, а столбцы – слова из всего корпуса, а значения – количество вхождений․

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): Более продвинутый вариант․ Он не только учитывает частоту слова в документе (TF), но и его редкость во всем корпусе (IDF)․ Слова, которые часто встречаются во многих документах (например, "и", "в"), получают меньший вес, а уникальные и значимые слова – больший․ Это помогает выявить наиболее релевантные термины․

Мы часто используем Scikit-learn для реализации этих векторизаторов, поскольку это быстро и удобно․ Однако эти методы имеют свои ограничения: они не учитывают семантическую близость слов ("собака" и "щенок" будут рассматриваться как совершенно разные сущности) и не могут обрабатывать слова, не встречавшиеся в обучающем корпусе․

Word Embeddings: Глубокое погружение в смысл слов

Революция в представлении слов произошла с появлением Word Embeddings․ Это плотные векторные представления, где слова с похожим значением расположены близко друг к другу в многомерном пространстве․

- Word2Vec и GloVe: Эти модели, реализованные, например, в библиотеке Gensim, обучаются на больших текстовых корпусах и могут улавливать семантические отношения между словами․ Например, "король" ⸺ "мужчина" + "женщина" = "королева"․ Мы использовали их для таких задач, как поиск синонимов, расширение запросов и улучшение качества классификации․

- FastText: Разработанный Facebook, FastText улучшает Word2Vec, учитывая подсловные единицы (символьные n-граммы)․ Это делает его особенно полезным для работы с редкими словами и языками с богатой морфологией, где одно слово может иметь множество форм․

- Doc2Vec: Расширение Word2Vec, которое позволяет векторизовать не только слова, но и целые документы или предложения․ Это бесценно для сравнения документов, поиска похожих статей или кластеризации текстов․

Контекстуальные встраивания и Трансформеры: Когда контекст – это всё

Несмотря на все преимущества Word Embeddings, они имеют один существенный недостаток: одно слово всегда имеет один и тот же вектор, независимо от контекста․ Например, слово "банк" в значении "финансовое учреждение" и "берег реки" будет иметь одинаковое представление․ Здесь на сцену выходят контекстуальные встраивания и архитектура Трансформеров․

Модели, такие как BERT (Bidirectional Encoder Representations from Transformers), ELMo, GPT, используют сложную нейронную архитектуру, чтобы генерировать векторное представление слова, которое зависит от всего предложения или документа, в котором оно находится․ Это позволяет улавливать тончайшие нюансы смысла․

Мы активно используем библиотеку Hugging Face Transformers, которая предоставляет доступ к сотням предварительно обученных моделей․ Это кардинально изменило наш подход ко многим задачам NLP, позволив достигать state-of-the-art результатов даже с ограниченными данными, благодаря тонкой настройке (fine-tuning) предварительно обученных моделей․

"Язык – это лабиринт, по которому мы идем, чтобы понять мир․ NLP – это карта и компас, которые помогают нам не заблудиться․"

Ключевые задачи NLP: От распознавания сущностей до тематического моделирования

Теперь, когда у нас есть чистый текст и способы его представления в числовом виде, мы можем приступить к решению более сложных и прикладных задач․

Распознавание именованных сущностей (NER)

NER – это задача идентификации и классификации именованных сущностей в тексте, таких как имена людей, названия организаций, географические объекты, даты и т․д․ Это краеугольный камень для систем извлечения информации․ Мы активно используем spaCy для быстрого и точного NER, так как она предлагает отличные предварительно обученные модели․ Для более сложных или специфичных задач мы обращаемся к библиотеке Flair, которая использует state-of-the-art модели на основе нейронных сетей, или к CRF (Conditional Random Fields) для случаев, когда требуется высокая точность и возможность ручной настройки признаков․

Оценка качества NER-моделей является для нас важной частью работы․ Мы внимательно следим за метриками, такими как F1-score, Precision и Recall, чтобы убедиться, что наши модели эффективно справляются с поставленной задачей, особенно когда речь идет об извлечении дат и чисел из текста или разметке сущностей в юридических документах․

Анализ тональности (Sentiment Analysis)

Понять эмоциональную окраску текста – это, пожалуй, одна из самых востребованных задач NLP․ Мы используем VADER (Valence Aware Dictionary and sEntiment Reasoner) для быстрого анализа тональности, особенно в социальных сетях, поскольку он хорошо справляется с текстами, содержащими смайлики, сленг и акронимы․ Для более общего анализа мы обращаемся к TextBlob, хотя и понимаем его ограничения․

Когда мы анализируем отзывы клиентов, финансовые новости или посты о политике, мы часто сталкиваемся с сарказмом и иронией, которые представляют собой серьезную проблему для любой модели тональности․ В таких случаях мы применяем более продвинутые подходы, включая тонкую настройку трансформерных моделей, чтобы улавливать эти тонкие нюансы․

Тематическое моделирование: Поиск скрытых тем

Представьте, что у вас есть огромный корпус текстов, и вам нужно понять, о чем они вообще․ Тематическое моделирование позволяет нам автоматически обнаруживать скрытые "темы" в коллекции документов․

- LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing): Эти алгоритмы, реализованные в библиотеке Gensim, являются классическими методами тематического моделирования․ Они позволяют нам понять, какие слова чаще встречаються вместе и формируют определенные темы․ Мы использовали их для анализа отзывов о продуктах, выявления сезонности в текстовых данных и категоризации статей․

- NMF (Non-negative Matrix Factorization): Еще один мощный метод, который часто сравнивают с LDA․ Мы обнаружили, что NMF иногда дает более интерпретируемые темы, особенно когда мы работаем с текстами, где ожидаем четкого разделения по темам․

Мы всегда проводим сравнение моделей тематического моделирования (LDA vs NMF), чтобы выбрать наиболее подходящий подход для конкретной задачи, а затем используем инструменты визуализации, такие как Word Clouds, чтобы представить выявленные темы․

Классификация текстов: Распределение по категориям

Одна из самых распространенных задач NLP – это классификация текстов, то есть отнесение документа к одной или нескольким заранее определенным категориям․ Будь то спам-фильтр, категоризация новостей или анализ тональности, классификация является ключевым элементом․

- Scikit-learn: Наша основная библиотека для классического машинного обучения․ Мы часто применяем такие алгоритмы, как SVM (Support Vector Machines) и Наивный Байесовский классификатор, предварительно векторизовав текст с помощью TF-IDF․ Они просты в реализации и часто дают отличные результаты․

- Трансформеры и глубокое обучение: Для более сложных задач и достижения высочайшей точности мы переходим к использованию PyTorch/TensorFlow для создания нейронных сетей, таких как LSTM-сети, или, что чаще всего, применяем BERT для задач классификации, тонко настраивая его на наших данных․

Мы регулярно проводим сравнение различных методов машинного обучения для NLP, чтобы определить наиболее эффективный подход для каждой конкретной задачи․

Продвинутые техники и реальные сценарии применения

Мир NLP постоянно развивается, и мы всегда стремимся быть в курсе последних достижений, применяя их для решения самых разнообразных и интересных задач․

Суммаризация текста: От длинного к краткому и ёмкому

В условиях информационного перегруза способность быстро извлекать суть из больших текстов становится бесценной․ Суммаризация текста – это процесс создания краткого и связного изложения документа или набора документов․ Мы различаем два основных подхода:

- Экстрактивная суммаризация: Этот метод выбирает наиболее важные предложения или фразы из оригинального текста и объединяет их․ Мы используем такие алгоритмы, как TextRank, который строит граф на основе предложений и ранжирует их по важности․

- Абстрактивная суммаризация: Более сложный подход, который генерирует новые предложения, перефразируя оригинальный текст․ Это требует глубокого понимания контекста и семантики․ Здесь на помощь приходят Transformer-модели от Hugging Face, специально обученные для генерации текста․

Мы постоянно сравниваем модели суммирования: экстрактивную и абстрактную, чтобы найти оптимальный баланс между точностью, связностью и вычислительной эффективностью․

Веб-скрейпинг и извлечение данных: За пределами структурированных источников

Часто данные, которые нам нужны для NLP, находятся не в аккуратных CSV-файлах, а разбросаны по веб-страницам, PDF-документам или лог-файлам․

- Веб-скрейпинг: Для извлечения текста с веб-страниц мы активно используем библиотеку Beautiful Soup․ Она позволяет нам парсить HTML-структуру и извлекать нужные элементы, будь то статьи, отзывы или описания продуктов․

- Извлечение текста из PDF: PDF-документы – это отдельная история․ Для работы с ними мы применяем PyMuPDF, который позволяет эффективно извлекать текст, изображения и метаданные даже из сложных многостраничных документов, таких как юридические контракты или финансовые отчетности․

- Анализ лог-файлов: Лог-файлы тоже являются ценным источником текстовых данных․ Мы используем Python для их парсинга и анализа, выявляя паттерны, аномалии и ключевые события․

Мультиязычность и сложные языки: Преодолевая барьеры

Мир не ограничивается английским языком․ Мы часто работаем с многоязычными текстовыми корпусами, а также с языками, имеющими богатую морфологию, как русский․

- Polyglot и Stanza: Эти библиотеки стали для нас незаменимыми помощниками․ Polyglot отлично подходит для анализа редких языков и базовых операций вроде определения языка․ Stanza (от Stanford NLP Group) предоставляет высококачественные модели для многих языков, включая русский, позволяя выполнять продвинутую лемматизацию, POS-теггинг и синтаксический парсинг зависимостей․

- Машинный перевод: Разработка систем машинного перевода – одна из самых амбициозных задач NLP․ Мы экспериментировали с созданием собственных моделей на Python, а также активно используем Transformer-модели для машинного перевода, в т․ч․ для узкоспециализированных текстов․

Будущее уже здесь: Трансформеры и генеративные модели

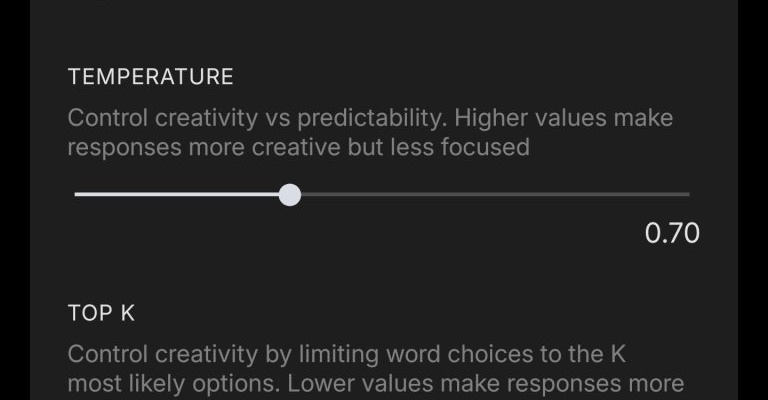

Последние годы ознаменовались появлением генеративных моделей на основе архитектуры Трансформеров, которые изменили ландшафт NLP․

- Генерация текста (GPT): Модели вроде GPT-3 (и его наследников) способны генерировать связный, грамматически корректный и даже креативный текст на заданную тему․ Мы используем Transformer-модели для генерации диалогов, создания FAQ на основе документов и даже для автоматического перефразирования текста․

- Анализ кода и его генерация: Удивительно, но Трансформеры находят применение и в анализе кода․ Мы экспериментировали с использованием их для сжатия кода и даже генерации фрагментов кода на основе естественного языка․

Инструменты и экосистема: Наш любимый арсенал

Мы уже упоминали многие библиотеки, но стоит собрать их воедино и подчеркнуть их роль в нашем ежедневном рабочем процессе․

| Библиотека | Основные функции | Примеры использования |

|---|---|---|

| NLTK | Токенизация, стемминг, POS-теггинг, морфологический анализ, создание словарей․ | Основы предобработки текста, обучение новичков в NLP․ |

| spaCy | Быстрый NER, синтаксический парсинг, лемматизация, построение пайплайнов․ | Высокопроизводительная обработка текста, извлечение сущностей, анализ зависимостей․ |

| Gensim | Тематическое моделирование (LDA, LSI), Word2Vec, Doc2Vec․ | Обнаружение скрытых тем, векторизация слов и документов․ |

| Scikit-learn | Классификация текстов, кластеризация, векторизация (CountVectorizer, TfidfVectorizer)․ | Построение моделей классификации, сравнение методов машинного обучения․ |

| Hugging Face Transformers | Предварительно обученные модели (BERT, GPT), тонкая настройка, генерация текста, QA․ | Продвинутые задачи NLP, использование state-of-the-art моделей․ |

| TextBlob | Простой NLP, анализ тональности, определение языка․ | Быстрый прототип, базовый анализ тональности для небольших проектов․ |

| Beautiful Soup | Парсинг HTML/XML, веб-скрейпинг․ | Извлечение текстовых данных с веб-страниц․ |

| Stanza | Морфологический анализ, синтаксический парсинг для языков с богатой морфологией․ | Обработка русского и других неанглийских языков на глубоком уровне․ |

| Flair | Современный NER, векторизация предложений, POS-теггинг․ | Высокоточные модели для распознавания сущностей․ |

| PyMuPDF | Извлечение текста и данных из PDF․ | Работа с юридическими, финансовыми, научными документами․ |

Визуализация и оценка качества

Мы всегда подчеркиваем важность не только построения моделей, но и их адекватной оценки и визуализации результатов․

- Инструменты для визуализации текстовых данных: Word Clouds (для частотности слов), Heatmaps (для корреляции тем), а также различные графики и диаграммы помогают нам наглядно представить выявленные паттерны и темы․

- Оценка качества моделей: Для нас крайне важно понимать, насколько хорошо работает наша модель․ Мы используем метрики, такие как Precision, Recall, F1-score для классификации и NER, а также различные методы для оценки качества тематических моделей․

Завершающие мысли: Путь NLP бесконечен

Мы только что совершили грандиозное путешествие по миру Natural Language Processing, используя Python как наш путеводитель․ Мы начали с самых основ – токенизации и очистки текста, узнали, как превратить слова в числа с помощью векторизаторов и Word Embeddings, и углубились в сложный, но захватывающий мир Трансформеров и контекстуальных встраиваний․ Мы рассмотрели ключевые задачи, такие как NER, анализ тональности, тематическое моделирование и классификация, и прикоснулись к практическим применениям – от суммаризации до обработки многоязычных корпусов․

Наш опыт показывает, что Python предлагает невероятно богатую экосистему для NLP, позволяя нам решать задачи любой сложности․ От простых скриптов для предобработки до создания высокоинтеллектуальных систем на базе глубокого обучения – возможности практически безграничны․ Мы надеемся, что это погружение вдохновило вас на собственные эксперименты и открытия в этой увлекательной области․ Помните, что каждый обработанный нами текст, каждый извлеченный инсайт – это шаг к лучшему пониманию мира, в котором мы живем, и людей, которые его населяют․ Мы продолжаем учиться, исследовать и делиться своими знаниями, ведь в мире NLP всегда есть что-то новое и удивительное для открытия;

На этом статья заканчивается․

Подробнее

| Основы NLTK | NER с spaCy | LDA и Gensim | Классификация текстов Scikit-learn | Word2Vec в Python |

| Анализ тональности VADER | Разработка векторизаторов текста | Регулярные выражения NLP | Трансформеры Hugging Face | Глубокое обучение NLP PyTorch |