- Погружение в бездну текста: От основ NLTK до магии Трансформеров в Python

- Наши первые шаги: Фундамент NLP с NLTK и spaCy

- Основы NLTK: Токенизация и стемминг

- Использование spaCy для быстрого NER и синтаксического парсинга

- От слов к числам: Представление текста для машин

- Разработка собственных векторизаторов текста: CountVectorizer и TfidfVectorizer

- Word Embeddings: Word2Vec и GloVe с использованием Gensim

- Глубокое понимание: Тематическое моделирование и анализ тональности

- Библиотека Gensim для тематического моделирования (LDA, LSI)

- Анализ тональности (Sentiment Analysis) с VADER и TextBlob

- Магия машинного обучения и глубокого обучения в NLP

- Применение Scikit-learn для классификации текстов

- Трансформеры (Hugging Face) для сложных задач NLP

- Применение PyTorch/TensorFlow для создания нейросетей NLP

- Инструменты для решения специфических задач и обработки данных

- Предобработка текста: От регулярных выражений до очистки данных

- Работа с многоязычными текстами и сложной морфологией

- Извлечение ключевой информации и суммирование

- Наши проекты и практическое применение NLP

- Разработка чат-ботов и вопросно-ответных систем

- Анализ стилистики, проверка грамматики и обнаружение плагиата

- Работа с большими данными и визуализация

Погружение в бездну текста: От основ NLTK до магии Трансформеров в Python

Приветствуем вас, дорогие читатели, в нашем увлекательном путешествии по миру обработки естественного языка (NLP) с использованием Python! Сегодня мы не просто изучим сухие теории, а окунемся в практические аспекты, которые позволят нам, как опытным блогерам и энтузиастам, использовать мощь NLP для понимания, анализа и даже генерации текста. Мы поделимся нашим личным опытом, покажем, как мы справляемся с огромными объемами текстовых данных, и раскроем секреты, которые превратят ваш код в настоящий лингвистический инструмент. Приготовьтесь, ведь нас ждет увлекательное приключение, где каждая строка кода открывает новые горизонты для работы с человеческим языком.

В современном мире, где информация генерируется со скоростью света, способность машин понимать и обрабатывать текст становится не просто полезной, а абсолютно необходимой. От чат-ботов, которые отвечают на наши вопросы, до систем, которые анализируют миллионы отзывов клиентов, NLP прочно вошло в нашу повседневную жизнь. Мы, как блогеры, ежедневно сталкиваемся с необходимостью анализировать тенденции, понимать настроения аудитории и создавать контент, который резонирует с читателем. Именно поэтому мы уделяем такое большое внимание инструментам и техникам NLP, которые позволяют нам быть на шаг впереди.

Наши первые шаги: Фундамент NLP с NLTK и spaCy

Наш путь в мир NLP традиционно начинается с фундаментальных библиотек. Они как азбука, которую мы учим, чтобы потом писать целые романы. Без понимания базовых концепций и инструментов дальнейшее продвижение будет затруднительным. Мы всегда рекомендуем начинать с двух гигантов: NLTK (Natural Language Toolkit) и spaCy. Эти библиотеки предлагают мощные инструменты для первичной обработки текста, которые мы активно используем в наших проектах.

Основы NLTK: Токенизация и стемминг

NLTK – это наша рабочая лошадка для многих базовых операций. Когда мы получаем сырой текст, будь то статья, комментарий или целая книга, первое, что нам нужно сделать, это разбить его на более мелкие, осмысленные единицы. Этот процесс называется токенизацией. Мы можем токенизировать текст на слова или на предложения, в зависимости от задачи. Например, для анализа частотности слов нам нужны токены-слова, а для анализа структуры речи – токены-предложения.

После токенизации часто возникает необходимость привести слова к их базовой форме. Здесь на помощь приходят стемминг и лемматизация. Стемминг – это грубый процесс отсечения окончаний слов, чтобы привести их к общей корневой форме (например, "бежал", "бегущий", "бегать" могут быть приведены к "бег"). Лемматизация, в свою очередь, более интеллектуальный процесс, который использует морфологический анализ словаря для приведения слова к его словарной форме (лемме), например, "были" к "быть". Мы предпочитаем лемматизацию, поскольку она сохраняет смысл слова, но стемминг бывает полезен, когда важна скорость.

Мы часто используем NLTK для:

- Токенизации предложений и слов.

- Удаления стоп-слов (таких как "и", "в", "на"), которые не несут смысловой нагрузки.

- Стемминга с помощью алгоритмов Портера или Сноуболла для быстрого приведения слов к основе.

- Морфологического анализа (POS-теггинг) для определения частей речи.

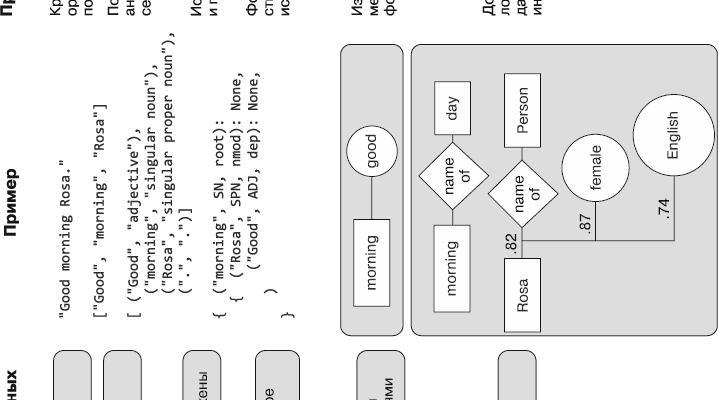

Использование spaCy для быстрого NER и синтаксического парсинга

Если NLTK – это наш швейцарский армейский нож, то spaCy – это высокопроизводительный электроинструмент. Эта библиотека разработана с учетом скорости и эффективности, что делает ее идеальной для работы с большими объемами данных. Одним из ключевых преимуществ spaCy является его способность к распознаванию именованных сущностей (NER). Это позволяет нам автоматически выделять из текста имена людей, названия организаций, географические объекты, даты и многое другое. Представьте, сколько времени это экономит, когда нам нужно извлечь ключевые данные из тысяч новостных статей!

Кроме NER, spaCy превосходно справляется с синтаксическим парсингом, позволяя нам понять грамматическую структуру предложения, определить зависимости между словами. Это невероятно важно для более глубокого анализа текста, например, для построения вопросно-ответных систем или для понимания намерений пользователя. Мы всегда поражаемся, насколько легко и быстро spaCy обрабатывает текст, предоставляя богатую информацию о его структуре.

Вот пример, как мы сравниваем некоторые возможности NLTK и spaCy:

| Функция | NLTK | spaCy | Наши комментарии |

|---|---|---|---|

| Токенизация | Гибкая, множество алгоритмов. | Быстрая, предустановленные модели. | Для экспериментов NLTK, для продакшена spaCy. |

| Лемматизация | Требует POS-тегов. | Встроена, высокоточна. | spaCy часто дает более точные результаты. |

| NER | Есть, но менее развит. | Очень мощный, предустановленные модели. | spaCy – наш выбор для NER. |

| Скорость | Средняя. | Высокая, оптимизировано для CPython. | spaCy выигрывает по скорости. |

От слов к числам: Представление текста для машин

Компьютеры не понимают человеческий язык напрямую. Для них текст – это просто последовательность символов. Чтобы машины могли работать с текстом, нам нужно перевести его в числовой формат, который они могут обрабатывать. Этот процесс называется векторизацией текста. Мы экспериментировали с множеством подходов, и каждый из них имеет свои преимущества и недостатки, в зависимости от конкретной задачи.

Разработка собственных векторизаторов текста: CountVectorizer и TfidfVectorizer

Самые простые, но при этом очень эффективные методы векторизации, которые мы активно используем, – это CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn. CountVectorizer просто подсчитывает частоту каждого слова в документе. Это создает вектор, где каждая позиция соответствует уникальному слову в нашем корпусе текстов, а значение – количеству его вхождений. Просто и понятно.

Однако проблема CountVectorizer в том, что очень часто встречающиеся слова (например, "статья", "блог", "информация") могут иметь высокий вес, хотя они не несут много уникальной информации о конкретном документе. Здесь на помощь приходит TfidfVectorizer, который использует метрику TF-IDF (Term Frequency-Inverse Document Frequency). Она не только учитывает, как часто слово встречается в документе (TF), но и насколько оно уникально для всего корпуса документов (IDF). Таким образом, слова, которые встречаются редко, но важны для данного документа, получают больший вес. Мы часто используем TF-IDF для задач классификации и поиска похожих документов, поскольку он позволяет нам "фильтровать шум" и фокусироваться на действительно значимых терминах.

Word Embeddings: Word2Vec и GloVe с использованием Gensim

Хотя CountVectorizer и TF-IDF хорошо работают, они не учитывают семантическое значение слов. То есть, для них "король" и "королева" – это просто два разных слова, никак не связанных. Но мы знаем, что они тесно связаны! Здесь в игру вступают Word Embeddings (векторные представления слов), такие как Word2Vec и GloVe. Эти модели учатся представлять слова в виде плотных векторов, где слова с похожим значением имеют близкие векторные представления в многомерном пространстве. Это открывает совершенно новые возможности для анализа.

Мы используем библиотеку Gensim для работы с Word2Vec и GloVe. Gensim позволяет нам обучать собственные модели встраивания на наших уникальных корпусах текстов или использовать предварительно обученные модели. Например, если мы анализируем тексты в определенной нише, обучение Word2Vec на этом специфическом корпусе даст нам более релевантные векторные представления, чем использование общей модели. Это позволяет нам находить синонимы, аналогии и даже выявлять сложные семантические связи, что бесценно для создания систем рекомендаций или анализа скрытых тем в тексте.

"Язык – это дорожная карта культуры. Он говорит нам, откуда пришли его люди и куда они идут."

– Рита Мэй Браун

Глубокое понимание: Тематическое моделирование и анализ тональности

Помимо простого извлечения информации, мы часто стремимся понять более глубокий смысл текста. Какие скрытые темы присутствуют в большом наборе документов? Каково общее настроение наших клиентов? Для этих целей мы обращаемся к тематическому моделированию и анализу тональности.

Библиотека Gensim для тематического моделирования (LDA, LSI)

Когда мы работаем с большими архивами статей, блогов или отзывов, вручную определить основные темы становится невозможным. Здесь на помощь приходит тематическое моделирование. Мы активно используем библиотеку Gensim для реализации таких алгоритмов, как LDA (Латентное размещение Дирихле) и LSI (Латентное семантическое индексирование). Эти методы позволяют нам автоматически обнаруживать скрытые "темы" в коллекции документов, представляя каждый документ как смесь нескольких тем, а каждую тему – как распределение слов.

Например, мы можем загрузить тысячи отзывов о продукте, применить LDA, и алгоритм может выявить темы, такие как "качество батареи", "скорость доставки", "удобство использования" и "дизайн". Для каждой темы мы получим список наиболее характерных слов. Это дает нам ценную информацию о том, что волнует наших пользователей, и помогает нам формировать контент-стратегию или улучшать продукт. Мы постоянно сравниваем различные модели тематического моделирования (LDA vs NMF), чтобы выбрать наиболее подходящую для конкретной задачи.

Анализ тональности (Sentiment Analysis) с VADER и TextBlob

Понимание эмоциональной окраски текста – это еще один краеугольный камень в нашем арсенале NLP. Отзывы клиентов, комментарии в социальных сетях, новостные статьи – везде есть эмоциональный заряд. Анализ тональности позволяет нам классифицировать текст как позитивный, негативный или нейтральный. Мы используем несколько подходов для этого.

Для быстрого и эффективного анализа тональности на английском языке мы часто обращаемся к VADER (Valence Aware Dictionary and sEntiment Reasoner). Это лексический инструмент, который отлично справляется с текстами из социальных сетей, учитывая даже смайлики и использование заглавных букв для усиления эмоций. Для более общего анализа, а также для работы с простыми задачами на других языках (с соответствующими языковыми моделями), мы применяем TextBlob, который хоть и прост, но часто дает хорошие базовые результаты.

Однако, анализ тональности не всегда прямолинеен. Мы постоянно сталкиваемся с проблемами, такими как сарказм или ирония, которые могут обмануть простую модель. В таких случаях мы прибегаем к более сложным моделям на основе машинного обучения или даже глубокого обучения, которые способны улавливать тонкие нюансы языка. Например, для анализа тональности сообщений в социальных сетях (Twitter/Reddit) мы можем использовать тонко настроенные трансформерные модели, которые обучены на больших корпусах данных с разметкой сарказма.

Магия машинного обучения и глубокого обучения в NLP

Когда базовые методы уже освоены, мы переходим к более мощным инструментам – машинному обучению и глубокому обучению. Эти подходы позволяют нам создавать интеллектуальные системы, способные к обучению на данных и выполнению сложных задач, таких как классификация текста, машинный перевод и генерация контента.

Применение Scikit-learn для классификации текстов

Scikit-learn – это наш незаменимый инструмент для задач классификации текста. После того как мы векторизовали наш текст (например, с помощью TF-IDF), мы можем использовать различные алгоритмы машинного обучения для его категоризации. Мы регулярно применяем такие классификаторы, как:

- Наивный байесовский классификатор: Простой, но часто очень эффективный, особенно для текстовых данных.

- Метод опорных векторов (SVM): Отлично работает с высокоразмерными данными, такими как текстовые векторы, и часто показывает высокую точность.

- Случайный лес (Random Forest): Ансамблевый метод, который хорошо справляется с переобучением и может быть очень мощным.

С помощью Scikit-learn мы строим системы для автоматической категоризации статей, фильтрации спама, распределения отзывов по категориям продуктов и многого другого. Мы также используем его для кластеризации текстов, когда нам нужно найти естественные группы в неразмеченных данных, например, для выявления скрытых тем или сегментации пользовательских запросов.

Трансформеры (Hugging Face) для сложных задач NLP

Последние годы ознаменовались революцией в NLP благодаря появлению трансформерных архитектур. Библиотека Hugging Face Transformers стала нашим основным инструментом для работы с этими мощными моделями, такими как BERT, GPT, RoBERTa и многими другими. Эти модели предварительно обучены на огромных объемах текстовых данных и способны понимать контекст слов на совершенно новом уровне.

Мы используем трансформеры для широкого спектра задач, которые ранее казались недостижимыми:

- Продвинутое распознавание именованных сущностей (NER): Трансформеры значительно превосходят традиционные методы в точности NER, особенно для сложных и многоязычных текстов.

- Вопросно-ответные системы (QA): Мы можем создавать системы, которые отвечают на вопросы, основываясь на содержании предоставленных документов, что идеально для автоматизации поддержки или создания интеллектуальных баз знаний.

- Суммаризация текста: Трансформеры позволяют нам генерировать как экстрактивные (извлечение наиболее важных предложений из текста), так и абстрактивные (создание нового, сокращенного текста, передающего суть оригинала) суммаризации.

- Машинный перевод: Хотя это и сложная задача, трансформеры значительно улучшили качество автоматического перевода.

- Генерация текста: Модели, такие как GPT, позволяют нам генерировать связные и осмысленные тексты на заданную тему, что мы используем для создания черновиков статей или ответов в чат-ботах.

Работа с трансформерами включает в себя тонкую настройку (Fine-tuning) предварительно обученных моделей на наших собственных данных. Это позволяет адаптировать общую модель под специфику наших задач, достигая впечатляющих результатов даже с относительно небольшим количеством размеченных данных.

Применение PyTorch/TensorFlow для создания нейросетей NLP

Для тех случаев, когда нам нужна максимальная гибкость и контроль над архитектурой модели, или когда мы хотим исследовать совершенно новые подходы, мы обращаемся к фреймворкам глубокого обучения, таким как PyTorch и TensorFlow. На этих платформах мы создаем и обучаем собственные нейросетевые модели, включая:

- LSTM-сети (Long Short-Term Memory): Эти рекуррентные нейронные сети отлично подходят для обработки последовательностей, таких как текст, и хорошо справляются с долгосрочными зависимостями. Мы использовали их для классификации текста и даже для предсказания следующего слова.

- Модели для выявления связей между сущностями: Создание графовых нейронных сетей или других специализированных архитектур для анализа взаимосвязей между распознанными сущностями в тексте.

- Контекстное встраивание (Contextual Embeddings): Разработка моделей, которые генерируют векторные представления слов, учитывая их контекст в предложении, что является основой для многих современных трансформерных моделей.

Хотя PyTorch и TensorFlow требуют более глубокого понимания принципов глубокого обучения, они предоставляют нам неограниченные возможности для инноваций и создания по-настоящему уникальных NLP-решений. К тому же, обработка текста с использованием GPU-ускорения становится стандартом для больших моделей, и эти фреймворки отлично с этим справляются.

Инструменты для решения специфических задач и обработки данных

Помимо основных библиотек и методологий, в нашем арсенале есть множество специализированных инструментов, которые помогают нам справляться с конкретными вызовами в работе с текстом. Ведь реальные данные редко бывают чистыми и идеальными.

Предобработка текста: От регулярных выражений до очистки данных

Любая работа с текстом начинается с его предобработки. Это критически важный этап, от которого зависит качество всех последующих анализов. Мы постоянно используем:

- Регулярные выражения (re): Незаменимый инструмент для поиска, замены и извлечения паттернов из текста. С их помощью мы удаляем HTML-теги, ссылки, email-адреса, специальные символы, а также извлекаем даты и числа.

- Очистка текста от HTML-тегов: Часто мы получаем текст с веб-страниц, и он содержит много "мусора". Библиотека Beautiful Soup для веб-скрейпинга позволяет нам не только извлекать текст, но и эффективно очищать его от разметки.

- Удаление стоп-слов и пунктуации: Это стандартные шаги, которые мы выполняем перед векторизацией или тематическим моделированием, чтобы уменьшить размерность данных и сфокусироваться на значимых словах.

- Нормализация сленга и эмодзи: В текстах из социальных сетей мы сталкиваемся со сленгом, аббревиатурами и эмодзи. Для их корректной обработки мы разрабатываем собственные инструменты для нормализации, а иногда используем специализированные библиотеки.

Проблемы обработки неполных и ошибочных данных – это то, с чем мы сталкиваемся постоянно. Мы разрабатываем эвристики и используем библиотеки, такие как Jellyfish, для сравнения строк и поиска похожих, чтобы справляться с опечатками и вариациями написания.

Работа с многоязычными текстами и сложной морфологией

Наш блог ориентирован на международную аудиторию, поэтому нам часто приходится работать с текстами на разных языках. Это добавляет свои сложности, но и открывает новые возможности.

- Библиотека Polyglot: Отличный инструмент для мультиязычного анализа, поддерживающий множество языков для токенизации, NER, определения языка и других задач.

- Stanza: Разработанная Stanford NLP Group, Stanza предоставляет комплексные инструменты для языков с богатой морфологией, таких как русский. Она предлагает высокоточную токенизацию, POS-теггинг, лемматизацию и синтаксический анализ. Мы активно используем Stanza для русского языка, где NLTK может быть менее эффективен.

- Определение языка: С помощью TextBlob или Polyglot мы можем автоматически определять язык текста, что критически важно для выбора правильной модели обработки.

Мы также занимаемся разработкой систем машинного перевода на Python, используя трансформерные модели, и анализом многоязычных текстовых корпусов для выявления кросс-культурных паттернов.

Извлечение ключевой информации и суммирование

Извлечение наиболее важной информации из длинных текстов – одна из наших ключевых задач. Мы используем различные подходы:

- Анализ текста для извлечения ключевых фраз: Помимо NER, мы применяем алгоритмы, такие как RAKE (Rapid Automatic Keyword Extraction), для автоматического извлечения ключевых фраз из документов.

- Библиотека TextRank: Это алгоритм, основанный на PageRank, который мы используем для извлечения ключевых предложений и слов, а также для создания экстрактивной суммаризации. TextRank помогает нам быстро получить суть статьи или объемного документа.

- Разработка системы суммаризации текста (Abstractive vs Extractive): Как мы уже упоминали, трансформеры позволяют нам двигаться в сторону абстрактивной суммаризации, которая генерирует новый, более лаконичный текст, а не просто выбирает существующие предложения.

Наши проекты и практическое применение NLP

Наш опыт не ограничиваеться теоретическим изучением библиотек. Мы активно применяем все эти знания в реальных проектах, которые помогают нам оптимизировать работу и создавать более качественный контент;

Разработка чат-ботов и вопросно-ответных систем

Одним из самых захватывающих направлений для нас является разработка чат-ботов. Мы экспериментировали с фреймворком Rasa, который позволяет создавать мощных контекстно-осведомленных чат-ботов. Rasa объединяет в себе обработку естественного языка (NLU) и управление диалогом, что делает его отличным выбором для создания интерактивных помощников.

Мы также работаем над разработкой систем вопросно-ответных систем (QA). Представьте, что у вас есть огромная база знаний, и вы хотите, чтобы пользователи могли задавать вопросы на естественном языке и получать точные ответы. Мы используем комбинацию NER, тематического моделирования и трансформеров для создания таких систем, которые могут извлекать ответы из документов или генерировать их на лету.

Анализ стилистики, проверка грамматики и обнаружение плагиата

Как блогеры, мы особенно ценим инструменты, которые помогают нам улучшать качество нашего письма. Мы применяем NLP для:

- Анализа стилистики текстов (авторский почерк): Мы можем использовать методы машинного обучения для определения авторства текста или анализа уникальных стилистических паттернов различных авторов.

- Разработки инструментов для проверки грамматики и орфографии: Хотя существуют готовые решения, иногда нам нужно создать кастомизированные проверки для специфической терминологии или стиля.

- Разработки систем обнаружения плагиата: Сравнивая документы с помощью метрик сходства (например, TextDistance, или векторизации с Doc2Vec), мы можем выявлять потенциальные заимствования.

Работа с большими данными и визуализация

Мы живем в эпоху больших данных, и текстовые данные не исключение. Эффективная обработка больших текстовых массивов (Big Data NLP) требует особых подходов и оптимизации. Мы используем параллельные вычисления, распределенные системы и эффективные структуры данных для работы с миллионами документов.

После анализа данных важно представить результаты в понятном виде. Мы используем различные инструменты для визуализации текстовых данных, такие как:

- Облака слов (Word Clouds): Для быстрой визуализации наиболее часто встречающихся слов.

- Тепловые карты (Heatmaps): Для отображения корреляций между словами или темами.

- Графы взаимосвязей: Для визуализации связей между сущностями или темами, что особенно полезно при анализе сложных данных.

Библиотеки, такие как Matplotlib, Seaborn, и даже специализированные инструменты вроде Sweetviz, помогают нам создавать наглядные отчеты и презентации.

Наше путешествие по миру NLP с Python – это бесконечный процесс обучения и открытий. От базовой токенизации и стемминга до сложных трансформерных моделей и генерации текста, мы видим, как технологии развиваются с невероятной скоростью. Мы постоянно исследуем новые библиотеки, алгоритмы и архитектуры, чтобы оставаться на переднем крае инноваций и предлагать нашим читателям самые актуальные и интересные материалы.

Мы надеемся, что этот обзор вдохновил вас на собственные эксперименты с NLP. Помните, что ключ к успеху – это практика и постоянное изучение. Начните с простых задач, постепенно усложняйте их, и вы удивитесь, насколько мощными могут быть ваши инструменты для работы с языком. Будущее NLP выглядит невероятно ярким, и мы с нетерпением ждем, какие новые возможности оно нам принесет. Продолжайте исследовать, продолжайте творить, и пусть ваш код говорит за вас!

Подробнее

| Python NLP библиотеки | Машинное обучение текста | Обработка естественного языка Python | Анализ тональности Python | Тематическое моделирование LDA |

| Word2Vec применение | Трансформеры NLP | NER в Python | Лемматизация и стемминг | Создание чат-ботов Python |