- Погружение в Мир Естественного Языка: Наш Путь к Мастерству NLP с Python

- Первые Шаги: От Сырого Текста к Понятным Данным

- Основы NLTK: Токенизация и Стемминг

- Продвинутая Лемматизация и Стемминг: NLTK vs. spaCy

- Использование spaCy для Быстрого NER и Синтаксического Парсинга

- Регулярные Выражения (re) и Очистка Текста

- Использование TextBlob для Простого NLP

- Представление Текста для Машинного Обучения: От Слов к Векторам

- Разработка Собственных Векторизаторов Текста: CountVectorizer и TfidfVectorizer

- Word Embeddings: Word2Vec и GloVe с Использованием Gensim и FastText

- Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

- Глубокий Анализ и Применение NLP: От Тем к Эмоциям

- Библиотека Gensim для Тематического Моделирования (LDA‚ LSI)

- Применение Scikit-learn для Классификации Текстов

- Анализ Тональности (Sentiment Analysis) с VADER и TextBlob

- Извлечение Ключевых Фраз и Суммаризация Текста

- Продвинутые Техники и Современные Тенденции в NLP

- Трансформеры (Hugging Face) для Сложных Задач NLP

- Применение PyTorch/TensorFlow для Создания Нейросетей NLP

- Разработка Систем Вопросно-Ответных Систем (QA) и Чат-ботов

- Специализированные Инструменты и Приложения: Расширяем Горизонты

- Обработка Многоязычных Текстовых Корпусов и Редких Языков

- Извлечение Текста из Различных Источников: Веб-Скрейпинг и PDF

- Анализ Стилистики Текстов‚ Эмодзи и Сленга

- Визуализация Текстовых Данных и Оценка Качества Моделей

Погружение в Мир Естественного Языка: Наш Путь к Мастерству NLP с Python

Приветствуем вас‚ дорогие читатели‚ в нашем виртуальном уголке‚ где мы с энтузиазмом делимся знаниями и опытом‚ накопленным на бескрайних просторах разработки. Сегодня мы хотим пригласить вас в увлекательное путешествие по миру Обработки Естественного Языка‚ или NLP (Natural Language Processing). Это не просто набор технологий; это искусство научить машины понимать‚ интерпретировать и даже генерировать человеческий язык. И‚ поверьте нам‚ это одно из самых захватывающих направлений в современной науке о данных и искусственном интеллекте.

В чем же прелесть NLP? Представьте‚ что у вас есть возможность заставить компьютер читать миллионы книг‚ понимать суть клиентских отзывов‚ мгновенно переводить тексты или даже вести осмысленную беседу. Все это‚ и многое другое‚ становится реальностью благодаря NLP. Мы‚ как блогеры‚ ежедневно работающие с текстами‚ как никто другой ценим мощь и элегантность инструментов‚ позволяющих нам извлекать смыслы из хаотичного потока слов. На протяжении этой статьи мы покажем вам‚ как с помощью Python мы осваивали эти инструменты‚ превращая сырой текст в ценные инсайты.

Наш опыт показывает‚ что вход в NLP может казаться daunting‚ но с правильным руководством и последовательным подходом‚ каждый может освоить его основы и даже продвинутые методы. Мы собрали для вас самую суть нашего практического пути‚ от базовых понятий до сложных архитектур трансформеров‚ используя самые популярные и эффективные библиотеки Python. Приготовьтесь‚ ведь мы собираемся не просто рассказать‚ а буквально провести вас по лабиринтам текста‚ раскрывая его секреты шаг за шагом.

Первые Шаги: От Сырого Текста к Понятным Данным

Прежде чем машина сможет "понять" наш язык‚ текст необходимо подготовить. Это похоже на процесс очистки и сортировки ингредиентов перед приготовлением сложного блюда. Наш опыт показывает‚ что этап предобработки, один из самых критичных‚ ведь от его качества напрямую зависит успех всех последующих задач. Мы начинаем с самых азов: токенизации‚ стемминга и лемматизации‚ которые являются фундаментом для любого NLP-проекта.

Основы NLTK: Токенизация и Стемминг

NLTK (Natural Language Toolkit) — это наш верный спутник на старте любого проекта. Это мощная и гибкая библиотека‚ которая предоставляет все необходимые инструменты для работы с текстом на низком уровне. Мы часто используем ее для первых шагов‚ таких как разбиение текста на слова или предложения.

Токенизация — это процесс разбиения непрерывного текста на более мелкие единицы‚ называемые токенами. Токенами могут быть слова‚ пунктуация‚ числа. Например‚ предложение "Мы любим NLP!" может быть токенизировано в [‘Мы’‚ ‘любим’‚ ‘NLP’‚ ‘!’]. Это кажется простым‚ но правильный выбор токенизатора критичен‚ особенно для языков с богатой морфологией.

Стемминг — это упрощенный процесс приведения слов к их корневой форме (стемме). Например‚ слова "бегущий"‚ "бежал"‚ "бегать" могут быть приведены к стемме "бег". Стемминг быстр‚ но иногда агрессивен‚ обрезая слова без учета их грамматического значения‚ что может приводить к неточностям. Тем не менее‚ для многих задач‚ где важна скорость и не требуется абсолютная точность‚ стемминг является отличным выбором. Мы часто используем стеммеры Портера или Сноуболла.

Пример использования NLTK для токенизации и стемминга:

import nltk

from nltk.stem import PorterStemmer

from nltk.tokenize import word_tokenize

text = "Мы изучаем основы NLTK для обработки текстов."

tokens = word_tokenize(text)

print("Токены:"‚ tokens)

stemmer = PorterStemmer

stemmed_tokens = [stemmer.stem(word) for word in tokens]

print("Стеммы:"‚ stemmed_tokens)

Продвинутая Лемматизация и Стемминг: NLTK vs. spaCy

В отличие от стемминга‚ лемматизация — это более сложный процесс‚ который приводит слово к его базовой словарной форме (лемме)‚ учитывая при этом морфологию и часть речи. Например‚ "бегущий"‚ "бежал"‚ "бегать" будут приведены к лемме "бежать". Для нас лемматизация предпочтительнее в тех случаях‚ когда точность и сохранение смысла слова критичны.

Хотя NLTK предлагает лемматизацию через WordNetLemmatizer‚ мы часто обращаемся к библиотеке spaCy для более продвинутых и точных результатов‚ особенно для русского языка. spaCy не только быстрее‚ но и включает в себя модели‚ обученные на больших корпусах‚ что позволяет ей лучше справляться с контекстом и морфологией‚ чего часто не хватает NLTK вне английского языка. Сравнение этих подходов стало для нас важным шагом в понимании предобработки текста.

Мы часто сравниваем эти два подхода:

| Характеристика | Стемминг (NLTK) | Лемматизация (NLTK/spaCy) |

|---|---|---|

| Скорость | Высокая | Средняя/Высокая (spaCy быстрее) |

| Точность | Низкая (обрезает слова) | Высокая (учитывает морфологию) |

| Сохранение смысла | Часто теряется | Сохраняется |

| Применение | Поиск‚ анализ больших объемов | Классификация‚ тематическое моделирование |

Использование spaCy для Быстрого NER и Синтаксического Парсинга

Когда нам нужна скорость и высокая точность‚ особенно для распознавания именованных сущностей (NER) и синтаксического парсинга‚ мы обращаемся к spaCy. Это не просто библиотека‚ это целая экосистема‚ оптимизированная для продакшн-уровня. spaCy поставляется с предварительно обученными моделями для различных языков‚ что значительно упрощает работу.

Распознавание именованных сущностей (NER) позволяет нам автоматически идентифицировать и классифицировать сущности в тексте‚ такие как имена людей‚ организации‚ местоположения‚ даты и многое другое. Мы используем NER для извлечения ключевой информации из новостных статей‚ клиентских обращений или юридических документов. Это значительно ускоряет анализ и помогает структурировать неструктурированные данные.

Синтаксический парсинг‚ в свою очередь‚ раскрывает грамматическую структуру предложений‚ показывая взаимосвязи между словами. Мы можем определить подлежащее‚ сказуемое‚ дополнения и другие части речи‚ а также их зависимости. Это бесценно для создания более сложных систем‚ например‚ вопросно-ответных‚ где понимание структуры предложения играет ключевую роль.

Пример использования spaCy для NER:

import spacy

# Загружаем модель для русского языка (если еще не скачана‚ используйте: python -m spacy download ru_core_news_sm)

nlp = spacy.load("ru_core_news_sm")

text = "Apple разрабатывает новый продукт в Калифорнии."

doc = nlp(text)

print("Именованные сущности:")

for ent in doc.ents:

print(f" Текст: {ent.text}‚ Метка: {ent.label_}")

Регулярные Выражения (re) и Очистка Текста

Помимо специализированных библиотек‚ в нашем арсенале всегда присутствуют регулярные выражения (re). Это универсальный инструмент для поиска и манипулирования текстовыми шаблонами. Мы используем их для базовой‚ но критически важной предобработки: удаления HTML-тегов‚ ссылок‚ специальных символов‚ чисел‚ или для нормализации пунктуации и пробелов. Это рутинная‚ но необходимая работа‚ которая делает текст "чистым" для дальнейшего анализа.

Наш опыт показывает‚ что грамотная очистка данных — это половина успеха. Без нее модели будут "шуметь" на ненужных символах и форматах‚ что приведет к снижению точности. Мы всегда начинаем с этого этапа‚ прежде чем применять более сложные NLP-методы.

Основные шаги‚ которые мы выполняем при очистке текста:

- Удаление HTML-тегов: Часто текст приходит к нам из веб-источников‚ содержащих разметку.

- Удаление URL-адресов: Ссылки редко несут семантическую нагрузку для большинства NLP-задач.

- Удаление специальных символов и пунктуации: Если они не важны для конкретной задачи (например‚ для анализа тональности‚ где пунктуация может быть важна).

- Приведение к нижнему регистру: Чтобы "Apple" и "apple" рассматривались как одно и то же слово.

- Удаление стоп-слов: Общеупотребительные слова‚ такие как "и"‚ "в"‚ "на"‚ которые не несут много смысла для анализа.

- Нормализация пробелов: Замена множественных пробелов на одинарные.

Использование TextBlob для Простого NLP

Для быстрых и простых задач‚ а также для тех‚ кто только начинает свой путь в NLP‚ мы часто рекомендуем TextBlob. Эта библиотека является надстройкой над NLTK и предлагает интуитивно понятный API для выполнения таких задач‚ как анализ тональности‚ POS-теггинг‚ извлечение фраз‚ перевод и определение языка. TextBlob позволяет нам быстро получить "быстрые и грязные" результаты без необходимости погружаться в сложности более мощных библиотек. Это идеальный инструмент для прототипирования и экспресс-анализа.

Пример анализа тональности с TextBlob:

from textblob import TextBlob

text1 = "Это просто потрясающий продукт! Я очень доволен."

text2 = "Мне не нравится эта ситуация‚ все очень плохо."

blob1 = TextBlob(text1)

blob2 = TextBlob(text2)

# Для русского языка TextBlob требует установки дополнительных пакетов или использования переводчика

# Обычно мы используем VADER для английского или специализированные модели для русского

# Но для демонстрации концепции TextBlob может быть полезен в связке с переводом:

print(f"Тональность текста 1 (англ. перевод): {blob1.translate(to='en').sentiment}")

print(f"Тональность текста 2 (англ. перевод): {blob2.translate(to='en').sentiment}")

Представление Текста для Машинного Обучения: От Слов к Векторам

Машины не понимают слов в их лингвистическом смысле; они оперируют числами. Поэтому один из ключевых этапов в NLP — это преобразование текста в числовые векторы. Этот процесс называется векторизацией или созданием эмбеддингов. Мы исследовали множество методов‚ каждый из которых имеет свои преимущества и недостатки‚ и сейчас расскажем о тех‚ что показали себя наиболее эффективно в нашей практике.

Разработка Собственных Векторизаторов Текста: CountVectorizer и TfidfVectorizer

Наш путь в векторизации часто начинается с классических методов‚ таких как CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn. Эти инструменты относительно просты в понимании и реализации‚ но при этом обладают значительной мощностью для многих задач.

- CountVectorizer: Он просто считает частоту появления каждого слова в документе. В результате мы получаем матрицу‚ где строки соответствуют документам‚ а столбцы — уникальным словам (лексикону). Значение в ячейке показывает‚ сколько раз данное слово встретилось в данном документе. Это простой‚ но эффективный способ представления текста‚ особенно для задач классификации‚ где важна частотность слов.

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): Это более продвинутый метод‚ который учитывает не только частоту слова в документе (TF)‚ но и его редкость во всем корпусе документов (IDF). Идея заключается в том‚ что слова‚ которые встречаются часто в одном документе‚ но редко в других‚ более информативны. TfidfVectorizer помогает нам выделить наиболее значимые слова‚ игнорируя при этом слишком частые‚ но малоинформативные слова‚ такие как стоп-слова.

Мы используем эти векторизаторы для широкого спектра задач‚ от классификации текстов до тематического моделирования‚ и они являются надежной отправной точкой.

Word Embeddings: Word2Vec и GloVe с Использованием Gensim и FastText

Классические векторизаторы не учитывают семантические связи между словами. Именно здесь на помощь приходят Word Embeddings — плотные векторные представления слов‚ которые улавливают их смысловое значение и контекст. Мы активно работаем с Word2Vec и GloVe‚ а также с FastText.

- Word2Vec (от Google): Мы используем библиотеку Gensim для его реализации. Word2Vec строит векторы таким образом‚ что слова с похожим значением имеют близкие векторы в многомерном пространстве. Например‚ вектор "короля" будет близок к вектору "королевы" и будет иметь похожие отношения с "мужчиной" и "женщиной". Это позволяет нам выполнять семантические операции‚ такие как "король ─ мужчина + женщина = королева".

- GloVe (Global Vectors for Word Representation): Это еще один популярный метод‚ который‚ в отличие от Word2Vec‚ учитывает глобальную статистику со-встречаемости слов во всем корпусе. Мы находим‚ что GloVe часто дает хорошие результаты‚ особенно на больших‚ хорошо структурированных корпусах.

- FastText (от Facebook): Этот метод‚ также доступный через Gensim‚ является расширением Word2Vec. Его ключевое преимущество в том‚ что он работает с n-граммами символов (подсловами)‚ что позволяет ему генерировать хорошие эмбеддинги для редких слов и даже для слов‚ которых не было в обучающем корпусе (out-of-vocabulary words). Это особенно полезно для языков с богатой морфологией‚ где одно слово может иметь множество форм.

Векторы слов открывают для нас совершенно новый уровень понимания текста‚ позволяя моделям улавливать тонкие смысловые нюансы.

Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

Иногда нам нужно получить векторное представление не отдельного слова‚ а целого предложения или документа; Здесь на помощь приходят более продвинутые техники:

- Doc2Vec (также из Gensim): Это расширение Word2Vec‚ которое позволяет создавать эмбеддинги для целых документов. Doc2Vec присваивает каждому документу уникальный вектор‚ который учитывает слова‚ содержащиеся в нем‚ и их контекст. Мы используем его для поиска похожих документов‚ кластеризации и классификации.

- Sentence Transformers: Это современный подход‚ основанный на трансформерных архитектурах (о которых мы поговорим позже)‚ который позволяет генерировать высококачественные эмбеддинги для предложений и коротких документов. Эти эмбеддинги улавливают семантику предложения в целом и показывают отличные результаты в задачах поиска семантически похожих предложений‚ вопросно-ответных системах и кластеризации.

Возможность представлять целые смысловые единицы в виде векторов значительно расширяет наши возможности в анализе и обработке текста.

«Язык — это дорожная карта культуры. Он говорит вам‚ откуда пришли его люди и куда они идут.»

— Рита Мэй Браун

Глубокий Анализ и Применение NLP: От Тем к Эмоциям

После того как текст подготовлен и представлен в числовом виде‚ мы можем приступить к более сложным задачам. Наш опыт охватывает широкий спектр приложений‚ от выявления скрытых тем до понимания эмоциональной окраски текста.

Библиотека Gensim для Тематического Моделирования (LDA‚ LSI)

Когда у нас есть большой корпус текстов‚ и мы хотим понять‚ о чем они‚ не читая каждый документ по отдельности‚ мы обращаемся к тематическому моделированию; Gensim, наш основной инструмент для этого. Мы используем два основных алгоритма:

- LDA (Latent Dirichlet Allocation): Это один из самых популярных алгоритмов. LDA предполагает‚ что каждый документ представляет собой смесь тем‚ а каждая тема — это смесь слов. Он помогает нам автоматически выявлять скрытые темы в коллекции документов. Например‚ в корпусе новостей LDA может выделить темы "политика"‚ "спорт"‚ "экономика" и т.д.

- LSI (Latent Semantic Indexing): Это более старый‚ но все еще эффективный метод‚ основанный на сингулярном разложении (SVD). LSI анализирует взаимосвязи между терминами и документами для выявления скрытых семантических структур. Мы часто используем LSI для поиска похожих документов и улучшения информационного поиска.

Тематическое моделирование позволяет нам не только категоризировать тексты‚ но и выявлять тренды‚ анализировать интересы аудитории и даже обнаруживать скрытые связи между документами. Мы сравниваем LDA и NMF (Non-negative Matrix Factorization)‚ другой популярный метод‚ чтобы выбрать наиболее подходящий для конкретной задачи‚ исходя из его интерпретируемости и производительности.

Применение Scikit-learn для Классификации Текстов

Классификация текстов — одна из самых распространенных задач в NLP. Мы используем ее для автоматической категоризации статей‚ фильтрации спама‚ определения жанра или тональности. Scikit-learn предоставляет богатый набор алгоритмов машинного обучения‚ которые мы успешно применяем:

- Наивный Байесовский Классификатор (Naive Bayes): Простой‚ но удивительно эффективный алгоритм‚ особенно хорошо работающий с текстами благодаря своей способности обрабатывать высокоразмерные данные. Мы часто используем его как базовую модель.

- Метод Опорных Векторов (SVM ─ Support Vector Machine): SVM отлично справляется с задачами классификации‚ находя оптимальную гиперплоскость‚ разделяющую классы. Мы часто получаем с ним высокие показатели точности.

- Логистическая Регрессия: Несмотря на название‚ это мощный алгоритм классификации‚ который мы применяем‚ когда нам нужна хорошая интерпретируемость результатов;

Для нас важно не только обучить модель‚ но и тщательно оценить ее качество‚ используя такие метрики‚ как F1-score‚ Precision и Recall‚ чтобы убедиться‚ что она действительно хорошо справляется с поставленной задачей.

Анализ Тональности (Sentiment Analysis) с VADER и TextBlob

Понимание эмоциональной окраски текста — бесценный навык для бизнеса‚ маркетинга и социальных исследований. Мы активно используем анализ тональности для оценки отзывов клиентов‚ постов в социальных сетях или новостных заголовков.

- VADER (Valence Aware Dictionary and sEntiment Reasoner): Это лексический и основанный на правилах анализатор тональности‚ специально обученный на данных из социальных сетей. VADER отлично справляется с английским языком и учитывает такие нюансы‚ как восклицательные знаки‚ капслок и даже эмодзи. Мы ценим его за скорость и эффективность при работе с неформальным текстом.

- TextBlob: Как мы уже упоминали‚ TextBlob предоставляет простой интерфейс для анализа тональности‚ хотя для русского языка его часто приходится комбинировать с переводом или использовать специализированные словари.

Однако анализ тональности не всегда прямолинеен. Мы сталкивались с проблемами сарказма‚ иронии и двойных отрицаний‚ которые могут сбить с толку даже продвинутые модели. Для таких случаев мы либо используем более сложные модели на основе глубокого обучения‚ либо создаем собственные размеченные датасеты.

Извлечение Ключевых Фраз и Суммаризация Текста

В мире информационного переизбытка способность быстро извлекать самую важную информацию становится критичной. Мы используем NLP для:

- Извлечения ключевых фраз: С помощью алгоритмов‚ таких как RAKE (Rapid Automatic Keyword Extraction) или TextRank‚ мы можем автоматически находить наиболее релевантные слова и фразы в тексте. Это помогает нам быстро понять суть документа или статьи.

- Суммаризации текста: Мы различаем два основных подхода:

- Экстрактивная суммаризация: Выбирает наиболее важные предложения из оригинального текста и объединяет их. Это похоже на выделение ключевых моментов. Мы часто используем TextRank для этой задачи.

- Абстрактивная суммаризация: Генерирует новые предложения‚ которые передают суть оригинального текста‚ но не обязательно являются его прямыми цитатами. Это гораздо более сложная задача‚ требующая глубокого понимания языка‚ и для нее мы обычно используем трансформерные модели.

Эти инструменты позволяют нам значительно экономить время на чтении и анализе больших объемов информации.

Продвинутые Техники и Современные Тенденции в NLP

Мир NLP постоянно развивается‚ и мы стараемся идти в ногу со временем‚ осваивая самые передовые методы‚ особенно в области глубокого обучения и трансформеров.

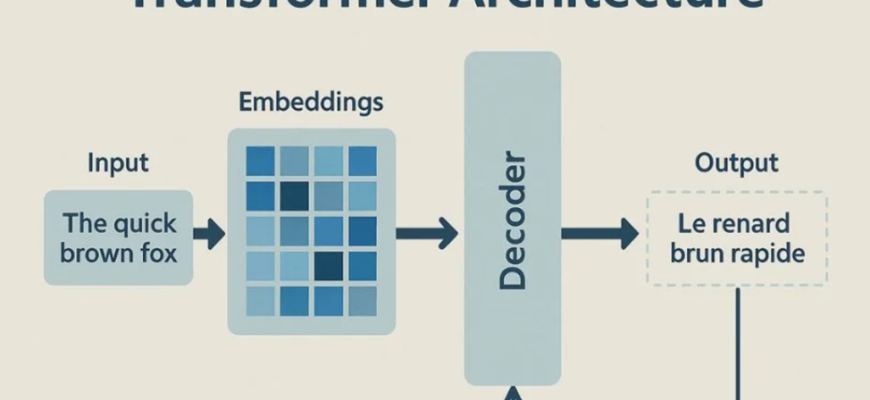

Трансформеры (Hugging Face) для Сложных Задач NLP

Появление трансформерных архитектур стало настоящей революцией в NLP. Эти модели‚ такие как BERT‚ GPT‚ RoBERTa‚ T5‚ изменили наш подход к решению самых сложных задач. Мы активно используем библиотеку Hugging Face Transformers‚ которая предоставляет простой доступ к сотням предварительно обученных моделей.

Что делает трансформеры такими мощными?

- Внимание (Attention Mechanism): Трансформеры могут уделять внимание различным частям входной последовательности при обработке каждого слова‚ что позволяет им улавливать долгосрочные зависимости в тексте.

- Предварительное обучение (Pre-training): Модели обучаются на огромных объемах текста (например‚ весь интернет) для выполнения задач‚ таких как предсказание следующего слова или заполнение пропущенных слов.

- Тонкая настройка (Fine-tuning): После предварительного обучения мы можем "дообучить" модель на небольшом‚ специфичном для нашей задачи датасете‚ чтобы она адаптировалась к нашим нуждам‚ будь то классификация‚ NER или вопросно-ответная система.

Мы применяем трансформеры для:

- NER: С моделями BERT или Flair мы добиваемся высочайшей точности.

- Классификации: Для более тонкой категоризации текстов‚ например‚ анализа тональности финансовых новостей.

- Генерации текста: Модели GPT позволяют нам создавать связные и осмысленные тексты‚ будь то ответы на вопросы‚ написание статей или даже кода.

- Машинного перевода: Современные трансформеры показывают феноменальные результаты в переводе‚ приближаясь к человеческому качеству.

Работа с трансформерами требует понимания глубокого обучения и часто использования GPU-ускорения‚ но результаты‚ которые мы получаем‚ оправдывают все затраты.

Применение PyTorch/TensorFlow для Создания Нейросетей NLP

Когда нам требуется максимальная гибкость‚ контроль над архитектурой модели или мы создаем что-то совершенно новое‚ мы обращаемся к фреймворкам глубокого обучения‚ таким как PyTorch и TensorFlow/Keras. Эти библиотеки позволяют нам строить нейронные сети с нуля‚ включая:

- Рекуррентные нейронные сети (RNN) и LSTM-сети: Хотя трансформеры во многом вытеснили их‚ RNN и LSTM все еще полезны для задач с последовательными данными‚ где важен порядок слов‚ например‚ для анализа временных рядов в текстовых данных или для создания более простых языковых моделей.

- Собственные архитектуры: Мы можем экспериментировать с различными слоями‚ функциями активации и оптимизаторами для создания моделей‚ идеально заточенных под наши специфические задачи.

Работа с PyTorch и TensorFlow — это более низкоуровневый подход‚ но он дает нам полный контроль и возможность для инноваций.

Разработка Систем Вопросно-Ответных Систем (QA) и Чат-ботов

Одна из наших самых захватывающих областей применения NLP, это создание систем‚ которые могут отвечать на вопросы (QA) и вести диалог (чат-боты). Мы используем:

- Для QA-систем: Трансформерные модели (например‚ BERT с дообучением на SQuAD датасете) показали себя феноменально. Они могут находить точные ответы в больших документах или генерировать их. Мы разрабатываем системы для создания FAQ на основе документов‚ что автоматизирует поддержку клиентов.

- Для чат-ботов: Фреймворк Rasa является нашим основным инструментом. Rasa позволяет нам создавать контекстно-зависимые диалоговые системы‚ используя компоненты для понимания естественного языка (NLU) и управления диалогом. Это значительно упрощает разработку сложных чат-ботов‚ которые могут обрабатывать сложные запросы и вести осмысленные беседы.

Создание умных ассистентов и систем‚ способных общаться с человеком‚ является для нас одним из самых вдохновляющих направлений.

Специализированные Инструменты и Приложения: Расширяем Горизонты

Помимо основных задач‚ существуют и более узкоспециализированные‚ но не менее важные области‚ где NLP проявляет свою мощь. Мы используем ряд библиотек и подходов для решения этих задач.

Обработка Многоязычных Текстовых Корпусов и Редких Языков

Мир не ограничивается английским языком. Мы активно работаем с многоязычными данными и сталкиваемся с проблемами обработки языков с богатой морфологией.

- Polyglot: Эта библиотека предоставляет широкий спектр функций для многоязычного NLP‚ включая обнаружение языка‚ POS-теггинг‚ NER и тональность. Она особенно полезна для работы с редкими языками‚ для которых нет обширных специализированных моделей.

- Stanza (от Stanford NLP Group): Stanza, это высокоточная библиотека для NLP‚ поддерживающая более 70 языков. Она предоставляет полный конвейер: токенизацию‚ многословные токены‚ лемматизацию‚ POS-теггинг‚ морфологический анализ и синтаксический парсинг. Мы часто используем Stanza для русского языка‚ где ее морфологический анализ особенно точен.

Работа с разными языками всегда бросает вызов‚ но эти инструменты значительно упрощают нашу задачу.

Извлечение Текста из Различных Источников: Веб-Скрейпинг и PDF

Текст не всегда доступен в удобном формате. Часто нам приходится извлекать его из различных источников:

- Beautiful Soup для веб-скрейпинга: Когда нам нужны данные с веб-сайтов‚ мы используем Beautiful Soup. Эта библиотека позволяет нам парсить HTML и XML документы‚ извлекая нужный текст‚ ссылки или другие элементы. Это незаменимый инструмент для сбора больших корпусов данных из интернета.

- PyMuPDF для извлечения текста из PDF: PDF-документы — еще один распространенный источник текста‚ но их обработка может быть сложной. PyMuPDF (или Fitz) позволяет нам эффективно извлекать текст‚ изображения и метаданные из PDF-файлов‚ что критично для анализа юридических документов‚ научных статей или финансовых отчетов.

Эти инструменты позволяют нам превращать неструктурированные данные из самых разных источников в формат‚ пригодный для NLP.

Анализ Стилистики Текстов‚ Эмодзи и Сленга

Современные тексты‚ особенно в социальных сетях‚ полны эмодзи‚ сленга и уникальных стилистических особенностей. Мы также углублялись в их анализ:

- Анализ стилистики текстов (авторский почерк): Это задача‚ известная как стилометрия. Мы используем различные лингвистические особенности (длина слов‚ предложений‚ частотность стоп-слов‚ использование пунктуации) для определения авторства‚ выявления плагиата или сравнения стилей.

- Работа с эмодзи и сленгом: Эмодзи часто несут эмоциональную нагрузку и могут быть ключевыми для анализа тональности. Мы разрабатываем специальные словари и правила для их обработки‚ а также используем библиотеки для нормализации сленга‚ чтобы привести его к стандартной форме. Это помогает нашим моделям лучше понимать неформальное общение.

Эти аспекты важны для получения полного и точного понимания современных текстовых данных.

Визуализация Текстовых Данных и Оценка Качества Моделей

Визуализация, это наш способ сделать сложные текстовые данные понятными и наглядными. Мы используем:

- Облака слов (Word Clouds): Простой‚ но эффективный способ показать наиболее часто встречающиеся слова в корпусе.

- Тепловые карты (Heatmaps): Для визуализации матриц схожести документов или тем.

- Гистограммы и графики распределения: Для анализа частотности слов‚ n-грамм‚ длины предложений и других статистических характеристик.

После того как мы построили модели‚ нам необходимо оценить их качество. Для этого мы используем стандартные метрики:

- Precision (Точность): Доля правильно предсказанных положительных исходов среди всех предсказанных положительных.

- Recall (Полнота): Доля правильно предсказанных положительных исходов среди всех фактических положительных.

- F1-score: Гармоническое среднее Precision и Recall‚ хороший показатель общего качества модели‚ особенно при несбалансированных классах.

Мы также проводим сравнение эффективности различных токенизаторов‚ стеммеров и лемматизаторов‚ чтобы выбрать оптимальный подход для конкретной задачи и языка. Например‚ для русского языка лемматизация с помощью spaCy часто превосходит стемминг NLTK по качеству.

Наше путешествие по миру Обработки Естественного Языка с Python было долгим и насыщенным. Мы начали с самых основ‚ освоив инструменты предобработки‚ такие как NLTK и spaCy‚ научились превращать слова в понятные для машин векторы с помощью CountVectorizer‚ TF-IDF‚ Word2Vec и трансформеров. Мы погрузились в сложные задачи‚ такие как тематическое моделирование с Gensim‚ классификация текстов со Scikit-learn и анализ тональности с VADER.

Мы видели‚ как трансформеры от Hugging Face открыли для нас новые горизонты в генерации текста‚ машинном переводе и создании умных вопросно-ответных систем. Мы научились работать с многоязычными данными‚ извлекать текст из самых разных источников и даже анализировать тонкости человеческого общения‚ включая эмодзи и сленг.

Каждый новый проект в NLP — это новый вызов и возможность научиться чему-то новому. Мы постоянно экспериментируем‚ сравниваем методы и ищем наиболее эффективные решения. Этот блог — это наше отражение этого пути‚ и мы надеемся‚ что наш опыт вдохновил вас на собственные открытия в этой захватывающей области. Мир NLP огромен и постоянно меняется‚ и мы рады быть его частью‚ продолжая учиться и делиться знаниями. Точка.

Подробнее

| NLTK основы | spaCy NER | Gensim LDA LSI | Scikit-learn классификация текста | Word2Vec GloVe |

| Анализ тональности Python | Hugging Face Transformers | Doc2Vec Sentence Transformers | PyTorch TensorFlow NLP | Суммаризация текста |