- Погружение в Мир NLP на Python: От Азов до Нейросетей и Трансформеров

- Наши Первые Шаги: Строительные Блоки NLP

- Основы NLTK: Токенизация и Стемминг

- Использование spaCy для Быстрого NER и Продвинутой Лемматизации

- Представление Текста для Машины: От Слов к Числам

- Разработка Собственных Векторизаторов: CountVectorizer и TfidfVectorizer

- Word Embeddings: Word2Vec и GloVe с Использованием Gensim

- Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

- Магия Смысла: Классификация, Тональность и Тематическое Моделирование

- Применение Scikit-learn для Классификации Текстов

- Анализ Тональности (Sentiment Analysis) с VADER и TextBlob

- Библиотека Gensim для Тематического Моделирования (LDA, LSI)

- Извлечение Смысла: Ключевые Фразы, Сущности и Информация

- Регулярные Выражения (re) в Предобработке Текста

- Анализ Текста для Извлечения Ключевых Фраз и Применение RAKE

- Новое Поколение NLP: Глубокое Обучение и Трансформеры

- Трансформеры (Hugging Face) для Сложных Задач NLP

- Применение PyTorch/TensorFlow для Создания Нейросетей NLP

- Практические Применения и Особенности NLP

- Обработка Многоязычных Текстовых Корпусов и Редких Языков

- Разработка Чат-ботов на Python (Rasa Framework)

- Анализ Текстов Отзывов Клиентов и Сообщений в Социальных Сетях

- Обработка Неструктурированного Текста: Очистка Данных и Нормализация

- Будущее NLP: Большие Данные, Автоматизация и Новые Горизонты

- Обработка Больших Текстовых Массивов (Big Data NLP)

- Разработка Инструментов для Автоматической Разметки Данных и Факт-Чекинга

- Визуализация Текстовых Данных: Word Clouds, Heatmaps и Другие

Погружение в Мир NLP на Python: От Азов до Нейросетей и Трансформеров

Приветствуем, дорогие читатели и коллеги по цеху! Сегодня мы с вами отправимся в увлекательное путешествие по безграничным просторам обработки естественного языка (NLP) с нашим верным спутником – Python. Возможно, для кого-то эта область кажется сложной и недоступной, полной математических формул и заумных терминов. Но поверьте нам, когда мы говорим, что с правильным подходом и мощными инструментами, которые предлагает Python, каждый может не просто понять, но и начать создавать свои собственные, невероятно полезные NLP-решения.

Мы сами прошли этот путь, от первых робких попыток токенизации до создания сложных моделей на трансформерах, и знаем, как важно иметь под рукой четкий и понятный гайд. В этой статье мы поделимся нашим опытом, расскажем о ключевых библиотеках и методах, которые составляют фундамент современного NLP, и покажем, как мы применяем их на практике. Приготовьтесь к тому, что ваш взгляд на текст изменится навсегда, ведь мы научимся не просто читать, но и понимать его на машинном уровне.

Наши Первые Шаги: Строительные Блоки NLP

Любое грандиозное здание начинается с фундамента, и в мире NLP таким фундаментом является предобработка текста. Прежде чем машина сможет "понять" человеческий язык, его необходимо подготовить. Этот этап включает в себя множество операций, которые позволяют нам перевести сырой, неструктурированный текст в формат, пригодный для анализа.

Мы всегда начинаем с самых базовых, но критически важных операций, которые закладывают основу для всех последующих шагов. Без них любые, даже самые продвинутые алгоритмы будут работать неэффективно или, что еще хуже, давать ошибочные результаты. Именно здесь мы знакомимся с такими понятиями, как токенизация, стемминг и лемматизация – краеугольными камнями предобработки.

Основы NLTK: Токенизация и Стемминг

Библиотека NLTK (Natural Language Toolkit) – это наш старый добрый друг, с которого многие из нас начинали свое знакомство с NLP. Она предоставляет огромное количество инструментов для работы с текстом, и хотя сейчас появились более быстрые и "тяжелые" библиотеки, NLTK остается незаменимой для понимания базовых концепций и проведения быстрых экспериментов. Мы часто используем ее для демонстрации студентам и начинающим разработчикам.

Токенизация – это процесс разбиения текста на отдельные единицы, называемые токенами. Токенами могут быть слова, пунктуационные знаки, цифры. Например, предложение "Мы изучаем NLP." будет токенизировано в ["Мы", "изучаем", "NLP", "."]. Этот, казалось бы, простой шаг, на самом деле, является первым ключом к разгадке смысла текста, позволяя нам работать с отдельными компонентами.

Стемминг – это процесс сокращения слов до их корневой формы (стема). Например, слова "бегает", "бегал", "бегущий" могут быть приведены к "бег"; Это полезно для уменьшения количества уникальных слов в корпусе и объединения словоформ, имеющих схожий смысл. Однако важно помнить, что стемминг не всегда дает лингвистически корректный корень, иногда обрезая слова слишком агрессивно. Для русского языка существуют специальные стеммеры, такие как PorterStemmer или SnowballStemmer, которые мы активно используем.

Использование spaCy для Быстрого NER и Продвинутой Лемматизации

Когда нам нужна скорость, точность и готовность к "боевым" задачам, мы обращаемся к spaCy. Эта библиотека – настоящий швейцарский нож в арсенале NLP-разработчика. Она предлагает высокопроизводительные конвейеры для обработки текста, предобученные модели для различных языков и интуитивно понятный API. Мы ценим spaCy за его эффективность и комплексность.

Распознавание именованных сущностей (NER) с помощью spaCy – это просто магия! Мы можем с легкостью выделить из текста имена людей, организации, географические названия, даты и многое другое. Это невероятно важно для извлечения структурированной информации из неструктурированных данных, например, для анализа новостных статей или юридических документов. Вот пример того, какие сущности spaCy может распознать:

-

PERSON: Имена людей.

-

ORG: Названия организаций.

-

GPE: Геополитические сущности (страны, города).

-

LOC: Места, не являющиеся GPE (горы, водные объекты).

Продвинутая лемматизация в spaCy – это еще одна функция, которую мы активно используем. В отличие от стемминга, лемматизация приводит слово к его базовой словарной форме (лемме), учитывая морфологию языка. Например, слова "бегает", "бегал", "бегущий" будут приведены к "бегать". Это гораздо точнее, чем стемминг, и позволяет сохранить лингвистическую корректность, что критически важно для многих задач.

Представление Текста для Машины: От Слов к Числам

Компьютеры не понимают слов в том виде, в каком их понимаем мы. Для них это просто последовательность символов. Чтобы машины могли работать с текстом, нам нужно перевести слова и предложения в числовые векторы. Это называется векторизацией текста. Мы исследовали множество подходов, и каждый из них имеет свои преимущества и области применения.

Выбор правильного метода векторизации – это половина успеха в любой NLP-задаче. От того, насколько хорошо мы представим семантику и синтаксис текста в числовом виде, зависит производительность наших моделей. Мы постоянно экспериментируем с новыми подходами, чтобы найти оптимальное решение для конкретной задачи.

Разработка Собственных Векторизаторов: CountVectorizer и TfidfVectorizer

Для многих классических задач машинного обучения, таких как классификация текста, мы начинаем с простых, но эффективных методов векторизации, предлагаемых Scikit-learn. Эти инструменты позволяют нам быстро получить числовое представление текста.

CountVectorizer просто подсчитывает частоту появления каждого слова в документе. В результате мы получаем матрицу, где строки соответствуют документам, а столбцы – уникальным словам из всего корпуса, а значения – количеству вхождений. Это очень интуитивный подход, но он не учитывает важность слова в контексте всего корпуса.

TfidfVectorizer (Term Frequency-Inverse Document Frequency) решает эту проблему. Он не только учитывает частоту слова в документе (TF), но и его редкость во всем корпусе (IDF). Таким образом, слова, которые часто встречаются в одном документе, но редко во всем корпусе, получают более высокий вес, что делает их более значимыми для классификации. Мы часто используем TF-IDF для задач, где важна уникальность и информативность терминов.

| Векторизатор | Описание | Пример использования | Преимущества | Недостатки |

|---|---|---|---|---|

| CountVectorizer | Создает матрицу частот слов в документах. | Классификация коротких текстов, анализ частотности. | Простота, интерпретируемость. | Не учитывает важность слов, может быть разреженным. |

| TfidfVectorizer | Взвешивает частоту слов с учетом их редкости в корпусе. | Классификация, извлечение ключевых слов, поиск релевантности. | Учитывает важность слов, хорошо работает с длинными текстами. | Все еще "мешок слов", не учитывает порядок слов. |

Word Embeddings: Word2Vec и GloVe с Использованием Gensim

Если мы хотим, чтобы машина понимала не просто наличие слов, но и их смысл, а также отношения между ними, нам нужны Word Embeddings (векторные представления слов). Эти модели позволяют нам отобразить слова в многомерное векторное пространство, где слова со схожим значением находятся близко друг к другу. Это был настоящий прорыв в NLP, и мы активно применяем его в наших проектах.

Библиотека Gensim – наш основной инструмент для работы с Word2Vec, GloVe и другими моделями векторных представлений. Она оптимизирована для работы с большими текстовыми корпусами и предлагает эффективные реализации алгоритмов. Мы часто обучаем свои собственные Word2Vec модели на специфических данных, чтобы получить более точные и релевантные векторы для конкретной предметной области.

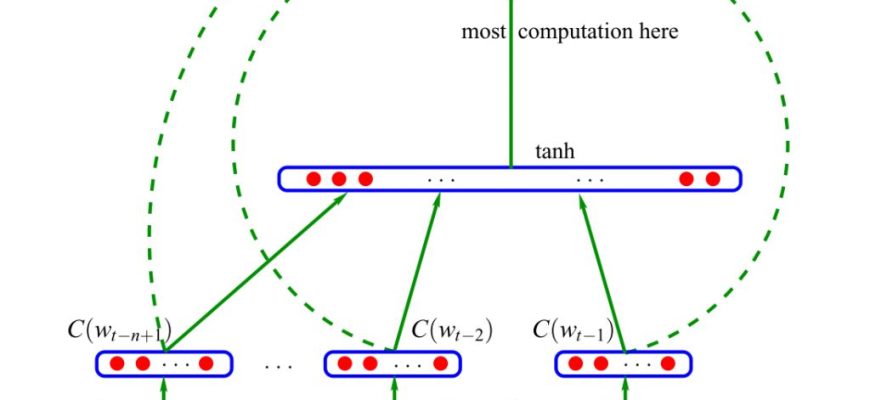

Word2Vec (предложенный Google) – это модель, которая обучается на большом корпусе текста и создает векторное представление для каждого слова. Она работает по принципу "слово по контексту" или "контекст по слову". Мы используем две основные архитектуры:

-

Skip-gram: Предсказывает контекстные слова, зная текущее слово.

-

CBOW (Continuous Bag-of-Words): Предсказывает текущее слово, зная контекст.

GloVe (Global Vectors for Word Representation) – это еще одна популярная модель, разработанная в Стэнфорде. Она объединяет статистическую информацию о со-встречаемости слов из всего корпуса с окном контекста, как в Word2Vec. GloVe часто дает отличные результаты, особенно на больших, гетерогенных корпусах. Мы сравниваем эти модели в зависимости от задачи, часто обнаруживая, что одна из них работает лучше для конкретного домена.

Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

Когда нам нужно получить векторное представление не просто слов, а целых предложений или даже документов, мы обращаемся к Doc2Vec (расширению Word2Vec) или, что чаще в последнее время, к Sentence Transformers. Doc2Vec позволяет нам генерировать векторы для целых документов, захватывая их общую семантику. Это очень полезно для задач поиска похожих документов или кластеризации.

Однако в последние годы мы видим, что Sentence Transformers стали настоящим прорывом. Эти модели, основанные на архитектурах трансформеров, позволяют получать высококачественные, контекстуализированные векторные представления предложений и коротких текстов. Они значительно превосходят традиционные методы в задачах поиска семантически похожих предложений, вопросно-ответных системах и кластеризации. Мы активно используем их для анализа отзывов клиентов и поиска похожих юридических прецедентов.

Магия Смысла: Классификация, Тональность и Тематическое Моделирование

Теперь, когда мы умеем переводить текст в числовой формат, перед нами открывается целый мир задач, где машины могут "понимать" и анализировать текст. Мы регулярно сталкиваемся с потребностью классифицировать документы, определять эмоциональную окраску высказываний или выявлять скрытые темы в больших массивах текста. Это те задачи, где NLP по-настоящему раскрывает свой потенциал.

От определения спама в почте до анализа настроений миллионов пользователей в социальных сетях – возможности безграничны. Мы используем комбинацию классических методов машинного обучения и самых современных нейронных сетей для достижения наилучших результатов.

Применение Scikit-learn для Классификации Текстов

Scikit-learn – это наш надежный инструмент для большинства задач машинного обучения, включая классификацию текста. После того как мы векторизовали наш текст с помощью CountVectorizer или TfidfVectorizer, мы можем применить к нему широкий спектр алгоритмов классификации. Мы часто начинаем с простых, но эффективных моделей, чтобы быстро получить базовый результат.

Мы используем такие алгоритмы, как:

-

Наивный Байесовский классификатор (Multinomial Naive Bayes): Отлично подходит для текстовых данных, прост и быстр в обучении.

-

Метод опорных векторов (SVM ⸺ Support Vector Machine): Часто показывает высокую точность на текстовых данных, особенно когда есть четкое разделение классов.

-

Логистическая регрессия: Простой, но мощный линейный классификатор, который хорошо работает в качестве отправной точки.

Сравнение моделей машинного обучения для NLP – это отдельная большая тема, и мы всегда проводим тщательный анализ, чтобы выбрать наиболее подходящий алгоритм для конкретной задачи, учитывая размер данных, сложность классов и требования к производительности.

Анализ Тональности (Sentiment Analysis) с VADER и TextBlob

Понимание эмоциональной окраски текста – это одна из самых востребованных задач в NLP, особенно в бизнесе. Мы хотим знать, что клиенты думают о наших продуктах, как пользователи реагируют на новости или какие настроения преобладают в социальных сетях. Для этого мы используем анализ тональности.

Для быстрого и эффективного анализа тональности англоязычных текстов мы часто используем VADER (Valence Aware Dictionary and sEntiment Reasoner). Это лексический анализатор, который не требует обучения на размеченных данных и отлично справляется с текстами из социальных сетей, понимая сленг, эмодзи и даже сарказм; Он выдает оценки по положительной, отрицательной и нейтральной тональности, а также композитный балл.

Для более общего анализа и быстрого прототипирования мы также обращаемся к TextBlob. Это простая в использовании библиотека, которая предоставляет API для решения общих задач NLP, включая анализ тональности. Она может быть не такой мощной, как VADER для специфических случаев, но ее простота делает ее отличным выбором для первого знакомства. Однако, мы всегда помним про ограничения TextBlob и ищем альтернативы, когда требуется высокая точность для специфических доменов или языков.

«Язык – это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут.»

— Рита Мэй Браун

Библиотека Gensim для Тематического Моделирования (LDA, LSI)

Иногда нам нужно не просто классифицировать текст, а понять, о чем он. Представьте, что у вас есть тысячи отзывов клиентов, и вы хотите узнать, какие основные темы обсуждаются. Здесь на помощь приходит тематическое моделирование. Gensim снова становится нашим незаменимым помощником.

Мы активно используем такие алгоритмы, как:

-

LSI (Latent Semantic Indexing): Один из первых методов тематического моделирования, основанный на сингулярном разложении (SVD). Он позволяет нам выявлять скрытые семантические связи между словами и документами.

-

LDA (Latent Dirichlet Allocation): Более популярный и мощный подход, который предполагает, что каждый документ представляет собой смесь нескольких тем, а каждая тема – это смесь слов. Мы можем настроить количество тем и получить вероятностное распределение слов по темам и тем по документам.

Сравнение моделей тематического моделирования, таких как LDA и NMF (Non-negative Matrix Factorization), является важной частью нашей работы. Каждая из них имеет свои сильные стороны и лучше подходит для определенных типов данных или задач. Например, LDA часто дает более интерпретируемые темы, а NMF может быть более эффективным на очень разреженных данных.

Извлечение Смысла: Ключевые Фразы, Сущности и Информация

Помимо общего понимания текста, нам часто требуется извлекать конкретные кусочки информации. Это может быть что угодно: от ключевых слов, которые суммируют содержание документа, до конкретных дат или имен. Здесь мы переходим от "понимания" к "извлечению".

Эта область NLP имеет огромное практическое значение, позволяя автоматизировать процессы, которые раньше требовали ручного труда. Мы используем разнообразные подходы, от регулярных выражений до продвинутых алгоритмов извлечения ключевых фраз, чтобы максимально эффективно "выжать" нужную информацию из текста.

Регулярные Выражения (re) в Предобработке Текста

Прежде чем приступать к сложным моделям, мы всегда помним о силе регулярных выражений (regex). Это невероятно мощный инструмент для поиска и манипулирования строками, который является основой для многих задач предобработки текста, таких как очистка данных от HTML-тегов, удаление пунктуации, чисел или специфических паттернов.

Мы используем модуль `re` в Python для выполнения таких операций, как:

-

Очистка текста от HTML-тегов: Удаление разметки из веб-страниц, полученных с помощью веб-скрейпинга.

-

Извлечение дат и чисел: Поиск и стандартизация различных форматов дат или числовых значений.

-

Нормализация пунктуации и символов: Замена нескольких пробелов одним, удаление лишних знаков.

Регулярные выражения – это как швейцарский армейский нож для работы с текстом, позволяющий нам быстро и эффективно выполнять множество операций, прежде чем текст будет передан более сложным NLP-моделям.

Анализ Текста для Извлечения Ключевых Фраз и Применение RAKE

Извлечение ключевых фраз – это задача, цель которой – выделить наиболее важные и информативные фразы из текста. Это очень полезно для суммаризации, создания тегов или индексирования документов. Мы используем различные подходы для решения этой задачи.

Один из наших любимых и простых в реализации методов – это RAKE (Rapid Automatic Keyword Extraction). RAKE – это алгоритм, который выявляет ключевые фразы, анализируя частоту слов и их со-встречаемость, а также используя стоп-слова для разделения потенциальных фраз. Он не требует обучения и дает удивительно хорошие результаты для многих типов текстов. Мы часто используем его для быстрого получения списка тем в статьях или отзывах.

Кроме RAKE, мы также применяем библиотеку TextRank (основанную на алгоритме PageRank), которая не только извлекает ключевые слова, но и ключевые предложения, что позволяет нам создавать экстрактивные суммаризации. Это позволяет нам быстро понять основную суть длинного документа, не читая его целиком.

Новое Поколение NLP: Глубокое Обучение и Трансформеры

Последние годы ознаменовались революцией в NLP благодаря глубокому обучению, и особенно трансформерным архитектурам. То, что раньше казалось фантастикой, теперь стало реальностью: машины не просто обрабатывают текст, они его понимают, генерируют и переводят с невероятной точностью. Мы с энтузиазмом осваиваем эти новые технологии и интегрируем их в наши проекты.

Эти модели открыли двери для решения задач, которые ранее считались почти невозможными, таких как сложные вопросно-ответные системы, высококачественный машинный перевод и даже креативная генерация текста. Это самая захватывающая часть нашего пути в NLP.

Трансформеры (Hugging Face) для Сложных Задач NLP

Если говорить о современном NLP, то мы не можем обойти стороной библиотеку Hugging Face Transformers. Это де-факто стандарт для работы с передовыми моделями, такими как BERT, GPT, RoBERTa и многими другими. Эта библиотека предоставляет простой и унифицированный API для загрузки, использования и тонкой настройки тысяч предобученных моделей, способных решать практически любую задачу NLP.

Мы используем трансформеры для:

-

Классификации текстов: Достижение SOTA (State-of-the-Art) результатов на различных наборах данных.

-

NER (Распознавание именованных сущностей): Значительно более точное и контекстно-зависимое, чем традиционные методы.

-

Машинного перевода: Создание высококачественных систем перевода, в т.ч. для узкоспециализированных текстов.

-

Генерации текста: От создания связных абзацев до написания кода и диалогов.

-

Суммаризации текста: Как экстрактивной, так и абстрактивной, когда модель генерирует новое резюме.

Тонкая настройка (Fine-tuning) предварительно обученных моделей – это ключевой аспект работы с трансформерами. Мы берем модель, которая уже "понимает" язык, и дообучаем ее на наших специфических данных, чтобы она лучше справлялась с нашей конкретной задачей. Это позволяет нам достигать впечатляющих результатов даже с относительно небольшими объемами размеченных данных.

Применение PyTorch/TensorFlow для Создания Нейросетей NLP

Хотя Hugging Face предоставляет высокоуровневый API, иногда нам нужна полная гибкость и контроль над архитектурой модели. В таких случаях мы обращаемся к фреймворкам глубокого обучения, таким как PyTorch и TensorFlow. Эти библиотеки позволяют нам строить нейронные сети с нуля, экспериментировать с различными архитектурами (например, LSTM-сетями для последовательностей) и реализовывать самые передовые исследования.

Мы используем PyTorch/TensorFlow для:

-

Разработки систем вопросно-ответных систем (QA), где модель должна находить точные ответы в тексте или генерировать их.

-

Создания моделей для выявления связей между сущностями, что критически важно для построения графов знаний.

-

Разработки систем машинного перевода с нуля или модификации существующих архитектур.

-

Построения LSTM-сетей для задач, требующих учета долговременных зависимостей в тексте, хотя сейчас трансформеры часто вытесняют их.

Работа с этими фреймворками требует более глубокого понимания математики и архитектур нейронных сетей, но она дает нам безграничные возможности для инноваций и создания по-настоящему уникальных решений.

Практические Применения и Особенности NLP

Теория – это хорошо, но что нас по-настоящему вдохновляет, так это возможность применять эти знания для решения реальных задач. NLP на Python – это не просто академическая дисциплина; это мощный инструмент, который мы используем для улучшения бизнеса, автоматизации рутинных процессов и даже для анализа человеческого поведения.

Мы постоянно сталкиваемся с новыми вызовами и ищем новые способы применения наших навыков. От анализа отзывов до создания интеллектуальных чат-ботов – возможности безграничны, и мы стараемся охватить как можно больше аспектов.

Обработка Многоязычных Текстовых Корпусов и Редких Языков

Мир не ограничивается английским языком, и в нашей работе мы часто сталкиваемся с необходимостью обрабатывать тексты на разных языках, включая русский, немецкий, французский и даже менее распространенные. Это добавляет свои сложности, но и открывает новые горизонты.

Для работы с мультиязычностью мы используем:

-

Библиотека Polyglot: Отличный выбор для анализа многих языков, предоставляя токенизацию, NER, анализ тональности и определение языка.

-

Библиотека Stanza (от Стэнфорда): Предлагает высококачественные модели для языков с богатой морфологией, включая русский. Она предоставляет продвинутую токенизацию, POS-теггинг, лемматизацию и синтаксический парсинг.

-

Трансформеры Hugging Face: Многие предобученные модели являются мультиязычными (например, mBERT, XLM-RoBERTa) и отлично справляются с текстами на разных языках.

Обработка нелатинских алфавитов требует особого внимания к кодировкам и специфике языков, но современные библиотеки значительно упрощают эту задачу. Мы также работаем над разработкой систем для автоматического перевода узкоспециализированных текстов, что имеет большое значение для наших международных проектов.

Разработка Чат-ботов на Python (Rasa Framework)

Чат-боты и виртуальные ассистенты – это, пожалуй, одно из самых наглядных применений NLP. Мы активно занимаемся их разработкой, используя Rasa framework. Rasa – это мощный фреймворк с открытым исходным кодом, который позволяет нам создавать контекстно-зависимых, диалоговых чат-ботов.

С помощью Rasa мы можем:

-

Распознавать намерения пользователя (Intent Recognition): Например, "заказать пиццу" или "узнать погоду".

-

Извлекать сущности (Entity Extraction): Например, "пепперони" из "заказать пиццу пепперони".

-

Управлять диалоговым состоянием: Отслеживать ход разговора и реагировать соответствующим образом.

Разработка чат-ботов – это не только NLP, но и проектирование диалогов, управление состоянием и интеграция с внешними системами. Это сложная, но очень интересная задача, которая позволяет нам создавать по-настоящему интерактивные системы.

Анализ Текстов Отзывов Клиентов и Сообщений в Социальных Сетях

Отзывы клиентов и сообщения в социальных сетях – это золотая жила для бизнеса. Мы используем NLP для извлечения ценных инсайтов из этих данных. Это позволяет компаниям понимать своих клиентов, улучшать продукты и принимать более обоснованные решения.

Наши задачи включают:

-

Анализ тональности отзывов: Определение общего настроения (положительное, отрицательное, нейтральное) и выявление специфических аспектов, вызывающих недовольство или восторг.

-

Тематическое моделирование отзывов: Выявление основных тем, которые обсуждают пользователи (например, "доставка", "качество продукта", "обслуживание").

-

Анализ тональности сообщений в социальных сетях (Twitter/Reddit): С учетом сленга, эмодзи и сарказма, что представляет собой отдельную сложную задачу. Мы активно работаем над разработкой инструмента для нормализации сленга и учета сарказма.

-

Анализ поведенческих паттернов в чатах и отзывах: Поиск повторяющихся запросов, проблем или предпочтений.

Для этих задач мы часто комбинируем VADER, трансформерные модели для анализа тональности и тематическое моделирование с LDA или NMF. Это позволяет нам получить максимально полную картину настроений и мнений.