- Тайные Тропы Текста: Как Python Открывает Нам Вселенную Естественного Языка

- Фундамент Понимания: От Сырого Текста к Структурированным Данным

- Превращаем Слова в Числа: Векторизация и Встраивания

- Простые‚ но Эффективные Векторизаторы

- Word Embeddings: Слова с Смыслом

- Язык в Действии: Ключевые Задачи NLP

- Распознавание Именованных Сущностей (NER) и Извлечение Информации

- Анализ Тональности (Sentiment Analysis)

- Тематическое Моделирование (Topic Modeling)

- Глубокое Погружение: Нейронные Сети и Трансформеры

- Трансформеры и Hugging Face

- Специализированные Инструменты и Приложения

- Работа с Разнообразными Источниками и Языками

- Создание Интеллектуальных Систем

- Визуализация и Анализ Качества

- Вызовы и Перспективы

Тайные Тропы Текста: Как Python Открывает Нам Вселенную Естественного Языка

В мире‚ где информация является новой валютой‚ способность понимать‚ обрабатывать и извлекать смысл из огромных объемов текстовых данных стала поистине бесценной. Каждый день мы сталкиваемся с миллионами слов: в электронных письмах‚ социальных сетях‚ новостных статьях‚ отзывах клиентов и научных работах. Но как превратить этот бесформенный поток символов в структурированные знания‚ которые могут принимать решения‚ предсказывать тренды или даже генерировать новый контент? Именно здесь на сцену выходит Обработка Естественного Языка (NLP)‚ и‚ поверьте нам‚ Python — это наш верный проводник в этом увлекательном путешествии.

Мы‚ как пытливые исследователи цифровой эпохи‚ постоянно ищем способы заглянуть за кулисы текста. Нас всегда манила идея научить машины понимать человеческий язык так же‚ как мы сами; И это не просто академический интерес; это ключ к созданию более умных чат-ботов‚ персонализированных рекомендательных систем‚ систем автоматического перевода и многого другого. За последние годы мы были свидетелями невероятного прогресса в NLP‚ и сегодня мы готовы поделиться нашим опытом и показать вам‚ как мы используем Python для разгадывания языковых загадок. Приготовьтесь‚ ведь мы погрузимся в мир алгоритмов‚ моделей и библиотек‚ которые делают текст по-настоящему живым.

Фундамент Понимания: От Сырого Текста к Структурированным Данным

Прежде чем мы сможем научить машину "читать" текст‚ нам необходимо его подготовить. Представьте‚ что вы пытаетесь учить ребенка читать‚ не объяснив ему‚ что такое буквы‚ слова и предложения. Примерно так же обстоят дела и с машинами. Поэтому наши первые шаги в NLP всегда связаны с предобработкой текста‚ и здесь нам на помощь приходят такие базовые‚ но невероятно мощные инструменты‚ как токенизация‚ стемминг и лемматизация. Это как азбука для наших алгоритмов.

Мы начинаем с токенизации – процесса разбиения текста на мельчайшие значимые единицы‚ или "токены". Чаще всего это слова или знаки препинания. Например‚ предложение "Мы любим NLP!" превратится в токены [‘Мы’‚ ‘любим’‚ ‘NLP’‚ ‘!’]. Для этой задачи мы часто используем библиотеку NLTK (Natural Language Toolkit)‚ которая предлагает различные токенизаторы‚ способные справляться с особенностями разных языков.

После токенизации мы сталкиваемся с проблемой вариативности слов: "бежать"‚ "бежит"‚ "бегал" — все они обозначают одно и то же действие. Здесь в игру вступают стемминг и лемматизация.

Мы часто используем следующие методы для нормализации текста:

- Стемминг (Stemming): Процесс отсечения окончаний и суффиксов‚ чтобы получить "основу" слова (стем). Например‚ "running"‚ "runs"‚ "ran" могут быть сведены к "run". Это быстрый‚ но иногда грубый метод‚ поскольку стемы не всегда являются реальными словами. NLTK предлагает различные стеммеры‚ такие как PorterStemmer и SnowballStemmer.

- Лемматизация (Lemmatization): Более сложный и точный процесс‚ который приводит слово к его базовой словарной форме (лемме) с учетом его части речи и контекста. Например‚ "лучший" вернется к "хороший"‚ а "были" к "быть". Для лемматизации мы предпочитаем использовать spaCy или продвинутые инструменты NLTK‚ так как они дают более качественные результаты‚ особенно для языков с богатой морфологией‚ таких как русский.

Помимо этого‚ мы активно используем регулярные выражения (библиотека re) для более тонкой предобработки текста: удаления HTML-тегов‚ очистки от пунктуации‚ работы со сленгом и эмодзи‚ нормализации текста‚ извлечения дат и чисел. Это наш швейцарский нож для любых манипуляций с текстовыми строками. А для удаления стоп-слов (частотных‚ но малоинформативных слов‚ таких как "и"‚ "в"‚ "на") мы используем готовые списки из NLTK или spaCy‚ которые значительно сокращают размер данных и повышают эффективность дальнейшего анализа.

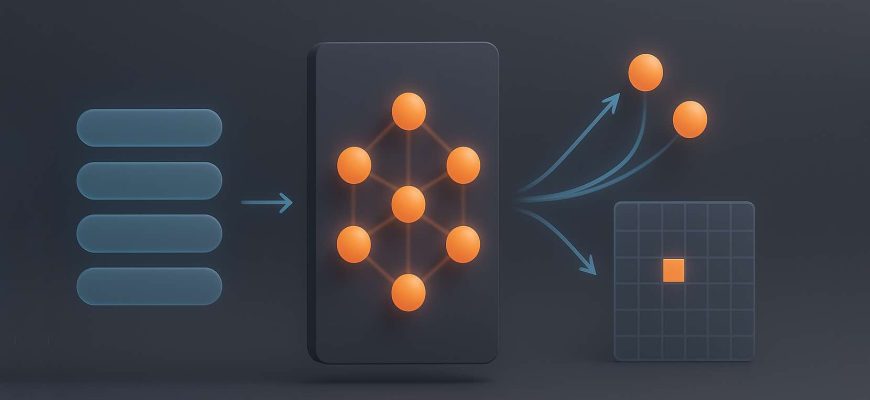

Превращаем Слова в Числа: Векторизация и Встраивания

Компьютеры понимают только числа. Поэтому‚ чтобы наши машины могли работать с текстом‚ нам нужно перевести слова и предложения в числовые представления‚ или векторы. Это один из самых критически важных этапов в NLP‚ и мы прошли долгий путь от простых методов до сложных контекстных встраиваний.

Простые‚ но Эффективные Векторизаторы

Начинаем мы всегда с основ‚ которые остаются актуальными для многих задач:

- CountVectorizer: Мы используем его для подсчета частоты каждого слова в документе. Получается матрица‚ где строки — документы‚ а столбцы, слова‚ а значения — количество вхождений. Просто‚ но работает.

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): Этот метод не только учитывает частоту слова в документе‚ но и его редкость во всем корпусе текстов; Он присваивает больший вес словам‚ которые часто встречаются в конкретном документе‚ но редко в других‚ тем самым выделяя наиболее информативные слова. Мы часто применяем его для классификации текстов и поиска ключевых фраз.

Однако эти методы имеют ограничения: они не учитывают семантическое сходство слов и порядок их следования. Поэтому мы перешли к более продвинутым техникам‚ которые позволяют нам уловить смысл.

Word Embeddings: Слова с Смыслом

Для нас Word Embeddings стали настоящим прорывом. Эти методы отображают слова в векторы таким образом‚ что семантически похожие слова оказываются близко друг к другу в многомерном пространстве. Мы активно используем:

| Метод | Описание | Применение |

|---|---|---|

| Word2Vec (Gensim) | Модель‚ которая учится векторным представлениям слов‚ анализируя их контекст. Мы используем две архитектуры: Skip-gram (предсказывает контекст по слову) и CBOW (предсказывает слово по контексту). | Поиск синонимов‚ рекомендательные системы‚ кластеризация слов. |

| GloVe | Глобальные Векторы для Представления Слов – еще один популярный метод‚ основанный на глобальной статистике со-встречаемости слов. | Схожие задачи с Word2Vec‚ часто дает хорошие результаты на больших корпусах. |

| FastText | Разработанный Facebook‚ FastText расширяет Word2Vec‚ учитывая не только целые слова‚ но и их подслова (n-граммы символов). Это делает его особенно эффективным для работы с редкими словами и морфологически богатыми языками. | Классификация текста‚ работа с OOV (Out-Of-Vocabulary) словами‚ многоязычный NLP. |

Но что‚ если нам нужно векторизовать не просто слова‚ а целые предложения или документы? Здесь мы обращаемся к Doc2Vec (расширению Word2Vec для документов) и Sentence Transformers‚ которые позволяют нам получать контекстно-зависимые встраивания для более длинных фрагментов текста. Это открывает двери для сравнения документов‚ поиска дубликатов и анализа тематического сходства.

Язык в Действии: Ключевые Задачи NLP

С подготовленным и векторизованным текстом мы можем приступать к решению более сложных задач. Наш опыт показывает‚ что Python предоставляет невероятный арсенал инструментов для выполнения практически любой задачи в NLP. Мы применяем эти методы для извлечения информации‚ классификации‚ анализа тональности и многого другого.

Распознавание Именованных Сущностей (NER) и Извлечение Информации

Одной из самых востребованных задач является Распознавание Именованных Сущностей (NER). Это процесс идентификации и классификации именованных сущностей в тексте‚ таких как имена людей‚ названия организаций‚ локации‚ даты и т.д. Мы активно используем для этого библиотеку spaCy‚ которая известна своей скоростью и точностью‚ а также Flair‚ предлагающую современные NER-модели на основе трансформеров. Для более специфических задач мы иногда обращаемся к CRF (Conditional Random Fields)‚ особенно когда у нас есть небольшие‚ но хорошо размеченные данные.

Извлечение ключевых фраз‚ дат‚ чисел и связей между сущностями – это то‚ что мы делаем постоянно. Для этого мы применяем RAKE (Rapid Automatic Keyword Extraction) для извлечения ключевых слов‚ а также строим свои собственные системы на основе регулярных выражений и правил‚ чтобы точно извлекать нужную информацию из неструктурированных данных‚ например‚ из юридических документов или лог-файлов.

Анализ Тональности (Sentiment Analysis)

Понимание эмоциональной окраски текста — критически важно для анализа отзывов клиентов‚ постов в социальных сетях или финансовых новостей. Мы используем различные подходы к анализу тональности:

- VADER (Valence Aware Dictionary and sEntiment Reasoner): Это лексический инструмент‚ специально разработанный для анализа тональности в социальных сетях. Он учитывает не только отдельные слова‚ но и их усиление‚ ослабление‚ использование заглавных букв и знаков препинания. Мы находим его очень полезным для быстрого анализа коротких сообщений.

- TextBlob: Предлагает простой API для анализа тональности. Хотя он и не всегда самый точный‚ его легко интегрировать для базовых задач. Мы часто используем его для быстрого прототипирования.

- Модели машинного обучения: Для более сложных задач и специфических доменов мы обучаем собственные классификаторы тональности‚ используя Scikit-learn (SVM‚ наивный байесовский классификатор) или даже глубокие нейронные сети на базе PyTorch/TensorFlow‚ которые могут учитывать контекст и улавливать сарказм.

Мы также не забываем о таких нюансах‚ как анализ тональности сообщений в социальных сетях с учетом сарказма и работа с эмодзи и сленгом. Эти элементы требуют более сложных моделей и обширных обучающих данных‚ но их учет значительно повышает качество анализа.

Тематическое Моделирование (Topic Modeling)

Когда у нас есть большой корпус текстов‚ и мы хотим понять‚ о чем они‚ не читая каждый из них‚ мы обращаемся к тематическому моделированию. Это позволяет нам автоматически выявлять скрытые темы в коллекциях документов.

Наиболее часто используемые нами подходы включают:

- LDA (Latent Dirichlet Allocation): Классический метод‚ который предполагает‚ что каждый документ представляет собой смесь нескольких тем‚ а каждая тема, это смесь слов. Мы используем библиотеку Gensim для реализации LDA‚ что позволяет нам анализировать большие текстовые массивы и извлекать ключевые темы из отзывов‚ статей и других источников.

- LSI (Latent Semantic Indexing): Еще один метод‚ основанный на сингулярном разложении матрицы слов-документов. Также доступен через Gensim.

- NMF (Non-negative Matrix Factorization): Альтернатива LDA‚ часто дающая более интерпретируемые темы. Мы проводим сравнение моделей тематического моделирования (LDA vs NMF)‚ чтобы выбрать наиболее подходящий метод для конкретной задачи.

Тематическое моделирование позволяет нам не только увидеть основные темы‚ но и отследить их динамику во времени‚ например‚ анализируя временные ряды в текстовых данных‚ чтобы выявить сезонность или внезапные изменения интересов.

Глубокое Погружение: Нейронные Сети и Трансформеры

Современный NLP невозможно представить без глубокого обучения. Нейронные сети‚ особенно трансформерные архитектуры‚ произвели революцию в этой области‚ позволив нам решать задачи‚ которые ранее казались недостижимыми. Мы активно используем эти мощные инструменты.

Трансформеры и Hugging Face

Когда речь заходит о передовых задачах NLP‚ мы не можем обойти стороной трансформеры. Библиотека Hugging Face Transformers стала для нас незаменимым инструментом. Она предоставляет доступ к огромному количеству предварительно обученных моделей‚ таких как BERT‚ GPT‚ RoBERTa и многих других. Мы используем их для:

- Классификации текста: BERT для задач классификации‚ таких как анализ тональности финансовых новостей или категоризация статей‚ показал себя чрезвычайно эффективно.

- NER: Тонкая настройка (Fine-tuning) предварительно обученных моделей для распознавания сущностей в специфических доменах.

- Генерации текста: Модели семейства GPT открыли нам возможности для создания систем‚ способных генерировать связные и осмысленные тексты‚ отвечать на вопросы и даже писать код.

-

Суммаризации текста (Abstractive vs Extractive): Трансформеры позволяют нам разрабатывать системы‚ которые могут не только извлекать ключевые предложения (экстрактивная суммаризация)‚ но и генерировать полностью новые‚ краткие пересказы (абстрактивная суммаризация).

- Машинного перевода: Современные трансформерные модели значительно улучшили качество автоматического перевода‚ особенно для пар языков‚ для которых доступно много данных.

- Разработки систем вопросно-ответных систем (QA): Мы строим QA-системы‚ которые могут находить ответы на вопросы в больших текстовых корпусах‚ используя возможности трансформеров для понимания контекста запроса и документа.

Мы также применяем PyTorch/TensorFlow для создания нейросетей NLP с нуля или для тонкой настройки более сложных архитектур‚ таких как LSTM-сети‚ когда это требуется для специфических задач.

"Язык — это дорожная карта культуры. Он говорит вам‚ откуда пришли люди и куда они идут."

— Рита Мэй Браун

Специализированные Инструменты и Приложения

Наш арсенал не ограничивается только общими библиотеками. Мы часто используем специализированные инструменты для решения конкретных задач‚ а также для работы с особыми типами данных и языков.

Работа с Разнообразными Источниками и Языками

Текст не всегда приходит в удобном формате. Иногда нам приходится извлекать текст из PDF с помощью PyMuPDF или веб-скрейпить текст с сайтов‚ используя Beautiful Soup. Это первый шаг к превращению неструктурированных данных в пригодный для анализа формат.

Мир многоязычен‚ и наши системы тоже должны быть такими. Мы активно обрабатываем многоязычные текстовые корпусы. Для этого мы используем такие библиотеки‚ как Polyglot‚ которая предоставляет поддержку для множества языков‚ включая анализ редких языков. Stanza‚ разработанная Stanford NLP Group‚ также является мощным инструментом для языков с богатой морфологией‚ включая русский‚ предлагая высококачественный POS-теггинг‚ лемматизацию и синтаксический парсинг.

Для русского языка‚ в частности‚ мы проводим продвинутую лемматизацию и стемминг‚ морфологический анализ и POS-теггинг с использованием NLTK и SpaCy‚ которые имеют хорошие модели для нашего родного языка.

Создание Интеллектуальных Систем

Наш опыт простирается до создания полноценных интеллектуальных систем:

- Чат-боты: Мы разрабатываем чат-ботов на Python‚ часто используя фреймворк Rasa‚ который позволяет нам строить диалоговые системы с пониманием естественного языка и управлением диалогом.

- Системы машинного перевода: Мы создаем и тонко настраиваем модели для автоматического перевода‚ в т.ч. узкоспециализированных текстов‚ что требует специфических данных и доменной адаптации.

- Системы суммаризации: От экстрактивных методов на основе TextRank до абстрактивных моделей с использованием трансформеров‚ мы помогаем автоматически сокращать большие тексты.

- Системы обнаружения плагиата: Используя метрики сходства текста (например‚ из библиотеки Textdistance)‚ мы разрабатываем системы‚ способные выявлять дубликаты и заимствования.

- Автоматическая категоризация и тегирование: Для организации больших объемов контента мы создаем системы‚ которые автоматически классифицируют статьи по темам и присваивают им теги.

Визуализация и Анализ Качества

Визуализация данных играет ключевую роль в понимании результатов NLP. Мы используем инструменты для визуализации текстовых данных‚ такие как облака слов (Word Clouds)‚ тепловые карты (Heatmaps) для частотности n-грамм‚ чтобы наглядно представить наиболее важные термины и их взаимосвязи. Для более глубокого анализа данных мы применяем библиотеку Sweetviz‚ которая предоставляет быстрые и информативные отчеты‚ в т.ч. для текстовых полей.

Оценка качества наших моделей — это не просто формальность‚ а неотъемлемая часть процесса разработки. Мы оцениваем качество NER-моделей с помощью метрик F1-score‚ Precision и Recall. Мы также сравниваем эффективность различных токенизаторов и методов лемматизации (SpaCy vs NLTK)‚ чтобы убедиться‚ что выбираем оптимальный подход для каждой задачи. Сравнение методов векторизации (TF-IDF vs Word2Vec) также регулярно проводится для подбора наилучшего представления текста.

Вызовы и Перспективы

Работа с естественным языком никогда не бывает простой. Мы постоянно сталкиваемся с проблемами обработки неполных и ошибочных данных‚ необходимостью нормализации сленга и пунктуации‚ а также с задачей анализа стилистики текстов (авторского почерка). Мы разрабатываем инструменты для проверки грамматики и исправления орфографии‚ чтобы наши входные данные были как можно более чистыми.

Мы также работаем с большими текстовыми массивами (Big Data NLP)‚ где производительность и масштабируемость становятся критически важными. В таких случаях мы используем GPU-ускорение для обработки текста‚ что значительно сокращает время обучения сложных моделей.

Будущее NLP для нас выглядит невероятно захватывающим. Мы видим‚ как развиваются системы обнаружения связей между сущностями‚ как Transformer-модели используются для анализа кода и генерации диалогов‚ и как NLP проникает во все большее количество областей‚ от анализа медицинских записей до автоматического создания FAQ. Наша цель — не просто следовать за трендами‚ но и активно формировать их‚ применяя наш опыт и знания для создания по-настоящему умных и полезных решений.

Мы верим‚ что Python и его экосистема останутся краеугольным камнем в мире NLP‚ предоставляя нам гибкость‚ мощность и доступ к передовым исследованиям. Каждый проект — это новое приключение‚ каждая строка кода — шаг к более глубокому пониманию того‚ как мы‚ люди‚ общаемся и как машины могут стать нашими партнерами в этом общении.

На этом статья заканчивается.

Подробнее

| NLTK токенизация | spaCy NER | Gensim LDA | Word2Vec GloVe | Анализ тональности VADER |

| Трансформеры Hugging Face | PyTorch NLP | TextRank суммаризация | Polyglot мультиязычность | BERT классификация |