- Проводник в мир слов: Наш путь в глубины Обработки Естественного Языка на Python

- Первые шаги: Строим фундамент с NLTK и регулярными выражениями

- Токенизация и стемминг (NLTK)

- Регулярные выражения (re) в предобработке текста

- Углубляемся в предобработку: От очистки до лемматизации

- Продвинутая лемматизация и стемминг

- Очистка текста: Стоп-слова, пунктуация, HTML

- Работа с эмодзи и сленгом в современных текстах

- Превращаем текст в числа: Искусство векторизации

- Классические методы: CountVectorizer и TF-IDF

- Магия Word Embeddings: Word2Vec, GloVe и FastText

- От слов к предложениям и документам: Doc2Vec и Sentence Transformers

- Контекстные встраивания: Эра BERT и Flair

- Разгадываем смысл: Основные задачи NLP на практике

- Распознавание именованных сущностей (NER) с spaCy и Flair

- Анализ тональности: От VADER до сложных эмоций

- Тематическое моделирование: Погружение в Gensim (LDA, LSI)

- Классификация текстов: Scikit-learn и нейросети

- Извлечение ключевых фраз: RAKE и TextRank

- Суммаризация текста: От простого к абстрактному

- За пределами основ: Продвинутые техники и инструменты

- Трансформеры (Hugging Face) для сложных задач NLP

- Мультиязычный NLP: Stanza и Polyglot

- Веб-скрейпинг для данных: Beautiful Soup

- Анализ стилистики и авторского почерка

- Работа с большими текстовыми массивами (Big Data NLP)

- Оценка и сравнение: Выбираем лучшее решение

- Метрики качества: F1-score, Precision, Recall

- Сравнение методов: LDA vs NMF, Word2Vec Skip-gram vs CBOW

- Наши собственные NLP-проекты: Что дальше?

- Разработка инструментов для проверки грамматики и орфографии

- Системы обнаружения плагиата и факт-чекинга

- Анализ юридических и медицинских документов

Проводник в мир слов: Наш путь в глубины Обработки Естественного Языка на Python

Привет, дорогие читатели и коллеги по цеху! Мы, как опытные путешественники по бескрайним просторам данных, сегодня приглашаем вас в увлекательное приключение – в мир Обработки Естественного Языка (NLP) с помощью Python. Это не просто набор инструментов или алгоритмов; это целая философия, позволяющая машинам понимать, интерпретировать и даже генерировать человеческую речь. Поверьте, когда мы впервые столкнулись с возможностями NLP, наш мир перевернулся. Мы осознали, что текст, этот казалось бы хаотичный поток символов, на самом деле скрывает в себе невероятные структуры и смыслы, которые можно извлечь, проанализировать и использовать.

За годы практики мы накопили немалый опыт, работая с текстами самых разных форм и объемов – от коротких твитов до объемных юридических документов. И каждый раз, когда нам удавалось заставить компьютер "понять" смысл сказанного или написанного, мы испытывали настоящий восторг. В этой статье мы хотим поделиться с вами нашим путем, нашими открытиями и теми инструментами, которые стали нашими верными спутниками в этом захватывающем путешествии. Мы не будем просто перечислять библиотеки; мы покажем, как они интегрируются в единую, мощную систему, способную решать реальные задачи – от анализа тональности отзывов до создания интеллектуальных чат-ботов. Приготовьтесь, нас ждет глубокое погружение!

Прежде чем мы углубимся в технические детали, давайте поговорим о том, почему NLP стало такой краеугольной дисциплиной в современном мире. Ежедневно мы генерируем колоссальные объемы текстовых данных: электронные письма, сообщения в социальных сетях, новостные статьи, научные публикации, отзывы клиентов, юридические документы. Представьте себе, сколько ценной информации скрывается в этом потоке! Вручную обрабатывать такие объемы просто невозможно. Именно здесь на помощь приходит NLP, позволяя нам автоматизировать анализ, извлечение, структурирование и даже генерацию текстового контента.

Для нас, как для блогеров, NLP открыло двери к пониманию нашей аудитории, анализу комментариев, автоматическому тегированию статей и даже генерации идей для новых публикаций. Для бизнеса это означает возможность отслеживать репутацию бренда, анализировать обратную связь от клиентов, оптимизировать работу колл-центров и создавать персонализированные предложения. В медицине NLP помогает в извлечении важной информации из историй болезни, в юриспруденции – в поиске прецедентов, в науке – в ускорении анализа исследований. По сути, NLP – это ключ к разблокировке потенциала неструктурированных текстовых данных, превращению их в actionable insights, то есть в идеи, на основе которых можно принимать решения и действовать.

Первые шаги: Строим фундамент с NLTK и регулярными выражениями

Каждое великое путешествие начинается с первых шагов, и в мире NLP эти шаги обычно ведут нас к библиотеке NLTK (Natural Language Toolkit). Это своего рода азбука для любого, кто начинает работать с текстом на Python. NLTK предоставляет нам базовые, но при этом фундаментальные инструменты для предобработки, без которых дальнейшая работа с текстом была бы попросту невозможна. Мы всегда начинаем с неё, чтобы заложить прочный фундамент.

Токенизация и стемминг (NLTK)

Представьте, что перед нами огромный текст. Как компьютер может его "понять"? Для начала его нужно разбить на мельчайшие значимые единицы – токены. Это могут быть слова, знаки препинания, числа. Процесс разделения текста на токены называется токенизацией. NLTK предлагает различные токенизаторы, например, для слов (word_tokenize) или предложений (sent_tokenize). Это кажется простым, но правильная токенизация критически важна для дальнейшего анализа. Например, "don’t" может быть одним токеном или двумя ("do" и "n’t"), и от этого зависит смысл.

После токенизации слова часто нужно привести к их базовой форме. Например, "бегать", "бегал", "бегущий" – все они связаны с корнем "бег". Здесь в игру вступают стемминг и лемматизация. Стемминг (от англ. "stem" – корень) – это процесс усечения слов до их основы, или "ствола". Porter Stemmer и Snowball Stemmer – это популярные алгоритмы стемминга в NLTK. Они работают по набору правил и эвристик, удаляя суффиксы и префиксы. Мы часто используем стемминг для задач, где нам важна только корневая форма слова, а не его грамматические вариации, например, для поиска документов по ключевым словам.

| Метод | Описание | Пример (рус.) |

|---|---|---|

| Токенизация | Разбиение текста на отдельные слова или предложения. | "Привет, мир!" -> ["Привет", ",", "мир", "!"] |

| Стемминг | Приведение слова к его основе путем удаления окончаний. | "Красивый", "красота" -> "красив" (может быть не словом) |

Регулярные выражения (re) в предобработке текста

Несмотря на мощь специализированных библиотек, в нашем арсенале всегда есть универсальный инструмент – регулярные выражения (библиотека re). Они незаменимы для тонкой настройки предобработки, когда нам нужно найти и заменить определенные паттерны в тексте. Удаление ссылок, хештегов, упоминаний, чисел, специальных символов, очистка от HTML-тегов – всё это мы можем эффективно делать с помощью регулярных выражений. Они позволяют нам быть гибкими и адаптироваться к любым особенностям данных. Например, чтобы удалить все HTML-теги, мы можем использовать паттерн <.*?>.

Мы часто применяем re для предварительной очистки текста перед подачей его в NLTK или spaCy, чтобы избежать проблем с токенизацией или распознаванием сущностей, вызванных "шумом" в данных. Это своего рода первый фильтр, который делает сырые данные более пригодными для анализа. Мы всегда рекомендуем сначала пройтись регулярными выражениями, а уже потом применять более сложные NLP-алгоритмы;

Углубляемся в предобработку: От очистки до лемматизации

Предобработка текста – это, пожалуй, самый трудоёмкий, но и самый важный этап в любом NLP-проекте. Качество ваших результатов напрямую зависит от того, насколько хорошо вы подготовили данные. Мы убедились в этом на собственном опыте: иногда даже самые продвинутые модели выдают бессмысленные результаты, если их "накормить" грязным текстом. Поэтому мы уделяем этому этапу особое внимание.

Продвинутая лемматизация и стемминг

Хотя стемминг прост и быстр, у него есть существенный недостаток: он часто генерирует "псевдо-слова", которые не существуют в реальном языке. Например, "красивый" может стать "красив", а "бежать" – "бег". Для задач, где важно сохранять лексический смысл и грамматическую правильность, мы используем лемматизацию. Лемматизация – это процесс приведения слова к его словарной (нормальной) форме, или лемме. Она значительно сложнее стемминга, так как требует знания морфологии языка. Для этого мы часто обращаемся к библиотекам, таким как spaCy или Stanza, которые имеют более продвинутые языковые модели.

Например, в русском языке лемматизация особенно важна из-за его богатой морфологии (множество падежей, спряжений, склонений). Сравнение моделей лемматизации (SpaCy vs NLTK WordNetLemmatizer) показывает, что SpaCy часто справляется лучше, особенно с учетом контекста слова в предложении. Мы используем лемматизацию для таких задач, как тематическое моделирование, где важна семантическая близость слов, или для построения систем вопросно-ответных систем, где точность понимания запроса критична.

Очистка текста: Стоп-слова, пунктуация, HTML

Помимо токенизации и лемматизации, предобработка включает удаление различных "шумов":

- Стоп-слова (stop-words): Это часто встречающиеся слова, такие как "и", "в", "на", "он", "она", которые не несут существенной смысловой нагрузки и могут только мешать анализу. NLTK и spaCy предоставляют списки стоп-слов для различных языков. Мы создаем собственные "инструменты для маркировки стоп-слов", адаптируя их под специфику нашей предметной области, так как то, что является стоп-словом в одной области, может быть ключевым в другой.

- Пунктуация: Зачастую знаки препинания не несут смысловой нагрузки для машинного обучения и могут быть удалены или заменены пробелами. Однако иногда, например, в анализе тональности, восклицательные знаки или вопросительные знаки могут быть важны. Мы используем "инструмент для нормализации пунктуации", чтобы либо полностью убрать её, либо привести к единообразному виду.

- HTML-теги: Текст, полученный из веб-страниц, часто содержит HTML-теги. Мы уже упоминали регулярные выражения для их удаления, но существуют и специализированные библиотеки, например, Beautiful Soup (о которой мы поговорим позже), которая может помочь в более сложном "инструменте для очистки текста от HTML-тегов".

Работа с эмодзи и сленгом в современных текстах

Современные тексты, особенно из социальных сетей, изобилуют эмодзи и сленгом. Игнорировать их – значит терять важный контекст, особенно в анализе тональности. Эмодзи могут выражать сильные эмоции, а сленг – указывать на принадлежность к определенной группе или на неформальный стиль общения. Мы разрабатываем собственные методы для работы с ними: для эмодзи это может быть их преобразование в текстовые описания (например, "😊" -> "улыбающееся лицо") или использование специальных векторизаций. Для сленга мы создаем "инструмент для нормализации сленга", используя словари и правила замены, чтобы приводить нестандартные выражения к их общепринятым аналогам. Это сложная, но крайне важная задача для анализа текстов из социальных медиа.

Превращаем текст в числа: Искусство векторизации

После того, как мы очистили и нормализовали текст, возникает следующая фундаментальная проблема: как компьютер может работать с текстом, если он оперирует только числами? Ответ прост: нам нужно превратить слова и предложения в числовые векторы. Этот процесс называется векторизацией текста, и он является основой практически любого алгоритма машинного обучения в NLP.

Классические методы: CountVectorizer и TF-IDF

Начнем с классики. Когда мы только начинали, мы активно использовали простые, но эффективные методы:

- CountVectorizer: Этот метод просто подсчитывает, сколько раз каждое слово встречается в документе. Он создает матрицу, где строки – это документы, а столбцы – уникальные слова в нашем корпусе, и на пересечении стоит количество вхождений. Это простой, но часто достаточно мощный подход для многих задач.

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): TF-IDF идет дальше. Он не просто считает частоту слова в документе (TF), но и учитывает, насколько это слово редко встречается во всём корпусе документов (IDF). Таким образом, слова, которые часто встречаются в одном документе, но редко в других, получают больший "вес". Это помогает выделить действительно важные слова и часто дает лучшие результаты, чем простой CountVectorizer, особенно для классификации и поиска. Мы часто используем TF-IDF для извлечения ключевых фраз и для задач классификации текстов.

Сравнение методов векторизации (TF-IDF vs Word2Vec) показывает, что классические методы хороши для задач, где важны индивидуальные слова и их частотность, но они не учитывают семантику и контекст.

Магия Word Embeddings: Word2Vec, GloVe и FastText

Революция в векторизации произошла с появлением Word Embeddings – распределенных представлений слов. Вместо того чтобы просто считать слова, мы теперь можем представлять их в виде плотных векторов в многомерном пространстве, где слова со схожим значением располагаются ближе друг к другу. Это открыло нам совершенно новые горизонты:

- Word2Vec (Gensim): Разработанный Google, Word2Vec позволяет обучать модели, которые предсказывают слово на основе его соседей (Skip-gram) или соседей на основе слова (CBOW). Мы используем Gensim для обучения Word2Vec на наших собственных корпусах текстов, что позволяет получать векторы, адаптированные под нашу предметную область. Это особенно полезно для анализа текстов отзывов клиентов, где может быть специфическая лексика. Сравнение моделей Word2Vec (Skip-gram vs CBOW) часто показывает, что Skip-gram лучше справляется с редкими словами, а CBOW быстрее обучается.

- GloVe (Global Vectors for Word Representation): GloVe, разработанный Стэнфордским университетом, также создает векторные представления слов, но делает это, анализируя глобальную статистику со-встречаемости слов в корпусе. Это альтернатива Word2Vec, которую мы также активно используем, особенно когда доступны предобученные на больших корпусах модели.

- FastText: От Facebook, FastText расширяет идею Word2Vec, представляя каждое слово как сумму векторов его n-грамм символов. Это позволяет ему лучше работать с редкими словами и даже со словами, которых не было в обучающем корпусе (out-of-vocabulary words), а также эффективно обрабатывать морфологически богатые языки, такие как русский. Мы часто используем FastText для работы с редкими словами и для анализа текстов, содержащих опечатки.

Эти методы позволили нам перейти от простой частотности к пониманию семантической близости слов, что значительно улучшило качество наших моделей.

От слов к предложениям и документам: Doc2Vec и Sentence Transformers

Векторы слов – это здорово, но что делать, если нам нужно получить векторное представление целого предложения или документа? Здесь на помощь приходят более продвинутые техники:

- Doc2Vec (Gensim): Расширение Word2Vec, которое позволяет создавать векторные представления не только для слов, но и для целых документов. Doc2Vec полезен для задач, таких как поиск похожих документов, кластеризация или классификация документов, где нам нужно понять общий смысл всего текста. Мы применяем Doc2Vec для представления целых документов и для анализа больших текстовых массивов.

- Sentence Transformers: Это относительно новая, но очень мощная парадигма. Sentence Transformers позволяют получать семантически значимые эмбеддинги для предложений и даже небольших абзацев. Они обучаются таким образом, чтобы предложения со схожим смыслом имели схожие векторы, что идеально подходит для задач поиска семантически похожих предложений, кластеризации комментариев или построения вопросно-ответных систем. Мы активно используем Sentence Transformers для векторизации предложений и документов, так как они дают очень качественные результаты.

Контекстные встраивания: Эра BERT и Flair

Истинным прорывом в векторизации стали контекстные встраивания, рожденные с появлением архитектуры Трансформеров. В отличие от Word2Vec или GloVe, где у каждого слова один фиксированный вектор, контекстные встраивания (например, в BERT) генерируют вектор для слова, который зависит от контекста, в котором оно используется. Это позволяет моделям различать значения омонимов (например, "коса" как прическа и "коса" как инструмент).

- BERT (Bidirectional Encoder Representations from Transformers): Разработанный Google, BERT стал настоящим гейм-ченджером. Он обучается на огромных объемах текста и способен понимать двунаправленный контекст слова. Мы используем BERT для задач классификации, NER, QA-систем и для тонкой настройки (Fine-tuning) предварительно обученных моделей под наши специфические задачи. Применение BERT для задачи NER даёт выдающиеся результаты.

- Flair: Библиотека Flair предоставляет отличные предобученные контекстные эмбеддинги для различных языков. Она особенно хороша для задач NER, POS-теггинга и классификации текста, предлагая state-of-the-art результаты с относительно меньшими усилиями. Мы используем библиотеку Flair для современного NER, а также для суммаризации.

Эти модели изменили наш подход к NLP, подняв планку качества и открыв путь к решению гораздо более сложных задач.

Разгадываем смысл: Основные задачи NLP на практике

После того как текст очищен и превращен в числовые векторы, мы можем приступить к решению конкретных задач. Именно здесь начинается настоящая магия NLP, позволяющая компьютерам "понимать" и "интерпретировать" человеческий язык. Мы пройдемся по наиболее востребованным и интересным задачам, с которыми сталкивались в нашей практике.

Распознавание именованных сущностей (NER) с spaCy и Flair

Одной из самых полезных задач NLP является Распознавание Именованных Сущностей (Named Entity Recognition, NER). Суть NER заключается в идентификации и классификации именованных сущностей в тексте, таких как имена людей, названия организаций, географические объекты, даты, суммы денег и т.д. Это крайне важно для извлечения структурированной информации из неструктурированного текста. Например, из новостной статьи мы можем автоматически извлечь, кто, где и когда совершил какое-либо действие.

- Использование spaCy для быстрого NER: spaCy – это высокопроизводительная библиотека для NLP на Python, которая предоставляет готовые, оптимизированные модели для NER. Мы активно используем spaCy благодаря её скорости и точности. Она позволяет нам быстро прототипировать решения и получать качественные результаты без глубокого погружения в обучение моделей. Реализация синтаксического парсинга с spaCy также помогает улучшить NER, предоставляя информацию о зависимостях слов.

- Библиотека Flair для современного NER: Как мы уже упоминали, Flair предлагает state-of-the-art эмбеддинги, которые значительно улучшают качество NER, особенно для языков с богатой морфологией. Мы используем Flair, когда требуется максимальная точность или когда работаем с данными, где spaCy не справляется достаточно хорошо.

- Применение CRF для распознавания сущностей: В некоторых случаях, когда у нас есть специфический набор сущностей или требуется большая гибкость, мы прибегаем к более классическим методам, таким как условные случайные поля (CRF). Они позволяют нам обучать собственные модели NER на размеченных данных, что особенно полезно для извлечения узкоспециализированных сущностей, например, из медицинских или юридических текстов.

Разработка системы для автоматической разметки сущностей – это важный этап для обучения собственных моделей.

Анализ тональности: От VADER до сложных эмоций

Анализ тональности (Sentiment Analysis) – это процесс определения эмоциональной окраски текста: является ли он позитивным, негативным или нейтральным. Это одна из самых популярных задач NLP, которая находит применение везде, от анализа отзывов клиентов до мониторинга социальных сетей. Мы используем анализ тональности для понимания общественного мнения, реакции на продукты и события.

- Анализ тональности (Sentiment Analysis) с VADER: Для быстрого и эффективного анализа тональности англоязычных текстов мы часто используем VADER (Valence Aware Dictionary and sEntiment Reasoner). Это правило-ориентированный анализатор, который не требует обучения и отлично справляется с текстами из социальных сетей, учитывая использование заглавных букв, пунктуации и эмотиконов.

- Использование TextBlob для простого NLP: TextBlob – это простая в использовании библиотека, которая предоставляет API для общих задач NLP, включая анализ тональности. Она удобна для быстрых прототипов, хотя для более сложных задач мы предпочитаем другие инструменты.

- Анализ тональности сообщений в социальных сетях (Twitter/Reddit) с учетом сарказма: Это одна из самых сложных задач. Сарказм и ирония могут полностью изменить смысл предложения, и традиционные методы анализа тональности часто терпят неудачу. Мы экспериментируем с продвинутыми моделями машинного обучения и глубокого обучения, а также с использованием контекстных эмбеддингов, чтобы улавливать эти тонкости. Применение Topic Modeling для анализа отзывов может помочь выявить скрытые темы и улучшить понимание тональности.

Анализ тональности финансовых новостей или отзывов о фильмах требует специфических моделей и словарей.

"Язык — это дорожная карта культуры. Он говорит нам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Тематическое моделирование: Погружение в Gensim (LDA, LSI)

Часто нам нужно понять, о чём говорят документы в большом корпусе, не читая каждый из них. Здесь на помощь приходит Тематическое Моделирование (Topic Modeling) – набор статистических алгоритмов, которые позволяют обнаруживать скрытые "темы" в коллекции документов. Каждая тема представлена набором слов, которые часто встречаются вместе.

- Библиотека Gensim для тематического моделирования (LDA, LSI): Gensim – это мощная и эффективная библиотека для тематического моделирования. Мы активно используем её для реализации таких алгоритмов, как:

- LDA (Latent Dirichlet Allocation): Один из самых популярных алгоритмов. Он предполагает, что каждый документ представляет собой смесь нескольких тем, а каждая тема – смесь слов.

- LSI (Latent Semantic Indexing): Более старый, но все еще полезный метод, основанный на сингулярном разложении (SVD) матрицы "слова-документы".

Тематическое моделирование незаменимо для анализа текстов из блогов и форумов, а также для автоматической категоризации статей.

Классификация текстов: Scikit-learn и нейросети

Классификация текстов – это задача присвоения тексту одной или нескольких категорий (меток). Это может быть определение спама, категоризация новостей по темам, определение языка текста, или классификация отзывов по продуктам. Это одна из самых распространенных задач, которую мы решаем.

- Применение Scikit-learn для классификации текстов: Scikit-learn – это наша рабочая лошадка для классического машинного обучения. Мы используем различные алгоритмы, такие как SVM (метод опорных векторов), наивный байесовский классификатор, логистическую регрессию. Сочетание TF-IDF векторизации и классификаторов из Scikit-learn часто дает отличные результаты для многих задач. Сравнение методов машинного обучения для NLP (SVM, наивный байесовский классификатор) помогает нам выбрать оптимальный алгоритм.

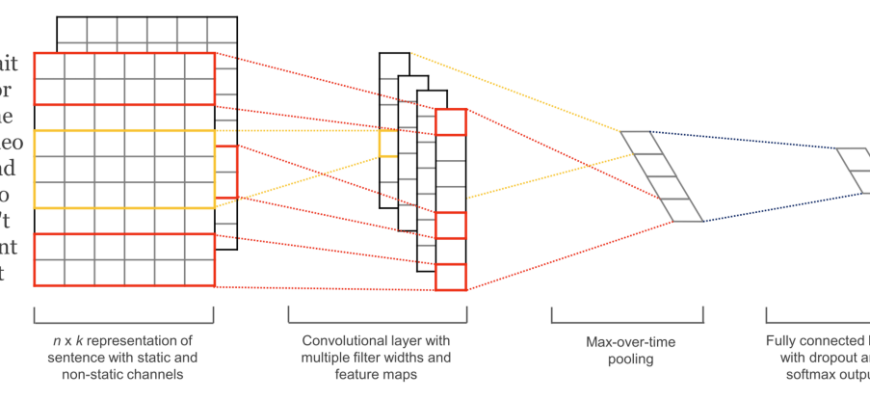

- Применение PyTorch/TensorFlow для создания нейросетей NLP: Для более сложных задач, где требуется уловить глубокие зависимости в тексте, мы переходим к глубокому обучению. PyTorch и TensorFlow – это фреймворки, которые позволяют нам строить и обучать нейронные сети, такие как LSTM (Long Short-Term Memory) или сверточные нейронные сети (CNN), для классификации текстов. Эти модели, особенно в сочетании с Word Embeddings или контекстными эмбеддингами, способны достигать очень высокой точности.

- Применение BERT для задач классификации: Как мы уже упоминали, тонкая настройка (Fine-tuning) предварительно обученных моделей BERT для задачи классификации часто дает наилучшие результаты, превосходя классические методы и даже более простые нейросети, поскольку BERT уже "понимает" язык.

Извлечение ключевых фраз: RAKE и TextRank

В длинных текстах часто бывает необходимо быстро понять их основное содержание. Для этого мы используем извлечение ключевых фраз – автоматический процесс идентификации наиболее важных слов или фраз, которые лучше всего характеризуют текст. Это полезно для создания тегов, суммаризации или индексации документов.

- Применение RAKE для извлечения ключевых слов: RAKE (Rapid Automatic Keyword Extraction) – это простой и эффективный алгоритм, который извлекает ключевые фразы, основываясь на частотности слов и их встречаемости с другими словами, игнорируя стоп-слова. Мы часто используем его для быстрого получения списка ключевых слов.

- Использование библиотеки TextRank для извлечения ключевых предложений и тем: TextRank – это алгоритм, основанный на PageRank (используется Google для ранжирования веб-страниц), адаптированный для текста. Он строит граф слов или предложений и ранжирует их по важности. Мы используем TextRank не только для извлечения ключевых слов, но и для "извлечения ключевых предложений", что является основой для экстрактивной суммаризации. Применение TextRank для выделения тем также очень эффективно.

Разработка системы для автоматического тегирования контента – это одно из наших любимых применений этих алгоритмов.

Суммаризация текста: От простого к абстрактному

В мире, где информации становится все больше, способность быстро получать суть длинных текстов бесценна. Суммаризация текста – это задача создания краткого, но информативного изложения длинного документа.

- Разработка системы суммаризации текста (Abstractive vs Extractive):

- Экстрактивная суммаризация: Это когда мы выбираем наиболее важные предложения из исходного текста и объединяем их в краткое изложение. TextRank, упомянутый выше, является отличным инструментом для этого.

- Абстрактивная суммаризация: Это гораздо более сложная задача, при которой модель генерирует новое резюме, перефразируя и обобщая информацию из исходного текста, подобно тому, как это делает человек.

За пределами основ: Продвинутые техники и инструменты

Мир NLP постоянно развивается, и за последние годы произошли революционные изменения, особенно с появлением архитектуры Трансформеров. Мы всегда стараемся быть в курсе последних тенденций и интегрировать их в нашу работу.

Трансформеры (Hugging Face) для сложных задач NLP

Мы уже упоминали Трансформеры в контексте BERT, но их влияние на NLP гораздо шире. Библиотека Hugging Face Transformers стала де-факто стандартом для работы с этими моделями. Она предоставляет доступ к сотням предобученных моделей (BERT, GPT, T5, RoBERTa и многие другие) для самых разных задач:

- Машинный перевод: Использование Transformer-моделей для машинного перевода значительно превзошло традиционные статистические и даже рекуррентные нейронные сети. Мы работаем над разработкой систем машинного перевода на Python, используя эти модели.

- Генерация текста: Модели, такие как GPT (Generative Pre-trained Transformer), способны генерировать связный и осмысленный текст по заданной затравке. Мы используем Transformer-модели для генерации текста, например, для создания черновиков статей, ответов в чат-ботах или даже кода.

- Вопросно-ответные системы (QA): Эти системы способны отвечать на вопросы, основываясь на предоставленном тексте. Трансформеры значительно улучшили качество QA-систем, позволяя им находить точные ответы даже в больших документах. Мы активно занимаемся "разработкой систем вопросно-ответных систем (QA)".

- Генерация диалогов и чат-боты: Модели Трансформеров также используются для создания более естественных и контекстно-зависимых чат-ботов. Разработка чат-ботов на Python (Rasa framework) в сочетании с Трансформерами открывает новые возможности.

Мультиязычный NLP: Stanza и Polyglot

Работа с текстами на разных языках представляет свои уникальные вызовы, особенно когда речь идет о языках с богатой морфологией или нелатинскими алфавитами. Мы не ограничиваемся только английским или русским.

- Использование Stanza для языков с богатой морфологией: Stanza – это библиотека NLP от Стэнфордского университета, которая предоставляет готовые нейронные сети для анализа более 70 языков. Она включает токенизацию, POS-теггинг, лемматизацию и синтаксический анализ, что делает её незаменимой для обработки многоязычных текстовых корпусов. Особенно ценно её "использование Stanza для русского языка", так как она хорошо справляется с его сложной грамматикой.

- Применение Polyglot для мультиязычности: Polyglot – еще одна полезная библиотека для работы с множеством языков. Она предоставляет инструменты для токенизации, NER, определения языка и анализа тональности для большого количества языков, включая редкие. Мы используем библиотеку Polyglot для мультиязычности, когда нам нужно быстро получить базовый анализ для малоресурсных языков.

Работа с нелатинскими алфавитами в Python NLP требует особого внимания к кодировкам и шрифтам, но современные библиотеки справляются с этим очень хорошо.

Веб-скрейпинг для данных: Beautiful Soup

Чтобы анализировать текст, его сначала нужно откуда-то получить. Часто источником становятся веб-страницы. Для этого мы используем веб-скрейпинг.

- Библиотека Beautiful Soup для веб-скрейпинга текста: Beautiful Soup – это наша любимая библиотека для парсинга HTML и XML документов. Она позволяет легко извлекать нужные фрагменты текста, ссылки, изображения и другие данные с веб-страниц. В сочетании с библиотекой

requestsдля получения содержимого страницы, Beautiful Soup становится мощным инструментом для сбора данных для наших NLP-проектов. - Использование PyMuPDF для извлечения текста из PDF: Помимо веб-страниц, часто приходится извлекать текст из PDF-документов. PyMuPDF – это эффективная библиотека для этой задачи, позволяющая извлекать текст, изображения и метаданные из PDF. Мы используем PyMuPDF для извлечения текста из PDF, что особенно актуально для анализа юридических или научных документов.

Анализ стилистики и авторского почерка

Иногда задача NLP выходит за рамки простого понимания смысла. Мы можем захотеть понять, кто написал текст или каков его стиль.

- Анализ стилистики текстов (авторский почерк): Это увлекательная область, где мы пытаемся идентифицировать автора текста или определить его уникальный стиль. Мы анализируем такие метрики, как частотность слов и n-грамм, длину предложений, использование пунктуации, лексическое богатство текстов и даже синтаксические структуры. Разработка системы для определения авторства текста – это сложная, но крайне интересная задача, которая имеет применение в криминалистике, литературоведении и журналистике.

- Анализ частотности слов и n-грамм: Это базовый, но очень информативный метод для анализа стилистики. Мы можем сравнивать, какие слова и последовательности слов (n-граммы) чаще использует один автор по сравнению с другим.

Работа с большими текстовыми массивами (Big Data NLP)

Когда речь идет о миллиардах документов, стандартные подходы могут быть неэффективны. Мы сталкивались с задачами, где объем данных требовал специальных решений.

- Обработка больших текстовых массивов (Big Data NLP): Для таких задач мы используем распределенные вычислительные системы, такие как Apache Spark, и специальные библиотеки, оптимизированные для работы с большими данными. Например, Gensim, о котором мы говорили, хорошо масштабируется для обучения моделей Word2Vec на больших корпусах.

- Обработка текста в режиме реального времени (Streaming NLP): Для анализа потоковых данных, например, сообщений в социальных сетях, мы разрабатываем системы, способные обрабатывать текст "на лету". Это требует эффективных алгоритмов и оптимизированных моделей, способных работать с низкой задержкой.

Оценка и сравнение: Выбираем лучшее решение

В мире NLP существует множество алгоритмов и моделей для решения одной и той же задачи. Как нам выбрать лучший? Ответ кроется в тщательной оценке и сравнении. Мы никогда не принимаем решение о выборе модели, не проверив её эффективность на реальных данных.

Метрики качества: F1-score, Precision, Recall

Для оценки качества наших моделей мы используем стандартные метрики из области машинного обучения:

- Precision (Точность): Доля правильно предсказанных положительных классов от всех предсказанных положительных классов.

- Recall (Полнота): Доля правильно предсказанных положительных классов от всех фактических положительных классов.

- F1-score: Гармоническое среднее Precision и Recall, которое является хорошим индикатором общей производительности модели, особенно когда классы несбалансированы.

Оценка качества NER-моделей (F1-score, Precision, Recall) – это стандартная процедура для нас. Мы также используем эти метрики для классификации текстов, распознавания эмоций и других задач.

Сравнение методов: LDA vs NMF, Word2Vec Skip-gram vs CBOW

Как мы уже упоминали, мы постоянно сравниваем различные подходы:

- Сравнение моделей тематического моделирования (LDA vs NMF): Позволяет нам понять, какой алгоритм лучше выявляет скрытые темы в конкретном корпусе текстов.

- Сравнение моделей Word2Vec (Skip-gram vs CBOW): Помогает выбрать оптимальную архитектуру для обучения векторных представлений слов.

- Сравнение методов векторизации (TF-IDF vs Word2Vec): Демонстрирует, когда простые частотные методы достаточны, а когда необходимо использовать семантические эмбеддинги.

- Сравнение различных методов лемматизации (SpaCy vs NLTK): Помогает выбрать наиболее точный лемматизатор для конкретного языка и задачи.

- Сравнение алгоритмов кластеризации (K-Means vs DBSCAN): Используется, когда мы применяем методы машинного обучения без учителя для анализа текстовых данных, например, для кластеризации отзывов о продуктах по категориям.

Наши собственные NLP-проекты: Что дальше?

Наш опыт показывает, что самые интересные проекты рождаются на стыке существующих технологий и уникальных потребностей. Мы постоянно разрабатываем собственные инструменты и системы, опираясь на описанные выше методы.

Разработка инструментов для проверки грамматики и орфографии

Кто из нас не допускал опечаток? Автоматическая проверка грамматики и орфографии – это очень востребованная функция. Мы работаем над "разработкой инструментов для проверки грамматики" и "инструмента для исправления орфографии", используя морфологический анализ, языковые модели и методы глубокого обучения. Это не только улучшает качество текста, но и помогает в предобработке данных, снижая "шум".

Системы обнаружения плагиата и факт-чекинга

В мире контента проблема плагиата и фейковых новостей стоит остро. Мы активно исследуем "разработку систем обнаружения плагиата", используя методы сравнения строк (например, с библиотекой Jellyfish или Textdistance для измерения сходства), векторизацию документов и поиск ближайших соседей. "Разработка инструмента для проверки фактов (Fact-Checking)" – это еще более сложная задача, требующая не только анализа текста, но и интеграции с базами знаний и внешними источниками информации. Это требует выявления связей между сущностями и анализа тональности в постах о политике, где могут быть предвзятости.

Анализ юридических и медицинских документов

Эти области требуют особой точности и понимания специфической терминологии. Мы применяем NLP для "анализа юридических документов" и "анализа текста в медицинских записях" для извлечения ключевых дат, сущностей, условий контрактов или диагнозов. Это помогает автоматизировать рутинные задачи, повысить эффективность и снизить риск человеческой ошибки. Для этого мы часто создаем собственные словари и тезаурусы.

Мы прошли с вами долгий, но, надеемся, увлекательный путь по самым разным аспектам Обработки Естественного Языка на Python. От базовой токенизации и стемминга до сложных трансформерных моделей и специализированных приложений – мы постарались охватить весь спектр возможностей, которые открывает перед нами эта удивительная область. Наш опыт показывает, что нет единого "лучшего" инструмента или алгоритма; успех кроется в глубоком понимании задачи, гибком выборе и комбинации различных подходов, а также в постоянном обучении и экспериментировании.

Каждый новый проект – это новая головоломка, и каждый раз, когда мы видим, как компьютер "понимает" человеческий язык, мы испытываем удовлетворение и предвкушение новых открытий. Мир NLP постоянно эволюционирует, появляются новые модели, методы и библиотеки. Это бесконечный процесс обучения, и мы приглашаем вас присоединиться к нему. Надеемся, что эта статья стала для вас не просто источником информации, но и вдохновением для ваших собственных проектов. Помните, что каждый из нас способен не только потреблять информацию, но и создавать новые, умные системы, которые изменят наш мир к лучшему. Вперёд, к новым вершинам в мире NLP!

Подробнее

| 1 | 2 | 3 | 4 | 5 |

|---|---|---|---|---|

| NLP Python | Обработка текста | Машинное обучение текста | Библиотеки NLP | Токенизация |

| Векторизация | Анализ тональности | NER | Тематическое моделирование | Трансформеры |