- Python и NLP: Наш Путь от Сырых Текстов к Глубоким Смыслам

- Первые Шаги: От Сырого Текста к Понятным Блокам

- Токенизация и Стемминг: Разбираем Слова по Косточкам

- Лемматизация: Точность во всем

- Мощные Инструменты для Глубокого Анализа: spaCy‚ Gensim и Scikit-learn

- spaCy: Скорость и Точность NER

- Gensim: Открываем Скрытые Темы в Текстах

- Scikit-learn: Классификация Текстов – Наш Выбор

- Векторное Представление Текста: От Слов к Числам

- Разработка Собственных Векторизаторов: CountVectorizer и TfidfVectorizer

- Word Embeddings: Слово – Это Вектор‚ а Вектор – Это Смысл

- Векторизация Предложений и Документов: Beyond Words

- Глубокий Анализ и Современные Подходы

- Анализ Тональности (Sentiment Analysis): Чувства в Тексте

- Трансформеры (Hugging Face): Новый Уровень Понимания

- PyTorch/TensorFlow: Создание Нейросетей NLP

- Практические Применения и Нишевые Задачи

- Извлечение Информации и Ключевые Фразы

- Работа с Неструктурированным Текстом и Очистка Данных

- Мультиязычный NLP и Редкие Языки

- Специализированные Приложения

- Оценка‚ Сравнение и Будущее NLP

- Метрики и Сравнение Моделей

- Визуализация и Анализ Данных

- NLP в Режиме Реального Времени и Big Data

Python и NLP: Наш Путь от Сырых Текстов к Глубоким Смыслам

Привет‚ дорогие читатели и коллеги-энтузиасты! Сегодня мы отправляемся в увлекательное путешествие по миру Обработки Естественного Языка (NLP) с нашим верным спутником – языком Python. Мы знаем‚ что текст окружает нас повсюду: от сообщений в мессенджерах до многостраничных юридических документов‚ от твитов до научных статей. И задача сделать этот бескрайний океан слов понятным для машин‚ извлечь из него ценные знания и даже заставить компьютеры генерировать осмысленные тексты – это именно то‚ чем занимается NLP.

Наш опыт показывает‚ что вход в эту область может показаться daunting из-за обилия библиотек‚ алгоритмов и концепций. Но не волнуйтесь! Мы здесь‚ чтобы провести вас шаг за шагом‚ показать‚ как мощные инструменты Python позволяют нам превращать хаотичные наборы символов в структурированные данные‚ выявлять скрытые закономерности и даже обучать машины понимать человеческую речь. Приготовьтесь‚ ведь мы собираемся разобрать все от основ токенизации до хитросплетений глубоких нейронных сетей и трансформеров!

За годы практики мы убедились‚ что NLP – это не просто набор технических приемов. Это искусство понимания языка‚ его тонкостей‚ нюансов и контекста. И Python предоставляет нам идеальный набор кистей и красок для этого творчества. Мы будем делиться не только теоретическими знаниями‚ но и нашим личным опытом‚ подводными камнями и эффективными решениями‚ которые мы нашли на этом пути.

Первые Шаги: От Сырого Текста к Понятным Блокам

Прежде чем мы сможем заставить компьютер "понять" текст‚ нам нужно его подготовить. Представьте‚ что у нас есть огромный объем текста‚ например‚ тысячи отзывов клиентов. Это просто длинные строки символов. Чтобы начать работать с ними‚ нам необходимо разбить их на более мелкие‚ осмысленные единицы. Именно здесь в игру вступают токенизация и стемминг.

Мы часто начинаем с библиотеки NLTK (Natural Language Toolkit)‚ которая является настоящим швейцарским армейским ножом для базовых задач NLP. NLTK предоставляет нам простой и интуитивно понятный способ для токенизации – процесса разбиения текста на слова или предложения. Например‚ фраза "Мы любим NLP!" может быть разбита на токены "Мы"‚ "любим"‚ "NLP"‚ "!". Казалось бы‚ мелочь‚ но это фундаментальный шаг‚ который позволяет нам считать слова‚ анализировать их порядок и многое другое.

Токенизация и Стемминг: Разбираем Слова по Косточкам

После токенизации мы сталкиваемся с другой проблемой: одно и то же слово может иметь разные формы. Например‚ "бегать"‚ "бежит"‚ "бежал" – все они относятся к одному корню. Здесь нам на помощь приходит стемминг‚ процесс сокращения слов до их базовой формы или "корня"‚ даже если этот корень не является настоящим словом. NLTK предлагает несколько стеммеров‚ таких как Портер или Сноуболл‚ каждый со своими особенностями.

Мы используем стемминг‚ когда нам важна только общая идея слова‚ а не его грамматическая форма. Например‚ при поиске документов или анализе частотности слов‚ где "бегать" и "бежал" должны считаться одним и тем же. Однако‚ стоит отметить‚ что стемминг иногда может быть слишком агрессивным‚ обрезая слова до неузнаваемости. Вот почему существуют более продвинутые методы‚ о которых мы поговорим чуть позже.

"Язык – это лабиринт путей. Вы приближаетесь с одной стороны и знаете‚ где вы находитесь‚ вы приближаетесь с другой стороны и знаете‚ где вы находитесь‚ но это все тот же лабиринт."

— Людвиг Витгенштейн

Лемматизация: Точность во всем

В отличие от стемминга‚ лемматизация стремится привести слово к его словарной или канонической форме (лемме) с учетом морфологического анализа. То есть "бегал"‚ "бежит"‚ "бегущий" будут приведены к "бегать". Это гораздо точнее и предпочтительнее в случаях‚ когда нам нужна семантическая и грамматическая корректность. Мы обычно используем WordNetLemmatizer из NLTK или более продвинутые лемматизаторы‚ предоставляемые такими библиотеками‚ как spaCy или Stanza‚ особенно для языков с богатой морфологией‚ как русский.

Мы всегда тщательно выбираем между стеммингом и лемматизацией‚ исходя из конкретной задачи. Для быстрого анализа больших объемов текста‚ где небольшие потери точности допустимы‚ стемминг может быть достаточен. Но для задач‚ требующих глубокого понимания контекста и грамматики‚ таких как машинный перевод или вопросно-ответные системы‚ лемматизация – наш выбор.

Мощные Инструменты для Глубокого Анализа: spaCy‚ Gensim и Scikit-learn

Когда речь заходит о более сложных задачах‚ таких как распознавание именованных сущностей (NER)‚ тематическое моделирование или классификация текстов‚ мы обращаемся к специализированным и высокопроизводительным библиотекам. Эти инструменты выходят за рамки базовой предобработки и позволяют нам извлекать из текста гораздо более глубокие инсайты.

spaCy: Скорость и Точность NER

spaCy – это не просто библиотека‚ это целая экосистема для промышленного NLP. Мы ценим её за невероятную скорость и высокую точность‚ особенно когда дело доходит до распознавания именованных сущностей (NER). NER позволяет нам автоматически находить и классифицировать сущности в тексте‚ такие как имена людей‚ организации‚ местоположения‚ даты и денежные суммы. Например‚ в предложении "Джон Смит из Google посетил Лондон 15 июля" spaCy легко выделит "Джон Смит" как PERSON‚ "Google" как ORG‚ "Лондон" как GPE (геополитическая сущность) и "15 июля" как DATE.

Мы используем spaCy в проектах‚ где нужна высокая производительность и надёжность. Его предварительно обученные модели для разных языков‚ включая русский‚ делают его незаменимым инструментом для быстрого прототипирования и развертывания. Кроме NER‚ spaCy также предоставляет возможности для:

- Токенизации и лемматизации с учетом контекста.

- Определения частей речи (POS-теггинг).

- Синтаксического парсинга для понимания структуры предложений.

- Векторизации слов‚ о которой мы поговорим позже.

Мы обнаружили‚ что для проектов‚ требующих высокой скорости обработки и точности‚ spaCy является одним из лучших решений на рынке.

Gensim: Открываем Скрытые Темы в Текстах

Когда перед нами встает задача понять‚ о каких основных темах идет речь в большом корпусе документов‚ мы обращаемся к библиотеке Gensim. Gensim специализируется на тематическом моделировании‚ позволяя нам обнаруживать скрытые абстрактные "темы"‚ которые присутствуют в наборе документов. Наиболее известные алгоритмы‚ которые мы используем‚ это LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing).

Представьте‚ что у нас есть тысячи новостных статей. Вручную классифицировать их по темам (политика‚ спорт‚ экономика) было бы крайне трудоёмко. Gensim позволяет нам автоматически выявить эти темы‚ представив каждый документ как смесь нескольких тем‚ а каждую тему – как набор слов с определенными вероятностями. Это бесценно для анализа больших текстовых массивов‚ таких как отзывы клиентов‚ научные публикации или новостные ленты.

| Характеристика | LDA (Latent Dirichlet Allocation) | LSI (Latent Semantic Indexing) |

|---|---|---|

| Основа | Вероятностная модель‚ байесовский подход. | Матричное разложение (SVD). |

| Интерпретируемость тем | Темы более легко интерпретируются как наборы связанных слов. | Темы могут быть менее интуитивно понятными. |

| Работа с синонимами/полисемией | Учитывает контекст‚ может разделять значения. | Может объединять синонимы‚ но не всегда различает полисемию. |

| Скорость обучения | Может быть медленнее для больших корпусов. | Обычно быстрее. |

| Применение | Обнаружение скрытых тем‚ рекомендательные системы. | Поиск информации‚ уменьшение размерности. |

Gensim также широко используется нами для работы с Word Embeddings (Word2Vec‚ GloVe‚ FastText)‚ которые являются краеугольным камнем современного NLP. Мы поговорим о них подробнее в следующем разделе‚ но уже сейчас отметим‚ что Gensim позволяет нам обучать и использовать эти векторные представления слов‚ которые улавливают семантические отношения между словами.

Scikit-learn: Классификация Текстов – Наш Выбор

Для задач классификации текстов‚ таких как определение спама‚ категоризация новостей или анализ тональности‚ мы неизменно обращаемся к библиотеке Scikit-learn. Это мощный и универсальный инструмент для машинного обучения‚ который предоставляет широкий спектр алгоритмов классификации‚ регрессии‚ кластеризации и уменьшения размерности.

Наш типичный рабочий процесс включает следующие этапы:

- Предобработка текста: токенизация‚ лемматизация‚ удаление стоп-слов.

- Векторизация текста: преобразование текста в числовые векторы с использованием таких методов‚ как CountVectorizer или TfidfVectorizer (о которых мы подробно расскажем ниже).

- Обучение модели: применение классических алгоритмов машинного обучения‚ таких как Наивный Байесовский классификатор‚ SVM (Support Vector Machine)‚ Логистическая регрессия.

- Оценка модели: использование метрик‚ таких как точность (accuracy)‚ полнота (recall)‚ F1-мера.

Мы часто начинаем с простого Наивного Байесовского классификатора для базовой классификации‚ а затем переходим к SVM или другим более сложным моделям‚ если требуется большая точность. Scikit-learn предоставляет нам все необходимые инструменты для создания надёжных и масштабируемых систем классификации текста.

Векторное Представление Текста: От Слов к Числам

Компьютеры не "понимают" слова в том смысле‚ в каком понимаем их мы. Для них это просто последовательности символов. Чтобы машины могли работать с текстом‚ нам нужно преобразовать его в числовой формат – векторы. Это один из самых критически важных этапов в NLP‚ поскольку качество векторного представления напрямую влияет на производительность наших моделей.

Разработка Собственных Векторизаторов: CountVectorizer и TfidfVectorizer

Начнем с классических методов векторизации‚ которые мы часто используем с Scikit-learn.

- CountVectorizer: Этот векторизатор создает матрицу‚ где каждая строка соответствует документу‚ а каждый столбец – уникальному слову (токену) во всем корпусе. Значение в ячейке – это количество раз‚ сколько данное слово встречается в данном документе. Это простой‚ но эффективный способ представления текста.

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): TF-IDF – это более продвинутый метод. Он не просто считает частоту слова‚ но и учитывает его важность в документе относительно всего корпуса. Слова‚ которые часто встречаются в одном документе‚ но редко во всем корпусе‚ получают высокий вес. И наоборот‚ очень частые слова (например‚ "и"‚ "в"‚ "на") получают низкий вес‚ так как они не несут много уникальной информации. Мы применяем TF-IDF‚ когда хотим выделить наиболее значимые слова в каждом документе‚ отфильтровывая "шум".

Мы часто сравниваем эти два метода‚ и наш опыт показывает‚ что TF-IDF обычно дает лучшие результаты в задачах классификации‚ поскольку он лучше отражает уникальность и важность слов.

Word Embeddings: Слово – Это Вектор‚ а Вектор – Это Смысл

Современный NLP сделал гигантский скачок с появлением Word Embeddings (векторных представлений слов). Это плотные векторные представления‚ которые захватывают семантические и синтаксические отношения между словами. Идея проста‚ но гениальна: слова‚ которые часто встречаются в похожих контекстах‚ имеют схожие векторные представления. Это позволяет нам выполнять математические операции над словами‚ например‚ "король — мужчина + женщина = королева".

Мы активно используем различные модели Word Embeddings:

- Word2Vec: Разработанный Google‚ этот алгоритм (Skip-gram и CBOW) позволяет нам обучать векторные представления слов на огромных текстовых корпусах. Gensim предоставляет отличную реализацию Word2Vec.

- GloVe (Global Vectors for Word Representation): Разработанный в Стэнфорде‚ GloVe сочетает в себе глобальную статистику со статистикой локального окна контекста.

- FastText: Разработанный Facebook‚ FastText является расширением Word2Vec‚ который учитывает подслова (символьные n-граммы). Это делает его особенно эффективным для работы с редкими словами и языками с богатой морфологией‚ где слова могут иметь много флексий. Мы часто используем FastText для русского языка и других языков с большим количеством словоформ.

Использование предварительно обученных Word Embeddings (например‚ на Википедии или больших новостных корпусах) значительно ускоряет разработку и улучшает качество моделей‚ поскольку они уже "знают" о смысле слов.

Векторизация Предложений и Документов: Beyond Words

Помимо отдельных слов‚ нам часто требуется получить векторное представление целых предложений или даже документов. Здесь на помощь приходят:

- Doc2Vec (Paragraph Vector): Расширение Word2Vec‚ которое позволяет нам получать векторные представления для целых документов. Это очень полезно для задач‚ таких как поиск похожих документов или кластеризация.

- Sentence Transformers: Это относительно новая‚ но очень мощная группа моделей‚ основанных на архитектуре трансформеров‚ которые позволяют нам получать высококачественные векторные представления предложений. Они отлично подходят для задач семантического поиска‚ кластеризации и сравнения предложений по смыслу.

Мы активно используем эти методы‚ когда нам нужно измерить сходство между текстами или подать целый текст на вход нейронной сети.

Глубокий Анализ и Современные Подходы

Наш путь в NLP не ограничивается только классическими методами. Современные достижения в области глубокого обучения произвели революцию в этой сфере‚ открыв двери для решения задач‚ которые раньше казались неразрешимыми. Мы активно используем эти новые подходы в наших проектах.

Анализ Тональности (Sentiment Analysis): Чувства в Тексте

Понимание эмоциональной окраски текста – это одна из самых востребованных задач NLP. Будь то отзывы клиентов‚ сообщения в социальных сетях или новостные заголовки‚ знание тональности позволяет нам принимать более обоснованные решения. Мы используем несколько подходов для анализа тональности:

- VADER (Valence Aware Dictionary and sEntiment Reasoner): Это правиловой подход‚ основанный на лексиконе‚ который хорошо работает для текстов из социальных сетей. Он учитывает не только слова‚ но и такие факторы‚ как использование заглавных букв‚ восклицательных знаков и смайликов. Мы часто начинаем с VADER для быстрой оценки тональности‚ особенно для англоязычных текстов.

- TextBlob: Это простая в использовании библиотека‚ которая предоставляет интерфейс для выполнения базовых задач NLP‚ включая анализ тональности. Она работает на основе лексикона и обучаемых моделей. Мы используем TextBlob для быстрого прототипирования и простых задач‚ хотя для более сложных случаев она может быть ограничена.

- Модели машинного обучения и глубокого обучения: Для более сложных задач и многоязычного анализа мы обучаем собственные модели‚ используя Scikit-learn или фреймворки глубокого обучения‚ такие как PyTorch/TensorFlow‚ на размеченных данных. Это позволяет нам учитывать специфику предметной области и повышать точность.

Особый вызов для нас представляет анализ тональности в социальных сетях с учетом сарказма. Здесь требуются более сложные модели‚ способные улавливать тонкие нюансы языка и контекст‚ часто с использованием трансформеров.

Трансформеры (Hugging Face): Новый Уровень Понимания

С появлением архитектуры Трансформеров и библиотеки Hugging Face Transformers‚ мы вошли в новую эру NLP. Эти модели‚ такие как BERT‚ GPT‚ RoBERTa и многие другие‚ обучены на огромных объемах текста и способны выполнять широкий спектр задач с беспрецедентной точностью. Они понимают контекст слова не только на основе ближайших соседей‚ но и всего предложения или даже документа.

Мы используем Hugging Face Transformers для:

- NER (Распознавание именованных сущностей): Трансформеры значительно превосходят классические подходы в этой задаче.

- Классификации текстов: От определения спама до категоризации документов. Мы часто тонко настраиваем (Fine-tuning) предварительно обученные модели на наших собственных данных.

- Вопросно-ответных систем (QA): Модели могут находить ответы на вопросы непосредственно в тексте или даже генерировать их.

- Суммаризации текста: Как экстрактивной (извлечение ключевых предложений)‚ так и абстрактивной (генерация нового‚ сокращенного текста).

- Машинного перевода: Трансформеры стали стандартом де-факто в этой области.

- Генерации текста: Такие модели‚ как GPT‚ способны создавать связные и осмысленные тексты по заданному началу.

Работа с трансформерами требует больше вычислительных ресурсов (часто с использованием GPU)‚ но результаты оправдывают вложения. Мы активно применяем BERT для задач классификации и NER‚ а также экспериментируем с Transformer-моделями для генерации диалогов и кода.

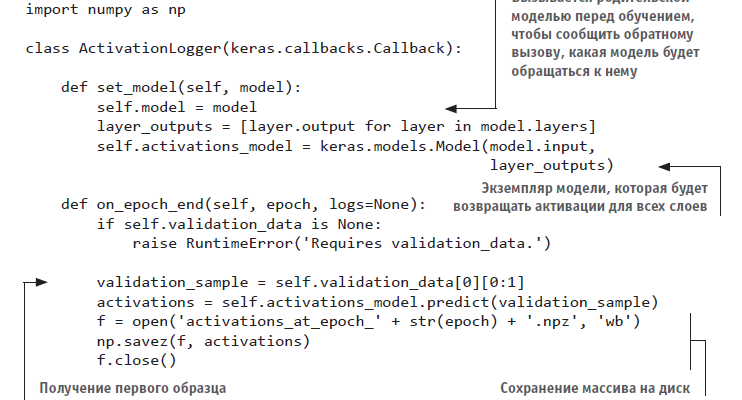

PyTorch/TensorFlow: Создание Нейросетей NLP

Для создания собственных‚ более специализированных нейронных сетей для NLP мы используем фреймворки PyTorch и TensorFlow/Keras. Эти библиотеки предоставляют гибкость для проектирования и обучения сложных архитектур‚ таких как LSTM-сети (Long Short-Term Memory)‚ которые исторически были очень эффективны для последовательных данных‚ таких как текст‚ до появления трансформеров.

Мы обращаемся к PyTorch или TensorFlow‚ когда:

- Нам нужна специфическая архитектура‚ которой нет в готовых библиотеках.

- Мы работаем с нестандартными типами данных или задачами.

- Требуется глубокий контроль над процессом обучения и оптимизации.

Хотя трансформеры часто являются отправной точкой‚ понимание основ PyTorch/TensorFlow позволяет нам создавать по-настоящему кастомные и инновационные решения.

Практические Применения и Нишевые Задачи

NLP – это не только теоретические изыскания‚ но и мощный инструмент для решения реальных бизнес-задач. На протяжении нашей практики мы сталкивались с множеством интересных применений‚ требующих специализированных подходов и библиотек.

Извлечение Информации и Ключевые Фразы

Одна из наиболее частых задач – это извлечение ключевых фраз и важной информации из больших объемов текста.

- RAKE (Rapid Automatic Keyword Extraction): Мы используем RAKE для быстрого извлечения ключевых слов и фраз из текста без предварительной тренировки. Это простой‚ но эффективный алгоритм‚ основанный на статистике.

- TextRank: Это алгоритм‚ основанный на PageRank (алгоритме Google для ранжирования веб-страниц)‚ который мы применяем для извлечения ключевых предложений и слов из текста. Он строит граф слов или предложений и ранжирует их по важности. Мы используем TextRank для суммаризации и выделения тем в тексте.

- Textacy: Эта библиотека предоставляет более продвинутые инструменты для извлечения информации‚ включая именованные сущности‚ n-граммы и ключевые фразы‚ а также для работы с синтаксическими зависимостями.

Помимо этого‚ мы разрабатываем системы для извлечения дат и чисел‚ выявления связей между сущностями и автоматической категоризации статей‚ что является основой для многих систем управления контентом.

Работа с Неструктурированным Текстом и Очистка Данных

Реальный мир редко предоставляет нам идеально чистые данные. Обработка неструктурированного текста часто начинается с тщательной очистки данных. Мы регулярно сталкиваемся с:

- HTML-тегами: Для их удаления мы часто используем библиотеку Beautiful Soup‚ которая изначально предназначена для веб-скрейпинга‚ но прекрасно справляется с парсингом HTML и извлечением чистого текста.

- Пунктуацией и стоп-словами: Разрабатываем инструменты для нормализации пунктуации и удаления стоп-слов‚ которые не несут семантической нагрузки (например‚ "и"‚ "или"‚ "но").

- Сленгом и эмодзи: Это особенно актуально для анализа социальных сетей. Мы создаем собственные словари и инструменты для нормализации сленга и обработки эмодзи‚ которые могут нести значительную эмоциональную нагрузку.

- Орфографическими ошибками: Разрабатываем инструменты для исправления орфографии‚ что критически важно для качества анализа.

Проблемы обработки неполных и ошибочных данных – это наша повседневная реальность‚ и мы постоянно ищем новые способы сделать наши пайплайны более надёжными.

Мультиязычный NLP и Редкие Языки

Работаем не только с английским и русским языками. Для обработки многоязычных текстовых корпусов мы используем:

- Polyglot: Универсальная библиотека для многоязычного NLP‚ поддерживающая токенизацию‚ NER‚ анализ тональности для множества языков. Мы используем её для анализа редких языков‚ где нет специализированных моделей.

- Stanza: Разработанная в Стэнфорде‚ Stanza (ранее StanfordNLP) предоставляет высококачественные модели для многих языков‚ включая русский‚ с поддержкой токенизации‚ POS-теггинга‚ лемматизации и синтаксического парсинга. Она особенно полезна для языков с богатой морфологией.

- Библиотека Flair: Ещё один мощный инструмент для современного NER и других задач‚ который хорошо работает с мультиязычными моделями и контекстными эмбеддингами.

Работа с нелатинскими алфавитами и разработка систем машинного перевода для узкоспециализированных текстов также являются частью нашей работы.

Специализированные Приложения

Наш опыт включает разработку решений для очень специфических областей:

- Анализ юридических документов: Извлечение ключевых условий‚ дат‚ сторон из контрактов с использованием Python и NLP.

- Анализ медицинских записей: Помощь в извлечении диагнозов‚ процедур‚ симптомов из неструктурированных медицинских текстов.

- Разработка чат-ботов: Используем фреймворк Rasa для создания интеллектуальных разговорных агентов.

- Разработка систем обнаружения плагиата: Сравнение документов с использованием методов векторизации и метрик сходства‚ например‚ с библиотекой Jellyfish для сравнения строк.

- Анализ стилистики текстов (авторский почерк): Определение авторства на основе уникальных лингвистических паттернов.

- Разработка системы суммаризации текста: Создание как экстрактивных‚ так и абстрактивных суммаризаторов для больших документов.

- Создание словарей и тезаурусов: Для улучшения качества семантического поиска и расширения словарного запаса наших моделей.

Мы даже работали с анализом тональности финансовых новостей‚ где важен не только сам тон‚ но и его влияние на рынок.

Оценка‚ Сравнение и Будущее NLP

В мире NLP постоянно появляются новые модели и методы. Наша задача – не только быть в курсе последних тенденций‚ но и уметь эффективно оценивать и сравнивать различные подходы‚ чтобы выбрать наиболее подходящий для конкретной задачи.

Метрики и Сравнение Моделей

Мы всегда уделяем большое внимание оценке качества наших NLP-моделей. Для задач классификации мы используем такие метрики‚ как:

- Precision (точность): Доля правильно предсказанных положительных классов от всех предсказанных положительных.

- Recall (полнота): Доля правильно предсказанных положительных классов от всех фактических положительных.

- F1-score: Гармоническое среднее между Precision и Recall‚ особенно полезно при несбалансированных классах.

Для NER-моделей эти метрики также являются стандартом. Мы постоянно сравниваем эффективность различных токенизаторов‚ методов лемматизации (SpaCy vs NLTK) и методов векторизации (TF-IDF vs Word2Vec)‚ а также моделей тематического моделирования (LDA vs NMF)‚ чтобы понять‚ какой подход лучше всего подходит для наших данных.

Наш опыт показывает‚ что выбор правильной метрики и тщательное тестирование на разнообразных наборах данных – это ключ к созданию надёжных систем;

Визуализация и Анализ Данных

Понимание текстовых данных не всегда возможно только через числа. Инструменты для визуализации текстовых данных помогают нам увидеть паттерны‚ которые иначе остались бы незамеченными.

- Word Clouds: Простой‚ но эффективный способ визуализации частотности слов.

- Heatmaps: Для отображения корреляций или распределения тем.

- Библиотека Sweetviz: Может помочь в автоматическом анализе и визуализации текстовых данных‚ выявляя скрытые зависимости.

Мы также проводим анализ частотности слов и n-грамм‚ чтобы выявить наиболее значимые термины и фразы‚ а также анализ временных рядов в текстовых данных для обнаружения сезонности или трендов в упоминаниях определенных тем или настроений.

NLP в Режиме Реального Времени и Big Data

С развитием технологий и увеличением объемов данных‚ мы все чаще сталкиваемся с необходимостью обработки текста в режиме реального времени (Streaming NLP). Это требует оптимизированных алгоритмов и эффективного использования ресурсов‚ часто с GPU-ускорением.

Для обработки больших текстовых массивов (Big Data NLP) мы используем такие библиотеки‚ как Gensim‚ оптимизированные для работы с крупными корпусами‚ и интегрируем наши решения с распределёнными вычислительными платформами. Это позволяет нам анализировать терабайты текстовых данных‚ извлекая из них ценные знания.

Наш путь в мире NLP с Python – это непрерывное обучение и исследование. От простых задач токенизации до сложнейших архитектур трансформеров‚ мы видим‚ как постоянно развиваются инструменты и методы‚ открывая новые горизонты для работы с человеческим языком.

Мы верим‚ что Python благодаря своей гибкости‚ обширной экосистеме библиотек и активному сообществу‚ останется ключевым языком для NLP. И мы будем продолжать делиться нашим опытом‚ открывая для себя и для вас всё новые возможности этого захватывающего направления в искусственном интеллекте. Пусть наши тексты станут понятны не только нам‚ но и машинам!

Подробнее

| Анализ социальных медиа | Компьютерная лингвистика | Семантический поиск | Извлечение знаний | Генеративный ИИ текст |

| Обработка естественной речи | Машинное обучение текста | Автоматическое суммаризирование | Векторные представления | Трансформерные модели |