- Раскрываем Тайны Текста: Наш Полный Гид по NLP в Python от А до Я

- Первые Шаги: От Сырого Текста к Понятным Данным

- Подготовка Текста: Очистка и Нормализация

- Строим Фундамент: Основные Инструменты NLP в Python

- NLTK: Наш Верный Спутник в Мире Текста

- spaCy: Скорость и Эффективность

- TextBlob и Gensim: Простота и Мощность

- Представление Смысла: Векторизация Текста

- От Слов к Числам: Классические Методы

- Глубокие Представления: Word Embeddings и Трансформеры

- Решение Задач: Прикладные Аспекты NLP

- Распознавание Именованных Сущностей (NER)

- Анализ Тональности (Sentiment Analysis)

- Тематическое Моделирование и Классификация

- Суммаризация и Извлечение Ключевых Фраз

- Вопросно-ответные Системы и Чат-боты

- Машинный Перевод и Мультиязычность

- Глубокое Погружение: Нейросети и Трансформеры

- PyTorch/TensorFlow: Создание Собственных Моделей

- Трансформеры: Революция в NLP

- Практические Сценарии и Нишевые Применения

- Работа с Различными Источниками Данных

- Специализированный Анализ

- Инструменты для Оценки и Визуализации

- Оценка Качества Моделей

- Визуализация и Мониторинг

- Вызовы и Перспективы

- Работа с Неполными и Ошибочными Данными

- Большие Данные и Обработка в Реальном Времени

- Наши Рекомендации

Раскрываем Тайны Текста: Наш Полный Гид по NLP в Python от А до Я

Привет, дорогие читатели и коллеги по цеху! Сегодня мы хотим поделиться с вами нашим многолетним опытом и глубокими знаниями в одной из самых увлекательных областей искусственного интеллекта – обработке естественного языка, или NLP (Natural Language Processing). Мы, как опытные блогеры, не просто расскажем о теории, но и покажем, как эти мощные инструменты работают на практике, основываясь на реальных проектах и вызовах, с которыми мы сталкивались. Если вы когда-либо задумывались, как компьютеры понимают человеческую речь, или мечтали научить машину читать между строк, то эта статья – ваш путеводитель.

Мир вокруг нас пронизан текстом: социальные сети, электронные письма, статьи, книги, документы. Каждый день мы генерируем колоссальные объемы информации, и извлечь из нее смысл вручную становится непосильной задачей. Именно здесь на помощь приходит NLP, позволяя автоматизировать анализ, классификацию, перевод и даже генерацию текста. Мы убеждены, что знание основ и продвинутых техник NLP открывает двери к бесчисленным инновациям и помогает решать самые разнообразные бизнес-задачи – от улучшения клиентского сервиса до выявления скрытых тенденций на рынке.

Первые Шаги: От Сырого Текста к Понятным Данным

Прежде чем погружаться в сложные алгоритмы и нейросети, нам необходимо понять, как подготовить наш исходный текстовый материал. Ведь сырой текст, каким мы его получаем из интернета или баз данных, часто содержит шум, ошибки и неструктурированные элементы, которые могут помешать точному анализу. Этот этап, известный как предобработка текста, является краеугольным камнем любого успешного проекта в области NLP.

Подготовка Текста: Очистка и Нормализация

Наш первый шаг – это всегда очистка данных. Мы сталкиваемся с HTML-тегами, специальными символами, ссылками, эмодзи и прочим "мусором", который не несет смысловой нагрузки для большинства задач. Здесь нашими лучшими друзьями становятся регулярные выражения (re). С их помощью мы можем элегантно удалить все ненужное, оставив только чистый текст. Например, мы часто используем их для удаления всех неалфавитных символов или для извлечения конкретных паттернов.

После очистки мы переходим к нормализации. Представьте, что в тексте встречаются слова "бежать", "бежит", "бежал". Для человека это одно и то же действие, но для компьютера – три разных слова. Чтобы привести их к общей форме, мы используем токенизацию, стемминг и лемматизацию.

- Токенизация: Это процесс разбиения текста на отдельные слова или фразы, называемые токенами. NLTK предоставляет прекрасные инструменты для этого, например,

word_tokenizeилиsent_tokenize. Мы используем их для разделения предложений и слов. - Стемминг: Это более грубый процесс сокращения слов до их корневой формы (стема), часто путем отсечения окончаний. Например, "бежать", "бежит", "бежал" могут быть сокращены до "беж". Популярные стеммеры, которые мы используем, это

PorterStemmerиSnowballStemmerиз NLTK. - Лемматизация: В отличие от стемминга, лемматизация – это более изощренный процесс, который приводит слова к их словарной форме (лемме) с учетом морфологии языка. Например, "бежать", "бежит", "бежал" будут приведены к "бежать". Для продвинутой лемматизации мы активно применяем spaCy и Stanza, особенно для языков с богатой морфологией, таких как русский;

Еще один важный аспект нормализации – это работа со стоп-словами и пунктуацией. Стоп-слова (например, "и", "в", "на") не несут много информации и часто удаляются, чтобы уменьшить размер данных и сфокусироваться на более значимых терминах. Пунктуация также обычно удаляется, если она не важна для конкретной задачи (например, анализ тональности, где восклицательные знаки могут быть важны).

Строим Фундамент: Основные Инструменты NLP в Python

Python предлагает богатую экосистему библиотек для NLP, каждая из которых имеет свои сильные стороны и области применения. Мы постоянно экспериментируем с новыми инструментами, но есть несколько "рабочих лошадок", которые всегда с нами в наших проектах.

NLTK: Наш Верный Спутник в Мире Текста

NLTK (Natural Language Toolkit) – это, пожалуй, первая библиотека, с которой мы знакомились, когда только начинали свой путь в NLP. Это своего рода швейцарский нож для исследователей и разработчиков, предлагающий огромный набор инструментов и ресурсов. NLTK отлично подходит для обучения, экспериментов и выполнения базовых задач, таких как токенизация, стемминг, POS-теггинг (определение частей речи) и даже синтаксический анализ. Мы часто используем его для быстрого прототипирования и анализа частотности слов и N-грамм.

Хотя NLTK может быть медленным для обработки больших объемов данных по сравнению с более оптимизированными библиотеками, его обширные возможности и активное сообщество делают его незаменимым для понимания фундаментальных концепций. Мы рекомендуем NLTK всем, кто только начинает свой путь в NLP, чтобы получить прочную базу.

spaCy: Скорость и Эффективность

Когда речь заходит о производительности и готовности к продакшну, наш выбор часто падает на spaCy. Эта библиотека разработана с акцентом на скорость и эффективность, что делает ее идеальной для крупномасштабной обработки текста. Одной из ключевых особенностей spaCy, которую мы активно используем, является быстрое распознавание именованных сущностей (NER). Это позволяет нам автоматически извлекать из текста имена людей, организаций, географические названия, даты и многое другое.

Кроме NER, spaCy предлагает мощные инструменты для синтаксического парсинга, что дает нам возможность анализировать грамматическую структуру предложений и выявлять зависимости между словами. Это невероятно полезно для более глубокого понимания текста, например, при разработке систем вопросно-ответных систем или извлечения фактов. spaCy также поддерживает различные языки, включая русский, и имеет отличные предварительно обученные модели, что значительно ускоряет разработку.

TextBlob и Gensim: Простота и Мощность

Для быстрого и простого NLP, а также для задач, требующих глубокого анализа тем, мы обращаемся к TextBlob и Gensim.

- TextBlob: Это облегченная библиотека, построенная на базе NLTK, которая предоставляет интуитивно понятный API для выполнения общих задач NLP, таких как POS-теггинг, извлечение фраз, перевод и анализ тональности. Мы используем TextBlob для быстрого определения настроения текста, определения языка и даже для проверки орфографии. Конечно, у TextBlob есть свои ограничения, особенно для сложных задач и специфических языков, но для быстрого старта это отличный вариант.

- Gensim: Эта библиотека является нашим основным инструментом для тематического моделирования (LDA, LSI) и работы с Word Embeddings (Word2Vec, GloVe). Gensim разработан для работы с большими текстовыми корпусами и эффективно реализует алгоритмы, которые позволяют нам обнаруживать скрытые темы в коллекциях документов. Мы применяем его, чтобы понять, о чем говорят наши клиенты в отзывах, или какие темы преобладают в новостных статьях.

Мы часто сравниваем модели тематического моделирования, такие как LDA (Латентное размещение Дирихле) и NMF (Неотрицательная матричная факторизация), используя Gensim и Scikit-learn, чтобы найти наиболее подходящий подход для конкретной задачи. Каждая из них имеет свои особенности и по-разному раскрывает структуру тем в тексте.

Представление Смысла: Векторизация Текста

Текст, даже после тщательной предобработки, все еще остается набором символов, которые машина не может напрямую "понять". Чтобы алгоритмы машинного обучения могли работать с текстом, нам нужно преобразовать его в числовой формат – векторы. Это процесс, называемый векторизацией текста, является одним из самых критически важных этапов в NLP.

От Слов к Числам: Классические Методы

На заре NLP мы использовали довольно простые, но эффективные методы векторизации:

- CountVectorizer: Этот метод создает вектор, где каждая позиция соответствует слову из всего корпуса документов, а значение в этой позиции – это количество раз, сколько данное слово встречается в конкретном документе. Это простой и интуитивно понятный подход, но он не учитывает важность слов.

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): TF-IDF – это более продвинутый метод, который не только учитывает частоту слова в документе (TF), но и его редкость во всем корпусе (IDF). Таким образом, слова, которые часто встречаются в одном документе, но редко в других, получают больший вес, что позволяет нам выделить наиболее информативные термины. Мы активно используем TfidfVectorizer для классификации текстов и извлечения ключевых фраз.

Сравнение этих методов векторизации (TF-IDF vs Word2Vec и другие) – это отдельная большая тема, и мы всегда подходим к выбору векторизатора исходя из специфики задачи и объема данных. Для нас важно, чтобы выбранный метод наилучшим образом отражал семантическое значение текста.

Глубокие Представления: Word Embeddings и Трансформеры

Классические методы векторизации имеют один существенный недостаток: они не улавливают семантическую связь между словами. Например, слова "король" и "царь" будут рассматриваться как совершенно разные сущности. Чтобы преодолеть это, появились Word Embeddings – векторные представления слов, которые отображают их смысл в многомерном пространстве. Чем ближе слова по смыслу, тем ближе будут их векторы.

- Word2Vec и GloVe: С помощью библиотеки Gensim мы активно используем модели Word2Vec (Skip-gram и CBOW) и GloVe. Эти модели обучаются на огромных текстовых корпусах и создают плотные векторные представления, которые улавливают семантические и синтаксические отношения между словами. Например, мы можем выполнить векторную арифметику: "король" ⎯ "мужчина" + "женщина" ≈ "королева".

- Doc2Vec и FastText: Для представления целых документов или предложений мы используем Doc2Vec, также доступный через Gensim. Это расширение Word2Vec, которое позволяет нам получать векторы для более крупных текстовых единиц. FastText, разработанный Facebook AI Research, является еще одним мощным инструментом. Его уникальность в том, что он учитывает подсловные единицы (n-граммы символов), что делает его особенно эффективным для работы с редкими словами и языками с богатой морфологией.

- Sentence Transformers и Контекстное Встраивание: С появлением глубокого обучения и трансформерных архитектур, мы получили возможность создавать векторизацию предложений и документов, которая учитывает контекст. Sentence Transformers – это фреймворк для создания семантических эмбеддингов предложений, который позволяет сравнивать их по смыслу.

Но настоящая революция произошла с появлением Трансформеров. Модели, такие как BERT (Bidirectional Encoder Representations from Transformers) и GPT (Generative Pre-trained Transformer), изменили ландшафт NLP. Они способны создавать контекстуальные встраивания, то есть векторное представление слова меняется в зависимости от его окружения в предложении. Это позволяет нам решать гораздо более сложные задачи с беспрецедентной точностью. Мы активно используем библиотеку Hugging Face Transformers для доступа к тысячам предварительно обученных моделей и их тонкой настройки (Fine-tuning) под наши специфические задачи.

Решение Задач: Прикладные Аспекты NLP

Теперь, когда мы знаем, как подготовить и векторизовать текст, давайте рассмотрим, какие реальные задачи мы можем решать с помощью NLP. Это сердце нашей работы, где теория встречается с практикой.

Распознавание Именованных Сущностей (NER)

Распознавание именованных сущностей (NER) – это задача идентификации и классификации именованных сущностей в тексте (например, имена людей, названия организаций, локации, даты, денежные суммы). Это критически важно для извлечения структурированной информации из неструктурированного текста.

Как мы уже упоминали, spaCy является нашим основным инструментом для быстрого и точного NER. Мы также используем библиотеку Flair, которая предлагает современные подходы к NER, основанные на глубоком обучении, и показывает отличные результаты, особенно для языков с богатой морфологией. В некоторых случаях, когда требуется высокая точность и есть возможность разметить данные, мы применяем CRF (Conditional Random Fields) для распознавания сущностей, обучая собственные модели. Мы всегда оцениваем качество NER-моделей, используя метрики, такие как F1-score, Precision и Recall.

Анализ Тональности (Sentiment Analysis)

Понимание эмоциональной окраски текста – это мощный инструмент для бизнеса. Будь то отзывы клиентов, сообщения в социальных сетях или новостные заголовки, анализ тональности позволяет нам оценить, является ли текст позитивным, негативным или нейтральным.

Для простых задач мы используем VADER (Valence Aware Dictionary and sEntiment Reasoner) из NLTK, который хорошо справляется с англоязычным текстом, или TextBlob. Однако для более сложных сценариев, особенно при анализе тональности сообщений в социальных сетях (Twitter/Reddit), где присутствуют сарказм, сленг и эмодзи, мы разрабатываем собственные модели, используя машинное обучение и глубокие нейронные сети. Мы также исследуем анализ тональности финансовых новостей, где точность имеет первостепенное значение.

Тематическое Моделирование и Классификация

Эти две задачи тесно связаны и являются фундаментальными для организации и понимания больших объемов текстовых данных.

- Тематическое Моделирование: Как мы уже упоминали, Gensim является нашим основным инструментом для LDA и LSI, позволяя нам обнаруживать скрытые темы в коллекциях документов. Мы также активно применяем Topic Modeling для анализа отзывов, чтобы выявить основные болевые точки или преимущества продуктов. Сравнение моделей тематического моделирования (LDA vs NMF) помогает нам выбрать наиболее подходящий подход для извлечения скрытых тем.

- Классификация Текстов: Это задача присвоения тексту одной или нескольких предопределенных категорий. Например, классификация электронных писем как "спам" или "не спам", или отзывов о продукте по категориям. Мы используем библиотеку Scikit-learn для классификации текстов, экспериментируя с различными методами машинного обучения, такими как SVM (Support Vector Machines) и наивный байесовский классификатор. Также мы применяем BERT для задач классификации, достигая высокой точности благодаря его способности улавливать контекст.

Суммаризация и Извлечение Ключевых Фраз

В мире информационного перегруза способность быстро получать суть документа становится бесценной. Суммаризация текста и извлечение ключевых фраз помогают нам в этом.

- Извлечение Ключевых Фраз: Мы используем алгоритмы вроде RAKE (Rapid Automatic Keyword Extraction) и TextRank для извлечения наиболее важных фраз из текста. TextRank также может быть применен для извлечения ключевых предложений и даже для суммаризации.

- Суммаризация Текста: Существует два основных подхода: экстрактивная и абстрактивная суммаризация. Экстрактивная суммаризация выбирает наиболее важные предложения из оригинального текста и объединяет их. Абстрактивная суммаризация генерирует новые предложения, которые передают суть текста, но не обязательно присутствуют в оригинале. Мы работаем над обеими, используя традиционные методы для экстрактивной и Transformer-модели для абстрактивной суммаризации.

Вопросно-ответные Системы и Чат-боты

Мечта о машинах, которые могут осмысленно общаться с людьми, становится реальностью благодаря NLP. Мы активно участвуем в разработке систем вопросно-ответных систем (QA), которые могут находить ответы на вопросы в больших коллекциях документов.

Для создания интерактивных диалоговых систем мы используем Rasa framework для разработки чат-ботов на Python; Rasa позволяет нам строить контекстуальных ассистентов, которые могут вести естественный диалог, понимать намерения пользователя и выполнять соответствующие действия. В этом нам также помогают Transformer-модели для генерации диалогов, которые позволяют ботам создавать более естественные и разнообразные ответы.

Машинный Перевод и Мультиязычность

Преодоление языковых барьеров – еще одна захватывающая область NLP. Мы работаем с обработкой многоязычных текстовых корпусов и разработкой систем машинного перевода на Python.

Для работы с мультиязычностью мы используем библиотеку Polyglot, которая поддерживает широкий спектр языков и предлагает инструменты для их анализа. Stanza также отлично подходит для языков с богатой морфологией, включая русский. В наших проектах по машинному переводу мы все чаще обращаемся к Transformer-моделям для машинного перевода, которые показывают выдающиеся результаты, значительно превосходящие традиционные подходы.

"Язык – это дорожная карта культуры. Он рассказывает, откуда приходят его люди и куда они направляются." – Рита Мэй Браун

Глубокое Погружение: Нейросети и Трансформеры

В последние годы глубокое обучение стало доминирующей парадигмой в NLP, открыв новые горизонты для решения сложных задач. Мы активно используем нейронные сети для достижения state-of-the-art результатов.

PyTorch/TensorFlow: Создание Собственных Моделей

Для разработки и экспериментов с собственными нейросетями мы используем фреймворки PyTorch и TensorFlow. Эти мощные библиотеки предоставляют гибкость для создания архитектур любой сложности, от простых полносвязных сетей до рекуррентных нейронных сетей (RNN) и их вариантов, таких как LSTM-сети (Long Short-Term Memory). Мы применяем Keras/TensorFlow для создания LSTM-сетей, которые особенно хорошо подходят для обработки последовательных данных, таких как текст.

Мы постоянно работаем над тонкой настройкой (Fine-tuning) предварительно обученных моделей, что позволяет нам адаптировать мощные, но общие модели под очень специфические задачи с ограниченным объемом размеченных данных. Это значительно сокращает время и ресурсы, необходимые для разработки высокопроизводительных систем.

Трансформеры: Революция в NLP

Как мы уже упоминали, архитектура Трансформеров и модели на ее основе (BERT, GPT, T5) произвели настоящую революцию. Мы применяем их для широкого спектра задач:

- Сложные задачи NLP: Используя библиотеку Hugging Face, мы решаем задачи, которые раньше казались недостижимыми, такие как генерация связного и осмысленного текста, продвинутое понимание вопросов и ответы на них.

- Генерация текста: Использование Transformer-моделей для генерации текста (GPT) позволяет нам создавать статьи, описания продуктов, диалоги и даже код. Это открывает невероятные возможности для автоматизации контента.

- Генерация кода: Да, трансформеры могут даже помочь в программировании! Мы исследуем использование трансформеров для анализа и генерации кода (сжатие кода), что может значительно повысить продуктивность разработчиков.

- Выявление связей между сущностями: Мы разрабатываем модели для выявления связей между сущностями, что критически важно для построения графов знаний и более глубокого понимания взаимосвязей в тексте.

Практические Сценарии и Нишевые Применения

NLP – это не только академические исследования, но и мощный инструмент для решения реальных проблем в самых разных отраслях. Мы накопили большой опыт в применении NLP к специализированным задачам.

Работа с Различными Источниками Данных

Текст может поступать из самых разных источников, и часто его приходится сначала извлечь:

- Веб-скрейпинг: Для сбора текстовых данных с веб-сайтов мы используем библиотеку Beautiful Soup. Это позволяет нам парсить HTML-страницы и извлекать нужный контент для дальнейшего анализа.

- Извлечение текста из PDF: Работа с PDF-документами – частая задача. Мы применяем библиотеку PyMuPDF для эффективного извлечения текста из PDF-файлов, что особенно актуально для анализа юридических документов или научных статей.

- Анализ лог-файлов: Лог-файлы содержат ценную информацию о работе систем. Мы используем Python для анализа лог-файлов, выявляя аномалии, ошибки и паттерны поведения.

Специализированный Анализ

Наш опыт показывает, что NLP находит применение в самых неожиданных областях:

- Анализ юридических документов и финансовых новостей: Это области, где точность и контекст имеют критическое значение; Мы используем Python для анализа юридических документов, выявляя ключевые положения, даты и сущности. Аналогично, анализ тональности финансовых новостей помогает нам прогнозировать рыночные тренды.

- Медицинские записи: Извлечение информации из неструктурированных медицинских записей помогает в диагностике и исследованиях. Мы работаем над анализом текста в медицинских записях для извлечения симптомов, диагнозов и процедур.

- Анализ стилистики текстов (авторский почерк): Это увлекательная задача, где мы пытаемся определить автора по его стилю письма или выявить аномалии.

- Работа с эмодзи и сленгом: В современных текстах, особенно в социальных сетях, эмодзи и сленг играют огромную роль. Мы разрабатываем инструменты для нормализации сленга и учета эмоциональной нагрузки эмодзи.

- Обнаружение плагиата и проверка фактов: Мы разрабатываем системы обнаружения плагиата, используя методы сравнения строк (например, с библиотекой Jellyfish) и векторизации документов. Также мы исследуем создание инструментов для проверки фактов (Fact-Checking).

- Проверка грамматики и орфографии: Хотя существуют готовые решения, мы также работаем над разработкой инструментов для проверки грамматики и исправления орфографии, адаптированных под специфические требования.

Инструменты для Оценки и Визуализации

Разработка NLP-моделей – это итеративный процесс, который требует постоянной оценки и визуализации результатов. Без этих шагов мы не сможем понять, насколько хорошо работает наша система и где ее можно улучшить.

Оценка Качества Моделей

Когда мы говорим об оценке, мы всегда используем стандартные метрики. Для задач классификации и NER это:

| Метрика | Описание | Когда использовать |

|---|---|---|

| Precision (Точность) | Доля правильно идентифицированных положительных результатов среди всех результатов, классифицированных как положительные. | Когда стоимость ложноположительных результатов высока (например, спам-фильтр). |

| Recall (Полнота) | Доля правильно идентифицированных положительных результатов среди всех фактических положительных результатов. | Когда стоимость ложноотрицательных результатов высока (например, медицинская диагностика). |

| F1-score | Гармоническое среднее Precision и Recall, балансирующее между ними. | Когда важен баланс между Precision и Recall. |

Мы также проводим сравнение эффективности различных токенизаторов, лемматизаторов (SpaCy vs NLTK) и методов векторизации (TF-IDF vs Word2Vec), чтобы выбрать оптимальные компоненты для нашей архитектуры. Для этого мы часто используем библиотеки, такие как TextDistance для измерения сходства строк и документов, что полезно для поиска дубликатов или оценки качества перефразирования.

Визуализация и Мониторинг

Визуализация помогает нам быстро понять большие объемы текстовых данных:

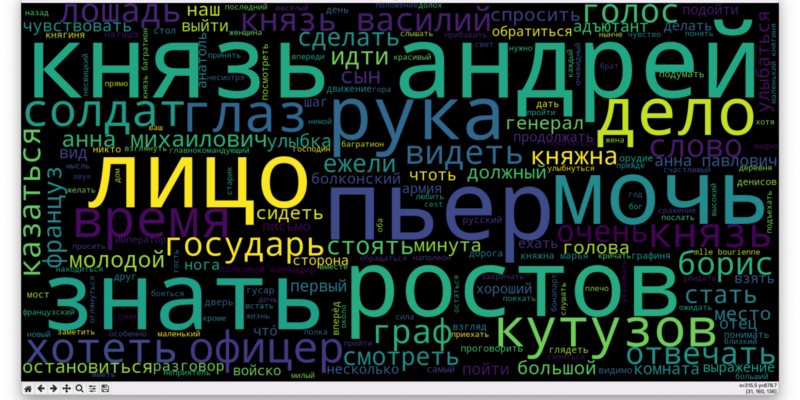

- Word Clouds (Облака слов): Простой, но эффективный способ визуализировать частотность слов.

- Heatmaps (Тепловые карты): Могут быть использованы для отображения матриц сходства или корреляций между темами.

- Sweetviz: Для более глубокого анализа текстовых данных мы используем библиотеку Sweetviz, которая автоматически генерирует подробные отчеты с визуализациями.

Мы также следим за анализом частотности слов и N-грамм, а также анализом частотности редких слов и их значения, чтобы выявить скрытые паттерны и инсайты.

Вызовы и Перспективы

Несмотря на все достижения, NLP по-прежнему сталкивается с рядом серьезных вызовов, и мы активно работаем над их преодолением.

Работа с Неполными и Ошибочными Данными

Реальный мир редко бывает идеальным. Мы часто сталкиваемся с проблемами обработки неполных и ошибочных данных: опечатки, неполные предложения, отсутствующие символы. Разработка инструментов для автоматической очистки и нормализации таких данных – это непрерывный процесс. Мы создаем инструменты для автоматического перефразирования, чтобы справиться с вариативностью языка.

Большие Данные и Обработка в Реальном Времени

Объемы текстовых данных продолжают расти экспоненциально. Обработка больших текстовых массивов (Big Data NLP) требует эффективных алгоритмов и распределенных вычислений. Кроме того, все чаще возникает потребность в обработке текста в режиме реального времени (Streaming NLP), например, для анализа потоков сообщений в социальных сетях или чатов. Мы исследуем обработку текста с использованием GPU-ускорения для повышения производительности.

Наши Рекомендации

Итак, с чего начать? Наш главный совет – не бояться экспериментировать. Начните с NLTK и TextBlob, чтобы освоить основы. Затем переходите к spaCy для более быстрых и мощных решений. Для глубоких погружений в семантику и тематическое моделирование освойте Gensim. А если вы готовы к настоящим вызовам и передовым технологиям – Hugging Face Transformers и PyTorch/TensorFlow ждут вас. Помните, что каждый проект уникален, и нет универсального "лучшего" инструмента. Всегда анализируйте свою задачу, доступные данные и требуемую производительность.

Мы надеемся, что этот обширный обзор вдохновил вас на собственные исследования и проекты в мире NLP. От базовой токенизации до продвинутых трансформерных моделей – мы прошли долгий путь, и возможности, которые открывает обработка естественного языка, поистине безграничны. Мы верим, что каждый из вас может внести свой вклад в эту захватывающую область, помогая машинам лучше понимать нас, а нам – лучше понимать мир вокруг. Удачи в ваших начинаниях, и пусть ваш код всегда будет чистым, а ваши модели – точными!

Подробнее

| Основы NLTK | NER с spaCy | Тематическое моделирование | Word Embeddings | Анализ тональности VADER |

| Scikit-learn для NLP | Трансформеры Hugging Face | Разработка чат-ботов Python | Лемматизация и стемминг | Векторизация текста |