Раскрываем Тайны Текста: Наш Путь в Мир NLP с Python – От Азов до Трансформеров

Привет, дорогие читатели и коллеги по цеху! Сегодня мы хотим поделиться с вами нашим захватывающим опытом погружения в мир Обработки Естественного Языка (NLP) с использованием такого мощного инструмента, как Python. В современном мире, где объемы текстовой информации растут экспоненциально каждую секунду, способность машин понимать, интерпретировать и даже генерировать человеческий язык становится не просто полезной, а абсолютно необходимой. Мы прошли долгий путь от первых экспериментов с токенизацией до тонкой настройки сложнейших трансформерных моделей, и готовы рассказать вам о каждом шаге этого увлекательного приключения.

Текст окружает нас повсюду: это электронные письма, сообщения в социальных сетях, новостные статьи, научные публикации, отзывы клиентов и многое другое. Представьте, сколько ценной информации скрыто в этих потоках слов! NLP — это именно тот мост, который позволяет нам извлекать эту информацию, автоматизировать рутинные задачи и создавать по-настоящему умные системы. Мы убеждены, что каждый, кто работает с данными, рано или поздно столкнется с необходимостью анализа текстовых данных, и Python предлагает для этого самый богатый арсенал инструментов. Давайте вместе окунемся в этот мир и исследуем его фундаментальные концепции и передовые технологии.

Где Начинается Путешествие: Базовые Инструменты и Концепции NLP

Как и в любом большом приключении, наше знакомство с NLP началось с самых основ. Мы помним те дни, когда с восторгом открывали для себя первые библиотеки, способные «разрезать» текст на части и приводить слова к их базовой форме. Эти первые шаги заложили фундамент для всех последующих, более сложных задач, и мы хотим провести вас по этому пути, чтобы вы могли уверенно начать свое собственное исследование;

Понимание базовых концепций и умение работать с ключевыми библиотеками — это критически важный этап. Без него невозможно двигаться дальше, к более продвинутым моделям и алгоритмам. Мы всегда начинаем с фундамента, потому что именно он определяет прочность всей последующей конструкции. И поверьте нам, даже базовые инструменты способны творить чудеса, если знать, как их правильно применять.

NLTK: Наш Старый Добрый Друг для Предобработки

Библиотека NLTK (Natural Language Toolkit), это, пожалуй, одна из первых, с которой мы познакомились, входя в мир NLP. Она является настоящей сокровищницей для тех, кто только начинает свой путь, предлагая интуитивно понятные инструменты для выполнения самых базовых, но в то же время крайне важных операций с текстом. NLTK не только предоставляет функционал, но и служит отличной образовательной платформой, позволяя глубоко понять принципы работы с языком.

Мы часто используем NLTK для первоначальной токенизации — процесса разбиения текста на отдельные слова (токены) или предложения. Это фундаментальный шаг, поскольку большинство последующих алгоритмов работают не с целым текстом, а с его отдельными смысловыми единицами. Представьте, что вы пытаетесь собрать пазл, не разделив его на отдельные части — это просто невозможно. Токенизация делает текст «перевариваемым» для машин. Помимо этого, NLTK блестяще справляется со стеммингом (отсечением окончаний слов, чтобы привести их к общей основе) и лемматизацией (приведением слов к их словарной форме, учитывая морфологию). Эти операции незаменимы для уменьшения размерности данных и улучшения качества анализа.

| Операция | Описание | Пример (Русский) |

|---|---|---|

| Токенизация | Разбиение текста на слова или предложения. | "Мы изучаем NLP." -> ["Мы", "изучаем", "NLP", "."] |

| Стемминг | Удаление окончаний для получения основы слова. Грубый метод. | "бегущий", "бегать", "бегал" -> "бег" (может быть не словом) |

| Лемматизация | Приведение слова к его словарной (нормальной) форме. Учитывает контекст. | "бегущий", "бегать", "бегал" -> "бегать" |

В нашей практике NLTK остается незаменимым инструментом для быстрого прототипирования и обучения базовым концепциям. Его простота и обширная документация делают его идеальным выбором для начинающих исследователей в области NLP.

spaCy: Когда Скорость и Эффективность Важны

Когда наши проекты начали расти в масштабах, а требования к скорости и производительности стали критически важными, мы открыли для себя spaCy. Эта библиотека — настоящий тяжеловес в мире промышленного NLP. Она спроектирована с акцентом на скорость, эффективность и простоту использования в реальных приложениях. Мы ценим spaCy за ее пред-обученные модели, которые позволяют выполнять сложные задачи, такие как распознавание именованных сущностей (NER) и синтаксический парсинг, буквально одной строкой кода.

Одной из наиболее впечатляющих особенностей spaCy, которой мы активно пользуемся, является ее способность к NER. Это позволяет нам автоматически идентифицировать в тексте такие сущности, как имена людей, названия организаций, географические объекты, даты и многое другое. Представьте, что у вас есть огромный массив новостных статей, и вам нужно быстро извлечь все упоминания компаний или политиков. spaCy делает это легко и эффективно. Кроме того, ее мощный синтаксический парсер помогает нам понять грамматическую структуру предложений, что открывает двери для более глубокого анализа текста, например, для извлечения отношений между сущностями.

Регулярные Выражения (re): Мастера Маскировки Текста

Прежде чем перейти к более сложным алгоритмам, нельзя не упомянуть о незаменимом инструменте в арсенале любого специалиста по NLP — регулярных выражениях (re). Мы не раз убеждались в их мощи при решении задач предобработки текста. Регулярные выражения позволяют нам искать, заменять и извлекать сложные паттерны в строках, что делает их идеальными для очистки данных от "шума", стандартизации форматов и выделения специфической информации.

В нашей работе мы постоянно сталкиваемся с необходимостью очистки текста от HTML-тегов, удаления лишних пробелов, извлечения email-адресов или номеров телефонов. Все эти задачи, казалось бы, рутинные, но крайне важные, легко решаются с помощью модуля `re` в Python. Это как швейцарский нож для работы со строками — всегда под рукой и всегда полезен. Мы всегда рекомендуем уделить время изучению регулярных выражений, так как они значительно упростят вашу жизнь при работе с неструктурированными текстовыми данными.

TextBlob: Простота для Быстрых Задач

Иногда, особенно на начальных этапах проекта или когда нужна быстрая оценка текста, мы обращаемся к TextBlob. Эта библиотека привлекает своей невероятной простотой и интуитивно понятным API. Она построена поверх NLTK, но предлагает более высокоуровневый и удобный интерфейс для выполнения базовых задач NLP, таких как анализ тональности, перевод, POS-теггинг и даже морфологический анализ.

Мы используем TextBlob для быстрого анализа тональности, когда не требуется глубокая точность, но важна скорость получения результата. Например, для беглого анализа небольшого набора отзывов. Однако, по мере роста сложности задач, мы начинаем ощущать ее ограничения. TextBlob, при всей своей простоте, не всегда подходит для масштабных или высокоточных проектов, особенно когда речь идет о специфических доменах или многоязычных текстах. В таких случаях мы переходим к более мощным инструментам, о которых расскажем далее.

Переводим Слова на Язык Машин: Векторизация и Представление

После того как текст очищен и разбит на токены, возникает следующий фундаментальный вопрос: как заставить компьютер "понять" эти слова? Компьютеры оперируют числами, а не буквами. Именно здесь на сцену выходит векторизация текста – процесс преобразования слов, предложений или целых документов в числовые векторы. Это ключевой шаг, который позволяет нам применять к текстовым данным мощные алгоритмы машинного обучения и глубоких нейронных сетей.

Мы прошли через эволюцию этих методов, начиная от самых простых и заканчивая сложными контекстно-зависимыми представлениями. Каждый метод имеет свои преимущества и недостатки, и выбор правильного подхода критически важен для успеха проекта. Давайте разберем, как мы учим машины "читать" между строк, превращая слова в осмысленные числа.

Классические Векторизаторы: CountVectorizer и TF-IDF

Наше погружение в мир числового представления текста началось с классических, но до сих пор актуальных методов: CountVectorizer и TF-IDF (Term Frequency-Inverse Document Frequency). Эти подходы очень просты для понимания и реализации, но при этом обладают достаточной мощностью для решения множества задач, особенно когда объем данных не запредельно велик или требуется высокая интерпретируемость.

CountVectorizer, как следует из названия, просто подсчитывает частоту каждого слова в документе. Он создает словарь всех уникальных слов в корпусе и представляет каждый документ как вектор, где каждый элемент — это количество вхождений соответствующего слова. Мы использовали его для задач, где абсолютная частота слова имела значение. Однако, у него есть недостаток: очень частые слова (стоп-слова вроде "и", "в", "на") могут доминировать в векторе, не неся при этом большого смыслового значения.

Здесь на помощь приходит TF-IDF. Этот метод не только учитывает частоту слова в документе (Term Frequency, TF), но и его редкость во всем корпусе документов (Inverse Document Frequency, IDF). Мы обнаружили, что TF-IDF гораздо лучше выделяет важные для конкретного документа слова, подавляя при этом влияние общеупотребительных. Это делает его идеальным для классификации текстов, поиска похожих документов и тематического моделирования. Мы часто используем его в Scikit-learn, где эти векторизаторы реализованы очень эффективно.

| Векторизатор | Принцип работы | Преимущества | Недостатки |

|---|---|---|---|

| CountVectorizer | Подсчитывает вхождения слов в документе. | Простота, интерпретируемость. | Не учитывает важность слов, чувствителен к стоп-словам. |

| TfidfVectorizer | Учитывает частоту слова в документе и его редкость в корпусе. | Выделяет важные слова, подавляет общие. | Игнорирует порядок слов, семантику, создает очень разреженные векторы. |

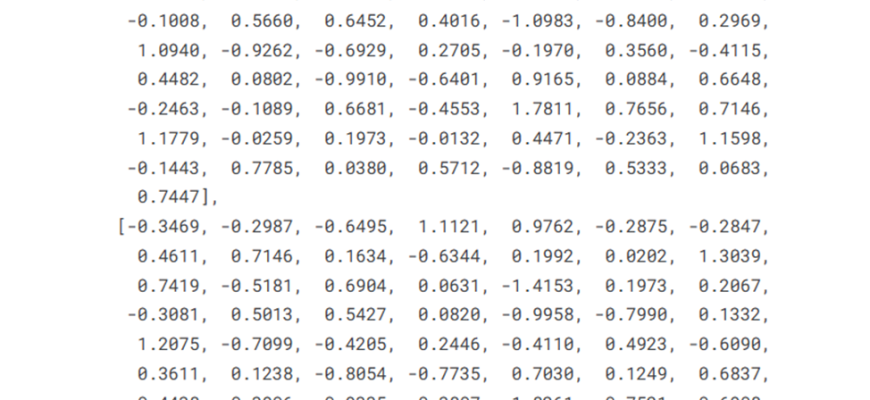

Word Embeddings: Когда Слова Обретают Смысл

Хотя TF-IDF и CountVectorizer отлично справляются с базовыми задачами, они имеют существенный недостаток: они не улавливают семантические отношения между словами. Слова "король" и "королева" могут быть очень далеки друг от друга в пространстве TF-IDF, хотя мы интуитивно понимаем их близость. Именно здесь на сцену выходят Word Embeddings — методы, которые позволяют словам обрести "смысл", представляя их в виде плотных векторов в многомерном пространстве, где семантически близкие слова расположены рядом.

Мы активно работали с такими моделями, как Word2Vec и GloVe. Word2Vec, разработанный Google, оказался настоящим прорывом. Мы использовали его с библиотекой Gensim, которая предоставляет удобный интерфейс для обучения собственных моделей или загрузки предобученных. Основные алгоритмы Word2Vec — Skip-gram (предсказывает контекст по слову) и CBOW (предсказывает слово по контексту) — позволили нам увидеть, как слова, такие как "Париж" и "Франция", или "Москва" и "Россия", имеют схожие векторные отношения. Это открыло нам двери для решения задач, требующих понимания смысла слов, например, для поиска синонимов или анализа ассоциаций.

Кроме того, мы экспериментировали с FastText, особенно когда сталкивались с редкими словами или языками с богатой морфологией. FastText, расширяя идеи Word2Vec, учитывает подсловесные единицы (символьные n-граммы), что позволяет ему генерировать векторы даже для слов, которые не встречались в обучающем корпусе, и лучше работать с опечатками. Для представления целых документов или абзацев мы использовали Doc2Vec, который является расширением Word2Vec и позволяет создавать векторы для более крупных текстовых единиц. Это оказалось чрезвычайно полезным для задач сравнения документов и кластеризации текстов.

Глубже в Смысл: Извлечение Информации и Анализ

Когда мы научились переводить слова и документы в числовые векторы, открылись новые возможности для извлечения глубокого смысла из текста. На этом этапе мы перешли от базовой предобработки к задачам, которые требуют более сложного понимания структуры и содержания языка. Это включает в себя идентификацию конкретных объектов, выявление скрытых тем, понимание эмоциональной окраски и выделение наиболее важных частей текста. Это те задачи, которые напрямую приближают нас к созданию систем, способных по-настоящему "читать" и "понимать" информацию.

Мы постоянно ищем способы, как максимально эффективно извлечь ценные сведения из текстовых данных, и каждый из следующих методов стал важной частью нашего арсенала. Они позволяют нам не просто обрабатывать текст, а превращать его в структурированные знания, которые затем можно использовать для принятия решений или автоматизации процессов.

NER: Охота за Сущностями в Тексте

Одной из наиболее практичных и востребованных задач в NLP является Распознавание Именованных Сущностей (NER). Мы уже упоминали о нем в контексте spaCy, но стоит углубиться в эту тему, поскольку она критически важна для многих реальных приложений. NER позволяет нам автоматически находить и классифицировать именованные объекты в тексте, такие как имена людей, организации, местоположения, даты, денежные суммы и многое другое.

В нашей работе мы активно используем spaCy для быстрого и точного NER, особенно для английского и некоторых европейских языков, где предобученные модели показывают отличные результаты. Однако, когда речь заходит о русском языке или о специфических доменах (например, медицинских или юридических текстах), нам часто приходится прибегать к более продвинутым инструментам или даже обучать собственные модели. Здесь на помощь приходят библиотеки, такие как Flair, которая предлагает современные подходы к NER, основанные на глубоком обучении, и позволяет легко адаптировать модели под наши нужды. Иногда, для более контролируемого и интерпретируемого подхода, мы даже обращались к условным случайным полям (CRF), которые хоть и не являются глубоким обучением, но показывают хорошие результаты на размеченных данных.

Мы часто сталкиваемся с необходимостью разметки данных для обучения NER-моделей. Это кропотливый, но крайне важный процесс, поскольку качество размеченных данных напрямую влияет на производительность модели. Разработка систем, способных извлекать даты и числа, а также другие специфические сущности, стала для нас обыденностью, и мы постоянно ищем способы улучшить точность и охват наших NER-систем.

Тематическое Моделирование: Что Скрывается в Больших Корпусах

Когда мы имеем дело с очень большими объемами текста, например, тысячами отзывов клиентов или сотнями тысяч новостных статей, ручной анализ становится невозможным. Здесь на помощь приходит тематическое моделирование – набор алгоритмов, которые позволяют нам автоматически выявлять скрытые темы или основные смысловые направления в коллекции документов. Это как если бы машина сама читала все тексты и группировала их по смыслу, даже если явных ключевых слов нет.

Мы активно применяем библиотеку Gensim для реализации таких популярных алгоритмов, как LDA (Латентное размещение Дирихле) и LSI (Латентно-семантический анализ). LDA оказалась особенно полезной для анализа больших корпусов, позволяя нам понять, о чем говорят пользователи в отзывах, или какие основные темы обсуждаются в новостях. Мы также экспериментировали с NMF (Неотрицательная матричная факторизация). Сравнение моделей тематического моделирования, таких как LDA vs NMF, стало для нас важной частью процесса, поскольку каждый алгоритм имеет свои особенности и лучше подходит для разных типов данных и задач. Выявление скрытых тем позволяет нам принимать более обоснованные решения, например, в маркетинге или продуктовой разработке.

Анализ Тональности: Понимаем Эмоции Текста

В эпоху социальных сетей и онлайн-отзывов способность понимать эмоциональную окраску текста стала бесценной. Анализ тональности (Sentiment Analysis) позволяет нам определить, является ли текст позитивным, негативным или нейтральным. Это крайне важно для бизнеса, который хочет понять отношение клиентов к своим продуктам или услугам, или для политиков, отслеживающих общественное мнение.

Для быстрого анализа англоязычных текстов мы часто используем библиотеку VADER (Valence Aware Dictionary and sEntiment Reasoner), которая отлично справляется с текстами из социальных сетей, учитывая даже эмодзи и сленг. Однако, мы понимаем, что анализ тональности — это не всегда простое бинарное "хорошо/плохо". Мы сталкивались с необходимостью учитывать сарказм, иронию и сложные контексты, что требует более продвинутых моделей, часто основанных на глубоком обучении. Мы применяли анализ тональности сообщений в социальных сетях (Twitter/Reddit), а также анализировали отзывы о продуктах по категориям, что давало более детальную картину.

Извлечение Ключевых Фраз и Предложений

В огромном потоке информации не всегда нужно читать весь текст целиком, иногда достаточно быстро понять его суть. Для этого мы используем методы извлечения ключевых фраз и предложений. Это помогает нам сэкономить время и сосредоточиться на самом важном.

Мы активно применяем алгоритмы, такие как RAKE (Rapid Automatic Keyword Extraction) для извлечения ключевых слов. RAKE очень эффективен и не требует обучения, что делает его отличным выбором для быстрого анализа. Для извлечения ключевых предложений и, по сути, для суммаризации текста, мы обращаемся к библиотеке TextRank. TextRank, основанный на алгоритме PageRank, позволяет выделить наиболее важные предложения в тексте, которые наилучшим образом отражают его основное содержание. Это отличный инструмент для создания кратких обзоров или аннотаций, особенно когда нужно понять суть длинной статьи или документа без потери ключевой информации.

"Язык — это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Машинное Обучение и Глубокие Нейросети в NLP

По мере того как мы углублялись в мир NLP, стало очевидно, что для решения по-настоящему сложных задач нам потребуется арсенал машинного обучения и, особенно, глубоких нейронных сетей. Эти технологии подняли наше понимание и обработку языка на совершенно новый уровень, позволив создавать системы, которые не просто анализируют, но и "понимают" контекст, генерируют осмысленный текст и даже отвечают на вопросы. Это был настоящий качественный скачок в наших возможностях.

Мы прошли путь от классических алгоритмов машинного обучения до современных трансформерных архитектур, и каждый этап этого пути приносил свои открытия и вызовы. Эти методы позволили нам перейти от извлечения отдельных фактов к построению комплексных интеллектуальных систем, способных взаимодействовать с человеком на его собственном языке.

Классификация Текстов: Распределяем по Полочкам

Одна из самых фундаментальных задач в NLP, это классификация текстов, или, как мы ее называем, "распределение по полочкам". Это процесс присвоения тексту одной или нескольких предопределенных категорий. Будь то спам-фильтрация электронных писем, категоризация новостных статей по темам, или определение тональности отзывов, классификация текста лежит в основе многих интеллектуальных систем.

Мы активно используем библиотеку Scikit-learn для реализации классических алгоритмов машинного обучения, таких как SVM (Метод опорных векторов) и Наивный Байесовский классификатор. Эти методы, хоть и не являются "глубокими", показывают отличные результаты на хорошо подготовленных данных и обладают высокой интерпретируемостью. Мы применяли их для автоматической категоризации статей, анализа текстов отзывов клиентов и многих других задач. Сравнение методов машинного обучения для NLP, таких как SVM и наивный Байесовский классификатор, всегда было частью нашего рабочего процесса, чтобы выбрать наиболее подходящий алгоритм для конкретной задачи и набора данных.

Революция Трансформеров: Новый Уровень Понимания

Если Word Embeddings стали прорывом, то появление Трансформеров стало настоящей революцией в NLP. Эти архитектуры, основанные на механизме внимания, позволили моделям улавливать долгосрочные зависимости в тексте и понимать контекст слов с беспрецедентной точностью. Мы помним, как с восторгом наблюдали за тем, как трансформеры преобразовывали подходы к решению практически всех задач NLP.

Особое место в нашей работе занимает библиотека Hugging Face Transformers. Она предоставляет доступ к огромному количеству предобученных моделей, таких как BERT (Bidirectional Encoder Representations from Transformers) и GPT (Generative Pre-trained Transformer). Мы использовали BERT для таких задач, как NER, классификация текстов и даже для разработки вопросно-ответных систем (QA). Возможность тонкой настройки (Fine-tuning) этих предобученных моделей на наших собственных данных позволила нам достигать выдающихся результатов даже с относительно небольшими наборами данных.

GPT-модели открыли для нас совершенно новые горизонты в области генерации текста. Мы экспериментировали с ними для создания осмысленных диалогов, суммаризации (как Abstractive, так и Extractive), и даже для машинного перевода. Работа с PyTorch/TensorFlow стала неотъемлемой частью нашего процесса, когда мы создаем и обучаем собственные нейросети или адаптируем существующие архитектуры под уникальные задачи. Эти фреймворки дают нам гибкость и мощь, необходимые для работы на переднем крае NLP.

Векторизация Предложений и Документов с Контекстом

С появлением трансформеров изменился и подход к векторизации предложений и документов. Если раньше мы могли получить вектор для каждого слова, то теперь стало возможным создавать векторы, которые учитывают весь контекст предложения или документа. Это достигается за счет использования таких моделей, как Sentence Transformers.

Мы обнаружили, что контекстное встраивание значительно улучшает качество результатов в задачах, где важно понимание смысла всего предложения, а не просто отдельных слов. Например, для поиска семантически похожих предложений или документов, даже если они используют совершенно разную лексику. Это привело к значительному улучшению наших систем поиска и рекомендаций, где точность сопоставления контента является ключевой.

Практика и Продвинутые Инструменты: Расширяем Горизонты

После того как мы освоили основы и погрузились в мир глубокого обучения, пришло время применить эти знания на практике и расширить наш арсенал инструментов. NLP — это не только алгоритмы, но и умение работать с реальными, часто "грязными" данными, интегрировать различные системы и решать специфические задачи, которые выходят за рамки стандартных академических примеров. Мы столкнулись с множеством интересных вызовов, которые требовали творческого подхода и использования самых разнообразных библиотек.

Этот раздел посвящен тем инструментам и техникам, которые помогли нам справляться с реальными проектами, от извлечения текста из сложных источников до работы с многоязычными данными и создания интерактивных систем. Мы хотим поделиться тем, что действительно работает в полевых условиях, и какие решения мы находили для нестандартных задач.

Работа с Данными: От Скрейпинга до Очистки

Начало любого проекта по NLP — это получение и подготовка данных. Часто эти данные разбросаны по интернету, спрятаны в PDF-файлах или просто нуждаются в тщательной очистке. Мы многому научились на этом этапе, и теперь у нас есть надежный набор инструментов для работы с источниками любой сложности.

Для извлечения текстовых данных с веб-страниц мы активно используем библиотеку Beautiful Soup. Это мощный и гибкий инструмент для веб-скрейпинга, который позволяет нам парсить HTML и XML документы, извлекая нужную информацию. Если данные находятся в PDF-файлах, то PyMuPDF становится нашим незаменимым помощником для извлечения текста, изображений и метаданных. Мы также сталкивались с необходимостью обработки неструктурированного текста: очистки данных от артефактов, таких как HTML-теги, специальные символы или нерелевантная информация. Здесь, помимо регулярных выражений, мы используем различные подходы для обработки неполных и ошибочных данных, чтобы наши модели получали максимально качественный вход.

Мультиязычный NLP: Когда Языковые Барьеры Падают

В глобальном мире работа только с одним языком — это роскошь, которую мы не всегда можем себе позволить. Наши проекты часто требовали обработки текстов на разных языках, и здесь мы столкнулись с новыми вызовами и открыли для себя специализированные инструменты для многоязычных текстовых корпусов.

Библиотека Polyglot оказалась очень полезной для работы с множеством языков, предлагая токенизацию, NER, анализ тональности и перевод. Для языков с богатой морфологией, таких как русский, мы активно используем Stanza (от Stanford NLP Group), которая предоставляет высококачественные модели для синтаксического парсинга, POS-теггинга и NER, специально обученные для различных языков. Работа с нелатинскими алфавитами в Python NLP также стала для нас рутиной, и мы научились эффективно обрабатывать тексты на арабском, китайском, японском и многих других языках, что значительно расширило наши возможности.

Создание Интеллектуальных Систем

Конечная цель многих наших проектов — это создание полноценных интеллектуальных систем, которые могут решать реальные проблемы. Мы работали над различными типами таких систем, которые автоматизируют рутинные задачи и предоставляют новые возможности для взаимодействия с информацией.

Мы занимались разработкой чат-ботов на Python, используя фреймворк Rasa, который позволяет создавать диалоговые AI-ассистенты с возможностью понимания естественного языка и управления диалогом. Также мы работали над разработкой системы суммаризации текста (Abstractive vs Extractive), чтобы автоматически генерировать краткие изложения длинных документов. Другие направления включали разработку систем обнаружения плагиата, разработку инструментов для проверки грамматики и орфографии, а также создание словарей и тезаурусов для улучшения семантического поиска и расширения словарного запаса наших моделей.

Визуализация Текстовых Данных

Понимание текстовых данных не всегда возможно только через числа и таблицы; Визуализация играет ключевую роль в исследовании и представлении результатов анализа. Мы убедились, что "один раз увидеть" часто значит гораздо больше, чем "сто раз прочитать".

Мы активно используем различные инструменты для визуализации текстовых данных. Облака слов (Word Clouds) стали нашим стандартным способом быстрого представления наиболее часто встречающихся терминов в корпусе текста. Для более глубокого анализа, например, для визуализации матриц сходства или распределения тем, мы используем тепловые карты (Heatmaps). Эти и другие методы визуализации помогают нам не только лучше понять данные самим, но и более наглядно донести результаты анализа до наших коллег и заказчиков.

Вот мы и подошли к концу нашего обширного рассказа о путешествии в мир NLP с Python. Мы постарались охватить самые важные аспекты, от базовой предобработки до сложнейших трансформерных моделей и практических приложений. Наш опыт показывает, что Python с его богатым набором библиотек является абсолютно незаменимым инструментом для любого, кто хочет работать с естественным языком.

Мир NLP постоянно развивается, и каждый день появляются новые алгоритмы, модели и подходы. То, что сегодня кажется вершиной технологий, завтра может стать стандартом. Мы уверены, что наше путешествие в этот увлекательный мир только начинается, и впереди нас ждут еще множество открытий и вызовов. Мы призываем вас не останавливаться на достигнутом, продолжать экспериментировать, учиться и создавать что-то новое. Возможности NLP поистине безграничны, и каждый из нас может внести свой вклад в то, чтобы машины стали еще умнее и лучше понимали нас.

На этом статья заканчивается. .

Подробнее

| Основы NLTK: Токенизация и стемминг | Использование spaCy для быстрого NER | Библиотека Gensim для тематического моделирования | Word Embeddings: Word2Vec и GloVe с использованием Gensim | Анализ тональности (Sentiment Analysis) с VADER |

| Трансформеры (Hugging Face) для сложных задач NLP | Разработка систем вопросно-ответных систем (QA) | Библиотека Beautiful Soup для веб-скрейпинга текста | Обработка многоязычных текстовых корпусов | Разработка системы суммаризации текста (Abstractive vs Extractive) |