- Раскрываем Тайны Текста: Наш Путь в Мире NLP на Python

- Основы Предобработки Текста: Первый Шаг к Пониманию

- Токенизация и Стемминг: Разбираем Текст на Части

- Лемматизация: Ключ к Глубокому Пониманию

- Очистка Текста: Регулярные Выражения и Удаление Шума

- Превращаем Слова в Числа: Векторизация Текста

- Классические Методы: CountVectorizer и TF-IDF

- Эмбеддинги Слов: Word2Vec и GloVe с Использованием Gensim

- Эмбеддинги Предложений и Документов: Doc2Vec и Sentence Transformers

- Глубже в Смысл: Извлечение Информации и Тематическое Моделирование

- Распознавание Именованных Сущностей (NER) с SpaCy и Flair

- Тематическое Моделирование: LDA и LSI с Использованием Gensim

- Извлечение Ключевых Фраз и Суммаризация Текста (TextRank, RAKE)

- Эмоции и Авторский Почерк: Анализ Тональности и Стилистики

- Анализ Тональности (Sentiment Analysis) с VADER и TextBlob

- Работа с Эмодзи и Сленгом в Современных Текстах

- Определение Авторства и Стилистики Текстов

- Революция Трансформеров: Новый Уровень NLP

- Hugging Face и Предварительно Обученные Модели (BERT, GPT)

- PyTorch/TensorFlow для Создания Нейросетей NLP (LSTM)

- NLP в Действии: От Чат-ботов до Фактчекинга

- Разработка Чат-ботов на Python (Rasa Framework)

- Системы Вопросно-ответных Систем (QA)

- Машинный Перевод и Многоязычность (Polyglot, Stanza)

- Веб-скрейпинг для Данных (Beautiful Soup)

- Обработка PDF (PyMuPDF) и других форматов

- Оценка Качества NER-моделей (F1-score, Precision, Recall)

- Трудности и Горизонты: С Чем Сталкиваемся и Куда Движемся

- Проблемы Обработки Неполных и Ошибочных Данных

- Обработка Больших Текстовых Массивов (Big Data NLP)

- Этика и Предвзятость в Моделях NLP

Раскрываем Тайны Текста: Наш Путь в Мире NLP на Python

Привет, друзья! В нашем блоге мы всегда стремимся делиться самым интересным и полезным из мира технологий, особенно когда речь заходит о Python и его безграничных возможностях. Сегодня мы погрузимся в одну из самых увлекательных и быстро развивающихся областей искусственного интеллекта – Обработку Естественного Языка, или NLP (Natural Language Processing). Мы знаем, что текст окружает нас повсюду: от ежедневных сообщений и постов в социальных сетях до огромных баз данных документов и научных статей. Но как заставить компьютер не просто хранить эти слова, а понимать их, извлекать смысл, эмоции и даже генерировать новые, осмысленные предложения? Именно об этом мы сегодня и поговорим.

За годы наших экспериментов и проектов мы убедились, что Python – это не просто язык программирования, это настоящий швейцарский нож для работы с текстом. С его помощью мы можем разбирать сложные конструкции, выявлять скрытые закономерности и даже обучать машины общаться так, как это делаем мы с вами. Этот путь не всегда прост, но он невероятно захватывающий; Мы пройдемся по ключевым концепциям, рассмотрим мощные библиотеки и покажем, как эти инструменты помогают нам решать реальные задачи – от анализа отзывов клиентов до создания умных чат-ботов. Приготовьтесь, нас ждет глубокое погружение в мир, где слова оживают под нашим управлением!

Основы Предобработки Текста: Первый Шаг к Пониманию

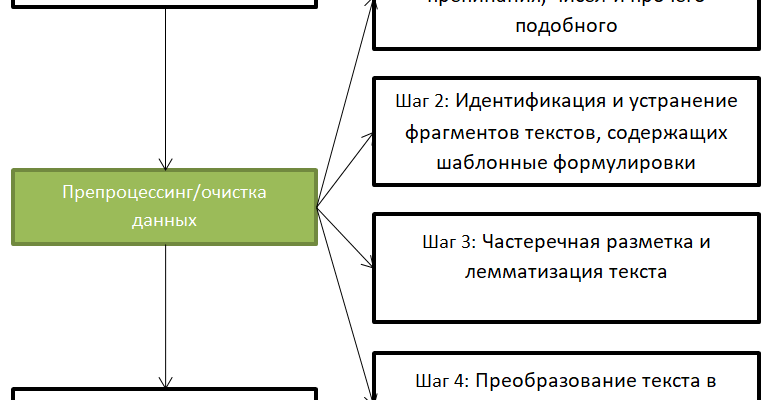

Прежде чем мы сможем научить компьютер "читать" и "понимать" текст, нам необходимо этот текст соответствующим образом подготовить. Представьте, что вы хотите проанализировать огромную библиотеку: вы же не начнете с изучения каждой буквы в каждом слове, не так ли? Сначала вы разделите книги на главы, главы на предложения, а предложения на слова; В NLP этот процесс называется предобработкой, и он является краеугольным камнем любого успешного проекта. Мы всегда начинаем с этого этапа, поскольку качество наших данных напрямую влияет на точность и эффективность последующих моделей.

Наш опыт показывает, что без тщательной предобработки даже самые продвинутые алгоритмы будут работать неэффективно. Текст в его сыром виде полон "шума": лишних символов, пунктуации, стоп-слов, которые не несут смысловой нагрузки, а лишь усложняют анализ. Поэтому мы уделяем этому этапу особое внимание, используя проверенные инструменты и методики, которые позволяют нам привести данные к чистому, стандартизированному виду, готовому для дальнейшего машинного обучения.

Токенизация и Стемминг: Разбираем Текст на Части

Первый шаг в предобработке – это токенизация. Это процесс разбиения текста на более мелкие, значимые единицы, которые мы называем токенами. Токенами могут быть слова, пунктуационные знаки или даже целые предложения. Например, предложение "Мы любим NLP!" может быть разбито на токены ["Мы", "любим", "NLP", "!"]. Почему это важно? Потому что компьютер работает с дискретными единицами, и для него каждое слово, даже если оно отличается регистром или пунктуацией, является уникальным. Токенизация позволяет нам стандартизировать эти единицы.

Для токенизации мы часто используем такие мощные библиотеки, как NLTK (Natural Language Toolkit) и spaCy. NLTK предлагает широкий спектр токенизаторов, включая токенизаторы слов и предложений. SpaCy, в свою очередь, известен своей скоростью и эффективностью, особенно для больших объемов текста, и предоставляет более сложные модели, учитывающие контекст.

Следующий важный этап – это стемминг. Его цель – уменьшить флективные (изменяемые) формы слов до их базовой или корневой формы, называемой "стемом" (основой). Например, слова "бегу", "бежать", "бегал" могут быть сведены к стему "бег". Это помогает нам сократить количество уникальных слов в корпусе текста, что, в свою очередь, упрощает анализ и повышает эффективность моделей. Мы используем стеммеры из NLTK, такие как PorterStemmer или SnowballStemmer, которые хорошо зарекомендовали себя в наших проектах.

Лемматизация: Ключ к Глубокому Пониманию

Хотя стемминг и полезен, он имеет свои ограничения: стеммы не всегда являются реальными словами и могут быть трудно интерпретируемы. Здесь на помощь приходит лемматизация. В отличие от стемминга, лемматизация преобразует слова к их словарной форме, или лемме, которая всегда является реальным словом. Например, "бегу", "бежать", "бегал" будут сведены к лемме "бежать". Это достигается за счет использования морфологических словарей и правил, что делает процесс более точным и сохраняет семантическую целостность.

Мы предпочитаем использовать лемматизацию вместо стемминга, когда точность и сохранение смысла слов критически важны. Для этой задачи spaCy является нашим фаворитом благодаря своим высококачественным языковым моделям. Также, для языков с богатой морфологией, таких как русский, мы часто обращаемся к библиотеке Stanza, которая предоставляет продвинутые инструменты для морфологического анализа и лемматизации, значительно превосходящие простые стеммеры.

Очистка Текста: Регулярные Выражения и Удаление Шума

После токенизации, стемминга или лемматизации нам часто требуется дополнительная очистка; Это может включать удаление:

- Стоп-слов: Общеупотребительные слова, такие как "и", "в", "на", "он", которые не несут особого смысла для анализа, но увеличивают объем данных. NLTK предоставляет списки стоп-слов для многих языков, которые мы активно используем.

- Пунктуации: Знаки препинания, которые, как правило, не влияют на смысл для большинства задач NLP.

- Чисел: В зависимости от задачи, числа могут быть либо важны, либо бесполезны. Мы часто удаляем их или заменяем на специальные токены.

- Специальных символов и HTML-тегов: В текстах, полученных из веб-страниц, часто встречаются HTML-теги, URL-адреса, хештеги, упоминания пользователей.

Для этих целей мы активно используем модуль регулярных выражений (re) в Python. Регулярные выражения – это мощный инструмент для поиска и манипулирования строками, который позволяет нам эффективно удалять или заменять нежелательные паттерны в тексте. Например, мы можем легко удалить все HTML-теги, найти и заменить все URL-адреса или очистить текст от лишних пробелов. Наш опыт показывает, что мастерство владения регулярными выражениями является бесценным активом в арсенале любого NLP-специалиста.

Превращаем Слова в Числа: Векторизация Текста

После того как мы очистили и подготовили наш текст, возникает следующий вызов: как представить слова и предложения таким образом, чтобы компьютер мог их обрабатывать? Машины не понимают слов в нашем человеческом смысле; они работают с числами. Поэтому нам нужно преобразовать текстовые данные в числовой формат – процесс, который мы называем векторизацией или встраиванием (embedding). Это критически важный этап, поскольку качество числового представления текста напрямую влияет на производительность моделей машинного обучения.

За годы работы мы видели, как эволюционировали методы векторизации. От простых подсчетов слов до сложных нейросетевых моделей, способных улавливать тонкие семантические нюансы – каждый подход имеет свои преимущества и недостатки, и выбор метода часто зависит от конкретной задачи и объема данных. Мы постоянно экспериментируем с новыми техниками, чтобы добиться наилучших результатов в наших проектах.

Классические Методы: CountVectorizer и TF-IDF

Одними из первых и до сих пор широко используемых методов векторизации являются CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn. Эти методы просты в понимании и реализации, но при этом достаточно эффективны для многих задач.

-

CountVectorizer: Этот метод просто подсчитывает частоту вхождения каждого слова в каждом документе. Результатом является матрица, где строки представляют документы, а столбцы – уникальные слова (словарный запас). Значение в ячейке показывает, сколько раз данное слово появилось в данном документе. Это просто, но может привести к проблеме "проклятия размерности" для больших словарей и не учитывает важность слов.

-

TfidfVectorizer (Term Frequency-Inverse Document Frequency): Этот метод является улучшением CountVectorizer. Он не только учитывает частоту слова в документе (TF), но и его редкость во всем корпусе документов (IDF). Идея проста: слова, которые часто встречаются в одном документе, но редко во всем корпусе, считаются более важными. Это помогает нам выделить ключевые слова, которые действительно характеризуют документ, отсеивая общие слова. Мы часто используем TF-IDF для задач классификации и извлечения ключевых слов.

Эти векторизаторы являются отличной отправной точкой, особенно когда вычислительные ресурсы ограничены или требуется быстрая прототипизация. Мы часто начинаем именно с них, прежде чем переходить к более сложным моделям.

Эмбеддинги Слов: Word2Vec и GloVe с Использованием Gensim

С появлением нейронных сетей и глубокого обучения, методы векторизации текста претерпели революционные изменения. Мы получили возможность не просто считать слова, а улавливать их семантический смысл и отношения между ними. Здесь на сцену выходят Word Embeddings – плотные векторные представления слов, которые кодируют их значение.

-

Word2Vec: Разработанный Google, Word2Vec стал прорывом в представлении слов. Он использует нейронную сеть для обучения векторов слов таким образом, чтобы слова с похожим смыслом располагались близко друг к другу в многомерном векторном пространстве. Есть две основные архитектуры: Skip-gram (предсказывает контекст по слову) и CBOW (предсказывает слово по контексту). Мы активно используем Gensim для обучения и работы с моделями Word2Vec, поскольку он предоставляет эффективные реализации и позволяет легко загружать предварительно обученные модели.

-

GloVe (Global Vectors for Word Representation): Еще один популярный метод, разработанный Стэнфордским университетом. GloVe комбинирует идеи глобального матричного разложения (как в LSA) и локального контекстного окна (как в Word2Vec). Он строит векторы слов, используя глобальную статистику соо встречаемости слов. Наш опыт показывает, что GloVe часто дает отличные результаты, особенно когда требуется уловить более тонкие семантические отношения.

Эти методы позволяют нам выполнять такие удивительные вещи, как арифметические операции с векторами слов: например, "король" ー "мужчина" + "женщина" ≈ "королева". Это открывает двери для гораздо более глубокого анализа текста, чем это было возможно с классическими подходами.

Эмбеддинги Предложений и Документов: Doc2Vec и Sentence Transformers

Если Word2Vec и GloVe отлично работают на уровне слов, то как быть с целыми предложениями или документами? Здесь нам на помощь приходят методы, способные создавать векторные представления для более крупных текстовых единиц.

-

Doc2Vec (Paragraph Vector): Расширение Word2Vec, предложенное теми же авторами. Doc2Vec создает векторное представление не только для слов, но и для целых документов или абзацев. Он делает это, добавляя специальный "вектор документа" в качестве дополнительного входного параметра при обучении нейронной сети. Это позволяет нам сравнивать документы по их смысловому содержанию, находить похожие тексты или кластеризовать их. Gensim также предоставляет отличную реализацию Doc2Vec, которой мы активно пользуемся;

-

Sentence Transformers: С появлением архитектуры Трансформеров мы получили еще более мощные инструменты для создания эмбеддингов предложений. Библиотека Sentence Transformers предоставляет предварительно обученные модели, основанные на BERT, RoBERTa и других трансформерных архитектурах, которые способны генерировать высококачественные векторные представления предложений. Эти эмбеддинги отлично подходят для задач поиска семантически похожих предложений, кластеризации текстов или даже для создания систем вопросно-ответных систем. Мы были поражены их эффективностью в наших проектах.

Эти продвинутые методы позволяют нам перейти от анализа отдельных слов к пониманию общего смысла более крупных фрагментов текста, что открывает новые горизонты для создания по-настоящему интеллектуальных систем.

Глубже в Смысл: Извлечение Информации и Тематическое Моделирование

Когда текст преобразован в числовой формат, мы можем начать извлекать из него глубокий смысл и структуру. Это уже не просто работа со словами, это понимание, о чем текст, кто в нем упоминается, какие темы он затрагивает. На этом этапе мы переходим от низкоуровневой обработки к более сложным задачам, которые позволяют нам получать ценные инсайты из неструктурированных данных.

Наш путь в этой области был полон открытий. Мы видели, как из хаотичного набора документов можно выделить четкие темы, как из потока новостей автоматически извлекаются имена людей и организаций, и как системы могут самостоятельно суммировать объемные тексты. Эти возможности преображают способы взаимодействия с информацией и открывают двери для автоматизации многих рутинных задач.

Распознавание Именованных Сущностей (NER) с SpaCy и Flair

Одной из наиболее фундаментальных задач в извлечении информации является Распознавание Именованных Сущностей (NER). Это процесс идентификации и классификации именованных сущностей в тексте по предопределенным категориям, таким как имена людей, названия организаций, географические названия, даты, время, денежные суммы и т.д.. NER является основой для многих других NLP-задач, таких как вопросно-ответные системы, суммаризация или извлечение фактов.

Для NER мы активно используем две мощные библиотеки:

-

spaCy: Это наш выбор по умолчанию для многих задач NER благодаря его скорости, точности и легкости использования. spaCy поставляется с предварительно обученными моделями для различных языков, которые отлично справляются с распознаванием стандартных типов сущностей. Мы ценим его за баланс между производительностью и качеством.

-

Flair: Если нам нужна максимальная точность или работа с языками с богатой морфологией, мы обращаемся к Flair. Эта библиотека использует мощные контекстуальные строковые эмбеддинги (например, ELMo или BERT), что позволяет ей достигать выдающихся результатов в NER, особенно на сложных и специализированных корпусах. Мы также используем Flair для задач, где требуется тонкая настройка моделей под конкретные типы сущностей.

Вот небольшое сравнение этих двух библиотек для NER:

| Характеристика | SpaCy | Flair |

|---|---|---|

| Скорость | Очень высокая | Средняя (зависит от модели) |

| Точность | Высокая, для общих задач | Очень высокая, особенно с контекстными эмбеддингами |

| Простота использования | Очень простая, интуитивный API | Немного сложнее, но гибкий API |

| Поддержка языков | Множество языков, качественные модели | Множество языков, отличная поддержка языков с богатой морфологией |

| Глубокое обучение | Использует CNN/Bi-LSTM | Использует Bi-LSTM-CRF с контекстными эмбеддингами |

Тематическое Моделирование: LDA и LSI с Использованием Gensim

Представьте, что у вас есть огромная коллекция текстовых документов, и вы хотите понять, о каких основных темах в них идет речь, не читая каждый из них. Именно для этого существует тематическое моделирование – набор алгоритмов машинного обучения, которые позволяют нам автоматически обнаруживать скрытые "темы" в большом корпусе текстов. Каждая тема представляется как набор слов, которые часто встречаются вместе.

-

LDA (Latent Dirichlet Allocation): Это, пожалуй, самый популярный алгоритм тематического моделирования. LDA предполагает, что каждый документ представляет собой смесь нескольких тем, и каждая тема, в свою очередь, является смесью слов. Алгоритм пытается "обратно вывести" эти темы и распределение слов в них, основываясь на частоте слов в документах. Мы активно используем LDA через библиотеку Gensim, которая предоставляет эффективные реализации этого и других алгоритмов.

-

LSI (Latent Semantic Indexing): Один из ранних методов тематического моделирования, основанный на сингулярном разложении (SVD) матрицы "терм-документ". LSI пытается найти скрытые семантические отношения между словами и документами, проецируя их в более низкоразмерное пространство. Хотя LDA обычно дает более интерпретируемые темы, LSI до сих пор используется в некоторых задачах, особенно для поиска информации.

Тематическое моделирование – это мощный инструмент для анализа больших объемов неструктурированного текста, позволяющий нам понять общие тренды, выявить ключевые обсуждения и категоризировать документы. Мы использовали его для анализа отзывов клиентов, научных статей и новостных лент.

Вот сравнение LDA и NMF (Non-negative Matrix Factorization) – еще одного популярного метода тематического моделирования:

| Характеристика | LDA | NMF |

|---|---|---|

| Основа | Вероятностная модель (Байесовский подход) | Матричное разложение |

| Интерпретируемость тем | Высокая, темы хорошо разделены | Хорошая, но иногда менее четкая |

| Требования к данным | Частоты слов (CountVectorizer) | Частоты слов (CountVectorizer или TF-IDF) |

| Производительность | Может быть медленным на больших данных | Обычно быстрее LDA на больших данных |

| Применение | Анализ тем, категоризация документов | Анализ тем, снижение размерности |

Извлечение Ключевых Фраз и Суммаризация Текста (TextRank, RAKE)

В мире перегруженном информацией, способность быстро извлекать самую суть из длинных текстов становится бесценной. Здесь нам на помощь приходят методы извлечения ключевых фраз и автоматической суммаризации.

-

Извлечение ключевых фраз: Цель этой задачи – автоматически идентифицировать наиболее важные слова или короткие фразы, которые лучше всего описывают содержание документа. Для этого мы часто используем алгоритмы, основанные на статистических методах или графовых моделях.

-

RAKE (Rapid Automatic Keyword Extraction): Простой, но эффективный алгоритм, который определяет ключевые слова и фразы, основываясь на частоте их появления и соо встречаемости с другими словами. Мы часто используем его для быстрого получения списка ключевых терминов из текста.

-

TextRank: Это алгоритм, основанный на PageRank (алгоритме ранжирования веб-страниц Google), но адаптированный для текста. Он строит граф слов или предложений, где ребра представляют отношения соо встречаемости. Слова/предложения с более высоким "рангом" считаются более важными. TextRank может быть использован как для извлечения ключевых слов/фраз, так и для суммаризации.

Суммаризация текста: Это процесс создания краткого, но информативного изложения более длинного документа. Существует два основных подхода:

Экстрактивная суммаризация: Система выбирает наиболее важные предложения из оригинального текста и объединяет их, чтобы сформировать краткое изложение. Методы, основанные на TextRank, часто используются для этого.

Абстрактивная суммаризация: Более сложный подход, при котором система генерирует новые предложения, которые могут не присутствовать в оригинальном тексте, но передают его основной смысл. Это требует более продвинутых моделей глубокого обучения, таких как Трансформеры.

Мы используем эти методы для создания кратких обзоров новостей, автоматического формирования мета-описаний для статей или для быстрого анализа объемных юридических документов.

"Язык – это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Эмоции и Авторский Почерк: Анализ Тональности и Стилистики

Текст – это не просто набор слов; это отражение человеческих мыслей, чувств и намерений. Способность машин улавливать эти тонкие нюансы открывает огромные возможности для бизнеса, исследований и социального анализа. Мы говорим об анализе тональности, стилистики и даже распознавании сарказма – задач, которые еще недавно казались уделом только человеческого интеллекта.

Наш опыт показывает, что понимание эмоциональной окраски текста может кардинально изменить способ взаимодействия компаний с клиентами, политиков с избирателями и даже людей друг с другом. Мы научились не только определять, позитивен ли отзыв, но и выявлять скрытые недовольства, анализировать изменения настроения со временем и даже предсказывать поведенческие паттерны на основе текстовых данных.

Анализ Тональности (Sentiment Analysis) с VADER и TextBlob

Анализ тональности, или сентимент-анализ, – это процесс определения эмоциональной окраски текста. Мы стремимся понять, выражает ли автор позитивное, негативное или нейтральное отношение к объекту обсуждения. Это одна из самых востребованных задач в NLP, применяемая для анализа отзывов клиентов, постов в социальных сетях, новостных статей и многого другого.

-

VADER (Valence Aware Dictionary and sEntiment Reasoner): Это лексический и основанный на правилах анализатор тональности, который специально разработан для анализа тональности в социальных сетях. VADER не требует обучения на размеченных данных и отлично справляется с текстами, содержащими смайлики, сокращения, знаки препинания и акронимизацию. Мы часто используем VADER для быстрого анализа тональности коротких текстов, таких как твиты или комментарии.

-

TextBlob: Эта библиотека предоставляет простой API для выполнения общих задач NLP, включая анализ тональности. TextBlob использует предобученные модели, которые возвращают оценку полярности (от -1.0 до 1.0, где -1.0 – негативно, 1.0 – позитивно) и субъективности (от 0.0 до 1.0, где 0.0 – объективно, 1.0 – субъективно). Это отличный инструмент для быстрого старта и прототипирования.

Однако, анализ тональности имеет свои подводные камни, особенно когда речь идет о сарказме, иронии или двойных отрицаниях. Мы постоянно ищем способы улучшить точность наших моделей, используя более сложные подходы, включая глубокое обучение и контекстно-зависимые эмбеддинги, чтобы справиться с этими вызовами.

Работа с Эмодзи и Сленгом в Современных Текстах

Современный язык, особенно в цифровом пространстве, постоянно эволюционирует. Эмодзи, сленг, аббревиатуры и специфические выражения стали неотъемлемой частью нашего общения. Игнорировать их при анализе текста означает упустить значительную часть информации и эмоционального контекста. Мы столкнулись с этой проблемой, анализируя сообщения в социальных сетях и чатах.

Для работы с эмодзи мы используем специальные библиотеки, которые позволяют нам преобразовывать эмодзи в текстовые описания (например, "😄" -> ":grinning_face_with_smiling_eyes:"). Это помогает нашим моделям лучше понимать их значение. Что касается сленга, то здесь задача сложнее. Мы либо используем пользовательские словари сленга и его нормализованными эквивалентами, либо обучаем модели на больших корпусах текстов, содержащих сленг, чтобы они могли самостоятельно выявлять и интерпретировать его значение. Иногда мы также используем методы векторизации, такие как FastText, который хорошо работает с редкими и внесловарными словами, что особенно полезно для обработки сленга и опечаток.

Определение Авторства и Стилистики Текстов

Каждый из нас обладает уникальным "почерком" в письме. Это не только набор слов, но и предпочтения в грамматике, синтаксисе, длине предложений, использовании пунктуации. Анализ стилистики текстов и определение авторства – это захватывающие задачи, которые позволяют нам идентифицировать автора текста или анализировать его характерные особенности.

Для этих целей мы используем ряд лингвистических признаков (метрики):

- Средняя длина слова и предложения.

- Использование конкретных частей речи (существительные, глаголы, прилагательные).

- Частота использования определенных стоп-слов или функциональных слов.

- Разнообразие лексики (например, соотношение уникальных слов к общему количеству слов).

- Сложность синтаксических конструкций.

Мы применяем методы машинного обучения, такие как SVM или наивный байесовский классификатор, для обучения моделей на этих стилистических признаках. Это позволяет нам не только определять авторство, но и анализировать, как меняется стиль письма с течением времени, или выявлять тексты, написанные в определенном стиле. Это может быть полезно в криминалистике, литературоведении или даже для анализа политических речей.

Революция Трансформеров: Новый Уровень NLP

Если Word Embeddings стали прорывом, то появление архитектуры Трансформеров и моделей, таких как BERT, GPT, произвело настоящую революцию в мире NLP. Мы наблюдали, как эти модели, основанные на механизме внимания (attention mechanism), превзошли все предыдущие подходы во множестве задач, от машинного перевода до генерации текста.

До трансформеров, рекуррентные нейронные сети (RNNs) и LSTM были вершиной глубокого обучения для последовательных данных, включая текст. Но они страдали от проблемы "дальних зависимостей" и были медленными в обучении из-за своей последовательной природы. Трансформеры решили эти проблемы, позволив обрабатывать все токены в последовательности одновременно и эффективно улавливать зависимости на любом расстоянии. Этот сдвиг открыл эру "больших языковых моделей" (Large Language Models, LLMs), которые теперь лежат в основе многих передовых систем NLP.

Hugging Face и Предварительно Обученные Модели (BERT, GPT)

Центральным элементом этой революции стала библиотека Hugging Face Transformers. Она предоставляет удобный интерфейс и огромное количество предварительно обученных моделей, таких как BERT, GPT-2, RoBERTa, T5 и многие другие. Эти модели обучаются на колоссальных объемах текстовых данных (например, всей Википедии, книгах и веб-страницах), что позволяет им изучать сложные языковые паттерны и семантические отношения.

-

BERT (Bidirectional Encoder Representations from Transformers): Разработанный Google, BERT стал первой по-настоящему двунаправленной трансформерной моделью, которая учитывает контекст слова как слева, так и справа. Это позволяет ему лучше понимать смысл слова в предложении. Мы используем BERT для задач классификации текста, распознавания именованных сущностей (NER) и ответов на вопросы.

-

GPT (Generative Pre-trained Transformer): Разработанный OpenAI, GPT – это семейство моделей, ориентированных на генерацию текста. Они могут продолжать текст, отвечать на вопросы, переводить и даже писать код. GPT-подобные модели стали основой для создания многих креативных и интерактивных приложений NLP.

Одной из ключевых концепций в работе с этими моделями является тонкая настройка (Fine-tuning). Это процесс адаптации предварительно обученной большой модели к конкретной, более узкой задаче с использованием небольшого набора размеченных данных. Вместо того чтобы обучать модель с нуля (что требует огромных ресурсов), мы берем уже "умную" модель и "доучиваем" ее, что значительно экономит время и вычислительные мощности, а также позволяет достигать очень высоких результатов даже на небольших датасетах.

PyTorch/TensorFlow для Создания Нейросетей NLP (LSTM)

Хотя трансформеры сейчас доминируют, важно помнить о фундаментальных архитектурах глубокого обучения, которые проложили им путь. Рекуррентные нейронные сети (RNNs), особенно их продвинутые варианты, такие как LSTM (Long Short-Term Memory), долгое время были стандартом для задач NLP, связанных с последовательностями, таких как машинный перевод, генерация текста и анализ тональности.

-

LSTM: Эти сети способны "запоминать" информацию на длительных промежутках времени, что критически важно для понимания контекста в длинных предложениях. Они решают проблему "исчезающего градиента", с которой сталкивались простые RNNs.

Мы используем фреймворки глубокого обучения, такие как PyTorch и TensorFlow/Keras, для создания и обучения наших собственных нейросетей для NLP. Хотя для многих задач мы теперь обращаемся к трансформерам, понимание LSTM и других базовых архитектур глубокого обучения остается фундаментальным. Эти фреймворки предоставляют нам полный контроль над архитектурой модели, процессом обучения и оптимизацией, что незаменимо для исследовательских проектов и создания кастомных решений.

NLP в Действии: От Чат-ботов до Фактчекинга

Теория и алгоритмы – это одно, но настоящее волшебство начинается, когда мы применяем эти знания для решения реальных проблем. NLP превращает абстрактные концепции в осязаемые инструменты, которые меняют нашу повседневную жизнь. Мы видели, как эти технологии помогают компаниям улучшать обслуживание клиентов, исследователям – анализировать огромные массивы данных, а обычным людям – эффективнее взаимодействовать с информацией.

В этом разделе мы хотим поделиться нашим опытом в разработке различных систем, которые демонстрируют практическую мощь NLP. От создания интеллектуальных помощников до автоматической проверки фактов – возможности Python и специализированных библиотек практически безграничны. Мы постоянно ищем новые способы применения NLP, чтобы сделать мир более информативным и удобным.

Разработка Чат-ботов на Python (Rasa Framework)

Чат-боты стали повсеместными, и мы активно участвуем в их разработке. Создание эффективного чат-бота – это сложная задача, требующая не только понимания NLP, но и умения проектировать диалоги, управлять состояниями и интегрироваться с внешними системами. Для разработки сложных, контекстно-зависимых чат-ботов мы часто используем фреймворк Rasa.

Rasa позволяет нам:

-

Распознавать намерения пользователя (Intent Recognition): Определять, что пользователь хочет сделать (например, "заказать пиццу", "узнать погоду").

-

Извлекать сущности (Entity Extraction): Выявлять ключевую информацию из запроса пользователя (например, "пепперони" из "заказать пиццу пепперони").

-

Управлять диалогом (Dialogue Management): Поддерживать контекст разговора и определять следующий шаг в диалоге, даже если пользователь отклоняется от темы.

Благодаря Rasa, мы смогли создать чат-ботов, которые не просто отвечают на вопросы, а ведут осмысленный диалог, помогают с решением проблем и автоматизируют рутинные задачи, значительно улучшая взаимодействие с пользователями.

Системы Вопросно-ответных Систем (QA)

Вопросно-ответные системы (QA) – это еще одна область, где NLP показывает свою мощь. Цель QA-системы – автоматически отвечать на вопросы пользователей, извлекая информацию из заданного корпуса документов или используя общие знания. Это значительно отличается от простого поиска документов, поскольку QA-системы должны не просто найти релевантные документы, а дать точный ответ на вопрос.

Мы разрабатываем QA-системы, используя комбинацию методов:

-

Поиск релевантных документов: Сначала мы используем методы поиска информации (например, на основе TF-IDF или векторных эмбеддингов), чтобы найти документы, которые, вероятно, содержат ответ.

-

Извлечение ответа: Затем, с помощью продвинутых моделей глубокого обучения, часто основанных на трансформерах (например, BERT), мы извлекаем точный фрагмент текста из найденных документов, который является ответом на вопрос. Эти модели обучаются на датасетах, где для каждого вопроса указан фрагмент текста, содержащий ответ.

Такие системы находят применение в корпоративном поиске, клиентской поддержке и образовании, позволяя пользователям быстро получать нужную информацию без необходимости прочитывать длинные тексты.

Машинный Перевод и Многоязычность (Polyglot, Stanza)

Преодоление языковых барьеров – одна из самых амбициозных задач в NLP. Машинный перевод значительно продвинулся вперед благодаря глубокому обучению и трансформерам. Мы работаем с системами машинного перевода, используя как готовые модели (например, от Hugging Face), так и разрабатывая собственные решения для узкоспециализированных текстов.

Для работы с многоязычными текстовыми корпусами и языками с богатой морфологией мы обращаемся к следующим библиотекам:

-

Polyglot: Это библиотека, которая предоставляет широкий спектр функций для NLP на многих языках, включая токенизацию, распознавание именованных сущностей, анализ тональности и определение языка. Она особенно полезна для работы с менее распространенными языками, для которых нет обширных ресурсов в других библиотеках.

-

Stanza: Разработанная Стэнфордским университетом, Stanza предлагает высокоточные модели для многих языков, включая русский. Она предоставляет полный набор инструментов для синтаксического анализа, POS-теггинга, лемматизации и NER, что делает ее незаменимой для глубокого анализа многоязычных текстов.

Наши проекты по машинному переводу и многоязычному анализу помогают компаниям работать на международных рынках, анализировать глобальные тренды и обеспечивать эффективную коммуникацию между различными культурами.

Веб-скрейпинг для Данных (Beautiful Soup)

Для многих NLP-проектов нам требуются большие объемы текстовых данных. Часто эти данные доступны в интернете, но не в структурированном виде. Здесь на помощь приходит веб-скрейпинг – процесс автоматического извлечения данных с веб-страниц. Нашим незаменимым инструментом для этой задачи является библиотека Beautiful Soup.

Beautiful Soup позволяет нам:

- Парсить HTML и XML документы.

- Искать элементы по тегам, классам, идентификаторам и другим атрибутам.

- Извлекать текст из определенных частей страницы.

Мы используем Beautiful Soup в сочетании с библиотекой requests для получения веб-страниц и последующего извлечения необходимого текстового контента, например, статей, отзывов, новостей. Это позволяет нам формировать кастомные датасеты для обучения наших моделей, адаптированных под специфические задачи.

Обработка PDF (PyMuPDF) и других форматов

Текстовые данные не всегда представлены в удобном для обработки формате, таком как чистый текст или HTML. Часто нам приходится сталкиваться с документами в формате PDF, которые могут содержать сложную структуру, изображения и таблицы. Извлечение текста из PDF-файлов – это отдельная задача, которая требует специализированных инструментов. Для этого мы используем библиотеку PyMuPDF (также известную как Fitz).

PyMuPDF – это высокопроизводительная библиотека, которая позволяет нам:

- Извлекать текст из PDF-документов, сохраняя при этом его структуру и порядок.

- Работать с изображениями и векторной графикой внутри PDF.

- Обрабатывать зашифрованные PDF-файлы.

Мы применяем PyMuPDF для автоматического анализа юридических документов, извлечения информации из отчетов и научных публикаций, которые часто распространяются в формате PDF; Это позволяет нам интегрировать эти важные источники данных в наши NLP-паайплайны.

Оценка Качества NER-моделей (F1-score, Precision, Recall)

Разработка NLP-модели – это только часть работы. Критически важно уметь оценивать ее качество, чтобы понимать, насколько хорошо она справляется со своей задачей и где есть возможности для улучшения. Для задач классификации и, в частности, для NER, мы используем стандартные метрики, которые помогают нам количественно измерять производительность наших моделей:

-

Precision (Точность): Какая доля из сущностей, предсказанных моделью как положительные, действительно являются положительными? (TP / (TP + FP))

-

Recall (Полнота): Какая доля из всех истинно положительных сущностей была корректно обнаружена моделью? (TP / (TP + FN))

-

F1-score (F-мера): Гармоническое среднее Precision и Recall. Эта метрика особенно полезна, когда существует дисбаланс между классами или когда нам важно найти баланс между точностью и полнотой. (2 * (Precision * Recall) / (Precision + Recall))

Мы используем эти метрики, чтобы сравнивать различные модели, оценивать влияние изменений в предобработке или архитектуре модели и убеждаться, что наши решения соответствуют требованиям к производительности. Понимание этих метрик позволяет нам не просто создавать модели, а создавать эффективные модели.

Трудности и Горизонты: С Чем Сталкиваемся и Куда Движемся

Путешествие в мир NLP, как и любое другое приключение, не обходится без трудностей. Мы сталкиваемся с проблемами, которые требуют творческого подхода и глубокого понимания как лингвистики, так и машинного обучения. Но именно эти вызовы делают нашу работу такой увлекательной и значимой. Каждый раз, когда мы преодолеваем очередное препятствие, мы чувствуем, что делаем еще один шаг к созданию по-настоящему интеллектуальных систем, способных понимать и генерировать человеческий язык.

Мы постоянно следим за новейшими исследованиями и разработками, потому что область NLP развивается с невероятной скоростью. То, что вчера казалось фантастикой, сегодня уже становится стандартом. Мы верим, что будущее NLP принесет еще больше удивительных прорывов, и мы готовы быть на переднем крае этих изменений.

Проблемы Обработки Неполных и Ошибочных Данных

Реальные текстовые данные редко бывают идеальными. Мы часто сталкиваемся с неполными, ошибочными или зашумленными данными. Это могут быть опечатки, грамматические ошибки, пропущенные слова, неформальный язык, а также неструктурированный ввод. Такие данные могут значительно снизить производительность наших NLP-моделей.

Для борьбы с этими проблемами мы используем различные стратегии:

-

Очистка данных: Активно применяем регулярные выражения для удаления лишних символов, HTML-тегов, унификации форматов. Разрабатываем инструменты для очистки текста от HTML-тегов и нормализации пунктуации.

-

Исправление орфографии и грамматики: Используем библиотеки, такие как TextBlob или разрабатываем собственные инструменты для проверки грамматики и исправления орфографии. Иногда применяем алгоритмы сравнения строк (например, из библиотеки Jellyfish) для выявления и исправления близких по написанию слов.

-

Устойчивые модели: Обучаем модели на данных, которые содержат некоторый уровень шума, чтобы сделать их более устойчивыми к неидеальному вводу.

-

Нормализация сленга: Для работы с неформальным языком, мы создаем словари для нормализации сленговых выражений.

Наш подход заключается в том, чтобы максимально очистить данные на этапе предобработки, но также обучить модели быть достаточно «умными», чтобы справляться с оставшимся шумом.

Обработка Больших Текстовых Массивов (Big Data NLP)

В современном мире объемы текстовых данных растут экспоненциально. Анализ социальных сетей, новостных лент, клиентских запросов – все это генерирует петабайты информации. Работа с такими большими текстовыми массивами (Big Data NLP) требует не только эффективных алгоритмов, но и масштабируемых инфраструктур.

Мы сталкиваемся с такими вызовами, как:

-

Вычислительные ресурсы: Обучение сложных моделей на огромных датасетах требует значительных мощностей CPU и GPU. Мы используем GPU-ускорение для обработки текста, особенно при работе с трансформерными моделями.

-

Память: Хранение и обработка больших словарей и векторных представлений может быстро исчерпать доступную оперативную память.

-

Время обработки: Даже самые эффективные алгоритмы могут работать слишком долго на больших объемах данных.

Для решения этих проблем мы используем распределенные системы обработки данных (например, Apache Spark), оптимизированные библиотеки (такие как Gensim для больших корпусов), а также методы семплирования и инкрементального обучения. Наша цель – обеспечить, чтобы наши NLP-решения оставались масштабируемыми и производительными, независимо от объема входящих данных.

Этика и Предвзятость в Моделях NLP

По мере того как NLP-модели становятся все более мощными и проникают во все сферы нашей жизни, мы не можем игнорировать важные этические вопросы. Модели обучаются на данных, созданных людьми, а люди, к сожалению, не лишены предвзятости; Это означает, что наши модели могут невольно усваивать и воспроизводить эти предубеждения, что приводит к несправедливым или дискриминационным результатам.

Например, модель, обученная на текстах, где определенные профессии ассоциируются только с одним полом, может ошибочно классифицировать «медсестру» как женщину, а «инженера» как мужчину. Мы активно работаем над тем, чтобы наши модели были справедливыми, прозрачными и подотчетными. Это включает в себя:

-

Анализ предвзятости: Мы используем специализированные инструменты для выявления и измерения предвзятости в эмбеддингах слов и моделях.

-

Сбалансированные датасеты: Стремимся использовать разнообразные и сбалансированные обучающие данные, чтобы минимизировать влияние существующих предубеждений.

-

Дебаесинг: Применяем методы для «очистки» эмбеддингов от гендерных, расовых или других нежелательных предвзятостей.

-

Интерпретируемость моделей: Разрабатываем методы, которые позволяют нам понять, почему модель приняла то или иное решение, что критически важно для выявления и устранения предвзятости.

Мы верим, что ответственное развитие NLP – это не только вопрос технических достижений, но и глубокого понимания социального контекста и этических последствий наших разработок. Мы стремимся создавать технологии, которые приносят пользу всем, без исключения.

Вот и подошло к концу наше путешествие по захватывающему миру Обработки Естественного Языка на Python. Мы с вами прошли долгий путь – от самых основ предобработки текста до сложных архитектур трансформеров, от анализа эмоций до создания умных чат-ботов. Мы увидели, как Python, с его богатой экосистемой библиотек, стал настоящим центром для инноваций в этой области, позволяя нам превращать сырой текст в ценные инсайты и интеллектуальные решения.

Наш опыт показывает, что NLP – это не просто набор алгоритмов; это мощный инструмент, который дает нам возможность лучше понимать человеческий язык, а значит, и друг друга. Мы постоянно учимся, экспериментируем и открываем новые горизонты. Каждый проект приносит новые вызовы и новые решения, и это делает нашу работу такой вдохновляющей.

Мы призываем вас не бояться экспериментировать, погружаться в документацию, пробовать разные библиотеки и подходы. Мир NLP огромен и постоянно меняется, и всегда есть что-то новое для изучения. Возможно, именно вы совершите следующий прорыв! Мы надеемся, что эта статья вдохновила вас и дала прочную основу для ваших собственных проектов. Удачи в ваших NLP-приключениях, и до новых встреч в нашем блоге! На этом статья заканчивается.

Подробнее

| Основы NLTK | SpaCy NER | Gensim LDA | Word2Vec в Python | Анализ тональности VADER |

| Трансформеры Hugging Face | Чат-боты Rasa | Векторизация TF-IDF | Лемматизация SpaCy | BERT классификация |

>