- Раскрываем Тайны Текста: Наш Путь в Мире Обработки Естественного Языка с Python

- Первые Шаги: От Сырого Текста к Смысловым Частицам

- NLTK и spaCy: Наши Первые Помощники в Токенизации и Стемминге

- Регулярные Выражения: Точность в Очистке Данных

- От Слов к Числам: Векторизация и Представление Текста

- Классические Векторизаторы: CountVectorizer и TfidfVectorizer

- Word Embeddings: Когда Слова Обретают Смысл в Пространстве

- За Гранью Слов: Понимание Контекста и Смысла

- Распознавание Именованных Сущностей (NER) и Тематическое Моделирование

- Анализ Тональности: Чувства в Коде

- Классификация Текстов: Автоматическая Организация Информации

- Революция Трансформеров: Новый Уровень Понимания Языка

- От BERT к Генерации Текста: Безграничные Возможности

- Инструменты для Специализированных Задач и Работы с Данными

- Извлечение Информации: От Веб-Страниц до PDF

- Работа с Многоязычными Корпусами и Нестандартными Текстами

- Визуализация и Оценка Качества

- Продвинутые Применения и Будущие Направления

- Создание Своих Систем и Инструментов

- NLP в Реальном Времени и Big Data

- Инновационные Применения

Раскрываем Тайны Текста: Наш Путь в Мире Обработки Естественного Языка с Python

Привет, дорогие читатели и коллеги по цеху! Мы, как заядлые исследователи цифровых джунглей, постоянно сталкиваемся с огромным, непрерывным потоком информации․ Большая часть этой информации представлена в виде текста – от сообщений в социальных сетях до юридических документов и научных статей․ Представьте, сколько ценных данных скрыто в этих словах, если бы мы только могли их "понять"! Именно здесь на сцену выходит Обработка Естественного Языка, или NLP (Natural Language Processing) – удивительная область, которая позволяет машинам не просто читать текст, но и интерпретировать его, извлекать смысл и даже генерировать новый․

За годы нашего погружения в мир Python и его бесчисленных библиотек, мы накопили значительный опыт в работе с текстом․ Мы видели, как простые инструменты превращаются в мощные аналитические системы, способные решать самые сложные задачи – от определения тональности отзывов до автоматического перевода и даже создания чат-ботов, которые кажутся почти человечными․ Сегодня мы хотим поделиться с вами нашим путешествием, рассказать о ключевых концепциях и незаменимых инструментах, которые стали нашими верными спутниками в этом увлекательном приключении․ Приготовьтесь, ведь мы собираемся глубоко погрузиться в мир, где слова обретают новую жизнь благодаря коду!

Первые Шаги: От Сырого Текста к Смысловым Частицам

Прежде чем компьютер сможет "понять" человеческий язык, текст необходимо подготовить․ Это похоже на то, как повар подготавливает ингредиенты перед приготовлением изысканного блюда․ Мы называем этот процесс предобработкой текста, и он является фундаментом для любых последующих аналитических задач․ Без качественной предобработки результаты даже самых сложных моделей будут, мягко говоря, неудовлетворительными․ Мы научились ценить каждый этап этого процесса․

NLTK и spaCy: Наши Первые Помощники в Токенизации и Стемминге

Начало нашего пути в NLP было неразрывно связано с библиотекой NLTK (Natural Language Toolkit)․ Это, по сути, "швейцарский армейский нож" для начинающего NLP-инженера․ NLTK предоставил нам первые инструменты для токенизации – процесса разбиения текста на отдельные слова или фразы, которые мы называем токенами․ Это базовый, но критически важный шаг․ Без него весь текст воспринимается как одна большая строка символов, что совершенно бесполезно для анализа․ Мы использовали различные токенизаторы: от простых, разбивающих по пробелам, до более сложных, учитывающих пунктуацию и сокращения․

Следом за токенизацией мы столкнулись с необходимостью нормализации слов․ Английские слова "run", "running", "ran" по сути описывают одно и то же действие, но в разных формах․ Для анализа важно привести их к единой основе․ Здесь нам на помощь пришли стемминг и лемматизация․ Стемминг, как правило, отсекает окончания слов, приводя их к "корню" (например, "connection" -> "connect"), но может создавать несуществующие слова․ Лемматизация, в свою очередь, использует словарные знания для приведения слова к его базовой форме (лемме), что всегда является действительным словом․ Мы часто сравнивали эти два подхода, и для многих задач, особенно в начале, стемминг был достаточен из-за своей простоты и скорости․ Однако для более глубокого анализа мы всегда склонялись к лемматизации․

| Метод | Описание | Пример (англ․) | Преимущества | Недостатки |

|---|---|---|---|---|

| Токенизация | Разбиение текста на отдельные единицы (слова, знаки препинания)․ | "Hello, world!" -> ["Hello", ",", "world", "!"] | Основа для любого NLP․ | Разные языки, сокращения, эмодзи требуют специфичных правил․ |

| Стемминг | Отсечение окончаний для приведения слова к его "корню"․ | "running" -> "run", "connection" -> "connect" | Быстрый, простой в реализации․ | Может создавать несуществующие слова, иногда слишком агрессивен․ |

| Лемматизация | Приведение слова к его словарной форме (лемме) с использованием морфологического анализа․ | "better" -> "good", "running" -> "run" | Возвращает реальные слова, более точна․ | Медленнее, требует словарных данных․ |

По мере роста наших проектов и требований к скорости и точности, мы стали активно использовать библиотеку spaCy․ Это настоящая находка для продакшн-систем․ spaCy предлагает невероятно быстрые и эффективные модели для токенизации, лемматизации и POS-теггинга (разметки частей речи), которые работают "из коробки" и отлично справляются с многоязычными текстами, включая русский․ Мы обнаружили, что spaCy значительно упрощает жизнь, когда дело доходит до продвинутой лемматизации и обработки языков с богатой морфологией, таких как наш родной русский․ Это позволило нам перейти от базовой обработки к более глубокому синтаксическому анализу․

Регулярные Выражения: Точность в Очистке Данных

Параллельно с использованием специализированных библиотек, мы всегда держали в арсенале регулярные выражения (библиотека `re`)․ Эти мощные инструменты незаменимы для тонкой предобработки: удаления HTML-тегов, очистки текста от пунктуации, извлечения дат и чисел, нормализации сленга или работы с эмодзи․ С их помощью мы можем создавать очень точные паттерны для поиска и замены, что позволяет нам буквально "вычищать" данные до состояния, пригодного для дальнейшего анализа․ Например, для анализа тональности сообщений в социальных сетях, где изобилие эмодзи и сленга, регулярные выражения – это наше спасение․

Мы часто сталкивались с проблемой неструктурированного текста, где данные содержат много "шума" – лишних символов, повторяющихся слов, URL-адресов, которые не несут смысловой нагрузки․ Регулярные выражения позволили нам разработать эффективные инструменты для очистки данных, гарантируя, что на вход нашим моделям поступает только релевантная информация․ Это критически важно, поскольку "мусор на входе" неизбежно приводит к "мусору на выходе"․

От Слов к Числам: Векторизация и Представление Текста

Компьютеры, в отличие от людей, не понимают слова․ Они понимают числа․ Чтобы текст стал доступен для алгоритмов машинного обучения, его необходимо преобразовать в числовое представление – векторы․ Это один из самых захватывающих этапов, потому что именно здесь мы начинаем видеть, как абстрактные концепции языка превращаются в математические объекты, с которыми можно работать․

Классические Векторизаторы: CountVectorizer и TfidfVectorizer

Наши первые эксперименты с векторизацией текста начались с CountVectorizer из библиотеки Scikit-learn․ Этот метод довольно прост: он подсчитывает частоту каждого слова в документе и создает вектор, где каждая позиция соответствует уникальному слову из всего корпуса текстов․ Это позволяет нам получить представление о "содержании" документа․ Однако у него есть недостаток: очень частые слова, такие как "и", "в", "на" (так называемые стоп-слова), могут искажать картину, так как они встречаются почти везде и не несут особой смысловой нагрузки․

Чтобы решить эту проблему, мы перешли к использованию TfidfVectorizer (Term Frequency-Inverse Document Frequency)․ Этот метод не только учитывает частоту слова в документе (TF), но и его редкость во всем корпусе текстов (IDF)․ Таким образом, слова, которые часто встречаются в одном документе, но редко в других, получают больший "вес", что делает их более значимыми для определения уникальности документа․ Это был огромный шаг вперед для таких задач, как классификация текстов или поиск похожих документов․

Мы разрабатывали собственные векторизаторы текста, комбинируя различные предобработки (лемматизация, удаление стоп-слов) с этими базовыми подходами․ Это позволило нам адаптировать процесс векторизации под специфические требования наших проектов, будь то анализ текстов отзывов клиентов или категоризация статей․

Word Embeddings: Когда Слова Обретают Смысл в Пространстве

Классические методы, хотя и полезны, имеют ограничения․ Они не учитывают семантическую близость слов: "король" и "королева" могут быть очень далеки друг от друга в векторном пространстве, если они редко встречаются вместе․ И здесь на помощь приходят Word Embeddings – методы, которые позволяют представить слова в виде плотных векторов чисел таким образом, что семантически близкие слова оказываются близко друг к другу в многомерном пространстве․ Это было поистине революционным открытием для нас․

Мы активно использовали библиотеку Gensim для работы с Word2Vec и GloVe․ Word2Vec, разработанный Google, позволяет обучать модели, которые предсказывают слово на основе его контекста (CBOW) или контекст на основе слова (Skip-gram)․ GloVe (Global Vectors for Word Representation) от Стэнфорда, в свою очередь, строит векторы, основываясь на глобальной статистике совместной встречаемости слов․ Эти методы позволили нам создавать векторы слов, которые улавливают сложные семантические и синтаксические отношения․ Мы могли наблюдать, как вектор "король" ー "мужчина" + "женщина" приближается к вектору "королева" – это было волшебство!

Помимо отдельных слов, мы также начали работать с векторизацией предложений и целых документов․ Doc2Vec (расширение Word2Vec) и Sentence Transformers стали нашими инструментами для этой цели․ Они позволяют создавать плотные векторные представления для более крупных текстовых единиц, что особенно полезно для задач, где важен контекст всего предложения или документа, например, для поиска похожих документов или суммаризации текста․

За Гранью Слов: Понимание Контекста и Смысла

После того как текст преобразован в числа, мы можем применять мощные алгоритмы машинного обучения для решения самых разнообразных задач․ Это та часть, где NLP действительно начинает раскрывать свой потенциал, переходя от простой обработки к глубокому пониманию․

Распознавание Именованных Сущностей (NER) и Тематическое Моделирование

Одной из первых задач, где мы оценили мощь NLP, стало Распознавание Именованных Сущностей (NER)․ Это процесс идентификации и классификации именованных сущностей в тексте, таких как имена людей, названия организаций, географические местоположения, даты и т․д․ spaCy оказался здесь незаменимым инструментом, предлагая быстрые и точные модели NER "из коробки"․ Мы использовали его для извлечения ключевой информации из юридических документов, новостных статей и даже медицинских записей․ Позднее, с появлением более продвинутых методов, мы стали использовать библиотеку Flair и даже тонкую настройку (Fine-tuning) предварительно обученных трансформерных моделей, таких как BERT, для достижения еще большей точности в специфических доменах․

Для понимания основных тем, скрытых в больших коллекциях документов, мы обратились к Тематическому Моделированию․ Библиотека Gensim с ее реализациями LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing) стала нашим проводником в этом мире․ LDA позволяет нам обнаружить скрытые "темы" в корпусе текстов, представляя каждый документ как смесь этих тем, а каждую тему – как распределение слов․ Мы использовали тематическое моделирование для анализа отзывов о продуктах, выявления скрытых тем в блогах и форумах, а также для сравнения моделей тематического моделирования (LDA vs NMF) в различных сценариях․ Это помогло нам понять общие настроения и интересы нашей аудитории, а также автоматизировать категоризацию статей․

Анализ Тональности: Чувства в Коде

Когда мы начали работать с отзывами клиентов и сообщениями в социальных сетях, одной из самых востребованных задач стал Анализ Тональности (Sentiment Analysis)․ Мы хотели понять, что люди чувствуют по отношению к продуктам, услугам или даже политическим событиям․ Для простых случаев мы использовали VADER (Valence Aware Dictionary and sEntiment Reasoner) – лексический анализатор тональности, который хорошо работает с социальными медиа благодаря своей способности обрабатывать сленг и эмодзи․ Для более сложных задач мы применяли модели машинного обучения (SVM, наивный байесовский классификатор) с использованием Scikit-learn, обучая их на размеченных данных․

Анализ тональности – это не просто "положительно/отрицательно"․ Мы углубились в анализ тональности финансовых новостей, сообщений в социальных сетях с учетом сарказма, и даже отзывов о фильмах․ Это требовало более тонких подходов и использования контекстно-зависимых моделей, иногда даже с применением трансформеров․ Анализ тональности помог нам не только измерять уровень удовлетворенности, но и выявлять проблемные зоны и тенденции, например, анализируя поведенческие паттерны в чатах или отзывы о продуктах по категориям․

"Язык – это дорожная карта культуры․ Он показывает, откуда пришли ее люди и куда они идут․"

— Рита Мэй Браун

Классификация Текстов: Автоматическая Организация Информации

Представьте себе тысячи новостных статей, отзывов или документов, которые нужно отсортировать по категориям․ Вручную это невозможно․ Здесь нам на помощь пришла классификация текстов․ Scikit-learn стал нашим основным инструментом для этой задачи․ Мы использовали различные алгоритмы машинного обучения, такие как SVM (Support Vector Machines), наивный байесовский классификатор, а позже и более сложные модели, обученные на предварительно векторизованных текстах․ Это позволило нам разрабатывать системы автоматической категоризации новостей и статей, распределять отзывы по тематическим группам и даже анализировать стилистику текстов для определения авторского почерка․

Особый интерес для нас представляло применение BERT для задач классификации, а также использование PyTorch/TensorFlow для создания нейросетей NLP, включая LSTM-сети․ Эти методы позволили нам достичь высокой точности, особенно в задачах с большим объемом данных и сложными паттернами․

Революция Трансформеров: Новый Уровень Понимания Языка

Если Word Embeddings стали большим шагом вперед, то появление архитектуры Трансформеров (особенно моделей, таких как BERT, GPT, T5) стало настоящей революцией в NLP․ Эти модели, часто используемые через библиотеку Hugging Face, способны понимать контекст слов не просто на уровне ближайших соседей, но и по всему предложению, улавливая сложнейшие зависимости и нюансы․

От BERT к Генерации Текста: Безграничные Возможности

Мы активно использовали BERT (Bidirectional Encoder Representations from Transformers) для множества задач: от продвинутого NER и классификации до разработки систем вопросно-ответных систем (QA)․ Способность BERT понимать текст в обоих направлениях (контекст до и после слова) дала беспрецедентную точность․ Мы научились тонкой настройке (Fine-tuning) предварительно обученных моделей, адаптируя их под наши специфические задачи с относительно небольшим объемом размеченных данных․

А затем появились модели, способные не только понимать, но и генерировать текст․ Transformer-модели для генерации текста (GPT) открыли для нас совершенно новые горизонты․ Мы экспериментировали с ними для автоматического создания тегов, суммаризации текста (как экстрактивной, так и абстрактивной), генерации диалогов для чат-ботов и даже, к нашему удивлению, для генерации кода! Это позволило нам разрабатывать системы суммаризации текста, которые не просто вырезают ключевые предложения, но и перефразируют их, создавая связный и краткий пересказ․

Работа с трансформерными архитектурами для распознавания эмоций и анализа тональности сообщений в социальных сетях с учетом сарказма показала, насколько глубоко эти модели способны улавливать человеческие нюансы․

Инструменты для Специализированных Задач и Работы с Данными

Помимо основных библиотек, наш арсенал пополнился множеством специализированных инструментов, которые облегчают работу с текстом на разных этапах․

Извлечение Информации: От Веб-Страниц до PDF

Часто исходные текстовые данные находятся не в удобном формате․ Мы освоили веб-скрейпинг текста с помощью библиотеки Beautiful Soup․ Это позволило нам автоматически извлекать контент с веб-страниц, формируя огромные текстовые корпусы для анализа․ Для работы с документами в формате PDF нашим незаменимым помощником стал PyMuPDF, который позволяет эффективно извлекать текст, изображения и метаданные из PDF-файлов, что особенно важно при анализе юридических документов или финансовых отчетов․

Для извлечения ключевых фраз мы использовали такие методы, как RAKE (Rapid Automatic Keyword Extraction) и TextRank․ Последний, основанный на алгоритме PageRank, позволяет выделять наиболее важные предложения или слова в тексте, что крайне полезно для суммаризации или индексации․ Эти инструменты помогли нам создавать системы для извлечения фактов из новостей и автоматического тегирования контента․

Работа с Многоязычными Корпусами и Нестандартными Текстами

Мир не ограничивается одним языком, и наши проекты тоже․ Мы столкнулись с необходимостью обработки многоязычных текстовых корпусов․ Библиотеки Polyglot и Stanza (от Стэнфорда) стали нашими основными инструментами для этой цели․ Polyglot позволяет работать с широким спектром языков, предлагая токенизацию, NER, анализ тональности и определение языка․ Stanza, в свою очередь, предлагает высококачественные модели для языков с богатой морфологией, включая русский, и отлично справляется с синтаксическим парсингом․

Мы также научились работать с эмодзи и сленгом в современных текстах, используя специальные словари и регулярные выражения для их нормализации․ Это особенно важно для анализа социальных медиа, где традиционные NLP-инструменты могут не справляться с неформальным языком․ Разработка инструмента для нормализации сленга стала для нас отдельным и интересным проектом․

Визуализация и Оценка Качества

Визуализация – это ключ к пониманию данных․ Мы использовали инструменты для визуализации текстовых данных (Word Clouds, Heatmaps), чтобы быстро получить представление о частотности слов, распространенности тем или тональности․ Word Clouds, например, отлично подходят для демонстрации наиболее часто встречающихся слов в корпусе․

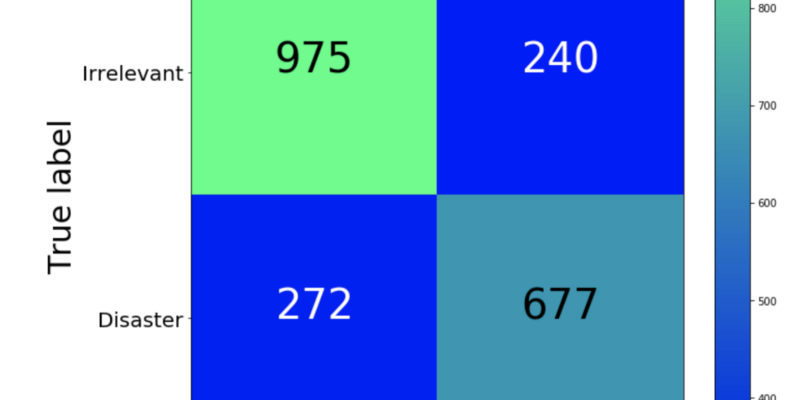

Оценка качества наших моделей – это неотъемлемая часть процесса․ Для NER-моделей мы использовали метрики F1-score, Precision, Recall․ Для классификации – матрицы ошибок, AUC-ROC кривые․ Сравнение эффективности различных токенизаторов, методов лемматизации (SpaCy vs NLTK), моделей тематического моделирования (LDA vs NMF) и методов векторизации (TF-IDF vs Word2Vec) стало для нас рутиной, позволяющей постоянно улучшать наши системы;

Продвинутые Применения и Будущие Направления

Мир NLP постоянно развивается, и мы стараемся идти в ногу со временем, исследуя новые возможности и решая все более сложные задачи․

Создание Своих Систем и Инструментов

Наш опыт позволил нам не только использовать готовые библиотеки, но и разрабатывать собственные инструменты․ Мы создавали словари и тезаурусы для конкретных доменов, разрабатывали системы для обнаружения плагиата с использованием библиотеки Jellyfish для сравнения строк, а также инструменты для проверки грамматики и исправления орфографии․ Эти кастомные решения часто оказывались незаменимыми для специфических задач, где стандартные инструменты не справлялись․

Мы также экспериментировали с построением языковых моделей на основе N-грамм, что является классическим подходом к предсказанию следующего слова, и с анализом частотности слов и n-грамм для выявления поведенческих паттернов в пользовательских запросах или чатах․ Это позволило нам лучше понимать, как люди формулируют свои мысли и запросы․

NLP в Реальном Времени и Big Data

Работа с большими текстовыми массивами (Big Data NLP) стала для нас обыденностью․ Мы научились оптимизировать процессы обработки текста с использованием GPU-ускорения и распределенных вычислений․ Обработка текста в режиме реального времени (Streaming NLP) для анализа тональности сообщений в социальных сетях или мониторинга новостных лент также стала частью нашего арсенала․ Использование библиотеки Gensim для анализа больших данных – это одно из ключевых направлений, которое мы активно развиваем․

Инновационные Применения

Мы продолжаем исследовать новые области: от разработки систем для выявления связей между сущностями с использованием Graph Embeddings до анализа временных рядов в текстовых данных для выявления сезонности или трендов․ Разработка систем для создания FAQ на основе документов, автоматического перевода узкоспециализированных текстов, а также анализ текста в медицинских записях – все это открывает новые горизонты для применения наших знаний․

Мы даже заглянули в мир анализа кода с использованием трансформеров, что является увлекательной новой областью, где NLP-модели помогают в сжатии кода или его понимании․ Использование библиотеки Gentle для распознавания речи (Speech-to-Text) открывает мост между устной и письменной речью, позволяя нам обрабатывать голосовые данные․

Библиотеки, такие как Textacy и Sweetviz, помогают нам в глубоком анализе текстовых данных, извлечении информации и визуализации, делая процесс более эффективным и наглядным․

Наше путешествие в мире Обработки Естественного Языка с Python – это непрерывный процесс обучения и открытий; От простых токенизаторов и стеммеров до мощных трансформерных моделей, способных генерировать связный текст, мы видели, как технологии меняют наше взаимодействие с информацией․ Мы прошли путь от борьбы с неполными и ошибочными данными до разработки сложных систем, которые действительно "понимают" язык․

Мы глубоко убеждены, что возможности NLP только начинают раскрываться․ С каждым новым алгоритмом, с каждой новой библиотекой, мы приближаемся к созданию систем, которые смогут общаться с нами нашими же словами, понимать наши намерения и помогать нам ориентироваться в бескрайних океанах текстовой информации․ Это невероятно увлекательное время для работы в этой области, и мы с нетерпением ждем, какие новые вызовы и открытия ждут нас впереди․ Мы надеемся, что наш опыт вдохновит вас на собственные исследования и достижения в этом захватывающем мире․ На этом статья заканчивается․

Подробнее

| Основы токенизации NLTK | Применение spaCy для NER | Сравнение LDA и NMF | Word2Vec и GloVe разница | Анализ тональности VADER |

| Настройка BERT для классификации | Извлечение текста из PDF Python | Многоязычный NLP Stanza | Суммаризация текста трансформерами | Разработка чат-ботов Rasa |