- Раскрываем Тайны Текста: Наш Путеводитель по NLP в Python от А до Я

- Что такое NLP и почему Python стал нашим фаворитом?

- Наш арсенал: Ключевые библиотеки и их возможности

- Фундамент NLP: От сырого текста к значимым данным

- Предобработка текста: Наши первые шаги к пониманию

- Токенизация: Разбиваем текст на строительные блоки

- Стемминг и лемматизация: Приводим слова к их корню

- Очистка текста: Устраняем шум

- Векторизация текста: Превращаем слова в числа

- Традиционные методы: CountVectorizer и TF-IDF

- Word Embeddings: Слова с семантикой (Word2Vec, GloVe, FastText)

- Векторизация предложений и документов (Doc2Vec, Sentence Transformers)

- Контекстные встраивания: Трансформеры и BERT

- Ключевые задачи NLP: Применяем наши инструменты

- Распознавание именованных сущностей (NER)

- Анализ тональности (Sentiment Analysis)

- Тематическое моделирование (Topic Modeling)

- Классификация текстов

- Суммаризация текста

- Системы вопросно-ответных систем (QA) и чат-боты

- Продвинутые техники и специализированные применения

- Трансформеры и глубокое обучение: Наш взгляд в будущее

- Специализированные инструменты и задачи

- Извлечение ключевых фраз и слов

- Многоязычная обработка текста

- Анализ стилистики и авторства

- Работа с неструктурированными данными

- Визуализация текстовых данных

- Проблемы и вызовы в NLP

- Наш взгляд в будущее и заключение

Раскрываем Тайны Текста: Наш Путеводитель по NLP в Python от А до Я

Добро пожаловать, дорогие читатели, в увлекательный мир, где машины начинают понимать человеческий язык! Мы, как опытные исследователи и энтузиасты больших данных, с гордостью представляем вам этот обширный путеводитель по обработке естественного языка (NLP) с использованием Python․ Если вы когда-либо задавались вопросом, как Google переводит тексты, как чат-боты отвечают на ваши вопросы, или как системы анализируют тоннальность отзывов, то вы попали по адресу․ Этот путь будет наполнен открытиями, практическими советами и глубоким погружением в мир текстовых данных․

Наш собственный опыт показывает, что NLP — это не просто набор алгоритмов, это искусство и наука одновременно․ Мы постоянно сталкиваемся с задачами, где нужно извлечь смысл из неструктурированного текста, предсказать намерения пользователя или даже сгенерировать новый, осмысленный контент․ Python, с его богатой экосистемой библиотек, стал для нас незаменимым инструментом в этом приключении․ Он предлагает гибкость, мощь и огромное сообщество, готовое помочь в любой ситуации․

Мы приглашаем вас присоединиться к нам в этом путешествии, где мы шаг за шагом разберем основные концепции, изучим мощные библиотеки и научимся применять их для решения реальных задач․ Приготовьтесь удивляться тому, насколько глубоко мы можем заглянуть в суть языка, используя лишь несколько строк кода․ Давайте вместе раскроем тайны текста и научим наши машины говорить на одном языке с нами!

Что такое NLP и почему Python стал нашим фаворитом?

Обработка естественного языка, или NLP, — это область искусственного интеллекта, которая фокусируется на взаимодействии между компьютерами и человеческим языком․ Наша цель в NLP состоит в том, чтобы научить машины понимать, интерпретировать, генерировать и манипулировать человеческим языком таким образом, чтобы это было полезно и значимо․ Это включает в себя все: от простого подсчета слов до сложного анализа эмоциональной окраски текста и даже создания интеллектуальных диалоговых систем․ Мир вокруг нас наполнен текстовой информацией — документы, электронные письма, сообщения в социальных сетях, веб-страницы — и NLP предоставляет нам инструменты для превращения этого хаоса в ценные инсайты․

Почему именно Python стал нашим выбором для погружения в этот мир? Ответ прост: его универсальность, читаемость и обширная библиотека готовых решений․ Мы обнаружили, что Python позволяет нам быстро прототипировать идеи, легко интегрировать различные инструменты и масштабировать наши решения․ Независимо от того, работаем ли мы с небольшими наборами данных или обрабатываем гигабайты текстовой информации, Python справляется с задачей․ Его экосистема включает в себя такие гиганты, как NLTK, spaCy, Scikit-learn, Gensim и, конечно же, революционные библиотеки для глубокого обучения, такие как PyTorch и TensorFlow, а также Hugging Face Transformers․ Этот арсенал позволяет нам решать практически любые задачи NLP, от самых базовых до самых продвинутых․

Наш арсенал: Ключевые библиотеки и их возможности

Мы полагаемся на целый ряд библиотек, каждая из которых имеет свои сильные стороны и предназначена для определенных задач․ Выбор правильного инструмента, это половина успеха в любом проекте NLP, и наш опыт научил нас ценить гибкость и специализацию этих инструментов․

Вот краткий обзор основных библиотек, которые мы активно используем:

| Библиотека | Назначение | Примеры использования |

|---|---|---|

| NLTK | Основы NLP, образование, исследования․ | Токенизация, стемминг, POS-теггинг, морфологический анализ․ |

| spaCy | Производственные системы, быстрое и точное NLP․ | NER, синтаксический парсинг, лемматизация, векторизация․ |

| Gensim | Тематическое моделирование, векторные представления слов․ | LDA, LSI, Word2Vec, Doc2Vec․ |

| Scikit-learn | Машинное обучение, классификация, кластеризация․ | Классификация текстов (SVM, Naive Bayes), векторизаторы (CountVectorizer, TfidfVectorizer)․ |

| Hugging Face Transformers | Современные архитектуры глубокого обучения (BERT, GPT)․ | NER, классификация, генерация текста, машинный перевод, QA․ |

| TextBlob | Простое и быстрое NLP для небольших задач․ | Анализ тональности, POS-теггинг, определение языка․ |

| Beautiful Soup | Веб-скрейпинг, извлечение текста из HTML․ | Очистка веб-страниц от лишних элементов, извлечение контента․ |

Каждая из этих библиотек дополняет другие, позволяя нам создавать комплексные и эффективные решения для самых разнообразных задач обработки текста․ Мы часто используем их в связке, чтобы извлечь максимум пользы из каждого инструмента․

Фундамент NLP: От сырого текста к значимым данным

Прежде чем мы сможем заставить машины "понимать" текст, нам необходимо его подготовить․ Это похоже на то, как мы готовим ингредиенты перед приготовлением сложного блюда: очищаем, нарезаем, измельчаем․ В NLP этот процесс называется предобработкой, и он является критически важным этапом, определяющим качество всех последующих анализов․ Мы уделяем этому этапу особое внимание, ведь "мусор на входе, мусор на выходе"․

Предобработка текста: Наши первые шаги к пониманию

Начальный этап работы с любым текстовым корпусом — это его очистка и нормализация․ Мы сталкивались с текстами, полными опечаток, HTML-тегов, сленга и смайликов, и знаем, что без правильной предобработки любой анализ будет неточным․

Токенизация: Разбиваем текст на строительные блоки

Первым делом мы разбиваем непрерывный поток текста на отдельные "токены" — слова, фразы, символы пунктуации․ Это фундаментальная операция, поскольку большинство алгоритмов NLP работают не с целым текстом, а с его дискретными элементами․

Мы используем различные подходы к токенизации:

- Токенизация слов: Разбиение текста на отдельные слова․

- Токенизация предложений: Разбиение текста на отдельные предложения․

Наш выбор часто падает на NLTK и spaCy для этих задач․ NLTK предлагает простые и эффективные токенизаторы, в то время как spaCy предоставляет более продвинутые модели, учитывающие контекст и особенности языка, что особенно полезно для русского языка․

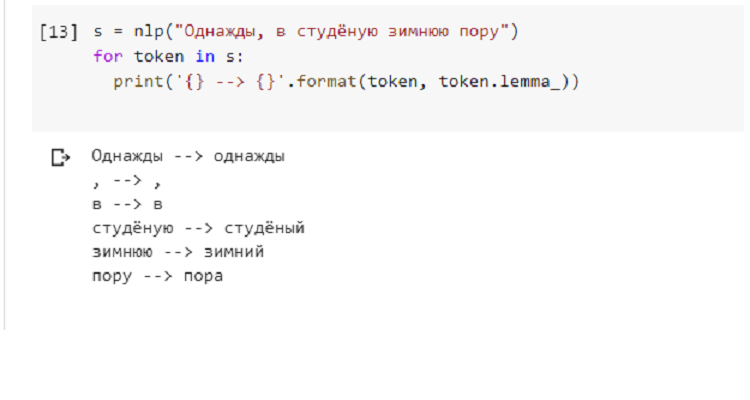

Стемминг и лемматизация: Приводим слова к их корню

После токенизации мы часто сталкиваемся с проблемой различных форм одного и того же слова ("бежать", "бежит", "бегал")․ Чтобы компьютер мог распознавать их как одно целое, мы применяем стемминг и лемматизацию․

Стемминг, это процесс удаления суффиксов и префиксов для получения "корня" слова (например, "бежал" -> "беж")․ Это быстрый, но иногда грубый метод․

Лемматизация — это более сложный процесс, который приводит слово к его базовой словарной форме (лемме), учитывая его часть речи и контекст (например, "бежал" -> "бежать")․

Мы предпочитаем лемматизацию с использованием spaCy или Stanza, особенно для языков с богатой морфологией, таких как русский, поскольку она дает более точные результаты․ NLTK также предлагает хорошие стеммеры (например, PorterStemmer) и лемматизаторы (WordNetLemmatizer), которые мы используем для быстрых экспериментов․

Очистка текста: Устраняем шум

Сырой текст редко бывает чистым․ Он может содержать HTML-теги, пунктуацию, стоп-слова (частотные слова вроде "и", "в", "на", которые не несут значимой информации), числа, символы, эмодзи и даже сленг․ Мы используем комбинацию методов для очистки:

- Регулярные выражения (`re`): Наш незаменимый инструмент для удаления специфических паттернов, таких как URL, email-адреса, HTML-теги или специальные символы․

- Удаление стоп-слов: Мы используем предопределенные списки стоп-слов из NLTK или spaCy, а иногда и создаем свои собственные, специфичные для предметной области․

- Нормализация: Приведение текста к единому регистру (обычно нижнему), обработка сокращений, исправление опечаток․

- Работа с эмодзи и сленгом: Это особенно актуально для анализа социальных сетей․ Мы разрабатываем собственные словари для нормализации сленга и специальные правила для обработки эмодзи, чтобы они не искажали тоннальность․

- Извлечение текста из PDF и веб-страниц: Для этого мы применяем PyMuPDF и Beautiful Soup, соответственно, чтобы получить чистый текстовый контент․

Векторизация текста: Превращаем слова в числа

Компьютеры не "понимают" слова в том смысле, в каком понимаем их мы․ Они оперируют числами․ Поэтому следующим критически важным шагом является преобразование текста в числовые векторы․ Этот процесс называется векторизацией или эмбеддингом․

Традиционные методы: CountVectorizer и TF-IDF

На заре NLP мы активно использовали простые, но эффективные методы:

- CountVectorizer: Создает матрицу, где каждая строка, документ, каждый столбец — уникальное слово, а значение ячейки — частота слова в документе․

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): Улучшенная версия, которая учитывает не только частоту слова в документе, но и его редкость во всем корпусе․ Это позволяет придать больший вес уникальным и значимым словам․

Эти методы, реализованные в Scikit-learn, до сих пор являются отличной отправной точкой для многих задач классификации и кластеризации․

Word Embeddings: Слова с семантикой (Word2Vec, GloVe, FastText)

Революция в представлении слов произошла с появлением Word Embeddings․ Вместо простых счетчиков, эти модели учатся представлять слова в виде плотных векторов в многомерном пространстве, где семантически близкие слова находятся рядом․

Word2Vec (Gensim): Мы используем Skip-gram или CBOW для обучения моделей, которые улавливают контекстуальные отношения между словами․ Это позволяет нам находить синонимы, аналогии и даже решать задачи вроде "король ⸺ мужчина + женщина = королева"․

GloVe: Глобальные векторы для представления слов, основанные на матрицах совместной встречаемости слов․

FastText: Расширение Word2Vec от Facebook, которое учитывает подсловные единицы (n-граммы символов), что особенно полезно для работы с редкими словами и морфологически богатыми языками․ Мы часто применяем его, когда сталкиваемся с Out-Of-Vocabulary (OOV) словами․

Векторизация предложений и документов (Doc2Vec, Sentence Transformers)

Когда нам нужно представить смысл не отдельного слова, а целого предложения или документа, мы обращаемся к:

- Doc2Vec (Gensim): Расширение Word2Vec, которое генерирует векторы для целых документов, позволяя нам сравнивать их по смыслу․

- Sentence Transformers: Фреймворк, основанный на трансформерах, который позволяет получать высококачественные эмбеддинги для предложений и документов, превосходящие Doc2Vec во многих задачах․

Контекстные встраивания: Трансформеры и BERT

Самый большой прорыв последних лет — это контекстные встраивания, такие как BERT, ELMo и GPT, которые используют архитектуру трансформеров․ Они решают одну из главных проблем традиционных Word Embeddings: полисемию (многозначность слов)․ Теперь слово "банк" будет иметь разные векторы в зависимости от контекста, будь то "берег реки" или "финансовое учреждение"․

Мы активно используем предобученные модели из библиотеки Hugging Face Transformers для получения контекстных эмбеддингов, что значительно улучшает производительность в широком спектре задач NLP․

"Язык — это дорожная карта культуры․ Он говорит вам, откуда пришел ее народ и куда он направляется․"

— Рита Мэй Браун

Ключевые задачи NLP: Применяем наши инструменты

После того как мы подготовили и векторизовали наш текст, мы готовы решать конкретные и очень интересные задачи NLP․ От извлечения имен до понимания настроения, возможности поистине безграничны․

Распознавание именованных сущностей (NER)

NER — это процесс идентификации и классификации именованных сущностей в тексте, таких как имена людей, организаций, местоположений, дат и т․д․․ Мы используем NER для автоматического извлечения структурированной информации из неструктурированного текста․

spaCy: Наш основной инструмент для быстрого и точного NER․ spaCy поставляется с высокопроизводительными предобученными моделями для различных языков․

Flair: Библиотека, предоставляющая современные NER-модели на основе рекуррентных нейронных сетей и контекстных эмбеддингов, часто дающая более высокую точность, особенно для русского языка․

CRF (Conditional Random Fields): Классический метод машинного обучения, который мы применяем для задач NER, когда данные невелики, или требуется высокая интерпретируемость․

BERT: Для самых сложных задач NER мы используем тонкую настройку (fine-tuning) моделей BERT из Hugging Face, которые достигают state-of-the-art результатов․

Анализ тональности (Sentiment Analysis)

Анализ тональности — это задача определения эмоциональной окраски текста (положительная, отрицательная, нейтральная)․ Мы применяем его для анализа отзывов клиентов, постов в социальных сетях, новостных статей и многого другого․

VADER (Valence Aware Dictionary and sEntiment Reasoner): Отличный инструмент из NLTK для анализа тональности, особенно эффективный для коротких текстов и социальных медиа, так как он учитывает эмодзи и акронимы․

TextBlob: Предоставляет простой интерфейс для анализа тональности, хотя для русского языка его точность может быть ограничена без дополнительной настройки․

Модели машинного обучения: Для более сложных задач мы обучаем собственные модели классификации (SVM, наивный байесовский классификатор) с использованием Scikit-learn, применяя TF-IDF или Word Embeddings․

Трансформеры (BERT): Для высокоточного анализа тональности, включая учет сарказма и нюансов, мы используем тонкую настройку BERT-моделей․

Мы также анализируем тональность финансовых новостей и сообщений в социальных сетях, адаптируя модели под специфику предметной области․

Тематическое моделирование (Topic Modeling)

Тематическое моделирование позволяет нам автоматически обнаруживать скрытые "темы" в большом наборе документов․ Это помогает нам понять, о чем говорят тексты, без необходимости читать каждый из них․

LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing): Мы используем библиотеку Gensim для реализации этих классических алгоритмов․ Они позволяют нам извлекать набор ключевых слов, которые определяют каждую тему․

NMF (Non-Negative Matrix Factorization): Альтернативный метод, доступный в Scikit-learn, который также хорошо справляется с тематическим моделированием․

Сравнение моделей: Мы часто сравниваем результаты LDA и NMF, чтобы выбрать наиболее подходящую модель для конкретного датасета, оценивая их по когерентности тем․

Классификация текстов

Классификация текстов — это задача отнесения документа к одной или нескольким предопределенным категориям․ Это может быть спам/не спам, положительный/отрицательный отзыв, спортивная/политическая новость․

Scikit-learn: Наша рабочая лошадка для классификации․ Мы экспериментируем с различными алгоритмами:

- Метод опорных векторов (SVM): Часто дает отличные результаты․

- Наивный байесовский классификатор: Простой, но эффективный, особенно для больших наборов данных․

- Логистическая регрессия: Хороший баланс между производительностью и интерпретируемостью․

Мы используем CountVectorizer или TfidfVectorizer для векторизации текста перед подачей в эти модели․

PyTorch/TensorFlow: Для более сложных задач и когда у нас есть достаточно данных, мы строим нейронные сети, такие как LSTM-сети или сверточные нейронные сети (CNN), используя эти фреймворки․

BERT: Для достижения наивысшей точности мы тонко настраиваем модели BERT для задач классификации, что позволяет нам использовать всю мощь контекстных эмбеддингов․

Суммаризация текста

Суммаризация текста, это процесс создания краткого, но информативного изложения длинного документа․ Мы различаем два основных типа:

Экстрактивная суммаризация: Идентифицирует и извлекает наиболее важные предложения из исходного текста․ Мы используем такие методы, как TextRank (реализован в Textacy или Gensim) для этой цели․

Абстрактивная суммаризация: Генерирует новые предложения, которые передают суть текста, но не обязательно присутствуют в оригинале․ Это более сложная задача, которую мы решаем с помощью трансформерных моделей (например, T5, BART) из Hugging Face․

Системы вопросно-ответных систем (QA) и чат-боты

Создание систем, способных отвечать на вопросы на естественном языке,, одна из самых амбициозных задач NLP․

QA-системы: Мы разрабатываем системы QA, используя трансформерные модели (например, SQuAD-обученные BERT-модели), которые могут находить ответы на вопросы в заданном тексте․

Чат-боты: Для разработки полноценных чат-ботов мы часто обращаемся к фреймворку Rasa․ Он позволяет нам создавать диалоговые системы, способные понимать намерения пользователя, извлекать сущности и генерировать осмысленные ответы․

Продвинутые техники и специализированные применения

Мир NLP постоянно развивается, и мы всегда ищем новые способы применения этих технологий для решения более сложных и нишевых задач;

Трансформеры и глубокое обучение: Наш взгляд в будущее

Архитектура трансформеров, ставшая основой таких моделей, как BERT, GPT, T5, изменила ландшафт NLP․ Мы активно используем их для:

- Генерации текста: Модели GPT позволяют нам создавать связные и контекстуально релевантные тексты, от статей до диалогов и даже кода․

- Машинного перевода: Transformer-модели достигли беспрецедентной точности в машинном переводе, и мы применяем их для создания систем перевода узкоспециализированных текстов․

- Тонкой настройки (Fine-tuning): Мы берем предобученные на огромных корпусах данных модели и дообучаем их на наших специфических наборах данных, чтобы адаптировать их под конкретные задачи с высокой точностью․

- Создания нейросетей: С помощью PyTorch и TensorFlow мы проектируем и обучаем собственные нейронные сети для уникальных задач NLP, когда готовые решения не подходят․

Специализированные инструменты и задачи

Мы также работаем с рядом более специфических задач и инструментов, расширяя границы наших возможностей:

Извлечение ключевых фраз и слов

Для быстрого определения основных тем документа мы используем:

- RAKE (Rapid Automatic Keyword Extraction): Простой, но эффективный алгоритм для извлечения ключевых слов․

- TextRank: Алгоритм, основанный на PageRank, который мы применяем для извлечения ключевых предложений и фраз, а также для суммаризации․

Многоязычная обработка текста

Работа с текстами на разных языках требует специализированных подходов:

- Polyglot: Библиотека, которую мы используем для мультиязычного анализа, поддерживающая широкий спектр языков для токенизации, NER и анализа тональности․

- Stanza: Разработанная Stanford NLP Group, эта библиотека предоставляет высококачественные модели для многих языков, включая русский, особенно ценные для языков с богатой морфологией․

Анализ стилистики и авторства

Иногда нам нужно определить автора текста или проанализировать его уникальный стиль․ Это задачи стилометрии․ Мы разрабатываем системы для определения авторства текста, анализируя частотность слов, n-грамм, длин предложений и других стилистических маркеров․

Работа с неструктурированными данными

Мы постоянно сталкиваемся с необходимостью извлекать информацию из самых разных источников:

- Анализ юридических документов и финансовых отчетов: Извлечение дат, сумм, имен, связей между сущностями․

- Анализ лог-файлов: Выявление аномалий и паттернов в системных логах․

- Веб-скрейпинг: Beautiful Soup позволяет нам эффективно извлекать текст с веб-страниц для последующего анализа․

Визуализация текстовых данных

Для того чтобы сделать результаты нашего анализа более понятными и наглядными, мы используем различные инструменты визуализации:

- Облака слов (Word Clouds): Для быстрого отображения наиболее частотных слов․

- Тепловые карты (Heatmaps): Для визуализации матриц схожести или корреляции․

Проблемы и вызовы в NLP

Несмотря на все достижения, NLP по-прежнему сталкивается с серьезными вызовами:

- Неполные и ошибочные данные: Реальные данные редко бывают идеальными, и мы тратим много усилий на их очистку и нормализацию․

- Редкие слова и OOV (Out-Of-Vocabulary): Слова, которых нет в словаре модели, представляют проблему, которую мы решаем с помощью FastText или контекстных эмбеддингов․

- Сарказм и ирония: Анализ тональности с учетом этих нюансов до сих пор остается сложной задачей, требующей продвинутых моделей и большого количества данных․

- Большие текстовые массивы (Big Data NLP): Обработка гигантских объемов текста требует эффективных алгоритмов и оптимизированных подходов, часто с использованием GPU-ускорения․

- Автоматическая разметка данных: Создание размеченных данных для обучения моделей часто является самым трудоемким этапом․ Мы разрабатываем инструменты для автоматической разметки, чтобы ускорить этот процесс․

Наш взгляд в будущее и заключение

Мы прошли долгий путь, исследуя основы и продвинутые концепции NLP с использованием Python․ Наш опыт показывает, что эта область продолжает стремительно развиваться, предлагая все новые и новые возможности для извлечения смысла из человеческого языка․ От простых методов токенизации до сложных архитектур трансформеров — каждый шаг приближает нас к созданию по-настоящему интеллектуальных систем, способных взаимодействовать с нами на естественном языке․

Мы видим будущее, где NLP будет еще глубже интегрировано в нашу повседневную жизнь: улучшенные голосовые помощники, более точные системы медицинского диагностирования на основе текстовых записей, персонализированные образовательные платформы и многое другое․ Инструменты, которые мы рассмотрели,, NLTK, spaCy, Gensim, Scikit-learn, Hugging Face Transformers — являются краеугольными камнями этого будущего․

Мы надеемся, что этот путеводитель вдохновил вас на собственные исследования и эксперименты в мире NLP․ Не бойтесь начинать с малого, постепенно углубляясь в более сложные концепции․ Python и его мощные библиотеки всегда будут рядом, чтобы поддержать вас в этом захватывающем путешествии․ Продолжайте учиться, экспериментировать и создавать, ведь именно так мы вместе раскрываем все тайны текста․

Подробнее

| Основы NLTK | spaCy NER | Тематическое моделирование LDA | Классификация текстов Python | Word2Vec Gensim |

| Анализ тональности VADER | Трансформеры NLP | Лемматизация SpaCy | Текстовая аналитика Python | Обработка естественного языка |