- Раскрываем Тайны Текста: Наш Увлекательный Путь в Мир Обработки Естественного Языка с Python

- Первые Шаги: Подготовка Текста к Анализу

- Разбиваем на Части: Токенизация и Стемминг

- К Совершенству: Лемматизация

- Магия Шаблонов: Регулярные Выражения

- Наши Первые Помощники: NLTK и TextBlob

- Погружение в Смысл: Ключевые Задачи NLP

- Кто, Что, Где: Распознавание Именованных Сущностей (NER)

- Наводим Порядок: Классификация Текстов

- Что чувствует Текст: Анализ Тональности (Sentiment Analysis)

- Скрытые Темы: Тематическое Моделирование

- Как Машины "Видят" Слова: Представление Текста

- От Слов к Числам: Векторизаторы Текста

- Смысл в Пространстве: Word Embeddings

- Больше, чем Слова: Векторизация Предложений и Документов

- На Вершине Технологий: Глубокое Обучение и Трансформеры в NLP

- Магия Внимания: Трансформеры (Hugging Face)

- Создание Своих Шедевров: Нейросети с PyTorch/TensorFlow

- Практическое Применение и Продвинутые Техники

- Извлечение Сути: Ключевые Фразы и Суммаризация

- Мир Без Границ: Обработка Многоязычных Текстов

- Взаимодействие с Людьми: Чат-боты и QA Системы

- Сбор и Анализ: От Веб-скрейпинга до Визуализации

- Детальный Разбор: От Стилистики до Графов

- Вызовы и Перспективы: Куда Мы Движемся Дальше

Раскрываем Тайны Текста: Наш Увлекательный Путь в Мир Обработки Естественного Языка с Python

Привет, дорогие читатели и коллеги-энтузиасты! Сегодня мы хотим поделиться с вами нашим невероятным опытом и знаниями, накопленными за годы погружения в одну из самых захватывающих областей современной информатики — обработку естественного языка, или NLP (Natural Language Processing)․ Мы, как опытные блогеры, всегда стремимся не просто передать сухую информацию, а вдохновить вас на собственные открытия, показать, насколько безграничны возможности, когда вы вооружены правильными инструментами и пониманием․

Мир вокруг нас пронизан текстом․ От миллиардов сообщений в социальных сетях и электронных писем до огромных архивов научных статей и юридических документов — данные в текстовом формате являются поистине неисчерпаемым источником информации․ Но как извлечь смысл из этого хаоса? Как заставить компьютер понимать человеческий язык, выявлять эмоции, классифицировать информацию или даже генерировать новые тексты, неотличимые от написанных человеком? Именно здесь на сцену выходит NLP, и Python, наш верный спутник в этом приключении․ Мы приглашаем вас в путешествие, где мы вместе раскроем секреты превращения бесформенного текста в ценные инсайты и умные приложения․

Первые Шаги: Подготовка Текста к Анализу

Прежде чем мы сможем научить компьютер "читать" и "понимать" текст, нам необходимо его подготовить․ Человеческий язык полон нюансов, неоднозначностей и избыточности, с которыми машинам, не привыкшим к такой свободе, довольно сложно справляться․ Поэтому мы начинаем с основ, которые закладывают фундамент для всех последующих, более сложных задач․

Разбиваем на Части: Токенизация и Стемминг

Первое, что мы делаем, это разбиваем текст на более мелкие, осмысленные единицы․ Этот процесс называется токенизацией․ Слова, предложения, даже подслова, это все токены․ Мы используем такие библиотеки, как NLTK (Natural Language Toolkit), которая предоставляет мощные инструменты для этих целей․ NLTK позволяет нам легко токенизировать текст на слова или предложения, что является критически важным для дальнейшей обработки․

После токенизации мы часто сталкиваемся с проблемой различных форм одного и того же слова (например, "бежать", "бежит", "бежал")․ Чтобы привести их к общей основе, мы применяем стемминг — процесс отсечения окончаний и суффиксов․ NLTK предлагает несколько стеммеров, таких как Портеровский (PorterStemmer) или Сноуболл (SnowballStemmer), которые эффективно справляются с этой задачей для разных языков․ Однако, важно помнить, что стемминг может привести к потере части смысла, поскольку он не всегда оставляет слово в его морфологически корректной форме․

К Совершенству: Лемматизация

Там, где стемминг иногда подводит, на помощь приходит лемматизация․ В отличие от стемминга, лемматизация стремится привести слово к его базовой словарной форме, или лемме, учитывая при этом его часть речи и морфологию․ Это означает, что "бежать", "бежит", "бежал" будут приведены к лемме "бежать", а не к усеченному "беж"․ Для этой более продвинутой задачи мы часто обращаемся к spaCy или Stanza, особенно когда работаем с языками, обладающими богатой морфологией, такими как русский․ Эти библиотеки предоставляют высокоточные модели для лемматизации, значительно улучшая качество предобработки․

Магия Шаблонов: Регулярные Выражения

Помимо токенизации и лемматизации, нам часто требуется выполнять более специфическую очистку или извлечение данных․ Здесь на сцену выходят регулярные выражения (re)․ Они позволяют нам находить, заменять или извлекать текстовые шаблоны, от электронных адресов и номеров телефонов до удаления HTML-тегов или специфической пунктуации․ Мы используем модуль `re` в Python для тонкой настройки предобработки текста, что особенно важно при работе с "грязными" данными, полученными, например, из интернета․

Вот несколько примеров того, что мы обычно очищаем на этом этапе:

- HTML-теги: Часто текст приходит к нам с веб-страниц, и он содержит ненужные теги․

- Пунктуация: Удаление или нормализация знаков препинания, которые могут мешать анализу․

- Стоп-слова: Исключение часто встречающихся, но малозначимых слов (например, "и", "в", "на"), которые не несут смысловой нагрузки․

- Эмодзи и сленг: Особенно актуально для анализа социальных сетей, где мы разрабатываем инструменты для их нормализации или удаления․

- Пробелы и символы: Удаление лишних пробелов, символов новой строки и других управляющих символов․

Наши Первые Помощники: NLTK и TextBlob

Для быстрого старта и выполнения простых задач NLP мы часто обращаемся к NLTK и TextBlob․ NLTK, как мы уже упоминали, является краеугольным камнем для базовых операций, таких как токенизация и POS-теггинг (определение частей речи)․ TextBlob, в свою очередь, предоставляет удобный высокоуровневый API для выполнения таких задач, как анализ тональности, извлечение ключевых фраз и перевод, что делает его отличным выбором для быстрого прототипирования․

| Библиотека | Ключевые Возможности | Преимущества | Когда Мы Её Используем |

|---|---|---|---|

| NLTK | Токенизация, стемминг, POS-теггинг, морфологический анализ․ | Широкий набор алгоритмов, отлично для изучения основ, хорошая документация․ | Базовая предобработка, образовательные проекты, глубокое понимание алгоритмов․ |

| spaCy | Лемматизация, NER, синтаксический парсинг, векторизация․ | Высокая производительность, готовые модели для многих языков, удобный API․ | Производственные системы, сложные задачи NLP, языки с богатой морфологией․ |

| TextBlob | Анализ тональности, извлечение фраз, перевод, POS-теггинг․ | Очень простой API, быстрый старт, подходит для небольших проектов․ | Быстрый прототип, простой анализ тональности, образовательные цели․ |

| re (Регулярные выражения) | Поиск, замена, извлечение шаблонов в тексте․ | Гибкость, точность в поиске специфических паттернов; | Очистка данных, извлечение структурированной информации из неструктурированного текста․ |

Погружение в Смысл: Ключевые Задачи NLP

Как только текст готов, мы можем приступать к извлечению из него значимой информации․ Здесь мы сталкиваемся с целым спектром увлекательных задач, каждая из которых открывает новые горизонты для анализа и взаимодействия с языком․

Кто, Что, Где: Распознавание Именованных Сущностей (NER)

Распознавание именованных сущностей (Named Entity Recognition, NER), это задача идентификации и классификации именованных сущностей в тексте по заранее определенным категориям, таким как имена людей, названия организаций, географические местоположения, даты и т․д․ Это невероятно полезно для структурирования информации из неструктурированных текстов․ Мы активно используем spaCy для быстрого и точного NER, так как она поставляется с предварительно обученными моделями, которые демонстрируют отличную производительность․ Однако, для более сложных случаев и языков мы обращаемся к Flair, которая часто дает более точные результаты благодаря использованию мощных контекстных встраиваний․

В некоторых задачах, особенно требующих высокой точности или работы с предметными областями, где стандартные модели NER могут ошибаться, мы используем Условные случайные поля (CRF)․ Они позволяют нам обучать собственные модели NER на размеченных данных, адаптируя их под специфические требования проекта, например, для анализа юридических документов или медицинских записей, где требуется извлекать очень специфические типы сущностей․ Оценка качества NER-моделей (с помощью метрик F1-score, Precision, Recall) является обязательной частью нашего процесса разработки, чтобы убедиться в надежности наших решений․

Наводим Порядок: Классификация Текстов

Представьте, что у вас есть тысячи новостных статей, отзывов клиентов или электронных писем, и вам нужно быстро определить их тематику или категорию․ Классификация текстов, это именно та задача, которая нам нужна․ Мы используем Scikit-learn для применения классических алгоритмов машинного обучения, таких как SVM (метод опорных векторов) или наивный байесовский классификатор․ Эти методы хорошо работают для многих задач, особенно когда у нас есть достаточное количество размеченных данных․

Для более сложных задач классификации, где требуется улавливать тонкие семантические связи, мы переходим к глубокому обучению, используя PyTorch или TensorFlow для создания LSTM-сетей или использования BERT-моделей․ Применение BERT для задач классификации, например, для анализа финансовых новостей или отзывов о продуктах по категориям, значительно повышает точность, поскольку эти модели способны учитывать контекст слова в предложении․

Что чувствует Текст: Анализ Тональности (Sentiment Analysis)

Знать, что люди говорят, — это одно, а понимать, что они при этом чувствуют, — совсем другое․ Анализ тональности (Sentiment Analysis) позволяет нам определить эмоциональную окраску текста — положительную, отрицательную или нейтральную․ Для простых задач мы часто используем библиотеку VADER (Valence Aware Dictionary and sEntiment Reasoner), которая хорошо справляется с текстами на английском языке, особенно в социальных сетях, так как она специально настроена на обработку эмотиконов, сленга и капитализации․

Однако, анализ тональности в социальных сетях (например, Twitter/Reddit) с учетом сарказма или иронии — это гораздо более сложная задача․ Здесь мы часто обучаем собственные модели, используя те же подходы, что и для классификации текста, но с акцентом на эмоциональную разметку․ Мы также применяем анализ тональности к более специализированным областям, таким как финансовые новости, где эмоциональный фон может влиять на рыночные настроения, или к отзывам о фильмах и ресторанах, чтобы выявить общие настроения потребителей․

Скрытые Темы: Тематическое Моделирование

Когда у нас есть большой корпус документов, и мы хотим понять, о чем они, не читая каждый из них, на помощь приходит тематическое моделирование․ Это класс алгоритмов, которые позволяют нам обнаруживать абстрактные "темы" в коллекции текстов․ Gensim, наша любимая библиотека для этих целей, предлагающая реализацию таких моделей, как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing)․ Мы используем их для анализа отзывов клиентов, блогов, форумов или статей, чтобы выявить скрытые темы и тренды․

Существуют и другие подходы, например, NMF (Non-negative Matrix Factorization)․ Мы часто сравниваем модели тематического моделирования (LDA vs NMF), чтобы выбрать наиболее подходящую для конкретной задачи, поскольку они имеют разные предположения о структуре данных и могут давать разные результаты․ Применение Topic Modeling для анализа отзывов позволяет нам автоматически категоризировать их по темам, например, "качество обслуживания", "скорость доставки" или "цена продукта"․

"Язык — это дорожная карта культуры․ Он говорит нам, откуда пришли его люди и куда они идут․"

— Рита Мэй Браун

Как Машины "Видят" Слова: Представление Текста

Для того чтобы алгоритмы машинного обучения могли работать с текстом, нам нужно преобразовать его в числовой формат․ Этот процесс называется векторизацией, и он является одним из самых фундаментальных аспектов NLP․

От Слов к Числам: Векторизаторы Текста

Самые простые, но эффективные способы векторизации — это CountVectorizer и TfidfVectorizer, доступные в Scikit-learn․ CountVectorizer просто подсчитывает частоту вхождений каждого слова в документе, создавая разреженную матрицу․ TfidfVectorizer идет дальше, учитывая не только частоту слова в документе, но и его редкость во всем корпусе текстов, что позволяет выделять более значимые слова․ Мы часто сравниваем эти методы векторизации (TF-IDF vs Word2Vec), чтобы понять, какой подход лучше подходит для конкретной задачи․

Смысл в Пространстве: Word Embeddings

Однако, простые векторизаторы не учитывают семантические отношения между словами․ Здесь на помощь приходят Word Embeddings (векторные представления слов)․ Это плотные векторы, которые отображают слова в многомерное пространство таким образом, что слова со схожим значением располагаются ближе друг к другу․ Мы используем Gensim для работы с популярными моделями, такими как Word2Vec и GloVe․ Word2Vec, в частности, имеет две основные архитектуры: Skip-gram и CBOW, и мы часто сравниваем их эффективность для наших задач․

Для работы с редкими словами, которые могут быть проблемой для Word2Vec, мы обращаемся к FastText, который строит векторные представления на основе подслов (n-грамм символов), позволяя ему эффективно работать даже со словами, которые не встречались в обучающем корпусе․ Мы также используем FastText для векторизации текста в целом․

Больше, чем Слова: Векторизация Предложений и Документов

Помимо отдельных слов, нам часто нужно получать векторные представления целых предложений или даже документов․ Для этого мы применяем Doc2Vec (расширение Word2Vec), который позволяет нам представлять целые документы в виде плотных векторов․ Это полезно для задач поиска сходства между документами, кластеризации текстов или построения рекомендательных систем․

В последние годы огромную популярность получили Sentence Transformers — модели, которые генерируют высококачественные векторные представления предложений, учитывающие контекст․ Они превосходно подходят для поиска семантически похожих предложений, суммаризации и даже для создания систем вопросно-ответных систем․

На Вершине Технологий: Глубокое Обучение и Трансформеры в NLP

Последние несколько лет принесли революцию в NLP благодаря появлению глубоких нейронных сетей и, в частности, архитектуры Трансформеров․ Эти модели значительно превзошли традиционные методы во многих задачах, открыв двери для создания по-настоящему интеллектуальных систем․

Магия Внимания: Трансформеры (Hugging Face)

Библиотека Hugging Face Transformers стала де-факто стандартом для работы с современными моделями глубокого обучения в NLP․ Она предоставляет легкий доступ к предварительно обученным моделям, таким как BERT, GPT, RoBERTa и многим другим․ Эти модели основаны на механизме внимания, который позволяет им эффективно улавливать долгосрочные зависимости в тексте и учитывать контекст каждого слова․

Мы используем трансформеры для широкого спектра сложных задач:

- Системы вопросно-ответных систем (QA): Трансформеры позволяют нам строить системы, которые могут отвечать на вопросы, извлекая информацию из больших текстовых корпусов․

- Генерация текста: С помощью таких моделей, как GPT, мы можем генерировать связные и осмысленные тексты, от статей до диалогов и даже кода․

- Машинный перевод: Transformer-модели значительно улучшили качество машинного перевода, делая его более естественным и точным․

- Суммаризация текста: Мы используем трансформеры для создания как экстрактивных (извлечение ключевых предложений), так и абстрактивных (генерация нового, сокращенного текста) систем суммаризации․

- Анализ кода: Даже для сжатия кода и анализа его структуры мы применяем трансформеры․

Тонкая настройка (Fine-tuning) предварительно обученных моделей является ключевым этапом в нашей работе․ Мы берем уже обученную на огромном объеме данных модель и дообучаем ее на небольшом, специфическом для нашей задачи наборе данных․ Это позволяет достичь высокой точности при минимальных затратах времени и ресурсов․

Создание Своих Шедевров: Нейросети с PyTorch/TensorFlow

Хотя готовые трансформеры Hugging Face очень мощны, иногда нам нужно больше гибкости или контроля․ В таких случаях мы используем PyTorch или TensorFlow для создания собственных нейросетей NLP с нуля или для реализации уникальных архитектур․ Это позволяет нам экспериментировать с различными слоями (например, LSTM-сетями), функциями потерь и оптимизаторами, чтобы добиться наилучших результатов для наших конкретных, часто очень специфических задач․

Практическое Применение и Продвинутые Техники

Когда мы освоили основы и современные модели, перед нами открывается целый мир специализированных приложений и продвинутых техник, которые позволяют нам решать реальные бизнес-задачи и создавать инновационные продукты․

Извлечение Сути: Ключевые Фразы и Суммаризация

Часто нам нужно быстро понять основные идеи текста․ Для этого мы используем анализ текста для извлечения ключевых фраз․ Такие алгоритмы, как RAKE (Rapid Automatic Keyword Extraction) или TextRank (на основе графов), помогают нам автоматически идентифицировать наиболее важные термины и предложения․ TextRank также отлично подходит для суммаризации текста, извлекая наиболее релевантные предложения, чтобы создать краткий обзор документа․

Мы также работаем над разработкой системы суммаризации текста, которая может быть как экстрактивной (выбирает существующие предложения), так и абстрактивной (генерирует новые предложения, передающие суть)․ Сравнение моделей суммаризации позволяет нам выбирать наиболее эффективный подход для различных типов контента․

Мир Без Границ: Обработка Многоязычных Текстов

Работаем мы не только с английским или русским․ Обработка многоязычных текстовых корпусов — это отдельный вызов․ Здесь нам помогают библиотеки, такие как Polyglot и Stanza․ Polyglot поддерживает множество языков для токенизации, NER и определения языка, что делает его ценным для глобальных проектов․ Stanza, разработанная Stanford NLP Group, предоставляет высокоточные модели для языков с богатой морфологией, обеспечивая точную лемматизацию и синтаксический парсинг для русского и других сложных языков․

Мы также активно развиваем системы машинного перевода на Python, используя трансформеры для создания высококачественных переводов, в т․ч․ для узкоспециализированных текстов․

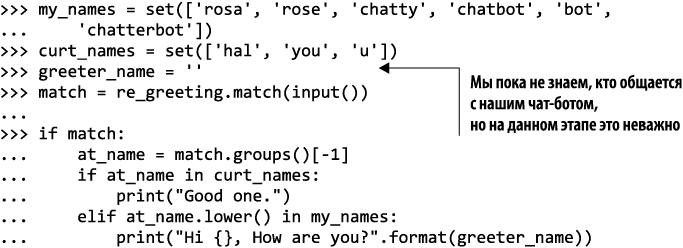

Взаимодействие с Людьми: Чат-боты и QA Системы

Одной из самых захватывающих областей применения NLP является создание интеллектуальных систем для взаимодействия с пользователями․ Мы занимаемся разработкой чат-ботов на Python, часто используя фреймворк Rasa, который позволяет нам создавать контекстно-зависимых и диалоговых агентов․ Параллельно мы разрабатываем системы вопросно-ответных систем (QA), которые могут извлекать точные ответы из документов или баз знаний, используя продвинутые модели чтения с пониманием․

Сбор и Анализ: От Веб-скрейпинга до Визуализации

Прежде чем анализировать текст, его нужно где-то взять․ Библиотека Beautiful Soup является нашим незаменимым помощником для веб-скрейпинга текста с веб-страниц․ Для извлечения текста из PDF-документов мы используем PyMuPDF․ После сбора и обработки данных мы переходим к инструментам для визуализации текстовых данных, таким как облака слов (Word Clouds) для анализа частотности или тепловые карты (Heatmaps) для отображения взаимосвязей, что помогает нам и нашим читателям лучше понимать полученные инсайты․

Детальный Разбор: От Стилистики до Графов

Наш опыт включает в себя и более глубокий анализ: анализ стилистики текстов (авторский почерк) для определения авторства или выявления аномалий․ Мы также работаем с Graph Embeddings для анализа взаимосвязей между сущностями в тексте, что позволяет нам строить сложные семантические сети․ Анализ лексического богатства и сложности текстов помогает нам оценивать качество и доступность контента․ А для работы с нелатинскими алфавитами мы используем специализированные подходы, обеспечивая универсальность наших решений․

Мы также активно применяем библиотеку Scipy для различных статистических и вычислительных задач при анализе текстовых данных, что позволяет нам проводить глубокий количественный анализ․

Вызовы и Перспективы: Куда Мы Движемся Дальше

Путь в NLP полон не только успехов, но и вызовов․ Мы постоянно сталкиваемся с проблемами обработки неполных и ошибочных данных, необходимостью разработки инструментов для автоматической разметки данных и проверки грамматики․ Работа с большими текстовыми массивами (Big Data NLP) требует оптимизации и использования GPU-ускорения․

Мы также постоянно сравниваем библиотеки для лемматизации (SpaCy vs NLTK), сравниваем алгоритмы кластеризации (K-Means vs DBSCAN) и сравниваем методы машинного обучения для NLP (SVM, наивный байесовский классификатор), чтобы наши решения были максимально эффективными и современными․

Наш блог — это площадка для обмена опытом, и мы всегда открыты для новых идей и подходов․ Мы продолжаем исследовать такие области, как анализ временных рядов в текстовых данных, разработка систем обнаружения плагиата с использованием библиотеки Textdistance, анализ тональности сообщений в социальных сетях с учетом сарказма, разработка инструмента для проверки фактов (Fact-Checking) и многое другое․

Мы надеемся, что этот обзор нашего пути в мире обработки естественного языка вдохновил вас и показал, насколько глубоко и широко мы погрузились в эту увлекательную область․ От самых базовых операций, таких как токенизация и стемминг, до сложных архитектур трансформеров и создания интеллектуальных систем, мы постоянно учимся, экспериментируем и делимся своими открытиями․ Python с его богатой экосистемой библиотек, таких как NLTK, spaCy, Gensim, Scikit-learn и Hugging Face, является нашим надежным инструментом, который позволяет превращать идеи в работающие решения․ Помните, что каждый текст — это не просто набор символов, а ключ к пониманию человеческого мышления, эмоций и знаний․ И мы, вместе с вами, продолжаем открывать эти ключи, шаг за шагом, слово за словом․

Подробнее: LSI Запросы

| Основы NLTK и spaCy для текста | Применение BERT в классификации | Разработка чат-ботов на Python | Анализ тональности с VADER | Word2Vec и GloVe в Gensim |

| Суммаризация текста трансформерами | NER с использованием Flair | Тематическое моделирование LDA NMF | Векторизация текстов Doc2Vec | Очистка текста регулярными выражениями |