- Раскрывая Тайны Текста: Наш Увлекательный Путеводитель по Миру NLP и Python

- Начало Пути: Фундаментальные Кирпичики NLP

- Токенизация: Разделяй и Властвуй

- Стемминг и Лемматизация: К Корню Проблемы

- Регулярные Выражения: Ваш Швейцарский Нож для Текста

- Как Машины "Видят" Слова: Векторизация Текста

- От Простого к Сложному: CountVectorizer и TF-IDF

- Глубокое Понимание: Word Embeddings (Word2Vec‚ GloVe‚ FastText‚ Doc2Vec)

- Контекстное Встраивание: Когда Слово Значит Больше

- Ключевые Задачи NLP: От Распознавания до Анализа Эмоций

- Распознавание Именованных Сущностей (NER)

- Тематическое Моделирование: О чём на Самом Деле Текст?

- Анализ Тональности (Sentiment Analysis): Чувства Машины

- Классификация Текстов: Автоматическая Сортировка

- Современный NLP: Эпоха Глубокого Обучения и Трансформеров

- Нейронные Сети для NLP: PyTorch и TensorFlow

- Трансформеры и Hugging Face: Новый Уровень Понимания

- Практические Приложения и Инструментарий

- Сбор Данных: Веб-Скрейпинг и Извлечение из PDF

- Работа с Разнообразием Языка: Многоязычие и Морфология

- От Чат-Ботов до Суммаризации: Автоматизация Смысла

- Визуализация и Оценка

- Специализированные Инструменты и Продвинутые Техники

- Работа с «Живым» Языком

- NLP в Специфических Областях

- Расширенные Возможности и Инструменты

Раскрывая Тайны Текста: Наш Увлекательный Путеводитель по Миру NLP и Python

Привет‚ друзья и коллеги по перу! Сегодня мы хотим погрузиться в одну из самых захватывающих и быстро развивающихся областей современного программирования и искусственного интеллекта – обработку естественного языка‚ или NLP (Natural Language Processing). Мы‚ как опытные блогеры‚ работающие с текстом каждый день‚ давно осознали всю мощь и потенциал‚ который скрывается за строчками слов‚ и хотим поделиться нашим опытом и знаниями‚ накопленными за годы работы с Python и его бесчисленными библиотеками; Приготовьтесь к увлекательному путешествию‚ где мы шаг за шагом раскроем‚ как машины учатся понимать‚ анализировать и даже генерировать человеческую речь.

В нашем мире‚ где информация генерируется со скоростью света‚ большая её часть представлена в текстовом формате: от электронных писем и сообщений в социальных сетях до научных статей и юридических документов. Понимание и извлечение ценности из этих огромных массивов данных становится критически важным для бизнеса‚ науки и повседневной жизни. Именно здесь на помощь приходит NLP‚ позволяя нам автоматизировать процессы‚ которые ещё недавно казались прерогативой исключительно человеческого разума. Мы убеждены‚ что каждый‚ кто работает с данными‚ должен иметь хотя бы базовое представление об этих технологиях.

Начало Пути: Фундаментальные Кирпичики NLP

Прежде чем машина сможет "понять" текст‚ его нужно подготовить. Представьте‚ что вы учите ребёнка читать: сначала он должен выучить буквы‚ затем слова‚ и только потом предложения. В NLP мы следуем схожей логике‚ разбивая текст на более мелкие‚ осмысленные единицы. Эти шаги составляют основу любой задачи обработки текста‚ и мы регулярно используем их в наших проектах.

Токенизация: Разделяй и Властвуй

Первый и‚ возможно‚ самый очевидный шаг – это токенизация. Мы берём большой кусок текста и разбиваем его на отдельные слова или фразы‚ которые мы называем токенами. Это может показаться простым‚ но на деле существуют нюансы. Например‚ "Нью-Йорк" – это одно слово или два? А как насчёт пунктуации? Должны ли мы отделять её или считать частью слова? NLTK (Natural Language Toolkit) является нашим верным помощником на этом этапе. Он предлагает различные токенизаторы‚ способные справляться с этими задачами.

Мы используем NLTK‚ потому что он предоставляет богатый набор инструментов для работы с различными языками и сценариями токенизации. Например‚ для русского языка‚ где морфология играет огромную роль‚ правильная токенизация – это уже половина успеха. Без неё дальнейший анализ будет затруднён. Мы часто начинаем наши проекты именно с этого этапа‚ поскольку от качества токенизации зависит точность всех последующих операций.

Стемминг и Лемматизация: К Корню Проблемы

Язык богат формами одного и того же слова. "Бегать"‚ "бегает"‚ "бегал"‚ "бегущий" – все они связаны с одним действием. Для компьютера это четыре разных слова‚ что может усложнять анализ. Здесь на помощь приходят стемминг и лемматизация. Мы стремимся привести слова к их базовой форме. Стемминг – это более грубый метод‚ отсекающий окончания‚ чтобы получить "корень" слова (например‚ "бег" из "бегает"). Он быстр‚ но иногда может давать несуществующие слова.

Лемматизация‚ в свою очередь‚ более интеллектуальна. Она использует словари и морфологический анализ‚ чтобы привести слово к его словарной (базовой) форме‚ или лемме. Так‚ "бегает" станет "бегать"‚ а "лучший" – "хороший". Мы предпочитаем лемматизацию‚ когда требуется высокая точность‚ особенно в таких языках‚ как русский‚ с его сложной морфологией. Библиотеки вроде spaCy и Stanza (для языков с богатой морфологией) предоставляют мощные инструменты для продвинутой лемматизации.

Мы часто сталкиваемся с тем‚ что выбор между стеммингом и лемматизацией зависит от конкретной задачи. Если нам нужна высокая производительность и небольшие потери в точности допустимы‚ мы используем стемминг. Однако для задач‚ требующих глубокого понимания семантики‚ лемматизация – наш выбор. Этот этап помогает нам значительно сократить словарь уникальных слов‚ что упрощает и ускоряет последующую обработку и анализ.

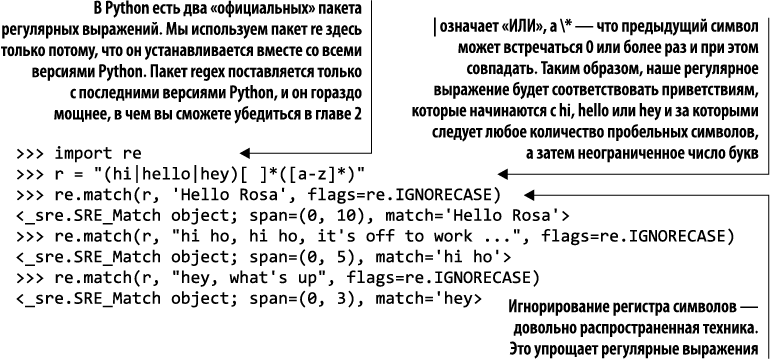

Регулярные Выражения: Ваш Швейцарский Нож для Текста

Прежде чем мы начнём глубокий лингвистический анализ‚ часто возникает необходимость в "черновой" очистке текста. Удаление HTML-тегов‚ специфической пунктуации‚ чисел‚ ссылок или даже эмодзи – всё это задачи‚ с которыми мы сталкиваемся ежедневно. И здесь наш незаменимый инструмент – регулярные выражения (библиотека `re` в Python). Они позволяют нам находить и манипулировать строками по сложным шаблонам‚ давая невероятную гибкость в предобработке.

Мы используем регулярные выражения для стандартизации текста‚ например‚ для приведения всех форм написания дат или валют к единому виду. Это особенно важно при работе с неструктурированными данными‚ где форматирование может быть очень разнообразным. Очистка данных – это не просто удаление мусора; это создание прочной основы для последующего машинного обучения‚ и регулярные выражения играют в этом ключевую роль.

Как Машины "Видят" Слова: Векторизация Текста

Компьютеры не понимают слова в том же смысле‚ что и люди. Для них это просто последовательности символов. Чтобы применить к тексту математические модели и алгоритмы машинного обучения‚ нам нужно преобразовать слова и предложения в числовые векторы. Это называется векторизацией‚ и мы используем различные подходы для решения этой задачи.

От Простого к Сложному: CountVectorizer и TF-IDF

Начнём с классики. CountVectorizer просто подсчитывает‚ сколько раз каждое слово встречается в документе. Это создаёт разреженные векторы‚ где каждый элемент соответствует слову из словаря‚ а его значение – частоте этого слова. Просто‚ понятно‚ но не всегда эффективно‚ так как игнорирует важность слова.

TfidfVectorizer (Term Frequency-Inverse Document Frequency) идёт дальше. Мы не только учитываем частоту слова в документе (TF)‚ но и его редкость во всём корпусе текстов (IDF). Чем реже слово встречается в других документах‚ тем больше его "вес" в данном документе. Этот подход позволяет нам выделять слова‚ которые действительно характеризуют конкретный текст‚ а не просто являются общими "стоп-словами". Мы часто используем TF-IDF для задач классификации текстов‚ где важно понять‚ о чём именно идёт речь в каждом документе.

Разработка собственных векторизаторов текста также является частью нашей практики‚ когда стандартные методы не совсем подходят под специфику задачи. Мы можем добавлять дополнительные признаки‚ например‚ часть речи слова или его позицию в предложении‚ чтобы создать более информативные представления.

Глубокое Понимание: Word Embeddings (Word2Vec‚ GloVe‚ FastText‚ Doc2Vec)

Современный NLP немыслим без векторных представлений слов (Word Embeddings). Вместо того чтобы просто считать слова‚ мы учим модели представлять их в виде плотных векторов в многомерном пространстве‚ где слова со схожим значением или контекстом оказываются близко друг к другу. Это настоящий прорыв‚ который мы активно используем в наших проектах.

- Word2Vec (с использованием Gensim): Мы обучаем нейронную сеть‚ чтобы она предсказывала слово по его соседям (CBOW) или соседей по слову (Skip-gram). Результат – векторы‚ которые улавливают семантические отношения. Например‚

вектор('король') ⸺ вектор('мужчина') + вектор('женщина')часто даёт вектор‚ близкий квектор('королева'). Мы применяем Gensim для эффективной работы с большими корпусами текстов. - GloVe: Этот метод основан на глобальной матрице совместной встречаемости слов. Он комбинирует преимущества матричной факторизации и локального контекстного окна. Мы часто используем предобученные модели GloVe‚ когда у нас нет достаточного объёма данных для обучения Word2Vec с нуля.

- FastText: Разработанный Facebook AI‚ FastText расширяет Word2Vec‚ учитывая не только слова целиком‚ но и их подслова (n-граммы символов). Это позволяет нам получать хорошие векторы для редких слов и даже для слов‚ которых не было в обучающем корпусе. Мы находим его особенно полезным для языков с богатой морфологией.

- Doc2Vec: Если Word2Vec работает со словами‚ то Doc2Vec (также часть Gensim) позволяет нам получать векторные представления для целых предложений и документов. Это мощный инструмент‚ когда нам нужно сравнивать документы или классифицировать их по смыслу.

Мы видим‚ как эти методы преобразуют текст из набора дискретных символов в непрерывное‚ осмысленное пространство‚ открывая двери для гораздо более сложных видов анализа. Векторизация предложений и документов с помощью этих техник позволяет нам эффективно работать с большими текстовыми массивами‚ находить сходства и различия‚ которые были бы незаметны при традиционных подходах.

Контекстное Встраивание: Когда Слово Значит Больше

Даже продвинутые Word Embeddings имеют одно ограничение: каждое слово имеет один фиксированный вектор‚ независимо от контекста. Но ведь слово "коса" может означать и инструмент‚ и причёску! Здесь на сцену выходит контекстное встраивание (contextual embeddings)‚ которое стало краеугольным камнем современных трансформерных моделей. Мы видим‚ как эти модели‚ такие как BERT‚ генерируют разные векторы для одного и того же слова в зависимости от окружающих его слов. Это позволяет нам улавливать тончайшие нюансы значения‚ что невероятно важно для задач‚ требующих глубокого языкового понимания.

Ключевые Задачи NLP: От Распознавания до Анализа Эмоций

Теперь‚ когда у нас есть способы представить текст в виде чисел‚ мы можем решать множество интересных и практических задач.

Распознавание Именованных Сущностей (NER)

Представьте‚ что вы читаете новостную статью. Нам интересно‚ о каких людях‚ организациях‚ местах или датах идёт речь. NER (Named Entity Recognition) – это задача автоматического выделения и классификации таких "именованных сущностей" в тексте. Мы активно используем spaCy для быстрого и точного NER‚ так как он предоставляет предобученные модели и высокую производительность.

Для более сложных случаев или языков с богатой морфологией мы обращаемся к библиотеке Flair‚ которая известна своими State-of-the-Art моделями для NER. Мы также экспериментируем с CRF (Conditional Random Fields) для распознавания сущностей‚ особенно когда требуется высокая точность на специфических наборах данных. Оценка качества NER-моделей (F1-score‚ Precision‚ Recall) является важной частью нашей работы‚ чтобы убедиться в их эффективности.

Тематическое Моделирование: О чём на Самом Деле Текст?

В больших коллекциях документов часто бывает сложно понять общие темы‚ которые в них обсуждаются. Тематическое моделирование – это набор алгоритмов‚ которые позволяют нам автоматически обнаруживать скрытые «темы» в текстовых корпусах. Библиотека Gensim является нашим основным инструментом для этого.

- LDA (Latent Dirichlet Allocation): Мы используем LDA для выявления набора тем‚ каждая из которых представлена распределением слов‚ и каждого документа – как распределения тем. Это позволяет нам понять‚ какие темы доминируют в коллекции документов и какие слова характерны для каждой темы.

- LSI (Latent Semantic Indexing): LSI использует методы сингулярного разложения (SVD) для выявления скрытых семантических связей между словами и документами. Мы находим его полезным для задач поиска информации и категоризации.

- NMF (Non-negative Matrix Factorization): NMF – ещё один мощный метод тематического моделирования‚ часто используемый в Scikit-learn. Мы часто сравниваем модели тематического моделирования (LDA vs NMF)‚ чтобы выбрать наиболее подходящий подход для конкретной задачи‚ например‚ для анализа текстов отзывов клиентов.

Тематическое моделирование позволяет нам быстро ориентироваться в огромных объёмах информации‚ выявлять тренды и скрытые паттерны‚ что неоценимо для анализа больших текстовых массивов.

Анализ Тональности (Sentiment Analysis): Чувства Машины

Понимание эмоциональной окраски текста – положительной‚ отрицательной или нейтральной – является одной из самых востребованных задач NLP. Это помогает бизнесам анализировать отзывы клиентов‚ отслеживать упоминания бренда в социальных сетях и многое другое. Мы активно применяем VADER (Valence Aware Dictionary and sEntiment Reasoner) для быстрого и эффективного анализа тональности англоязычных текстов‚ особенно сообщений в социальных сетях (Twitter/Reddit).

Для более глубокого анализа тональности или работы с другими языками мы часто строим собственные модели классификации на основе машинного обучения. Анализ тональности финансовых новостей или отзывов о фильмах требует более тонкой настройки и часто учета сарказма и иронии‚ что является одной из сложных проблем обработки естественного языка;

Классификация Текстов: Автоматическая Сортировка

Классификация текстов – это задача отнесения документа к одной или нескольким предопределённым категориям. Будь то спам-фильтр‚ категоризация новостных статей или маршрутизация обращений клиентов‚ классификация – это фундамент. Мы используем Scikit-learn для классификации текстов‚ применяя такие алгоритмы‚ как SVM (Support Vector Machines)‚ наивный байесовский классификатор‚ логистическую регрессию и другие. Сравнение методов машинного обучения для NLP является частью нашей регулярной практики для выбора оптимального алгоритма.

Мы разрабатываем системы автоматической категоризации статей‚ новостей и даже пользовательских запросов‚ что значительно упрощает управление контентом и информационными потоками. Этот подход также применим для анализа отзывов о продуктах по категориям‚ позволяя быстро выявить проблемные области или сильные стороны продукта.

"Язык – это дорожная карта культуры. Он говорит нам‚ откуда пришли его люди и куда они идут." – Рита Мэй Браун

Современный NLP: Эпоха Глубокого Обучения и Трансформеров

Последние годы принесли революцию в NLP благодаря глубокому обучению и‚ в частности‚ архитектуре трансформеров. Это изменило наш подход к решению многих задач и открыло новые горизонты.

Нейронные Сети для NLP: PyTorch и TensorFlow

Для создания сложных моделей NLP‚ способных улавливать тонкие языковые закономерности‚ мы используем фреймворки глубокого обучения‚ такие как PyTorch и TensorFlow. Эти инструменты позволяют нам строить и обучать нейронные сети‚ включая рекуррентные нейронные сети (RNN) и их варианты‚ такие как LSTM (Long Short-Term Memory). Мы применяем Keras/TensorFlow для создания LSTM-сетей‚ которые были очень популярны для задач последовательностей‚ таких как машинный перевод или генерация текста‚ до появления трансформеров.