- Распаковываем Язык: Глубокое Погружение в NLP с Python – От Азов до Трансформеров

- Почему Python стал королем в мире NLP?

- Первые Шаги: Предобработка Текста – Фундамент Успеха

- Токенизация и Стемминг с NLTK

- Продвинутая Лемматизация и Стемминг со spaCy и Stanza

- Регулярные Выражения (re) в Предобработке Текста

- Как Компьютеры "Видят" Слова: Векторизация Текста

- Bag of Words и TF-IDF: Первые Попытки

- Word Embeddings: Word2Vec и GloVe с использованием Gensim

- Doc2Vec и Sentence Transformers: Векторизация Документов и Предложений

- Ключевые Задачи NLP: От Распознавания Сущностей до Анализа Тональности

- NER (Named Entity Recognition): Распознавание Именованных Сущностей

- Анализ Тональности (Sentiment Analysis)

- Тематическое Моделирование (LDA, LSI) с Gensim

- Классификация Текстов со Scikit-learn и Глубоким Обучением

- Извлечение Ключевых Фраз и Суммаризация Текста

- Продвинутые Техники и Современные Инструменты

- Трансформеры (Hugging Face) для Сложных Задач NLP

- Работа с Многоязычными Текстовыми Корпусами

- Веб-скрейпинг и Извлечение Текста из PDF

- Практические Применения и Решение Реальных Задач

- Анализ Отзывов Клиентов и Пользовательских Запросов

- Разработка Чат-ботов и QA-систем

- Анализ Юридических и Финансовых Документов

- Инструменты для Визуализации Текстовых Данных

- Вызовы и Будущее NLP

Распаковываем Язык: Глубокое Погружение в NLP с Python – От Азов до Трансформеров

Привет, дорогие читатели! Сегодня мы отправляемся в захватывающее путешествие по миру, где машины начинают понимать наш человеческий язык. Это не научная фантастика, а реальность, воплощенная в жизнь благодаря удивительной области — обработке естественного языка, или NLP (Natural Language Processing). Мы, как команда исследователей и энтузиастов, с каждым днем погружаемся все глубже в эту тему, и сегодня хотим поделиться с вами нашим опытом, от самых фундаментальных концепций до передовых архитектур, таких как Трансформеры.

В современном мире объемы текстовых данных растут экспоненциально: социальные сети, электронные письма, статьи, книги, отзывы клиентов – все это огромные залежи информации, ожидающие своего анализа. Но как заставить компьютер не просто хранить эти данные, а извлекать из них смысл, эмоции, ключевые идеи? Именно здесь на сцену выходит NLP, вооруженное мощью языка программирования Python и его обширными библиотеками. Мы покажем вам, как начать этот путь и какие инструменты станут вашими верными спутниками.

Почему Python стал королем в мире NLP?

Прежде чем мы углубимся в технические детали, давайте разберемся, почему именно Python занял лидирующие позиции в области NLP. Ответ прост: это его доступность, огромное сообщество и богатый арсенал библиотек. Мы видим, как каждый день появляются новые инструменты, упрощающие сложные задачи и делающие NLP доступным не только для академиков, но и для разработчиков, аналитиков и даже блогеров.

Синтаксис Python интуитивно понятен, что позволяет нам быстро прототипировать идеи и воплощать их в жизнь. Кроме того, наличие таких гигантов, как NLTK, spaCy, Gensim, Scikit-learn, PyTorch и TensorFlow, означает, что практически любая задача, связанная с текстом, может быть решена с помощью уже существующих, хорошо оптимизированных решений. Мы ценим эту экосистему за ее гибкость и мощь, которая позволяет нам сосредоточиться на сути проблемы, а не на низкоуровневой реализации.

Первые Шаги: Предобработка Текста – Фундамент Успеха

Любой проект в области NLP начинается с предобработки данных. Мы не можем просто передать "сырой" текст модели и ожидать чудес. Текст для компьютера — это всего лишь последовательность символов, и наша задача — помочь ему увидеть в этом потоке значимые единицы. Этот этап является краеугольным камнем, определяющим качество дальнейшего анализа.

Токенизация и Стемминг с NLTK

Начнем с токенизации – процесса разбиения текста на отдельные слова или фразы, которые мы называем токенами. NLTK (Natural Language Toolkit) является одной из старейших и наиболее уважаемых библиотек в Python для NLP, предоставляя множество инструментов для этой задачи. Мы часто используем его для начального этапа, так как он прост в освоении и очень гибок.

После токенизации часто возникает необходимость привести слова к их базовой форме. Здесь на помощь приходят стемминг (выделение основы слова путем отсечения окончаний) и лемматизация (приведение слова к его словарной форме, учитывая морфологию). NLTK предлагает различные стеммеры, например, PorterStemmer и SnowballStemmer. Хотя стемминг быстрее, он менее точен, чем лемматизация, которая использует словари и морфологический анализ, что делает ее предпочтительной для нас в проектах, где требуется высокая точность.

Мы также не забываем об очистке текста от пунктуации, чисел и приведении всех слов к нижнему регистру. Это стандартные операции, которые значительно улучшают качество данных для последующих моделей. Удаление стоп-слов (наиболее часто встречающихся слов, не несущих смысловой нагрузки, таких как "и", "в", "на") также является важным шагом, позволяющим снизить размерность данных и сосредоточиться на более значимых терминах.

Продвинутая Лемматизация и Стемминг со spaCy и Stanza

Когда речь заходит о более сложных задачах, особенно для языков с богатой морфологией, таких как русский, мы обращаемся к spaCy и Stanza. spaCy – это высокопроизводительная библиотека, предназначенная для работы с "боевыми" проектами. Её лемматизатор значительно превосходит стеммеры NLTK по точности, так как он основан на статистических моделях и глубоком обучении.

Stanza (от Stanford NLP Group) – еще один мощный инструмент, который мы активно используем, особенно для многоязычных проектов. Он обеспечивает высокую точность лемматизации и морфологического анализа, что крайне важно при работе с текстами на русском языке, где каждое слово может иметь множество форм. Эти библиотеки позволяют нам обрабатывать текст не просто как последовательность символов, а как осмысленную структуру.

Регулярные Выражения (re) в Предобработке Текста

Несмотря на мощь специализированных библиотек, стандартный модуль Python re для работы с регулярными выражениями остается нашим незаменимым помощником. Мы используем его для решения множества задач по очистке текста: удаление HTML-тегов, извлечение URL-адресов, нормализация сленга или эмодзи, поиск определенных паттернов и многое другое. Гибкость регулярных выражений позволяет нам точно контролировать процесс очистки, адаптируя его под специфические требования каждого проекта.

Например, чтобы удалить все HTML-теги из текста, мы можем использовать простую регулярку. А для извлечения даты или номера телефона – более сложные паттерны. Это мощный инструмент, который, при правильном использовании, значительно упрощает предобработку и делает данные более чистыми и пригодными для анализа.

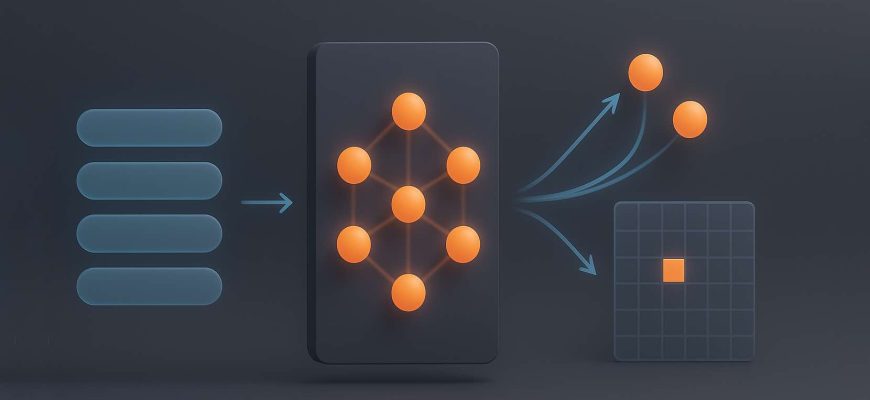

Как Компьютеры "Видят" Слова: Векторизация Текста

После того как текст очищен и приведен к нужной форме, нам нужно преобразовать слова в числовой формат, понятный для алгоритмов машинного обучения. Этот процесс называется векторизацией текста. Мы не можем просто передать слова "кошка", "собака", "дом" в модель; они должны быть представлены в виде векторов чисел.

Bag of Words и TF-IDF: Первые Попытки

Одни из самых базовых, но все еще актуальных методов векторизации – это CountVectorizer (модель "мешка слов") и TfidfVectorizer. CountVectorizer просто подсчитывает частоту каждого слова в документе, игнорируя порядок слов. Это простой, но часто эффективный подход.

Однако он не учитывает важность слов. Здесь на помощь приходит TF-IDF (Term Frequency-Inverse Document Frequency). Этот метод не только учитывает, как часто слово встречается в конкретном документе (TF), но и насколько оно редко встречается во всем корпусе документов (IDF). Таким образом, слова, которые часто встречаются во многих документах (например, стоп-слова), получают меньший вес, а уникальные и информативные слова – больший. Мы часто используем TF-IDF для задач классификации и тематического моделирования, так как он дает хорошие базовые результаты.

Давайте посмотрим на небольшое сравнение:

| Метод | Преимущества | Недостатки | Применение |

|---|---|---|---|

| CountVectorizer | Простота реализации, высокая скорость | Не учитывает важность слов, большую размерность, отсутствие семантики | Классификация коротких текстов, анализ частотности |

| TfidfVectorizer | Учитывает важность слов, снижает вес общих слов | Потеря контекста, все еще высокая размерность | Классификация, тематическое моделирование, поиск релевантности |

Word Embeddings: Word2Vec и GloVe с использованием Gensim

Более продвинутый подход к векторизации – это Word Embeddings, или векторные представления слов. Вместо того чтобы просто подсчитывать частоту, эти методы учатся представлять слова в многомерном пространстве таким образом, чтобы семантически похожие слова располагались ближе друг к другу. Это настоящий прорыв, позволяющий моделям улавливать смысл слов и их отношения.

Мы активно используем Word2Vec и GloVe, часто с помощью библиотеки Gensim. Word2Vec, разработанный Google, имеет две основные архитектуры: Skip-gram и CBOW. Skip-gram предсказывает контекст по слову, а CBOW – слово по контексту. GloVe (Global Vectors for Word Representation) использует глобальную статистику соо встречаемости слов. Эти модели позволяют нам получить плотные векторы, где каждое измерение несет в себе некий аспект значения слова.

Преимущество Word Embeddings в том, что они позволяют нам работать с семантикой. Например, в векторном пространстве может существовать приблизительное соотношение: "король" ⏤ "мужчина" + "женщина" = "королева". Это открывает двери для гораздо более глубокого анализа текста.

Doc2Vec и Sentence Transformers: Векторизация Документов и Предложений

Если Word Embeddings работают со словами, то Doc2Vec (расширение Word2Vec) позволяет нам получать векторные представления целых документов. Это невероятно полезно, когда нам нужно сравнивать документы по их смысловому содержанию, кластеризовать их или находить похожие. Мы используем Doc2Vec через Gensim для задач, связанных с анализом больших текстовых массивов, например, для поиска схожих статей или отзывов.

Еще более продвинутым подходом являются Sentence Transformers. Эти модели, основанные на архитектурах трансформеров, позволяют получать высококачественные векторные представления целых предложений и даже коротких параграфов. Они особенно эффективны для задач, где важен контекст всего предложения, таких как семантический поиск, кластеризация предложений или определение их сходства. Мы находим их незаменимыми для современных задач NLP.

Ключевые Задачи NLP: От Распознавания Сущностей до Анализа Тональности

Теперь, когда мы знаем, как подготовить текст и представить его в числовом виде, давайте рассмотрим некоторые из наиболее распространенных и важных задач, которые мы решаем с помощью NLP.

NER (Named Entity Recognition): Распознавание Именованных Сущностей

Распознавание именованных сущностей (NER) — это задача идентификации и классификации именованных сущностей в тексте, таких как имена людей, названия организаций, географические местоположения, даты, валюты и т.д. Это критически важно для извлечения структурированной информации из неструктурированного текста.

Мы часто используем spaCy для быстрого NER благодаря его высокой производительности и точности. Он поставляется с предварительно обученными моделями для различных языков, что позволяет нам начать работу почти мгновенно. Для более сложных сценариев или специфических доменов мы можем обучать собственные модели NER, используя такие фреймворки, как Flair, который особенно хорош для языков с богатой морфологией, или CRF (Conditional Random Fields) для более классических подходов.

Представьте, что у вас есть тысячи новостных статей, и вам нужно быстро узнать, какие компании, люди и места упоминаются в каждой. NER делает это возможным, автоматизируя процесс, который вручную занял бы недели.

Анализ Тональности (Sentiment Analysis)

Анализ тональности — это процесс определения эмоциональной окраски текста: позитивной, негативной или нейтральной. Это одна из самых востребованных задач NLP, особенно для бизнеса, который хочет понять, что клиенты думают о его продуктах или услугах.

Для быстрого и простого анализа тональности мы часто обращаемся к VADER (Valence Aware Dictionary and sEntiment Reasoner), который отлично подходит для текстов из социальных сетей, поскольку учитывает эмодзи и сленг. TextBlob также предлагает удобный интерфейс для анализа тональности, хотя его точность может быть ниже для специфических доменов или русского языка без дополнительной настройки.

Однако для глубокого анализа, особенно в таких чувствительных областях, как анализ тональности финансовых новостей или анализ тональности сообщений в социальных сетях с учетом сарказма, мы разрабатываем более сложные модели на основе машинного обучения или глубоких нейронных сетей, обучая их на размеченных данных. Это позволяет нам улавливать тонкие нюансы и контекст, которые не могут быть учтены простыми лексическими методами.

Тематическое Моделирование (LDA, LSI) с Gensim

Как извлечь скрытые темы из большого набора документов? Для этого существует тематическое моделирование. Это задача, при которой мы пытаемся обнаружить абстрактные "темы", которые присутствуют в наборе документов, и определить, какие документы связаны с какими темами.

Библиотека Gensim является нашим основным инструментом для тематического моделирования. Мы используем такие алгоритмы, как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing). LDA предполагает, что каждый документ состоит из смеси тем, а каждая тема — из смеси слов. LSI, в свою очередь, использует сингулярное разложение для выявления латентных семантических связей между словами и документами.

Сравнение моделей тематического моделирования, таких как LDA и NMF (Non-negative Matrix Factorization), показывает, что выбор алгоритма часто зависит от характеристик данных и конкретной задачи. Мы экспериментируем с обоими, чтобы найти наиболее подходящее решение для выявления скрытых тем в отзывах клиентов, статьях или новостных лентах.

"Язык – это дорожная карта культуры. Он говорит вам, откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Классификация Текстов со Scikit-learn и Глубоким Обучением

Классификация текстов, это одна из наиболее распространенных задач NLP, которая заключается в присвоении категории или метки тексту. Будь то спам-фильтрация, категоризация новостей или анализ отзывов по продуктам, классификация текста играет ключевую роль.

Мы часто начинаем с Scikit-learn, используя такие алгоритмы, как SVM (Support Vector Machines), наивный байесовский классификатор или логистическая регрессия. Эти методы, в сочетании с TF-IDF векторизацией, дают отличные базовые результаты и являются хорошей отправной точкой для многих проектов. Простота использования и обширная документация Scikit-learn делают его незаменимым инструментом в нашем арсенале.

Однако для более сложных задач, где требуется уловить глубокие контекстные зависимости, мы переходим к PyTorch/TensorFlow для создания нейросетей NLP. LSTM-сети (Long Short-Term Memory) долгое время были стандартом для последовательных данных, таких как текст, позволяя сохранять информацию на больших дистанциях. Сегодня же, с появлением Transformer-моделей, мы видим новый виток в развитии классификации, где контекстные встраивания и механизмы внимания обеспечивают беспрецедентную точность.

Извлечение Ключевых Фраз и Суммаризация Текста

В условиях информационного перегруза, способность быстро извлекать главное из текста становится бесценной. Здесь нам помогают извлечение ключевых фраз и суммаризация текста.

Для извлечения ключевых слов и фраз мы используем такие алгоритмы, как RAKE (Rapid Automatic Keyword Extraction) и TextRank (на основе алгоритма PageRank). RAKE эффективен для извлечения многословных фраз, а TextRank отлично подходит для выделения ключевых предложений, что может быть первым шагом к экстрактивной суммаризации.

Разработка системы суммаризации текста может идти по двум основным путям:

- Экстрактивная суммаризация: Выбор наиболее важных предложений из исходного текста для формирования краткого изложения. Мы используем TextRank для этой цели.

- Абстрактивная суммаризация: Генерация нового текста, который передает смысл оригинала, но не обязательно содержит его оригинальные предложения. Это более сложная задача, требующая применения моделей глубокого обучения, таких как Transformer-модели (например, на базе Hugging Face).

Мы постоянно сравниваем модели суммирования, чтобы понять их эффективность для разных типов контента, будь то новостные статьи или длинные отчеты.

Продвинутые Техники и Современные Инструменты

Мир NLP развивается с невероятной скоростью. То, что вчера казалось сложным исследовательским проектом, сегодня доступно в виде готовой библиотеки. Мы постоянно следим за новейшими тенденциями и интегрируем их в нашу работу.

Трансформеры (Hugging Face) для Сложных Задач NLP

Без преувеличения, Трансформеры произвели революцию в NLP. Они лежат в основе таких моделей, как BERT, GPT, RoBERTa, T5 и многих других. Их ключевая особенность — механизм внимания (attention mechanism), который позволяет модели взвешивать важность различных частей входной последовательности при обработке. Это значительно улучшает понимание контекста и взаимосвязей в тексте.

Библиотека Hugging Face Transformers стала де-факто стандартом для работы с этими моделями. Она предоставляет простой и унифицированный интерфейс для сотен предварительно обученных моделей, позволяя нам решать множество задач: от классификации и NER до суммаризации и генерации текста. Мы активно используем ее для тонкой настройки (fine-tuning) предварительно обученных моделей на наших собственных данных, что позволяет достигать впечатляющих результатов даже с ограниченным объемом размеченных данных.

Примеры задач, которые мы решаем с помощью трансформеров:

- Генерация текста (GPT): Создание связных и осмысленных текстов, например, для автозаполнения, написания статей или диалогов для чат-ботов.

- Машинный перевод: Построение систем для перевода текстов между различными языками с высокой точностью.

- Вопросно-ответные системы (QA): Создание моделей, способных отвечать на вопросы, основываясь на предоставленном тексте или корпусе документов.

- Анализ кода (сжатие кода): Применение NLP-техник для понимания и оптимизации программного кода.

Работа с Многоязычными Текстовыми Корпусами

Мир не ограничивается английским языком, и мы часто сталкиваемся с необходимостью обработки текстов на разных языках. Для этого у нас есть несколько мощных инструментов.

Polyglot – это библиотека, которая предоставляет простой доступ к многоязычным функциям, таким как определение языка, токенизация, NER и анализ тональности для множества языков, включая редкие. Stanza, как мы уже упоминали, также отлично подходит для языков с богатой морфологией, предлагая продвинутый синтаксический парсинг и POS-теггинг.

Работа с нелатинскими алфавитами в Python NLP требует особого внимания к кодировке и выбору моделей. Современные трансформерные модели часто обучаются на многоязычных корпусах (Multilingual BERT, XLM-R), что позволяет им эффективно работать с десятками языков без необходимости обучения отдельных моделей для каждого.

Веб-скрейпинг и Извлечение Текста из PDF

Текстовые данные не всегда находятся в удобном для анализа формате. Часто нам приходится собирать данные из интернета или извлекать текст из различных документов.

Для веб-скрейпинга мы используем библиотеку Beautiful Soup. Она позволяет нам парсить HTML и XML документы, легко извлекая нужный текст, ссылки, заголовки и другие элементы. Это наш первый шаг, когда нам нужно собрать большой корпус текстов для обучения модели или для анализа определенной предметной области.

Когда данные заперты в PDF-файлах, на помощь приходит PyMuPDF. Эта библиотека позволяет нам эффективно извлекать текст, изображения и метаданные из PDF-документов, что крайне важно при работе с юридическими документами, научными статьями или отчетами.

Практические Применения и Решение Реальных Задач

Теория прекрасна, но настоящая магия NLP проявляется в его практическом применении. Мы используем эти инструменты для решения самых разных задач в реальном мире.

Анализ Отзывов Клиентов и Пользовательских Запросов

Одним из самых мощных применений NLP является анализ текстов отзывов клиентов. Мы можем не только определить общую тональность, но и выявить ключевые темы, о которых говорят люди, понять их болевые точки, определить сильные и слабые стороны продукта или услуги. Например, с помощью тематического моделирования мы можем обнаружить, что клиенты часто жалуются на "качество обслуживания" или "скорость доставки".

Анализ паттернов в пользовательских запросах позволяет нам улучшать поисковые системы, понимать намерения пользователей и оптимизировать контент. Мы также можем использовать NLP для анализа стилистики текстов, чтобы определить авторский почерк, или для работы с эмодзи и сленгом в современных текстах, что особенно важно для социальных сетей.

Разработка Чат-ботов и QA-систем

Разработка чат-ботов на Python, особенно с использованием фреймворка Rasa, стала для нас увлекательным направлением. Rasa позволяет создавать контекстно-зависимых чат-ботов, способных понимать естественный язык и вести диалог. Мы используем NLP для понимания намерений пользователя (intent recognition) и извлечения сущностей (entity extraction) из его запросов.

Параллельно мы работаем над разработкой систем вопросно-ответных систем (QA). Это более сложная задача, чем чат-боты, поскольку QA-системы должны не просто отвечать по шаблону, а находить точный ответ в большом корпусе документов. Современные Transformer-модели прекрасно подходят для этой цели, позволяя нам строить системы, которые могут "читать" текст и находить нужную информацию.

Анализ Юридических и Финансовых Документов

Применение NLP в специализированных областях, таких как юриспруденция и финансы, открывает огромные возможности. Использование Python для анализа юридических документов позволяет нам автоматизировать извлечение ключевых дат, имен сторон, обязательств и условий из контрактов. Это значительно сокращает время на ручной анализ и повышает точность.

Аналогично, анализ текстовых данных в финансовой отчетности или анализ тональности финансовых новостей помогает нам выявлять риски, предсказывать тенденции рынка и принимать более обоснованные решения. Мы можем разрабатывать системы для извлечения фактов из новостей, что критически важно для проверки информации (Fact-Checking) в условиях постоянно меняющегося информационного потока.

Инструменты для Визуализации Текстовых Данных

Визуализация играет ключевую роль в понимании больших объемов текстовых данных. Мы не просто хотим получить результаты, мы хотим их увидеть и интерпретировать. Для этого мы используем различные инструменты:

- Word Clouds (облака слов): Простой, но эффективный способ визуализации частотности слов в тексте. Чем больше слово, тем чаще оно встречается.

- Heatmaps (тепловые карты): Используются для отображения матриц сходства, например, между документами или словами, помогая выявить кластеры и взаимосвязи.

- Графики распределения частотности: Для анализа частотности слов и n-грамм, что позволяет нам понять основные темы и особенности языка в корпусе.

- Визуализация эмбеддингов: Снижение размерности (например, с помощью t-SNE или UMAP) для отображения векторных представлений слов или документов на 2D/3D графике, позволяя увидеть семантические кластеры.

Эти инструменты помогают нам не только представлять результаты, но и глубже понимать данные, направляя дальнейший анализ.

Вызовы и Будущее NLP

Несмотря на все достижения, NLP по-прежнему сталкивается с серьезными вызовами. Проблемы обработки неполных и ошибочных данных, понимание сарказма и иронии, а также работа с постоянно развивающимся языком (сленг, новые эмодзи) требуют постоянных исследований и разработок.

Мы видим будущее NLP в еще большей интеграции с другими областями ИИ, такими как компьютерное зрение (для мультимодального анализа) и речевые технологии (Speech-to-Text с библиотекой Gentle); Разработка систем машинного перевода на Python продолжит улучшаться, преодолевая языковые барьеры. Создание словарей и тезаурусов, а также разработка инструментов для проверки грамматики и орфографии, остаются важными задачами для повышения качества текста.

Обработка больших текстовых массивов (Big Data NLP) становится все более актуальной, требуя эффективных и масштабируемых решений. Мы также ожидаем дальнейшего развития в области разработки инструмента для автоматической разметки данных, что значительно упростит процесс подготовки обучающих выборок для моделей глубокого обучения.

Мы надеемся, что это глубокое погружение в мир NLP с Python оказалось для вас таким же увлекательным, как и для нас. От основ токенизации и стемминга до магии трансформеров и их способности генерировать связный текст – мы прошли долгий путь. Мы увидели, как Python, со своим богатым набором библиотек, позволяет нам решать самые амбициозные задачи, превращая неструктурированный текст в ценные инсайты.

NLP — это динамично развивающаяся область, которая постоянно предлагает новые возможности и вызовы. Наше путешествие в этот мир только начинается, и мы с нетерпением ждем, какие открытия и инновации принесет нам завтрашний день. Если вы только начинаете свой путь в NLP, помните: главное — это экспериментировать, учиться и не бояться сложных задач. Удачи вам в ваших текстовых приключениях!

Подробнее: Ключевые запросы для углубленного изучения NLP

| NLTK основы | spaCy NER | Gensim LDA | Scikit-learn классификация текста | Word2Vec GloVe |

| Анализ тональности VADER | Трансформеры Hugging Face | TextRank ключевые фразы | Doc2Vec векторизация | Python NLP приложения |