- Распаковываем Язык: Наш Глубокий Погружение в NLP с Python

- Первые шаги: Фундамент обработки текста

- Токенизация и Стемминг: Разбираем слова по косточкам

- Лемматизация: Более точный подход

- Мощные инструменты в нашем арсенале

- spaCy: Скорость и Точность для Профессионалов

- Gensim: Вглубь Тем и Смыслов

- Scikit-learn: Классификация и Векторизация на Высоте

- VADER: Анализ тональности без лишних слов

- Векторизация текста: Превращаем слова в числа

- Эмбеддинги слов: Word2Vec, GloVe, FastText

- Эмбеддинги предложений и документов: Doc2Vec и Sentence Transformers

- Глубокое погружение: Трансформеры и нейросети

- Hugging Face и Предварительно Обученные Модели: Демократизация ИИ

- Нейросети на PyTorch/TensorFlow: Строим свое будущее

- Практические кейсы: Где NLP раскрывает свой потенциал

- Анализ Тональности: Понимаем Эмоции

- Извлечение Ключевых Фраз и Сущностей

- Суммаризация Текста: Извлекаем Суть

- Чат-боты и Диалоговые Системы

- Веб-скрейпинг и Работа с Различными Форматами

- Работа с Многоязычными Корпусами

- Специфические Задачи и Вызовы

- Визуализация и Оценка: Что показывают данные?

- Будущее NLP: Куда движемся

Распаковываем Язык: Наш Глубокий Погружение в NLP с Python

Привет, дорогие читатели и коллеги по цеху! Сегодня мы отправляемся в одно из самых захватывающих путешествий в мире технологий – в область Обработки Естественного Языка (NLP). Это не просто набор алгоритмов; это волшебство, позволяющее машинам понимать, интерпретировать и даже генерировать человеческую речь. Представьте: мы можем заставить компьютер читать тысячи отзывов, извлекать из них ключевые мнения, переводить тексты на разные языки, или даже вести осмысленный диалог. Все это стало возможным благодаря невероятному прогрессу в NLP, а Python выступает нашим надежным проводником в этом удивительном мире. Мы, как блогеры, ежедневно работающие с текстом, особенно ценим инструменты, которые помогают нам анализировать огромные объемы информации, понимать тренды и создавать контент, который действительно резонирует с нашей аудиторией.

Мы помним времена, когда работа с текстом для машин казалась чем-то из области фантастики. Слова, предложения, контекст, сарказм, метафоры – все это представляло собой непреодолимый барьер. Однако сегодня, благодаря таким библиотекам, как NLTK, spaCy, Gensim и, конечно же, революционным трансформерам от Hugging Face, мы можем творить чудеса. В этой статье мы не просто расскажем о различных инструментах и методах; мы поделимся нашим опытом, покажем, как эти технологии применяются на практике, и вдохновим вас на собственные эксперименты. Приготовьтесь, будет много кода, интересных идей и глубоких размышлений о том, как язык формирует наш цифровой мир.

Первые шаги: Фундамент обработки текста

Прежде чем мы начнем строить сложные модели и анализировать огромные массивы данных, нам необходимо освоить базовые, но крайне важные концепции. Представьте, что текст – это сырой алмаз. Чтобы он засиял, его нужно сначала обработать. В NLP этот процесс называется предобработкой текста, и он является краеугольным камнем любой успешной задачи. Мы начинаем с того, что разбиваем текст на более мелкие, управляемые части, а затем приводим эти части к их базовым формам, чтобы машина могла их эффективно "понять".

Наш первый и, пожалуй, самый важ инструмент здесь – NLTK (Natural Language Toolkit). Это одна из старейших и наиболее полных библиотек для NLP в Python, которая предоставляет нам фундаментальные строительные блоки. С NLTK мы учимся токенизировать текст, то есть разбивать его на слова и предложения. Это кажется простым, но это критически важный шаг, поскольку компьютер не может работать с целым абзацем текста так же, как человек.

Токенизация и Стемминг: Разбираем слова по косточкам

Итак, что же такое токенизация? Это процесс разделения текста на отдельные "токены", которые могут быть словами, знаками препинания или даже целыми предложениями. Мы используем методы NLTK для word_tokenize и sent_tokenize, чтобы превратить непрерывный поток символов в структурированный список элементов, с которыми уже можно работать. Например, предложение "Мы любим NLP!" может быть разделено на токены [‘Мы’, ‘любим’, ‘NLP’, ‘!’].

После токенизации часто возникает проблема: одно и то же слово может иметь разные формы (например, "бежать", "бежит", "бежал"). Для компьютера это разные слова, хотя по сути они обозначают одно и то же действие. Здесь на помощь приходит стемминг (stemming) – процесс приведения слова к его корневой форме (стемме) путем отсечения окончаний. Стеммеры, такие как PorterStemmer или SnowballStemmer в NLTK, делают это быстро и эффективно, хотя иногда и не всегда корректно, создавая несуществующие слова. Например, "running" может стать "runn", а не "run". Несмотря на свои недостатки, стемминг значительно сокращает словарный запас и помогает в анализе.

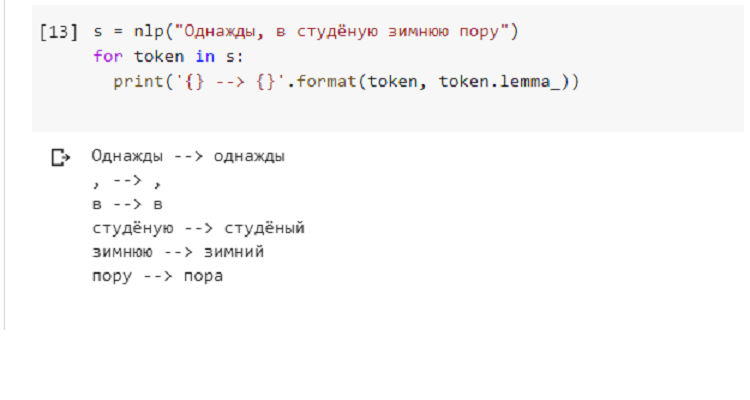

Лемматизация: Более точный подход

Если стемминг – это грубая обрезка, то лемматизация – это более элегантный и точный подход. Она тоже приводит слова к их базовой форме (лемме), но делает это с учетом морфологического анализа, то есть понимает часть речи и контекст. Результатом лемматизации всегда является реально существующее слово. Например, "бегущий", "бежал", "бегать" будут приведены к "бежать", а "лучший" к "хороший". Для лемматизации мы часто используем WordNetLemmatizer из NLTK или более продвинутые инструменты из spaCy, о которых мы поговорим чуть позже. Это позволяет нам сохранять семантическую целостность слов и улучшает качество последующего анализа.

Помимо токенизации, стемминга и лемматизации, мы также активно используем регулярные выражения (re) для более тонкой предобработки текста. Они позволяют нам находить и заменять определенные паттерны в тексте: удалять URL-адреса, хэштеги, цифры, специальные символы или HTML-теги. Это незаменимый инструмент для очистки данных, который гарантирует, что в наш анализ попадает только релевантная информация, свободная от "шума", который может исказить результаты. Представьте, что мы собираем данные из интернета – там часто встречаются различные артефакты, и регулярные выражения помогают нам навести порядок.

Вот краткий обзор основных этапов предобработки текста, которые мы обычно выполняем:

- Очистка текста: Удаление HTML-тегов, URL-адресов, специальных символов, цифр (если они не важны для задачи).

- Приведение к нижнему регистру: Чтобы "Слово" и "слово" считались одним и тем же.

- Токенизация: Разделение текста на слова или предложения.

- Удаление стоп-слов: Избавление от часто встречающихся, но малозначимых слов (артикли, предлоги, союзы – "и", "в", "на", "он" и т.д.). NLTK предлагает готовые списки стоп-слов для разных языков.

- Стемминг или Лемматизация: Приведение слов к их базовой форме.

Мощные инструменты в нашем арсенале

После освоения основ предобработки мы готовы перейти к более мощным и специализированным библиотекам. NLTK отлично подходит для фундаментальных задач, но для более сложных и производительных операций нам нужны другие инструменты. Мы используем их как единую экосистему, выбирая лучший инструмент для каждой конкретной задачи. Это как иметь целый ящик с инструментами, где для каждого вида работ есть свой специализированный молоток или отвертка.

spaCy: Скорость и Точность для Профессионалов

Если NLTK – это наша уютная мастерская, то spaCy – это высокоскоростной завод. Эта библиотека разработана с учетом производительности и простоты использования в продакшене. Она предоставляет нам предварительно обученные модели для различных языков, что значительно упрощает работу. Мы особенно ценим spaCy за его возможности в Распознавании Именованных Сущностей (NER). NER позволяет нам автоматически выделять из текста имена людей, организации, географические названия, даты и многое другое. Это невероятно полезно для извлечения информации из неструктурированных текстов, например, для анализа новостных статей или юридических документов. Представьте, что мы читаем тысячи контрактов и нам нужно быстро найти все компании и даты – spaCy сделает это за нас.

Кроме NER, spaCy предлагает продвинутую лемматизацию (значительно точнее, чем в NLTK), синтаксический парсинг (анализ грамматической структуры предложения), а также быстрые и эффективные токенизаторы. Мы часто используем spaCy, когда нам нужна не только точность, но и скорость обработки больших объемов данных. Его архитектура позволяет легко интегрировать собственные модели и расширять функциональность.

Gensim: Вглубь Тем и Смыслов

Когда нам нужно понять "о чем" текст, или найти скрытые связи между словами, мы обращаемся к Gensim. Эта библиотека специализируется на тематическом моделировании и работе с векторными представлениями слов (Word Embeddings). Мы используем Gensim для:

- Тематического моделирования (LDA, LSI): Алгоритмы, такие как Латентное Размещение Дирихле (LDA) и Латентно-Семантический Индекс (LSI), позволяют нам выявлять скрытые темы в больших коллекциях документов. Например, анализируя тысячи статей, мы можем автоматически определить, какие из них посвящены "политике", какие – "спорту", а какие – "технологиям". Это незаменимо для организации контента или анализа пользовательских отзывов.

- Word Embeddings (Word2Vec, GloVe, Doc2Vec): Это одна из самых революционных идей в NLP. Вместо того чтобы представлять слова как уникальные идентификаторы, мы учим модель отображать их в многомерное векторное пространство. Слова с похожим значением оказываются близко друг к другу в этом пространстве. Word2Vec и GloVe – это наши основные инструменты здесь. Мы используем их для поиска семантически похожих слов, для улучшения рекомендательных систем и даже для решения аналоговых задач типа "Король ⎻ Мужчина + Женщина = Королева". Doc2Vec расширяет эту идею на целые документы, позволяя нам сравнивать их по смыслу.

Gensim позволяет нам заглянуть за поверхностный уровень текста и понять его истинную суть, что особенно важно для блогеров, стремящихся создавать глубокий и релевантный контент.

Scikit-learn: Классификация и Векторизация на Высоте

Для задач классификации текстов, когда нам нужно отнести документ к одной или нескольким заранее определенным категориям, нашим главным инструментом является Scikit-learn. Это универсальная библиотека машинного обучения, которая предоставляет широкий спектр алгоритмов и утилит. В контексте NLP мы активно используем ее для:

- Классификации текстов: Отфильтровать спам, категоризировать новостные статьи, определить тональность отзывов (положительный/отрицательный/нейтральный). Мы можем применять такие алгоритмы, как SVM, Наивный Байесовский классификатор, Логистическая Регрессия и многие другие.

- Векторизаторы текста: Scikit-learn предоставляет отличные реализации

CountVectorizerиTfidfVectorizer. Эти инструменты превращают необработанный текст в числовые векторы, которые могут быть поданы на вход моделям машинного обучения.

CountVectorizerпросто подсчитывает частоту каждого слова в документе.TfidfVectorizerучитывает не только частоту слова в документе, но и его редкость во всем корпусе, что делает его более мощным для выделения важных слов.

Мы создаем собственные векторизаторы текста, чтобы адаптировать их под специфические нужды наших проектов, а затем используем их в связке с классификаторами Scikit-learn для построения надежных систем;

VADER: Анализ тональности без лишних слов

Когда речь заходит об анализе тональности (Sentiment Analysis), особенно для коротких текстов из социальных сетей, VADER (Valence Aware Dictionary and sEntiment Reasoner) становится нашим быстрым и эффективным помощником. Это лексический инструмент, который не требует предварительного обучения на больших корпусах, что делает его идеальным для экспресс-анализа. VADER хорошо справляется с сленгом, эмодзи и даже сарказмом, что очень важно при анализе пользовательских комментариев и сообщений в Twitter или Reddit. Мы используем его для быстрого получения представлений о настроениях аудитории по отношению к определенному продукту, событию или бренду.

Чтобы наглядно показать различия и области применения наших любимых библиотек, мы подготовили небольшую сравнительную таблицу:

| Библиотека | Основные функции | Преимущества | Идеально для |

|---|---|---|---|

| NLTK | Токенизация, стемминг, лемматизация, POS-тегинг, стоп-слова | Обширный набор базовых инструментов, учебные материалы, поддержка многих языков | Обучение NLP, академические исследования, базовый препроцессинг |

| spaCy | NER, синтаксический парсинг, продвинутая лемматизация, быстрые токены | Высокая производительность, готовые обученные модели, удобство для продакшена | Извлечение информации, построение продакшн-систем, анализ зависимостей |

| Gensim | Тематическое моделирование (LDA, LSI), Word2Vec, GloVe, Doc2Vec | Эффективная работа с большими корпусами, глубокий семантический анализ | Выявление тем, поиск похожих документов/слов, рекомендательные системы |

| Scikit-learn | CountVectorizer, TfidfVectorizer, классификаторы (SVM, Naive Bayes и др;) | Множество алгоритмов ML, стандартизированный API, хорошие векторизаторы | Классификация текста, создание собственных векторизаторов |

| VADER | Анализ тональности | Не требует обучения, хорошо работает с социальными медиа, эмодзи, сленгом | Быстрый анализ тональности коротких текстов |

Векторизация текста: Превращаем слова в числа

Мы уже упоминали о векторизаторах, но давайте уделим им отдельное внимание, ведь это ключевой момент в NLP. Компьютеры работают с числами, а не со словами. Поэтому, чтобы машина могла "понять" текст, мы должны преобразовать его в числовой формат – вектор. Это как дать каждому слову или документу свой уникальный "адрес" в математическом пространстве.

Начали мы с простых методов, таких как CountVectorizer и TfidfVectorizer, которые являются частью Scikit-learn. Они строят матрицу, где строки – это документы, а столбцы – слова, и заполняют ячейки частотой слов или их TF-IDF весами. TF-IDF (Term Frequency-Inverse Document Frequency) – это мощный способ оценить важность слова в документе относительно его распространенности во всем корпусе. Мы активно используем TF-IDF для извлечения ключевых фраз и для задач классификации, поскольку он эффективно выделяет наиболее релевантные термины.

Однако эти методы имеют свои ограничения: они не учитывают семантику слов. "Король" и "Принц" оказываются так же "далеки" друг от друга, как "Король" и "Банан", если только они не встречаются в похожих контекстах. Это привело нас к эпохе Word Embeddings.

Эмбеддинги слов: Word2Vec, GloVe, FastText

Как мы уже упоминали, Word2Vec и GloVe (Global Vectors for Word Representation) стали прорывом. Они учатся представлять слова в виде плотных векторов (обычно 100-300 измерений), где семантически похожие слова имеют похожие векторные представления. Мы использовали их для множества задач: от поиска синонимов до улучшения поиска по сайту. Наш опыт показывает, что предварительно обученные модели (например, на Google News или Wikipedia) дают отличные результаты даже для специфических доменов, хотя иногда мы обучаем свои модели на наших собственных данных для максимальной точности.

FastText, разработанный Facebook, – это еще один мощный инструмент, который мы активно используем. Его особенность в том, что он работает не только со словами целиком, но и с их подсловами (n-граммами символов). Это позволяет ему эффективно работать с редкими словами (out-of-vocabulary words) и языками с богатой морфологией (например, с русским), где слова могут иметь множество форм. FastText часто дает нам более устойчивые эмбеддинги для таких языков.

Эмбеддинги предложений и документов: Doc2Vec и Sentence Transformers

Если мы можем векторизовать слова, почему бы не векторизовать целые предложения или документы? Именно это делает Doc2Vec (расширение Word2Vec) и Sentence Transformers. Doc2Vec позволяет нам получить векторное представление для всего документа, что полезно для поиска похожих документов или кластеризации текстов. Мы использовали его для анализа текстов отзывов клиентов, чтобы группировать их по схожим темам, даже если они используют разную лексику.

Sentence Transformers – это более современный и мощный подход, основанный на архитектуре трансформеров (о них чуть позже). Они позволяют нам получать высококачественные эмбеддинги для предложений и документов, которые прекрасно работают для поиска семантического сходства, суммаризации и создания вопросно-ответных систем. Мы обнаружили, что Sentence Transformers значительно превосходят традиционные методы, когда речь идет о понимании тонких нюансов смысла в предложениях.

Глубокое погружение: Трансформеры и нейросети

Если Word Embeddings стали революцией, то Трансформеры – это настоящая квантовая скачок в NLP. Мы помним, как появление этой архитектуры изменило все. Теперь машины могут не просто понимать отдельные слова, но и контекст целых предложений и даже документов, улавливая сложные зависимости, которые раньше были недоступны.

Hugging Face и Предварительно Обученные Модели: Демократизация ИИ

Пионером в этой области, безусловно, является Hugging Face с их библиотекой transformers. Они сделали предварительно обученные модели, такие как BERT, GPT, RoBERTa, T5 и многие другие, доступными для всех. Это изменило подход к разработке NLP-систем. Вместо того чтобы обучать модели с нуля на огромных массивах данных (что требует колоссальных вычислительных ресурсов), мы теперь можем брать уже "умные" модели и "доучивать" их (fine-tuning) на наших специфических задачах с гораздо меньшими объемами данных. Мы использовали эти модели для:

- Классификации: Более точная классификация текстов по сравнению с традиционными методами.

- NER: Значительно улучшенное распознавание именованных сущностей.

- Вопросно-ответных систем (QA): Создание систем, которые могут находить ответы на вопросы в больших текстовых корпусах.

- Генерации текста: Написание статей, создание диалогов для чат-ботов, даже генерация кода!

Это как получить в руки суперспособность: мы можем адаптировать самые передовые исследования под наши нужды, не будучи крупной корпорацией с неограниченными ресурсами.

Нейросети на PyTorch/TensorFlow: Строим свое будущее

Для самых сложных и кастомных задач, когда нам требуется полный контроль над архитектурой модели, мы обращаемся к фреймворкам глубокого обучения, таким как PyTorch и TensorFlow (с Keras). На них мы создаем собственные нейросети, включая архитектуры LSTM (Long Short-Term Memory) для обработки последовательностей, или даже модифицируем существующие трансформерные модели. Это позволяет нам глубоко экспериментировать и разрабатывать решения для уникальных проблем, которые не могут быть эффективно решены с помощью готовых моделей. Например, мы можем разрабатывать модели для выявления связей между сущностями в тексте или для анализа временных рядов в текстовых данных, что требует более глубокого понимания внутренних механизмов нейронных сетей.

"The limits of my language mean the limits of my world."

— Ludwig Wittgenstein

Практические кейсы: Где NLP раскрывает свой потенциал

Теория – это хорошо, но настоящий блогер всегда ищет практическое применение. Мы постоянно находим новые способы использования NLP в наших повседневных задачах и проектах. Это целый спектр применений, от улучшения нашего контента до автоматизации рутинных операций.

Анализ Тональности: Понимаем Эмоции

Анализ тональности – это одна из самых востребованных задач. Мы используем его для:

- Анализа отзывов клиентов: Понять, что нравится и не нравится нашим пользователям, выявить общие проблемы или, наоборот, сильные стороны продукта. Это помогает нам улучшать наши статьи, продукты и сервисы.

- Мониторинга социальных сетей: Отслеживать упоминания нашего бренда или ключевых тем, быстро реагировать на негатив и развивать позитивные тренды. Мы даже экспериментировали с анализом сарказма, что является сложной, но крайне интересной задачей.

- Анализа финансовых новостей: Для выявления настроений на рынке, что может быть полезно для принятия инвестиционных решений.

Кроме VADER, мы также используем Scikit-learn с TF-IDF и классификаторами, а для более глубокого анализа — трансформерные модели, которые могут улавливать тонкие эмоциональные нюансы.

Извлечение Ключевых Фраз и Сущностей

Нам часто нужно быстро понять, о чем идет речь в большом документе. Здесь на помощь приходят методы извлечения:

- Извлечение ключевых фраз: Мы используем такие алгоритмы, как RAKE (Rapid Automatic Keyword Extraction) и TextRank, чтобы автоматически выделять наиболее важные слова и фразы из текста. Это помогает нам быстро понять суть статьи, создать теги для контента или оптимизировать наши посты для поисковых систем. TextRank, кстати, основан на алгоритме PageRank и может быть использован не только для ключевых фраз, но и для суммаризации.

- Распознавание именованных сущностей (NER): Как мы уже говорили, spaCy и трансформеры (например, BERT) – наши основные инструменты для NER. Они позволяют нам автоматически извлекать из текста имена, организации, даты, места и многое другое. Это незаменимо для структурирования информации из неструктурированных источников, таких как новостные статьи или юридические документы.

Мы также разрабатываем инструменты для автоматической разметки данных, что значительно упрощает процесс обучения собственных NER-моделей.

Суммаризация Текста: Извлекаем Суть

В мире перегруженном информацией, способность быстро извлекать суть из длинных текстов становится бесценной. Мы работаем над системами суммаризации текста:

- Экстрактивная суммаризация: Мы выбираем наиболее важные предложения из исходного текста и объединяем их. TextRank часто используется для этой цели.

- Абстрактивная суммаризация: Это более сложная задача, где модель генерирует новый, сокращенный текст, который передает основную идею оригинала, используя свои собственные слова. Трансформеры (например, T5 или BART от Hugging Face) показали здесь выдающиеся результаты. Мы используем их для создания кратких анонсов статей или для получения быстрых обзоров сложных документов.

Эти инструменты помогают нам не только экономить время, но и предоставлять нашим читателям более структурированную и легкоусвояемую информацию.

Чат-боты и Диалоговые Системы

Разработка чат-ботов – еще одна увлекательная область, где NLP играет центральную роль. Мы экспериментировали с фреймворком Rasa для создания интеллектуальных помощников. Rasa позволяет нам строить контекстно-зависимые диалоги, понимать намерения пользователя и извлекать сущности из их запросов. Это открывает двери для автоматизации поддержки клиентов, создания интерактивных гидов или даже для ведения осмысленных бесед с виртуальными ассистентами.

Веб-скрейпинг и Работа с Различными Форматами

Прежде чем мы сможем анализировать текст, нам часто нужно его откуда-то получить. Мы используем Beautiful Soup для веб-скрейпинга, чтобы извлекать текстовый контент с веб-страниц. Это позволяет нам собирать данные для анализа отзывов, новостей или любого другого открытого контента в интернете. А для извлечения текста из PDF-документов нашим выбором становится PyMuPDF, который эффективно справляется даже с комплексными макетами.

Работа с Многоязычными Корпусами

Мир не ограничивается одним языком, и наши проекты тоже. Мы активно работаем с многоязычными текстовыми корпусами, используя такие библиотеки, как Polyglot и Stanza. Polyglot отлично подходит для определения языка, а Stanza (разработанная Stanford NLP Group) предоставляет высокоточные инструменты для токенизации, POS-теггинга, лемматизации и NER для множества языков, включая языки с богатой морфологией, такие как русский. Это позволяет нам расширять наши проекты на глобальный уровень.

Специфические Задачи и Вызовы

NLP находит применение и в очень нишевых областях:

- Анализ юридических документов: Извлечение ключевых условий, дат, сторон контракта.

- Анализ медицинских записей: Выявление симптомов, диагнозов, названий лекарств.

- Анализ лог-файлов: Поиск аномалий, извлечение важной информации о событиях.

- Стилистика текстов (авторский почерк): Определение авторства или сравнение стилей.

- Проблемы неполных и ошибочных данных: Разработка инструментов для проверки грамматики и исправления орфографии, например, с использованием библиотеки Jellyfish для сравнения строк и поиска похожих слов.

- Обработка эмодзи и сленга: Использование продвинутых моделей и словарей для корректного понимания современной интернет-речи.

Мы также сталкиваемся с необходимостью обработки больших текстовых массивов (Big Data NLP) и используем для этого оптимизированные подходы и библиотеки, такие как Gensim для масштабируемого тематического моделирования.

Визуализация и Оценка: Что показывают данные?

Любой анализ бесполезен без возможности интерпретировать результаты. Мы активно используем различные инструменты для визуализации текстовых данных:

- Облака слов (Word Clouds): Для быстрого представления наиболее часто встречающихся слов.

- Тепловые карты (Heatmaps): Для визуализации матриц сходства или корреляций.

Для оценки качества NER-моделей и других классификаторов мы опираемся на метрики F1-score, Precision и Recall. Эти метрики помогают нам понять, насколько хорошо наша модель справляется с задачей, насколько она точна и полна в своих предсказаниях.

Когда дело доходит до сравнения моделей тематического моделирования (LDA vs NMF) или различных методов векторизации (TF-IDF vs Word2Vec), мы проводим тщательные эксперименты, оценивая их производительность и качество результатов на наших данных. Это позволяет нам выбирать наиболее эффективные подходы для конкретных задач.

Будущее NLP: Куда движемся

Мы живем во времена стремительных изменений, и NLP не исключение; Новые исследования и технологии появляются постоянно, открывая перед нами все новые возможности. Мы следим за трендами и активно внедряем их в нашу практику. Вот некоторые направления, которые, по нашему мнению, будут определять будущее:

- Контекстное встраивание (Contextual Embeddings): Модели, такие как BERT, которые учитывают контекст слова в предложении, а не просто его глобальное значение, продолжают развиваться. Это ведет к более глубокому и точному пониманию языка.

- Graph Embeddings: Анализ взаимосвязей в тексте с использованием графовых структур и эмбеддингов. Это позволяет нам выявлять более сложные отношения между сущностями и событиями.

- Автоматическая разметка данных и Fact-Checking: Разработка инструментов, которые могут автоматически размечать данные для обучения моделей или проверять факты в тексте, становится все более актуальной в эпоху фейковых новостей.

- NLP в режиме реального времени (Streaming NLP): Обработка и анализ текстовых данных по мере их поступления, что критически важно для мониторинга социальных сетей, чатов и других динамичных источников.

- GPU-ускорение: Использование графических процессоров (GPU) для ускорения обучения и инференса (применения) сложных моделей NLP, что позволяет работать с огромными объемами данных и сложными архитектурами.

- Генерация кода: Трансформерные модели уже способны генерировать код на основе текстовых описаний, что обещает революцию в разработке программного обеспечения.

- Мультимодальный NLP: Интеграция текста с другими типами данных, такими как изображения или аудио, для создания более полных и умных систем.

Эти направления показывают, что NLP не стоит на месте, и мы, как блогеры и практики, продолжаем учиться и адаптироваться, чтобы использовать весь потенциал этих удивительных технологий.

Итак, дорогие друзья, наше путешествие по бескрайним просторам Обработки Естественного Языка с Python подошло к концу. Мы с вами прошли путь от базовых концепций токенизации и стемминга до сложных архитектур трансформеров и их практических применений. Мы увидели, как Python, с его богатой экосистемой библиотек – NLTK, spaCy, Gensim, Scikit-learn, Hugging Face – предоставляет нам беспрецедентные возможности для работы с человеческим языком.

Наш опыт показывает, что мир NLP полон вызовов, но и невероятных возможностей. Мы научились не просто извлекать слова, но и понимать их смысл, выявлять скрытые темы, анализировать эмоции и даже генерировать новые тексты. Эти навыки бесценны для любого, кто работает с информацией, будь то блогер, аналитик или разработчик.

Мы надеемся, что эта статья вдохновила вас на собственные эксперименты и открытия в области NLP. Не бойтесь погружаться в детали, пробовать новые библиотеки и алгоритмы. Мир языка огромен и многогранен, и каждый новый инструмент Python открывает перед нами новую грань этого мира. Продолжайте учиться, экспериментировать и делиться своими знаниями – ведь именно так мы строим будущее.

На этом статья заканчивается.

Подробнее

| Основы NLTK | spaCy NER | Тематическое моделирование Gensim | Классификация текста Scikit-learn | Word2Vec GloVe |

| Анализ тональности VADER | Трансформеры Hugging Face | Суммаризация текста Python | Обработка многоязычного текста | Векторизация предложений |