- Распаковывая Разум Машин: Наш Путь в Захватывающий Мир Обработки Естественного Языка (NLP)

- Первые Шаги: От Слов к Данным – Основы Предобработки Текста

- Токенизация и Стемминг: Разбираем Текст на Элементы

- Продвинутая Лемматизация и Стоп-слова

- Регулярные Выражения и Очистка Данных

- Инструментарий NLP: Наши Главные Помощники

- NLTK, spaCy и TextBlob: Основы и Скорость

- Gensim и Scikit-learn: Моделирование и Классификация

- Как Машины "Слышат" Слова: Представление Текста Числами

- Классические Векторизаторы: CountVectorizer и TF-IDF

- Word Embeddings: Word2Vec, GloVe, FastText и Doc2Vec

- Контекстное Встраивание: Эра Трансформеров

- Ключевые Задачи и Приложения NLP: Что Мы Можем Делать с Текстом

- Распознавание Сущностей (NER) и Извлечение Информации

- Анализ Тональности (Sentiment Analysis): Понимая Эмоции

- Тематическое Моделирование и Суммаризация: Извлекаем Суть

- Машинный Перевод и Генерация Текста: Говорим на Разных Языках

- Глубокое Погружение: Нейросети и Продвинутые Модели

- PyTorch/TensorFlow и LSTM-сети

- Трансформерные Архитектуры и Fine-tuning

- Практические Применения и Нишевые Задачи

- Создание Чат-ботов и QA Систем

- Анализ и Автоматизация: От Юридических Документов до Лог-файлов

- Морфология, Синтаксис и Стилистика: Глубже в Язык

- Визуализация и Оценка Моделей

Распаковывая Разум Машин: Наш Путь в Захватывающий Мир Обработки Естественного Языка (NLP)

Привет, дорогие читатели и коллеги-энтузиасты технологий! Сегодня мы хотим поделиться с вами чем-то поистине захватывающим, тем, что буквально меняет наш взгляд на взаимодействие человека и машины. Мы говорим об Обработке Естественного Языка, или NLP (Natural Language Processing). Это не просто модное слово; это целая вселенная, где компьютеры учатся понимать, интерпретировать и даже генерировать человеческий язык. Представьте себе: машины, которые не просто распознают слова, а проникают в их смысл, улавливают эмоции и даже шутят! Мы погружаемся в эту тему уже давно, и с каждым днём она открывает для нас новые горизонты. Приготовьтесь, будет интересно!

Мы уверены, что каждый из вас сталкивался с NLP в повседневной жизни, даже не подозревая об этом. Когда ваш голосовой помощник отвечает на вопрос, когда поисковая система выдаёт релевантные результаты, когда спам-фильтр отсеивает нежелательные письма – за всем этим стоят сложные алгоритмы обработки естественного языка. Мы, как блогеры, стремящиеся донести сложные концепции простым языком, считаем своим долгом провести вас через этот удивительный ландшафт, раскрывая его тайны и показывая, как мы сами применяем эти знания на практике. Наша цель – не просто перечислить термины, а показать, как они работают, и вдохновить вас на собственные эксперименты.

Первые Шаги: От Слов к Данным – Основы Предобработки Текста

Прежде чем компьютер сможет "понять" текст, его нужно подготовить. Человеческий язык полон нюансов, неоднозначностей и беспорядка, что делает эту задачу непростой. Мы начинаем с основ, с самых первых шагов, которые превращают сырой текст в структурированные данные, пригодные для анализа. Этот этап критически важен, ведь от качества предобработки зависит успех всех последующих задач NLP.

Токенизация и Стемминг: Разбираем Текст на Элементы

Самый первый шаг в предобработке текста – это токенизация. Представьте себе предложение, где слова сливаются друг с другом. Наша задача – разделить его на отдельные, осмысленные единицы, которые мы называем токенами. Чаще всего токенами являются слова, но это могут быть и знаки препинания, числа или даже эмодзи. Мы используем такие библиотеки, как NLTK (Natural Language Toolkit), которая предоставляет мощные инструменты для этой цели. Например, предложение "Мы любим NLP!" будет токенизировано в ["Мы", "любим", "NLP", "!"]. Это кажется простым, но в реальном мире есть много нюансов, таких как сокращения, дефисные слова и специальные символы, которые нужно учитывать.

После токенизации мы часто прибегаем к стеммингу. Суть стемминга заключается в приведении различных форм слова к его базовой, "корневой" форме, или так называемому "стему". Например, слова "бежать", "бежит", "бегущий" могут быть приведены к стему "беж". Это помогает уменьшить количество уникальных слов в корпусе текста, что упрощает дальнейший анализ. Однако у стемминга есть свой недостаток: стем не всегда является настоящим словом, что может приводить к потере семантики. Мы часто используем стеммеры из NLTK, такие как Porter Stemmer или Snowball Stemmer, особенно для английского языка.

Продвинутая Лемматизация и Стоп-слова

В отличие от стемминга, лемматизация стремится привести слово к его словарной, канонической форме – лемме. То есть, "бежать", "бежит", "бегущий" будут приведены к "бежать". Лемматизация более сложна, так как требует понимания морфологии языка (частей речи, падежей, времён), но она даёт более точные и осмысленные результаты. Мы активно используем spaCy и его возможности для лемматизации, особенно когда критически важна точность и сохранение смысла слов. SpaCy значительно превосходит NLTK в этом аспекте, предлагая более качественные предобученные модели для разных языков, включая русский.

Ещё один важный аспект предобработки – удаление стоп-слов. Стоп-слова – это часто встречающиеся, но малоинформативные слова, такие как "и", "в", "на", "он", "она" и т.д.. Они не несут в себе глубокого смысла для большинства задач NLP, но занимают место и могут замедлять обработку. Мы поддерживаем собственные списки стоп-слов, а также используем предопределенные списки из NLTK и spaCy, адаптируя их под конкретные задачи. Например, для анализа финансовой отчётности мы можем добавить в список стоп-слов такие термины, как "компания", "отчёт", "рынок", если они встречаются повсеместно и не несут ценности для выявления уникальных тем.

Регулярные Выражения и Очистка Данных

В реальных проектах текст редко бывает чистым. Мы сталкиваемся с HTML-тегами, URL-адресами, специальными символами, цифрами, неполными и ошибочными данными. Здесь на помощь приходят регулярные выражения (библиотека re в Python). Мы используем их для поиска и замены специфических паттернов в тексте. Например, для удаления всех URL-адресов или очистки текста от HTML-тегов, если мы получаем данные с веб-страниц. Это мощный инструмент, который требует практики, но его освоение окупается сторицей.

Очистка неструктурированного текста – это целый арсенал техник. Мы можем удалить лишние пробелы, привести весь текст к нижнему регистру, стандартизировать пунктуацию, работать с эмодзи и сленгом в современных текстах, а также нормализовать их. Например, для работы со сленгом мы можем создать собственные словари синонимов, чтобы привести разные варианты написания к одному стандарту. Эти шаги гарантируют, что наш текст будет максимально "чистым" и готовым к более глубокому анализу. Мы даже сталкивались с задачами, где нужно было извлекать текст из PDF с помощью PyMuPDF или скрейпить его с сайтов, используя Beautiful Soup, что добавляет ещё один слой сложности в предобработку.

Инструментарий NLP: Наши Главные Помощники

Для того чтобы эффективно работать с текстом, нам необходимы надёжные и мощные библиотеки. За годы практики мы опробовали множество инструментов и выделили несколько "рабочих лошадок", которые стали неотъемлемой частью нашего арсенала. Каждая из них имеет свои сильные стороны и применяется для определённого круга задач, позволяя нам решать как простые, так и самые комплексные вызовы в мире NLP.

NLTK, spaCy и TextBlob: Основы и Скорость

NLTK (Natural Language Toolkit) – это, без преувеличения, краеугольный камень для многих, кто начинает свой путь в NLP. Мы часто используем NLTK для образовательных целей и для быстрого прототипирования. Он предоставляет огромный набор алгоритмов и корпусов для токенизации, стемминга, POS-теггинга (разметки частей речи) и базового морфологического анализа. Его модульная структура позволяет нам легко экспериментировать с различными подходами. Однако, когда речь заходит о производительности и готовых к продакшну решениях, мы обычно обращаемся к другим инструментам.

Здесь на сцену выходит spaCy. Если NLTK – это швейцарский нож, то spaCy – это высокоскоростной электроинструмент, оптимизированный для промышленного применения. Мы обожаем spaCy за его скорость, эффективность и преднастроенные модели для различных языков, включая русский. Он идеально подходит для быстрого NER (Распознавания Именованных Сущностей), лемматизации и синтаксического парсинга. Мы используем его для извлечения имен, организаций, дат и других ключевых сущностей из текста с удивительной точностью и скоростью. SpaCy – наш выбор для большинства задач, требующих высокой производительности и надёжности.

Для более простых и быстрых задач, особенно когда нужно что-то протестировать "на лету", мы часто обращаемся к TextBlob. Эта библиотека построена на NLTK, но предлагает более высокоуровневый API, делая операции вроде анализа тональности, POS-теггинга или извлечения n-грамм невероятно простыми. Для нас TextBlob – это отличный инструмент для быстрого старта, хотя для сложных, высокоточных проектов мы предпочитаем более мощные решения. Мы также знаем о TextBlob: ограничения и альтернативы, и используем её с пониманием, когда её простота перевешивает её меньшую гибкость по сравнению со spaCy или NLTK.

Gensim и Scikit-learn: Моделирование и Классификация

Когда нам нужно погрузиться в глубины текста и выявить скрытые темы или создать числовые представления слов, мы обращаемся к Gensim. Эта библиотека – настоящий клад для тематического моделирования (LDA, LSI). Мы используем её для анализа больших коллекций документов, чтобы определить основные темы, которые в них обсуждаются. Например, в корпусе новостей Gensim может помочь нам выявить, какие статьи посвящены политике, какие – экономике, а какие – спорту. Это невероятно мощный инструмент для понимания структуры больших текстовых массивов.

А для задач классификации текстов, где нам нужно отнести документ к одной или нескольким предопределённым категориям, мы неизменно выбираем Scikit-learn. Эта библиотека – стандарт де-факто в машинном обучении на Python, и она отлично интегрируется с NLP. Мы применяем её для создания моделей, которые могут определять спам, категоризировать статьи, или анализировать тексты отзывов клиентов, относя их к позитивным или негативным. Scikit-learn предоставляет широкий спектр алгоритмов – от наивного байесовского классификатора до SVM, что позволяет нам выбирать наиболее подходящий метод для каждой конкретной задачи.

"Язык – это дорожная карта культуры. Он рассказывает вам, откуда пришли его люди и куда они идут."

– Рита Мэй Браун

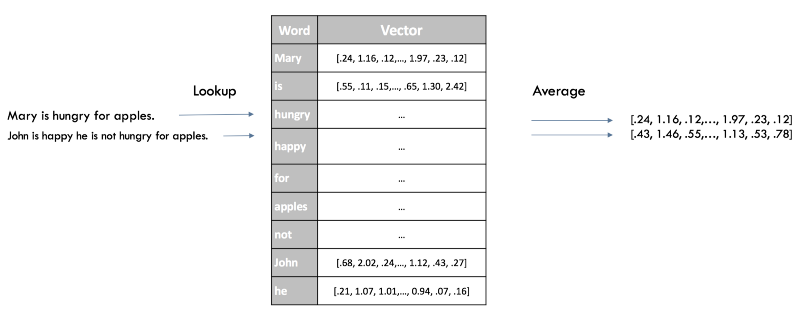

Как Машины "Слышат" Слова: Представление Текста Числами

Сердце любого NLP-проекта – это способность преобразовать человеческий язык в формат, понятный компьютеру, то есть в числа. Слова, предложения и целые документы должны быть представлены в виде векторов. Этот процесс называется векторизацией, и мы используем для него целый арсенал методов, каждый из которых имеет свои преимущества и области применения.

Классические Векторизаторы: CountVectorizer и TF-IDF

Наш путь в векторизацию часто начинается с CountVectorizer из Scikit-learn. Это самый простой способ преобразовать коллекцию текстовых документов в матрицу частот токенов. Каждая строка матрицы соответствует документу, а каждый столбец – уникальному слову (токену) из всего корпуса. Значение в ячейке – это количество раз, которое данное слово встречается в данном документе. Мы используем его для базового анализа, когда нам нужно быстро получить числовое представление текста.

Однако, простая частота слов не всегда идеальна. Слова, которые встречаются очень часто (например, "мы", "есть", "быть"), могут доминировать, не неся при этом особого смысла. Здесь в игру вступает TfidfVectorizer (Term Frequency-Inverse Document Frequency). TF-IDF не только учитывает частоту слова в документе (TF), но и его редкость во всем корпусе документов (IDF). Таким образом, слова, которые часто встречаются в одном документе, но редко в других, получают больший вес. Мы находим TF-IDF значительно более эффективным для задач, где важна информативность слова, таких как извлечение ключевых слов или классификация текстов. Сравнение методов векторизации (TF-IDF vs Word2Vec) показывает, что TF-IDF отлично подходит для задач, где важна уникальность слова в контексте документа и корпуса.

Word Embeddings: Word2Vec, GloVe, FastText и Doc2Vec

Современные методы векторизации идут гораздо дальше, пытаясь уловить семантическое значение слов. Word Embeddings, или векторные представления слов, – это плотные векторы, где похожие по смыслу слова расположены близко друг к другу в многомерном пространстве. Мы активно используем Word2Vec и GloVe с использованием Gensim. Word2Vec, разработанный Google, учится предсказывать контекст слова (Skip-gram) или слово по его контексту (CBOW). GloVe (Global Vectors for Word Representation) использует глобальную статистику со-встречаемости слов. Эти модели позволяют нам работать со смыслом слов, а не просто с их наличием. Например, в векторном пространстве слова "король" и "королева" будут расположены примерно так же, как "мужчина" и "женщина", что открывает двери для удивительных семантических операций.

FastText, разработанный Facebook, является расширением Word2Vec, который учитывает подсловные единицы (n-граммы символов). Это делает его особенно эффективным для работы с редкими словами и языками с богатой морфологией, где одно слово может иметь множество форм. Мы применяем FastText, когда сталкиваемся с большими словарями или языками, где обычные Word2Vec модели дают сбой. Для векторизации целых предложений и документов мы используем Doc2Vec (расширение Word2Vec) и Sentence Transformers; Эти модели позволяют нам получить векторное представление всего текста, сохраняя при этом его смысл. Это критически важно для задач поиска похожих документов или суммаризации.

Контекстное Встраивание: Эра Трансформеров

Самый большой прорыв в векторизации текста произошел с появлением контекстного встраивания (contextual embeddings) и моделей-трансформеров. В отличие от Word2Vec или GloVe, где каждое слово имеет один фиксированный вектор, контекстные встраивания генерируют вектор слова в зависимости от его контекста в предложении. Это означает, что слово "банк" будет иметь разные векторные представления в предложениях "я иду в банк" и "это берег реки, или банк".

Здесь мы говорим о таких гигантах, как BERT (Bidirectional Encoder Representations from Transformers) и GPT (Generative Pre-trained Transformer). Мы используем Трансформеры (Hugging Face) для сложных задач NLP. Hugging Face – это невероятный ресурс, который предоставляет доступ к сотням предобученных моделей-трансформеров и инструментам для их тонкой настройки (fine-tuning). Применение BERT для задач классификации или NER дало нам небывалые результаты по точности. Мы также используем Transformer-модели для генерации текста, создания диалогов и даже для машинного перевода, что позволяет нам создавать по-настоящему интеллектуальные системы.

| Метод векторизации | Принцип работы | Основные преимущества | Типичные задачи применения |

|---|---|---|---|

| CountVectorizer | Подсчёт частоты слов | Простота, быстрота | Базовая классификация, анализ частотности |

| TF-IDF | Частота слова + обратная частота документа | Выделение информативных слов, масштабируемость | Классификация, извлечение ключевых слов |

| Word2Vec/GloVe | Предсказание контекста/со-встречаемость | Семантическое сходство, плотные векторы | Поиск синонимов, рекомендательные системы |

| BERT/Transformer-модели | Контекстное встраивание, архитектура трансформера | Высокая точность, понимание контекста | NER, QA, суммаризация, генерация текста |

Ключевые Задачи и Приложения NLP: Что Мы Можем Делать с Текстом

После того как текст подготовлен и представлен в числовом виде, мы можем приступить к решению конкретных задач. Мир NLP огромен и разнообразен, предлагая решения для самых разных потребностей – от понимания чувств до автоматического перевода. Мы рассмотрим наиболее востребованные направления, в которых мы активно работаем.

Распознавание Сущностей (NER) и Извлечение Информации

Распознавание именованных сущностей (NER) – это задача идентификации и классификации именованных сущностей в тексте (например, имена людей, названия организаций, географические объекты, даты, денежные суммы). Мы уже упоминали, что активно используем spaCy для быстрого NER, а также библиотеку Flair для современного NER, которая обеспечивает выдающуюся производительность. Flair – это мощная библиотека, которая позволяет нам достигать высокой точности, особенно с использованием контекстных эмбеддингов. Мы также применяем CRF (Conditional Random Fields) для распознавания сущностей, когда требуется более тонкий контроль над признаками и правилами.

NER является фундаментом для многих более сложных задач, таких как извлечение фактов из новостей или разработка систем обнаружения плагиата. Если мы можем точно определить, кто, что, где и когда, то мы на шаг ближе к полному пониманию текста. Мы также работаем над разработкой моделей для выявления связей между сущностями, что позволяет нам строить сложные графы знаний и проводить более глубокий анализ текста, например, в юридических документах или медицинских записях.

Анализ Тональности (Sentiment Analysis): Понимая Эмоции

Понимание эмоциональной окраски текста – одна из самых востребованных задач NLP. Анализ тональности (Sentiment Analysis) позволяет нам определить, является ли отзыв позитивным, негативным или нейтральным. Мы начинаем с простых методов, таких как VADER (Valence Aware Dictionary and sEntiment Reasoner), который отлично подходит для анализа тональности сообщений в социальных сетях (Twitter/Reddit) благодаря своей способности учитывать смайлики, сокращения и акронимы. VADER быстр и не требует обучения на больших данных, что делает его идеальным для быстрого анализа.

Однако, для более сложных случаев, таких как анализ тональности финансовых новостей или анализ тональности с учетом сарказма, мы переходим к моделям машинного обучения и глубокого обучения. Мы используем Scikit-learn для классификации текстов на позитивные/негативные, а также применяем BERT для задач классификации тональности. Анализ текстов отзывов клиентов, продуктов, фильмов, ресторанов – это те области, где мы регулярно применяем эти методы, помогая бизнесам понимать своих клиентов и улучшать свои продукты.

Тематическое Моделирование и Суммаризация: Извлекаем Суть

Когда у нас есть большой объем текста, вручную выделить основные темы или создать краткое изложение становится невозможным. Здесь на помощь приходят методы тематического моделирования и суммаризации. Мы уже упоминали библиотеку Gensim для тематического моделирования (LDA, LSI). Сравнение моделей тематического моделирования (LDA vs NMF) показывает, что LDA (Latent Dirichlet Allocation) – это вероятностная модель, которая предполагает, что каждый документ состоит из смеси тем, а каждая тема – из смеси слов. NMF (Non-negative Matrix Factorization) – это другой подход, основанный на линейной алгебре. Мы выбираем между ними в зависимости от характеристик данных и желаемой интерпретируемости результатов.

Разработка системы суммаризации текста – ещё одна увлекательная задача. Существует два основных подхода: экстрактивная и абстрактивная суммаризация. Экстрактивная суммаризация выбирает наиболее важные предложения из исходного текста и объединяет их. Мы используем для этого библиотеку TextRank для извлечения ключевых предложений. Абстрактивная суммаризация, с другой стороны, генерирует новые предложения, которые передают смысл исходного текста, что гораздо сложнее и часто требует использования Transformer-моделей для суммаризации (например, BART, T5). Мы также применяем TextRank для выделения тем, что помогает нам быстро понять суть статьи или отзыва.

Машинный Перевод и Генерация Текста: Говорим на Разных Языках

Разработка систем машинного перевода на Python – это одна из самых амбициозных задач в NLP. От простых статистических методов мы перешли к нейросетевым подходам. Сегодня мы используем Transformer-модели для машинного перевода, которые позволяют нам достигать удивительного качества перевода, даже для сложных языков. Обработка многоязычных текстовых корпусов и использование библиотек вроде Polyglot для мультиязычности становятся стандартом в наших проектах.

Ещё более захватывающее направление – генерация текста. С появлением таких моделей, как GPT-3 и его последователей, мы можем заставить машины писать связные, креативные и даже стилистически разнообразные тексты. Мы используем Transformer-модели для генерации текста (GPT), чтобы создавать статьи, генерировать диалоги для чат-ботов и даже помогать с генерацией кода. Это открывает невероятные возможности для автоматизации контента и создания интерактивных систем.

Глубокое Погружение: Нейросети и Продвинутые Модели

Когда классические методы и статистические модели достигают своих пределов, мы переходим к глубокому обучению. Нейронные сети произвели революцию в NLP, позволив нам решать задачи, которые ранее казались неразрешимыми, и достигать беспрецедентной точности.

PyTorch/TensorFlow и LSTM-сети

Мы активно используем PyTorch/TensorFlow для создания нейросетей NLP. Это два самых популярных фреймворка для глубокого обучения, которые предоставляют нам гибкость и мощность для построения сложных архитектур. Для задач, требующих работы с последовательностями, таких как анализ временных рядов в текстовых данных или генерация текста, мы применяем Keras/TensorFlow для создания LSTM-сетей (Long Short-Term Memory). LSTM – это тип рекуррентных нейронных сетей (RNN), которые способны обрабатывать длинные последовательности данных, "помня" информацию на протяжении многих шагов. Это было критически важно до появления трансформеров для таких задач, как машинный перевод или предсказание следующего слова.

Трансформерные Архитектуры и Fine-tuning

Как мы уже упоминали, трансформерные архитектуры – это вершина современных достижений в NLP. Их способность обрабатывать слова параллельно и учитывать глобальный контекст сделала их незаменимыми. Мы не просто используем готовые модели; мы занимаемся тонкой настройкой (Fine-tuning) предварительно обученных моделей. Это означает, что мы берём уже обученную на огромных массивах текста модель (например, BERT или GPT) и дообучаем её на наших специфических данных для конкретной задачи, будь то классификация юридических документов или распознавание эмоций в социальных сетях. Такая "доводка" позволяет нам достигать максимальной производительности.

Мы также исследуем возможности Graph Embeddings для анализа взаимосвязей в тексте. Это позволяет нам моделировать не только слова, но и их отношения в виде графов, что особенно полезно для извлечения сложных связей между сущностями в больших текстовых массивах. Обработка текста с использованием GPU-ускорения стала для нас стандартом при работе с крупными моделями-трансформерами, значительно сокращая время обучения и инференса.

Практические Применения и Нишевые Задачи

NLP – это не только теория и модели, это прежде всего практический инструмент для решения реальных проблем. Мы применяем наши знания в самых разных областях, от создания чат-ботов до анализа юридических документов.

Создание Чат-ботов и QA Систем

Разработка чат-ботов на Python (Rasa framework) – это одно из самых популярных применений NLP. Мы создаем интеллектуальных помощников, которые могут вести естественный диалог с пользователями, отвечать на вопросы и выполнять различные задачи. Rasa – это отличный фреймворк, который позволяет нам строить контекстно-зависимые диалоги и легко интегрировать модели глубокого обучения.

Параллельно мы занимаемся разработкой систем вопросно-ответных систем (QA). Эти системы способны не просто найти ответ в базе знаний, а понять вопрос и извлечь точный ответ из большого текстового корпуса. Мы используем трансформерные модели для этой цели, достигая высокой точности в поиске информации. Разработка системы для создания FAQ на основе документов – это прекрасный пример того, как QA системы могут автоматизировать рутинные задачи.

Анализ и Автоматизация: От Юридических Документов до Лог-файлов

NLP находит применение там, где есть текст. Мы используем Python для анализа юридических документов, помогая юристам извлекать ключевые даты, стороны контрактов, обязательства и условия. Это значительно ускоряет процесс анализа и снижает вероятность ошибок. Аналогично, анализ текста в медицинских записях позволяет нам выявлять важную информацию о пациентах, диагнозах и лечении.

Анализ лог-файлов – ещё одна интересная область. Хотя лог-файлы кажуться структурированными, они часто содержат неструктурированные текстовые сообщения, которые могут указывать на проблемы в системе. Мы применяем NLP для автоматического выявления аномалий и паттернов в этих сообщениях. Разработка инструмента для автоматической категоризации статей или автоматического тегирования контента помогает нам эффективно управлять большими объёмами информации.

Морфология, Синтаксис и Стилистика: Глубже в Язык

Помимо семантики, мы также глубоко погружаемся в структуру языка. Использование NLTK для POS-теггинга (разметки частей речи) и SpaCy для анализа зависимостей (синтаксического парсинга) позволяет нам понять грамматическую структуру предложения. Это критически важно для таких задач, как разработка инструментов для проверки грамматики или проверки синтаксиса. Мы даже работаем над разработкой инструмента для автоматического перефразирования, который требует глубокого понимания синтаксиса и семантики.

Анализ стилистики текстов (авторский почерк) – это ещё одна область, где NLP может проявить себя. Мы используем статистические и машинные методы для определения уникальных характеристик письма, что может быть полезно для разработки систем для определения авторства текста или выявления аномалий в стиле. Мы также анализируем лексическое богатство текстов и частотность имен собственных, чтобы получить более полное представление о содержании и стиле.

Визуализация и Оценка Моделей

Конечно, любой анализ был бы неполным без возможности наглядно представить результаты. Мы используем инструменты для визуализации текстовых данных (Word Clouds, Heatmaps), чтобы быстро понять основные темы и распределение слов. Word Clouds, например, позволяют нам быстро увидеть наиболее часто встречающиеся слова в тексте, а Heatmaps – визуализировать корреляции между темами или словами.

И, разумеется, мы всегда оцениваем качество наших NER-моделей (F1-score, Precision, Recall) и других моделей NLP; Метрики, такие как точность (Precision), полнота (Recall) и F1-мера, являются для нас ключевыми показателями эффективности. Мы проводим сравнение различных методов машинного обучения для NLP (SVM, наивный байесовский классификатор) и постоянно ищем способы улучшить производительность наших систем. Разработка инструмента для автоматической разметки данных – это то, над чем мы активно работаем, чтобы ускорить процесс создания обучающих выборок для наших моделей.

Мы прошли долгий путь, от простых правил и частотных анализов до сложных нейронных сетей, способных улавливать тончайшие нюансы человеческого языка. Мир NLP постоянно развивается, и мы, как блогеры и практики, стараемся быть на острие этих изменений. От обработки больших текстовых массивов (Big Data NLP) до анализа поведенческих паттернов в чатах и обработки текста в режиме реального времени (Streaming NLP) – возможности безграничны.

Мы видим, как NLP проникает во все сферы жизни, делая взаимодействие с технологиями более естественным и интуитивным. Будь то разработка систем для автоматического перевода узкоспециализированных текстов, анализ тональности сообщений в социальных сетях с учетом сарказма или создание инструментов для проверки фактов (Fact-Checking) – каждый день приносит новые вызовы и новые решения. Мы надеемся, что этот обзор вдохновил вас на собственные исследования и эксперименты в этой удивительной области. Ведь язык – это то, что делает нас людьми, а NLP помогает нам учить машины понимать эту фундаментальную часть нашего существования. На этом статья заканчивается.

Подробнее

| Основы токенизации и стемминга | NER с использованием spaCy | Тематическое моделирование LDA | Классификация текста Scikit-learn | Word Embeddings Word2Vec |

| Анализ тональности VADER | Разработка векторизаторов CountVectorizer | Трансформеры Hugging Face | Разработка чат-ботов Rasa | Анализ юридических документов Python |