- Расшифровка Языка Цифрового Мира: Наш Путь в Захватывающий Мир NLP с Python

- Основы NLP: Фундамент, на Котором Строится Все

- Первые Шаги: Токенизация и Стемминг с NLTK

- Лемматизация: Глубокое Понимание Слов

- Регулярные Выражения: Ваш Швейцарский Нож для Текста

- Извлечение Смысла: От Слов к Знаниям

- Распознавание Именованных Сущностей (NER): Обнаружение Важного

- Тематическое Моделирование: Поиск Скрытых Темы

- Извлечение Ключевых Фраз и Суммаризация

- Оцифровка Языка: Векторизация и Представления Слов

- Простые Векторизаторы: CountVectorizer и TF-IDF

- Word Embeddings: Глубокий Взгляд в Семантику

- Трансформеры: Революция в NLP

- Анализ и Применение: Решение Реальных Задач

- Анализ Тональности (Sentiment Analysis): Понимание Эмоций

- Классификация Текстов: Сортируем Информацию

- Многоязычность и Сложная Морфология

- Веб-Скрейпинг и Работа с Документами

- Продвинутые Темы и Будущее NLP

- Разработка Чат-ботов и QA-систем

- Проверка Качества и Оценка Моделей

- Визуализация Текстовых Данных

- Работа с Большими Данными и GPU

Расшифровка Языка Цифрового Мира: Наш Путь в Захватывающий Мир NLP с Python

Привет, дорогие читатели и коллеги-энтузиасты технологий! Сегодня мы хотим поделиться с вами нашим глубоким погружением в одну из самых увлекательных и быстро развивающихся областей искусственного интеллекта – Обработку Естественного Языка, или как мы ее ласково называем, NLP; Это не просто набор алгоритмов; это ключ к пониманию того, как машины могут не только "читать" текст, но и по-настоящему "понимать" его, извлекая смысл, эмоции и даже скрытые связи․ Мы прошли долгий путь от первых строк кода с NLTK до тонкой настройки сложнейших Transformer-моделей, и готовы рассказать вам о наших открытиях и практическом опыте․

Наше путешествие началось с простого любопытства: как заставить компьютер понимать человеческую речь? Этот вопрос привел нас в мир, где слова превращаются в числа, предложения — в векторы, а целые документы — в осмысленные структуры, доступные для анализа машиной․ В этой статье мы не просто расскажем о популярных библиотеках и алгоритмах; мы поделимся нашим взглядом на то, как эти инструменты помогают решать реальные задачи, превращая огромные массивы неструктурированных данных в ценную информацию․ Приготовьтесь, ведь мы собираемся провести вас через все этапы работы с текстом — от базовой предобработки до создания интеллектуальных систем, способных вести диалог и даже генерировать тексты․

Основы NLP: Фундамент, на Котором Строится Все

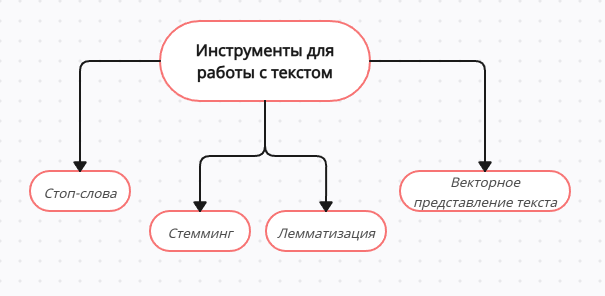

Любое большое путешествие начинается с первого шага, и в мире NLP этот шаг — предобработка текста․ Прежде чем машина сможет "понять" слова, их необходимо подготовить․ Это похоже на то, как мы готовим ингредиенты перед приготовлением сложного блюда: очищаем, нарезаем, измельчаем․ В тексте это означает разделение на отдельные слова, приведение их к базовой форме и удаление всего лишнего․

Первые Шаги: Токенизация и Стемминг с NLTK

Наш первый опыт взаимодействия с текстовыми данными был неразрывно связан с библиотекой NLTK (Natural Language Toolkit)․ Это мощный, но при этом достаточно простой в освоении инструмент, который стал для нас настоящим путеводителем в мир NLP․ С него мы начали наше знакомство с токенизацией – процессом разбиения текста на отдельные единицы, или "токены"․ Это могут быть слова, предложения или даже символы․ Подумайте об этом как о делении большого текста на кирпичики, из которых он состоит․

После токенизации мы столкнулись с проблемой того, что одно и то же слово может иметь разные формы (например, "бежать", "бежит", "бежал")․ Здесь на помощь пришел стемминг – процесс отсечения окончаний слов для приведения их к общей "основе" или "стеблю"․ Мы активно использовали стеммеры из NLTK, такие как PorterStemmer и SnowballStemmer․ Это оказалось невероятно полезным для уменьшения словаря и улучшения качества анализа, поскольку теперь "бежать" и "бежит" рассматривались как одно и то же слово․ Конечно, стемминг иногда бывает слишком агрессивным, отсекая слишком много и создавая несуществующие основы, но для многих задач это был быстрый и эффективный подход․

| Исходное слово | Porter Stemmer | Snowball Stemmer (Русский) |

|---|---|---|

| running | run | — |

| красивый | — | красив |

| libraries | librari | — |

| работающие | — | работа |

Лемматизация: Глубокое Понимание Слов

Хотя стемминг и хорош, он часто создает "основы", которые не являются реальными словами․ Это может быть проблемой, когда нам нужно сохранить семантический смысл․ Здесь в игру вступает лемматизация․ В отличие от стемминга, лемматизация приводит слово к его базовой словарной форме (лемме), которая всегда является существующим словом․ Например, "бежал", "бежит", "бегущий" будут приведены к "бежать", а не к абстрактному "беж"․

Для более продвинутой лемматизации мы активно используем библиотеки spaCy и Stanza․ SpaCy особенно впечатляет своей скоростью и точностью, а Stanza (разработанная Stanford NLP Group) предлагает великолепную поддержку языков с богатой морфологией, таких как русский, что для нас было крайне важно․ Эти инструменты позволяют нам проводить не только лемматизацию, но и другие виды морфологического анализа, такие как определение части речи (POS-теггинг), что значительно обогащает наши данные․

Регулярные Выражения: Ваш Швейцарский Нож для Текста

В процессе предобработки текста мы быстро поняли, что "сырой" текст редко бывает идеальным․ Он полон HTML-тегов, нежелательных символов, ссылок и других "шумов"․ Для борьбы с этим беспорядком нашим незаменимым помощником стал модуль re (регулярные выражения) в Python․ Это настоящий швейцарский нож для манипуляций со строками, позволяющий нам с ювелирной точностью находить и заменять нужные паттерны․

Мы использовали регулярные выражения для самых разных задач: от удаления лишних пробелов и пунктуации до извлечения конкретных данных, таких как даты или номера телефонов․ Это мощный инструмент, который требует некоторого времени для освоения, но его гибкость и эффективность окупаются сторицей в любой задаче, связанной с предобработкой текста․ Например, очистка текста от HTML-тегов или нормализация сленга и эмодзи часто начинается именно с регулярных выражений․

Извлечение Смысла: От Слов к Знаниям

После того как текст очищен и приведен в порядок, настает время извлечь из него нечто большее, чем просто последовательность слов․ Наша цель — найти скрытые сущности, темы, ключевые идеи, которые и делают текст по-настоящему информативным․ Это как искать сокровища в пещере: сначала нужно расчистить вход, а затем начать внимательно осматриваться․

Распознавание Именованных Сущностей (NER): Обнаружение Важного

Одна из самых увлекательных задач в NLP, с которой мы регулярно сталкиваемся, — это Распознавание Именованных Сущностей (NER)․ Представьте, что у вас есть огромный объем новостных статей, и вам нужно быстро понять, о каких людях, организациях, местах или датах в них говорится․ NER делает именно это: автоматически находит и классифицирует именованные сущности в тексте․ Это фундаментальная задача для многих приложений, от извлечения информации до создания поисковых систем․

Для быстрого и эффективного NER мы часто обращаемся к spaCy․ Его пред-обученные модели работают невероятно быстро и дают отличные результаты для английского и многих других языков․ Когда же нам требовалась еще большая точность или работа с языками с богатой морфологией, мы осваивали Flair — библиотеку, известную своими мощными, контекстуальными встраиваниями и state-of-the-art моделями для NER․ Мы также экспериментировали с CRF (Conditional Random Fields) для распознавания сущностей, особенно когда данные были специфическими, а готовые модели не справлялись идеально․ NER стал для нас незаменимым инструментом в анализе текстов отзывов клиентов, юридических документов и даже в анализе лог-файлов․

Тематическое Моделирование: Поиск Скрытых Темы

Когда мы имеем дело с очень большими коллекциями документов, возникает вопрос: как понять, о чем в них говорится, не читая каждый? Здесь на помощь приходит Тематическое Моделирование․ Это класс алгоритмов, которые позволяют нам автоматически обнаруживать скрытые "темы" в коллекции текстов․ Это похоже на то, как если бы вы разложили тысячи книг по полкам, не зная их содержания, а потом алгоритм сам бы сгруппировал их по темам․

Наша основная рабочая лошадка для этой задачи — библиотека Gensim, особенно ее реализации LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing)․ Мы использовали их для анализа отзывов о продуктах, новостных статей и сообщений в социальных сетях, чтобы выявить основные обсуждаемые темы․ Сравнение моделей тематического моделирования, таких как LDA и NMF (Non-negative Matrix Factorization), показало нам, что выбор метода сильно зависит от характеристик данных и требуемой интерпретируемости результатов․

Извлечение Ключевых Фраз и Суммаризация

В современном мире информации очень много, и времени на ее усвоение катастрофически не хватает․ Поэтому задачи извлечения ключевых фраз и суммаризации текста стали для нас особенно актуальными․ Мы стремимся создавать системы, которые могут быстро выделить самое важное из длинного документа или даже автоматически сгенерировать краткое изложение․

Для извлечения ключевых слов мы успешно применяли алгоритм RAKE (Rapid Automatic Keyword Extraction), который позволяет быстро выделить наиболее значимые фразы․ Для более сложных задач, таких как суммаризация, мы обращаемся к TextRank – алгоритму, который, подобно PageRank для веб-страниц, оценивает важность предложений в тексте․ Мы изучали как экстрактивную суммаризацию (выбор наиболее важных предложений из исходного текста), так и абстрактивную суммаризацию (генерация нового текста, передающего суть оригинала), причем для последней активно используем Transformer-модели, о которых мы поговорим позже․ Эти подходы помогают нам создавать системы для автоматической категоризации статей и формирования FAQ на основе документов․

Оцифровка Языка: Векторизация и Представления Слов

Чтобы компьютер мог работать с текстом, его необходимо преобразовать в числовой формат․ Это своего рода перевод человеческого языка на язык, понятный машине․ Этот процесс, известный как векторизация, является одним из краеугольных камней современного NLP․ Мы прошли через несколько этапов этого перевода, каждый из которых открывал новые возможности для анализа․

Простые Векторизаторы: CountVectorizer и TF-IDF

Наш первый опыт векторизации был связан с простыми, но очень эффективными методами, которые закладывают основу для понимания более сложных подходов․ Мы начали с CountVectorizer, который преобразует текст в матрицу, где каждая строка — это документ, а каждый столбец — слово из всего корпуса․ Значения в ячейках показывают, сколько раз каждое слово встречается в документе․ Это концепция "мешка слов" (Bag-of-Words), где порядок слов игнорируется, но их частотность учитывается․

Затем мы перешли к TfidfVectorizer, который улучшает CountVectorizer, учитывая не только частотность слова в документе (Term Frequency, TF), но и его редкость во всем корпусе документов (Inverse Document Frequency, IDF)․ Это позволяет придать больший вес словам, которые важны для конкретного документа, но при этом не слишком часто встречаются в других․ Мы часто используем TF-IDF для задач классификации текстов и извлечения ключевых слов․ Сравнение различных методов векторизации, таких как TF-IDF и Word2Vec, показало нам, что выбор зависит от конкретной задачи и объема данных․

"Язык – это карта человеческого разума․ Если мы сможем научить машины читать эту карту, мы откроем двери к беспрецедентным уровням понимания и творчества․"

— Йошуа Бенжио (один из "крестных отцов" глубокого обучения)

Word Embeddings: Глубокий Взгляд в Семантику

Хотя CountVectorizer и TF-IDF хороши, они не учитывают семантические отношения между словами․ Слова "король" и "королева" могут быть очень далеки друг от друга в пространстве TF-IDF, но мы знаем, что они семантически близки․ Здесь в игру вступают Word Embeddings – методы, которые представляют слова в виде плотных векторов в многомерном пространстве, где семантически похожие слова находятся близко друг к другу․

Мы активно работали с Word2Vec (реализации Skip-gram и CBOW) и GloVe с использованием библиотеки Gensim․ Эти модели научили нас, как можно улавливать тонкие нюансы значений слов и даже аналогии (например, "король" ⎼ "мужчина" + "женщина" = "королева")․ Для работы с редкими словами, которые плохо представлены в традиционных эмбеддингах, мы использовали FastText, который строит векторы на основе подслов․ Когда нам нужно было представить целые документы или предложения в виде векторов, мы обращались к Doc2Vec и Sentence Transformers․ Последние стали особенно полезны для сравнения сходства между предложениями и документами․

Трансформеры: Революция в NLP

Настоящей революцией в нашем подходе к NLP стало появление Transformer-моделей․ Это архитектуры, которые изменили ландшафт обработки естественного языка, позволив создавать модели с беспрецедентным уровнем понимания контекста и генерации текста․ Мы погрузились в мир Hugging Face Transformers – экосистемы, которая предоставляет доступ к сотням предварительно обученных моделей, таких как BERT, GPT, RoBERTa и многим другим․

Мы использовали BERT для задач классификации текста, распознавания именованных сущностей (NER) и даже для задач вопросно-ответных систем․ GPT-модели открыли для нас двери в мир генерации текста – от создания коротких ответов до написания целых статей и даже кода․ Возможность тонкой настройки (fine-tuning) этих предварительно обученных моделей на наших специфических данных позволила нам достичь выдающихся результатов, значительно превосходящих традиционные подходы․ Мы также экспериментировали с использованием PyTorch и TensorFlow для создания собственных нейросетей NLP, что дало нам глубокое понимание внутренней работы этих мощных систем․

Анализ и Применение: Решение Реальных Задач

Полученные знания и инструменты не имеют смысла без их практического применения․ Для нас NLP — это не просто наука, это искусство решения реальных проблем, с которыми сталкиваются компании и люди каждый день․ Мы всегда стремились применять наши навыки для создания чего-то полезного и значимого․

Анализ Тональности (Sentiment Analysis): Понимание Эмоций

Одной из самых востребованных задач, которую мы решаем с помощью NLP, является Анализ Тональности (Sentiment Analysis)․ Понимание того, что чувствуют ваши клиенты, к какому продукту они относятся позитивно, а к какому — негативно, является бесценным․ Мы начали с простых инструментов, таких как VADER (Valence Aware Dictionary and sEntiment Reasoner), который отлично подходит для анализа тональности коротких текстов, особенно в социальных сетях․ Затем мы исследовали TextBlob для более простого и быстрого анализа․

По мере усложнения задач мы перешли к более продвинутым методам, обучая собственные модели классификации тональности с использованием векторизаторов и даже Transformer-моделей․ Мы анализировали тональность сообщений в социальных сетях (Twitter/Reddit), отзывы о фильмах и продуктах, а также финансовые новости, чтобы предсказывать рыночные тренды․ Отдельной задачей стала работа с эмодзи и сленгом в современных текстах, а также выявление сарказма, что потребовало от нас тонкой настройки и глубокого понимания контекста․

Классификация Текстов: Сортируем Информацию

Автоматическая классификация текстов — еще одна фундаментальная задача, которая помогает нам управлять огромными объемами информации․ Будь то категоризация новостных статей, спам-фильтрация электронных писем или маршрутизация обращений клиентов, классификация лежит в основе многих систем․ Мы активно использовали Scikit-learn для применения классических алгоритмов машинного обучения, таких как SVM (Support Vector Machines) и наивный байесовский классификатор․

Наш опыт показал, что для простых задач эти методы в сочетании с TF-IDF или CountVectorizer дают отличные результаты․ Для более сложных случаев, особенно когда важен контекст и семантика, мы обращались к глубокому обучению, используя PyTorch и TensorFlow для создания LSTM-сетей и, конечно же, Transformer-моделей (например, BERT для задач классификации)․ Это позволило нам разрабатывать системы для автоматической категоризации статей, анализа отзывов по категориям и даже для определения авторства текста․

Многоязычность и Сложная Морфология

Мир не ограничивается одним языком, и мы часто сталкиваемся с необходимостью обработки многоязычных текстовых корпусов․ Работа с языками, отличными от английского, особенно с теми, что обладают богатой морфологией (например, русский, немецкий), представляет свои уникальные вызовы․ Мы освоили библиотеку Polyglot для мультиязычности и анализа редких языков, а также Stanza, которая, как мы уже упоминали, прекрасно справляется с языками со сложной морфологией․ Это позволило нам разрабатывать системы машинного перевода на Python и анализировать тексты, написанные нелатинскими алфавитами․

Наш опыт показал, что для каждого языка могут потребоваться свои подходы к токенизации, лемматизации и POS-теггингу․ Например, сравнение методов лемматизации SpaCy и NLTK для русского языка выявило преимущества каждого в различных сценариях․ Это напоминает нам о том, что нет универсального решения, и всегда нужно адаптировать инструменты под специфику задачи и языка․

Веб-Скрейпинг и Работа с Документами

Часто исходные текстовые данные находятся не в идеальном формате․ Они могут быть разбросаны по веб-страницам, заперты в PDF-файлах или скрыты в специализированных документах․ Для нас сбор и извлечение этих данных стало неотъемлемой частью рабочего процесса․ Мы начали с Beautiful Soup для веб-скрейпинга текста, что позволило нам автоматизировать сбор информации с сайтов и блогов․

Когда данные были в PDF, мы использовали PyMuPDF для эффективного извлечения текста, а также изображений и метаданных․ Это оказалось особенно полезным при работе с юридическими документами, финансовой отчетностью и медицинскими записями, где точность извлечения имеет критическое значение․ Мы также разрабатывали инструменты для очистки текста от HTML-тегов, что является важным шагом после скрейпинга․

Продвинутые Темы и Будущее NLP

Мир NLP постоянно развивается, и мы стараемся не отставать, исследуя новые горизонты и применяя самые современные технологии․ От создания интерактивных систем до обработки огромных массивов данных — мы всегда ищем способы расширить границы возможного․

Разработка Чат-ботов и QA-систем

Создание систем, способных вести осмысленный диалог и отвечать на вопросы, всегда было нашей мечтой․ Мы погрузились в разработку чат-ботов на Python, используя фреймворк Rasa․ Rasa позволяет нам не только создавать диалоговые агенты, но и обучать их понимать намерения пользователя и генерировать адекватные ответы․ Это гораздо больше, чем просто скрипты "вопрос-ответ"; это системы, которые учатся на взаимодействии и развиваются․

Параллельно мы разрабатывали системы вопросно-ответных систем (QA), которые могут находить точные ответы на вопросы в больших массивах документов․ С появлением Transformer-моделей это стало намного эффективнее, позволяя нам строить QA-системы, способные понимать сложный контекст и извлекать информацию с высокой точностью․ Мы даже экспериментировали с использованием Transformer-моделей для генерации диалогов, что открывает путь к созданию еще более естественных и интеллектуальных чат-ботов․

Проверка Качества и Оценка Моделей

В любой инженерной задаче крайне важно уметь оценивать качество своей работы․ В NLP это означает не только метрики, но и понимание ограничений используемых инструментов; Мы всегда уделяем особое внимание оценке качества NER-моделей (F1-score, Precision, Recall), а также сравнению эффективности различных токенизаторов, лемматизаторов и моделей суммаризации․

Мы сталкивались с проблемами обработки неполных и ошибочных данных и разрабатывали инструменты для проверки грамматики и исправления орфографии, чтобы улучшить качество входных данных․ Сравнение различных методов машинного обучения для NLP, таких как SVM и наивный байесовский классификатор, помогает нам выбирать наиболее подходящий подход для каждой конкретной задачи․ Мы также используем библиотеки, такие как Jellyfish и Textdistance, для измерения сходства строк и поиска дубликатов, что критически важно для очистки данных и предотвращения переобучения․

Визуализация Текстовых Данных

Числа и метрики — это одно, но иногда гораздо нагляднее увидеть данные визуально․ Для нас визуализация текстовых данных стала мощным инструментом для понимания и презентации результатов․ Мы активно используем Word Clouds для быстрого определения наиболее частотных слов и Heatmaps для визуализации матриц сходства или корреляций․ Библиотека Sweetviz также оказалась полезной для быстрого анализа текстовых данных, предоставляя исчерпывающие отчеты․

Визуализация помогает нам обнаруживать скрытые паттерны, например, в пользовательских запросах или поведенческих паттернах в чатах, а также анализировать частотность слов и n-грамм․ Это не просто украшение, это неотъемлемая часть процесса исследования и понимания данных, которая позволяет нам принимать более обоснованные решения․

Работа с Большими Данными и GPU

По мере роста объемов текстовых данных мы столкнулись с необходимостью обработки больших текстовых массивов (Big Data NLP)․ Это потребовало от нас оптимизации кода, использования эффективных структур данных и, конечно же, применения GPU-ускорения․ Библиотеки, такие как Gensim, а также фреймворки глубокого обучения PyTorch и TensorFlow, позволяют нам использовать мощности GPU для значительно ускорения обучения моделей и обработки данных․

Мы также исследовали возможности стримингового NLP, когда текст обрабатывается в режиме реального времени․ Это открывает двери для анализа тональности сообщений в социальных медиа с учетом сарказма, мониторинга отзывов о продуктах и реагирования на события практически мгновенно․ Работа с большими данными и использование GPU стали для нас стандартом при создании масштабируемых и высокопроизводительных NLP-систем․

Мы надеемся, что это погружение в мир NLP с Python оказалось для вас таким же увлекательным и познавательным, как и для нас․ От основ токенизации и стемминга до сложнейших Transformer-моделей и систем генерации текста – мы прошли огромный путь, полный вызовов и открытий․ NLP, это не просто набор инструментов; это мощный катализатор для инноваций, который позволяет нам раскрывать потенциал языка, спрятанный в огромных объемах данных․

Мы верим, что возможности NLP только начинают раскрываться․ С каждым новым алгоритмом, с каждой новой библиотекой мы приближаемся к созданию машин, способных по-настоящему понимать и взаимодействовать с человеческим языком․ И мы приглашаем вас присоединиться к нам в этом захватывающем путешествии․ Продолжайте учиться, экспериментировать и создавать, ведь именно так рождаются самые интересные и полезные решения․ На этом статья заканчивается․

Подробнее

| Применение NLP в бизнесе | Сравнение библиотек для обработки текста | Обучение моделей машинного обучения для NLP | Инструменты для анализа больших текстовых данных | Практические кейсы анализа тональности |

| Как выбрать векторизатор текста | Разработка чат-ботов на Python с нуля | Понимание работы Transformer-моделей | Извлечение информации из неструктурированных данных | Автоматизация анализа текстов |