- Расшифровывая Язык Человека: Наши Приключения в Мире NLP с Python

- С чего Всё Начинается: Фундамент Обработки Текста

- Первые Шаги: Токенизация и Стемминг с NLTK

- Магия Регулярных Выражений: Очистка и Структурирование

- Лемматизация: За Гранью Стемминга

- Погружение в Смысл: От Слов к Значениям

- Векторизация Текста: Как Машина "Видит" Слова

- Тематическое Моделирование: Открытие Скрытых Смыслов

- Распознавание и Анализ: Ключевые Задачи NLP

- Распознавание Именованных Сущностей (NER): Имена‚ Даты‚ Места

- Анализ Тональности (Sentiment Analysis): Чувства в Тексте

- Классификация Текстов: Распределение по Категориям

- Инструменты и Библиотеки: Наша Мастерская NLP

- NLTK: Классика Жанра

- spaCy: Скорость и Эффективность

- Gensim: Для Тематического Моделирования и Векторов

- TextBlob: Простой Вход в Мир NLP

- Hugging Face Transformers: Передовой Край

- Другие Полезные Инструменты

- Сложные Задачи и Реальные Применения

- Генерация и Суммаризация Текста: От Человека к Машине и Обратно

- Системы Вопросно-Ответных Систем (QA) и Чат-боты

- Обработка Многоязычных Данных и Редких Языков

- Работа с Большими Данными и Неструктурированным Текстом

- Качество и Оценка: Проверка Грамматики‚ Орфографии‚ Плагиата

- Визуализация и Глубокий Анализ

- Визуализация Текстовых Данных

- Анализ Стилистики и Авторства

- Выявление Связей и Паттернов

Расшифровывая Язык Человека: Наши Приключения в Мире NLP с Python

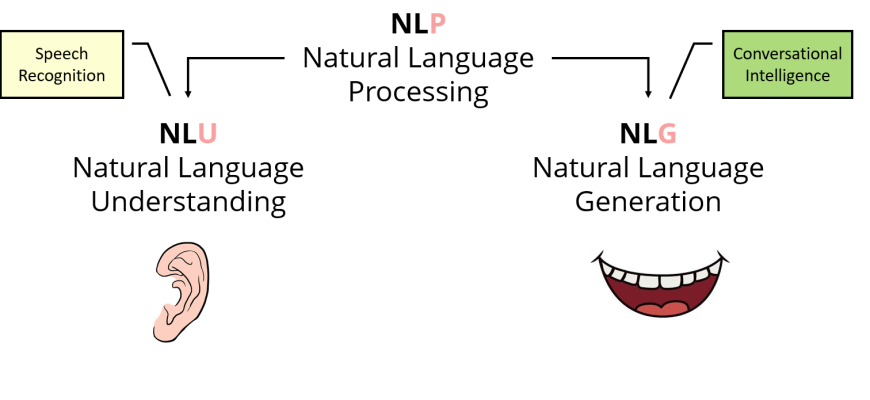

Привет‚ дорогие читатели и коллеги-энтузиасты! Сегодня мы хотим поделиться с вами нашим захватывающим опытом погружения в мир Обработки Естественного Языка (NLP) с использованием одного из самых мощных и гибких инструментов — Python. Для нас этот путь стал не просто изучением новых технологий‚ а настоящим приключением‚ где каждое открытие приближало нас к пониманию того‚ как машины могут "слышать" и "понимать" то‚ что мы говорим и пишем. Приготовьтесь‚ ведь мы отправляемся в увлекательное путешествие по основам и продвинутым техникам NLP‚ которые навсегда изменили наш взгляд на взаимодействие человека и компьютера.

В современном мире‚ где объемы текстовой информации растут экспоненциально‚ способность автоматизировать ее анализ становится не просто желательной‚ а критически важной. От анализа отзывов клиентов до создания умных чат-ботов‚ от перевода текстов до выявления скрытых смыслов в огромных массивах данных – везде присутствует NLP. Мы убедились в этом на собственном опыте‚ реализуя проекты различной сложности и постоянно расширяя наш инструментарий. Давайте же вместе исследуем‚ как Python помогает нам разгадывать загадки человеческого языка.

С чего Всё Начинается: Фундамент Обработки Текста

Прежде чем машина сможет "понять" текст‚ его необходимо подготовить. Этот этап‚ известный как предобработка‚ является краеугольным камнем любого NLP-проекта. Именно здесь мы сталкиваемся с первой порцией вызовов и учимся "чистить" и "структурировать" данные‚ чтобы сделать их пригодными для анализа. Наш опыт показывает‚ что качество предобработки напрямую влияет на результат.

Первые Шаги: Токенизация и Стемминг с NLTK

Наш путь в NLP начался с библиотеки NLTK (Natural Language Toolkit) — мощного и универсального инструмента‚ который стал для нас первой "песочницей" для экспериментов с текстом. Мы быстро освоили такие базовые‚ но крайне важные операции‚ как токенизация и стемминг. Токенизация – это процесс разбиения текста на отдельные слова или фразы‚ которые мы называем токенами. Представьте‚ как вы берете сплошной текст и аккуратно разделяете его на кирпичики – это и есть токены. Мы использовали различные токенизаторы из NLTK‚ такие как word_tokenize и sent_tokenize‚ каждый из которых имеет свои особенности и наилучшим образом подходит для разных задач.

После токенизации мы перешли к стеммингу. Цель стемминга – сократить слова до их базовой‚ корневой формы (стема)‚ удаляя суффиксы и окончания. Например‚ слова "бежать"‚ "бежит"‚ "бегущий" могут быть сведены к "беж". Это помогает уменьшить количество уникальных слов и улучшить эффективность анализа. В NLTK мы часто применяли стеммеры‚ такие как PorterStemmer и SnowballStemmer. Однако‚ мы быстро поняли‚ что стемминг‚ будучи довольно агрессивным‚ иногда приводит к потере смысла‚ оставляя "несуществующие" корни. Например‚ "красивый" может превратиться в "красив"‚ что не является реальным словом.

Магия Регулярных Выражений: Очистка и Структурирование

Работая с реальными данными‚ мы столкнулись с тем‚ что текст редко бывает идеально чистым. Веб-страницы содержат HTML-теги‚ социальные сети – эмодзи и сленг‚ а пользовательские вводы – опечатки и лишние символы. Здесь на помощь приходит модуль re в Python – регулярные выражения. Это мощный инструмент для поиска и манипулирования строками‚ который позволяет нам эффективно очищать текст.

Мы научились использовать регулярные выражения для удаления:

- HTML-тегов: С помощью шаблонов мы легко избавляемся от всех

<div>‚<a>и других элементов разметки‚ которые не несут смысловой нагрузки для NLP. - Пунктуации и специальных символов: Для многих задач они являются шумом‚ поэтому мы их удаляем или заменяем на пробелы.

- Чисел: В зависимости от задачи‚ числа могут быть удалены или заменены на специальные токены.

- Эмодзи и сленга: Для анализа современных текстов‚ особенно из социальных сетей‚ мы разрабатывали специальные правила или использовали библиотеки для их обработки‚ чтобы они не искажали результаты анализа тональности.

Благодаря регулярным выражениям‚ мы могли превратить сырой‚ неструктурированный текст в чистый и готовый к дальнейшей обработке формат. Это позволило нам значительно повысить качество входных данных для наших моделей.

Лемматизация: За Гранью Стемминга

Как мы уже упоминали‚ стемминг имеет свои ограничения. Мы искали более интеллектуальный подход и нашли его в лемматизации. В отличие от стемминга‚ лемматизация стремится привести слово к его словарной (базовой) форме‚ известной как лемма‚ с учетом контекста и морфологических правил языка. Например‚ слова "был"‚ "есть"‚ "будет" будут сведены к лемме "быть". Это значительно улучшает качество анализа‚ сохраняя при этом смысл слова.

Для лемматизации мы активно использовали следующие библиотеки:

- spaCy: Эта библиотека стала для нас фаворитом благодаря своей скорости и точности. Она предоставляет отличные модели для различных языков‚ включая русский‚ и выполняет лемматизацию на основе глубокого синтаксического анализа.

- Stanza: Для языков с богатой морфологией‚ таких как русский‚ Stanza (от Stanford NLP Group) оказалась незаменимой. Она предлагает продвинутую лемматизацию‚ POS-теггинг и анализ зависимостей‚ превосходя NLTK в точности для сложных языков.

Сравнение методов лемматизации (например‚ SpaCy vs NLTK) показало‚ что более современные и контекстно-ориентированные подходы дают гораздо лучшие результаты‚ особенно когда точность морфологического анализа критична. Мы также разрабатывали инструменты для нормализации сленга‚ что было особенно актуально при работе с текстами из социальных сетей.

Погружение в Смысл: От Слов к Значениям

Когда текст очищен и приведен к нормальной форме‚ наступает самый интересный этап – извлечение смысла. Машины не понимают слова в человеческом смысле; им нужны числовые представления. Именно здесь в игру вступают методы векторизации и тематического моделирования‚ позволяющие трансформировать текст в формат‚ пригодный для алгоритмов машинного обучения.

Векторизация Текста: Как Машина "Видит" Слова

Чтобы компьютер мог работать с текстом‚ каждое слово или документ должны быть представлены в виде чисел – векторов. Мы экспериментировали с различными подходами к векторизации‚ каждый из которых имеет свои преимущества:

- Bag-of-Words и TF-IDF (Scikit-learn):

- CountVectorizer: Это самый простой метод‚ который создает вектор‚ где каждое измерение соответствует слову из всего корпуса‚ а значение – количеству вхождений этого слова в документ. Мы использовали его для задач‚ где важна абсолютная частотность.

- TfidfVectorizer: Более продвинутый подход‚ который учитывает не только частоту слова в документе (Term Frequency‚ TF)‚ но и его редкость во всем корпусе (Inverse Document Frequency‚ IDF). Это помогает выделить слова‚ которые являются уникальными и значимыми для конкретного документа‚ а не просто часто встречаются везде. Мы обнаружили‚ что TF-IDF гораздо эффективнее для классификации и поиска похожих документов.

- Word Embeddings: Word2Vec и GloVe (Gensim):

Эти методы произвели революцию в NLP‚ позволяя словам иметь "смысловое" представление. Вместо простого подсчета‚ Word2Vec (мы использовали как Skip-gram‚ так и CBOW модели) и GloVe обучают нейронные сети создавать плотные векторы (эмбеддинги)‚ где слова с похожим значением расположены близко друг к другу в многомерном пространстве. Мы применяли библиотеку Gensim для тренировки наших собственных эмбеддингов на специализированных корпусах‚ что значительно улучшило качество наших моделей.

- FastText для редких слов:

В работе с большими и разнообразными текстовыми данными мы часто сталкивались с проблемой редких слов (OOV ⎼ Out-Of-Vocabulary). FastText‚ расширение Word2Vec‚ решает эту проблему‚ представляя слова как набор символьных N-грамм. Это позволяет ему создавать осмысленные векторы даже для слов‚ которые он не встречал во время обучения‚ что стало для нас огромным преимуществом.

- Doc2Vec и Sentence Transformers:

Если Word2Vec и GloVe работают на уровне слов‚ то Doc2Vec (также от Gensim) позволяет векторизовать целые документы‚ а Sentence Transformers – предложения. Это открыло нам новые возможности для задач‚ требующих сравнения целых текстов или их суммаризации. Контекстное встраивание‚ когда вектор слова меняется в зависимости от его окружения‚ стало особенно важным с появлением трансформерных моделей.

Сравнение методов векторизации (TF-IDF vs Word2Vec) показало‚ что для некоторых задач‚ особенно при ограниченных вычислительных ресурсах‚ TF-IDF остается весьма конкурентоспособным.

Тематическое Моделирование: Открытие Скрытых Смыслов

Представьте‚ что у вас есть огромный архив документов‚ и вы хотите понять‚ о чем они. Перечитывать каждый – нереально. Здесь на помощь приходит тематическое моделирование – набор алгоритмов‚ которые позволяют нам автоматически выявлять скрытые "темы" в коллекции текстов. Мы использовали эти методы для анализа отзывов‚ статей и даже юридических документов.

Наш опыт включает работу с:

- LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing) с Gensim:

Эти алгоритмы стали для нас отправной точкой. LDA помог нам выявить‚ какие слова чаще всего встречаются вместе в определенных темах‚ а LSI – понять скрытые семантические связи между словами и документами. Мы использовали Gensim для эффективного обучения этих моделей на больших корпусах данных.

- NMF (Non-negative Matrix Factorization):

Помимо LDA‚ мы активно применяли NMF‚ особенно когда требовалась лучшая интерпретируемость тем. Сравнение моделей тематического моделирования (LDA vs NMF) показало‚ что NMF часто дает более "чистые" и понятные темы‚ что было важно для представления результатов нашим заказчикам.

- TextRank для выделения тем:

Иногда нам нужно было не просто найти темы‚ а выделить ключевые предложения‚ которые наилучшим образом представляют основную идею документа. Для этой задачи TextRank оказался очень эффективным‚ помогая нам создавать краткие выжимки или определять главные смысловые блоки.

Тематическое моделирование позволило нам превратить горы неструктурированного текста в понятные смысловые блоки‚ открыв доступ к ценной информации‚ которая иначе осталась бы скрытой.

"Язык – это дорожная карта культуры. Он говорит вам‚ откуда пришли его люди и куда они идут."

– Рита Мэй Браун

Распознавание и Анализ: Ключевые Задачи NLP

После того‚ как мы научились подготавливать текст и извлекать из него числовые представления‚ пришло время решать более сложные задачи. Наш опыт охватывает широкий спектр приложений‚ от идентификации важных сущностей до определения эмоционального окраса текста и автоматической классификации.

Распознавание Именованных Сущностей (NER): Имена‚ Даты‚ Места

Распознавание именованных сущностей (NER) – это одна из самых фундаментальных задач в NLP. Она позволяет нам автоматически находить и классифицировать такие сущности‚ как имена людей‚ названия организаций‚ географические объекты‚ даты‚ суммы денег и т.д. В наших проектах NER играл ключевую роль‚ например‚ при извлечении информации из юридических документов или анализе новостей.

Мы активно использовали:

- spaCy для быстрого NER: Благодаря предобученным моделям‚ spaCy позволяет нам выполнять NER с высокой скоростью и точностью. Мы могли быстро извлекать даты и числа из текста‚ а также другие важные сущности.

- CRF и Flair для современного NER: Для более сложных и специализированных задач мы обращались к моделям на основе CRF (Conditional Random Fields) и к библиотеке Flair. Flair‚ использующая контекстные строковые эмбеддинги‚ показала выдающиеся результаты в распознавании сущностей‚ особенно на неидеальных данных.

Разработка систем для автоматической разметки сущностей и оценка качества NER-моделей (F1-score‚ Precision‚ Recall) стали для нас рутиной‚ позволяя постоянно улучшать наши решения.

Анализ Тональности (Sentiment Analysis): Чувства в Тексте

Понимание эмоционального окраса текста – бесценно для бизнеса‚ маркетинга и социальных исследований. Мы активно применяли анализ тональности для оценки отзывов клиентов‚ мониторинга социальных сетей и анализа финансовых новостей.

Наш инструментарий для анализа тональности включал:

- VADER (Valence Aware Dictionary and sEntiment Reasoner): Для простого и быстрого анализа тональности на английском языке VADER оказался очень эффективен‚ поскольку он специально разработан для текстов из социальных сетей и учитывает такие аспекты‚ как восклицательные знаки и использование заглавных букв.

- TextBlob для простого NLP: TextBlob также предлагает удобные функции для анализа тональности‚ хотя мы обнаружили‚ что для более глубокого и точного анализа‚ особенно на русском языке‚ требуются более сложные модели.

- Продвинутые подходы: Мы разрабатывали собственные модели на основе машинного обучения для анализа тональности сообщений в социальных сетях (Twitter/Reddit)‚ финансовой отчетности и отзывов о фильмах/продуктах. При этом мы сталкивались с проблемой сарказма и иронии‚ что требовало более изощренных методов и Transformer-моделей.

Анализ тональности помог нам выявлять скрытые темы в отзывах и понимать общее настроение потребителей.

Классификация Текстов: Распределение по Категориям

Классификация текстов – это задача отнесения документа к одной или нескольким предопределенным категориям. Мы использовали ее для автоматической категоризации статей‚ новостей‚ отзывов и даже юридических документов.

В наших проектах мы применяли:

- Scikit-learn для классификации текстов: Эта библиотека стала нашим основным инструментом. Мы использовали различные алгоритмы‚ такие как SVM (Support Vector Machines) и наивный байесовский классификатор‚ в сочетании с TF-IDF векторизаторами.

- BERT для задач классификации: С появлением трансформерных моделей‚ таких как BERT‚ мы смогли значительно улучшить качество классификации. BERT‚ благодаря своей способности понимать контекст‚ показал себя превосходно даже на сложных задачах.

- Применение PyTorch/TensorFlow для создания нейросетей NLP: Для особо сложных задач‚ требующих высокой точности‚ мы переходили к созданию собственных нейронных сетей на PyTorch или TensorFlow‚ включая LSTM-сети;

Разработка систем для автоматической категоризации статей и новостей позволила нам значительно ускорить обработку информации и предоставить пользователям более релевантный контент.

Инструменты и Библиотеки: Наша Мастерская NLP

За годы работы в NLP мы собрали внушительный арсенал инструментов. Каждая библиотека имеет свои сильные стороны и идеально подходит для определенных задач. Мы рассмотрим те‚ которые стали для нас незаменимыми помощниками.

NLTK: Классика Жанра

Как мы уже упоминали‚ NLTK был нашим проводником в мир NLP. Мы до сих пор используем его для базовых задач‚ таких как:

- Токенизация: Быстрое разбиение текста на слова и предложения.

- POS-теггинг (Part-of-Speech Tagging): Определение части речи каждого слова (существительное‚ глагол‚ прилагательное и т.д.)‚ что полезно для синтаксического анализа.

- Морфологический анализ: Исследование структуры слов и их форм.

Несмотря на появление более продвинутых библиотек‚ NLTK остается отличной отправной точкой для новичков и мощным инструментом для многих стандартных задач.

spaCy: Скорость и Эффективность

spaCy быстро завоевала наше доверие благодаря своей производительности и простоте использования. Мы применяем ее для:

- Быстрого NER: Высокоточная идентификация именованных сущностей.

- Синтаксического парсинга: Анализ грамматической структуры предложения. Реализация синтаксического парсинга с spaCy позволила нам лучше понимать взаимосвязи между словами.

- Анализа зависимостей: Выявление связей между словами в предложении‚ что критично для извлечения информации.

- Лемматизации: Точное приведение слов к их базовой форме.

spaCy – это наш выбор‚ когда нужна высокая скорость обработки больших объемов текста без потери качества.

Gensim: Для Тематического Моделирования и Векторов

Gensim стал нашим незаменимым помощником в работе с большими текстовыми массивами‚ особенно когда речь заходила о:

- Тематическом моделировании: LDA‚ LSI для выявления скрытых тем.

- Создании Word Embeddings: Word2Vec и Doc2Vec для получения содержательных векторных представлений слов и документов.

Использование библиотеки Gensim для анализа больших данных и тематического моделирования позволило нам эффективно работать с огромными текстовыми корпусами.

TextBlob: Простой Вход в Мир NLP

TextBlob – это легковесная библиотека‚ которая предоставляет простой API для выполнения общих задач NLP. Мы часто использовали ее для быстрого прототипирования и для таких задач‚ как:

- Анализ тональности: Быстрая оценка позитивного/негативного окраса текста.

- Определение языка: Удобная функция для многоязычных корпусов.

- POS-теггинг и токенизация: Простые реализации базовых операций.

Однако‚ мы также осознаем ограничения TextBlob‚ особенно для русского языка и более сложных задач‚ где требуются более мощные и точные инструменты.

Hugging Face Transformers: Передовой Край

С появлением архитектуры трансформеров‚ мир NLP изменился навсегда. Библиотека Hugging Face Transformers стала для нас незаменимым инструментом для работы с самыми современными моделями‚ такими как BERT‚ GPT и многими другими. Мы используем ее для:

- Сложных задач NLP: NER‚ классификация‚ вопросно-ответные системы.

- Генерации текста: Использование Transformer-моделей для генерации текста (GPT) открыло нам двери в мир креативного письма и автоматического создания контента.

- Машинного перевода: Разработка систем машинного перевода на Python‚ основанных на трансформерах‚ позволяет достигать очень высокого качества.

- Тонкой настройки (Fine-tuning): Мы регулярно адаптируем предварительно обученные модели под наши специфические задачи‚ что дает невероятные результаты.

Трансформеры – это будущее NLP‚ и Hugging Face делает их доступными для всех.

Другие Полезные Инструменты

Помимо основных‚ в нашей "мастерской" есть и другие ценные инструменты:

| Библиотека | Назначение | Наши Примеры Использования |

|---|---|---|

| Beautiful Soup | Веб-скрейпинг текста | Извлечение статей с новостных сайтов‚ сбор отзывов. |

| PyMuPDF | Извлечение текста из PDF | Автоматический анализ отчетов и документов в формате PDF. |

| Stanza / Polyglot | Обработка многоязычных текстовых корпусов‚ редкие языки | Продвинутая лемматизация для русского‚ анализ языков с богатой морфологией. |

| Textacy | Продвинутая обработка и анализ текста | Извлечение информации‚ работа с зависимостями. |

| TextDistance / Jellyfish | Измерение сходства строк‚ поиск дубликатов | Обнаружение плагиата‚ сравнение документов‚ исправление опечаток. |

| RAKE / TextRank | Извлечение ключевых слов и предложений | Быстрая суммаризация‚ выделение основных тем. |

| Sweetviz | Автоматический EDA (Exploratory Data Analysis) | Быстрый анализ текстовых данных и их распределения. |

Сложные Задачи и Реальные Применения

Переходя от базовых концепций к более комплексным задачам‚ мы видим‚ как NLP трансформирует целые отрасли. Наш опыт позволяет нам применять эти знания для решения реальных бизнес-проблем‚ создавая интеллектуальные системы‚ которые экономят время и ресурсы.

Генерация и Суммаризация Текста: От Человека к Машине и Обратно

Возможность автоматически создавать или сокращать текст – это мечта‚ которая становится реальностью благодаря NLP. Мы работали над задачами:

- Суммаризация текста: Мы различаем экстрактивную (извлечение ключевых предложений из исходного текста) и абстрактивную (генерация нового‚ связного резюме) суммаризацию. Transformer-модели для суммаризации показали себя наилучшим образом для абстрактивного подхода.

- Генерация текста: Использование Transformer-моделей для генерации текста (GPT) позволяет нам создавать уникальные описания товаров‚ новостные статьи или даже диалоги для чат-ботов. Это открывает безграничные возможности для автоматизации контента.

- Автоматическое перефразирование: Разработка инструмента для автоматического перефразирования помогает нам создавать вариации одного и того же текста‚ что полезно для SEO и тестирования маркетинговых сообщений.

Системы Вопросно-Ответных Систем (QA) и Чат-боты

Создание систем‚ способных отвечать на вопросы пользователей или вести осмысленный диалог‚ является одной из самых амбициозных задач NLP. Мы активно работали над:

- Разработкой систем вопросно-ответных систем (QA): Используя продвинутые Transformer-модели‚ мы создавали системы‚ которые могут находить точные ответы на вопросы в больших текстовых документах.

- Разработкой чат-ботов на Python (Rasa framework): Для более сложных и интерактивных чат-ботов мы применяли фреймворк Rasa‚ который позволяет строить контекстно-зависимые диалоговые системы.

- Генерацией диалогов: Использование Transformer-моделей для генерации диалогов позволяет нашим ботам звучать более естественно и поддерживать длительные беседы.

Обработка Многоязычных Данных и Редких Языков

Мир не ограничивается одним языком‚ и наши проекты часто требуют работы с многоязычными корпусами. Мы использовали:

- Библиотеки Polyglot и Stanza: Эти инструменты оказались незаменимыми для работы с языками с богатой морфологией и для анализа редких языков‚ предоставляя качественные модели для токенизации‚ лемматизации и POS-теггинга.

- Системы машинного перевода: Разработка систем для автоматического перевода узкоспециализированных текстов‚ используя Transformer-модели‚ стала для нас увлекательной задачей.

Работа с Большими Данными и Неструктурированным Текстом

Объемы данных растут‚ и способность эффективно обрабатывать большие текстовые массивы (Big Data NLP) становится критичной. Мы сталкивались с задачами:

- Очистки неструктурированного текста: Разработка инструментов для очистки текста от HTML-тегов‚ пунктуации‚ стоп-слов‚ нормализации сленга – это постоянный процесс.

- Анализа лог-файлов‚ юридических документов‚ финансовых отчетов: Для этих задач мы применяли комбинацию NER‚ классификации и извлечения ключевых фраз. Анализ текста в медицинских записях‚ юридических контрактах и финансовой отчетности требует высокой точности и специализированных моделей.

- Обработки текста в режиме реального времени (Streaming NLP): Для задач‚ где скорость реакции критична‚ мы разрабатывали решения для потоковой обработки текста.

- Использования GPU-ускорения: Для тренировки больших нейронных сетей и обработки огромных объемов данных мы активно используем GPU-ускорение с PyTorch и TensorFlow.

Качество и Оценка: Проверка Грамматики‚ Орфографии‚ Плагиата

Поддержание высокого качества текста – это еще одна важная область применения NLP. Мы разрабатывали:

- Инструменты для проверки грамматики и орфографии: Создание таких систем требует глубокого понимания синтаксиса и морфологии языка.

- Системы обнаружения плагиата: Используя методы сравнения строк (TextDistance) и векторизации документов (Doc2Vec)‚ мы создавали инструменты для выявления схожести между текстами.

- Инструменты для проверки фактов (Fact-Checking): Эта сложная задача включает в себя извлечение информации и ее верификацию по надежным источникам.

Визуализация и Глубокий Анализ

Числа и векторы – это хорошо‚ но для человека гораздо понятнее визуальные представления. Визуализация помогает нам лучше интерпретировать результаты анализа и доносить их до широкой аудитории.

Визуализация Текстовых Данных

Мы активно применяли различные методы визуализации:

- Облака слов (Word Clouds): Для быстрого понимания наиболее часто встречающихся слов в тексте.

- Тепловые карты (Heatmaps): Для визуализации корреляций между словами или темами.

- Визуализация эмбеддингов: Снижение размерности векторов слов (например‚ с помощью t-SNE) и их отображение на 2D/3D графиках помогает увидеть семантические связи.

Анализ Стилистики и Авторства

NLP позволяет нам заглянуть глубже в сам текст‚ анализируя его стиль и определяя автора. Мы работали над:

- Анализом стилистики текстов (авторский почерк): Выявление уникальных характеристик письма разных авторов.

- Разработкой систем для определения авторства текста: Применение машинного обучения для идентификации автора на основе его стилистических особенностей.

- Анализом лексического богатства и сложности текстов: Оценка разнообразия словарного запаса и сложности синтаксических конструкций.

Выявление Связей и Паттернов

Текст – это не просто набор слов‚ это сложная сеть взаимосвязей. Мы использовали NLP для:

- Разработки моделей для выявления связей между сущностями: Например‚ кто связан с кем в новостной статье.

- Применения Graph Embeddings для анализа взаимосвязей в тексте: Представление текста в виде графов и использование методов для их анализа.

- Анализа поведенческих паттернов в чатах и отзывах: Выявление типичных последовательностей действий или фраз.

- Анализа временных рядов в текстовых данных: Например‚ как меняется тональность или частотность определенных тем со временем‚ выявление сезонности.

На этом наш обзор мира NLP с Python подходит к концу. Мы надеемся‚ что наш опыт вдохновит вас на собственные исследования и открытия. Этот мир постоянно развивается‚ и каждый день появляются новые удивительные инструменты и подходы. Главное – не бояться экспериментировать и всегда оставаться любопытными. Удачи в ваших NLP-приключениях!

Подробнее

| NLTK основы | spaCy NER | Gensim LDA | Word2Vec | Анализ тональности Python |

| Трансформеры NLP | Классификация текста Scikit-learn | Регулярные выражения текст | Лемматизация Python | Чат-боты Python |