- Расшифровывая язык: Наш путь в мире NLP на Python от А до Я

- Основы основ: Строим фундамент понимания текста

- Токенизация: Разделяя текст на кирпичики смысла

- spacy․load("ru_core_news_sm") или другая модель для вашего языка

- Стемминг и Лемматизация: Приводим слова к общему знаменателю

- Извлекаем суть: Как превратить слова в числа‚ понятные машине

- Векторизация текста: CountVectorizer и TF-IDF — первые шаги

- [[0 0 0 1 1 0 0 0 1 0]

- [1 1 0 0 0 1 1 0 1 0]

- [0 0 1 0 0 1 0 1 0 1]]

- Word Embeddings: От слов к векторам глубокого смысла

- Предположим‚ у нас есть корпус предложений (список списков токенов)

- Находим слова‚ похожие на "Python"

- Векторизация предложений и документов: Doc2Vec и Sentence Transformers

- Получаем вектор для первого документа

- Классические задачи NLP: От распознавания до анализа эмоций

- Распознавание именованных сущностей (NER): Кто‚ что‚ где‚ когда?

- Сущность: Лев Толстой‚ Тип: PER

- Сущность: Ясной Поляне‚ Тип: LOC

- Сущность: 1828 году‚ Тип: DATE

- Анализ тональности: Чувства и мнения в тексте

- Тематическое моделирование: Выявляем скрытые темы

- Пример корпуса документов

- Предобработка: токенизация и удаление стоп-слов

- Создание словаря и корпуса Gensim

- Обучение LDA модели

- Классификация текстов: Распределяем по категориям

- Пример данных

- Создание пайплайна: векторизация + классификатор

- Разделение данных на обучающую и тестовую выборки

- Обучение модели

- Предсказания и оценка

- Эра Трансформеров: Новый уровень понимания языка

- Hugging Face и предобученные модели: BERT‚ GPT и другие

- Использование пайплайна для анализа тональности (пример)

- Использование пайплайна для NER (пример)

- Генерация текста и суммаризация: Когда машина пишет сама

- Практическое применение и продвинутые техники

- Веб-скрейпинг для NLP: Добываем данные с Beautiful Soup

- Извлечение всего текста из параграфов

- Многоязычный NLP: Работаем со всем миром

- Чат-боты и QA-системы: Когда текст оживает

- Анализ стилистики‚ плагиата и эмодзи: Тонкости текстовой экспертизы

- Работа с неструктурированными данными: Очистка и предобработка

- Визуализация и оценка: Как увидеть и измерить результат

- Word Clouds и Heatmaps: Красота в данных

- Метрики качества: F1-score‚ Precision‚ Recall

- Вызовы и будущее NLP: Куда мы движемся дальше

Расшифровывая язык: Наш путь в мире NLP на Python от А до Я

Приветствуем вас‚ дорогие читатели‚ в нашем увлекательном путешествии по миру обработки естественного языка (NLP) с использованием Python! Мы‚ как опытные исследователи и практикующие разработчики‚ не раз убеждались в безграничных возможностях‚ которые открывает эта область․ Язык — это не просто набор символов и звуков; это сложная система‚ пронизанная смыслом‚ эмоциями и культурными нюансами․ И что может быть интереснее‚ чем научить машину понимать‚ анализировать и даже генерировать этот язык? Именно об этом мы хотим рассказать вам сегодня‚ делясь нашим личным опытом и глубокими знаниями․

Наше приключение в NLP началось много лет назад‚ когда мы впервые столкнулись с задачей автоматической обработки огромного объема текстовых данных․ Тогда мы поняли‚ что вручную с этим не справиться․ Тогда же мы осознали‚ что Python — это не просто язык программирования‚ а настоящий швейцарский нож для работы с текстом․ Его простота‚ обширная экосистема библиотек и огромное сообщество делают его идеальным выбором для любых NLP-проектов‚ от самых базовых до невероятно сложных․ В этой статье мы шаг за шагом проведем вас через основные концепции‚ инструменты и методы‚ которые мы сами освоили и успешно применяем в нашей работе․

Мир вокруг нас пропитан текстом․ Электронные письма‚ сообщения в социальных сетях‚ статьи в блогах‚ научные публикации‚ юридические документы‚ отзывы клиентов – все это огромные массивы неструктурированных данных‚ которые хранят в себе несметные сокровища информации․ Однако извлечь эти сокровища без специальных инструментов крайне сложно․ Именно здесь на помощь приходит обработка естественного языка (NLP) – область искусственного интеллекта‚ которая занимается взаимодействием компьютеров и человеческого языка․

Для нас NLP стало не просто сферой профессионального интереса‚ но и настоящей страстью․ Мы видим‚ как с помощью алгоритмов можно выявлять скрытые закономерности‚ прогнозировать тренды‚ автоматизировать рутинные задачи и создавать совершенно новые способы взаимодействия человека с машиной․ Представьте‚ что вы можете мгновенно узнать мнение миллионов людей о новом продукте‚ или автоматически сгруппировать тысячи новостных статей по их содержанию‚ или даже заставить компьютер писать связные и осмысленные тексты․ Все это и многое другое становится возможным благодаря NLP․

Почему же именно Python? Этот вопрос мы слышали не раз‚ и каждый раз наш ответ был однозначен․ Python предлагает невероятную гибкость и читаемость кода‚ что особенно важно при работе со сложными лингвистическими моделями․ Но самое главное – это его богатейшая экосистема библиотек․ От фундаментальных NLTK и spaCy до мощных Gensim и Hugging Face Transformers‚ Python предоставляет инструменты для решения практически любой задачи в NLP․ Мы начали свой путь с простых скриптов на Python и постепенно углублялись в этот мир‚ постоянно открывая для себя новые возможности и совершенствуя наши навыки․ Именно этот опыт мы и хотим передать вам‚ чтобы вы могли начать или продолжить свое собственное увлекательное путешествие․

Основы основ: Строим фундамент понимания текста

Прежде чем машина сможет "понять" человеческий язык‚ ей нужно его "разобрать" на мельчайшие составляющие․ Это как учить ребенка читать: сначала он учится распознавать буквы‚ потом слова‚ и только потом предложения․ В NLP этот процесс начинается с токенизации‚ а затем переходит к нормализации слов‚ таким как стемминг и лемматизация․

Токенизация: Разделяя текст на кирпичики смысла

Представьте‚ что у нас есть предложение: "Мы любим изучать NLP на Python!"․ Для человека это единая мысль‚ но для компьютера это просто строка символов․ Токенизация, это процесс разбиения текста на отдельные единицы‚ называемые токенами․ Этими токенами могут быть слова‚ символы пунктуации или даже подслова‚ в зависимости от выбранного метода․ Это первый и‚ пожалуй‚ самый важный шаг в любой задаче NLP․

На нашем опыте мы пробовали различные токенизаторы․ В библиотеке NLTK (Natural Language Toolkit) есть универсальные токенизаторы‚ такие как word_tokenize и sent_tokenize‚ которые отлично подходят для английского языка и многих других․ Они достаточно просты в использовании и дают хорошие результаты для большинства базовых задач․ Например‚ чтобы токенизировать предложение по словам‚ мы бы написали:

import nltk from nltk․tokenize import word_tokenize text = "Мы любим изучать NLP на Python!" tokens = word_tokenize(text) print(tokens)

Однако‚ когда речь заходит о более сложных сценариях‚ таких как обработка текстов на языках с богатой морфологией или необходимость сохранения информации о частях речи и зависимостях‚ мы часто обращаемся к spaCy․ Эта библиотека предлагает более продвинутые и производительные токенизаторы‚ которые интегрированы с другими лингвистическими аннотациями․ SpaCy не только разбивает текст на токены‚ но и сразу предоставляет доступ к их свойствам‚ таким как лемма‚ часть речи и синтаксическая связь․ Это делает ее незаменимой для задач‚ требующих глубокого понимания структуры предложения․

import spacyspacy․load("ru_core_news_sm") или другая модель для вашего языка

nlp = spacy․load("ru_core_news_sm") text = "Мы любим изучать NLP на Python!" doc = nlp(text) tokens = [token․text for token in doc] print(tokens)

Выбор токенизатора всегда зависит от конкретной задачи и требований к точности․ Мы всегда начинаем с простых решений‚ а затем‚ при необходимости‚ переходим к более сложным и специализированным инструментам․

Стемминг и Лемматизация: Приводим слова к общему знаменателю

После того как мы разбили текст на токены‚ часто возникает следующая проблема: одно и то же слово может иметь множество форм․ Например‚ "бежать"‚ "бежит"‚ "бежал"‚ "бегущий" — все они относятся к одному и тому же корню или базовой форме․ Чтобы компьютер мог эффективно работать с этими словами‚ их нужно привести к некоторой нормализованной форме․ Здесь в игру вступают стемминг и лемматизация․

Стемминг — это процесс усечения слова до его "корня" или "основы" (stem)‚ который может не быть осмысленным словом сам по себе․ Это быстрый и простой способ нормализации․ Мы часто используем стеммеры из NLTK‚ такие как Porter Stemmer или Snowball Stemmer‚ особенно когда скорость обработки является приоритетом․ Например‚ "running"‚ "runs"‚ "ran" могут быть сведены к "run"․ Однако‚ стеммеры не всегда учитывают грамматические правила‚ что может привести к не совсем корректным результатам для некоторых слов․

from nltk․stem import PorterStemmer stemmer = PorterStemmer words = ["running"‚ "runs"‚ "ran"‚ "runner"] stemmed_words = [stemmer․stem(word) for word in words] print(stemmed_words)

Лемматизация‚ в отличие от стемминга‚ является более сложным и точным процессом․ Она приводит слово к его базовой словарной форме‚ или лемме‚ которая всегда является действительным словом․ Например‚ "бежал"‚ "бегущий" и "бежит" будут приведены к "бежать"․ Для лемматизации требуются словари и знание морфологии языка‚ что делает этот процесс более ресурсоемким‚ но и более точным․ Мы предпочитаем использовать лемматизацию‚ когда высокая точность анализа текста критична‚ например‚ при построении поисковых систем или систем вопросно-ответных систем․

import spacy

nlp = spacy․load("ru_core_news_sm")

text = "Мы любим изучать NLP на Python!"

doc = nlp(text)

lemmas = [token․lemma_ for token in doc]

print(lemmas)

Как вы видите‚ spaCy отлично справляется с лемматизацией русского языка‚ приводя "любим" к "любить"․ В NLTK для лемматизации мы часто используем WordNetLemmatizer‚ который требует указания части речи для лучшей точности․ Наш опыт показывает‚ что для большинства языков‚ особенно русского‚ spaCy предоставляет более удобный и точный инструмент для лемматизации из коробки․

| Характеристика | Стемминг (например‚ NLTK PorterStemmer) | Лемматизация (например‚ spaCy) |

|---|---|---|

| Цель | Усечение слова до основы (stem) | Приведение слова к словарной форме (лемме) |

| Результат | Основа слова‚ которая не всегда является реальным словом | Действительное словарное слово |

| Точность | Ниже‚ может быть эвристическим‚ иногда ошибается | Выше‚ учитывает морфологию и часть речи |

| Скорость | Выше‚ быстрее | Ниже‚ требует больше вычислений и словарей |

| Применение | Для быстрого анализа‚ поисковых систем‚ когда точность не критична | Для глубокого анализа текста‚ классификации‚ вопросно-ответных систем |

Выбор между стеммингом и лемматизацией всегда обусловлен компромиссом между скоростью и точностью․ Для задач‚ где скорость важнее‚ например‚ при обработке очень больших объемов данных‚ мы можем предпочесть стемминг․ Но для большинства аналитических задач‚ где важен смысл‚ лемматизация является нашим фаворитом․

Извлекаем суть: Как превратить слова в числа‚ понятные машине

Компьютеры‚ по своей природе‚ оперируют числами‚ а не словами․ Чтобы алгоритмы машинного обучения могли работать с текстовыми данными‚ нам необходимо преобразовать слова и предложения в числовые векторы․ Этот процесс называется векторизацией текста‚ и он является краеугольным камнем современного NLP․

Векторизация текста: CountVectorizer и TF-IDF — первые шаги

На заре нашего знакомства с NLP‚ мы начинали с относительно простых‚ но очень эффективных методов векторизации․ Одним из первых был CountVectorizer из библиотеки Scikit-learn․ Его принцип крайне прост: он создает словарь всех уникальных слов в корпусе документов и затем для каждого документа подсчитывает‚ сколько раз каждое слово встречается․ Результатом является матрица‚ где строки — это документы‚ а столбцы, слова‚ а значения в ячейках — частота встречаемости слов․

from sklearn․feature_extraction․text import CountVectorizer corpus = ["Мы любим Python"‚ "Python отличный инструмент для NLP"‚ "NLP очень интересная область"] vectorizer = CountVectorizer X = vectorizer․fit_transform(corpus) print(vectorizer․get_feature_names_out) print(X․toarray)[[0 0 0 1 1 0 0 0 1 0]

[1 1 0 0 0 1 1 0 1 0]

[0 0 1 0 0 1 0 1 0 1]]

Этот метод интуитивно понятен‚ но у него есть один существенный недостаток: он придает одинаковый вес всем словам‚ независимо от их значимости․ Такие слова‚ как "мы"‚ "для"‚ "очень"‚ могут встречаться часто‚ но не нести много уникальной информации о содержании документа․ Чтобы решить эту проблему‚ мы обратились к TF-IDF (Term Frequency-Inverse Document Frequency)․

TF-IDF учитывает не только частоту слова в документе (Term Frequency‚ TF)‚ но и его редкость во всем корпусе документов (Inverse Document Frequency‚ IDF)․ Интуиция здесь такова: слово‚ которое часто встречается в одном документе‚ но редко в других‚ вероятно‚ очень важно для этого конкретного документа․ И наоборот‚ слово‚ которое встречается повсеместно (например‚ "и"‚ "в"‚ "на")‚ имеет низкий IDF и‚ следовательно‚ меньший вес․ Мы активно используем TF-IDF для задач классификации и поиска‚ поскольку он позволяет выделить наиболее значимые слова в каждом документе․

from sklearn․feature_extraction․text import TfidfVectorizer corpus = ["Мы любим Python"‚ "Python отличный инструмент для NLP"‚ "NLP очень интересная область"] vectorizer = TfidfVectorizer X = vectorizer․fit_transform(corpus) print(vectorizer․get_feature_names_out) print(X․toarray)

TF-IDF показал себя как надежный и эффективный метод‚ особенно когда нужно быстро получить числовое представление текста для задач машинного обучения․ Он до сих пор остается одним из наших "рабочих лошадок" для многих проектов․

Word Embeddings: От слов к векторам глубокого смысла

Несмотря на свою эффективность‚ CountVectorizer и TF-IDF имеют фундаментальное ограничение: они не учитывают семантическую связь между словами․ То есть‚ слова "король" и "королева" воспринимаются ими как совершенно независимые сущности‚ хотя для нас очевидна их связь․ Чтобы преодолеть это ограничение‚ мы погрузились в мир Word Embeddings (векторных представлений слов)․

Word Embeddings — это плотные векторы чисел‚ которые представляют слова таким образом‚ что слова с похожим значением имеют близкие векторные представления в многомерном пространстве․ Это позволяет моделям машинного обучения "понимать" контекст и семантические отношения между словами․ Мы использовали Gensim для работы с различными моделями Word Embeddings․

- Word2Vec: Это одна из первых и наиболее влиятельных моделей для создания векторных представлений слов․ Она основана на идее "слово определяется своим контекстом"․ Word2Vec предлагает два основных алгоритма:

- Skip-gram: предсказывает контекстные слова‚ зная текущее слово․

- CBOW (Continuous Bag of Words): предсказывает текущее слово‚ зная его контекст․

- GloVe (Global Vectors for Word Representation): В отличие от Word2Vec‚ GloVe не только учитывает локальный контекст‚ но и глобальную статистику встречаемости слов в корпусе․ Мы обнаружили‚ что GloVe часто дает хорошие результаты‚ особенно при наличии достаточно большого и разнообразного корпуса данных․

- FastText: Разработанный Facebook‚ FastText является расширением Word2Vec‚ которое учитывает подсловные единицы (n-граммы символов)․ Это делает его особенно эффективным для работы с редкими словами (out-of-vocabulary words) и морфологически богатыми языками‚ к которым относится и русский․ Мы заметили‚ что FastText демонстрирует отличные результаты там‚ где Word2Vec и GloVe могут "спотыкаться" на словах‚ не встречавшихся в обучающем корпусе․

Мы часто тренировали свои собственные Word2Vec модели на больших корпусах текстов‚ когда стандартные предобученные модели не давали нужной точности для нашей предметной области․ Gensim делает это удивительно просто․

Пример использования Word2Vec с Gensim:

from gensim․models import Word2Vec from nltk․tokenize import word_tokenizeПредположим‚ у нас есть корпус предложений (список списков токенов)

sentences = [ word_tokenize("Мы любим программировать на Python")‚ word_tokenize("Python — отличный язык для обработки данных")‚ word_tokenize("NLP очень интересная область")‚ word_tokenize("Машинное обучение и NLP тесно связаны") ] model = Word2Vec(sentences‚ vector_size=100‚ window=5‚ min_count=1‚ workers=4)Находим слова‚ похожие на "Python"

similar_words = model․wv․most_similar("Python") print(similar_words) print(model․wv["Python"]) # Вектор слова "Python"

Word Embeddings стали для нас настоящим прорывом‚ позволив нашим моделям улавливать тонкие семантические связи и значительно улучшить качество задач‚ таких как классификация‚ кластеризация и анализ тональности․

Векторизация предложений и документов: Doc2Vec и Sentence Transformers

Когда нам нужно получить векторное представление не отдельного слова‚ а целого предложения или документа‚ мы используем более продвинутые методы․ Doc2Vec (также известный как Paragraph2Vec)‚ разработанный Томашем Миколовым и его командой‚ является расширением Word2Vec․ Он позволяет генерировать векторы для целых документов‚ сохраняя при этом семантические отношения между ними․ Мы успешно применяли Doc2Vec для поиска похожих документов или для кластеризации текстов по смыслу․

from gensim․models․doc2vec import Doc2Vec‚ TaggedDocument from nltk․tokenize import word_tokenize documents = [ "Мы любим программировать на Python"‚ "Python — отличный язык для обработки данных"‚ "NLP очень интересная область"‚ "Машинное обучение и NLP тесно связаны" ] tagged_data = [TaggedDocument(words=word_tokenize(_d․lower)‚ tags=[str(i)]) for i‚ _d in enumerate(documents)] model = Doc2Vec(tagged_data‚ vector_size=20‚ window=2‚ min_count=1‚ workers=4‚ epochs=100)Получаем вектор для первого документа

vector = model․dv[0] print(vector)

Однако‚ с появлением трансформеров‚ мы обнаружили еще более мощные инструменты для векторизации предложений — Sentence Transformers․ Эти модели‚ построенные на архитектуре BERT и других трансформеров‚ способны генерировать высококачественные эмбеддинги для предложений и даже коротких параграфов‚ которые прекрасно улавливают их смысл․ Sentence Transformers стали нашим основным инструментом для задач‚ где требуется сравнение предложений‚ поиск семантически похожих фраз или построение систем вопросно-ответных систем․ Они значительно превосходят традиционные методы по точности и контекстному пониманию․

Классические задачи NLP: От распознавания до анализа эмоций

Освоив базовые инструменты и методы векторизации‚ мы перешли к решению более прикладных задач․ Именно здесь NLP начинает демонстрировать свою истинную мощь‚ помогая нам извлекать конкретную информацию‚ понимать мнения и классифицировать огромные массивы текстов․

Распознавание именованных сущностей (NER): Кто‚ что‚ где‚ когда?

NER (Named Entity Recognition) — это задача по выявлению и классификации именованных сущностей в тексте‚ таких как имена людей‚ названия организаций‚ географические объекты‚ даты‚ денежные суммы и т․д․․ Это критически важный шаг для извлечения структурированной информации из неструктурированного текста․ Например‚ если у нас есть новостная статья‚ NER может автоматически выделить‚ кто совершил действие‚ где оно произошло и когда․

Наш опыт показывает‚ что spaCy является одним из лучших инструментов для NER "из коробки"․ Его предобученные модели обладают высокой точностью и производительностью для многих языков‚ включая русский․ Мы часто используем spaCy для первоначальной обработки документов‚ чтобы быстро извлечь ключевые сущности․

import spacy

nlp = spacy․load("ru_core_news_sm")

text = "Лев Толстой родился в Ясной Поляне в 1828 году․"

doc = nlp(text)

for ent in doc․ents:

print(f"Сущность: {ent․text}‚ Тип: {ent․label_}")

Сущность: Лев Толстой‚ Тип: PER

Сущность: Ясной Поляне‚ Тип: LOC

Сущность: 1828 году‚ Тип: DATE

Для более специфических доменов‚ где стандартные модели могут давать сбои (например‚ медицинские или юридические тексты)‚ мы обучали собственные модели NER․ Здесь на помощь приходят такие фреймворки‚ как Flair‚ который предлагает state-of-the-art архитектуры на основе рекуррентных нейронных сетей и трансформеров‚ или более классические методы‚ как CRF (Conditional Random Fields)‚ когда данных для глубокого обучения недостаточно․

Анализ тональности: Чувства и мнения в тексте

В современном мире‚ где социальные сети и онлайн-отзывы играют огромную роль‚ понимание эмоциональной окраски текста стало критически важным․ Анализ тональности (Sentiment Analysis) позволяет нам определить‚ является ли высказывание позитивным‚ негативным или нейтральным․ Мы применяем его для анализа отзывов о продуктах‚ мониторинга социальных сетей‚ оценки настроения клиентов и даже для анализа финансовых новостей․

Для быстрого и простого анализа тональности мы часто обращаемся к TextBlob․ Эта библиотека предоставляет удобный интерфейс для определения полярности (позитивная/негативная) и субъективности текста․ Однако‚ TextBlob лучше работает с английским языком и может быть менее точен для русского без дополнительных настроек․

from textblob import TextBlob text = "This product is absolutely amazing!" analysis = TextBlob(text)

Когда нам нужна более высокая точность‚ особенно для английского языка‚ мы используем VADER (Valence Aware Dictionary and sEntiment Reasoner)․ VADER специально разработан для анализа тональности текстов из социальных сетей и хорошо справляется с сленгом‚ эмодзи и акронимами․ Он выдает оценки по четырем параметрам: позитивность‚ нейтральность‚ негативность и составную оценку‚ которая является нормализованной взвешенной суммой․

from nltk․sentiment․vader import SentimentIntensityAnalyzer analyzer = SentimentIntensityAnalyzer text = "The movie was fantastic! 😄 I loved it․" vs = analyzer․polarity_scores(text)

Для русского языка и более сложных задач мы часто строим собственные модели на основе машинного обучения‚ используя размеченные данные и такие алгоритмы‚ как SVM или нейронные сети․ Анализ тональности с учетом сарказма и иронии остается одним из самых сложных вызовов‚ над которым мы продолжаем работать․

"Язык — это ключ к пониманию человеческого разума․ Если мы сможем научить машины понимать язык‚ мы откроем двери к созданию по-настоящему интеллектуальных систем․"

Тематическое моделирование: Выявляем скрытые темы

Представьте‚ что у вас есть огромная коллекция документов, тысячи статей‚ отзывов‚ новостей․ Как быстро понять‚ о чем в них говорится? Тематическое моделирование — это мощный инструмент‚ который позволяет нам обнаруживать скрытые абстрактные "темы" в коллекции текстовых документов․ Каждая тема представляется как набор слов‚ которые часто встречаются вместе․

Мы активно используем библиотеку Gensim для тематического моделирования․ Она предоставляет реализации таких популярных алгоритмов‚ как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing)․ LDA является нашим фаворитом‚ когда речь идет о поиске четко определенных‚ интерпретируемых тем․ Он предполагает‚ что каждый документ является смесью нескольких тем‚ а каждая тема‚ в свою очередь‚ является смесью слов․

from gensim import corpora from gensim․models import LdaModel from nltk․tokenize import word_tokenize from nltk․corpus import stopwordsПример корпуса документов

documents = [ "Машинное обучение и искусственный интеллект меняют мир"‚ "Python — популярный язык для анализа данных и NLP"‚ "Новые алгоритмы в искусственном интеллекте"‚ "Веб-разработка на Python с Django и Flask" ]Предобработка: токенизация и удаление стоп-слов

ru_stopwords = stopwords․words("russian") texts = [[word for word in word_tokenize(document․lower) if word․isalpha and word not in ru_stopwords] for document in documents]Создание словаря и корпуса Gensim

dictionary = corpora;Dictionary(texts) corpus = [dictionary․doc2bow(text) for text in texts]Обучение LDA модели

lda_model = LdaModel(corpus‚ num_topics=2‚ id2word=dictionary‚ passes=15) for idx‚ topic in lda_model․print_topics(-1): print(f"Тема: {idx} Слова: {topic}")

Мы также экспериментировали с NMF (Non-negative Matrix Factorization)‚ который часто дает хорошие результаты для более коротких текстов и может быть немного более интерпретируем‚ чем LDA в некоторых случаях․ Выбор между LDA и NMF часто зависит от характеристик данных и желаемой интерпретируемости результатов․

Классификация текстов: Распределяем по категориям

Классификация текстов — это одна из наиболее распространенных и полезных задач NLP․ Она заключается в автоматическом отнесении текстового документа к одной или нескольким предопределенным категориям․ Мы применяли классификацию для самых разных целей: от фильтрации спама и категоризации новостей до определения жанра текстов и маршрутизации клиентских запросов․

Наш подход к классификации обычно начинается с библиотеки Scikit-learn․ Она предоставляет широкий спектр алгоритмов машинного обучения‚ которые прекрасно работают с векторами TF-IDF или Word Embeddings․ Мы часто используем:

- Наивный Байесовский классификатор (Multinomial Naive Bayes): Простой‚ но удивительно эффективный алгоритм‚ который хорошо работает с текстовыми данными‚ особенно когда количество классов невелико․

- Метод опорных векторов (SVM ― Support Vector Machines): Мощный алгоритм‚ который отлично справляется с задачей разделения данных‚ находя оптимальную границу между классами․ Мы часто используем SVM‚ когда требуется высокая точность и у нас есть достаточно размеченных данных․

- Логистическая регрессия: Хотя это и модель регрессии‚ она широко используется для бинарной и многоклассовой классификации‚ предлагая хорошие результаты и интерпретируемость․

Пример классификации с Scikit-learn:

from sklearn․feature_extraction․text import TfidfVectorizer from sklearn․svm import SVC from sklearn․pipeline import make_pipeline from sklearn․model_selection import train_test_split from sklearn․metrics import classification_reportПример данных

texts = [ "Этот фильм просто потрясающий‚ очень понравился!"‚ "Ужасный сервис‚ никогда больше не пойду в этот ресторан․"‚ "Отличная книга‚ всем рекомендую к прочтению․"‚ "Еда была посредственной‚ но обслуживание хорошее․"‚ "Самый худший опыт‚ что у меня был․" ] labels = ["позитивный"‚ "негативный"‚ "позитивный"‚ "нейтральный"‚ "негативный"]Создание пайплайна: векторизация + классификатор

model = make_pipeline(TfidfVectorizer‚ SVC)Разделение данных на обучающую и тестовую выборки

X_train‚ X_test‚ y_train‚ y_test = train_test_split(texts‚ labels‚ test_size=0․2‚ random_state=42)Обучение модели

model․fit(X_train‚ y_train)Предсказания и оценка

y_pred = model․predict(X_test) print(classification_report(y_test‚ y_pred))

С появлением глубокого обучения‚ мы начали активно применять PyTorch/TensorFlow для создания нейронных сетей для классификации текстов‚ особенно когда объем данных велик‚ а задачи сложны․ Рекуррентные нейронные сети (RNN) и их варианты‚ такие как LSTM (Long Short-Term Memory)‚ а затем и трансформеры‚ значительно улучшили результаты в таких задачах‚ позволяя моделям улавливать долгосрочные зависимости в тексте;

Эра Трансформеров: Новый уровень понимания языка

Если Word Embeddings стали прорывом‚ то появление архитектуры Трансформеров и предобученных моделей‚ таких как BERT и GPT‚ ознаменовало настоящую революцию в NLP; Это изменило наш подход к решению многих задач и открыло двери для совершенно новых возможностей․

Hugging Face и предобученные модели: BERT‚ GPT и другие

Суть трансформеров заключается в механизме внимания (attention mechanism)‚ который позволяет модели взвешивать важность различных слов в предложении при обработке каждого слова․ Это помогает моделям улавливать контекст гораздо лучше‚ чем предыдущие архитектуры․ С появлением Hugging Face Transformers‚ процесс работы с этими мощными моделями стал удивительно простым и доступным․

Мы активно используем предобученные модели из библиотеки Hugging Face для широкого спектра задач:

- BERT (Bidirectional Encoder Representations from Transformers): Разработанный Google‚ BERT произвел фурор‚ представив двунаправленное обучение․ Это означает‚ что он учитывает контекст слова как слева‚ так и справа‚ что позволяет ему формировать более глубокие и контекстуально-обогащенные представления слов․ Мы используем BERT для задач классификации‚ NER‚ вопросно-ответных систем и многого другого․

- GPT (Generative Pre-trained Transformer): Серия моделей от OpenAI (GPT-2‚ GPT-3‚ GPT-4) специализируется на генерации текста․ Они обучены предсказывать следующее слово в последовательности‚ что позволяет им создавать связные‚ креативные и удивительно человекоподобные тексты․

- Другие модели: Hugging Face предлагает огромное количество других моделей‚ таких как RoBERTa‚ XLNet‚ T5‚ ELECTRA‚ каждый из которых имеет свои особенности и преимущества․ Мы всегда стараемся выбрать наиболее подходящую модель для конкретной задачи и языка․

Одним из самых мощных аспектов работы с трансформерами является возможность тонкой настройки (fine-tuning) предобученных моделей на наших собственных данных․ Это позволяет нам адаптировать общую‚ широко обученную модель под специфику нашей предметной области‚ достигая при этом выдающихся результатов даже с относительно небольшим объемом размеченных данных․

from transformers import pipelineИспользование пайплайна для анализа тональности (пример)

classifier = pipeline("sentiment-analysis"‚ model="d0rj/ru_ru_sentiment_qa") print(classifier("Эта книга просто великолепна!"))Использование пайплайна для NER (пример)

ner_pipeline = pipeline("ner"‚ model="d0rj/rubert-base-cased-ner") print(ner_pipeline("Вчера Владимир Путин посетил Санкт-Петербург․"))

Трансформеры кардинально изменили ландшафт NLP‚ подняв планку качества и позволив нам решать задачи‚ которые ранее казались невозможными․

Генерация текста и суммаризация: Когда машина пишет сама

Возможность заставить машину генерировать связный и осмысленный текст — это одна из самых впечатляющих и сложных задач в NLP․ С появлением трансформеров‚ таких как GPT‚ эта область претерпела колоссальные изменения․

Мы используем модели генерации текста для различных целей: от создания кратких описаний продуктов и ответов на часто задаваемые вопросы до помощи в написании статей и даже генерации кода․ Существуют два основных подхода к суммаризации:

- Экстрактивная суммаризация (Extractive Summarization): Этот метод выбирает наиболее важные предложения или фразы из исходного текста и объединяет их в краткое изложение․ Мы часто используем для этого такие алгоритмы‚ как TextRank (на основе Google PageRank)․ Он эффективен‚ когда нужно сохранить исходный смысл без изменений․

- Абстрактивная суммаризация (Abstractive Summarization): Это более сложный подход‚ при котором модель генерирует новое краткое изложение‚ которое может содержать слова и фразы‚ не присутствующие в исходном тексте․ Это больше похоже на то‚ как человек пишет краткий пересказ․ Трансформеры‚ такие как T5 или BART‚ отлично справляются с этой задачей‚ создавая очень качественные и информативные суммаризации․

Генерация текста‚ особенно с помощью GPT-подобных моделей‚ открывает невероятные возможности․ Мы можем использовать их для создания диалогов для чат-ботов‚ автоматического написания новостных статей на основе данных‚ или даже для творческого письма; Однако‚ мы всегда помним о необходимости контроля качества и этических аспектах использования сгенерированного текста․

Практическое применение и продвинутые техники

Теория и алгоритмы — это хорошо‚ но настоящий интерес к NLP возникает‚ когда мы видим‚ как эти инструменты применяются для решения реальных проблем․ Наш опыт охватывает широкий спектр практических применений‚ от извлечения данных до создания интеллектуальных систем․

Веб-скрейпинг для NLP: Добываем данные с Beautiful Soup

Для большинства проектов NLP нам нужны данные‚ и очень часто эти данные находятся на веб-страницах․ Beautiful Soup — это наша любимая библиотека для веб-скрейпинга․ Она позволяет легко парсить HTML- и XML-документы‚ извлекая нужный текст‚ ссылки‚ заголовки и другие элементы․ С ее помощью мы собирали огромные объемы текстовых данных для обучения наших моделей‚ будь то отзывы с маркетплейсов‚ новостные статьи или контент блогов․

from bs4 import BeautifulSoup import requests url = "https://example․com" # Замените на реальный URL response = requests․get(url) soup = BeautifulSoup(response․text‚ 'html․parser')Извлечение всего текста из параграфов

paragraphs = soup․find_all('p') text_content = [p․get_text for p in paragraphs]

После сбора данных‚ следующим шагом всегда является их очистка от HTML-тегов‚ скриптов и других ненужных элементов‚ чтобы получить чистый текст для дальнейшей обработки․ Это рутинная‚ но крайне важная часть процесса․

Многоязычный NLP: Работаем со всем миром

В глобализированном мире работа только с одним языком быстро становится недостаточной․ Мы часто сталкиваемся с необходимостью обрабатывать тексты на разных языках‚ и здесь нам помогают специализированные библиотеки․

- Polyglot: Эта библиотека предоставляет широкий набор функций для многоязычного NLP‚ включая распознавание языка‚ токенизацию‚ NER и даже машинный перевод для большого числа языков․ Она особенно полезна для работы с менее распространенными языками․

- Stanza (от Stanford NLP Group): Stanza — это мощный инструмент для высокоточного лингвистического анализа (токенизация‚ POS-теггинг‚ лемматизация‚ NER‚ синтаксический парсинг) для десятков языков․ Мы используем ее‚ когда требуется глубокий и точный анализ для языков с богатой морфологией‚ таких как русский или арабский․

Работа с многоязычными текстовыми корпусами требует внимательного подхода к выбору моделей и предобработки‚ поскольку каждый язык имеет свои уникальные особенности․

Чат-боты и QA-системы: Когда текст оживает

Создание чат-ботов и систем вопросно-ответных систем (QA) — это вершина прикладного NLP․ Мы работали над проектами‚ где нужно было автоматически отвечать на вопросы клиентов или вести осмысленный диалог․ Для этого мы использовали различные подходы:

- На основе правил: Для простых чат-ботов с ограниченным набором вопросов и ответов․

- На основе поиска по документам: Для QA-систем‚ которые находят ответы в базе знаний или коллекции документов‚ используя семантический поиск (например‚ с помощью Sentence Transformers)․

- На основе глубокого обучения: Для более сложных разговорных ИИ‚ которые могут генерировать ответы․ Здесь мы часто используем фреймворки вроде Rasa‚ который предоставляет полный стек для создания контекстуальных чат-ботов‚ или трансформеры для генерации диалогов․

Разработка QA-систем часто включает в себя такие этапы‚ как извлечение предложений (extractive QA) или генерация ответов (generative QA)‚ где модели‚ такие как BERT или GPT‚ играют ключевую роль․

Анализ стилистики‚ плагиата и эмодзи: Тонкости текстовой экспертизы

NLP позволяет нам погружаться в тонкие нюансы текста:

- Анализ стилистики текстов (авторский почерк): Мы можем использовать NLP для определения авторства текста‚ анализа лексического богатства‚ использования n-грамм и других стилистических характеристик․ Это полезно в криминалистике‚ литературоведении или для персонализации контента․

- Обнаружение плагиата: Сравнение документов на предмет сходства‚ используя такие библиотеки‚ как Textdistance или Doc2Vec‚ позволяет выявлять заимствования․

- Работа с эмодзи и сленгом: В социальных сетях эмодзи и сленг несут огромный объем информации․ Мы разрабатывали специальные препроцессоры и словари для корректной обработки этих элементов‚ чтобы они не искажали анализ тональности или тематическое моделирование․

Работа с неструктурированными данными: Очистка и предобработка

Большинство реальных текстовых данных "грязные"․ Они содержат опечатки‚ символы‚ не несущие смысла‚ HTML-теги‚ пунктуацию‚ которую нужно обработать․ Наш опыт показывает‚ что качество предобработки напрямую влияет на качество конечных результатов․

- Регулярные выражения (библиотека

re): Наш незаменимый инструмент для поиска и замены паттернов в тексте‚ удаления специальных символов‚ URL-адресов‚ чисел или очистки от HTML-тегов․ - Удаление стоп-слов: Слова типа "и"‚ "в"‚ "на"‚ "он" встречаются очень часто‚ но обычно не несут смысловой нагрузки․ Их удаление (с помощью списков стоп-слов из NLTK или spaCy) значительно улучшает качество векторизации и анализа․

- Нормализация пунктуации и регистра: Приведение всего текста к нижнему регистру и стандартизация пунктуации (или ее удаление) также являются стандартными шагами․

- Исправление орфографии: Для пользовательского контента мы иногда используем инструменты для автоматического исправления орфографических ошибок‚ чтобы улучшить качество анализа․

Визуализация и оценка: Как увидеть и измерить результат

После того как мы провели весь анализ‚ важно не только получить числовые результаты‚ но и уметь их наглядно представить‚ а также объективно оценить качество наших моделей․

Word Clouds и Heatmaps: Красота в данных

Визуализация текстовых данных помогает нам быстро понять основные паттерны и темы․ Мы часто используем:

- Облака слов (Word Clouds): Это отличный способ визуализировать частоту слов в тексте или теме․ Чем больше слово‚ тем чаще оно встречается․ Мы используем библиотеку

wordcloudдля быстрого создания красивых облаков слов․ - Тепловые карты (Heatmaps): Для визуализации матриц сходства слов‚ тем или документов․ Например‚ тепловая карта может показать‚ насколько сильно связаны между собой различные темы в нашем корпусе․

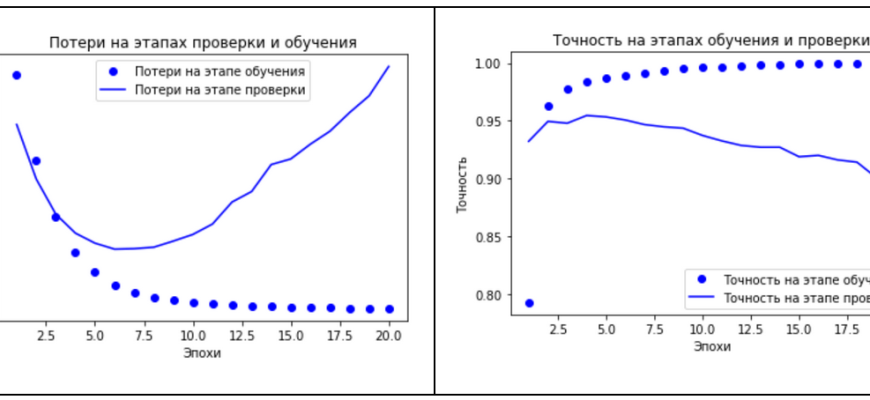

Метрики качества: F1-score‚ Precision‚ Recall

В NLP‚ как и в любом машинном обучении‚ нельзя обойтись без объективной оценки качества моделей․ Для задач классификации и NER мы используем стандартные метрики:

- Precision (Точность): Доля правильно предсказанных положительных случаев среди всех предсказанных положительных случаев․ Отвечает на вопрос: "Из того‚ что модель назвала положительным‚ сколько действительно было положительным?"

- Recall (Полнота): Доля правильно предсказанных положительных случаев среди всех фактических положительных случаев․ Отвечает на вопрос: "Из всех действительно положительных случаев‚ сколько модель смогла найти?"

- F1-score: Гармоническое среднее Precision и Recall․ Эта метрика особенно полезна‚ когда классы несбалансированы;

- Accuracy (Аккуратность): Общая доля правильно классифицированных примеров․ Мы используем ее‚ но всегда помним‚ что для несбалансированных классов она может быть обманчивой․

Для задач NER мы часто используем эти метрики на уровне токенов или на уровне сущностей‚ чтобы получить максимально объективную картину производительности модели․

Вызовы и будущее NLP: Куда мы движемся дальше

Несмотря на колоссальные успехи‚ NLP по-прежнему сталкивается с рядом серьезных вызовов․ Мы постоянно работаем над их преодолением‚ и это делает нашу область такой захватывающей:

- Проблемы обработки неполных и ошибочных данных: Реальные данные часто содержат опечатки‚ грамматические ошибки‚ пропуски․ Разработка robust-моделей‚ устойчивых к таким шумам‚ является одним из ключевых направлений․

- Понимание контекста и нюансов: Сарказм‚ ирония‚ метафоры‚ юмор, эти аспекты человеческого языка остаются чрезвычайно сложными для автоматического распознавания․ Модели все еще плохо справляются с тонкими эмоциональными и стилистическими нюансами․

- Многоязычность и редкие языки: Несмотря на прогресс‚ большинство передовых моделей сосредоточены на английском языке․ Разработка высококачественных инструментов для всех языков мира‚ особенно для тех‚ у которых мало данных‚ остается актуальной задачей․

- Этические вопросы и предвзятость: Модели NLP обучаются на реальных данных‚ которые могут содержать предвзятость‚ стереотипы или дискриминацию․ Это приводит к тому‚ что модели могут воспроизводить или даже усиливать эти негативные паттерны․ Мы уделяем большое внимание выявлению и минимизации предвзятости в наших моделях․

- Объяснимость моделей (Explainable AI): Современные глубокие нейронные сети часто работают как "черные ящики"․ Понимание того‚ почему модель приняла то или иное решение‚ критически важно для доверия и внедрения NLP в чувствительных областях‚ таких как медицина или юриспруденция․

Будущее NLP обещает быть еще более захватывающим․ Мы видим развитие в области мультимодального NLP‚ где текст будет анализироваться в связке с изображениями‚ видео и аудио․ Также ожидаем прорывы в создании по-настоящему интеллектуальных систем‚ которые смогут не только понимать‚ но и рассуждать‚ учиться на ходу и адаптироваться к новым ситуациям‚ используя язык как основной инструмент взаимодействия․

Наше путешествие по миру NLP на Python было долгим и невероятно увлекательным․ Мы прошли путь от изучения азов токенизации и стемминга до работы с мощными трансформерными архитектурами‚ способными генерировать текст и отвечать на сложные вопросы․ Каждый шаг на этом пути открывал для нас новые горизонты и демонстрировал безграничный потенциал‚ заложенный в машинном понимании человеческого языка․

Мы искренне верим‚ что NLP — это не просто набор технологий‚ а ключ к более глубокому пониманию нашего мира․ Оно позволяет нам не только извлекать информацию‚ но и выявлять эмоции‚ предсказывать тренды‚ автоматизировать рутину и создавать новые формы взаимодействия․ Python‚ со своей богатой экосистемой библиотек и активным сообществом‚ остается нашим верным спутником в этом приключении‚ делая сложные задачи доступными и увлекательными․

Мы надеемся‚ что наш опыт и знания‚ которыми мы поделились в этой статье‚ вдохновят вас на собственные исследования и проекты в области NLP․ Это динамичная и быстро развивающаяся сфера‚ где всегда есть место для новых открытий и инноваций․ Не бойтесь экспериментировать‚ погружаться в детали и‚ самое главное‚ наслаждаться процессом․ Мир слов ждет своих исследователей‚ и Python готов стать вашим проводником․ Удачи в ваших начинаниях!

Подробнее

| Основы NLTK Python | spaCy NER распознавание | Gensim тематическое моделирование | Scikit-learn классификация текста | Word Embeddings Word2Vec |

| Анализ тональности VADER | Трансформеры Hugging Face | Лемматизация стемминг сравнение | Векторизация текста TF-IDF | Разработка чат-ботов Python |