- Разгадываем Язык Машин: Полный Путеводитель по NLP в Python

- Фундамент NLP: От Сырого Текста к Структурированным Данным

- Первые шаги: Токенизация‚ Стемминг и Лемматизация

- Очистка и Подготовка Данных: Регулярные Выражения и Стоп-слова

- Представление Текста: Как Компьютер "Видит" Слова

- Классические Методы Векторизации: Частота и Значимость

- Word Embeddings: Слова как Векторы Смысла

- Контекстные Встраивания и Трансформеры: Революция в NLP

- Ключевые Задачи NLP: От Понимания к Действию

- Классификация Текстов: Сортировка и Категоризация

- Распознавание Именованных Сущностей (NER) и Извлечение Информации

- Тематическое Моделирование: Поиск Скрытых Темы

- Анализ Тональности (Sentiment Analysis): Понимание Эмоций

- Суммаризация Текста и Генерация: От Конспектов к Творчеству

- Расширенные Применения и Специализированные Инструменты

- Синтаксический Парсинг и Языковые Модели

- Веб-Скрейпинг и Извлечение из Документов

- Мультиязычный NLP и Сложные Задачи

- Анализ Стилистики и Уникальные Применения

- Практические Аспекты и Инструментарий

- Сравнение Инструментов и Методов

- Оценка Качества и Устранение Проблем

- Будущее NLP: Новые Горизонты и Вызовы

- Инновации и Перспективы

- Этические Аспекты и Ответственность

Разгадываем Язык Машин: Полный Путеводитель по NLP в Python

Добро пожаловать в захватывающий мир обработки естественного языка (NLP)! Мы‚ как опытные исследователи и энтузиасты Python‚ с удовольствием погружаемся в эту область‚ где слова‚ предложения и целые тексты превращаются в данные‚ понятные компьютерам. Это не просто академическая дисциплина; это ключ к пониманию человеческого общения на беспрецедентном уровне‚ открывающий двери для автоматизации‚ аналитики и даже творчества. Мы живем во времена‚ когда объем текстовых данных растет экспоненциально‚ и умение эффективно работать с ними становиться одним из самых ценных навыков.

Наш блог всегда стремился делиться практическими знаниями и опытом‚ и эта статья не станет исключением. Мы хотим провести вас по всем ключевым этапам и инструментам‚ которые делают NLP в Python таким мощным и доступным. От самых азов‚ таких как разбиение текста на слова‚ до сложнейших нейросетевых моделей‚ способных генерировать связные тексты‚ – мы рассмотрим всё. Приготовьтесь к увлекательному путешествию‚ которое изменит ваше представление о возможностях взаимодействия человека и машины через язык.

В этой обширной статье мы не просто перечислим библиотеки и алгоритмы; мы постараемся показать‚ как они связаны между собой‚ как формируют единую экосистему для решения реальных задач. Мы поделимся нашим личным опытом и наблюдениями‚ чтобы вы могли не только понять теорию‚ но и увидеть‚ как эти концепции применяются на практике. Цель этой статьи – дать вам всестороннее понимание NLP‚ вдохновить на собственные эксперименты и помочь вам стать уверенным специалистом в этой быстро развивающей области.

Фундамент NLP: От Сырого Текста к Структурированным Данным

Любое путешествие в мир обработки естественного языка начинается с одного и того же шага: превращения неструктурированного‚ "сырого" текста в нечто‚ с чем компьютер может работать. Это этап предварительной обработки‚ и он является критически важным для успеха любого NLP-проекта. Без качественной предобработки даже самые продвинутые модели будут испытывать трудности с пониманием и анализом данных. Мы уделяем этому этапу особое внимание‚ поскольку именно здесь закладываются основы для всех последующих операций.

Первые шаги: Токенизация‚ Стемминг и Лемматизация

Когда мы сталкиваемся с большим объемом текста‚ первая задача – это разбить его на более мелкие‚ осмысленные единицы. Этот процесс называется токенизацией. Мы разделяем текст на слова‚ предложения или даже подслова‚ которые называются токенами. Например‚ предложение "Мы изучаем NLP." может быть токенизировано в ["Мы"‚ "изучаем"‚ "NLP"‚ "."]. Правильная токенизация важна‚ так как она определяет‚ как слова будут восприниматься моделью.

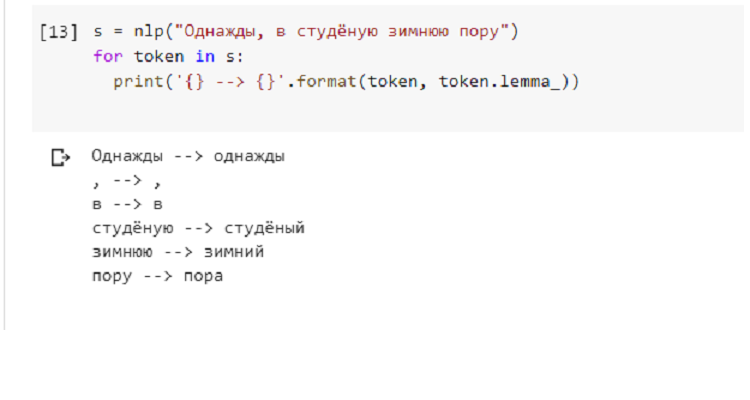

Следующий этап – это нормализация слов. В естественном языке одно и то же слово может иметь множество форм (например‚ "бежать"‚ "бежит"‚ "бежал"). Чтобы компьютер воспринимал их как одно и то же понятие‚ мы используем стемминг и лемматизацию; Стемминг – это процесс отсечения суффиксов и окончаний для получения "корня" слова (например‚ "бежал" -> "беж"). Он быстр‚ но может создавать несуществующие слова. Лемматизация более продвинута: она приводит слово к его базовой словарной форме (лемме)‚ используя словарь и морфологический анализ (например‚ "бежал" -> "бежать"). Мы часто предпочитаем лемматизацию для более точных результатов‚ особенно когда контекст имеет значение.

Для этих задач мы активно используем библиотеки NLTK (Natural Language Toolkit) и spaCy. NLTK является пионером в этой области и предоставляет широкий набор алгоритмов для токенизации‚ стемминга и лемматизации. spaCy‚ в свою очередь‚ предлагает более быстрые и оптимизированные решения‚ часто с предварительно обученными моделями для различных языков‚ что делает его отличным выбором для продакшн-систем;

Очистка и Подготовка Данных: Регулярные Выражения и Стоп-слова

Представьте‚ что вы работаете с текстом‚ полученным из интернета; Он может содержать HTML-теги‚ ссылки‚ пунктуацию‚ смайлики‚ цифры и прочий "шум". Всё это мешает анализу. На этом этапе мы применяем регулярные выражения (re) для удаления ненужных символов и форматирования. Это мощный инструмент для поиска и замены текстовых паттернов‚ позволяющий нам очищать данные от всего‚ что не является непосредственно языком.

Далее‚ мы сталкиваемся с таким явлением‚ как стоп-слова – это часто встречающиеся‚ но малоинформативные слова (артикли‚ предлоги‚ союзы: "и"‚ "в"‚ "на"‚ "он"‚ "она"). Для многих задач NLP‚ таких как классификация или тематическое моделирование‚ эти слова могут создавать ненужный шум и искажать результаты. Мы используем готовые списки стоп-слов‚ предоставляемые NLTK или spaCy‚ и удаляем их из текста. Однако‚ важно помнить‚ что в некоторых задачах (например‚ в анализе стилистики или машинного перевода) стоп-слова могут быть важны‚ и их удаление не всегда является лучшим решением.

Также‚ на этапе очистки мы можем столкнуться с необходимостью обработки многоязычных текстовых корпусов‚ нормализации сленга или работы с эмодзи. Для многоязычности отлично подходят такие библиотеки‚ как Polyglot или Stanza‚ которые поддерживают широкий спектр языков с богатой морфологией. А для сленга и эмодзи часто требуются кастомные словари и правила‚ разработанные специально для конкретной предметной области.

Представление Текста: Как Компьютер "Видит" Слова

После того как текст очищен и нормализован‚ возникает новый вызов: как представить слова и предложения в числовом формате‚ который могут понять алгоритмы машинного обучения? Компьютеры оперируют числами‚ а не буквами. Этот процесс называется векторизацией текста или созданием встраиваний (embeddings). Мы прошли долгий путь от простых методов до сложных нейросетевых архитектур‚ и каждый шаг открывал новые горизонты в понимании языка.

Классические Методы Векторизации: Частота и Значимость

Один из самых простых‚ но эффективных способов представления текста – это использование матриц частотности. CountVectorizer из библиотеки Scikit-learn создает матрицу‚ где каждая строка соответствует документу‚ а каждый столбец – уникальному слову в корпусе‚ и значения в ячейках – это количество вхождений слова в документ. Это прямолинейный подход‚ но он уже позволяет алгоритмам увидеть‚ какие слова чаще встречаются в каких документах.

Однако‚ частота слова не всегда отражает его важность. Например‚ стоп-слова встречаются очень часто‚ но не несут много смысла. Здесь на помощь приходит TF-IDF (Term Frequency-Inverse Document Frequency). Этот метод не только учитывает частоту слова в документе (TF)‚ но и penalizes слова‚ которые встречаются во многих документах (IDF). Таким образом‚ слова‚ уникальные для конкретного документа‚ получают больший вес. Мы часто используем TfidfVectorizer‚ также из Scikit-learn‚ для задач классификации и поиска похожих документов. Это был значительный прорыв‚ позволяющий нам лучше улавливать семантическую значимость слов.

| Метод Векторизации | Преимущества | Недостатки | Типичные задачи |

|---|---|---|---|

| CountVectorizer | Простота‚ интуитивность‚ сохраняет информацию о частоте | Большая разреженность матрицы‚ не учитывает семантику‚ игнорирует важность слова | Базовая классификация‚ анализ частотности слов |

| TfidfVectorizer | Учитывает важность слова‚ уменьшает влияние частых слов‚ улучшает качество | Не учитывает порядок слов‚ не передает семантические связи между словами | Классификация‚ кластеризация‚ поиск похожих документов |

Word Embeddings: Слова как Векторы Смысла

Классические методы векторизации имеют один существенный недостаток: они не улавливают семантические связи между словами. Например‚ слова "король" и "царь" должны быть близки в векторном пространстве‚ но CountVectorizer этого не покажет. Здесь на сцену выходят Word Embeddings – плотные векторные представления слов‚ где семантически похожие слова располагаются близко друг к другу в многомерном пространстве. Мы были поражены‚ когда впервые увидели‚ как эти модели способны улавливать такие отношения‚ как "король ⏤ мужчина + женщина = королева".

Одними из первых и наиболее влиятельных моделей стали Word2Vec и GloVe. Word2Vec (Skip-gram и CBOW) из библиотеки Gensim учится предсказывать контекст слова по самому слову или наоборот. GloVe (Global Vectors for Word Representation) использует глобальную статистику со-встречаемости слов из всего корпуса. Эти модели позволили нам перейти от простых подсчетов к семантическому пониманию текста‚ значительно улучшив качество многих NLP-задач. Gensim также прекрасно подходит для работы с большими текстовыми массивами и эффективной реализации этих моделей.

Помимо Word2Vec и GloVe‚ мы активно используем FastText‚ особенно для работы с редкими словами и языками с богатой морфологией. FastText расширяет идею Word2Vec‚ представляя слова как суммы векторов их n-грамм символов‚ что позволяет модели генерировать встраивания даже для слов‚ которые она никогда не видела во время обучения. А для представления целых документов или предложений мы применяем Doc2Vec и Sentence Transformers‚ которые генерируют плотные векторы для более крупных текстовых единиц‚ что особенно полезно для поиска схожих документов или кластеризации.

Контекстные Встраивания и Трансформеры: Революция в NLP

Хотя Word Embeddings были огромным шагом вперед‚ у них был один фундаментальный недостаток: каждое слово имело одно фиксированное векторное представление‚ независимо от контекста. Например‚ слово "банк" в значении "финансовое учреждение" и "берег реки" будет иметь один и тот же вектор. Это ограничивало их возможности. И вот‚ несколько лет назад произошла настоящая революция с появлением контекстных встраиваний и архитектуры Трансформеров.

Модели‚ такие как BERT (Bidirectional Encoder Representations from Transformers) и другие из семейства Hugging Face Transformers‚ изменили правила игры. Они генерируют векторное представление слова‚ которое зависит от всего контекста предложения. Это позволяет им улавливать многозначность слов и более тонкие семантические нюансы. Мы используем Трансформеры для широкого спектра задач: от NER и классификации до суммаризации и генерации текста. Они представляют собой вершину современных достижений в NLP и позволяют нам решать задачи‚ которые ранее казались невозможными.

"Язык – это дорожная карта культуры. Он говорит вам‚ откуда пришли его люди и куда они идут."

— Рита Мэй Браун

Ключевые Задачи NLP: От Понимания к Действию

После того как текст подготовлен и представлен в числовом виде‚ мы можем приступить к решению более сложных и прикладных задач. Здесь NLP действительно раскрывает свой потенциал‚ позволяя нам автоматизировать анализ‚ извлекать ценную информацию и даже создавать новые тексты. Мы рассмотрим наиболее востребованные задачи‚ с которыми сталкиваемся в нашей практике.

Классификация Текстов: Сортировка и Категоризация

Одной из наиболее распространенных задач является классификация текстов‚ то есть отнесение документа к одной или нескольким предопределенным категориям. Это может быть спам-фильтрация‚ категоризация новостей по темам‚ анализ отзывов клиентов по продуктам или определение тональности. Мы используем широкий спектр алгоритмов машинного обучения для этих целей.

Библиотека Scikit-learn предлагает богатый выбор классификаторов‚ таких как SVM (Support Vector Machines)‚ Наивный Байесовский классификатор‚ Логистическая регрессия и другие. Мы часто начинаем с этих "классических" методов‚ поскольку они относительно просты в реализации и часто дают хорошие результаты. Для более сложных задач‚ особенно с большими объемами данных и использованием контекстных встраиваний‚ мы переходим к глубокому обучению. PyTorch и TensorFlow позволяют нам строить и обучать нейронные сети‚ такие как LSTM-сети или использовать предварительно обученные модели на основе BERT для задач классификации‚ что значительно повышает точность.

Распознавание Именованных Сущностей (NER) и Извлечение Информации

Задача NER (Named Entity Recognition) заключается в идентификации и классификации именованных сущностей в тексте по заранее определенным категориям‚ таким как имена людей‚ названия организаций‚ географические объекты‚ даты и т.д. Это критически важно для извлечения структурированной информации из неструктурированного текста. Например‚ из предложения "Тим Кук посетил Apple Park в Купертино 10 января 2023 года" мы можем извлечь: Person: "Тим Кук"‚ Organization: "Apple Park"‚ Location: "Купертино"‚ Date: "10 января 2023 года".

Мы активно используем spaCy для быстрого и точного NER‚ так как он поставляется с высококачественными предварительно обученными моделями для многих языков. Для более продвинутых задач‚ или когда нам нужна тонкая настройка под специфические сущности‚ мы обращаемся к библиотеке Flair‚ которая известна своими State-of-the-Art моделями. Также в нашем арсенале есть методы на основе CRF (Conditional Random Fields)‚ которые‚ хоть и не относятся к глубокому обучению‚ все еще эффективны для некоторых задач NER.

Помимо NER‚ мы занимаемся извлечением ключевых фраз и ключевых слов. Для этого мы применяем такие алгоритмы‚ как RAKE (Rapid Automatic Keyword Extraction) и TextRank (из библиотеки TextRank). TextRank также может быть использован для извлечения ключевых предложений‚ что является основой для экстрактивной суммаризации. Мы также разрабатываем системы для извлечения дат и чисел из текста‚ что особенно полезно для анализа юридических и финансовых документов.

Тематическое Моделирование: Поиск Скрытых Темы

Представьте‚ что у вас есть огромный корпус документов‚ и вы хотите понять‚ какие основные темы в них обсуждаются‚ не читая каждый документ вручную. Здесь на помощь приходит тематическое моделирование – набор алгоритмов‚ которые позволяют нам обнаруживать скрытые "темы" в коллекции текстов. Каждая тема представлена набором наиболее релевантных слов‚ а каждый документ – распределением по этим темам.

Мы регулярно используем Gensim для реализации таких моделей‚ как LDA (Latent Dirichlet Allocation) и LSI (Latent Semantic Indexing). LDA – одна из самых популярных моделей‚ которая предполагает‚ что каждый документ является смесью нескольких тем‚ а каждая тема – смесью слов. LSI‚ в свою очередь‚ использует сингулярное разложение для выявления скрытых семантических структур. Мы также проводим сравнение моделей тематического моделирования‚ таких как LDA против NMF (Non-negative Matrix Factorization)‚ чтобы выбрать наиболее подходящий подход для конкретной задачи. Тематическое моделирование особенно полезно для анализа текстов отзывов клиентов‚ постов в блогах и форумах‚ позволяя нам выявлять скрытые тенденции и настроения.

Анализ Тональности (Sentiment Analysis): Понимание Эмоций

В современном мире‚ где мнения и отзывы играют огромную роль‚ способность автоматически определять эмоциональную окраску текста – позитивную‚ негативную или нейтральную – становится бесценной. Анализ тональности‚ или Sentiment Analysis‚ позволяет нам это делать. Мы используем его для анализа отзывов о продуктах‚ сообщений в социальных сетях‚ финансовых новостей и многого другого.

Для быстрого и простого анализа тональности английского текста мы часто обращаемся к библиотеке VADER (Valence Aware Dictionary and sEntiment Reasoner)‚ которая отлично справляется с текстами из социальных сетей. TextBlob также предлагает удобный интерфейс для анализа тональности‚ хотя его возможности более ограничены. Для более сложных случаев‚ особенно с русским языком или специфической лексикой‚ мы обучаем собственные модели классификации тональности‚ используя те же подходы‚ что и для общей классификации текстов.

Особую сложность представляет анализ тональности с учетом сарказма и сленга. Эти тонкие нюансы требуют более продвинутых моделей‚ часто основанных на трансформерах‚ которые могут улавливать контекст и иронию. Мы постоянно экспериментируем с точной настройкой предварительно обученных моделей (Fine-tuning) для улучшения качества анализа в таких сложных сценариях.

Суммаризация Текста и Генерация: От Конспектов к Творчеству

С ростом объема информации способность быстро получать суть длинных документов становится критически важной. Суммаризация текста решает эту проблему. Существуют два основных подхода: экстрактивная суммаризация и абстрактивная суммаризация.

- Экстрактивная суммаризация: Мы выбираем наиболее важные предложения из исходного текста и объединяем их в краткий конспект. Это похоже на выделение маркером ключевых моментов. Для этого мы используем алгоритмы вроде TextRank для суммаризации‚ который ранжирует предложения на основе их важности в тексте.

- Абстрактивная суммаризация: Это гораздо более сложная задача‚ где модель генерирует совершенно новый текст‚ который передает основную идею оригинала‚ но не обязательно содержит его оригинальные предложения. Это требует глубокого понимания текста и способности к перефразированию‚ что является отличительной чертой человека. Сегодня мы достигаем впечатляющих результатов в абстрактивной суммаризации с использованием Transformer-моделей для суммаризации‚ таких как те‚ что предоставляются Hugging Face.

Помимо суммаризации‚ мы также исследуем возможности генерации текста. Transformer-модели‚ такие как GPT (Generative Pre-trained Transformer)‚ позволяют нам создавать связные и осмысленные тексты на основе заданного начального фрагмента. Это открывает двери для автоматического создания контента‚ генерации ответов в чат-ботах и даже для творческого письма. Мы экспериментируем с генерацией кода‚ диалогов и других форм текста‚ видя в этом будущее автоматизации контента.

Расширенные Применения и Специализированные Инструменты

Мир NLP не ограничивается только базовыми задачами. Существует множество специализированных областей и уникальных инструментов‚ которые позволяют нам решать конкретные и часто очень сложные проблемы; Мы постоянно расширяем наш арсенал‚ исследуя новые подходы и библиотеки.

Синтаксический Парсинг и Языковые Модели

Помимо отдельных слов‚ важно понимать структуру предложения. Синтаксический парсинг позволяет нам анализировать грамматическую структуру предложения‚ выявлять отношения между словами (например‚ кто что делает‚ кто является объектом действия). spaCy отлично справляется с реализацией синтаксического парсинга‚ предоставляя древовидные структуры зависимостей. Это полезно для задач‚ где важен точный смысл‚ например‚ в вопросно-ответных системах или извлечении сложных фактов.

Мы также строим языковые модели на основе N-грамм. N-грамма – это последовательность из N слов. Такие модели предсказывают следующее слово в последовательности‚ основываясь на предыдущих N-х. Хотя N-граммные модели уступают современным нейросетевым‚ они все еще полезны для некоторых задач‚ таких как проверка грамматики или оценка вероятности последовательности слов.

Веб-Скрейпинг и Извлечение из Документов

Чтобы анализировать текст‚ его сначала нужно получить. Часто это означает извлечение данных из интернета или из различных форматов документов. Для веб-скрейпинга текста мы используем библиотеку Beautiful Soup. Она позволяет нам парсить HTML-страницы‚ находить нужные элементы и извлекать текст‚ очищая его от разметки. Это наш первый шаг к получению данных из открытых источников.

Когда речь идет о документах в формате PDF‚ задача усложняется. Для извлечения текста из PDF мы применяем библиотеку PyMuPDF‚ которая эффективно работает с этим форматом‚ позволяя нам получать текст‚ а иногда и метаданные‚ для последующей обработки. Это особенно актуально для анализа юридических документов‚ научных статей или финансовых отчетов.

Мультиязычный NLP и Сложные Задачи

Мир не ограничивается одним языком‚ и наши NLP-проекты тоже. Мы часто работаем с многоязычными текстовыми корпусами. Библиотеки‚ такие как Polyglot и Stanza‚ становятся незаменимыми в этих случаях. Polyglot поддерживает множество языков для токенизации‚ NER и морфологического анализа. Stanza‚ разработанная в Стэнфорде‚ предоставляет комплексные нейросетевые пайплайны для многих языков‚ включая русский‚ охватывая токенизацию‚ POS-теггинг‚ лемматизацию и синтаксический парсинг.

Для создания систем машинного перевода мы все чаще используем Transformer-модели‚ которые значительно превосходят традиционные подходы. Это позволяет нам разрабатывать инструменты для перевода узкоспециализированных текстов или даже сленга.

В области разработки чат-ботов на Python мы активно применяем фреймворк Rasa. Он предоставляет мощные инструменты для создания диалоговых систем‚ обработки естественного языка и управления диалогом‚ позволяя нам создавать умных и отзывчивых ботов.

Анализ Стилистики и Уникальные Применения

Иногда нас интересует не только смысл текста‚ но и то‚ как он написан. Анализ стилистики текстов (авторский почерк) позволяет нам определять автора текста‚ выявлять уникальные черты его письма или анализировать лексическое богатство и сложность. Мы используем различные метрики‚ такие как частотность слов‚ длина предложений‚ использование специфических частей речи‚ чтобы "отпечаток" автора. Это может быть полезно в криминалистике или для проверки фактов.

Мы также занимаемся разработкой систем обнаружения плагиата‚ используя методы сравнения строк и документов‚ такие как алгоритмы из библиотеки TextDistance или Jellyfish. Эти инструменты помогают нам измерять сходство между текстами‚ что критически важно для академической среды или издательств.

В нашей практике мы сталкиваемся с необходимостью анализа юридических документов и медицинских записей. Эти области требуют высокой точности и специфических знаний‚ поэтому мы разрабатываем узкоспециализированные инструменты для извлечения фактов‚ сущностей (например‚ названий лекарств‚ диагнозов) и проведения анализа тональности финансовых новостей.

Практические Аспекты и Инструментарий

NLP – это не только алгоритмы‚ но и правильный выбор инструментов‚ а также понимание практических вызовов. Мы хотим поделиться нашими наблюдениями по работе с различными библиотеками и методами‚ а также о том‚ как мы подходим к оценке качества моделей.

Сравнение Инструментов и Методов

В мире NLP существует множество библиотек‚ каждая со своими сильными и слабыми сторонами. Мы часто проводим сравнение библиотек для лемматизации (например‚ SpaCy vs NLTK)‚ сравнение эффективности различных токенизаторов или сравнение моделей тематического моделирования (LDA vs NMF)‚ чтобы выбрать оптимальное решение для конкретной задачи.

| Инструмент/Метод | Основные Функции | Когда Используем Мы |

|---|---|---|

| NLTK | Токенизация‚ стемминг‚ лемматизация‚ POS-теггинг‚ морфологический анализ‚ базовые алгоритмы. | Для изучения основ‚ прототипирования‚ работы с редкими алгоритмами‚ глубокого морфологического анализа. |

| spaCy | Быстрая токенизация‚ NER‚ синтаксический парсинг‚ лемматизация‚ предобученные модели. | Для продакшн-систем‚ задач‚ требующих высокой скорости и точности‚ работы с крупными корпусами. |

| Gensim | Тематическое моделирование (LDA‚ LSI)‚ Word2Vec‚ Doc2Vec‚ работа с большими текстовыми массивами. | Для извлечения тем‚ создания эффективных Word Embeddings‚ обработки больших объемов текста. |

| Scikit-learn | Векторизация (CountVectorizer‚ TF-IDF)‚ классификация (SVM‚ Наивный Байес)‚ кластеризация. | Для классических задач машинного обучения в NLP‚ базовой векторизации‚ быстрого прототипирования. |

| Hugging Face Transformers | Transformer-модели (BERT‚ GPT)‚ тонкая настройка‚ генерация текста‚ QA‚ суммаризация. | Для State-of-the-Art решений‚ контекстных встраиваний‚ сложных задач генерации и понимания языка. |

Мы также сравниваем методы векторизации‚ такие как TF-IDF vs Word2Vec‚ или различные архитектуры Word2Vec (Skip-gram vs CBOW)‚ чтобы понять‚ какой подход лучше всего подходит для нашей предметной области. Например‚ для задач‚ где важен контекст слова‚ мы отдаем предпочтение Skip-gram‚ а для более быстрых вычислений – CBOW.

Оценка Качества и Устранение Проблем

Разработка NLP-моделей – это итеративный процесс‚ и оценка качества NER-моделей (F1-score‚ Precision‚ Recall) или классификаторов является его неотъемлемой частью. Мы используем стандартные метрики для измерения производительности наших систем и постоянно стремимся их улучшать. Тонкая настройка (Fine-tuning) предварительно обученных моделей на наших собственных данных позволяет нам достигать лучших результатов.

В реальном мире мы часто сталкиваемся с проблемами обработки неполных и ошибочных данных. Это могут быть опечатки‚ грамматические ошибки‚ неполные предложения или шум в данных. Мы разрабатываем инструменты для проверки грамматики и исправления орфографии‚ используем алгоритмы для нормализации пунктуации и очистки текста от HTML-тегов. Sweetviz – это отличная библиотека для быстрого анализа текстовых данных‚ помогающая выявить аномалии и проблемы с качеством.

Для обработки больших текстовых массивов (Big Data NLP) мы используем различные подходы‚ включая GPU-ускорение для обучения нейронных сетей и обработку текста в режиме реального времени (Streaming NLP). Это позволяет нам масштабировать наши решения и работать с огромными объемами данных‚ которые генерируются каждый день.

Будущее NLP: Новые Горизонты и Вызовы

Индустрия NLP развивается с невероятной скоростью. То‚ что еще вчера казалось фантастикой‚ сегодня становится реальностью. Мы видим‚ как постоянно появляются новые архитектуры‚ улучшаются алгоритмы и расширяются области применения. Мы всегда на переднем крае этих изменений‚ исследуя новые возможности и предвосхищая будущие вызовы.

Инновации и Перспективы

Одним из наиболее захватывающих направлений является разработка моделей для выявления связей между сущностями. Это позволяет нам не просто находить имена людей или организаций‚ но и понимать‚ как они взаимодействуют друг с другом‚ кто кого упоминает‚ какие события происходят. Это следующий шаг к созданию "графов знаний" из неструктурированного текста.

Мы также видим большой потенциал в применении Graph Embeddings для анализа взаимосвязей в тексте. Представление текста в виде графов‚ где слова или сущности являются узлами‚ а их отношения – ребрами‚ открывает новые возможности для анализа сложных структур и паттернов. Это особенно актуально для анализа социальных сетей или юридических документов‚ где важно понимать сложную сеть связей.

Развитие Transformer-моделей для генерации кода и анализа кода (сжатие кода) также является областью нашего интереса. Автоматическая генерация и анализ программного кода с использованием NLP-технологий может революционизировать разработку программного обеспечения‚ делая её более быстрой и менее подверженной ошибкам.

Этические Аспекты и Ответственность

С ростом мощности NLP-моделей возрастает и наша ответственность. Вопросы предвзятости в данных‚ этичности использования генеративных моделей (например‚ для создания фейковых новостей) и конфиденциальности данных становятся все более острыми. Мы придерживаемся принципов ответственного ИИ‚ стараясь создавать справедливые‚ прозрачные и безопасные системы.

Анализ тональности в социальных медиа‚ особенно с учетом сарказма и иронии‚ требует не только технических навыков‚ но и глубокого понимания социальных и культурных нюансов. Мы осознаем‚ что наши модели должны быть не только точными‚ но и этически корректными‚ чтобы не усиливать существующие предубеждения.

Наше путешествие по миру обработки естественного языка в Python подходит к концу‚ но для нас это лишь очередная веха в непрерывном обучении и исследовании. Мы прошли путь от базовых концепций токенизации и стемминга до сложнейших нейросетевых архитектур‚ способных понимать и генерировать человеческий язык. Мы увидели‚ как Python с его богатой экосистемой библиотек – NLTK‚ spaCy‚ Gensim‚ Scikit-learn‚ Hugging Face Transformers и многими другими – предоставляет нам беспрецедентные возможности для работы с текстом.

Мы надеемся‚ что эта статья вдохновила вас и дала прочную основу для дальнейшего изучения. Помните‚ что NLP – это динамичная область‚ требующая постоянного обновления знаний и экспериментов. Не бойтесь погружаться в код‚ пробовать новые библиотеки‚ сравнивать методы и‚ самое главное‚ применять полученные знания для решения реальных задач. Будь то анализ отзывов клиентов‚ создание умных чат-ботов или разработка систем машинного перевода‚ потенциал NLP огромен и ждет‚ чтобы вы его раскрыли.

Мы продолжим делиться нашим опытом и открытиями в этой увлекательной области. Оставайтесь с нами‚ и давайте вместе разгадывать язык машин!

Подробнее

| Основы NLTK | NER с spaCy | Тематическое моделирование LDA | Word2Vec в Gensim | Анализ тональности VADER |

| Трансформеры Hugging Face | Очистка текста Python | Классификация текста Scikit-learn | Векторизация TF-IDF | Суммаризация текста |