- Разгадываем Код Языка: Наш Путь в Мир NLP с Python – От Азов до Трансформеров

- Эволюция NLP: Краткий Исторический Экскурс

- Первые Шаги: Основы Предобработки Текста

- Токенизация: Разделяй и Властвуй

- Стемминг и Лемматизация: К Корню Проблемы

- Регулярные Выражения и Очистка от Шума

- Понимание Смысла: Векторизация и Представление Текста

- Классические Методы: CountVectorizer и TF-IDF

- Word Embeddings: Word2Vec‚ GloVe и FastText

- Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

- Извлечение Информации: NER‚ Тематическое Моделирование и Ключевые Фразы

- Распознавание Именованных Сущностей (NER) с spaCy и Flair

- Тематическое Моделирование: LDA‚ LSI и NMF с Gensim

- Извлечение Ключевых Фраз и Суммаризация

- Анализ Тональности и Эмоций: За Гранью Простого "Да/Нет"

- Инструменты для Анализа Тональности: VADER и TextBlob

- Нюансы Анализа Тональности: Сарказм‚ Сленг и Контекст

- Классификация и Категоризация Текстов: Автоматизация Процессов

- Классические Алгоритмы Машинного Обучения для NLP

- Глубокое Обучение и Трансформеры для Классификации

- Продвинутые Техники: Трансформеры‚ QA-системы и Генерация Текста

- Трансформеры (Hugging Face): Новый Уровень NLP

- Разработка Систем Вопросно-Ответных Систем (QA)

- Генерация Текста: От Чат-ботов до Креативного Письма

- Работа с Данными: От Веб-Скрейпинга до Больших Массивов

- Сбор Данных: Веб-Скрейпинг и Извлечение из Документов

- Обработка Неструктурированного Текста: Очистка и Нормализация

- Обработка Больших Текстовых Массивов (Big Data NLP)

- Специализированные Задачи и Нишевые Применения

- Многоязычная Обработка Текстов

- NLP в Специфических Доменах

- Дополнительные Инструменты и Приложения

- Визуализация Текстовых Данных

- Метрики Оценки Качества Моделей NLP

Разгадываем Код Языка: Наш Путь в Мир NLP с Python – От Азов до Трансформеров

Привет‚ дорогие читатели и коллеги-энтузиасты! Сегодня мы отправляемся в увлекательное путешествие по миру‚ где машины начинают понимать наш человеческий язык. Мы говорим об Обработке Естественного Языка‚ или NLP (Natural Language Processing) – одной из самых захватывающих и быстро развивающихся областей искусственного интеллекта. Если вы когда-либо задумывались‚ как чат-боты отвечают на ваши вопросы‚ как спам-фильтры отличают нежелательную почту‚ или как поисковые системы находят именно то‚ что вы ищете‚ то эта статья для вас. Мы покажем‚ как Python стал нашим верным спутником в освоении этих сложных‚ но невероятно мощных технологий‚ и поделимся личным опытом‚ накопленным за годы работы с текстом.

В нашем блоге мы всегда стремимся не просто дать сухую теорию‚ а показать практическое применение и поделиться теми инсайтами‚ которые мы сами получили‚ набивая шишки и празднуя маленькие победы. Мы убеждены‚ что каждый из вас‚ кто читает эти строки‚ может не только освоить основы NLP‚ но и стать настоящим мастером в этой области‚ создавая свои собственные интеллектуальные системы. Приготовьтесь‚ ведь мы погрузимся в самые глубины текстовых данных‚ вооружившись мощными библиотеками Python и нашим неугасимым любопытством.

Мир вокруг нас наполнен текстом. Электронные письма‚ посты в социальных сетях‚ новостные статьи‚ научные публикации‚ отзывы клиентов‚ юридические документы – всё это огромные массивы информации‚ которые традиционные компьютерные системы с трудом обрабатывают и понимают. Человеческий язык полон нюансов‚ двусмысленностей‚ сарказма и контекста‚ что делает его понимание машинами невероятно сложной задачей. Однако именно здесь на помощь приходит NLP‚ позволяя нам автоматизировать анализ‚ извлечение‚ генерацию и перевод текстовых данных.

Для нас‚ как для практиков‚ NLP открывает двери к решению множества реальных бизнес-задач и исследовательских вызовов. От автоматизации клиентской поддержки с помощью чат-ботов до выявления скрытых трендов в отзывах пользователей‚ от борьбы со спамом до создания умных поисковых систем – спектр применения NLP практически безграничен. Мы видим‚ как компании‚ которые эффективно используют эти технологии‚ получают значительное конкурентное преимущество‚ принимая более обоснованные решения на основе глубокого понимания текстовых данных. Это не просто модное направление‚ это фундаментальный сдвиг в том‚ как мы взаимодействуем с информацией.

Эволюция NLP: Краткий Исторический Экскурс

Мы помним времена‚ когда NLP основывалось преимущественно на правилах и экспертных системах. Это был трудоемкий процесс‚ требовавший огромного количества ручной работы по созданию словарей‚ грамматик и шаблонов. Системы были хрупкими и плохо масштабировались. Затем на смену пришли статистические методы‚ которые позволили машинам "учиться" на больших объемах данных‚ выявляя закономерности. Это был значительный прорыв‚ открывший путь к таким технологиям‚ как машинный перевод и распознавание речи.

И вот‚ в последние годы‚ мы стали свидетелями настоящей революции благодаря глубокому обучению и‚ в частности‚ архитектурам трансформеров. Модели‚ такие как BERT‚ GPT и их многочисленные потомки‚ перевернули наше представление о возможностях NLP. Они способны не только понимать контекст‚ но и генерировать связный‚ релевантный и даже творческий текст. Эти достижения позволили нам решать задачи‚ которые еще десять лет назад казались фантастикой‚ и мы с нетерпением наблюдаем за каждым новым прорывом в этой области.

Первые Шаги: Основы Предобработки Текста

Прежде чем мы сможем заставить компьютер "понять" текст‚ его необходимо подготовить. Этот этап‚ известный как предобработка текста‚ является краеугольным камнем любого NLP-проекта. Без него все последующие шаги будут неэффективными или даже бессмысленными. Мы всегда начинаем с этого‚ потому что "мусор на входе – мусор на выходе" – это золотое правило в машинном обучении и NLP.

Наш опыт показывает‚ что качество предобработки напрямую влияет на точность и производительность итоговой модели. Мы используем ряд стандартных‚ но мощных техник‚ которые позволяют нам привести сырые текстовые данные к форме‚ пригодной для анализа. Эти техники включают в себя токенизацию‚ стемминг‚ лемматизацию‚ удаление стоп-слов‚ очистку от шума и многое другое; Давайте рассмотрим их подробнее.

Токенизация: Разделяй и Властвуй

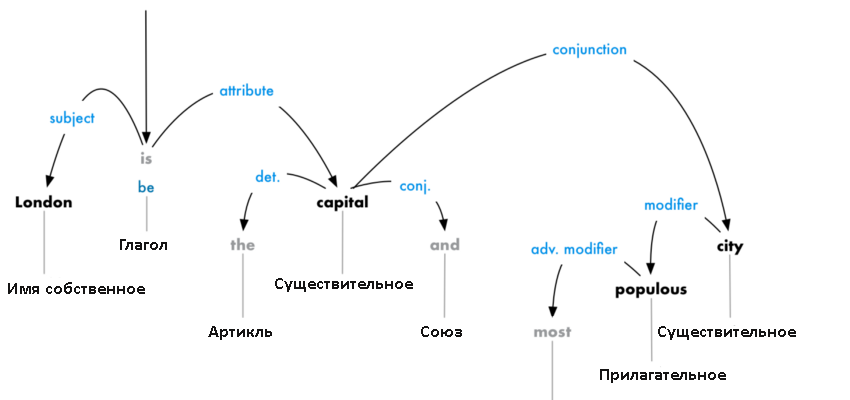

Первый шаг в предобработке – это токенизация. Это процесс разделения текста на более мелкие единицы‚ называемые токенами. Токены могут быть словами‚ символами‚ подсловами или даже предложениями. Мы используем различные подходы к токенизации в зависимости от задачи. Для большинства языков‚ включая русский‚ это означает разделение по словам и пунктуации.

Библиотеки‚ такие как NLTK (Natural Language Toolkit) и spaCy‚ предоставляют нам мощные инструменты для токенизации. NLTK предлагает функции для токенизации по словам (word_tokenize) и по предложениям (sent_tokenize)‚ которые хорошо справляются с большинством случаев. SpaCy же‚ будучи более комплексной библиотекой‚ включает токенизацию как часть своего конвейера обработки‚ автоматически учитывая многие особенности языка‚ что делает её очень удобной для нас.

Стемминг и Лемматизация: К Корню Проблемы

После токенизации мы часто сталкиваемся с проблемой: одно и то же слово может иметь множество форм (например‚ "бежать"‚ "бежит"‚ "бежал"). Для компьютера это разные слова‚ но для нас они несут одно и то же базовое значение. Здесь на помощь приходят стемминг и лемматизация.

Стемминг – это процесс отсечения окончаний и суффиксов слова‚ чтобы привести его к базовой‚ но не обязательно лингвистически корректной форме (например‚ "бежал" -> "бежа"). Мы часто используем стеммеры из NLTK‚ такие как Porter Stemmer или Snowball Stemmer‚ особенно для задач‚ где скорость важнее идеальной точности. Однако следует помнить‚ что стемминг может создавать несуществующие слова.

Лемматизация‚ в отличие от стемминга‚ более сложный процесс‚ который приводит слово к его базовой словарной форме (лемме)‚ используя морфологический анализ. Например‚ "бежал" -> "бежать". Мы предпочитаем лемматизацию‚ когда требуется высокая точность и сохранение лингвистической корректности. SpaCy и Stanza (особенно для языков с богатой морфологией‚ как русский) являются нашими основными инструментами для продвинутой лемматизации‚ поскольку они используют контекст для правильного определения леммы.

Регулярные Выражения и Очистка от Шума

Сырой текст редко бывает чистым. Он может содержать HTML-теги‚ специальные символы‚ URL-адреса‚ числа‚ эмодзи‚ сленг и прочий "мусор"‚ который не несет смысловой нагрузки для нашей задачи. Здесь неоценимую помощь нам оказывают регулярные выражения (библиотека re в Python). Мы используем их для:

- Удаления HTML-тегов и других структурных элементов.

- Извлечения или удаления URL-адресов.

- Очистки текста от пунктуации и специальных символов.

- Нормализации сленга или работы с эмодзи.

Мы также часто удаляем стоп-слова – это часто встречающиеся‚ но малоинформативные слова (например‚ "и"‚ "в"‚ "на"‚ "он"‚ "она"). NLTK предоставляет списки стоп-слов для многих языков‚ которые мы можем легко использовать и при необходимости расширять или модифицировать под конкретную задачу. Это помогает сократить размерность данных и сосредоточиться на наиболее значимых словах.

Понимание Смысла: Векторизация и Представление Текста

После того как текст очищен и подготовлен‚ возникает следующая фундаментальная проблема: как представить слова и документы в форме‚ которую могут понять математические модели и алгоритмы машинного обучения? Компьютеры работают с числами‚ а не с текстом. Поэтому нам необходимо преобразовать текстовые данные в числовые векторы. Этот процесс называется векторизацией текста.

Мы прошли долгий путь от простых методов до очень сложных‚ контекстно-зависимых представлений. Каждый метод имеет свои преимущества и недостатки‚ и выбор зависит от конкретной задачи и объема доступных данных. Мы рассмотрим наиболее популярные и эффективные подходы‚ которые мы активно используем в нашей работе.

Классические Методы: CountVectorizer и TF-IDF

Одни из самых простых и широко используемых методов векторизации – это CountVectorizer и TfidfVectorizer из библиотеки Scikit-learn. Они основаны на частотности слов:

- CountVectorizer: Создает матрицу‚ где каждая строка представляет документ‚ а каждый столбец – слово из всего корпуса. Значением в ячейке является количество вхождений слова в данный документ. Это простой‚ но эффективный метод для задач‚ где важна абсолютная частота слова.

- TfidfVectorizer (Term Frequency-Inverse Document Frequency): Это более продвинутый подход. Он не только учитывает‚ как часто слово встречается в документе (TF)‚ но и насколько оно уникально для всего корпуса документов (IDF). Слова‚ которые встречаются часто во многих документах (например‚ стоп-слова)‚ получают низкий вес‚ тогда как слова‚ уникальные для конкретного документа‚ получают высокий вес. Мы часто используем TF-IDF для задач классификации и извлечения ключевых слов‚ поскольку он хорошо отражает важность слова в контексте документа и корпуса.

Мы также часто работаем с n-граммами – последовательностями из N слов (например‚ биграммы "очень хорошо"‚ триграммы "крайне не доволен"). CountVectorizer и TfidfVectorizer позволяют легко включать n-граммы в процесс векторизации‚ что помогает уловить более сложный контекст и фразеологизмы.

Word Embeddings: Word2Vec‚ GloVe и FastText

Классические методы‚ такие как TF-IDF‚ имеют один существенный недостаток: они не улавливают семантические отношения между словами. Слова "король" и "царь" будут для них совершенно разными‚ хотя с человеческой точки зрения они очень близки. Здесь на сцену выходят Word Embeddings – плотные векторные представления слов‚ которые кодируют их семантическое значение.

Мы активно используем библиотеку Gensim для работы с моделями Word2Vec и GloVe:

- Word2Vec: Разработан Google‚ позволяет обучать векторы слов таким образом‚ чтобы слова с похожим значением имели близкие векторные представления. Мы можем обучать свои модели Word2Vec на наших данных или использовать предобученные модели.

- GloVe (Global Vectors for Word Representation): Разработан в Стэнфорде‚ также создает векторные представления слов‚ но с использованием глобальной статистики совместной встречаемости слов.

Оба метода позволяют нам выполнять интересные операции‚ например‚ "король ⏤ мужчина + женщина = королева" в векторном пространстве. Для нас это означает возможность создания систем‚ которые понимают нюансы языка.

FastText‚ разработанный Facebook‚ является еще одним мощным инструментом‚ который мы применяем‚ особенно когда имеем дело с редкими словами или языками с богатой морфологией. FastText представляет слова как суммы векторов их n-грам символов‚ что позволяет ему генерировать хорошие векторы для слов‚ которые он никогда не видел во время обучения‚ и лучше справляться с опечатками.

Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

Если Word Embeddings дают нам векторы для отдельных слов‚ то для многих задач нам нужны векторы для целых предложений или документов. Здесь мы используем:

- Doc2Vec (из Gensim): Расширение Word2Vec‚ которое позволяет генерировать векторы для целых документов. Это очень полезно для задач‚ таких как поиск схожих документов или кластеризация текстов.

- Sentence Transformers: Это относительно новая и очень мощная библиотека‚ которая позволяет нам получать высококачественные векторные представления предложений и даже целых параграфов. Она основана на архитектурах трансформеров и дает значительно лучшие результаты по сравнению с Doc2Vec для многих задач‚ особенно когда нам нужно уловить тонкие семантические различия между предложениями. Мы используем её для поиска семантически похожих предложений‚ суммаризации и QA-систем.

Извлечение Информации: NER‚ Тематическое Моделирование и Ключевые Фразы

После того как текст представлен в числовом виде‚ мы можем начать извлекать из него ценную информацию. Это одна из самых востребованных задач в NLP‚ позволяющая нам превращать неструктурированный текст в структурированные данные. Мы используем различные подходы для разных типов информации‚ от конкретных сущностей до абстрактных тем.

«Язык – это дорожная карта культуры. Он говорит вам‚ откуда пришли его люди и куда они идут.»

— Рита Мэй Браун

Эта цитата прекрасно отражает нашу задачу: мы не просто обрабатываем слова‚ мы пытаемся понять культуру‚ контекст и намерения‚ скрытые за языком. И современные NLP-инструменты дают нам возможность заглянуть в эту "дорожную карту".

Распознавание Именованных Сущностей (NER) с spaCy и Flair

Распознавание Именованных Сущностей (NER) – это задача идентификации и классификации именованных сущностей в тексте‚ таких как имена людей‚ организаций‚ географические названия‚ даты и т.д. Это крайне важно для многих приложений‚ от информационного поиска до автоматического заполнения баз данных.

Мы активно используем spaCy для быстрого и эффективного NER. SpaCy поставляется с предобученными моделями для различных языков‚ которые отлично справляются с большинством стандартных сущностей. Его конвейер обработки очень быстрый‚ что делает его идеальным для обработки больших объемов текста.

Для более сложных задач или языков‚ где стандартные модели могут быть менее точными‚ а также для получения более современных результатов‚ мы обращаемся к библиотеке Flair. Flair предлагает state-of-the-art модели для NER‚ основанные на глубоком обучении и контекстных встраиваниях‚ которые часто дают более высокую точность‚ особенно при работе с редкими сущностями или специфическими доменами. Мы также используем CRF (Conditional Random Fields) для распознавания сущностей‚ особенно когда требуется более тонкий контроль над признаками или когда данные для обучения ограничены‚ хотя трансформеры постепенно вытесняют этот подход.

Оценка качества NER-моделей является критически важной. Мы используем стандартные метрики‚ такие как F1-score‚ Precision и Recall‚ чтобы понять‚ насколько хорошо наша модель справляется с идентификацией и классификацией сущностей. Это помогает нам итеративно улучшать наши модели.

Тематическое Моделирование: LDA‚ LSI и NMF с Gensim

Представьте‚ что у вас есть тысячи документов‚ и вы хотите понять‚ о каких основных темах они говорят‚ не читая каждый из них. Здесь на помощь приходит тематическое моделирование – набор алгоритмов‚ которые позволяют нам автоматически обнаруживать скрытые "темы" в коллекции текстов. Каждый документ затем представляется как смесь этих тем.

Наша основная библиотека для тематического моделирования – Gensim. Мы используем следующие модели:

- LDA (Latent Dirichlet Allocation): Одна из самых популярных вероятностных моделей‚ которая предполагает‚ что каждый документ является комбинацией нескольких тем‚ а каждая тема – комбинацией слов. LDA отлично подходит для выявления скрытых тем в больших корпусах.

- LSI (Latent Semantic Indexing): Более старый‚ но все еще полезный метод‚ основанный на сингулярном разложении матрицы термов-документов. Он хорошо работает для уменьшения размерности и выявления основных семантических компонентов.

- NMF (Non-negative Matrix Factorization): Еще один мощный метод‚ часто сравниваемый с LDA. Он хорошо подходит для разреженных данных и может давать более интерпретируемые темы в некоторых случаях.

Мы регулярно проводим сравнение моделей тематического моделирования (LDA vs NMF)‚ чтобы выбрать наилучший подход для конкретной задачи‚ анализируя как качество тем‚ так и их интерпретируемость. Это позволяет нам эффективно анализировать тексты отзывов клиентов‚ новостные статьи или даже юридические документы для выявления скрытых тем и тенденций.

Извлечение Ключевых Фраз и Суммаризация

Помимо тем‚ нам часто нужно выделить наиболее важные слова или фразы из текста. Для этого мы используем:

- RAKE (Rapid Automatic Keyword Extraction): Простой‚ но эффективный алгоритм для извлечения ключевых слов на основе частотности и ко-одиночеств слов.

- TextRank (из библиотеки TextRank или реализованный вручную): Алгоритм‚ основанный на PageRank‚ который мы применяем для извлечения ключевых предложений или фраз. Он хорошо подходит для задач суммаризации текста‚ когда нам нужно получить экстрактивную (извлекающую существующие предложения) суммаризацию.

Для суммаризации текста мы различаем два основных подхода:

- Экстрактивная суммаризация: Выбирает наиболее важные предложения из исходного текста и объединяет их в краткое изложение. Здесь TextRank – наш хороший друг.

- Абстрактивная суммаризация: Генерирует новые предложения‚ которые передают суть исходного текста‚ используя модели глубокого обучения (например‚ на основе трансформеров). Это более сложная задача‚ но она дает более естественные и связные результаты. Мы используем Transformer-модели из Hugging Face для этой цели.

Мы также используем анализ частотности слов и n-грамм для извлечения ключевых фраз‚ особенно когда нужно понять‚ какие слова или сочетания слов наиболее характерны для данного корпуса текстов. Это просто‚ но часто очень эффективно.

Анализ Тональности и Эмоций: За Гранью Простого "Да/Нет"

В современном мире‚ где каждый оставляет отзывы‚ комментарии и сообщения‚ понимание эмоционального окраса текста становится критически важным. Анализ тональности (Sentiment Analysis) позволяет нам определить‚ является ли текст позитивным‚ негативным или нейтральным. Но мы идем дальше‚ стремясь понять не только общий тон‚ но и конкретные эмоции‚ сарказм и даже авторский почерк.

Наш опыт показывает‚ что простой анализ тональности уже приносит огромную пользу‚ но настоящая ценность заключается в тонкой настройке и учете специфики домена. Мы анализируем тональность сообщений в социальных сетях (Twitter/Reddit)‚ отзывы о продуктах‚ финансовых новостях и даже политических постах‚ каждый раз адаптируя наши модели под конкретные особенности языка и контекста.

Инструменты для Анализа Тональности: VADER и TextBlob

Для быстрого и эффективного анализа тональности мы используем несколько инструментов:

- VADER (Valence Aware Dictionary and sEntiment Reasoner): Это правило-ориентированный анализатор тональности‚ который специально обучен для текста из социальных сетей. Он очень хорош для быстрого определения тональности без необходимости обучения на своих данных. Мы часто используем его для анализа тональности в социальных медиа‚ где язык часто неформален и полон сокращений.

- TextBlob: Это простая‚ но мощная библиотека для NLP‚ которая предоставляет готовые функции для анализа тональности. Она удобна для быстрого прототипирования и простых задач. Однако‚ мы понимаем её ограничения и используем её в качестве отправной точки‚ переходя к более сложным моделям при необходимости.

Когда речь заходит о более глубоком понимании эмоций или выявлении сарказма‚ мы переходим к моделям‚ обученным на больших корпусах данных с размеченными эмоциями‚ часто используя глубокое обучение и трансформерные архитектуры. Это позволяет нам не просто определить "позитив"‚ но и различить "радость"‚ "гнев"‚ "печаль" и другие нюансы.

Нюансы Анализа Тональности: Сарказм‚ Сленг и Контекст

Мы хорошо знаем‚ что анализ тональности не всегда прямолинеен. Сарказм‚ ирония‚ двойные отрицания – все это может сбить с толку даже самые продвинутые модели. Наш подход включает в себя:

- Работа со сленгом и эмодзи: Современные тексты‚ особенно в социальных сетях‚ изобилуют сленгом и эмодзи. Мы разрабатываем инструменты для нормализации сленга и учитываем значение эмодзи при анализе тональности‚ чтобы модель не теряла ценную информацию.

- Контекстное понимание: Для анализа тональности с учетом сарказма или тонких нюансов мы часто используем контекстные встраивания и трансформерные модели. Они способны улавливать более сложные зависимости в тексте‚ которые указывают на сарказм или скрытые эмоции.

- Доменно-специфичные модели: Тональность в финансовых новостях может отличаться от тональности в отзывах о фильмах. Мы обучаем или дообучаем (fine-tuning) модели на специфических для домена данных‚ чтобы повысить их точность и релевантность.

Это позволяет нам получать более надежные результаты и применять анализ тональности в самых разных областях‚ от маркетинга до мониторинга репутации.

Классификация и Категоризация Текстов: Автоматизация Процессов

Одной из самых распространенных и полезных задач в NLP является классификация текстов. Это процесс присвоения тексту одной или нескольких предопределенных категорий или меток. Будь то спам-фильтр‚ категоризация новостей‚ маршрутизация клиентских запросов или анализ отзывов по категориям‚ классификация помогает нам автоматизировать рутинные задачи и структурировать информацию.

Мы использовали и продолжаем использовать широкий спектр методов‚ от классических алгоритмов машинного обучения до самых современных нейронных сетей‚ чтобы находить оптимальное решение для каждой конкретной задачи.

Классические Алгоритмы Машинного Обучения для NLP

Для многих задач классификации текста классические алгоритмы машинного обучения из Scikit-learn по-прежнему остаются отличным выбором‚ особенно когда данных не так много или требуется высокая интерпретируемость модели. Мы часто применяем:

- Наивный Байесовский классификатор (Naive Bayes): Простой‚ но удивительно эффективный алгоритм‚ основанный на теореме Байеса. Он хорошо работает для классификации текста‚ особенно со спам-фильтрами.

- Метод опорных векторов (SVM ⎯ Support Vector Machine): Мощный алгоритм‚ который ищет оптимальную гиперплоскость для разделения классов. SVM часто демонстрирует высокую точность в задачах классификации текста.

- Логистическая регрессия: Несмотря на название‚ это алгоритм классификации‚ который предсказывает вероятность принадлежности объекта к определенному классу.

Для этих алгоритмов мы используем векторизаторы‚ такие как TF-IDF или CountVectorizer‚ для преобразования текста в числовые признаки. Мы всегда проводим сравнение методов машинного обучения для NLP‚ чтобы выбрать наиболее подходящий‚ основываясь на таких метриках‚ как точность‚ полнота и F1-мера.

Глубокое Обучение и Трансформеры для Классификации

Когда требуется более высокая точность‚ обработка сложного контекста или работа с очень большими объемами данных‚ мы обращаемся к глубокому обучению. Мы применяем Keras/TensorFlow и PyTorch для создания нейронных сетей‚ таких как LSTM-сети‚ которые хорошо справляются с последовательными данными‚ такими как текст.

Однако настоящий прорыв для нас произошел с появлением трансформеров. Мы активно используем модели‚ такие как BERT (Bidirectional Encoder Representations from Transformers)‚ для задач классификации. BERT и его аналоги способны понимать глубокий контекст слов в предложении‚ что приводит к значительному повышению точности по сравнению с традиционными методами или даже LSTM. Мы часто проводим тонкую настройку (Fine-tuning) предварительно обученных трансформерных моделей на наших специфических данных‚ что позволяет достигать state-of-the-art результатов даже с относительно небольшими наборами данных для обучения.

Наш опыт показывает‚ что трансформеры – это мощный инструмент для автоматической категоризации статей‚ новостей и других текстовых материалов‚ позволяя нам создавать системы‚ которые с высокой точностью определяют тему или жанр документа.

Продвинутые Техники: Трансформеры‚ QA-системы и Генерация Текста

Если предыдущие разделы были посвящены анализу и пониманию существующего текста‚ то здесь мы переходим к более сложным и захватывающим задачам: созданию интеллектуальных систем‚ которые могут генерировать текст‚ отвечать на вопросы и даже переводить языки. Это вершина современного NLP‚ и она во многом стала возможной благодаря революции трансформерных архитектур.

Мы видим‚ как эти технологии меняют правила игры во многих отраслях‚ от создания контента до автоматизации обслуживания клиентов‚ и мы активно экспериментируем с ними‚ чтобы расширить границы возможного.

Трансформеры (Hugging Face): Новый Уровень NLP

Библиотека Hugging Face Transformers стала для нас незаменимым инструментом. Она предоставляет доступ к сотням предварительно обученных моделей‚ таких как BERT‚ GPT‚ T5‚ RoBERTa и многим другим‚ которые можно использовать для самых сложных задач NLP. Эти модели основаны на архитектуре трансформеров‚ которая позволяет им эффективно обрабатывать длинные последовательности текста и улавливать дальние зависимости между словами.

Мы используем трансформеры для:

- Сложных задач NER: Дообучая модели на специфических данных‚ мы можем распознавать очень специфические сущности.

- Классификации текста: Достигая высокой точности даже в тонких нюансах.

- Анализа тональности: С учетом контекста и сарказма.

- Суммаризации текста: Как экстрактивной‚ так и абстрактивной‚ создавая краткие‚ но информативные изложения.

- Вопросно-ответных систем (QA): Позволяя моделям находить точные ответы на вопросы в больших массивах текста.

Возможность тонкой настройки (Fine-tuning) этих моделей на наших собственных данных – это то‚ что позволяет нам достигать впечатляющих результатов даже при ограниченных ресурсах для обучения с нуля.

Разработка Систем Вопросно-Ответных Систем (QA)

Представьте систему‚ которая может прочитать большой документ и ответить на любой ваш вопрос‚ основываясь на его содержании. Это и есть вопросно-ответные системы (QA). Мы разрабатываем такие системы‚ используя трансформерные модели. Они могут быть двух типов:

- Экстрактивные QA-системы: Находят точный фрагмент текста в документе‚ который содержит ответ.

- Абстрактивные QA-системы: Генерируют новый ответ на основе информации из документа‚ не просто копируя фрагмент текста.

Для нас это открывает огромные возможности в автоматизации поддержки клиентов‚ поиске информации в базах знаний и даже в образовании. Мы используем PyTorch/TensorFlow для создания и обучения этих нейросетей NLP.

Генерация Текста: От Чат-ботов до Креативного Письма

Способность машины генерировать осмысленный и связный текст – это‚ пожалуй‚ одна из самых впечатляющих возможностей NLP. Мы используем Transformer-модели для генерации текста (GPT) для широкого круга задач:

- Разработка чат-ботов на Python (Rasa framework): Создание интерактивных диалоговых систем‚ которые могут вести естественный разговор с пользователем.

- Автоматическое создание тегов и заголовков для статей.

- Генерация диалогов для игровых персонажей или виртуальных ассистентов.

- Даже для более креативных задач‚ таких как генерация кода или написание черновиков статей.

Мы также активно изучаем и применяем разработку систем машинного перевода на Python‚ используя трансформерные архитектуры‚ которые обеспечивают значительно более высокое качество перевода по сравнению с предыдущими методами‚ особенно для сложных языков и специализированных текстов.

Работа с Данными: От Веб-Скрейпинга до Больших Массивов

Любой проект NLP начинается с данных. Без качественных и достаточных объемов текстовых данных наши модели не смогут эффективно обучаться. Поэтому для нас крайне важно уметь собирать‚ очищать и подготавливать данные. Мы сталкивались с самыми разными источниками данных и разработали ряд подходов для их эффективной обработки.

Сбор Данных: Веб-Скрейпинг и Извлечение из Документов

Часто нужные нам текстовые данные находятся в интернете или заперты внутри различных форматов документов. Для их извлечения мы используем:

- Библиотека Beautiful Soup для веб-скрейпинга текста: Это наш основной инструмент для извлечения текстового контента из HTML-страниц. Мы умело парсим веб-страницы‚ чтобы получить чистый текст‚ удаляя HTML-теги и другие элементы разметки.

- Использование PyMuPDF для извлечения текста из PDF: PDF-документы – это распространенный источник информации‚ особенно в корпоративной среде. PyMuPDF позволяет нам эффективно извлекать текст из этих файлов‚ что является критически важным для анализа юридических документов‚ научных статей или финансовых отчетов.

Мы также работаем с анализом метаданных текста‚ таких как автор‚ дата публикации‚ источник‚ что помогает нам обогащать наши текстовые данные и добавлять контекст для последующего анализа.

Обработка Неструктурированного Текста: Очистка и Нормализация

Собранные данные редко бывают идеальными. Они могут содержать ошибки‚ неполную информацию‚ шум и несоответствия. На этом этапе мы фокусируемся на очистке данных:

- Удаление стоп-слов и пунктуации: Как мы уже упоминали‚ это базовые шаги для уменьшения шума.

- Нормализация сленга и эмодзи: Приведение нестандартных выражений к общепринятой форме.

- Обработка неполных и ошибочных данных: Разработка стратегий для заполнения пропусков или коррекции ошибок.

- Разработка инструмента для исправления орфографии: Использование библиотек типа Jellyfish для сравнения строк и выявления схожих написаний‚ что помогает в стандартизации.

Для более продвинутых задач мы используем библиотеку Textacy‚ которая предоставляет широкий набор функций для обработки текста‚ от извлечения n-грамм до синтаксического парсинга‚ что значительно упрощает нам жизнь при работе со сложными текстовыми корпусами.

Обработка Больших Текстовых Массивов (Big Data NLP)

В современном мире объемы текстовых данных могут быть колоссальными. Работа с такими "большими текстовыми массивами" требует специальных подходов и оптимизаций. Мы применяем различные стратегии:

- Оптимизация производительности: Использование эффективных структур данных и алгоритмов.

- Параллельная обработка: Разделение задачи на более мелкие части и их обработка на нескольких ядрах или машинах.

- Использование GPU-ускорения: Для обучения больших нейронных сетей и трансформерных моделей это критически важно.

- Обработка текста в режиме реального времени (Streaming NLP): Для задач‚ где данные поступают непрерывным потоком‚ например‚ анализ сообщений в социальных сетях.

Библиотека Gensim‚ например‚ хорошо оптимизирована для работы с большими корпусами при обучении моделей Word2Vec или LDA‚ что делает её нашим выбором для таких задач.

Специализированные Задачи и Нишевые Применения

Мир NLP огромен и разнообразен. Помимо общих задач‚ существуют и очень специфические области применения‚ которые требуют уникальных подходов и инструментов. Мы постоянно исследуем эти ниши‚ чтобы расширить наши возможности и решать нестандартные задачи. От работы с многоязычными текстами до анализа юридических документов – каждый новый вызов приносит нам ценный опыт.

Многоязычная Обработка Текстов

Глобализация требует от нас способности работать с текстами на разных языках. Английский – не единственный язык интернета‚ и мы часто сталкиваемся с необходимостью обрабатывать многоязычные текстовые корпусы. Для этого мы используем:

- Библиотека Polyglot: Отличный инструмент для мультиязычного NLP‚ поддерживающий широкий спектр языков для токенизации‚ NER‚ анализа тональности и определения языка. Мы используем её для анализа редких языков‚ для которых стандартные библиотеки могут не иметь полной поддержки.

- Stanza: Разработанный Stanford‚ Stanza – это мощный инструмент для языков с богатой морфологией (как русский‚ арабский или финский). Он предоставляет высококачественные модели для токенизации‚ POS-теггинга‚ лемматизации и синтаксического парсинга‚ что делает его незаменимым для нас при работе с такими языками.

- Определение языка (TextBlob‚ Polyglot): Перед тем как обрабатывать текст‚ нам часто нужно определить‚ на каком языке он написан‚ особенно если данные поступают из разных источников.

Разработка систем машинного перевода‚ о которой мы говорили ранее‚ также является ключевым компонентом нашей работы с многоязычными данными‚ позволяя нам преодолевать языковые барьеры.

NLP в Специфических Доменах

Каждый домен имеет свою специфику‚ свой жаргон‚ свои термины. Мы адаптируем наши NLP-решения для таких областей‚ как:

- Анализ юридических документов: Извлечение ключевых фактов‚ дат‚ имен‚ сумм из контрактов и судебных решений с использованием BERT для NER.

- Анализ текста в медицинских записях: Извлечение информации о заболеваниях‚ симптомах‚ лекарствах‚ процедурах.

- Анализ финансовых новостей: Для прогнозирования рыночных движений на основе тональности и ключевых событий.

Для таких задач мы часто создаем словари и тезаурусы специфических терминов‚ а также разрабатываем инструменты для автоматической разметки данных‚ чтобы обучать модели на высококачественных‚ доменно-специфичных данных.

Дополнительные Инструменты и Приложения

Мы также используем и разрабатываем множество других инструментов и систем:

- Разработка систем обнаружения плагиата: Используя библиотеки типа TextDistance для измерения сходства между документами.

- Анализ стилистики текстов (авторский почерк): Определение автора на основе уникальных языковых паттернов.

- Разработка инструментов для проверки грамматики и синтаксиса: На основе синтаксического парсинга с spaCy.

- Построение языковых моделей на основе N-грамм: Для предсказания следующего слова или оценки вероятности предложения.

- Разработка системы для создания FAQ на основе документов: Автоматическое формирование ответов на часто задаваемые вопросы.

- Анализ лог-файлов: Извлечение информации об ошибках‚ событиях‚ пользователях.

- Разработка инструмента для проверки фактов (Fact-Checking): Сверка утверждений с известными фактами.

Наш подход всегда заключается в выборе наиболее подходящего инструмента для конкретной задачи‚ а при его отсутствии – в разработке собственного решения‚ что часто происходит при работе с узкоспециализированными текстами или редкими языками.

После того как мы обработали текст‚ извлекли информацию и обучили модели‚ нам необходимо понять‚ насколько хорошо они работают. Визуализация помогает нам наглядно представить результаты‚ а оценка качества – количественно измерить эффективность наших решений. Мы верим‚ что без этих двух компонентов невозможно создать по-настоящему полезные и надежные NLP-системы.

Визуализация Текстовых Данных

Визуализация играет ключевую роль в понимании больших объемов текстовых данных. Мы используем несколько подходов:

- Облака слов (Word Clouds): Простой‚ но эффективный способ показать наиболее часто встречающиеся слова в корпусе текста. Это помогает нам быстро получить представление о содержании документа или коллекции.

- Тепловые карты (Heatmaps): Для визуализации матриц сходства между документами‚ темами или словами. Это полезно для понимания кластеров и взаимосвязей.

- Распределения частотности слов и n-грамм: Для анализа лексического богатства‚ частотности редких слов и их значения.

- Визуализация тематических моделей: Например‚ с помощью PyLDAvis для LDA‚ чтобы интерактивно исследовать выявленные темы и их связь со словами.

Мы также используем библиотеку Sweetviz для анализа текстовых данных‚ которая может генерировать красивые и информативные отчеты с визуализациями.

Метрики Оценки Качества Моделей NLP

Для оценки производительности наших моделей мы используем стандартные метрики из области машинного обучения. Это позволяет нам не только сравнивать различные подходы‚ но и отслеживать прогресс в процессе разработки.

Мы регулярно проводим:

- Оценку качества NER-моделей (F1-score‚ Precision‚ Recall): Эти метрики показывают‚ насколько точно и полно модель идентифицирует именованные сущности.

- Оценку качества классификации текстов: Аналогично‚ Precision‚ Recall‚ F1-score и Accuracy являются нашими основными показателями.

- Сравнение эффективности различных токенизаторов‚ лемматизаторов и стеммеров: На основе ручной разметки или заранее определенных золотых стандартов.

- Сравнение моделей Word2Vec (Skip-gram vs CBOW)‚ LDA vs NMF‚ TF-IDF vs Word2Vec: Чтобы выбрать оптимальный метод для конкретной задачи.

- Оценка качества суммаризации: Используя метрики‚ такие как ROUGE‚ которые сравнивают сгенерированный текст с эталонным.

Все эти метрики помогают нам принимать обоснованные решения о том‚ какая модель или метод лучше всего подходит для решения поставленной задачи‚ и где требуется дополнительная работа или улучшение.

Мы прошли долгий путь в нашем обзоре мира NLP с Python. От основ предобработки текста до продвинутых трансформерных архитектур‚ от анализа тональности до генерации диалогов – мы увидели‚ как многого можно достичь с помощью этих мощных инструментов. Каждый шаг в этом путешествии‚ каждый успешно реализованный проект‚ каждый новый инсайт делает нас еще более увлеченными этой областью.

Будущее NLP обещает быть еще более захватывающим. Мы наблюдаем за развитием мультимодальных моделей‚ которые объединяют текст с изображениями и видео‚ за созданием еще более мощных и эффективных языковых моделей‚ способных к рассуждению и пониманию на уровне‚ приближающемся к человеческому. Мы также видим растущий интерес к этическим аспектам NLP‚ таким как предвзятость моделей и конфиденциальность данных‚ что является важным направлением для всех нас.

Мы продолжим исследовать‚ учиться и делиться нашими открытиями с вами. Ведь именно в постоянном обучении‚ экспериментировании и обмене знаниями кроется истинная сила сообщества. Мы призываем вас не бояться погружаться в эти темы‚ пробовать новые библиотеки‚ строить свои собственные проекты. Возможности NLP безграничны‚ и каждый из нас может внести свой вклад в развитие этой удивительной области. До встречи в следующих статьях!

Подробнее

| Токенизация NLTK | NER spaCy | LDA Gensim | Word2Vec Gensim | Анализ тональности VADER |

| TfidfVectorizer Scikit-learn | Лемматизация Stanza | Трансформеры Hugging Face | Суммаризация TextRank | Веб-скрейпинг Beautiful Soup |