- Разгадывая Язык Цифр: Наш Глубокий Дайв в Мир NLP с Python

- Фундаментальные Строительные Блоки NLP: С Чего Мы Начинаем

- Первые Шаги: Токенизация и Стемминг с NLTK

- Лемматизация: За Гранью Простой Формы

- Регулярные Выражения: Точность в Каждой Букве

- Очистка Данных: Подготовка Текста к Анализу

- Извлечение Смысла: Сущности, Темы и Эмоции

- Распознавание Именованных Сущностей (NER): spaCy и Flair

- Тематическое Моделирование: От LDA к NMF с Gensim

- Анализ Тональности: Понимание Эмоций с VADER и TextBlob

- Извлечение Ключевых Фраз и Суммаризация: От RAKE до Трансформеров

- Векторизация: Превращение Слов в Числа

- От CountVectorizer к TF-IDF: Первые Представления

- Word Embeddings: Word2Vec, GloVe, FastText с Gensim

- Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

- Контекстные Встраивания и Трансформеры: Революция в NLP

- Продвинутые Приложения и Специализированные Задачи

- Классификация Текстов: Scikit-learn и Глубокое Обучение с PyTorch/TensorFlow

- Разработка Чат-ботов и QA-систем: От Rasa до Генеративных Моделей

- Работа с Многоязычными Данными: Polyglot, Stanza, Специфика

- Веб-Скрейпинг и Извлечение из PDF: Beautiful Soup, PyMuPDF

- Анализ Юридических, Финансовых и Медицинских Документов

- Обнаружение Плагиата и Сравнение Строк с Jellyfish и Textdistance

- Визуализация Текстовых Данных: От Облаков Слов до Тепловых Карт

- Будущее NLP: Вызовы и Перспективы

- Работа с Неполными и Ошибочными Данными

- Анализ Стилистики, Эмодзи и Сленга

- GPU-ускорение и Big Data NLP

Разгадывая Язык Цифр: Наш Глубокий Дайв в Мир NLP с Python

Привет, друзья-энтузиасты технологий и любознательные умы! Мы, как всегда, рады приветствовать вас на страницах нашего блога, где делимся личным опытом и глубокими погружениями в самые захватывающие уголки IT․ Сегодня мы отправляемся в увлекательное путешествие по миру Обработки Естественного Языка (NLP) — области, которая позволяет компьютерам не просто видеть текст, но и понимать его, извлекать смысл, эмоции и даже генерировать новые, осмысленные фразы․ Представьте себе: машины, которые читают, анализируют и общаются почти как мы с вами!

За последние несколько лет мы стали свидетелями невероятного прорыва в NLP․ То, что раньше казалось научной фантастикой, теперь стало реальностью, доступной каждому разработчику благодаря мощным библиотекам Python․ Мы пройдемся по всему стеку — от самых базовых операций, таких как токенизация и стемминг, до продвинутых архитектур трансформеров, которые сегодня лежат в основе самых умных чат-ботов и переводчиков․ Приготовьтесь, ведь в этой статье мы не просто расскажем о концепциях, но и покажем, как мы используем их на практике, чтобы наши проекты "заговорили"!

Фундаментальные Строительные Блоки NLP: С Чего Мы Начинаем

Прежде чем погружаться в сложный анализ и машинное обучение, нам необходимо освоить базовые, но крайне важные операции, которые формируют основу любого NLP-проекта․ Эти шаги, хоть и кажутся простыми, являются краеугольным камнем для последующих, более сложных алгоритмов․ Мы всегда начинаем с них, чтобы убедиться, что данные готовы к глубокому анализу․

Мы узнали на собственном опыте, что качественная предобработка текста — это 80% успеха․ Без нее даже самые продвинутые модели будут давать сомнительные результаты․ Поэтому давайте рассмотрим, как мы подготавливаем наш текстовый "сырой материал" к дальнейшей обработке, используя проверенные временем и современные инструменты Python․

Первые Шаги: Токенизация и Стемминг с NLTK

Когда мы получаем текст, он представляет собой непрерывную последовательность символов․ Для компьютера это просто набор букв․ Чтобы начать его анализировать, нам нужно разбить его на более мелкие, осмысленные единицы․ Именно здесь на сцену выходят токенизация и стемминг – два фундаментальных процесса, с которых мы неизменно начинаем нашу работу․

Токенизация – это процесс разделения текста на отдельные слова (токены) или фразы․ Например, предложение "Мы любим NLP!" может быть токенизировано в ["Мы", "любим", "NLP", "!"]․ Мы часто используем библиотеку NLTK (Natural Language Toolkit) для этих целей, поскольку она предлагает множество готовых токенизаторов, подходящих для разных языков и задач․ NLTK – это наша "рабочая лошадка" для базовых операций, и она доказала свою надежность на протяжении многих лет․

После токенизации слова все еще могут иметь разные формы: "бежать", "бежит", "бегал"․ Для многих задач анализа нам нужно привести их к одной базовой форме․ Здесь приходит на помощь стемминг – процесс отсечения суффиксов и префиксов, чтобы получить "корень" слова, его стем․ Например, "running", "runs", "ran" могут быть приведены к "run"․ Мы используем стеммеры NLTK, такие как PorterStemmer или SnowballStemmer, которые отлично справляются с этой задачей для английского и многих других языков․

Лемматизация: За Гранью Простой Формы

Хотя стемминг и полезен, он иногда может быть слишком агрессивным, отсекая части слов, которые важны для их значения, и создавая "корни", которые не являются реальными словами․ Например, "beautiful" может стать "beauti", что не очень информативно․ Именно поэтому мы часто переходим к более продвинутому процессу, лемматизации․

В отличие от стемминга, лемматизация направлена на приведение слова к его словарной (базовой) форме, называемой леммой․ Это означает, что "бежать", "бежит", "бегал" будут приведены к "бежать", а "лучший" к "хороший"․ Лемматизация использует словарь и морфологический анализ, что делает ее гораздо более точной и лингвистически обоснованной․ Для лемматизации мы обычно обращаемся к библиотекам, таким как NLTK (с WordNetLemmatizer) или spaCy, которая предлагает высококачественные модели для различных языков, включая русский, и обеспечивает более глубокий синтаксический анализ․ Мы видим, что лемматизация особенно критична для языков с богатой морфологией, где одно и то же слово может иметь десятки форм․

Регулярные Выражения: Точность в Каждой Букве

Предобработка текста — это не только разбиение слов․ Это также очистка от "шума": лишних символов, HTML-тегов, URL-адресов, чисел, которые не несут смысловой нагрузки для нашей конкретной задачи․ Именно здесь мы активно используем регулярные выражения (regex), мощный инструмент для поиска и манипуляции строками․

С помощью модуля `re` в Python мы можем создавать паттерны для удаления всего, что нам не нужно․ Например, мы можем легко удалить все числа, если анализируем эмоциональный окрас текста и цифры лишь отвлекают․ Или же, если мы собираем данные из веба, регулярные выражения позволяют нам эффективно очищать текст от HTML-тегов, оставляя только чистое содержимое․ Мы ценим их за гибкость и точность, позволяющие нам создавать очень специфичные правила очистки, адаптированные под каждый наш проект․

Очистка Данных: Подготовка Текста к Анализу

Наш опыт показывает, что качество выходных данных напрямую зависит от качества входных․ Поэтому, помимо токенизации и лемматизации, мы уделяем огромное внимание всесторонней очистке текста․ Этот этап включает в себя несколько критически важных шагов, которые мы применяем почти в каждом проекте․

- Удаление HTML-тегов: Когда мы скрейпим данные с веб-страниц, текст часто содержит HTML-разметку․ Мы используем библиотеки вроде Beautiful Soup для парсинга HTML и извлечения чистого текста, а затем дочищаем остатки регулярными выражениями․

- Удаление пунктуации и специальных символов: Знаки препинания, скобки, кавычки и другие символы часто не несут смысловой нагрузки для задач анализа тональности или тематического моделирования․ Мы удаляем их или заменяем пробелами․

- Удаление стоп-слов: Такие слова, как "и", "в", "на", "он", "она" (stopwords) встречаются очень часто, но редко добавляют уникальную информацию о содержании текста․ Мы удаляем их, чтобы уменьшить размерность данных и сосредоточиться на более значимых словах․ NLTK предоставляет списки стоп-слов для многих языков․

- Приведение к нижнему регистру: Для обеспечения единообразия мы всегда приводим весь текст к нижнему регистру, чтобы "Слово" и "слово" воспринимались как один и тот же токен․

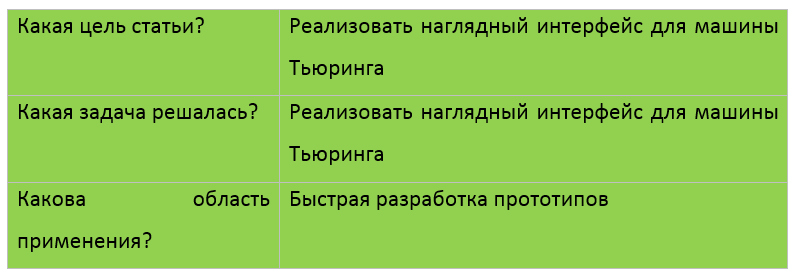

Мы видим, что этот комплексный подход к очистке данных значительно улучшает производительность наших моделей и точность анализа․ Вот как выглядит типичная таблица с этапами предобработки, которую мы используем для планирования:

| Этап Предобработки | Описание | Используемые Инструменты/Библиотеки | Пример (Исходный -> Обработанный) |

|---|---|---|---|

| Извлечение текста | Извлечение чистого текста из различных источников (веб, PDF)․ | Beautiful Soup, PyMuPDF | <p>Привет!</p> -> Привет! |

| Удаление HTML/URL | Очистка текста от HTML-тегов и веб-ссылок․ | re (регулярные выражения) | <a href="#">сайт</a> -> сайт |

| Токенизация | Разбиение текста на отдельные слова или фразы․ | NLTK (word_tokenize) | Привет, мир! -> ['Привет', ',', 'мир', '!'] |

| Приведение к нижнему регистру | Преобразование всех символов в нижний регистр․ | Python ․lower | Привет -> привет |

| Удаление пунктуации | Удаление знаков препинания․ | re, string․punctuation | привет, мир! -> привет мир |

| Удаление стоп-слов | Удаление часто встречающихся, но малоинформативных слов․ | NLTK (stopwords․words('russian')) | мы очень любим -> очень любим |

| Лемматизация/Стемминг | Приведение слов к их базовой форме․ | spaCy, NLTK (WordNetLemmatizer) | бегали -> бегать |

Извлечение Смысла: Сущности, Темы и Эмоции

Когда наш текст очищен и приведен в порядок, мы готовы перейти к более глубокому анализу․ На этом этапе мы стремимся не просто понять слова, но и извлечь из них более сложный, контекстный смысл: кто, что, где, когда, о чем идет речь и какие эмоции выражаются․ Это ключевые задачи, которые позволяют нам превращать необработанный текст в структурированную и полезную информацию․

Мы обнаружили, что эти методы являются основой для множества практических приложений, от автоматической категоризации документов до создания умных систем поддержки клиентов․ Давайте рассмотрим, как мы подходим к этим задачам, используя мощные инструменты Python․

Распознавание Именованных Сущностей (NER): spaCy и Flair

Одна из самых мощных задач в NLP — это Распознавание Именованных Сущностей (NER)․ NER позволяет нам автоматически идентифицировать и классифицировать именованные сущности в тексте, такие как имена людей (PERSON), организации (ORG), географические объекты (GPE), даты (DATE) и т․д․ Представьте, что вы читаете тысячи новостных статей, и вам нужно быстро узнать, о каких компаниях и людях идет речь․ NER делает это за вас!

Для NER мы активно используем библиотеку spaCy․ Она предлагает очень быстрые и точные предобученные модели для множества языков, которые легко интегрируются в наши пайплайны․ spaCy не только идентифицирует сущности, но и предоставляет их категории, что является огромным плюсом․ Помимо spaCy, мы также работаем с Flair – это современная библиотека, которая использует глубокие нейронные сети для state-of-the-art результатов в NER, особенно когда требуется высокая точность или работа с более сложными, контекстно-зависимыми сущностями․

Оценка качества NER-моделей (Precision, Recall, F1-score) – это отдельная важная задача․ Мы всегда тщательно измеряем эти метрики, чтобы убедиться, что наша модель не только находит большинство сущностей (Recall), но и делает это без ошибок (Precision), достигая хорошего баланса (F1-score)․ Ведь смысл NER в том, чтобы предоставить точную, а не просто обширную информацию․

Тематическое Моделирование: От LDA к NMF с Gensim

Представьте, что у нас есть огромная коллекция документов, например, статей, отзывов или научных работ․ Как понять, о каких основных темах идет речь в этой коллекции, не читая каждый документ вручную? Здесь на помощь приходит Тематическое Моделирование – это набор алгоритмов, которые позволяют нам автоматически обнаруживать абстрактные "темы", скрытые в текстовых данных․

Мы часто начинаем с LDA (Латентное размещение Дирихле), который является одним из самых популярных алгоритмов для тематического моделирования․ Он предполагает, что каждый документ представляет собой смесь нескольких тем, а каждая тема – это распределение слов․ Для работы с LDA мы используем библиотеку Gensim, которая оптимизирована для обработки больших текстовых корпусов и предоставляет эффективные реализации LDA и других алгоритмов․ Gensim – это наш швейцарский армейский нож для тематического моделирования и работы со встраиваниями слов․

Помимо LDA, мы также экспериментируем с NMF (Неотрицательная матричная факторизация)․ NMF, как и LDA, извлекает скрытые темы, но делает это несколько иначе, через разложение матрицы "документ-слово"․ Мы сравниваем эти модели, чтобы выбрать ту, которая лучше всего раскрывает суть данных для конкретной задачи․ Например, для некоторых типов данных NMF может давать более интерпретируемые темы, в то время как LDA лучше справляется с определенными статистическими свойствами текста․ Выбор между ними часто зависит от характера данных и наших целей․

Анализ Тональности: Понимание Эмоций с VADER и TextBlob

В современном мире, где социальные сети и отзывы клиентов играют огромную роль, понимание эмоционального окраса текста стало критически важным․ Анализ тональности (Sentiment Analysis) позволяет нам определить, является ли сообщение позитивным, негативным или нейтральным․ Это мощный инструмент для мониторинга бренда, анализа отзывов о продуктах и даже понимания общественных настроений․

Для быстрого и эффективного анализа тональности мы часто используем библиотеку VADER (Valence Aware Dictionary and sEntiment Reasoner)․ VADER уникален тем, что он настроен на работу с текстами из социальных сетей и хорошо справляется со сленгом, эмодзи и восклицательными знаками, которые сильно влияют на тональность․ Он выдает составной балл, показывающий общую полярность текста․ Для более простых задач и быстрого прототипирования мы также обращаемся к TextBlob, которая предоставляет интуитивно понятный API для определения тональности и других базовых NLP-операций․

Однако, мы знаем, что анализ тональности не всегда прост․ Сарказм, ирония, двойные отрицания – все это может сбить с толку даже продвинутые модели․ Мы всегда учитываем эти сложности, особенно при анализе сообщений в социальных сетях (Twitter, Reddit), где контекст и неявные значения играют огромную роль․ Для таких случаев мы используем более сложные модели, а иногда и ручную разметку для тонкой настройки наших алгоритмов․

"Язык — это дорожная карта культуры․ Он говорит вам, откуда пришли его люди и куда они идут․"

— Рита Мэй Браун

Извлечение Ключевых Фраз и Суммаризация: От RAKE до Трансформеров

В мире информационного перегруза способность быстро извлекать самую суть из длинных текстов бесценна․ Мы постоянно сталкиваемся с необходимостью быстрого понимания содержания документов, и здесь нам помогают два мощных инструмента: извлечение ключевых фраз и суммаризация текста․

Извлечение ключевых фраз позволяет нам определить наиболее важные слова и фразы, которые наилучшим образом описывают содержание документа․ Для этой задачи мы часто используем алгоритмы, такие как RAKE (Rapid Automatic Keyword Extraction), который достаточно прост в реализации, но при этом весьма эффективен․ RAKE анализирует частотность слов и их ко-о встречаемость, чтобы выделить наиболее релевантные термины․ Мы также экспериментируем с более продвинутыми методами, основанными на графовых алгоритмах, таких как TextRank, который может выявлять как ключевые слова, так и ключевые предложения․

Суммаризация текста идет еще дальше, создавая краткое изложение исходного документа․ Существует два основных подхода:

- Экстрактивная суммаризация: Мы выбираем наиболее важные предложения из оригинального текста и объединяем их․ Это как выделить маркером самые важные абзацы․ TextRank, упомянутый выше, может быть использован и для этой цели․

- Абстрактивная суммаризация: Это более сложный подход, при котором система генерирует совершенно новый текст, который передает основную идею исходного документа․ Это требует глубокого понимания контекста и способности к генерации естественного языка․ Здесь мы обращаемся к Трансформерам (Hugging Face), которые показали феноменальные результаты в этой области․ Мы используем предобученные модели, такие как BART или T5, и тонко настраиваем их под наши задачи․

Мы обнаружили, что трансформеры открыли новую эру в суммаризации, позволяя нам создавать гораздо более связные и осмысленные резюме, которые ранее были недостижимы․

Векторизация: Превращение Слов в Числа

Компьютеры не "понимают" слова в том смысле, в каком понимаем их мы․ Для них это просто последовательности символов․ Чтобы применить к тексту математические алгоритмы и модели машинного обучения, нам необходимо преобразовать слова и документы в числовые векторы․ Этот процесс называется векторизацией, и он является одним из самых критически важных этапов в любом NLP-проекте․

Наш путь в векторизации начинался с самых простых методов и постепенно привел нас к использованию самых современных и мощных технологий, которые позволяют улавливать тончайшие нюансы смысла․ Давайте посмотрим, как мы превращаем язык в математику․

От CountVectorizer к TF-IDF: Первые Представления

Самый простой способ представления текста в виде чисел – это подсчет слов․ CountVectorizer из библиотеки Scikit-learn делает именно это․ Он создает словарь всех уникальных слов в нашем корпусе документов и затем для каждого документа формирует вектор, где каждая позиция соответствует слову из словаря, а значение – количеству вхождений этого слова в документ․ Это простая, но эффективная техника, которая дает нам базовое представление о частотности слов․

Однако, CountVectorizer имеет один недостаток: очень частые слова (например, "очень", "хороший"), которые встречаются во многих документах, могут доминировать в векторах, не неся при этом особой смысловой нагрузки․ Чтобы решить эту проблему, мы переходим к TF-IDF (Term Frequency-Inverse Document Frequency)․ TF-IDF не просто считает слова, а взвешивает их: он повышает вес слов, которые часто встречаются в конкретном документе (Term Frequency), но редко встречаются во всем корпусе (Inverse Document Frequency)․ Это позволяет нам выделить слова, которые являются уникальными и характерными для каждого документа․

Мы используем TfidfVectorizer из Scikit-learn, и он прекрасно себя зарекомендовал для задач, где важны уникальные термины, например, для поиска похожих документов или для классификации текстов․ Мы часто сравниваем эти два метода для разных задач, чтобы выбрать наиболее подходящий:

| Метод векторизации | Основная Идея | Преимущества | Недостатки | Типичное Применение |

|---|---|---|---|---|

| CountVectorizer | Подсчет частоты слов в документе․ | Простота, интуитивность, быстрота․ | Игнорирует важность слова в контексте всего корпуса․ | Базовая классификация, анализ частотности․ |

| TF-IDF Vectorizer | Взвешивание слов на основе их частоты в документе и редкости в корпусе․ | Выделяет уникальные для документа слова, улучшает релевантность․ | Не улавливает семантическую схожесть слов․ | Поиск релевантности, кластеризация, классификация․ |

Word Embeddings: Word2Vec, GloVe, FastText с Gensim

Хотя TF-IDF и эффективен, он не учитывает семантическую связь между словами․ То есть, для него "король" и "королева" — это такие же разные слова, как "король" и "стол"․ Здесь в игру вступают Word Embeddings – векторные представления слов, которые улавливают их семантическое и синтаксическое значение․ Слова с похожим значением будут расположены близко друг к другу в многомерном векторном пространстве․

Мы активно используем:

- Word2Vec: Это одна из первых и самых влиятельных моделей для создания встраиваний слов․ Она предлагает два основных подхода: Skip-gram (предсказывает контекстные слова по центральному слову) и CBOW (предсказывает центральное слово по контексту)․ Gensim предоставляет отличную реализацию Word2Vec, позволяя нам обучать собственные модели на наших данных или использовать предобученные․

- GloVe (Global Vectors for Word Representation): GloVe объединяет идеи Word2Vec и матричной факторизации, используя глобальную статистику ко-о встречаемости слов․

- FastText: Разработанный Facebook, FastText расширяет Word2Vec, учитывая подслова (n-граммы символов)․ Это делает его особенно эффективным для работы с редкими словами и языками с богатой морфологией, где новые слова могут быть составлены из известных частей․

Мы убедились, что использование Word Embeddings значительно повышает качество наших моделей машинного обучения, поскольку они предоставляют более "умное" представление текста, учитывающее его смысл․

Векторизация Предложений и Документов: Doc2Vec и Sentence Transformers

Помимо векторизации отдельных слов, нам часто требуется получить числовое представление целых предложений или даже документов․ Это необходимо для таких задач, как поиск похожих документов, кластеризация больших текстовых массивов или оценка сходства между запросами пользователей․

Для представления целых документов мы используем Doc2Vec (также известный как Paragraph2Vec), который является расширением Word2Vec․ Doc2Vec создает векторное представление не только для каждого слова, но и для каждого документа, учитывая контекст, в котором слова встречаются․ Это позволяет нам сравнивать документы по их семантическому содержанию, а не просто по общим словам․

В последние годы огромную популярность приобрели Sentence Transformers․ Это семейство моделей, основанных на архитектуре трансформеров, специально разработанных для создания высококачественных векторных представлений предложений и абзацев․ Они способны улавливать очень тонкие семантические нюансы и дают превосходные результаты в задачах поиска семантически похожих предложений, вопросно-ответных системах и кластеризации․ Мы активно используем Sentence Transformers для задач, требующих высокой точности в сравнении текстов․

Контекстные Встраивания и Трансформеры: Революция в NLP

Настоящая революция в NLP произошла с появлением контекстных встраиваний и, в частности, архитектуры Трансформеров․ До этого момента встраивания слов были статичными: одно и то же слово всегда имело один и тот же вектор, независимо от контекста․ Но мы знаем, что слово "банк" имеет разное значение в "банковский счет" и "берег реки"․ Контекстные встраивания решают эту проблему․

Модели, такие как BERT (Bidirectional Encoder Representations from Transformers), GPT (Generative Pre-trained Transformer) и их многочисленные преемники, произвели фурор․ Они обучаются на огромных объемах текста и способны генерировать встраивания слов и предложений, которые учитывают их уникальный контекст в каждом предложении․ Это позволяет им достигать беспрецедентной точности во множестве задач NLP, от распознавания именованных сущностей до вопросно-ответных систем и генерации текста․

Мы активно работаем с библиотекой Hugging Face Transformers, которая стала де-факто стандартом для использования этих моделей․ Она предоставляет тысячи предобученных моделей, разработанных ведущими исследовательскими лабораториями, и удобный API для их тонкой настройки (fine-tuning) под наши специфические задачи․ Будь то классификация текстов, генерация диалогов или машинный перевод, трансформеры – это то, что мы используем для достижения state-of-the-art результатов․

Продвинутые Приложения и Специализированные Задачи

После освоения основ и векторизации, мы переходим к более сложным и прикладным аспектам NLP․ Именно здесь начинается настоящее волшебство, когда мы используем все полученные знания для решения реальных бизнес-задач и создания интеллектуальных систем․ Мы покажем, как мы применяем наши навыки в самых разнообразных областях․

От автоматической категоризации документов до создания умных чат-ботов и анализа юридических текстов – возможности безграничны․ Мы постоянно расширяем наш арсенал, исследуя новые инструменты и подходы, чтобы наши решения были не только эффективными, но и инновационными․

Классификация Текстов: Scikit-learn и Глубокое Обучение с PyTorch/TensorFlow

Одна из наиболее распространенных задач в NLP – это классификация текстов, то есть присвоение тексту одной или нескольких предопределенных категорий (например, "спам/не спам", "позитивный/негативный отзыв", "новости/спорт/политика")․ Мы используем классификацию для автоматической категоризации статей, фильтрации контента и многих других задач․

Для начала мы часто обращаемся к библиотеке Scikit-learn․ Она предлагает широкий спектр классификаторов машинного обучения, таких как SVM (Support Vector Machines), наивный байесовский классификатор, логистическая регрессия․ Эти модели, в сочетании с TF-IDF или CountVectorizer, дают отличные базовые результаты и являются хорошей отправной точкой для многих проектов․ Мы ценим Scikit-learn за его простоту использования и надежность․

Когда задачи становятся более сложными, а объемы данных – больше, мы переходим к глубокому обучению, используя фреймворки PyTorch или TensorFlow/Keras․ Для классификации текстов мы строим нейронные сети, такие как LSTM (Long Short-Term Memory) или сверточные нейронные сети (CNN), которые способны улавливать долгосрочные зависимости в тексте․ С появлением трансформеров мы также активно используем их для классификации, часто тонко настраивая (fine-tuning) предобученные модели BERT или RoBERTa на наших данных, что дает наилучшие результаты․

Разработка Чат-ботов и QA-систем: От Rasa до Генеративных Моделей

Чат-боты и системы вопросно-ответных систем (QA) – это, пожалуй, одни из самых заметных применений NLP в повседневной жизни․ Мы занимаемся разработкой таких систем, которые могут общаться с пользователями, отвечать на их вопросы и выполнять задачи․

Для создания сложных, многофункциональных чат-ботов мы часто используем фреймворк Rasa․ Rasa позволяет нам строить контекстно-зависимые диалоговые агенты, которые могут понимать намерения пользователя (intent recognition) и извлекать важные сущности из их сообщений (entity extraction), а затем управлять диалогом․ Это открытый и гибкий инструмент, который дает нам полный контроль над логикой бота․

Для более продвинутых QA-систем и чат-ботов, которые должны генерировать ответы, а не просто выбирать их из базы знаний, мы обращаемся к генеративным моделям на основе трансформеров․ Модели типа GPT-2, GPT-3 и их вариации могут генерировать удивительно связные и релевантные ответы, создавая впечатление естественного общения․ Мы используем Hugging Face Transformers для работы с этими моделями, разрабатывая системы, которые могут отвечать на вопросы, суммировать информацию и даже вести свободный диалог․

Работа с Многоязычными Данными: Polyglot, Stanza, Специфика

Мир не ограничивается одним языком, и наши проекты тоже․ Мы часто сталкиваемся с необходимостью обработки текстов на разных языках, каждый из которых имеет свои уникальные лингвистические особенности․ Работа с многоязычными корпусами требует особого подхода и специализированных инструментов․

Для базовых мультиязычных задач, таких как определение языка, токенизация и лемматизация для различных языков, мы используем библиотеку Polyglot․ Она предоставляет удобный интерфейс для работы с множеством языков․ Когда нам нужна более глубокая и точная лингвистическая обработка, особенно для языков с богатой морфологией (например, русский, немецкий), мы обращаемся к Stanza (разработанной Stanford NLP Group)․ Stanza предлагает высокоточные предобученные модели для POS-теггинга, анализа зависимостей и NER для десятков языков, включая русский, обеспечивая глубокий синтаксический анализ․

Мы также используем Hugging Face Transformers, так как многие предобученные модели (например, mBERT, XLM-RoBERTa) являются мультиязычными и отлично справляются с задачами NER, классификации и машинного перевода для большого количества языков, позволяя нам строить универсальные решения․

Веб-Скрейпинг и Извлечение из PDF: Beautiful Soup, PyMuPDF

Прежде чем мы сможем анализировать текст, нам его нужно получить․ Часто это означает извлечение данных из различных источников, таких как веб-страницы или PDF-документы․ Мы регулярно используем инструменты для веб-скрейпинга и извлечения текста из неструктурированных форматов․

Для веб-скрейпинга текста мы полагаемся на библиотеку Beautiful Soup в сочетании с requests․ Beautiful Soup позволяет нам легко парсить HTML- и XML-документы, находить нужные элементы по тегам, классам или идентификаторам и извлекать из них текстовое содержимое․ Это незаменимый инструмент для сбора больших объемов текстовых данных для обучения наших моделей или для анализа контента с сайтов․

Когда речь заходит об извлечении текста из PDF-документов, мы используем библиотеку PyMuPDF (также известную как Fitz)․ Она очень быстрая и эффективная, позволяя нам извлекать текст, изображения и даже метаданные из PDF-файлов․ Это особенно полезно при работе с юридическими документами, научными статьями или отчетами, которые часто распространяются в формате PDF․